基于分块特征点密度的多特征融合遥感图像场景分类

蒋亚平,李会敏

基于分块特征点密度的多特征融合遥感图像场景分类

蒋亚平,李会敏

摘 要:随着遥感等对地观测技术的发展,遥感图像分辨率越来越高。相比于中低分辨率遥感图像,高分辨率遥感图像能够提供更详细的地面信息,但各种地物空间结构分布较复杂。针对高分辨率遥感图像中的不同目标,各种特征有效性不尽相同、彼此存在互补现象,提出了一种分层多特征融合的场景分类方法。该方法首先对图像进行预分类,粗分为特征点分布均匀与不均匀两大类;然后,对分布均匀类别提取颜色直方图特征和Gabor纹理特征,对分布不均匀类别提取ScSPM(基于稀疏编码的空间金字塔匹配)特征;最后分别训练支持向量机分类器对测试图像进行分类。在一个2100幅图像构成的大型遥感图像数据库上的实验结果表明,提出的算法比仅用单一特征分类方法的最高精度提高了10%;与其他融合方法相比,提出的方法取得了最高分类精度,达到了90.1%;算法时间复杂度也大为降低。

关键词:高分辨率遥感图像;颜色直方图;纹理特征;ScSPM;多特征融合

0 引言

近年来,高分辨率对地观测技术得到了迅猛发展,已经在土地调查、城市规划和军事等诸多领域发挥了重要的作用。相比于中低分辨率遥感图像,高分辨率遥感图像能够提供详细的地面信息,但各种地物空间结构分布较复杂[1]。随着遥感图像分辨率的提高,空间地物几何信息、纹理信息等更加明显,但同时也带来了同类地物的光谱差异性增强,不同地物的光谱异质性降低等问题。因此,虽然高分遥感影像提供了更为精细的地表刻画,但自动化信息提取任务的难度大大增加。在遥感图像技术中,无论是专业信息提取、运动变化预测还是遥感数据库的建立都离不开分类,如何研制出新的适合于遥感图像分类的方法来提高分类精度是急需解决的问题。传统的遥感图像目视解译方法不仅要求丰富的专业经验和充足的野外实地调查资料,而且由于这种识别方法是建立在特定的先验知识基础上,因此识别难度较大,效率较低[2]。根据图像描述方式的不同,当前图像分类方法大致可以分为:基于全局特征的描述方法和基于局部特征的的描述方法。常见的全局特征包括:颜色直方图[3]、LBP(Local binary pattern)、Gabor纹理特征[4]等。由于全局特征的对象通常是整幅图像,因而不能较好地描述图像中的局部目标,因此对飞机、网球场等特征点分布较稀疏的类别图像分类精度较低。基于局部特征的图像描述方法,由于可以在同一类别千变万化的图像中寻找不变的特征,因而受到广大研究者青睐。

2004年,Csurka等学者[5]首次将词包模型用于图像场景分类,并提出了图像场景分类的视觉词包模型算法。Lazebnik等人[6]在视觉词包模型中加入空间金字塔匹配核,提出空间金字塔核的词包模型。Yang等[7]提出稀疏编码方法,大大提高了识别精度。文献[8]使用硬分配编码取代稀疏编码,使用监督字典学习算法对Bof特征进行压缩以弥补编码方法所带来的不足。Bolovinou等人[9]提出了基于有序空间结构关系的视觉单词,在特征表达中加入了上下文信息。

由于遥感图像地物信息极其丰富,但各种地物空间分布较复杂,同类目标呈现较大光谱异质性,基于像元的分类技术容易造成较多的错分、漏分现象,从而导致分类精度较低。对于图像中的不同目标、各种特征有效性不尽相同,彼此存在互补的现象[10],多特征融合能改善这种情况。因此,合理、高效地利用遥感数据,融合图像低层特征,将人工智能及知识发现等技术运用于遥感图像分类中,已成为新的研究热点。本文提出了一种分层多特征融合方法。该方法首先对图像分类挑选重要特征,分别计算每类基于分块特征点的密度对图像进行预分类,粗分为特征点分布均匀与不均匀两大类;然后,对分布均匀类别提取颜色直方图特征和Gabor纹理特征,对分布不均匀类别提取ScSPM特征;最后采用支持向量机分类器对测试图像进行分类。在一个2100幅图像构成的大型公共测试数据集上的实验结果表明,本文方法比仅用单一特征分类方法的最高精度提高了10%;与其他融合方法相比,本文方法取得了最高分类精度,达到了90.1%;算法时间复杂度也大为降低。

1 基于分块特征点密度的图像预分类

关于遥感图像场景分类技术的研究目前已经出现了很多方法。在早期,遥感图像场景分类主要采用基于低级特征的方法,由于低级特征的局限性导致分类准确率较低,已不再是场景分类的研究热点;近年来主要采用基于视觉词汇的方法,且该方法由于其有效地描述了场景图像语义,并具有较高的分类正确率,正日益成为研究的热点。Lazebnik等人[6]在视觉词包模型中加入空间金字塔匹配核,提出空间金字塔核的词包模型,为后来的研究提供了基础。Bolovinou等人[9]提出了基于有序空间结构关系的视觉单词,在内容表达中加入了上下文信息,但是这种方法计算量较大,不适用于大规模场景图像分类。Zheng等人[13]基于颜色相关图的思想,提出空间相关图概念并将其应用于视觉词包特征表达,该方法虽然提升了场景分类的性能,但相关图的特征表达方式增加了存储和计算的需求量。

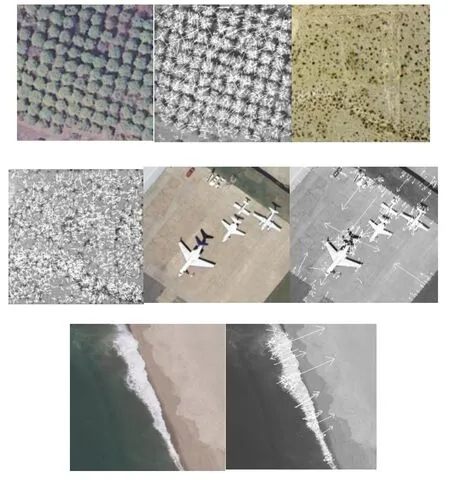

由于高分辨率遥感图像覆盖的场景范围比较广泛,包含的背景内容较复杂,地物目标分布变化多样,使得对于图像场景内容的描述和分类变得较为困难。对于图像中的不同目标、各种特征有效性不尽相同,若仅用单一特征对所有类别图像进行分类则会导致分类精度较低,因此充分利用遥感图像的特点对不同类别图像提取合适的特征很重要。我们可以看到,对农田和灌木丛类图像提取SIFT[14]特征,这两类图像的特征点在整幅图像上分布较均匀;并且从这两类彩色图像上可以看出颜色和纹理信息较明显,如图1所示:

图1 农田、灌木丛、飞机和海滨类图像特征点分布情况

如果对这类图像提取局部特征,则会丢失较多的图像信息;对飞机和海滨类图像提取SIFT特征,这两类图像特征点在整幅图像上分布较稀疏,其中飞机类图像特征点仅分布在飞机局部形状上,海滨类图像特征点仅分布在海水与沙滩的分界线上;与此同时从这两类彩色图像上我们看到飞机的局部模型较为明显、海岸线与海水以及沙滩的分界线较明显,因此对这类图像提取局部特征较好,如果对这类图像提取全局特征,则会增加一些不必要的干扰特征,降低分类精度。因此不同类别图像的特征点分布情况不一致,有些类别图像的显著特征点较均匀的分布在整幅图像上;还有一些则分布在局部、单个目标上,特征点在整幅图像上分布较稀疏。针对遥感图像的这种特点,我们可以先将图像进行预分类,分为特征点分布均匀与不均匀两大类。该算法具体过程如下:

(1)提取训练集中各图像的局部不变SIFT特征描述子,利用矢量量化方法对局部特征点集进行聚类[15],每个聚类中心表示一个视觉单词,所有聚类中心形成视觉单词码本(codebook);

(2)将各个图像的局部特征分配给视觉单词库中与其距离最近的视觉单词,然后统计各个视觉单词对应的词频,形成图像的视觉词袋特征表示;

(3)统计每一类场景所有图像的视觉词袋特征中各个视觉单词的词频的相加总和,并将各个视觉单词的词频进行排序,由于不同目标所提取特征不一样,这些特征有些对分类有用,有些对分类没有效果,因此选择每类图像的重要特征对于图像预分类具有很重要的意义。本文方法是从每类场景图像的视觉词袋特征表示中取出词频较大的前N个视觉单词。将各类别中词频较大的前N个视觉单词进行合并,并统计各个视觉单词的词频的相加总和,即得到类场景的总体视觉词袋表示。然后统计各类别中每幅图像含有与该总体词袋表示中视觉单词对应的特征即为重要特征。

(4)统计每类场景中每幅图像重要特征的个数,并计算每幅图像在3*3的图像块上每个分块中特征点密度分布情况,若每个分块区域密度分布情况接近,则将该幅图像判定为分布均匀,反之则为分布不均匀。

经过上述处理,将图像库中的图像分为两大类:特征点分布均匀与不均匀,然后分别提取不同特征进行细分类。接下来先介绍特征提取。

2 特征提取

图像特征提取作为图像表示的第一步,对图像的语义表示以及最终的图像分类结果至关重要,基于上节中讨论的分布均匀类别图像特征点分布在整幅图像上以及分布不均匀类别图像特征点分布在局部图像上的特点,我们提出对分布均匀类别图像提取全局特征,对分布不均匀类别图像提取局部特征。

2.1 颜色直方图

图像的颜色特征是一种全局特征,对图像本身的尺寸、方向、视角的依赖性较小[16],并且在遥感图像的分布均匀类别(例如农田、森林、活动房等)图像中分布较明显。颜色直方图描述的是不同色彩在整幅图像中所占的比例。本文基于HSL(Hue,Saturation,Lightness)色彩空间提取颜色直方图特征,相比于RGB色彩空间,前者更符合人眼的视觉感知特性。具体提取方法如下:

对于图像的每一个像素,首先将其H、S、L分量分别量化为8等份,这样HSL直方图就有512个间隔(bin),然后统计所有像素的直方图,最后采用L1范式对其进行归一化,以消除图像不同幅面大小的影响。

2.2 Gabor纹理特征

纹理是遥感图像的一种重要空间信息,随着分辨率的提高,地物的内部结构越来越清晰,这在遥感图像中表现为地物的纹理结构越来越明显。相对于光谱信息,纹理特征能反映目标地物内像元有规则的空间变化。鉴于Gabor滤波器具有较强的纹理描述能力,本文利用Gabor滤波器提取纹理特征,提取方法如下:

2.3 基于稀疏编码的空间金字塔匹配模型

BOF[17]模型是比较经典的局部特征提取方法,它采用硬指派方法对局部描述子进行编码[18],缺点是忽略了局部特征的空间位置排列信息。由于遥感图像地物信息极其丰富,视觉词包模型在编码过程中只能将特征描述子分配给最邻近的一个视觉词,这样容易丢失遥感图像的重要信息,因此本文采用基于稀疏编码的空间金子塔匹配模型特征来保留遥感图像更多的局部信息。

稀疏编码[19]是目前比较流行的基于表现属性的图像表示方法。该方法是基于过完备字典来选择少量原子信号对原始信号进行重建,过完备字典作为所有信号的表示基础,能尽可能的包含更多、更全面的信息。本文提取方法如下:

从密集的网格图像(dense sampling)中提取SIFT描述符,利用稀疏编码方法对SIFT特征进行编码。编码后采用预先选好的汇集函数[20]计算图像特征,与空间金字塔匹配模型相似,通过对图像进行多尺度划分,最后进行串接即可得到图像的向量表示。

3 融合多特征的图像分类算法

由于遥感图像中同一类别图像的显著特征有些既表现在纹理上也表现在颜色直方图特征上,如果仅用单一特征则无法很好地表达图像语义内容,因此进行多特征融合是有效提高分类性能的关键。图1中农田类图像的纹理特征较明显,同时颜色直方图特征也较均匀。如果仅采用单一特征对所有类别进行分类很容易造成一类场景图像的显著特征丢失,从而降低分类精度。因此本文中对于分布均匀类别图像采用颜色直方图特征和纹理特征串接后的特征。

本文针对遥感图像中复杂目标的特点,首先对分布均匀的类别图像提取颜色直方图特征和纹理特征并采用(2)式串接,再进行归一化,以消除不同特征对图像的影响;对分布不均匀的类别图像提取局部特征即采用基于稀疏编码的空间金字塔匹配模型表示图像。具体多特征融合算法步骤如下:

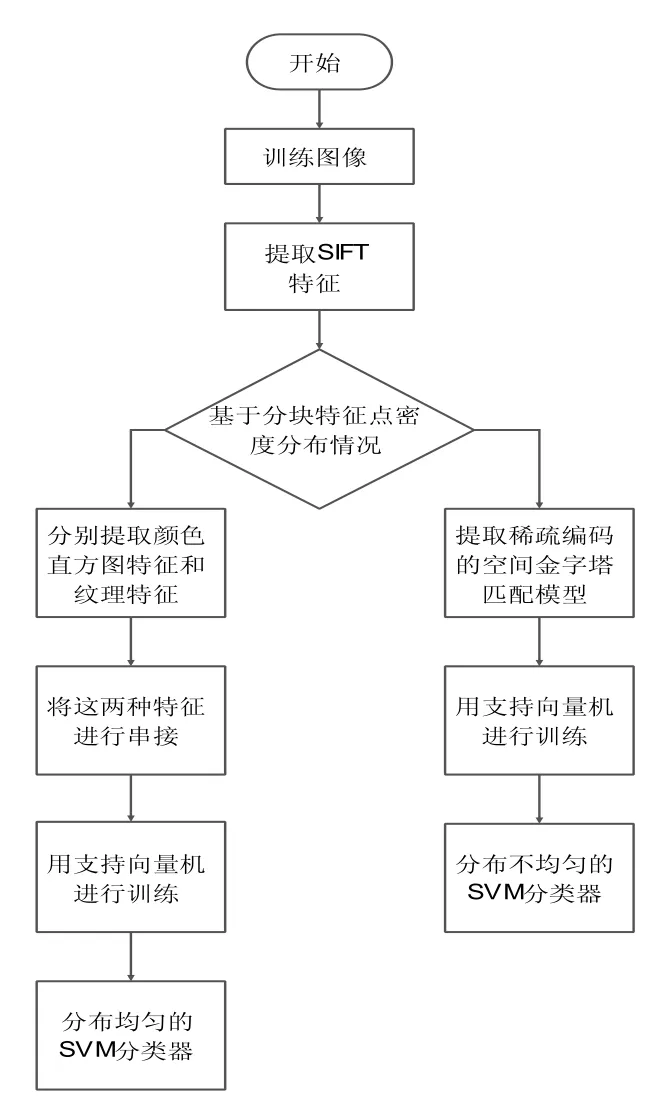

(1)训练过程:首先对训练样本图像提取SIFT特征,并且对该特征计算基于分块特征点的密度对图像进行预分类,粗分为特征点分布均匀与不均匀两大类。对分布均匀类别图像提取颜色直方图特征和Gabor纹理特征,并将这两种特征采用(2)式进行串接,对分布不均匀的类别图像提取局部特征ScSPM特征,然后分别采用支持向量机进行训练,得到两个分类器,分别记为分布均匀分类器和分布不均匀分类器。

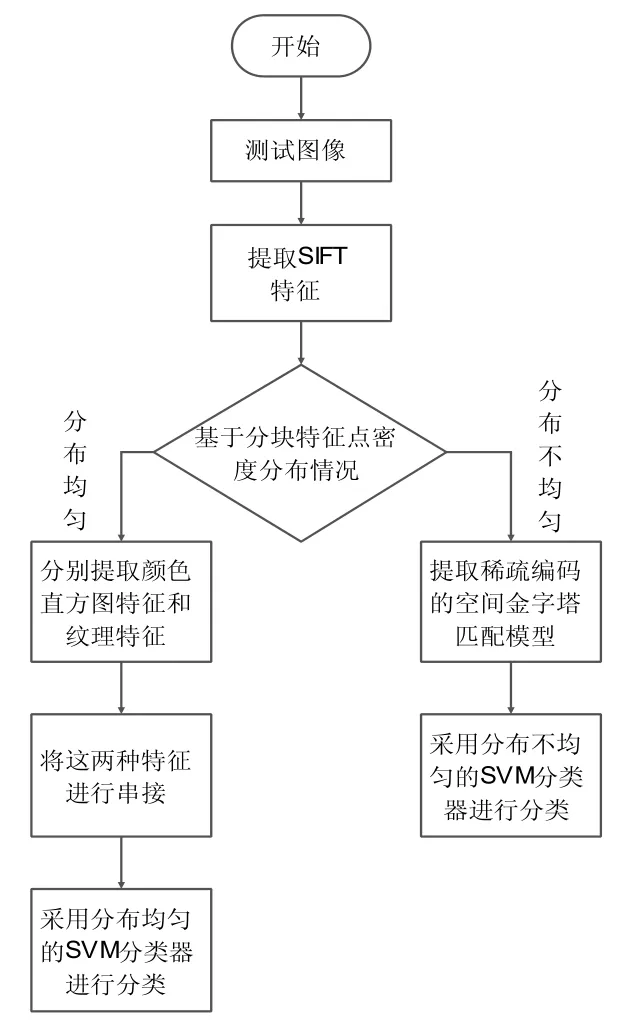

(2)测试过程:对测试样本图像提取SIFT特征并计算基于分块特征点的密度判断该图像各分块特征点是否分布均匀,如果分布均匀则对该待测图像提取颜色直方图特征和Gabor纹理特征,并将这两种特征进行串接,最后采用分布均匀分类器进行分类;如果分布不均匀则对该待测图像提取局部特征ScSPM特征并采用分布不均匀分类器进行分类。

本文训练、测试过程具体流程分别如图2、图3所示:

图2 训练过程流程图

图3 测试过程流程图

4 实验结果及分析

本文算法实现的硬件配置为i5处理器、64位操作系统;算法实现编程环境为Matlab2010b和Visual C++6.0。

4.1 实验数据

本文采用的数据集是国际上公共的大型遥感图像分类测试数据集[21],它涵盖自然与人工场景共21种类别,每种类别图像数目为100,图像的平均尺寸大小为256*256像素,这些图像从United States Geological Survey(美国地质勘探局)网站下载,其中包括的场景有:农田、飞机、棒球场、海滨、建筑物、丛林、密集住宅区、森林、高速公路、高尔夫球场、港口、十字路口、中密度住宅区、活动房、天桥、停车场、河流、跑道、稀疏住宅区、储油罐、网球场。这些图像反映了每类场景图像的不同情景,并具有良好的代表性。在下面实验中,若无特别说明,从每类中随机提取80幅图像作为训练样本,剩下的20幅图像作为测试样本。

4.2 单一特征分类结果

从每类中随机提取80幅图像作为训练样本,利用支持向量机进行训练,剩余20幅作为测试样本。各个特征信息如下:Color颜色直方图特征向量维数为512;Gabor纹理特征向量维数为60维;ScSPM特征向量维数为21504维。

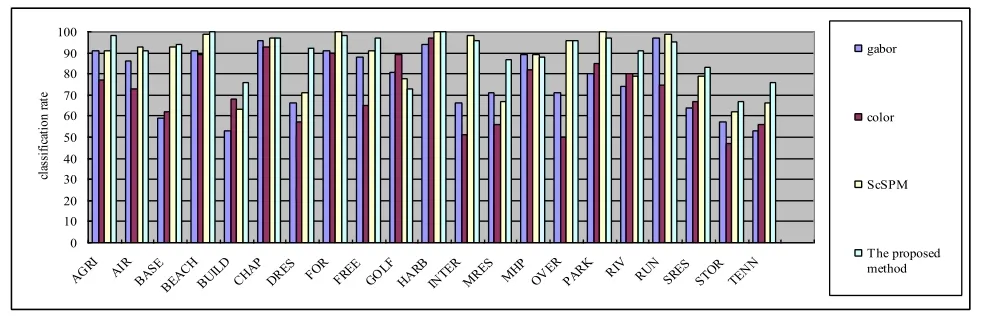

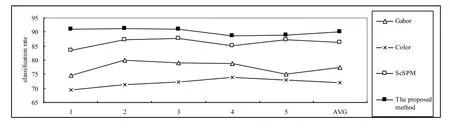

分类结果如图4所示:

图4 本文方法与单一特征对于各类别的分类精度

从图4中我们可以看出,颜色直方图特征在建筑物、高尔夫球场、河流分类问题中的分类正确率较其他类别高,这是由于这些类别图像的颜色特征在整幅图像中分布较明显;在十字路口和立交桥分类问题上表现很差。Gabor特征在农田、中密度住宅区分类问题中的分类精度较其他类别高,这是由于这些类别图像中纹理较清晰;在建筑物、停车场、河流分类问题上表现很差。ScSPM特征在飞机、海滨、跑道等分类问题中表现最好,这是由于这类图像具有绝对空间排列,其中对于海滨类图像中,尽管有一些特殊方向上的海岸线不好辨别,但是可以通过同一图像区域的沙滩或者浪花来分辨图像类别,对于跑道类图像也是如此;对于建筑物、高尔夫球场分类问题表现略差。

虽然每一种特征都具有其表现较好的几种类别,但是总体平均分类精度并不高,因此不能满足实际中对分类精度的要求。

4.3 本文多特征融合结果

本文多特征融合算法的分类结果如图5所示:

图5 本文方法与单一特征的总体平均分类精度性能对比

从图5中可以看出本文方法除了飞机、森林、高尔夫球场、十字路口、停车场和跑道类别图像外,其他类别图像的分类精度均高于使用单一特征进行分类时的最大分类精度,这充分说明了对于图像中的不同目标、各种特征有效性不尽相同,彼此间存在互补性。本文方法对于海滨和港口类分类性能较单特征方法具有明显的改善,达到了100%,而对于建筑物、高尔夫球场、储油罐、网球场等类别的分类精度较低,是因为这些类别图像的空间结构分布较复杂、图像类内间分布差异较大。

单一特征与本文方法的5次平均分类精度性能对比曲线图,从图中可以看出,本文方法的总体平均分类精度最高,达到90.1%。良好的分类精度证明了本文算法更具有鲁棒性。

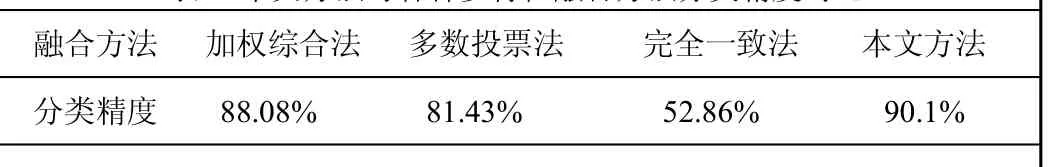

本文方法与几种常见融合方法的分类精度对比,如表1所示:

表1 本文方法与各种多特征融合方法分类精度对比

从表1中可以看出本文方法显著优于完全一致法和多数投票法,且比加权综合法高2%,说明了本文方法是一种较有效的多特征融合方法。

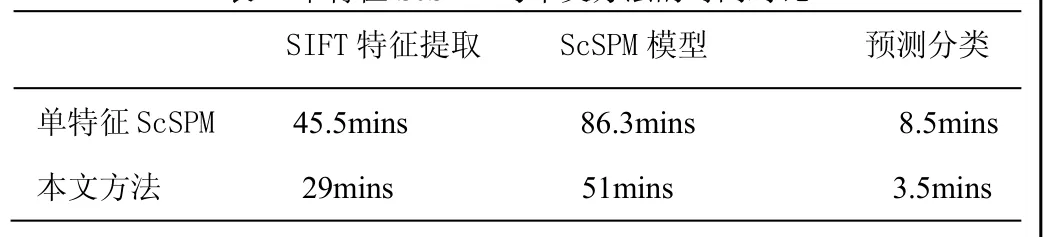

4.4 时间性能

ScSPM稀疏特征提取和分类是目前各种特征表示中最好的方法之一,但时间复杂度较高,本文通过分层分类的策略不仅提高了分类精度,而且降低了整体分类的时间复杂度。单特征ScSPM与本文方法中对分布不均匀的类别提取ScSPM特征和预测分类的时间性能比较结果如表2所示:

表2 单特征ScSPM与本文方法的时间对比

从表2可以看出,本文方法的时间性能较原始ScSPM方法好,随着图像数据集的类别数降低,本文方法的时间复杂度也降低。

5 总结

本文采用基于支持向量机多特征融合对遥感图像进行分类,提出了一种分层多特征融合的方法,该方法利用图像中分块特征点密度是否均匀对图像进行预分类,充分发挥各种特征在不同类别样本中的分类优势,从总体上提高了分类精度,并提高了算法效率。与目前流行的几种单一特征方法和几种常见的融合方法进行比较,在一个大型的遥感图像公共测试集上进行了对比实验,证明了本文方法的优越性。由于对分布不均匀的类别提取ScSPM特征的维数超过20000维,算法时间复杂度较高。如何进一步降低稀疏编码方法的计算复杂度是今后需要改进的方向之一。

参考文献

[1] 秦昆,陈一祥,甘顺子,等. 高分辨率遥感影像空间结构特征建模方法综 [J]. 中国图象图形学报,2013,18(9): 1055 -1064.

[2] 张锦水,何春阳,潘耀忠,等. 基于SVM的多源信息复合的高空间分辨率遥感数据分类研究 [J]. 遥感学报,2006,10(1):49-57.

[3] Swain MJ,Ballard DH. Color indexing [J]. International Journal of Computer Vision, 1991,7(1):11-32.

[4] Lee TS. Image representation using 2D gabor wavelets [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,1996,18(10):1-13.

[5] Csurka G,Dance CR,Fan L,et al. Visual categorization with bags of keypoints [C] // Proceedings of Workshop on Statistical Learning in Computer Vision. Prague,Czech Republic:Springer,2004:1-22.

[6] Lazebnik S,Schmid C,Ponce J. Beyond bags of features:Spatial pyramid matching for recognizing natural scene categories [C] // Computer Vision and Pattern Recognition. New York,USA:IEEE Computer society,2006:2169-2178.

[7] Yang JC,Yu K,Gong YH,et al. Linear spatial pyram id matchingusing sparse coding for image classification [C] // Proceedingsof the 22nd International Conference on Computer Vision and Pattern Recognition.M iami,USA: IEEE Computer Society,2009:1794-1801.

[8] Ji RR,Yao HX,Liu W. Task-dependent visual-codebook compression [J]. IEEE Transactions on Image Processing,2012,21(4):2282-2293.

[9] Bolovinou A,Pratikakis I,Perantonis S. Bag of spatio-visual words for context inference in scene classification [J]. Pattern Recognition,2013,46(3):1039-1053.

[10] 张春霞,张讲社. 选择性集成学习算法综述 [J]. 计算机学报,2011,34(8):1399-1410.

[11] 彭正林,毛先成,刘文毅,等. 基于多分类器组合的遥感影像分类方法研究 [J]. 国土资源遥感,2011,89(2):19-25.

[12] 杨艺,韩崇昭,韩德强. 利用特征子空间评价与多分类器融合的高光谱图像分类 [J]. 西安交通大学学报,2010,44(8):20-24.

[13] Zheng Y,Lu H,Jin C,et al. Incorporating spatial correlogram into bag-of-features model for scene categorization [C] // Proceedings of the 9th Asian Conference on Computer Vision. Xi an,China:Springer,2010:333-342.

[14] Lowe DG. Distinctive image features from scale-invariant key-points [J]. International Journal of Computer Vision,2004,60(2):91-110.

[15] MacQueen JB. Some methods for classification and analysis of multivariate observations [C] // Proceedings of 5-th Berkeley Symposium on Mathematical Statistics and Probability. Berkeley:University of California Press,1967:281-297.

[16] 陆丽珍,刘仁义,刘南. 一种融合颜色和纹理特征的遥感图像检索方法 [J]. 中国图象图形学报,2004,9(3):328 -332.

[17] Sivic J,Zisserman A. Video google:A Text Retrieval Approach to Object Matching in Videos [C] // Proceedings of IEEE International Conference on Computer Vision. Nice,France:IEEE Computer Society,2003:1470-1477.

[18] 梁晔,于剑,刘宏哲. 基于BoF模型的图像表示方法研究[J]. 计算机科学,2014,41(2): 36-44.

[19] Gemert JCV,Geusebroek JM,Veenman CJ,et al. Kernel codebooks for scene categorization [C] // Proceedings of European Conference on Computer Vision. Marseille,Fran -ce: Springer,2008:696-709.

[20] Jarrett K,Kavukcuoglu K,Ranzato M,et al. What is the Best Multi-stage Architecture for Object Rcognition [C] // Computer Vision. IEEE 12th International Conference on Computer Vision,2009:2146-2153.

[21] Yang Y,Shawn N. Spatial pyram id co-occurrence for image classification [C] // Computer Vision. TEEE International Conference on Computer Vision,2011:1465-1472.

Remote Sensing Image Classification Based on Fusion of M ultip le Features w ith Block Feature Point Density Analysis

Jiang Yaping, Li Huimin

(College of Computer and Information, Hohai University, Nanjing 210098, China)

Abstract:With the development of remote sensing and the related techniques, the resolution of these images is largely improved. Compared with moderate or low resolution images, high-resolution images can provide more detailed ground information. However,a variety of terrain has complex spatial distribution. The different objectives of high-resolution images have a variety of features. The effectiveness of these features is not the same, and some of them are complementary. Considering the above characteristics, a new method is proposed to classify remote sensing images based on the hierarchical fusion of multi-feature. Firstly, these images are pre-classified into two categories in terms of whether feature points are uniform or non-uniform distributed. Then, the color histogram and Gabor texture feature are extracted from the uniform distributed categories, and the ScSPM(linear spatial pyramid matching using sparse coding) feature is obtained from the non-uniform distributed categories. Finally, the classification is performed by the two different support vector machine classifiers. The experimental results on a large remote sensing image database with 2100 images show that the overall classification accuracy is boosted by 10% in comparison w ith the highest accuracy of single feature. Compared w ith other methods of multiple features fusion, the proposed method has achieved the highest classification accuracy which has reached 90.1%, and the time complexity of the algorithm is also greatly reduced.

Key words:Remote Sensing Image; Color Histogram; Gabor Texture Feature; ScSPM; Multi-feature Fusion

中图分类号:TP311

文献标志码:A

文章编号:1007-757X(2016)05-0001-05

基金项目:国家自然科学基金(61170200)

作者简介:蒋亚平(1990-),女,河海大学计算机与信息学院,硕士研究生,研究方向:图像处理,南京,211100李会敏(1990-),女,河海大学计算机与信息学院,硕士研究生,研究方向:图像处理,南京,211100

收稿日期:(2016.04.12)