改进的最大相似度区域目标分割算法

徐 杰,许存禄,邢 磊,马晓滢

(兰州大学 信息科学与工程学院,甘肃 兰州730000)

0 引 言

基于阈值的图像分割方法关键问题是根据某一准则函数求解最佳灰度阈值,但过程较为复杂[1],因此对基于阈值的分割方法研究遇到瓶颈。宁季锋等[2]提出的基于最大相似度区域融合的交互式图像合并算法在图像目标分割方面取得较好的处理效果,优点是根据图像空间内容自适应获取最大相似度而无需进行参数控制,即克服了传统阈值分割算法需要求解最佳灰度阈值的缺陷。算法核心思想是先使用均值漂移过分割图像获取初始特征值图像,再采用最大相似度区域融合进行特征值图像合并,但是在目标与背景存在模糊区域的情况下,由于空间特征值相似,此时使用均值漂移分割很难准确分割目标与背景小区域,从而使最大相似度区域融合不精确导致目标分割效果不够理想。

本文在分析宁季锋等工作的基础上,提出对最大相似度区域融合的改进算法,使用导向滤波算法[5]对原始模糊图像进行重建,对原始模糊图像做了细节增强处理,再用颜色分割[3]对重建图像去除冗余信息,缩短了目标分割时间,与传统MSRM 算法分割结果的比较验证了本文改进算法在模糊图像目标分割上更优。

1 最大相似度区域分割理论

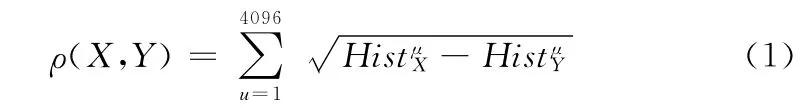

均值漂移算法分割图像得到具备目标与背景部分特征的小区域,为区域融合提供前提[4],假设目标与背景区域特征值相近,则难以分割出小区域或者分割出的小区域同时具备目标与背景特征而使区域融合不准确。该模型采用RGB颜色直方图表示每个区域,区域融合的关键在于如何确定标记区域与未标记区域的相似度,因此,在区域X 和Y 之间存在了一个相似性度量标准ρ(X,Y),使用Bhattacharyya系数测量X 和Y 之间的相似度

式中:4096 箱格——每个区域直方图的量化值,HistuX、——X、Y 的颜色直方图,μ——对应直方图的上标。

用户可以粗糙的对目标和背景进行标记,传统算法需要对标记的目标进行相似性计算,相似度达到某一阈值才进行合并,由于阈值不是固定的,所以会导致目标与背景的分割混淆。自适应的基于极大相似度的合并算法根据标记可以辨别目标和背景区域而不需要计算阈值。合并规则如下:假设Y 是X 的相邻区域,={}i=1,2...q是Y 的邻域集合,此时计算出相似度的ρ(Y),i=1,2...,q,X 是珚SY的子集,当满足式 (2)时,合并X、Y[5]

最大相似度区域合并算法过程可以分为两步:

(1)把标记的背景区域与邻域合并,对于每个区域E∈ME,邻域集合为={Fi}i=1,2.,..,r,假设FiME,我们得到Fi的邻域集合={}j=1,2.,..,k,可得E ∈,计算Fi与中每个元素的相似度ρ(Fi,SFij),当E 和Fi满足式 (2)时,下式成立

E 与Fi合并为一个区域,该区域与E 有相同的标记,即必须满足:E =E ∪Fi。

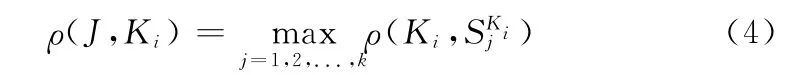

(2)对于未标记区域J ∈N (未标记区域),其对应邻域集合为={Ki}i=1,2.,..,j,对于每一个Ki,KiME(背景标 记 区 域),KiMO(目 标 标 记 区 域),={}j=1,2.,..,k,J ∈,计算Ki和的每个元素的相似度ρ(Ki,),假如J 和Ki满足式 (2),则有

J 与Ki合并为一个区域,该区域P 有相同的标记,即必须满足:J =J ∪Ki。

上述方法在图像区域的目标与背景部分特征不明确的情况下E 与Fi和J 与Ki无法合并为一个区域。

2 改进的最大相似度区域目标分割算法

2.1 导向滤波

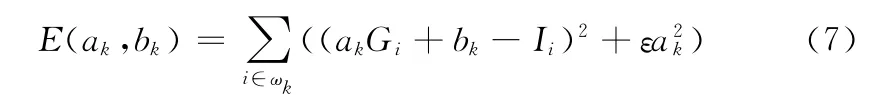

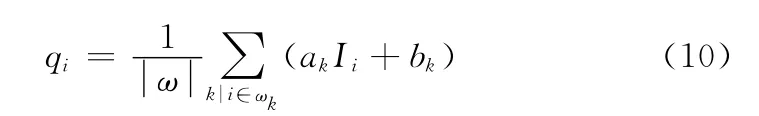

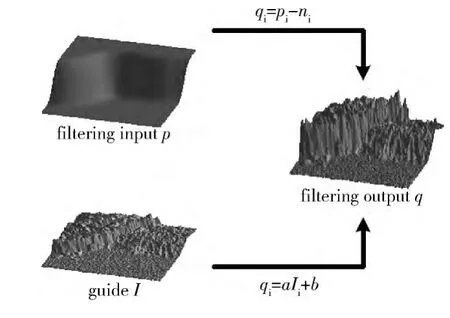

导向滤波器的主要过程集中于简单的方框模糊,而方框模糊的重量和半径无关的快速算法,在图像去雾、模糊区域锐化处理方面有较强的实用性,并能很好保持边缘信息。首先定义导向图像为G,输入图像为I,输出图像为O,G 和I 是一个局部线性模型,假设O 是G 中心在像素k的窗口ωk的线性转换

ak、bk与ωk有相同的线性系数。一个半径为r的方形窗口,这个局部线性模型决定了G 有一个边缘,那么O 就有一个边缘,因为 O =aG,这个模型在图像去雾、图像抠图中很有用[6]。为了约束ak、bk,Oi和Ii需满足以下条件

我们在保持线性模型的前提下寻求一个减小O 和I 之间差异的方法。我们最小化窗口ωk的函数

其中,ε是ak的正则化参数,方程 (7)的模型的解是

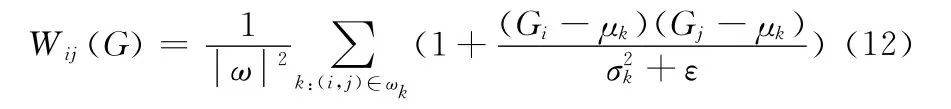

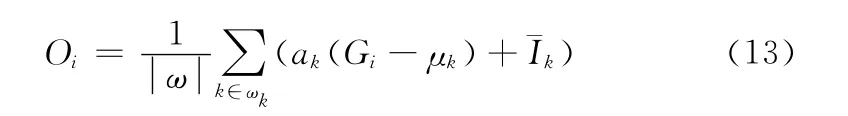

其中,μk、分别是导向图像G 的窗口函数ωk的均值和方差,是ωk的像素数,是I在ωk中的平均值,获得 (ak、bk)后可以计算出Oi。然而,像素i与覆盖i的所有的重叠窗口ωk相关,所以当用不同的窗口计算时,Oi的值是不相同的。平均所有的Oi的可能值。所以,计算了所有图像窗口ωk的 (ak、bk)值后,我们计算滤波结果Oi

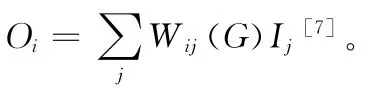

I和O 存在线性关系,决定了滤波核Wij=Oi/Ij,式 (9)带入式 (11)得到

对式 (13)求导得到

在这个等式中

当j在窗口ωk中的时候,δj∈ωk=1,否则,δj∈ωk=0[8,9],式 (14)带入式 (8)中求偏导得

把式 (15)、式 (16)带入式 (14)可得

Oi/Ij就是导向滤波的核Wij,最终由Wij计算得出的输出图像如图1所示。

图1 导向滤波输出图像O

输出图像O 对原模糊图像I 进行细节增强并与I 有线性关系,确保增强图像完全具备原模糊图像I 的特征值。属于窗口ωk的像素j 和与窗口ωk相关联像素i 通过式(14)、式 (16)确定δj∈ωk的值,假设等于1,则i、j同属一个区域,否则属于不同区域,由此判断经过均值漂移过分割的小区域属于目标还是背景区域。

2.2 颜色分割

由导向滤波获取的输出图像O 作为颜色分割输入图像,扩展至离散空间,尺寸任意获取,矢量简单化[10,11]。一般的变换图像C(x,y)的吸引区域为

式中:集合R=domain (C (u,v))\ {(x,y)},r→=(v-x)i→+ (w-y)j→,对于图像中的每一个像素,变换的结果分析了附近像素的强度,并产生一个矢量。和每个像素相关联的是σg,它反映了每个像素属于哪个区域,σs控制了附近像素的计算。

变化计算每个像素和其它像素之间的亲和力,通过变换对图像中其它部分的像素都定义了方向和亲和力,一些列像素间的亲和力由尺度参数确定。空间尺度参数为σs,控制尺度参数的函数为ds(·),同质 (相同形态的区域称为同质区域)尺度参数为:σg[12,13],控 制 平 均 尺 度 参 数 的函数为:dg(·)[14],对于一个灰度图像,两个像素间的同质参数为ΔC,被用来计算图像的分割结果

该算法允许高效迭代的基于区域的分割以及基于像素的分割[15,16],分割的步骤如下:

(1)分割颜色信息和边缘信息。

(2)使用色度、饱和度、强度进行颜色分割。

(3)使用MATLAB自带边缘处理程序获取图像边缘。

(4)把 (2)、(3)中获取的信息融合,然后去噪。

式 (18)中σg表示不同的像素跟附近像素之间关系,确定每个像素属于哪个区域,保证准确去除大量不相关冗余信息的同时为使用均值漂移可以准确过分割出小区域提供进一步保证。通过颜色分割可以得到图像Iinput。

2.3 算法实现

如何在最大相似度区域融合过程中确定目标与背景区域是最终分割效果精确性的关键,因此本文在使用均值滤波获取图像目标与背景区域阶段进行改进并建模,从而使目标分割能更加精确有效。

其步骤可总结如下:

输入图像:导向滤波处理存在模糊区图像获取保持边缘信息的细节增强图像,使用颜色分割算法分割增强图像,得到区域融合步骤中的输入图像Iinput。

输出图像:最后经过改进的最大相似度区域融合算法获取到的分割图像Ooutput。

区域融合步骤:

步骤1 未标记区域为N,标记的背景区域为MB。

输入图像:利用均值漂移分割得到的结果与Iinput融合作为原始输入图像或者以第二步分割得到的图像作为输入图像。

(1)对于每一个小区域E ∈ME,获得它的邻域集合:={Fi}i=1,2...,r。

(2)对于每一个区域Fi,并且FiME,它的相邻区域集合为:={S}j=1,2...,k,其中E ∈。

(3) 计 算 相 似 度ρ(Fi,S), 如 果ρ(Fi,B) =),则E =E ∪Fi,不然,E 与Fi无法合并。

(4)更新ME和N。

(5)如果对于MB不存在新的合并区域,那么第一步结束,否则从步骤1中 (1)再次执行。

步骤2 自适应的合并区域N 中未标记的部分。

对60例乳腺癌患者的70个病灶,其中有37个恶性病灶,占据比例为52.85%,即为29个浸润性导管癌、3个导管原位癌、1个导管内乳头状癌、1个小叶原位癌、1个浸润性小叶癌、1个混合癌、1个黏液癌。33个良性病灶,占据比例即为47.14%,15个纤维腺瘤、5个导管内乳头状瘤、5个纤维囊性乳腺病、2个良性叶状肿瘤、1个乳腺慢性炎症、1个放射状瘢痕、1个复合性硬化性腺病、1个重度不典型增生、1个脂肪瘤、1个错构瘤。

输入图像:第一步合并的结果。

(1)对于每一个区域J∈N,获得它的邻域集合:珚SJ={Ki}i=1,2...,j。

(2)对于每一个区域Ki,KiME,KiMO获得它的邻域集合:珚SKi={SKij}j=1,2...,k,其中J ∈珚SKi。

(3) 计 算 相 似 度ρ(Ki,SKij),如 果ρ(J,Ki) =

maxj=1,2,...,kρ(Ki,SKij),则J=J∪Ki,不然,J与Ki无法合并。

(4)更新N。

3 仿真结果分析

为了验证本文算法在图像存在模糊区时目标分割效果,实验在MATLAB7.14的平台上进行,所用的电脑配置为:Intel Corei5/2.5GHz/4GB,原图是大小为318*220的有雾图像,目标与背景区域存在模糊区。

使用传统MSRM 算法实验结果如图2所示,图2 (a)为原始有雾图像,图2 (b)为使用Edison系统 (均值漂移算法)获取的特征图像,作为最终合并的前提,由图可观察出,人物目标颜色特征与背景颜色特征值差别很小,所以得到的特征图像不能确定属于目标还是背景。图2 (c)为对目标及背景区域的标记,由图2 (d)观察得知,人物目标部分背景没有得到理想的分割,而与目标作为一个整体被分离,原因在于特征图像融合不精确。

图2 传统MSRM 算法区域合并

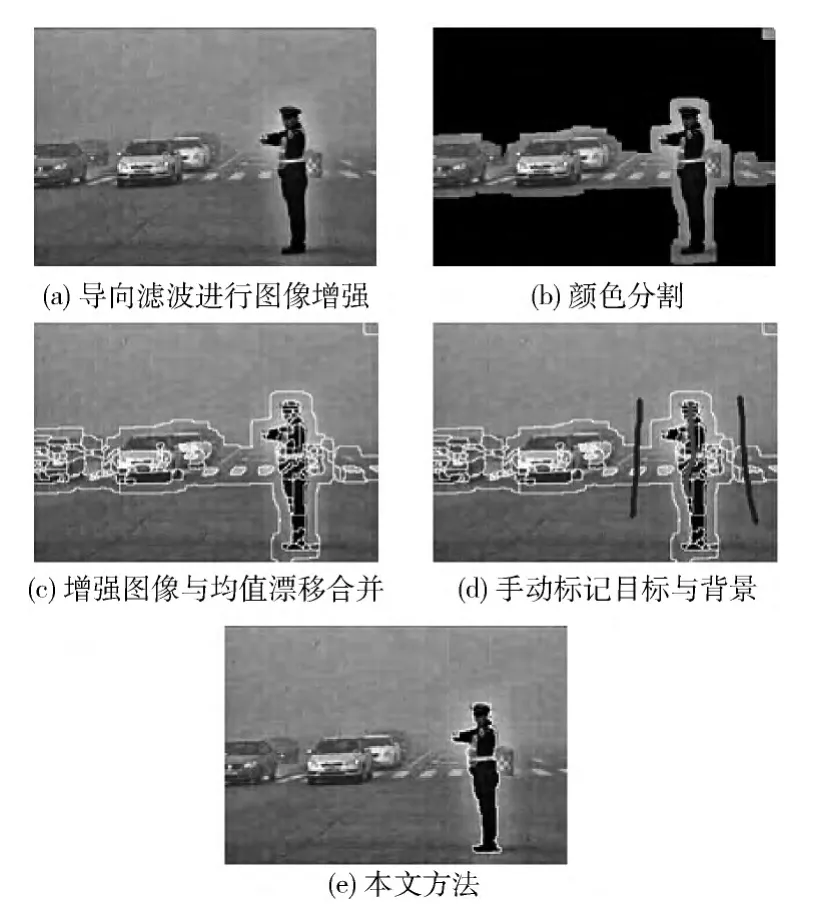

使用改进算法实验结果如图3所示,图3 (a)为使用导向滤波对原图重建,得到图像质量基本不损失、大小不变、边缘信息不丢失并且细节增强的图像,优化了目标与背景之间的模糊区。

图像质量基本不损失所使用的验证标准为峰值信噪比PSNR

式中:MSE——原图像与处理图像之间的均方误差,定义为

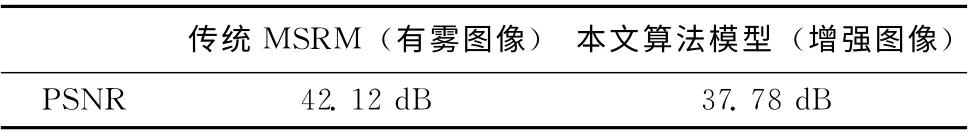

表1 两种算法PSNR 对比结果

图3 改进MSRM 算法区域合并

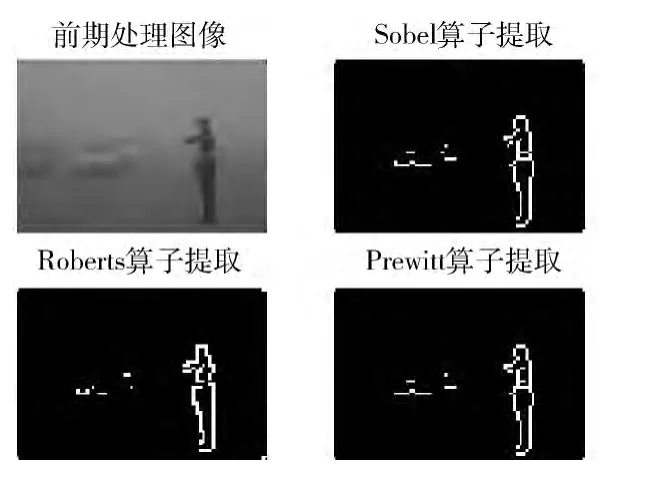

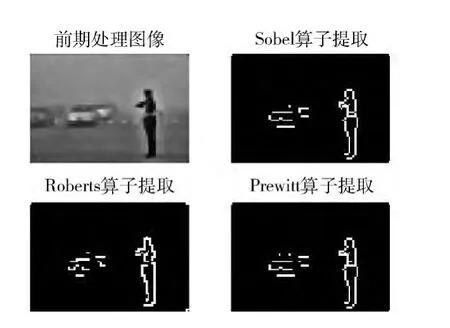

为了验证经过导向滤波处理后的增强图像能确定小区域属于目标还是背景,测试标准为Sobel算子、Robert算子以及Prewitt算子,三者均为边缘检测算子,能够提取出反应灰度变化的边缘点集。Sobel算子以滤波算子的形式来提取边缘,能更好反映出边缘所受影响大小;Robert算子是一种梯度算子,对边缘定位较强;Prewitt是加权平均算子,对边缘噪声有抑制作用。上述3种边缘检测算子测试结果均表明经过导向滤波进行目标与背景区域细节增强后的图像边缘信息未丢失并且更丰富,如图4和图5所示。

图4 原图进行边缘检测

图5 增强图像进行边缘检测

图3 (b)为使用颜色分割算法消除背景噪声等冗余信息的影响,从而获得更精确的特征图像,由图3 (c)观察得知,使用Edison系统获得的特征图像较图4 (b)更多,提供了更多准确的信息,使目标与背景区域融合更加精确,可通过图3 (e)对目标的分割结果观察得知,并作统计结果见表2。

表2 两种算法区域分割数量统计结果

如图3 (d)所示,与图2 (c)作近似标记,使用者手动标记目标和背景区域,由该算法设计的程序可以自行合并目标与背景区域,手动标记有误差的情况是在允许范围之内。对比图3 (e)与图2 (d)可知,后者使用改进的算法取得了较好的分割效果。

4 结束语

本文在分析MSRM 算法的基础上,把导向滤波、颜色分割算法思想应用到MSRM 算法前期的区域合并过程中,提出了改进的MSRM 算法。

通过仿真实验可以验证导向滤波算法在不损失图像质量的前提下对原模糊图像进行细节增强并保持边缘信息,再利用颜色分割算法去除噪声等冗余信息的干扰,使MSRM 算法在进行目标分割方面更精确、更快速,同时说明,改进的算法扩大了传统MSRM 算法的应用范围。

[1]LI Zhexue,CHEN Shuyue.Fast multi-thresholding approach[J].Journal of Computer Application,2010,30 (5):1335-1343 (in Chinese). [李哲学,陈树越.快速多阈值图像分割法 [J].计算机应用,2010,30 (5):1335-1343.]

[2]NING Jinfeng,ZHANG Lei.Interactive image segmentation by maximal similarity based region merging [J].Pattern Recognition,2010,43 (2):445-456.

[3]Mirandaa PAV,Facaoa AX,Udupa JK.Synergistic arcweight estimation for interactive image segmentation using graphs [J].Computer Vision and Image Understanding,2011,114 (1):85-99.

[4]WANG Xuewei,WANG Shili.Novel method of image fusion[J].Journal of Optoelectronics·Laser,2012,42 (9):1055-1060 (in Chinese). [王学伟,王世立.一种图像融合的新方法 [J].激光与红外,2012,42 (9):1055-1060.]

[5]XU Liyan,LIU Fuchang.Color image segmentation algorithm based on edge flow and region merging [J].Journal of Optoelectronics·Laser,2011,22 (10):1582-1587 (in Chinese).[徐丽燕,刘复昌.基于边缘流与区域归并的彩色图像分割方法 [J].光电子·激光,2011,22 (10):1582-1587.]

[6]Katkovnik V,Foi A,Egiazarian K,et al.From local kenerl to nonlocal multiple-model image denoising [J].International Journal of Computer Vision,2010,86 (1):1-32.

[7]HE Kaiming,SUN Jian,TANG Xiaoou.Guided image filtering [J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2013,35 (6):1397-1409.

[8]FAN Guoliang,SU Hongqi,WANG Chunxia,et al.Image segmentation algorithm based on fuzzy enhancement[J].Computer Engineering and Design,2012,33 (4):1463-1466 (in Chinese).[范郭亮,苏红旗,王春霞,等.基于模糊增强的图像区域分割算法研究 [J].计算机工程与设计,2012,33(4):1463-1466.]

[9]XU Shaoping,LIU Xiaoping,LI Chunquan,et al.A fast image segmentation algorithm based on region maximal similarity [J].Journal of Optoelectronics·Laser,2013,24 (5):990-999 (in Chinese).[徐少平,刘小平,李春泉,等.基于区域最大相似度的快速图像分割算法 [J].光电子·激光,2013,24 (5):990-999.]

[10]Vincent L,Soille P.Watersheds in digital spaces:an efficient algorithm based on immersion simulations [J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1991,13 (6):583-598.

[11]LU Binbin,JIA Zhenhong,YANG Jie,et al.A new fuzzy C-means algorithm based on gray value compensation and spatial information for aeral image segmentation [J].Journal of Optoelectronics·Laser,2011,22 (3):269-473 (in Chinese).[路彬彬,贾振红,杨杰,等.基于邻域灰度的模糊C均值图像分割算法 [J].光电子·激光,2011,22 (3):269-473.]

[12]L Xu,Lu C,Xu Y,et al.Image smoothing via 10gradient minimization [J].Proc ACM Siggraph Asia,2011,174:1-12.

[13]Adams A,Gelfand N,Dolson J,et al.Gaussian KD-trees for fast high-dimensional filtering [J].Proc ACM Siggraph,2009,21:1-12.

[14]FENG Xiaojun,Allchach JP.Segmented image interpolation using edge direction and texture synthsis[C]//15th IEEE International Conference on Image Processing,2008:881-884.

[15]LENG Lu,LI Mng,ZHANG Jiashu,et al.Image segmentation algorithm based on mean shift with high boundary precision and anti-noise performance [J].Computer Engineering and Design,2010,31 (1):145-152 (in Chinese). [冷璐,黎明,张家树,等.高边界精度和抗噪的均值漂移图像分割算法 [J].计算机工程与设计,2010,31 (1):145-152.]

[16]TANG Shiwei,ZU Guofeng,NIE Mingming.An improved image enhancement algorithm based on fuzzy sets [C]//International Forum on Information Technology and Applications,2010:197-199.