改进的视频车辆背景差分检测

神红玉 王波涛 闫跃

摘要:实时交通信息检测在智能交通系统中起着重要的作用,视频车辆检测是交通信息检测的一种重要手段。背景差分算法因其灵活性和准确性,成为基于视频的运动目标实时检测的一种常用方法,传统背景差分算法仅仅强调对二维图像的处理,尤其强调对图像分割和目标跟踪。该文对传统背景差分算法进行了改进,提出一种基于虚拟线框的车辆视频检测算法。该算法核心思想通过在每个车道设置两个虚拟线框来检测交通流参数,虚拟线框的输出信号源于背景差分。该方法只需对虚拟线框内的图像区域进行处理,从而并且避开了在视频图像中进行复杂的车辆特征提取与跟踪,减少了运算量,降低了运算负荷。经测试算法的处理速度为25帧/秒,车辆识别精度约为88%。

关键词:视频车辆检测;背景差分;虚拟线框

中图分类号:TP18 文献标识码:A 文章编号:1009-3044(2015)21-0144-03

The Video Vehicle Detection Based on Improved Background Difference Method

SHEN Hong-yu1, WANG Bo-tao 2, YAN Yue 2

(1. Career Academy, Jiangsu, Jiangsu, Huaian 223300, China; 2.Electronic Information and Control Engineering, Beijing University of Technology, Beijing 100124, China)

Abstract:The collection of real-time traffic data plays a critical role in the intelligent transport system, and video-based detection is an important part in traveler information systems. Background difference method has become common means in real-time motion detection because of its flexibility and veracity. Traditional background difference method is mainly based on 2-dimensional image processing, especially on image division and vehicle tracking. Improved the traditional background difference method, an algorithm of vehicle detection which is based on virtual frame is proposed in the paper. The main idea of this algorithm is based on the lane, each lane can have two virtual-frame to detect its traffic parameters. Each virtual-frames output signals mainly derive from the background difference. This method is only processing small area within virtual-frame and avoiding vehicle tracking in 2-dimensional image, hence the time cost of calculation and the computation burthen is reduced. The experiment tells us that the speed of the algorithm is 25 fps, the precision is about 88%.

Key words: video vehicle detection; background difference method; virtual frame

随着社会经济的不断发展,公路交通量持续增长,交通拥挤和阻塞现象日益严重,同时带来的交通污染与交通事故也越来越引起社会的普遍关注, 交通运输已经成为国民经济和现代社会发展的关键因素之一。由信息技术、通讯传输技术、自动控制技术以及计算机处理技术等高新技术组成的智能交通系统ITS(Intelligent Transport System)是解决交通拥堵难题的一条有效出路。它借助电子、通信、计算机、人工智能、数据库、运筹规划等先进的技术手段得到和提供道路交通的全方位信息,从而低成本、高效率地对公路交通实现科学的管理,达到高效合理地利用道路交通资源、及时测报和防范交通隐患、促进交通管理、城市安全的现代化的目的。

交通信息包括交通事件(交通事故、闯红灯等)和交通流量、车道占有率、行程时间等交通参数和道路拥挤程度等信息,其中车速、车辆驶向等参数在交通信息检测中起着至关重要的作用。在车辆信息检测中,人工测量方法只适用于作短期内的调查,不适用于实时交通控制和交通流的诱导。因此,就需要应用自动检测技术,同时测量多种车辆信息,从而便于对交通的实时监测与控制。随着数字图像处理理论的不断完善、计算机硬件系统的迅速发展、高速处理芯片和高速大容量存储芯片的出现与普及,从图像序列中检测出运动信息,识别与跟踪目标成为车辆信息实时检测技术的主要发展方向。

车辆实时检测的方法多种多样,但其基本原理就是利用运动车辆的某种特征把车辆目标从动态的图像序列中提取出来,目前常用的方法有基于背景差分的检测方法[1-2,7]、基于邻帧差分的检测方法[5]、基于检测窗数据流的检测方法[3-4]、基于概率特征分组的检测方法、基于阴影的检测方法。背景差分算法在处理运动目标的检测时较其他方法有着灵活性强、准确度高的优点,因而更加利于对动态的车辆目标进行检测。

但是,传统的背景差分算法[1]进行车辆检测需要对二维图像进行大面积的目标搜索并识别,这对于视频车辆的实时检测导致计算量过大。为准确、实时地进行车辆检测,本文在参考检测窗数据流法思路的基础上,对传统的背景差分法进行了改进,提出一种基于虚拟线框的车辆实时检测方法。该方法通过在各个车道上设置类似于电磁感应线圈的虚拟线框,通过判断车辆是否触发虚拟线框来进行车辆检测,避免了对图像进行复杂的图像分割,从而大大降低了算法的运算量。

以下第二部分中着重介绍基于虚拟线框的车辆检测算法的设计思想以及利用这种方法进行车辆信息的检测。第三部分测试该算法的处理速度和精度。最后是结论。

1 车辆检测算法

1.1 车辆识别算法

本文的算法是以背景差分法[7]为基础的,背景差分法是一种应用很广泛的运动目标提取方法,包括差分图像、图像分割和目标识别三个部分。差分图像是指将当前帧图像与预先提取的背景帧图像(无目标出现)逐像素差分,对于差分值大于某个阈值的像素二值化为1,差分值小于某个阈值的像素二值化为0;这样,二值化结果为1的像素所组成的区域为图像变化区域,这就将目标可能出现的区域从图像中分割出来了,称为图像分割;接着对该区域内的像素进行目标识别,即判断区域内是否存在车辆,目标识别的方法有很多,常用的有边缘检测法[1,3,8]、模型匹配法[6]、颜色特征分析法。

传统的背景差分法[1]是基于彩色图像的,由于本文的算法无需对车辆的颜色进行判断,所以车辆的颜色信息为无用信息,因此,在图像处理过程中,先将图像的颜色信息滤除,即将彩色图像转化为灰度图像,这样就能在一定程度上减少算法的计算量。

用背景差分法检测目标,使用的参考帧(背景帧)的好坏直接关系到检测的精度。然而,随着环境中光线和天气的不确定的变化,背景图像也是在不断变化的,单选取一个固定的背景图像进行差分肯定会造成较大的误差,降低算法的准确度。因此,在车辆检测中,背景帧不是一成不变的,而是需要不断刷新的[7]。所以,背景提取应当分为背景的初始选取和动态更新两个过程,背景初始选取就是在进行实时的视频车辆检测之前先预先选取一个没有目标出现的背景图像,以后的各个帧就同该背景帧进行差分。背景的动态更新就是根据当前帧和背景帧两个图像,来推导出在没有车辆通过的情况下当前帧的道路背景图像,滤除掉所有的车辆、行人,光线,天气等干扰。背景更新如以下公式(1)所示:

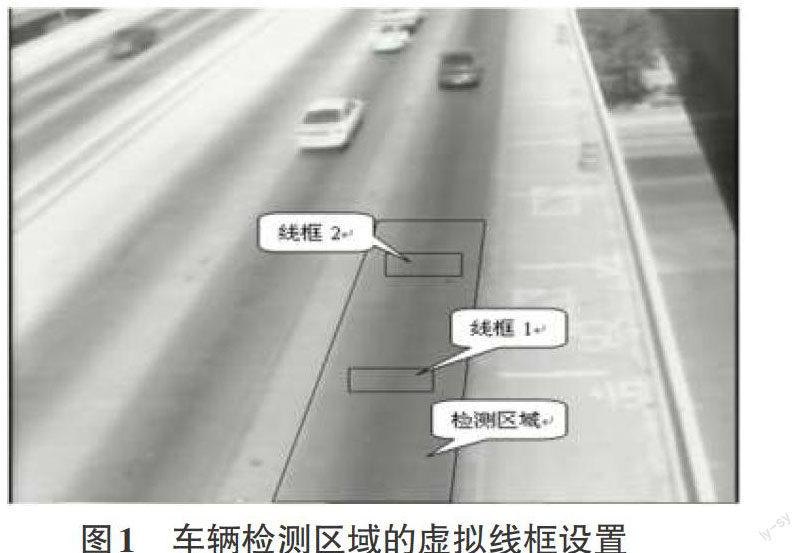

[Bn+1=Bn+Cn+12,ifCn-Bn 上式中,[Bn]、[Bn+1]为第n、n+1帧背景帧灰度,[Cn]为当前帧灰度,若当前帧灰度[Cn]与背景帧灰度[Bn]之间差分绝对值小于阈值时,通过平均法进行背景更新,若大于阈值就保持原背景不变。 但是,如果对整个图像进行上述的背景更新、差分图像、图像分割、目标识别等运算,并且在目标识别的基础上还要对其进行跟踪,以提取车辆信息,这对于每秒要处理25帧图像的系统来说计算量太大,不利于实时处理。这就需要对背景差分算法进行改进,降低其运算量,以达到高效,准确的进行车辆实时检测的目的。 检测窗数据流法[3、4]通过在图像中有车辆出现的某个区域设置一个检测窗,通过对检测窗内的图像进行边缘检测,当有车辆目标出现在窗口内时,算法就将该目标的边缘信息提取出来,从而判断出是否有车辆目标出现。检测窗的作用就类似电磁线圈,一旦被触发就向系统发出目标出现的信号。检测窗法只需要对窗口内的图像进行处理,从而避免了对整幅图像进行大面积目标搜索。但是,不断地对窗口内的图像进行边缘算子的计算也很难达到预想的效果,并且对于边缘信息不明显的车辆线框很难检测到,因此,仅用检测窗法进行目标检测还是存在弊端。 本文在背景差分算法的基础上,结合检测窗数据流法的思想,提出一种基于虚拟线框的视频车辆检 测算法。算法的基本思想是:在每个车道上设置虚拟线框,算法仅对虚拟线框内的图像作背景差分处理,即将当前帧中线框内的像素与背景帧线框内的像素进行差分处理,这样,就避免了对整个图像进行复杂的图像分割,直接对线框内的差分结果做特征分析,本文采用面积分析法,即当目标占用线框总面积的1/2以上时,触发虚拟线框,从而得到目标出现的信号。 1.2 车辆目标的跟踪 如果需要对车辆行驶方向和行驶速度进行检测,只对车辆目标进行识别是不够的,必须对车辆目标进行跟踪,即从连续的数帧图像中提取出车辆的运动轨迹。利用传统的背景差分算法进行车辆跟踪计算量是相当大的[1]。国内外的专家们也提出过许多能够准确进行目标跟踪的算法,如:基于模型分析的目标跟踪方法、基于运动估计的目标跟踪方法[7]、基于边缘检测的目标跟踪算法[8]、基于轮廓匹配的目标跟踪算法[6]。这些方法都能够准确对目标进行跟踪,而且还能够得到目标车辆的车型,车长,尤其是基于边缘检测和基于轮廓匹配的跟踪算法,它们甚至能直观的在视频图像中将车辆目标锁定并且在图像中表现出来。但是,以上算法存在一个通病,那就是算法复杂,对于检测器的运算速度要求较高。同时,算法的复杂性必然会导致算法的不稳定。而利用虚拟线框法进行车辆跟踪,虽然不能得到车型、车长等信息,但其算法简单,速度快,在同样能准确的检测出车辆的行驶速度和行驶方向的基础上耗费的硬件资源更少。 图1 车辆检测区域的虚拟线框设置 下面介绍一下虚拟线框法进行车辆目标跟踪的基本思想。如图1所示,在整个图像的感兴趣区域(即车辆检测区域)设置两个虚拟线框,一个线框作为车辆识别线框,用于判断有无车辆出现,另一个线框作为车辆跟踪线框,用于进行车辆行驶方向判断和车速的测量(两个线框中每个线框都可能作为车辆识别线框,关键是看哪个线框先被触发)。开始时,对该车道设置的两个虚拟线框进行目标检测,若某个线框内出现目标,则该线框成为车辆识别线框,另一个线框为车辆跟踪线框,并开始计时。当另一个线框也被触发,车辆跟踪结束,停止计时。此时即可输出车辆行驶方向,并且两个线框之间的距离(路面上的实际距离)除以计时变量输出的时间就是车辆行驶的(平均)速度。

2 测试结果及分析

本文分别对不同车型,不同颜色的50辆车的进行检测。车速车辆定性地划分为快速、中速、慢速三个部分。本文对每辆车分别检测5个时段,每个时段检测25帧图像,图像的分辨率为720×576像素,根据实验中检测准确的帧数除以帧数25得到一辆车在某个时段下的检测准确率,然后对得到的准确率求平均即可得到一辆车的识别准确率。每个虚拟线框的大小约为150×15像素。实验结果如表1所示。

经过测试,算法的测试效果还是比较理想的。结论如下:

1)算法对车辆行驶方向检测效果较好,在处理速度基本达到25帧/秒的情况下检测准确率约为

88%,对车辆行驶方向的判断基本准确。

2)在测试过程中,当虚拟线框内在首帧就有车辆出现时,车辆方向检测出错。

3)对于车辆颜色与路面相近的情况,算法出错,出现车辆“断裂”现象,即在车辆通过虚拟线框过程中出现某帧显示“无车经过”。

4)在车辆行驶缓慢的情况下,算法准确率明显下降。

3 结论

获得各条道路的交通流参数是对城市交通状况进行监控的前提,同时它又为城市的道路规划提供了必要的依据。基于视频的交通流检测方法由于它的种种优点目前已经成为了智能交通系统中的一个研究热点,视频检测方法的准确性和实时性是直接影响它实际应用价值的两个指标。

本文从传统的背景差分目标检测算法出发,探索出一种基于视频虚拟线框的车辆检测方法,能有效完成车辆行驶方向检测、车速测量,取得了较好的效果。

参考文献:

[1] Bevilacqua A. Vaccari, S. Real time detection of stopped vehicles in traffic scenes[C].IEEE Conference on Advanced Video and Signal Based Surveillance, 2007: 266 -270.

[2] Toshiyuki Yoshida,T.Background differencing technique for image segmentation based on the status of reference pixels[C]. 2004 International Conference on Image Processing,2004, 5: 3487-3490.

[3] Fathy M,Siyal M Y.A window-based image processing technique for quantitative and qualitative analysis of road traffic parameters[J]. IEEE Transactions on Vehicular Technology,1998,47(4): 1342-1349.

[4] Siyal M Y.A novel multiprocessor system for road traffic applications[C]. 2002 IEEE International Conference on Industrial Technology, 2002(1): 450-455.

[5] ThakoorN, Gao J. Automatic video object shape extraction and its classification with camera in motion[C]. IEEE International Conference on Image Processing, 2005,3:III-437-40.

[6] 杨建国,尹旭全.基于自适应轮廓匹配的视频运动车辆检测和跟踪[J].西安交通大学学报,2005,39(4):351-355.

[7] 郑江滨,张艳宁.视频监视中运动目标的检测与跟踪算法[J].系统工程与电子技术,2002,24(10):34-37.

[8] 王春波,张卫东.复杂交通环境中车辆的视觉检测[J].上海交通大学学报,2000,34(12):1680-1682.