智能视频监控系统中多摄像头协同跟踪算法

许慧芳,许亚军

(太原理工大学 信息工程学院,山西 太原 030024)

智能视频监控系统中多摄像头协同跟踪算法

许慧芳,许亚军

(太原理工大学 信息工程学院,山西 太原 030024)

为了提高智能视频监控系统中运动目标跟踪的准确率和有效性,利用数据融合和协同跟踪技术,实现了多摄像头协同跟踪系统中运动目标的有效跟踪。首先,利用单摄像头独自跟踪得到目标图像,然后利用平面单应性和极线几何约束结合实现多摄像头视图间的目标匹配和协同跟踪,最后得到精确的目标跟踪结果。通过在MATLAB上实验仿真,并与单摄像头目标跟踪进行对比,得出该算法具有较好的跟踪效果以及抗遮挡性能,可广泛应用于智能视频监控系统中。

智能视频监控;数据融合;协同跟踪;平面单应性;几何约束

1 智能视频监控

随着计算机性能的不断提高,以及图像处理技术的不断发展,智能视频监控(Intelligent Video Surveillance)已经逐步在国家经济建设、国防力量支撑、智能家居安防等诸多领域得到了广泛的应用。尤其当前我国提出了“互联网+”的新一代信息技术创新革命,智能视频监控技术潜在的市场价值必然会促使更多研究人员投身这一科研行列。

智能视频监控技术的关键是从视频序列中对运动目标进行检测、分类、目标跟踪以及目标行为的理解与描述这几个部分,如图1所示[1]。其中,低级视觉部分包括运动目标检测、分类识别以及目标跟踪;中级视觉部分即多摄像头数据融合,主要是融合来自多个单摄像头的数据,协同整个系统的跟踪;高级视觉部分主要由行为理解和描述等部分组成。虽然智能视频监控经过了十几年的快速发展,也取得了显著的成就,但应用场景复杂性与多元化决定了在未来较长阶段还需要科研学者投入大量的精力研究解决该技术的重点难点问题。尤其是,目标跟踪作为智能视频监控的关键技术之一,当应用场景范围较广或者存在感兴趣目标互相遮挡问题时,多摄像头之间如何协同工作已经成为智能视频监控技术的一个发展瓶颈,引起了人们极大的研究热情。

图1 智能视频监控技术的研究内容

2 多摄像头协同跟踪关键技术

2.1 目标交接与数据融合

作为多摄像头跟踪系统的核心技术之一,多摄像头之间目标交接的基础往往是目标匹配。因此,对目标交接方法的研究也是对目标匹配的研究。目标交接技术解决的主要问题是,目标从一个摄像头视野中消失或者进入另外一个摄像头视野时,如何完成目标匹配和确认的问题[2]。Guler. S等[3]首次提出了一个基于视野分界线的多角度多摄像头视图跟踪系统,其中的目标交接就是利用了目标与视野分界线之间的关系。L. F. Teixeira等[4]提出的量化局部特征描述符与自适应学习相结合的方法来匹配目标,就是通过目标之间的对应关系来完成目标交接。

同时,数据融合也是建立在目标匹配的基础之上的,数据融合能否进一步提取有效信息的关键就是能否进行良好的目标匹配。常用的数据融合理论包括卡尔曼滤波、模糊逻辑理论、神经网络等,这里不再赘述。值得注意的是,现在所提出的目标匹配算法都有其一定的局限性,普适的匹配算法目前并未被人们所发现。

2.2 多摄像头协同调度

在广域的动态场景监控系统中,多摄像头协同调度技术在稳定跟踪性能、提高跟踪质量以及有效分配计算资源等方面起着重要的作用。由于计算机性能的不断提升,信息技术的持续革新,摄像机网络化已经在逐步代替单纯的多摄像头协同。作为近两年研究的热点,摄像机网络越来越多地受到相关学者的关注。

摄像机网络主要分为集中式和分布式两种结构,拓扑形式见图2。摄像机网络作为多摄像头系统发展雏形出现的时候是建立在集中式基础之上的,系统的整体性能更多地依赖于中央处理计算机,对摄像头本身的计算性能要求较低。基于分布式结构的摄像机网络已经逐步得到广泛的应用,因为这种网络化摄像机系统几乎不需要中央处理器,并且对通信环境、通信带宽以及数据中心等要求较低,但分布式网络对每个摄像机的数据处理能力要求较高[5]。A. Alahi等[6]提出了一种基于视觉的摄像头跟踪调度算法,这种固定摄像头与移动摄像头相配合的主从分布系统其构成思想就是来源于无线传感器网络。

图2 多摄像头拓扑结构示意图

3 多摄像头协同跟踪算法研究

本文研究实现的基于分布式多摄像头协同跟踪系统,系统框架如图3所示。分布式系统对单摄像头的硬件性能有较高的要求,但随着技术的不断进步,目前的集成电路、计算机视觉技术已经能够满足这样的要求。分布式主要体现在图像处理和控制两个方面,依赖每个摄像头独自的数据运算环节,就可以实现单摄像头对目标的跟踪;同时,通过摄像头之间网络化通信,可以有效完成摄像头之间的协同控制等;摄像头之间目标匹配传递和运动状态的交接确认,又为数据融合提供了平台。下面首先对算法中2个关键内容进行研究。

《造纸装备及材料》是为造纸装备制造企业、材料制造企业专业服务的期刊,国内统一刊号CN43-1535/TS,国际连续出版物刊号:ISSN 2096—3092,全国公开发行。(2018年是第47卷,176期,季刊,大16开版)

3.1 平面单应性(Planar Homography)

一个平面到另一个平面的投影映射,在计算机视觉中这种投影映射被定义平面的单应性。空间中同一平面的任意2幅不完全对应的图像可以通过单应性关联在一起,这一特性在很多现实应用中受到了广泛的关注。基于图像平面单应性来实现多视图的目标融合,较基于标定的多摄像头跟踪方法易于实现而且算法相对简单,因此本文中采用平面单应性来实现目标融合。

假设有2个摄像头a和b,这2个相机都向平面π中的点P看去。点P在摄像头a和b中的成像分别为Pa和Pb,如图4所示。根据摄像头投影成像原理[7]可知

Pa=HaπPπ

(1)

Pb=HbπPπ

(2)

式中:Haπ表示摄像头a的投影矩阵,相应地,Hbπ为摄像头b的投影矩阵,平面图像上的点通过这种存在映射关系的投影矩阵与目标图像上的点联系了起来。由式(1)和(2)可推导出

(3)

平面中任一点在多个摄像头中的成像点之间存在着一定的对应关系,即存在一个H矩阵,使得Pb=HPa。这个3×3的矩阵H称为平面单应性矩阵(Planar Homography Matrix),这种投影对应关系称为平面单应性(Planar Homography)。

图4 平面点与成像点空间模拟图

3.2 极线几何约束(Epipolar Constraint)

在多视几何系统中,有2个摄像头在不同角度拍摄物理空间中的一实体点,在2幅图像上分别成有2个成像点。立体匹配就是已知其中的一个成像点,在另一幅图像上找出该成像点的对应点。极线几何约束是立体匹配技术中应用较广的一种,由于极线几何约束提供的约束条件,使得目标图像上的匹配对应点的范围限制在一条直线上。极线约束这种点对直线的约束与点到点的平面单应性映射一样,给出了对应点的重要约束条件,也常被用来进行多摄像头融合。

如图4所示,对于平面中任何一点P,点P在摄像头a和b中的成像分别为Pa和Pb。根据极线约束原理,空间平面中任一点的多个成像点之间存在着一种约束关系,也就是这里的Pa和Pb之间存在一种约束关系,即Pb一定在与点P和Pa确定的直线L平行的直线L′上。直线L′可由下式确定

L′=FPaπ

(4)

其中,F是一个3×3的基础矩阵(Fundamental Matrix)。与单应性矩阵相同,可以通过2幅图像中的对应点来计算基础矩阵F。本文使用findHomography函数以及findFundamentalMat函数来分别计算单应性矩阵H、基础矩阵F,并将平面单应性和极线几何约束相结合,来实现多摄像头图像之间的数据融合与目标关联。

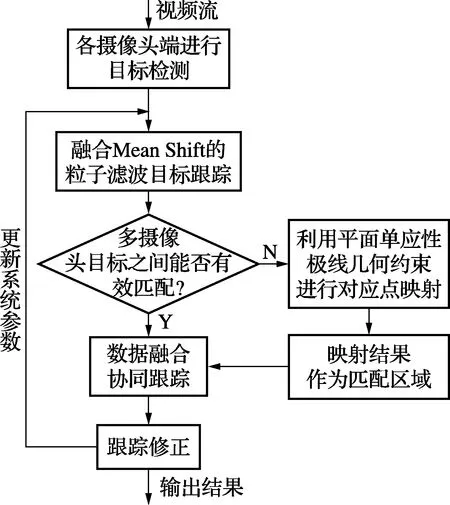

整个系统采用基于单摄像头目标检测进而跟踪的方法,也即目标的检测与跟踪首先在单摄像头层完成,对于每个摄像头输入的每一视频帧,根据目标检测提取的前景结果在单摄像头上使用融合Mean Shift的粒子滤波算法对多目标进行自动跟踪,单摄像头目标跟踪具体算法参见文献[8],这里不再赘述。当各个摄像头的独立跟踪完成后,再通过平面单应性和极线几何约束,实现在不同摄像头视图中同一目标的匹配,通过对多个摄像头的数据信息进行融合和协同跟踪来确定目标的运动状态。最后,对单摄像头跟踪结果进行修正,并输出最终跟踪结果。算法流程如图5所示。

图5 多摄像头协同跟踪算法流程图

4 仿真与实现

本文在MATLAB 7.10的仿真环境下,选用ICGLab6[9]数据集中的视频测试序列“chap”(分辨率1 024×768,帧率 20 f/s (帧/秒),共3 760帧)来评估系统的跟踪效果进而验证算法的有效性,该数据集使用3个摄像头搭建了一个有公共重叠区域的应用场景。然后在对比单摄像头独立跟踪效果与多摄像头协同跟踪效果的基础上,使用MOTA[10]等指标给出了跟踪效果的数据对比。

ICG多摄像头室内数据集“chap”的跟踪效果如图6所示。图中第1、2、3列分别对应第1、2、3个摄像头在第326帧、417帧和742帧的跟踪结果。由图可以看出,目标在行走状态多变、遮挡面积较大的情况下,都能被多摄像头准确稳定地跟踪。

图6 ICG视频测试序列“chap”多摄像头协同跟踪效果图

图7对比了在跟踪目标之间存在互相遮挡的情况下,采用3个摄像头协同跟踪和使用单个摄像头独立跟踪的结果。其中,图7a展示了采用3个摄像头进行协同跟踪的时候,第1个摄像头在第494帧、第539帧和第731帧的跟踪结果。从跟踪效果可以看出,本系统能够相互交换视野中多目标的运动状态数据信息,所以可以保持良好的跟踪性能,并且克服了单摄像头独自跟踪视野受限这种情况。而图7b则展示了采用单摄像头进行单独跟踪时第1个摄像头在上述帧的跟踪结果,由于视野中目标之间存在严重的互相遮挡,单个摄像头无法像多摄像头系统那样从多个视角获取目标的信息,无法对目标进行有效跟踪,容易发生错误匹配和跟丢的现象。

图7 多摄像头协同跟踪与单摄像头跟踪效果对比图

计算机视觉领域有许多针对多目标跟踪效果的衡量指标,MOTA(Multiple Object Tracking Accuracy)是其中公认度较高的一项,主要用来衡量跟踪的准确度。设定t时刻的跟丢个数由mt来表征。同样的,t时刻的误判数、误配数和目标总数分别由fpt,mmet和gt表征,计算如下

(5)

为了更好地评估该多摄像头协同算法的跟踪性能,这里使用MOTA、MT(跟丢个数)、FP(误报个数)以及ID-Switch(目标ID变换次数)等4个指标对ICG视频测试序列“chap”中第1个摄像头采集的视频的前1 500帧(共计2 740个行人目标)在单摄像头跟踪和多摄像头协同跟踪2种情况下的跟踪效果进行比较,对比结果如表1。单摄像头跟踪采用了系统中融合均值偏移的粒子滤波目标跟踪算法。在该实验室监控场景中目标之间很多时候容易发生严重的遮挡,单摄像头独立跟踪很难长时间准确地跟踪目标。但是,多摄像头的协同配合很好地克服了这一缺陷。由表1可知,多摄像头协同跟踪的MT仅有单摄像头独立跟踪的12%。其次,由于算法中引入平面单应性和极线几何约束函数,多摄像头之间受映射精度的影响,导致其FP和ID-Switch较单摄像头独立跟踪稍多。但是,相比较好的跟丢个数指标,这个误差在可接受的范围之内。综合对比,基于多摄像头协同目标跟踪算法的表现比单摄像头单独跟踪算法要优异很多。

表1 ICG场景单、多摄像头跟踪方法数据对比

方法MOTA/%MT/个FP/个ID-Switch/次单摄像头跟踪0 804516813多摄像头跟踪0 941625940

5 结束语

本文以智能视频监控系统的发展瓶颈——多摄像头目标跟踪为研究背景,详细阐述了多摄像头协同跟踪的关键技术,在此基础上设计了一个基于多摄像头协同跟踪系统的算法。算法采用融合均值偏移的粒子滤波方法来实现单摄像头的独自跟踪,然后采用平面单应性和极线几何约束的目标匹配方法,对不同摄像头之间的目标进行映射,从而方便地实现了多摄像头融合和协同跟踪。最后,在实验室环境下使用该算法实现了对多个目标的自动跟踪。从仿真结果可以看出,该算法跟踪效果与单摄像头目标跟踪相比较,具有跟踪准确度高、抗遮挡干扰强等特点,是一种高性能的多目标跟踪方法,可广泛应用于广域动态场景的多摄像头智能视频监控系统中。

[1] 许亚军, 许慧芳, 张艳春. 智能视频监控系统中运动目标检测的研究[J]. 电视技术, 2014,38(9):228-231.

[2] 孙晓燕. 多摄像机接力目标跟踪关键算法研究[D]. 济南:山东大学, 2014.

[3] GULER S, GRIFFITH J M, PUSHEE I A. Tracking and handoff between multiple perspective camera views[C]//Proc. Applied Imagery Pattern Recognition Workshop. [S.l.]:IEEE Press,2003:275-281.

[4] TEIXEIRA L F, CORTE-REAL L. Video object matching across multiple independent views using local descriptors and adaptive learning[J]. Pattern Recognition Letters,2009,30(2): 157-167.

[5] AVED A J, HUA K A, GURAPPA V. An informatics-based approach to object tracking for distributed live video computing[J]. Multimedia Tools and Applications,2014,68(1):111-133.

[6] ALAHI A, MARIMON D, BIERLAIRE M, et al. A master-slave approach for object detection and matching with fixed and mobile cameras[C]// Proc. 15th IEEE International Conference on Image Processing. [S.l.]:IEEE Press,2008:1712-1715.

[7] CHU C, HWANG J. Fully unsupervised learning of camera link models for tracking humans across non-overlapping cameras[J]. IEEE Trans. Circuits and Systems for Video Technology, 2014,24(6):979 - 994.

[8] 许慧芳, 许亚军. 智能视频监控系统中运动目标跟踪的研究[J]. 电视技术, 2014,38(19):202-206.

[9] POSSEGGER H. Multi-Camera Datasets[EB/OL].[ 2015-03-20].http://lrs.icg.tugraz.at/download.php.

[10]ALANKAR S R B,BABU C S M. Efficient human tracking system[J]. International Journal of Research in Computer Applications and Robotics,2014,3(2): 21-28.

责任编辑:闫雯雯

Algorithm Research on Multiple Cameras Collaborative Tracking in Intelligent Video Surveillance System

XU Huifang, XU Yajun

(TaiyuanUniversityofTechnology,CollegeofInformationEngineering,Taiyuan030024,China)

To improve the accuracy and effectiveness of the moving objects tracking in intelligent video surveillance system, using data integration and collaborative tracking technology,effective tracking of moving targets in multi-camera tracking system is achieved. Firstly, the foreground image is got by every single camera targets tracking, and then use the planar homography and the epipolar constraint,targets correlation and collaborative tracking between multi-camera views are achieved, and finally accurate tracking results are got. Through experiments and simulations in MATLAB, comparing with single camera tracking results, the algorithm has better tracking performance and anti-blocking properties, and can be widely used in intelligent video surveillance system.

intelligent video surveillance; data integration; collaborative tracking; planar homography; epipolar constraint

山西省自然科学基金项目(2013011017-3)

TN949.6

A

10.16280/j.videoe.2015.18.020

2015-03-29

【本文献信息】许慧芳,许亚军.智能视频监控系统中多摄像头协同跟踪算法[J].电视技术,2015,39(18).