基于超像素时空显著性的运动目标检测算法

云红全,徐 力,孙 骁,明德烈,鞠 雯

基于超像素时空显著性的运动目标检测算法

云红全1,2,徐 力1,2,孙 骁3,明德烈3,鞠 雯1,2

(1. 宇航智能控制技术国家级重点实验室,北京 100854;2. 北京航天自动控制研究所,北京 100854;3. 华中科技大学自动化学院 多谱信息处理技术国家级重点实验室,湖北 武汉 430074)

针对复杂背景下运动目标检测存在的背景干扰、目标分割不完整等问题,利用目标静态灰度特征和运动特征,结合目标运动连续特性,提出了一种基于超像素时空显著图的运动目标检测算法。首先对图像基于简单线性迭代聚类算法(SLIC)进行超像素分割,以初始超像素为节点、以运动特征差异性为边建立图结构对超像素区域进行合并,得到最终超像素图像,可以有效解决传统超像素分割方法过分割而导致目标被分为多个部分的问题;然后分别利用目标静态特征对比度和运动特征对比度,得到静态显著性图和运动显著性图,并融合得到最终的时空显著性图;最后利用恒虚警处理技术,结合运动连续特性实现目标的检测,可以有效减少虚警目标。实验结果表明,该算法针对复杂背景具有良好的鲁棒性,并且可以比较完整的保留目标的信息。

超像素;时空显著性;运动连续性;恒虚警处理

0 引言

运动目标检测在军事、工业、商业、医学、气象等各个方面有着广泛的应用。地面背景中建筑物、桥梁、树木等干扰物的存在以及成像设备的影响,造成目标亮度不均衡或者目标和背景灰度十分相近等,这给目标的检测带来困难。普通的检测方法例如帧差法[1]、背景减除法[2]等很难将目标完整的分割出来。

人类可以迅速地从大量视觉输入信息中排除复杂的环境干扰和信息冗余,发现所要关注的人或者事物,这主要依靠人类的视觉注意机制。对人类视觉注意机制的研究和分析是显著性分析的理论基础。近年来,通过许多专家和学者对视觉注意机制的研究,提出了许多视觉显著性计算模型,不同的模型使用不同的特征,主要包括颜色、亮度、梯度、边缘和纹理等[3-8],这些研究主要集中在对图像静态特性分析上。

超像素是由具有相似颜色纹理等特征的相邻像素构成的图像块。超像素能够捕获图像的冗余信息从而大大降低图像后续处理如目标识别图像分割等任务的复杂度,因此在计算机视觉应用中越来越受到人们的重视[9]。

为此,针对传统运动目标检测算法中检测结果易受复杂背景影响而产生虚警、分割结果难以保持目标完整形状等问题,本文提出了一种基于超像素时空显著性和运动连续性的复杂背景运动目标检测算法。该算法首先对图像进行超像素分割及超像素合并,然后利用目标静态和运动特性分别获得静态和动态显著图并融合成时空显著性图,最终利用恒虚警处理技术和运动连续特性实现目标的检测。

1 基于超像素时空显著性的运动目标检测算法

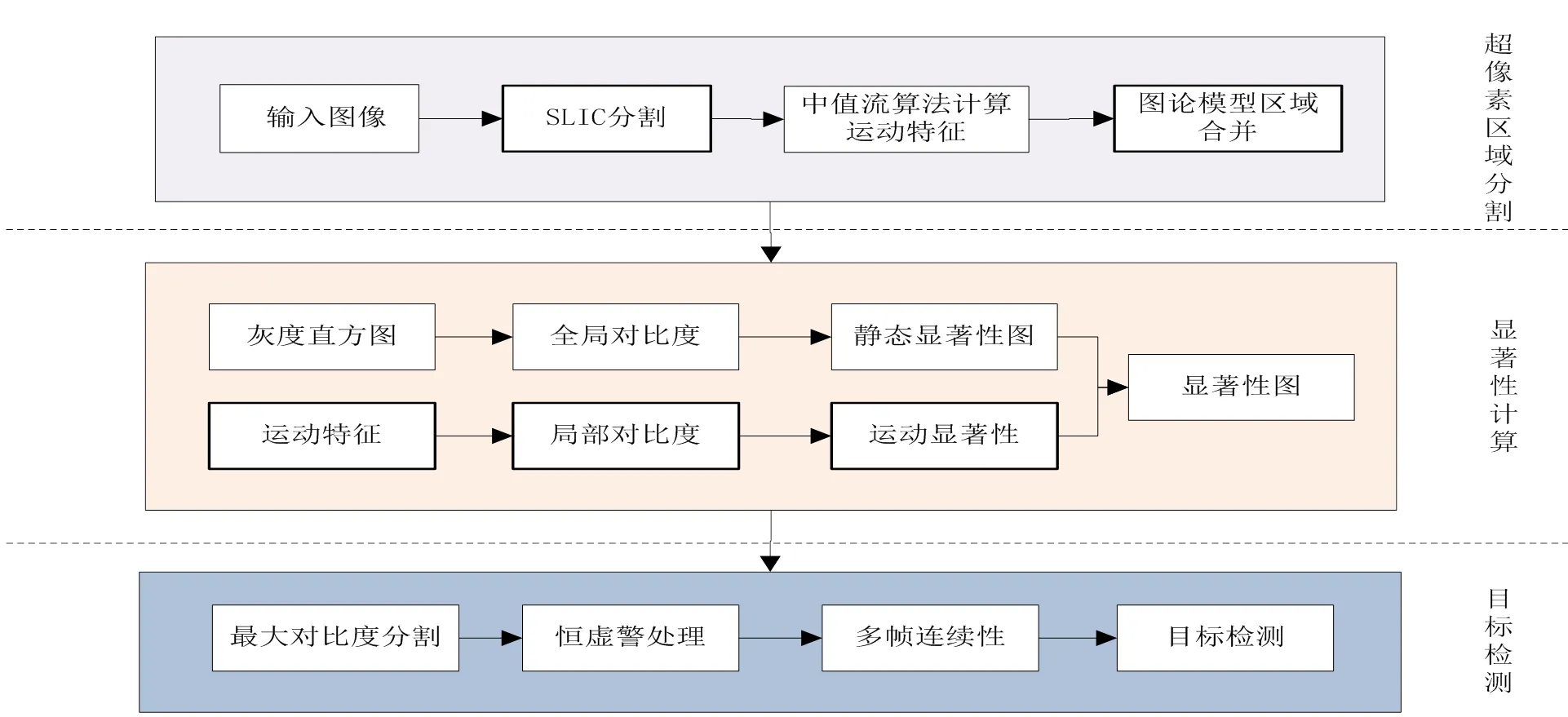

本文主要利用目标静态灰度特征和运动特征,建立时空显著性模型,并且结合目标运动连续特性,实现目标的检测,算法具体步骤如图1所示。

1)对输入图像进行超像素分割,并对每个超像素区域采用中值流算法提取运动特征。以超像素区域为节点,通过运动特征差异性计算边的权重值,建立图结构,利用图论模型实现超像素区域的合并,生成新的超像素图。

2)对每个超像素区域提取运动特征和灰度直方图统计特征。分别计算静态灰度特征区域全局对比度和运动特征区域局部对比度,得到静态显著性图和运动显著性图,融合得到最终的时空显著性图。

3)利用最大对比度算法对图像进行分割,然后利用恒虚警处理技术得到所有可能目标信息。

4)连续多帧做以上计算,利用目标运动连续性,实现目标的最终检测。

2 基于超像素的时空显著图生成

2.1 超像素生成及合并

SLIC算法[10]是一种思想简单、实现方便的超像素生成算法,该算法速度较快,能生成紧凑、近似均匀的超像素,但使用该算法生成的超像素区域有时会忽略目标的整体信息,而将目标分为多个部分。因此本文对利用图论模型对SLIC算法生成的超像素区域进行一次区域合并,得到最终的超像素分割图像。

首先,利用基于测地距离的SLIC算法[9]将图像分割成初始超像素区域。测地距离[11-12]可以较好地反映图像本身的几何信息,SLIC算法是基于均值聚类算法的超像素分割算法,计算简单、高效。基于测地距离的SLIC算法可以生成分布和大小均匀的超像素。

其次,对每个超像素区域采用中值流算法[13]计算运动特征,运动特征的计算方法2.2节中详述。

然后,利用超像素区域和运动特征建立的图论模型。图结构中每个节点对应图像中SLIC生成的超像素,每条边连接着相邻的超像素区域,边的权值对应着连接的超像素之间的运动特征的相似度,相似度用欧式距离衡量。

图1 运动目标检测算法整体流程

最后,将Felzenszwalb[14]提出的基于图论的图像分割算法扩展到本文的超像素图中,对超像素区域进行合并,得到新的超像素图用来进行后续的时空显著图生成计算。

2.2 时空显著图生成

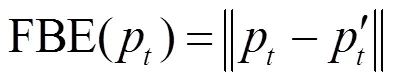

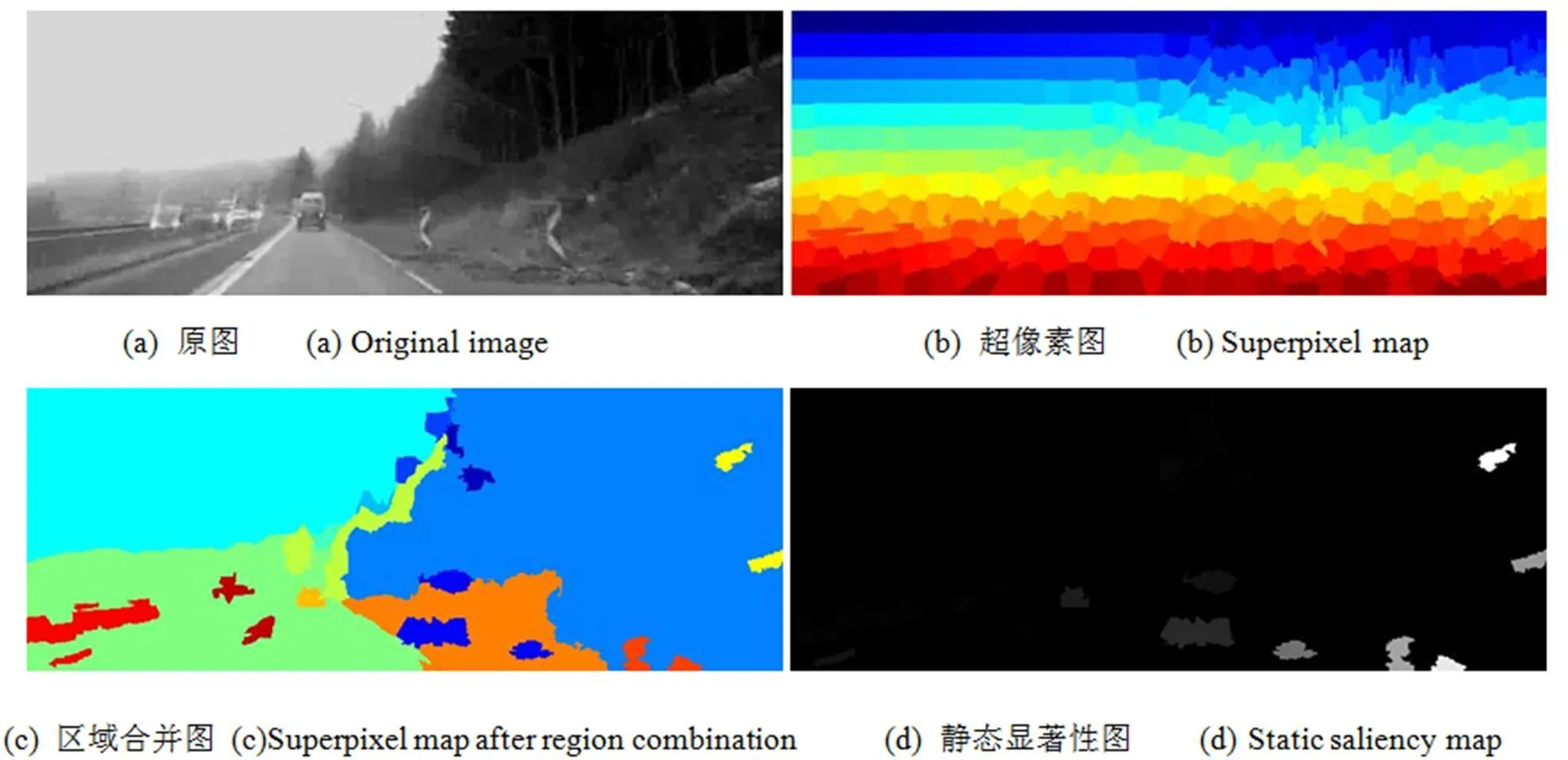

本文提取灰度和运动2种特征计算显著性图,首先利用运动特性对目标进行区域合并,在利用静态灰度和运动特征分别计算静态显著性和运动显著性图,最后将2个显著性图加权求和得到最终的时空显著性图。计算过程如图2所示。

图2 显著性图计算流程图

2.2.1 显著性特征提取

1)灰度直方图统计特征

对每个超像素区域进行灰度直方图统计,作为每个超像素区域的静态特征。灰度直方图是图像灰度级的函数,反映的是图像中各灰度出现的概率,是图像基本的统计特征。

2)运动特征计算

1)在每个超像素区域内选取K个梯度最大的点,作为每个超像素区域的初始跟踪点{p(i),=1, 2, …,K}。

2)正向跟踪。利用Lucas-Kanade光流算法得到对应的跟踪点系列{p+1(i),=1, 2, …,K}。

3)反向跟踪。将第+1帧中对应跟踪点{p+1(i),=1, 2, …,K}作为初始点,利用Lucas-Kanade光流算法反向跟踪得到对应的跟踪点系列{p¢(i),=1, 2, …,K}。

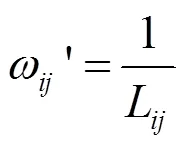

4)计算跟踪误差,剔除50%误差值高的跟踪点,剩下50%跟踪效果好作为有效跟踪点用于计算该超像素区域的运动特征。计算有效跟踪点的运动速度,然后取平均值作为该超像素区域的运动特征。

2.2.2 显著图生成

本文对每个超像素区域提取静态灰度特征和运动特征,分别计算静态显著性和运动显著性图,最后将2个显著图加权求和得到最终的时空显著图。

1)静态特征显著性

对每个超像素区域提取灰度直方图特征,每个超像素区域的静态显著性计算公式为:

式中:表示图像中除超像素区域以外的超像素区域。2个超像素之间静态特征差异性定义为:

式中:2(f,f)表示两超像素区域灰度直方图特征的卡方距离;为所有超像素区域的卡方距离的均值。权重超像素区域r,r中心位置欧氏距离的反比,然后进行归一化得到。计算方法如下:

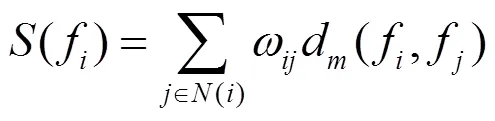

式中:L表示超像素区域r,r(x,y)(x,y)的欧式距离,即2个超像素之间的距离越近,则权重值越大,距离远的超像素的权重小。每个超像素区域的静态显著性是与图像中所有超像素区域的静态特征对比计算出的,所以是全局对比度的度量。

2)运动特征显著性

每个超像素区域利用中值流算法计算运动特征(2.1节中所述),对于目标的运动显著性,目标和周围邻域环境具有运动差异性,提取每个超像素区域的运动特征,计算每个超像素区域运动特征和其相邻超像素区域之间的差异性,计算公式:

式中:(i)表示超像素区域相邻超像素的集合;=1/L即为超像素区域r,r中心的欧氏距离的反比,然后进行归一化得到,计算方法与静态特征显著性中权重计算方法相同。运动特征差异性定义为运动速度矢量的欧氏距离:

3)静态、运动显著性图融合

通过计算静态灰度特征对比度和运动特征局部对比度得到静态显著性图和动态显著性图,由于2个显著性图的计算方法不同,其取值范围也不同,将两个显著性融合的过程中可能无法体现不同特征的显著程度,因此采用ITTI模型[15]中规范化算子将两种显著性图进行规范化,消除不同特征显著性图的动态范围的差异性,然后通过线性加权得到最终的时空显著性图。规范化算子的处理流程如下:

①将图像中的数值标准化量化至固定量级[0,…,],目的是消除不同的幅值差异;

3 基于恒虚警处理和运动连续性的目标检测

首先对显著性图采用最大对比度分割算法进行分割,然后根据利用恒虚警处理技术对分割结果进行处理,最后通过运动连续性获得最终目标。

3.1 基于最大对比度分割算法的显著图分割

在对显著性图分割的过程中,一般希望可以自动的获取最佳阈值,而不是人工设定。本文采用最大对比度分割算法实现对显著性图的分割。该算法的主要思想是最佳分割门限应该是使图像对比度最大的灰度值。绝对对比度定义为:

式中:()为高于阈值区域的灰度平均值;()为低于阈值区域的灰度平均值。

最佳分割阈值由公式(9)计算得到:

该分割算法可以自适应的计算阈值,不需要人工设定参数,适应范围比较广。

3.2 基于恒虚警处理和运动连续性的目标检测

对于分割效果而言,如果目标区域显著性值比较高,则很容易就将目标和背景分割开来,反之如果存在多个干扰区域,显著性同样比较高,则该分割算法仍会保留较多细节,而不至于将目标丢失。如果分割出多个目标,则对分割后结果本文采用恒虚警处理技术对结果进行处理。

采用恒虚警处理技术[16]对于分割出多可疑似目标的情况进行处理,使得输出的目标个数恒定。具体来说,首先给定恒虚警数CFA,如果显著性图分割目标数目小于恒虚警数CFA则直接输出目标检测结果。如果分割目标个数大于恒虚警数CFA,则分别计算每个疑似目标的“信噪比”,即目标的可能性指数。定义信噪比计算公式如下:

目标运动连续性是指在图像序列中目标是稳定的,持续存在的。各种背景干扰或者虚假目标只存在某一帧或者某些帧图像中,而目标是稳定存在的。本文在计算得到单帧恒虚警处理结果后,对连续多帧图像进行结果对比,在连续几帧图像中,目标位置变化不会很大,若某一位置附近一直存在疑似目标,则认为该疑似目标持续存在。利用目标的运动连续特性排除虚假目标,得到最终目标。

4 实验及结果分析

实验选取几组不同类型目标进行目标检测试验,试验平台为Matlab 2009,PC配置为CPU:Core i5,主频2.8GHZ,内存4GB,硬盘1T。部分实验结果如图3、图4所示。

图4 显著性图实验对比图

如图3为本文算法目标检测结果图,其中(a)为输入图像,(b)超像素分割结果,从分割结果可以看出利用SLIC算法初步对图像进行超像素分割,得到分布和大小均匀的超像素块。(c)为利用运动该特征和图论模型对超像素进行区域合并的结果,从结果可以看出由于目标运动的一致性和背景中局部一致性,新生成的超像素图像整体结构信息优于合并之前,这样在计算对比度时不会因为几个超像素区域具有相同特性而影响对比度的计算。(d)、(e)为计算得到的静态显著性图和运动显著性图,并分别归一化后线性求和得到最终显著性图(f)。(g)、(h)、(i)为连续3帧的恒虚警处理结果。(j)、(k)、(l)为利用于运动连续性得到的目标检测结果。由结果可以看出,运动连续特性是运动目标和背景分离的重要信息,目标在连续多帧图像中具有始终存在特性和运动特性保持稳定性等特征,在加上目标在静态单帧图像中与背景具有的差异性,综合静态差异和运动差异,最终实现目标的检测。

如图4将本文显著性计算模型和其他显著性计算模型进行对比,图中(a)~(e)分别为经典Itti模型[15]、GBVS显著性模型[17]、Context-Aware显著性方法[18]、AIM模型[19]和SR显著性计算方法[20]的实验结果图,(f)为本文实验结果图,由图中可以看出本文基于区域对比度的显著性计算方法,由于基于超像素区域的生成,可以保留目标的整体形状信息,并且可以减少大面积干扰的影响,生成的显著性图利于后续分割算法和恒虚警处理。

5 结论

本文主要利用区域对比度计算目标显著性图,利用运动连续性实现运动目标的检测。主要创新点有:①图论模型和SLIC算法结合计算超像素图像。将图论模型用于SLIC超像素区域的合并,利用目标的运动特征,实现超像素区域的合并,使得合并后超像素区域具有更好的整体结构信息。②显著性模型在计算区域对比度时通过全局对比度计算静态特征差异性,得到静态显著性图,通过局部对比度计算动态特征差异性,得到运动显著性图,融合得到最终的显著性图。③基于恒虚警处理方法以及运动连续性,提高算法精确度。实验结果表明,该方法检测结果稳定,针对复杂背景具有良好的鲁棒性,并且可以比较完整的保留目标的信息。

本项目研究成果一个重要应用方向就是高速高动态条件下的车辆视觉辅助导航,为了在夜间对可见光进行感知扩展,人们选择了许多非可见光波段的相机,其中首选的是红外成像传感器[21]。目前的车载夜间视觉系统中,中低端产品以采用主动式红外照明的近红外成像系统的为主,而高端则采用非制冷长波红外成像器,如宝马7系、奔驰S级等高级轿车,就加装了美国FLIR公司提供的PathFind IR非制冷长波红外热成像器,它可以在完全没有光照的条件下获取清晰的前方路面图像,具有远高于红外灯照明的探测距离和图像清晰度。红外图像主要反映物体的温度场和热辐射信息,因此可以获取驾驶人员夜间目视无法观测到的前方道路行人、车辆信息。运用本文所提算法可以较好的解决红外传感器图像中前方道路障碍物的快速探测及识别问题。另外,进一步优化算法、提高算法实时性是下一阶段研究的重点。

[1] Lipton A, Kanade T, Fujiyoshi H, et al.[M]. Pittsburg: Carnegie Mellon University, the Robotics Institute, 2000.

[2] Stauffer C, Grimson W E L. Adaptive background mixture models for real-time tracking[C]//, 1999, 2: doi: http: //dx. doi. org/ 10.1109/ CVPR. 1999. 784637.

[3] Kimura A, Yonetani R, Hirayama T. Computational models of human visual attention and their implementations: A survey[J]., 2013, 96(3): 562-578.

[4] Margolin R, Tal A, Zelnik-Manor L. What Makes a Patch Distinct?[C]//2013(), 2013: 1139-1146.

[5] Borji A, Itti L. State-of-the-art in visual attention modeling[J]., 2013, 35(1): 185-207.

[6] Borji A, Sihite D N, Itti L. Quantitative analysis of human-model agreement in visual saliency modeling: A comparative study[J]., 2013, 22(1): 55-69.

[7] Ni Q, Gu X. Video attention saliency mapping using pulse coupled neural network and optical flow[C]//2014(), 2014: 340-344.

[8] Luo Q, Geng Y, Liu J, et al. Saliency and texture information based full-reference quality metrics for video QoE assessment[C]//2014(NOMS), 2014: 1-6.

[9] 王爱齐, 邱天爽. 基于测地距离的超像素生成方法[J]. 大连理工大学学报, 2012, 52(4): 610-614.

Wang Ai-qi, Qiu Tian-shuang. Superpixels construction method based on geodesic distance[J]., 2012, 52(4): 610-614.

[10] Achanta R, Shaji A, Smith K, et al. Slicsuperpixels[R/OL].(),, 2010: http://ivrgwww.epfl.ch/supplementary_material/RK_SLICSuperpixels/.

[11] Sethian J A.:[M]. Cambridge university press, 1999.

[12] Yatziv L, Bartesaghi A, Sapiro G. O(N) implementation of the fast marching algorithm[J]., 2006, 212(2): 393-399.

[13] Kalal Z, Mikolajczyk K, Matas J. Forward-backward error: Automatic detection of tracking failures[C]//20(), 2010: 2756-2759.

[14] Felzenszwalb P F, Huttenlocher D P. Efficient graph-based image segmentation[J]., 2004, 59(2): 167-181.

[15] Itti L, Koch C, Niebur E. A model of saliency-based visual attention for rapid scene analysis[J]., 1998, 20(11): 1254-1259.

[16] Gandhi P P, Kassam S A. Analysis of CFAR processors in homogeneous background[J]., 1988, 24(4): 427-445.

[17] Harel J, Koch C, Perona P. Graph-based visual saliency[C]//, 2006: 545-552.

[18] Goferman S, Zelnik-Manor L, Tal A. Context-aware saliency detection[J]., 2012, 34(10): 1915-1926.

[19] Bruce N, Tsotsos J. Saliency based on information maximization[C] //, 2005: 155-162.

[20] Hou X, Zhang L. Saliency detection: A spectral residual approach[C]//, 2007: 1-8.

[21] 陈钱. 红外图像处理技术现状及发展趋势[J].红外技术, 2013, 35(6): 311-318.

Chen Qian. The status and development trend of infrared image processing technology[J]., 2013, 35(6): 311-318.

Moving Target Detection Algorithm Based on Superpixel Spatiotemporal Saliency

YUN Hong-quan1,2,XU Li1,2,SUN Xiao3,MING De-lie3,JU Wen1,2

(1.,100854,; 2.,100854,; 3.,,,430074,)

A new moving target detection algorithm based on superpixel spatiotemporal saliency is proposed to solve the problem of high false alarm and incomplete structure within moving target detection under complex background which takes into account of static characteristic and motion information of moving targets. Firstly, this algorithm extracts superpixels by image segmentation techniques, and builds a graph based on motion information and makes use of the graph theory for superpixels region emerging. Then, this algorithm calculates the static feature contrast and motion feature contrast of each superpixels to generate spatiotemporal saliency map. So the final saliency map can be obtained by fusing both the static and motion feature saliency map. Finally the target detection is achieved using constant false alarm processing and motion continuity feature. The experiment result shows that the algorithm is robust to complex background and detects intact information of the target.

superpixels,spatiotemporal saliency,motion continuity,constant false alarm

TP391.4

A

1001-8891(2015)05-0404-07

2014-09-25;

2014-11-20.

云红全(1984-),男,湖北孝感人,高级工程师,主要从事飞行器任务规划技术研究。E-mail:yunhongquan@sina.com。

国家自然科学基金资助项目,编号:61273241。