一种新的夜间交通流量检测方法

马永杰,李鹏飞,王 彬

(西北师范大学物理与电子工程学院,甘肃兰州 730070)

一种新的夜间交通流量检测方法

马永杰,李鹏飞,王彬

(西北师范大学物理与电子工程学院,甘肃兰州730070)

摘要:针对夜间交通监控面临的亮度不足、能见度不佳与光线反射干扰等,造成视频车辆检测器不能全天候准确检测的问题,提出一种基于车灯亮度、颜色、形状、位置、纹理等运动信息的夜间车辆检测系统.先找出可能为车灯的亮点,然后再判断属于同一车的可能性,并进行车灯配对,最后针对路面上碰触虚拟检测线的一对亮点进行计数.实验结果表明,本方法的平均准确率在96%以上,具有检测率高、鲁棒性强的特点,能够满足城市道路及高速公路的实时检测需求.

关键词:车流量检测;夜间交通监控;运动信息;车灯侦测配对;高检测率

中图分类号:TN 911.73

文献标志码:A

文章编号:1001-988Ⅹ(2015)03-0043-06

A new method of traffic flow detection at night

MA Yong-jie ,LI Peng-fei,WANG Bin

(College of Physics and Electronic Engineering,Northwest Normal University,Lanzhou 730070,Gansu,China)

Abstract:Aiming at the problem of the video vehicle detector in the night traffic monitoring that cannot accurately detect all-weather which caused by short of the brightness,poor visibility and light reflection interference.A kind of nighttime vehicle detection system based on light brightness,color,shape,location,texture movement information is proposed.Firstly,to identify possible light spot,and judge the possibility of belonging to the same car,and then do the light matching,finally count the pair of light spots touching the virtual detection line on the road.The experiment results show that the accuracy of this method in nighttime vehicle detection is above 96%,and this method is with the characteristics of high detection rate,strong robustness,and can meet the demand of real-time detection of city road and highway.

Key words:vehicles detection;nighttime traffic monitoring;movement information;lights matching;high detection rate

0前言

近年来,随着数字摄像与通讯传输设备的快速发展,智能型交通系统(Intelligent transportation systems, ITS)的研发在各国已逐渐成为必然趋势.相关研究包含了通讯、感测与控制、图像处理等多方面的技术,用来管控交通流量,减少堵塞情况,以提升各类车辆的流动性.智能型交通系统提供了很多便利:路人可以取得实时路况信息,安排行车路线或选择不同的交通运输工具;警方可根据实时路况来执行适当的交通管控策略.为了提供一个大众安全、便利迅速的交通环境,基于图像处理的智能交通监控系统的研发已成为刻不容缓的任务.

传统的方法大都是基于形态学处理,利用背景差分、帧间差分获得车辆的轮廓进行跟踪检测[1-3],然而这些方法受环境光线影响很大.此外,在夜间环境下,也会因为颜色纹理等信息的不足而大幅降低车辆辨识与追踪的效果.在交通监控图像中,若追踪路面上所有的车辆,在计算上将会相当耗时,当车流量大时尤其耗时.Cai等提出整合日夜间图像信息的方法,利用物体切割的技术,将夜间图像中不清楚的静态区域用日间图像中的相对位置来取代[4],但要在图像中妥善完整地切割出某种物体仍具有相当的难度,而且物体切割上的瑕疵将造成日夜间图像整合的不自然.为了产生看起来较为自然的夜间强化图像,Akito等将图像画面分成亮度和反射两个部分,然后参考日间图像改善夜间图像的亮度部分[5]. 尽管已有许多夜间图像强化的算法被提出,但夜间交通监控图像因前景与背景的对比度低,仍然无法利用背景去除法有效提取出前景车辆.为了克服此限制,Huang提出基于强烈对比分析的夜间物体检测与追踪算法,先利用局部性对比变化检测可能存在的移动物体,再用动向预测与空间邻近资料相关性减少错误检测[6].Kostia在夜间交通监控中采用HSV颜色模块Value∶Saturation(颜色值∶饱和度)的比例为特征,提取出画面中的明亮区块为车灯,最后经由一决定树(Decision tree)验证各车灯配对的假设,以达到车辆检测的目的[7]. Chen等则通过设定直方图的多重门阈值来切割画面中明亮物体,用以检测夜晚场景中的车辆.还有不少研究致力于夜间图像的强化[8],Sayed等提出改进传统的直方图等化(Histogram equalization)算法加强原始夜间图像的颜色信息[9].然而基于直方图等化的图像加强算法往往效果有限,因为原始场景许多细节信息在夜间画面中已经失去了.

因受亮度不足、能见度不高与光线反射等干扰因素的影响,夜间交通监控一直以来都有相当高的难度.文中提出一种新的夜间交通监控方法,针对城市公路夜间的监控视频,利用改进的车灯检测与配对分析夜间交通流量情况.在夜间交通监控图像中,车灯是最明显且最有用的特征,利用其颜色、亮度、形状等特征,先找出可能为车灯的亮点,接着再分析两车灯间的水平相关性、垂直相关性与两灯间的纹理量,推论两个车灯属于同一辆车的可能性,以进行车灯配对,而每组成功配对的车灯即表示一辆车.源于传统电感线圈的设计理念,在画面中设置一虚拟检测线,用来统计单位时间内通过的车辆数[10],最终把分析所得的交通信息提供给路人参考,合理安排路线、选择交通方式等.

1系统结构与研究方法

如图1所示,在夜间交通监控图像中各车辆几乎无法分辨,而画面中最明显且最具代表性的可见物体就是车灯.每一对车灯其实就代表着一辆车,因此可以通过车灯检测与车灯配对来评估图像中的交通情况.

图1 夜间与白天交通监控图像的差异

图2为文中所设计的夜间车灯检测系统结构流程图.首先,根据亮度(Luminance)特征找出影片画面中高亮度的区域(或亮点),并利用形状特征作进一步的确认,将不可能为车灯的部分滤除.为了加快影像处理速度并提高准确率,在画面中设置一虚拟检测线,就像传统电感线圈一样,用来检测通过特定区域的车辆.那么,只需针对触及此检测线的亮点进行车灯配对即可.在车灯配对的处理过程中,分析两亮点(车灯)的垂直相关性、水平相关性,以及两灯之间的纹理量来评估这两个亮点(车灯)属于同一车辆的可能性.最后,每一配对成功的车灯即表示一辆车,统计通过检测线的配对车灯数,就可以分析画面中的交通流量情况.

图2 夜间车灯检测系统结构流程

1.1车灯检测

观察大量的夜间交通监控视频后可以得知,车灯在画面中有两个主要的特性:① 亮度高;② 形状近似圆形.因此可以先利用亮度特征找出视频画面中高亮度的区域(或亮点),然后由形状特征再作一次确认,滤除非车灯的亮点.

1.1.1找出亮点首先,分析画面中车灯的颜色与亮度特性[11].图3(a),(b)分别为黄色与白色车灯的车辆,由内而外选取3个车灯像素,分析其RGB(R红色,G绿色,B蓝色)颜色合成值与亮度值(Luminance).

(a)黄色车灯的RGB与亮度

(b)白色车灯的RGB与亮度

像素的亮度值L(x,y)与RGB颜色合成值的计算关系式为

L(x,y)=0.299×R(x,y)+0.578×G(x,y)+

(1)

可以发现,在车灯中心部分其像素近似白色(RGB值约为255),RGB 3值很相近,且亮度较高;离车灯中心越远,RGB 3值的差异越大,而整体亮度也逐渐变弱.基于此特性,可将RGB变异度(RGB-Variation)作为参考量,借以辅助检测车灯亮点.RGB变异度V(x,y)的定义为

(2)

亮度L(x,y)高且RGB变异度V(x,y)低的像素可能为车灯像素,将被保留;反之,若亮度低或RGB变异度高,则不可能是车灯的部分,应被滤除.通常将亮度L(x,y)与RGB变异度V(x,y)的阈值分别设置为220和20.应用图像形态学的运算与相连区域分析所算得车灯像素,即得到可能为车灯的亮点区域.而画面中部分非车灯的亮点,如路面、路灯、车体边缘反光,它们同样具有高亮度,但因RGB变异度高可被滤除.

图4为亮点检测结果.图4(a)为原始夜间监控视频画面,红线为虚拟检测线,用以统计单位时间内通过的车辆数;图4(b)中显示所检测到的亮点区域.由此可以观察到两个重要的现象:① 除了车灯之外,车边缘、路灯因反光也会被检测到;② 远方的车灯因过度密集,相互靠得很近.因此,在画面近端设置一虚拟检测线,如图4(a)所示,后续处理将针对触及虚拟检测线的亮点作分析.由此,将不需要处理整个画面中的每个亮点,计算量将大幅减少,准确率也会提升.

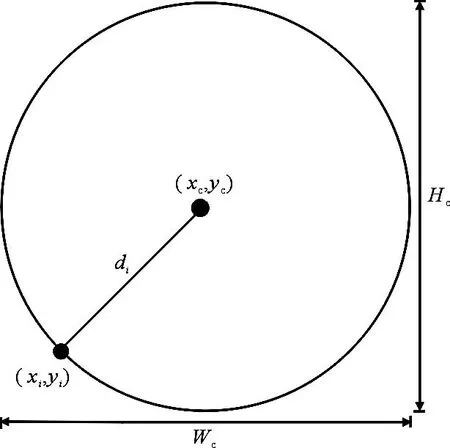

1.1.2形状确认画面中高亮度的区域多数为车灯,但也可能是路灯或是其他物体的反光,所以还需要利用形状特征来作进一步的确认.尽管因视角或其他因素的影响,车灯在画面中可能有些变形,但整体来说,其形状近似圆形.如图5所示,评估每一高亮度区域的形状接近圆形的程度,决定此亮点被保留或滤除.

针对每一个亮点,计算其每个边缘点(xi,yi)到中心点(xc,yc)的距离di,所有的di将形成一个

图5 计算亮度区域的近似圆形程度

集合D:

(3)

其中n是边缘点个数.如果此亮点为一完整的圆形,则所有的di应该会相等,也就是说,D的标准差是零.反之,如果该亮点的形状与圆形差异越大,则D的标准差也将跟着增加.D的标准差定义为

(4)

在此利用到自适应阈值(Adaptive threshold)Tσ:

(5)

其中Wc与Hc为亮点的宽与高(图5).若一亮点的标准差σ小于Tσ,则将其视作可能为车灯;反之则不可能为车灯,应被滤除.

1.2车灯配对

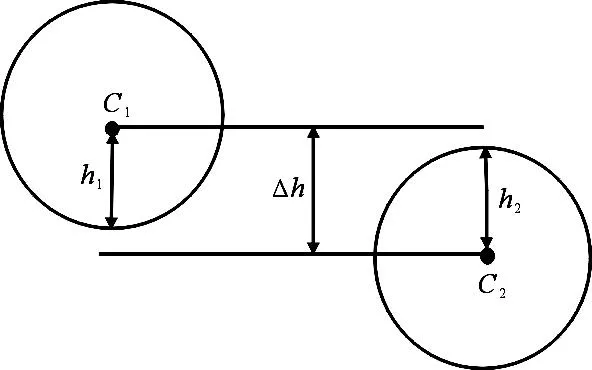

在夜间交通监控图像中,每一辆车可由一对车灯来表示[12,13],可以利用一些准则来评估任意两个车灯属于同一辆车的可能性.首先,由人眼观察画面中两车灯间的关系,可以得到以下几个特性:① 在一般路面呈水平的情况下,左右两车灯应该位于同一水平线上;② 一辆车左右两车灯距离略等于车体宽度;③ 相较于平滑的道路表面,车体本身会有较多的纹理,同一辆车左右两车灯间的纹理量会比不同车辆的车灯间的纹理量多.基于观察到的3个特征,可以定义3项准则,进行车灯配对.

1.2.1垂直相关性如图6,C1与C2为进行配对评估的两车灯,可假设C1比C2位置高,计算C1与C2两中心点的垂直距离Δh,及C1(C2)中心点到其下缘(上缘)的垂直距离h1(h2),进而定义两车灯的垂直相关性Rv:

(6)

图6 两车灯的垂直关系

如先前所述,在图像画面中沿垂直于马路方向设置一虚拟检测线(图4),且只针对触及此检测线的亮点(车灯)作配对,因此,两车灯的垂直距离Δh不会大于其各自中心点至上(下)缘的距离和,即

(7)

所以0≤Rv≤1.Δh越小,Rv越大,表示两车灯越接近同一水平线,属于同一辆车的可能性就越大.

1.2.2水平相关性交通法规中,对于车道宽度与车辆宽度均有规定,一般公路的宽度为3.65~3.75 m,而车宽为2.5 m.因此车宽∶路宽在区间[2.5/3.75,2.5/3.65]=[2/3,0.685]内.利用相关研究,可以计算出画面中虚拟检测线的路宽W,然后再计算画面中两车灯的水平距Δw与路宽W的比例,并定义两车灯的水平相关性Rh:

(8)

当两车灯水平距离Δw与路宽W的比例Δw/W落在合理范围[2/3,0.685]内时,设其水平关系为1;虽然在图像处理过程中,两车灯水平距离与路宽的计算可能会有误差,但是当其比例Δw/W小于1/3或大于1时,与合理范围差异过大,这表示这两个车灯不可能属于同一辆车,因此其水平相关性定为0;其余情况则考虑当Δw/W与标准比例(2/3)差异越大,则水平相关性越小.0≤Rh≤0.

1.2.3两车灯间纹理量透过Sobel边缘侦测,可以计算两车灯间区域内(图7)的边缘像素所占的比例Rt:

(9)

图7 两车灯间纹理量计算

其中,A为两车灯间的区域面积;E为此区域内的虚线边缘像素个数.Rt值越大,说明两车灯间的纹理量越多,表示两车灯属于同一辆车的可能性就越高.0≤Rh≤1.

有了垂直相关性Rv、水平相关性Rh及两灯间纹理量Rt这三项车灯配对评估值后,可以定义两车灯属于同一辆车的信心指数(Confidenceindex)I:

(10)

其中a,b,c 为Rv,Rh,Rt的相对权重(总和为1).I值越高表示此二车灯有较高的机率属于同一辆车.然后找出画面中所有车灯配对组合Pij形成一集合P:

(11)

其中n为画面中的车灯数,并计算各配对Pij的信心指数Iij,然后依次选取信心指数最高且Rv,Rh皆大于一阈值Tv的配对Pij,认证其为一车辆的左右车灯.在此选取Tv=0.5,因为若一车灯配对的垂直或水平相关性小于0.5,即表示不属于同一辆车.接着与此车灯配对Pij有共同车灯的其他配对则从集合P中去除.

此车灯配对的计算复杂度会随车灯数量的增加而呈指数增长,但使用虚拟检测线的方法,只需要针对触碰检测线的车灯作配对,而无需处理整个路面的车灯,因此本研究所提出的车灯配对计算比较快速.

2实验结果与讨论

车灯检测与配对结果如图8所示.图8(a)为夜间交通监控图像的原始画面,帧率为24帧/s,分别选取第72帧、第432帧、第504帧进行验证,红线为所设置的虚拟检测线,用以统计单位时间内通过的车辆数.图8(b)显示画面中所检测到的亮点区域,可以看到除了车灯之外,汽车上缘、路灯及其他一些反光物也会被检测到,透过形状确认可以滤除这类反光.如图8(c)所示,红色表示经形状确认后滤除的亮点,白色为确认后被保留的亮点;最后,显示经由水平相关性、垂直相关性、两灯间纹理量,计算信心指数,分析所得到的车灯配对结果.以白色线连接的亮点为配对车灯.实验结果证明,文中提出的方法可以有效检测车灯并准确配对,因为只针对触碰虚拟检测线的车灯作分析处理,不需要对整个画面的车灯进行确认与配对,因此系统执行效率高,能供后续及时的交通情况分析.

图8 车灯检测与配对结果

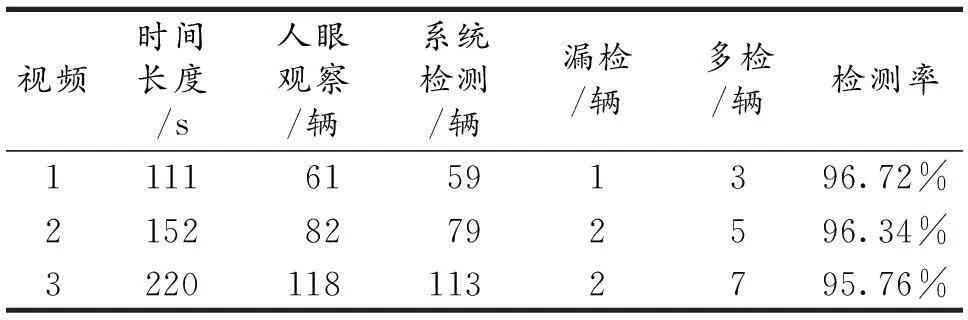

本实验的视频资料在晴天的夜间城市公路上拍摄,共拍摄了3个视频,实验平台为Inteli5 2 450M,2.50GHz,4核CPU,4G内存的个人电脑,借助于OPENCV图像处理数据库,用VC++编程实现系统的车辆检测与计数[14,15],表1分别列出了视频1、视频2、视频3的车流量检测结果,其中检测率R为

(12)

表1中视频1,2,3均是在晴天夜间拍摄,光线相对较好,拍摄距离近,场景较小.先由人眼观察完整视频后,得到人工观察车流量数据,然后由系统程序检测,得到程序检测数据;最后经过计算分析得到检测的准确率数据.可以看出,检测的平均准确率高达96%以上.主要误检发生在多检上,因为当车流量较大时,车辆相距较近,不同车辆的灯光相互影响,再加路面反光,在一定程度上会把两个不是同一车的车灯亮点误认为同一车的车灯进行配对,导致了多检测.

表1 夜间车流量检测统计结果

3结束语

在夜间交通监控图像中,车灯是最明显且最有用的特征,利用其颜色、亮度、形状、位置等特征,先找出可能为车灯的亮点;接着分析两车灯间的水平相关性、垂直相关性、纹理量,推论两个车灯属于同一辆车的可能性,再进行车灯配对,而每组成功配对的车灯即表示一辆车.源于传统电感线圈的设计理念,在画面中设置一虚拟检测线,用以统计单位时间内通过的车辆数.最终分析所得的交通情况可作为路人安排路径、选择交通方式的参考.

本研究以城市公路监控视频为实验资料,平均检测率高达96%以上,而且处理速度约为15帧/s,实验结果证明了本方法的高效性与鲁棒性.文中所叙述的研究方法为夜间交通监控系统的初始阶段,并没有考虑到恶劣天气(如雨天、雾天等),仍有许多方向需要努力.在未来的工作中,将考虑使用多重虚拟检测线,以分析更多的交通参数,例如车速、车流密度、车辆违章等,以期达到更完善的智能交通监控系统.

参考文献:

[1]唐佳林,李熙莹,罗东华,等.一种基于帧差法的夜间车辆检测方法[J].计算机测量与控制,2008,16(12):1811-1813.

[2]郭怡文,袁飞虎.基于背景差分的多车道车流量检测系统[J].电光与控制,2010,17(9):90-93.

[3]李从生,柏军,周广禄.基于帧差法的夜间城市道路车辆检测[J].制造业自动化,2011,33(2):212-214.

[4]CAIYH,WANGYH,HUANGKQ,etal.Contextenhancementofnighttimesurveillancebyimagefusion[C]//Proceedings of International Conference on Pattern Recognition.HongKong:InstituteofElectricalandElectronicsEngineers,2006:980-983.

[5]AKITOY,HIDENORITJ.Denighting:enhancementofnighttimeimagesforasurveillancecamera[C]//Proceedings of 19th International Conference on Pattern Recognition.Tampa:InstituteofElectricalandElectronicsEngineers,2008:1-4.

[6]HUANGK.Areal-timeobjectdetectingandtrackingsystemforoutdoornightsurveillance[J].Pattern Recognition,2008,41(3):432-444.

[7]KOSTIAR.Nighttimetrafficsurveillance:arobustframeworkformultiple-vehicledetectionclassificationandtracking[C]//Proceedings of International Conference on Advanced Video and Signal Based Surveillance.Genova:InstituteofElectricalandElectronicsEngineers,2009:1-6.

[8]CHENYL,WUBF,FANCJ,etal.Real-timevision-basedmultiplevehicledetectionandtrackingfornighttimetrafficsurveillance[C]//Proceedings of International Conference on Systems,Man,and Cybernetics.SanAntonio:InstituteofElectricalandElectronicsEngineers,2009:3352-3358.

[9]SAYEDMS,DELVAJ.Lowcomplexitycontrastenhancementalgorithmfornighttimevisualsurveillance[C]//Proceedings of the 10th International Conference on Intelligent Systems Design and Applications.Cairo:InstituteofElectricalandElectronicsEngineers,2010:835-838.

[10]钱凯,吴晓红,沈清波.基于虚拟线圈的夜晚车辆检测[J].微型机与应用,2014,33(3):35-37.

[11]刘勃,周荷琴,魏铭旭.基于颜色和运动信息的夜间车辆检侧方法[J].中国图象图形学报,2005,10(2):187-191.

[12]祁秋红,陈启兴.基于尾灯跟踪的夜间车辆检测[J].通信技术,2012,45(10):58-60.

[13]刘莉,潘晓露,李一民.基于视频的夜间车流量统计[J].微处理机,2012,33(1):67-70.

[14]于仕琪,刘瑞桢.学习OPENCV:中文版[M].北京:清华大学出版社,2009:399-450.

[16]谭荣伟,雷蕴奇,陈柏生.夜间运动车辆检测[J].计算机工程与应用,2005(13):227-228.

[17]王鹏,黄凯奇.基于视频的夜间高速公路车辆事件检测[J].中国图象图形学报,2010,15(2):301-306.

[18]陈柏生.基于图像处理的夜视车辆检测[J].微型机与应用,2012,31(5):36-38.

(责任编辑惠松骐)

作者简介:马永杰(1967—),男,甘肃灵台人,教授,博士.主要研究方向为进化算法与嵌入式系统.

基金项目:甘肃省自然科学基金资助项目(096RJZA115);甘肃省教育厅科研项目(0901B-08)

收稿日期:2014-09-27;修改稿收到日期:2014-11-18

E-mail:489358269@qq.com