基于连续帧间差分和背景差分法在输液速度检测中的研究

袁 伟 , 王金明 , 吴加明 , 秦水介

(1.贵州大学 大数据与信息工程学院,贵州 贵阳 550025;2.贵州省光电子技术及应用重点实验室 贵州 贵阳 550025)

医疗中输液速度直接影响治疗效果,目前对医疗中输液速度检测有机械称重检测、电容计量式输液检测和红外检测等,本文首先通过摄像机录取15帧/秒的20分钟输液视频,本文将输液时液滴变化过程当成对液滴运动目标的检测,通过算法分析液滴的整个过程,选取其中一个过程作为液滴速度检测的依据。目前有3种常用的目标检测方法,分别是帧间差分、背景差分和光流法。

背景差分是利用当前图像与背景图像进行差分,其算法简单,但受环境光线变化等干扰,就容易将一些伪目标判别为运动目标,影响准确性。本文所提取的视频在室内且时间相对较短,光线干扰较小。

光流法利用序列图象每帧的像素矢量特征来检测运动区域,计算较为复杂,抗干扰能力差,实时性差,因此本文不采用光流法

帧间差分通过对液滴视频图像序列中的连续两帧或三帧图像作差运算,利用时间提取运动区域,传统的帧间差分实现简单,计算速度快,但对移动缓慢,则不能完全提取出完整的运动信息,可能出现漏检的情况[1-2]。

本文为了准确检测出液滴的整个过程,结合了背景差分和帧间差分的优点,将连续帧间差分与背景差分相容合运用到医疗中输液液滴速度检测中,准确的计算出液滴的速度。

1 算法原理

1.1 连续帧间差分法

传统的帧间差分易产生空洞现象,不能检测出完整目标和对缓慢的运动物体不敏感的局限性。文献[1]出了积累的帧差法,通过求取连续张序列图像前后帧差所共有的部分来得到运动区域,避免因为目标运动速度慢而无法检测的情况。基于此本文将使用连续帧间差分[2],其算法如下:

图1 连续帧间差分流程图Fig.1 The flowchart of continuous frame difference method

以连续5帧序列的液滴视频为例,主要运算步骤:

1)设液滴视频 n 帧图像序列为{f1(x,y),…,fk(x,y),…,fn(x,y)},其中,fk(x,y)表示视频的第 k 帧图像,读取连续的 5帧图像,分别计算相邻两帧之间的差值,即

d(k,k-1)(x,y)=|fk(x,y)-fk-1(x,y)|d(k-1,k-2)(x,y)=|fk-1(x,y)-fk-2(x,y)|

d(k-2,k-3)(x,y)=|fk-2(x,y)-fk-3(x,y)|d(k-3,k-4)(x,y)=|fk-3(x,y)-fk-4(x,y)|

2)对所得到的差值进行求和运算

∑D=d(k,k-1)+d(k-1,k-2)+d(k-2,k-3)+d(k-3,k-4)

3)对图像进行求平均

r=∑D=/4

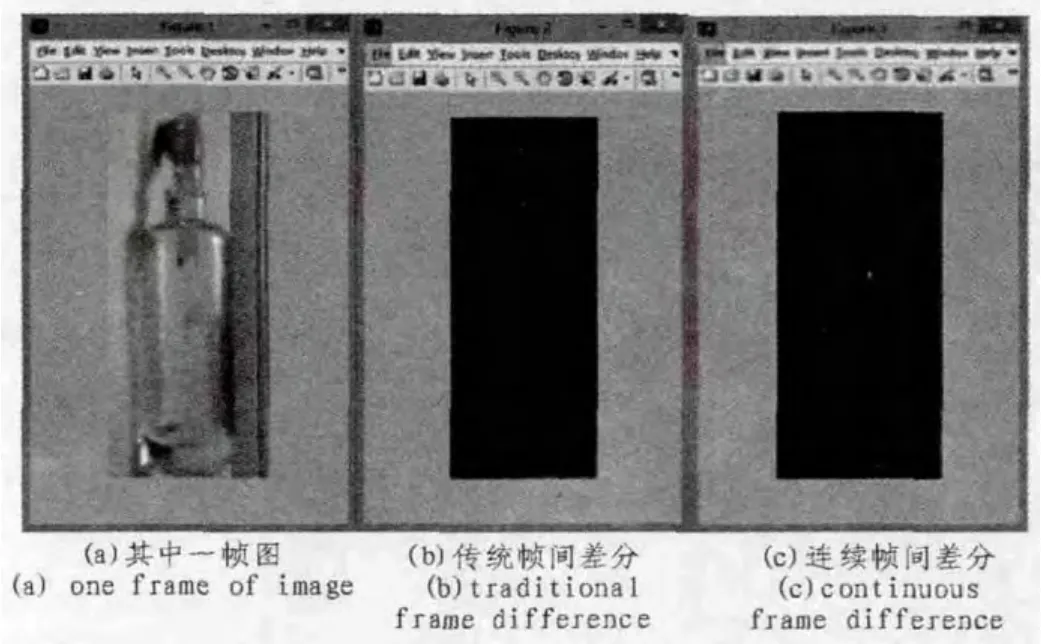

连续帧间差分方法充分利用了积累差分方法的优势,很好的对运动区域检测和目标增强,对差分图像求和平均,减弱了环境因素和噪声对目标的影响。在液滴刚形成的时候,目标运动移动相对较慢且液滴相对较小,容易漏检检测效果不佳。下图2是传统帧间差分和连续帧间差分对液滴图像的检测。

图2 传统帧间差分和本文提出的连续帧间差分结果对比Fig.2 Compared the results of traditional frame difference and continuous frame difference method

图2 中第一幅图为输液图像序列中的一幅图,第二幅为传统的帧间差分效果,第三幅为连续帧间差分,从效果上看,连续帧间差分能够较好的检测出液滴的运动过程。

1.2 背景差分法

背景差分法是利用通过当前图像与背景图像的差分来检测目标,其原理可以表示如下:

dk(x,y)=|fk(x,y)-bk(x,y)|

其中 fk(x,y)为当前帧,bk(x,y)为当前帧的背景帧,dk(x,y)是当前帧的差分。

1.3 结合连续帧间差分方法与背景差分对液滴运动的检测

该方法主要思想是先通过连续帧间差分法对运动目标粗略检测,然后采用滤波的方法再对所得到的帧差图像作进一步的处理,在此基础上,对滤波后的背景图像

图3 本文算法流程图Fig.3 The flowchart of presented algorithm

本文首先通过摄像机录取15帧/秒的一段输液视频,然后通过Matlab工具提取出每一帧的图像,运用1.3的算法分析液滴的整个过程,从中寻找出计算液滴速度的依据。

2 液滴速度检测

2.1 液滴图像分析

一般液滴滴落有3个过程,即液滴的形成、液滴的下落过程、液滴滴落液面。本文采用1.3的算法对液滴的3个过程进行分析,从液滴滴落的过程中寻找出计算液滴速度的方法。最终本文采用液滴滴落液面过程作为计算液滴速度的依据[5]。图4为液滴的下落过程。

①在液滴刚刚形成的过程中,由于液滴和滴斗都是透明的,图像并不像想象的那样边沿由小变大,而是不规则的,变化很小,很难判断,因此本文不采用液滴形成过程作为计算液滴速度的依据。

②液滴的视频图像为15帧/秒,由于时间过短和液滴透明的的原因,在液滴的形成和滴落过程中是很难捕捉的。因此本文也不采用这两个过程来计算液滴速度。

③液滴滴落到液面时,会在液斗的下面液面部分抖动一下,液面的抖动到平静要有个过程,因此液面滴落这个过程是计算液滴速度的最好过程

下面将对液滴滴落液面的过程进行仔细分析,进而找出计算液滴速度的有效方法。

2.2 液滴滴落液面的分析

液滴从管口落下,滴落到液面中,导致液面有相对剧烈抖动。这个抖动并不会因为液滴的滴下而立刻恢复平静,而是会持续一段时间。如图5所示。

从图5可以看出,在液滴滴落液面时,液面发生抖动,此过程有好多帧图像,因此很容易捕捉。为了减少计算,本文只需要计算液滴滴落液面的小区域,通过统计液滴滴落液面的小区域运动像素点,对其进行阈值处理,即可计算出液滴速度[5]。

图4 液滴下落过程Fig.4 The dropping process

图5 液滴滴液面过程Fig.5 The dropping process

2.3 运动像素点的统计

本文只需要计算液滴滴落液面的小区域,通过统计液滴滴落液面的小区域运动像素点的个数,运动像素点统计如图6所示。

图6看出,液滴引起的液面震动运动像素点在200~450之间。因此对其进行阈值处理即可计算液滴速度。

2.4 液滴速度的计算

图6 运动像素点统计Fig.6 Statistics movement pixel

本文取15帧/秒,统计60秒内运动像素点可以判断出速度。通过上图,可以看出,运动像素点在[200,450]之间表明有一滴液滴滴落,因此本文只需给出一个阈值,来统计在阈值内有多少个数就可以计算出液滴的速度。通过观测本文取运动像素点值大于300则算有一滴液滴滴落液面,则速度公式为:

V=60*15*sum/number(frame)

根据图6,可计算液滴的速度V=60*15*3/80=33.75≈34(滴/分),因此本文这段视频液滴的速度为34滴/分。与实际速度相符。

3 结束语

本文将连续帧间差分与背景差分方法相结合运用到液滴速度的检测,有效的解决了背景差分和帧间差分中可能出现的无法检测目标的现象,较好的实现了对液滴滴落过程的分析。实验表明该方法能够有效的检测出液滴速度,且运算简单,易于实现,对医疗中液滴速度检测具有一定的参考价值。

[1]许悦雷,左继章.一种累积帧差视频对象的分割算法[J].光电工程,2004(7):70-72.XU Yue-lei,ZOU Ji-zang.A video object segmentation algorithm frame difference[J].Accumulate.Optical Engineering,2004(7):70-72.

[2]屈晶晶,辛云宏.连续帧间差分与背景差分相融合的运动目标检测方法[J].光子学报,2014(7):219-226.QU Jing-jing,XIN Yun-hong.Continuous frame difference and background difference fusion of moving target detection[J].Photons Journal,2014(7):219-226.

[3]王振亚,曾黄麟.一种基于帧间差分和光流技术结合的运动车辆检测和跟踪新算法[J].计算机应用与软件,2012(5):118-120.WANG Zhen-ya,ZENG Huang-lin.A moving vehicle based on intervframe difference and optical flow technology combined with the detection and tracking of new algorithms[J].Computer Applications and Software,2012(5):118-120.

[4]陈俊超,张俊豪,刘诗佳,等.基于背景建模与帧间差分的目标检测改进算法[J].计算机工程,2011(12):172-173.CHENJun-chao,ZHANGJun-hao,LIUShi-jia,et al.Improved target detection algorithm based on background modeling and frame difference[J].Computer Engineering,2011(12):172-173.

[5]陈文鼎.基于嵌入式系统的液滴流速监测设计与实现[D].南京:南京理工大学,2013.

[6]孙欢,尚绪凤,朱赵龙,等.交通监控系统中帧差法和背景优劣法分析[J].电子科技,2012(10):1-3.SUN Huan,SHANG Xu-feng,ZHU Zhao-long,et al.Performance analysis for the frame difference and background difference methods in the traffic surveillance system[J].Electronic Sic.&Tech,2012(10):1-3.