随机图像选取与自适应背景更新的运动物体检测

李新县,余 烨

(合肥工业大学计算机与信息学院VCC研究室,安徽 合肥 230009)

Li Xinxian, Yu Ye

(VCC Division, School of Computer & Information, Hefei University of Technology, Hefei Anhui, 230009, China)

由于复杂背景、光照变化、目标相互遮挡等因素的存在,运动目标检测一直是计算机视觉领域的研究热点和难点。主流的运动目标检测方法有帧差法、光流法和背景差分法。帧差法对光线变化有一定的容忍性、背景更新快、自适应能力强,但其无法检测尺寸较大、内部颜色一致及运动速度快的物体。光流法由于其计算复杂、抗噪能力差,因而难以应用于实时系统中[1]。背景差分法的核心思想是通过当前图像与背景图像的比较来检测运动物体,其效果取决于以下3个因素:背景模型的表示方法、背景的初始化方法及更新方法。从实际应用角度来看,背景差分法是使用较多的一种方法。

如何构造一幅好的背景是背景差分法的难点,最简单的背景构造方法是预先采集一帧没有前景目标的图像作为背景,由于摄像机监视的动态场景往往会受到外界因素干扰(如天气变化、光照变化、背景骚动以及运动物体产生的阴影等),这就要求背景能够自适应的更新。针对这一问题,一种经典的方法,时间平均法(time-averaged background image,TABI)被提出来,即读取一段时间内的视频帧求和再平均,即可获得一个近似的背景图像,但此方法最致命的缺点是容易造成前景目标与背景的混合现象如图5(b1)所示,从而导致检测出虚假的目标物体。

有的学者采用统计平均法,即通过对连续图像序列进行统计平均来获得背景图像。例如Sapiro[2]假设背景在图像序列中总是经常被观测到,提出了一种基于偏微分方程的背景重构和运动目标检测算法;Tavakkoli和Lee等[3-4]利用高斯内核非参数估计法来计算像素点的概率密度,提出一种无参数的内核密度估计法;齐美彬等[5]提出一种新的基于“背景点像素值出现频次最高假设的背景重构算法”,在前景点灰度值出现的概率大于背景点灰度值出现概率的情况下,仍然能够正确的重构背景;Long和Yang[6]提出一种自适应平滑算法,认为在一段图像序列中,像素点处于稳定状态最长的灰度值可能是前景目标,此时就会产生错误的结果;Gutchess等[7]对此进行了改进,在算法中引入了光流场计算,把运动目标产生的稳定状态最长的灰度值去掉,从而得到了正确的结果,但是光流场的加入增加了计算的复杂性;Gloyer等[8]假设在训练阶段背景至少在50%的时间内可以被观测到,从而提出了中值法(median),即将图像序列中处于某个像素点中间的灰度值认为是该点的背景像素灰度值,W4系统[9]在背景图像训练阶段使用了该方法;但是,如果背景图像在少于50%的时间内被观测到,中值法就会得到错误的结果。

有的学者采用基于建模的方法来提取背景,如Stauffer和Grimson[10]提出用K个高斯分布的混合模型表示背景像素的分布规律来提高背景的精确度;白向峰等[11]对混合高斯模型进行空间邻域拓展,在空间邻域中利用背景与前景隶属度之间的竞争确定像素的归属,提高了检测精度。Magee等[12]在背景建立混合模型的基础上又建立了多个前景模型,实现了更为有效的检测;Wren等[13]对背景模型中每个像素建立一个高斯分布,在不含有前景的室内环境中进行初始化后,实现了在室内环境中对人的检测和跟踪;Toyama等[14]从图像的像素级和区域级对背景进行重构,并且采用了Wiener滤波实现了背景的自适应更新;Zivkovic等[15]采用了像素分析方法,对每一个像素都建立一个先验概率密度函数来更新像素值,但是这种方法的计算量大,难以满足实时性要求;Suo和Wang[16]对Zivkovic等[15]提出的方法进行了改进,提出了一种改进的自适应混合模型的方法,降低了运算量,实现了物体的实时检测,但是,当场景出现扰动时此方法失效。Barnich和Van Droogenbroeck等[17]利用采样一致性以及随机更新策略实现了轻微扰动场景运动目标快速检测。Godbehere等[18]将统计的方法和贝叶斯估计法结合在一起,提出了一种启发式信心模型的方法对物体进行检测,在光照发生快速变化时此方法仍然能够检测出运动物体,但是此方法无法消除阴影的影响(图4(e2)和图4(e3))。最近,王斌等[1]提出采用时空条件信息的运动物体检测算法,以像素邻域加权条件信息作为分类特征,增强目标与背景的线性可分性,提高运动目标检测精度,取得了很好的效果。

通过以上分析可以看出时间平均法构造出的背景容易出现混合现象,从而导致检测出虚假的目标物体;统计平均法有一定的假设限制(例如,假设背景图像总是在序列中被经常观测到),虽然Gutchess等[7]通过引入光流计算对此问题进行改进,但是光流计算降低了算法的效率;基于建模的方法,检测结果基本令人满意,但是算法的计算量很大,难以满足实时的应用需求。

针对上述方法的不足,本文提出了随机图像选取与自适应背景更新的运动物体检测方法。该方法首先从视频序列中随机选择一帧图像对背景进行初始化,然后构建变化标记矩阵,基于变化标记矩阵不断迭代更新背景,最后基于背景差分的方法进行运动目标的检测。实验结果表明,该方法具有一定的鲁棒性,在光照变化、运动物体间存在遮挡的情况下能够训练合适的背景,检测出目标物体。

1 随机图像选取与自适应背景更新算法

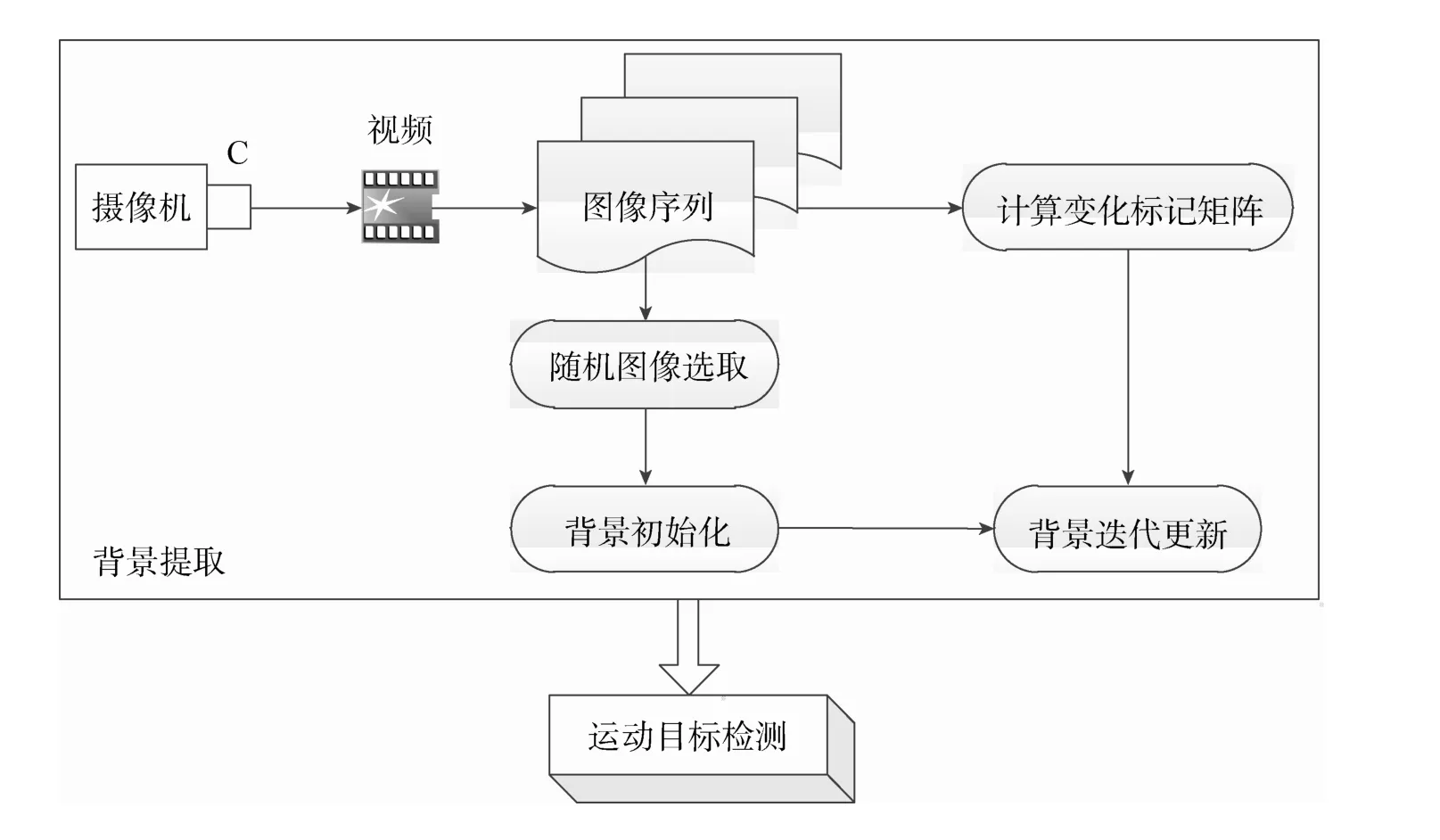

由于受光照变化、天气等因素的影响,不同时刻图像的差异很大,此时进行运动目标检测,构建能自适应更新的背景至关重要。本文算法属于背景差分法,其主要思想(如图1所示)为:基于随机图像选取方式进行背景的初始化,采用变化标记矩阵记录相邻两帧图像之间像素值的变化,依据此变化进行背景的迭代更新。在此基础上,实现运动物体的实时检测。算法的详细思路将在后续小节中进行描述。

图1 算法主要思想描述

1.1 变化标记矩阵

变化标记矩阵即与原图像大小相同的一个二维矩阵,用于记录相邻两帧图像之间像素值的变化。在进行背景更新时,依据变化标记矩阵的值自适应迭代更新背景。

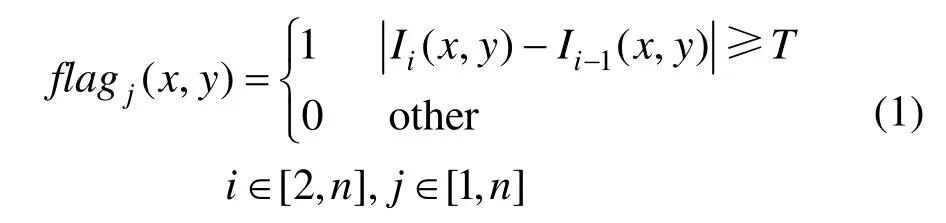

已知图像序列,则变化标记矩阵可通过式(1)计算获得。

其中,i,j分别表示视频序列的第i帧和通过相邻视频序列所求得的变化标记矩阵的下标(j=i–1);flagi(x,y)表示变化标记矩阵在(x,y)处的值,T为设定的阈值(本文中T的取值为60)。当变化标记矩阵的值为1时,表示相邻帧间变化较大;当变化标记矩阵值为0时,表示可能是微弱的光照变化或阴影而引起的像素值变化,此时不需要更新背景。

1.2 背景构造与自适应更新

本文算法能够从视频序列中随机选择一帧图像作为初始背景,然后根据变化标记矩阵自适应迭代更新背景,即可获得一幅清晰的背景图像。随机数的选取对背景的提取至关重要,如果选取的随机数集中在某一固定范围内,那么以此作为背景的初始帧构造出的背景可能会偏离真实的背景(例如,视频共500帧,如果生成的随机数总是在[450,480]内,那么在这一范围内最多对初始背景迭代更新30次,结果会有失真实性),因此,本文选取文献[19]中的随机数生成方法,使生成的随机数服从均匀分布,因而避免了初始帧的选取会集中在某一固定范围内。背景初始化之后,即依据变化标记矩阵来进行背景的迭代更新。背景初始化及背景迭代更新的算法描述如下:

步骤1.采用随机数生成器,产生一个随机数r,并设置计数器cnt=1。

步骤2.将第r帧图像framer作为初始背景图像B1和第一帧图像I1的值,即

步骤3.读取下一帧图像Ij,并与前一帧图像Ij-1相减,根据式(1)计算出变化标记矩阵flagj,j∈[1,n]。

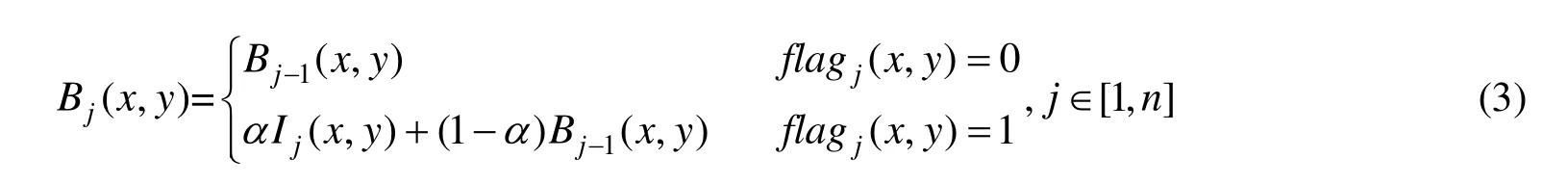

步骤4.根据变化标记矩阵flagj的值迭代更新背景,背景更新的公式如下:

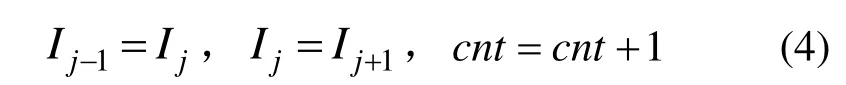

步骤5.读取下一帧图像,即Ij+1(j+1≤n),并为下一帧图像背景的获取做准备,即:

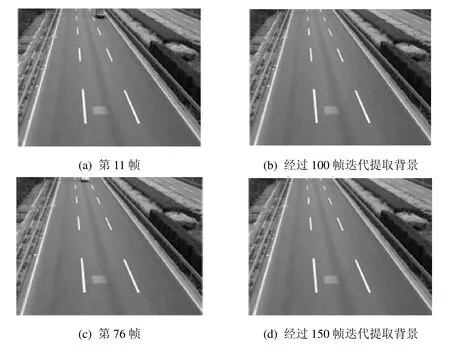

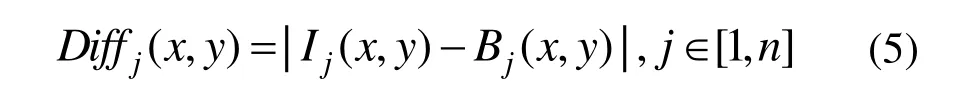

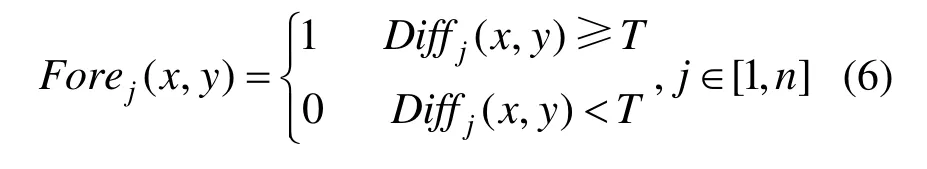

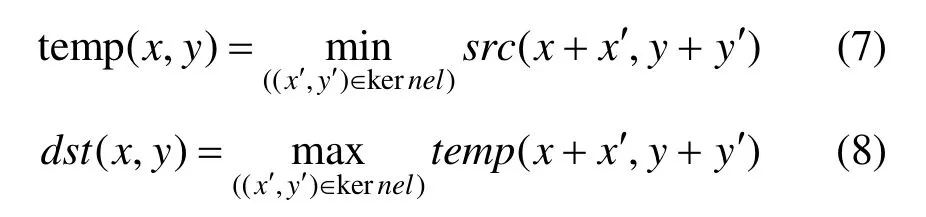

步骤6.如果计数cnt 其中,Ij(x,y),Bj(x,y),flagj(x,y)分别表示视频序列中的第j帧图像在(x,y)的值,第j帧的背景图像在(x,y)的值以及第j个变化标记矩阵在(x,y)处的值;T为固定阈值,α为加权系数,N为迭代更新的次数。参数的取值对于算法的结果有着至关重要的影响,如何选取有效的参数,Scotti等[20]对各种情况进行了详细地讨论,但是这些选取方法会增加算法的时间复杂度;为了降低计算成本,本文算法取经验值,T的取值为60,α的取值为0.3。 以某卡口处的交通视频为例,分别选取视频第11帧和第76帧作为初始背景,经过100次迭代更新后生成的背景图像分别如图2中(b)和(d)所示。 图2 初始帧迭代提取背景 采用本文算法提取的背景Bj,根据式(5)即可计算出差分图像Diffj。 然后根据式(6)即可获得前景图像,即目标物体: 其中,T为二值化阈值,此处取值为60。 由于光照变化的影响,当Forej(x,y)=1时,可能是由前景图像和光照变化引起的一部分噪声所组成,因此本文通过图像的后处理阶段来尽可能地消除噪声。如图3所示,图3(a)为当前帧,图3(b)为采用1.2节中背景更新算法所获取的背景,图3(c)为运动物体检测的结果,由于光线照射在道路的栅栏上,导致检测出由一些小斑点构成的栅栏形状的虚假目标物体。采用图像形态学中的开运算,即通过式(8)和(9)去除小的斑点和虚假的目标物体,最后的检测结果如图3(d)所示。 其中,kernel为3×3的矩形,核的锚点为核的中心。 图3 结果的后处理 将本文算法应用于背景提取和运动目标检测中,选取3组测试数据进行说明,分别为Pets2009行人序列、车辆序列和跳动的小球序列。将本文算法和时间平均法(TABI)、高斯建模法(MOG)[17]、VIBE方法[18]和GMG方法[21]的检测结果进行比较,实验结果如图4~6所示。详细分析如下: (1) Pets2009行人序列检测结果:使用Pets2009行人序列对TABI、MOG、VIBE、GMG和本文的方法进行测试,结果如图4所示,其中图4(a1)和图4(a2)分别是第159帧和第498帧图像。图4(b1)是通过时间平均法构造的背景,由于运动目标的影响,构造出的背景图像中出现了前景与背景混合的现象。图4(b2)和图4(b3)为TABI算法检测的结果,由于前景与背景混合的影响,图4(b2)和图4(b3) 中出现了虚假目标,检测出的目标物体也很不清晰,并且在图4(a1)中,两个人之间存在遮挡时,无法检测出被遮挡的行人;图4(c1)是通过高斯背景建模方法构造出的背景,由于高斯背景建模方法对光照的影响非常敏感,当强光照射在人的身体上产生阴影时,就会误判是运动物体,因此对背景的更新就会导致前景与背景的混合,混合程度取决于光照强度,故图4中可以看出图4(c1)的混合程度明显大于图4(b1);图4(c2)和图4(c3)为MOG算法检测的结果,由于混合现象的影响,检测出虚假的目标物体,受光照的影响,行人侧面的阴影也被当作目标物体;图4(d1)是VIBE算法提取的背景图像,从图中可以看出存在混合现象。图4(d2)和图4(d3)是VIBE算法检测的结果,从图中可以看出检测结果较清晰,但是在图4(d2)中出现了虚假目标;图4(e1)是GMG算法提取的背景图像,可以看出背景不存在混合现象。图4(e2)和图4(e3)为GMG算法检测结果,由于受光照的影响,将阴影当作目标物体检测出来;图4(f1)是使用本文算法构造出的背景,从图中可以看出本文算法构造出的背景不存在前景与背景的混合现象,图4(f2)和图4(f3)为本文算法检测的结果,从图中可以看出本文算法检测的目标物体清晰,并且在第159帧中出现遮挡时,检测出的目标轮廓清晰可见。 图4 Pets2009行人序列检测结果 (2) 车辆序列检测结果:使用车辆序列对TABI、MOG、VIBE、GMG和本文方法进行了测试,从图5中可以看出,5种方法提取出的背景都没有明显的混合现象,但是受光照的影响,5种算法构造出的背景的亮度却有所不同,MOG算法构造出的背景偏亮,TABI算法次之,VIBE和GMG算法提取的背景比较接近,本文算法构造出的背景亮度最接近真实背景;图5(b2)和图5(b3)为TABI算法检测的结果,可以看出车辆的轮廓暗淡,不清晰;图5(c2)和图5(c3)为MOG算法检测的结果,由于受光照的影响,检测出一些小的斑点和阴影,车辆的轮廓相对清晰;图5(d2)和图5(d3)为VIBE算法检测结果,图5(d2)中车的右前方存在缺损,图5(d3)中车的左侧检测出了阴影;图5(e2)和图5(e3)为GMG算法检测结果,由于受光照的影响,检测结果只能看见白色的团块。图5(f2)和图5(f3)为本文算法检测的结果,车辆的轮廓清晰可见,并且没有小的斑点,可以看出本文算法对光照变化鲁棒性强。 (3) 跳动的小球序列检测结果:采用跳动的小球序列对TABI、MOG,VIBE、GMG和本文算法进行比较(图6),在测试序列中小球始终处于弹跳状态且光线也随之变化。5种方法提取的背景都没有出现混合现象,但是光线有所不同,TABI和MOG算法最暗淡,VIBE和GMG算法次之,本文算法最接近真实的光线;图6(b2)和图6(b3)是采用时间平均法检测结果,出现了虚假的目标物体;图6(c2)和图6(c3)为MOG算法检测结果,结果中存在阴影;图6(d2)和图6(d3)为VIBE算法检测结果,可以看出在图6(d3)中右侧的阴影被检测出;图6(e2)和图6(e3)为GMG算法检测结果,图6(f2)和图6(f3)为本文方法检测结果,可以看出2种方法都取得了很好的效果,但是在图6(e3)中第一的小球的阴影比图6(f3)中稍大一些。 图5 车辆序列检测结果 图6 跳动的小球序列检测结果 为了评价本文的目标检测算法的性能,采用文献[22]中的评价标准:准确率(precision, P)和识别率(recall, R),P和R定义为: 其中,TP(true positives)表示被正确检测的前景像素数量,FP(false positives)表示背景误判为前景的像素数量,FN(false negatives)表示前景误判为背景的像素数量。算法性能的评价结果如表1所示(实验结果是通过对每个序列进行测试后得出的平局值),从表1中可以看出本文方法在检测率和识别率上高于其他算法。 表1 算法性能的评价结果 由于光照变化、遮挡现象、复杂背景等,视频背景的提取与实时更新一直是众多研究者努力的方向。本文提出了一种随机图像选取与自适应背景更新的运动物体检测方法,该方法的特点有:①通过从视频序列中随机选取一幅图像作为初始帧,以对背景进行初始化;②通过记录相邻两帧图像之间像素值的变化,构建变化标记矩阵,以自适应地迭代更新背景。通过实际的测试序列结果表明,本文算法有效地避免了前景目标与背景的混合现象,且对光照具有一定的鲁棒性。 由于本文算法中使用的参数是经验值,当采用Scotti等[20]提出的根据每帧图像实时求取参数的方法时,算法的检测率会有所提高,但同时,算法复杂度增加,实时检测困难,因此,如何在参数求取方法和复杂度之间取得平衡,提高算法的检测效率,是我们进一步的工作。 [1]王 斌, 肖文华, 张茂军, 熊志辉, 刘 煜.采用时空条件信息的动态场景运动目标检测[J].计算机辅助设计与图形学报, 2012, 24(12): 1576-1584. [2]Sapiro G.Geometric partial differential equations and image analysis [M].Cambridge: Cambridge University Press, 2006:150-158. [3]Tavakkoli A, Nicolescu M, Bebis G, Nicolescu M.Non-parametric statistical background modeling for efficient foreground region detection [J].Machine Vision and Applications, 2009, 20(6): 395-409. [4]Lee C S, Elgammal A.Modeling view and posture manifolds for tracking [C]//Computer Vision, 2007.ICCV 2007.IEEE 11th International Conference on,2007: 1-8. [5]齐美彬, 王 倩, 蒋建国, 安宝磊.基于背景像素值频次最高假设的背景重构算法[J].中国图象图形学报,2008, 13(4): 723-728. [6]Long W, Yang Y H.Stationary background generation:An alternative to the difference of two images [J].Pattern Recognition, 1990, 23(12): 1351-1359. [7]Gutchess D, Trajkonic M, Cohen-Solal E, Lyons D,Jain AK.A background model initialization algorithm for video surveillance.Proc [C]//of the 8th IEEE Int’l Conf.on Computer Vision.Vancouver, 2001: 733-740. [8]Gloyer B, Aghajan H K, Siu K Y, Kailath T.Video-based freeway-monitoring system using recursive vehicle tracking [C]//IS&T/SPIE's Symposium on Electronic Imaging: Science & Technology.International Society for Optics and Photonics, 1995: 173-180. [9]Haritaoglu I, Harwood D, Davis L S.W4: real-time surveillance of People and their activities [J].Pattern Analysis and Machine Intelligence, IEEE Transactions on,2000, 22(8): 809-830. [10]Stauffer C, Grimson W.Adaptive background mixture models for real-time tracking.Proc [C]//of the IEEE Computer Society Conf.on Computer Vision and Pattern Recognition, Vol 2.1999: 246-252. [11]白向峰, 李艾华, 蔡艳平, 李喜来, 李仁兵.复杂场景实时目标检测方法[J].计算机辅助设计与图形学学报,2012, 24(1): 104-111. [12]Magee D R.Tracking multiple vehicles using foreground,background and motion models [J].Image and Vision Computing, 2004, 22(2): 143-155. [13]Wren C R, Azarbayejani A, Trevor D, Pentland A P.Pfinder: Real-time tracking of the human body [J].Pattern Analysis and Machine Intelligence, IEEE Transactions on, 1997, 19(7): 780-785. [14]Toyama K, Krumm J, Brumitt B, Meyers B.Wallflower:principles and practice of background maintenance [C]//Computer Vision, 1999.The Proceedings of the Seventh IEEE International Conference on, 1999: 255-261. [15]Zivkovic Z, van der Heijden F.Efficient adaptive density estimation per image pixel for the task of background subtraction [J].Pattern Recognition Letters, 2006, 27(7):773-780. [16]Suo P, Wang Yanjiang.An improved adaptive background modeling algorithm based on Gaussian mixture model [C]//Signal Processing, 2008.ICSP 2008.9th International Conference on.IEEE, 2008: 1436-1439. [17]Barnich O, Van Droogenbroeck M.ViBe: A universal background subtraction algorithm for video sequences [J].Image Processing, IEEE Transactions on, 2011, 20(6):1709-1724. [18]Godbehere A B, Akihiro M, Ken G.Visual tracking of human visitors under variable-lighting conditions for a responsive audio art installation [C]//American Control Conference (ACC), 2012.IEEE, 2012: 4305-4312. [19]Multiply-with-carry [G/OL].wikipedia, (2013-4-11)[2013-5-2].http://en.wikipedia.org/wiki/Multiply-with-carry. [20]Scotti G, Marcenaro L, Regazzoni C S.SOM based algorithm for video surveillance system parameter optimal selection [C]//Proceedings.IEEE Conference on Advanced Video and Signal Based Surveillance, 2003.IEEE, 2003: 370-375. [21]Elhabian S Y, El-Sayed K M, Ahmed S H.Moving object detection in spatial domain using background removal techniques-state-of-art [J].Recent Patents on Computer Science, 2008, 1(1): 32-54. [22]Ko T, Soatto S, Estrin D.Background subtraction on distributions [C]//Computer Vision-ECCV 2008.Springer Berlin Heidelberg, 2008: 276-289.

1.3 运动物体检测与分割

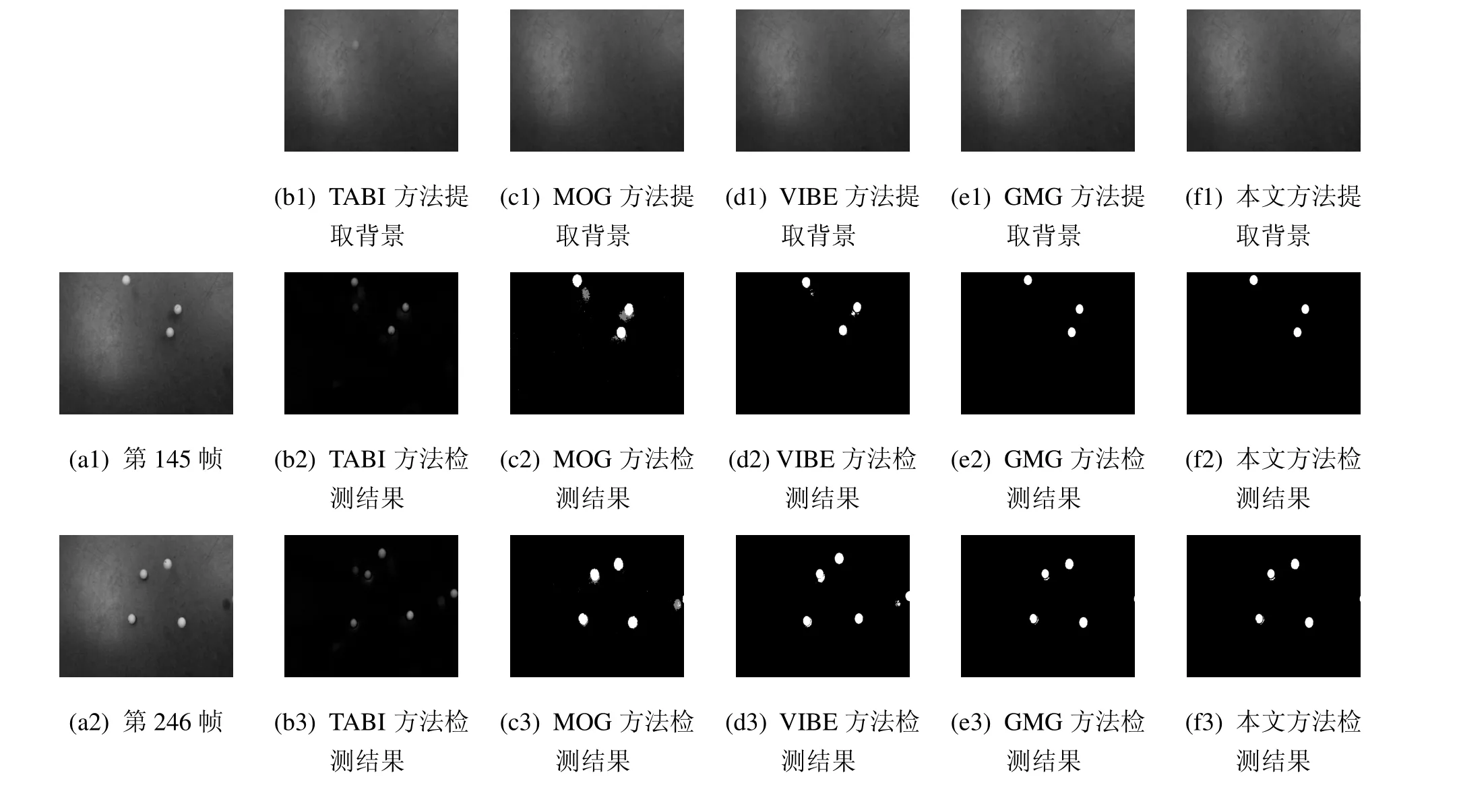

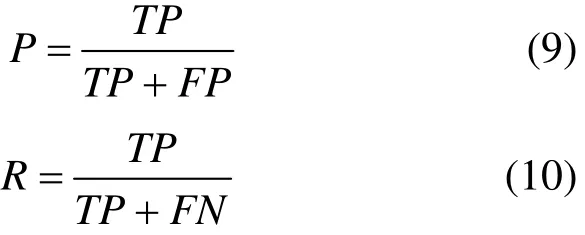

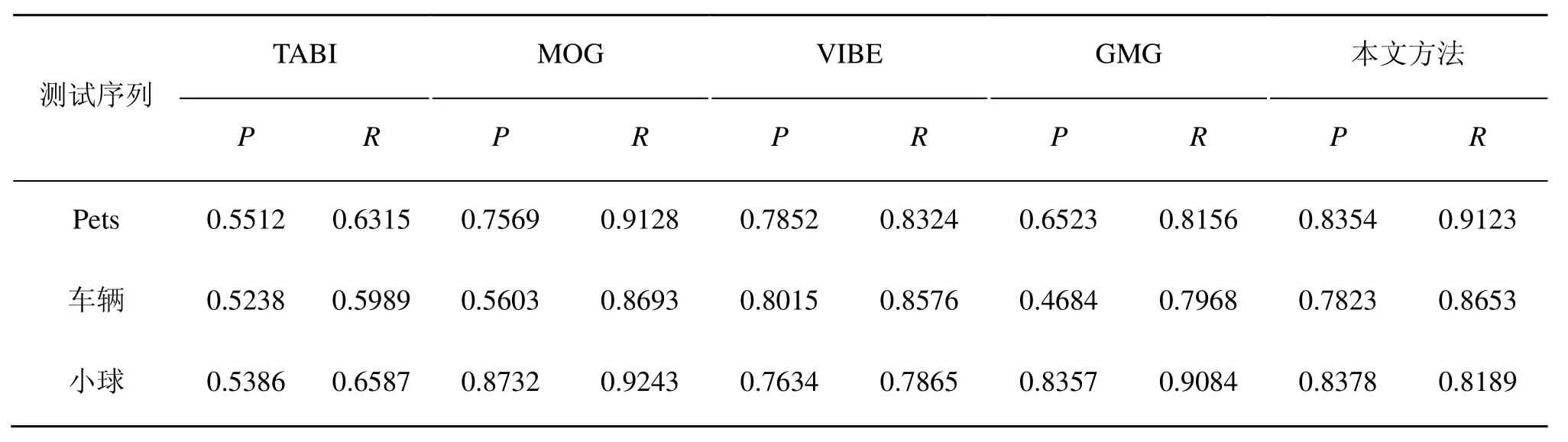

2 实验结果与分析

3 结 论