多特征提取的红外和可见光目标跟踪方法

赵高鹏,薄煜明,陈益

(南京理工大学 自动化学院,江苏 南京210094)

可见光传感器具有分辨率高、成本低的特点,因此大量跟踪算法的研究[1-3]都是针对可见光传感器的,然而其性能易受光照变化、阴影的影响。红外传感器的成像依赖于物体的辐射,对光照和阴影变化具有鲁棒性,但也存在自身的缺点,如信噪比低,在明暗对比强烈处存在光晕现象,缺乏纹理特征。将2 种传感器结合用于图像序列的目标跟踪,可以降低跟踪难度,扩大跟踪系统的应用范围,提高跟踪系统的准确性和稳定性。

在复杂环境条件下,基于单一特征的目标描述很难对所有场景的变化都保持鲁棒,从而影响跟踪算法的稳定性;利用多个具有互补性的目标特征描述同时对目标进行观测,可靠的得到目标状态,可以更好的适应场景的变化,得到鲁棒的跟踪结果。很多学者进行了这方面的研究[4-6],从这些研究成果中可知,基于多特征融合的跟踪方法较单一特征的跟踪算法具有明显的优势。

核概率密度估计的Mean Shift 跟踪方法具有特征稳定、实时性好、鲁棒性强等优势,在图像序列目标跟踪中得到了广泛的应用[3,7-8],但基本的Mean Shift 方法及其改进方法大多仅采用了单一的特征。文献[7]提出了一种在线选择多特征的均值漂移目标跟踪方法,但该方法本质上只利用了目标的颜色信息; 文献[8]利用颜色和纹理特征来提高均值漂移方法的鲁棒性,该方法权值选取困难,算法复杂度较高。

在以上研究的基础上,利用红外和可见光双传感器进行跟踪,采用从红外和可见光图像中提取多种特征信息来描述目标,提高了目标模型的可靠性;将基于多特征信息描述的目标模型集成到均值漂移跟踪框架中,根据相似性度量自适应的融合定位目标,同时给出了一种选择性的目标模板模型更新方法,提高了长时间跟踪的稳定性。采用多组实际场景下序列实验表明了本文方法的有效性。

1 特征提取和目标描述

本节给出了目标的多特征模型描述方法,以及考虑红外和可见光传感器的特性,给出具体特征的提取方法。

在起始帧,通过手动标定或运动目标检测算法确定包含运动目标的候选区域,该区域即为被跟踪的目标区域,对目标区域提取特征建立目标模板模型。Mean Shift 跟踪方法[3]采用特征的核函数加权直方图来描述目标,定义目标模板模型和以y 为中心的候选目标模型分别为

在目标模板模型和候选目标模型中,第u =1,…,m 级概率密度表示为

式中:C、C'为标准化的常量系数;K 为核函数;X*i为以目标中心位置为坐标原点的第i 个像素的相对坐标;H、H' 为核函数的带宽;δ 为Kronecker delta 函数。

对于目标的多特征描述,如果采用直接组合目标的多个特征,形成一个多维特征向量,在目标的高维特征空间用其特征直方图来描述目标,则随着特征空间维数的增加,运算复杂度会呈现指数级增长。因此,本文采用单个特征单独描述目标,然后将各个特征模型组成一个集合来描述目标,每个特征均单独采用核函数量化的直方图进行描述,参照(1)式~(4)式,定义目标模板模型的多特征描述为

式中:qk为第k 个特征单独描述的目标模板模型;N为提取的特征总个数;mk为第k 个特征对应的直方图的量化级数;为目标模板模型第k 个特征的核直方图各级概率密度,定义见(3)式。

同样可定义中心位置在y 处的候选目标的多特征模型为

考虑红外和可见光传感器的特性,本文特征提取的具体方法如下:

对于可见光图像,采用颜色特征作为目标的一个特征描述,实验中颜色直方图量化为16 ×16 ×16级。颜色信息是目标最主要的特征之一,然而目标表面颜色常常会由于光照变化、遮挡或目标发生非平面旋转运动等因素而发生改变。

为弥补颜色特征的不足,从可见光图像中提取局部二进制模式[9](LBP)纹理特征,构建纹理特征直方图作为目标的一个特征描述。LBP 纹理特征的优点是计算简单,对全局的灰度变化不敏感,能够减弱阴影的影响。具体计算参见文献[9],实验中纹理特征直方图量化为16 级。

红外图像的灰度值反映物体的温度,成像不受光照变化和阴影的影响,因此选取红外图像的灰度特征用于跟踪,存在的问题是目标与背景亮度差异不大时,难以区分,且当跟踪框内出现类目标干扰时,容易产生跟踪错误。实验中红外灰度特征直方图量化为16 级。

2 基于多特征的均值漂移跟踪方法

均值漂移跟踪方法[3]在每帧中对目标模板模型和候选目标进行相似性度量,并沿着核直方图相似性的梯度方向迭代搜索目标位置,最终定位目标。本文在得到多特征信息描述的目标模型后,将其与均值漂移跟踪框架结合来进行跟踪,以下进行详细描述。

2.1 相似性度量

在获得目标模板和候选目标的多特征模型描述后,需要度量目标模板模型和候选目标模型间的相似性。度量2 个模型间的相似性实质上是度量2 个离散概率分布之间的相似性,本文选用Bhattacharyya 系数来实现,对第k 个特征,其相似性系数值为

其值在(0,1)之间。ρk(y)的值越大,表示相似性越大。

2.2 目标定位

设上一帧的目标位置为y0,目标定位就是在y0的邻域内寻找当前帧的最优目标位置y1.首先利用第k 个特征进行定位就是在当前帧的不同位置计算ρk(y),寻找使得ρk(y)最大的位置yk1; 然后根据Bhattacharyya 系数进行特征选择和自适应加权确定目标位置y1.

对第k 个特征而言,假设相邻帧特征直方图变化不大,将ρk(y)在y0处泰勒展开,相似性函数可近似为

至此问题转化为求(10)式最大化,右边第1项为常量,不再考虑,使用均值漂移算法确定第2 项的局部极大值点,推导迭代公式如(11)式所示,具体推导过程参见文献[10].

式中:y1k为利用第k 个特征定位计算得到的新位置。

由于Mean Shift 算法的收敛性,通过若干次反复迭代,会得到目标的最优位置yk1,使得相似性度量ρk达到最大,记为max (ρk),令BCk=max (ρk).

第k 个特征定位迭代结束时,Bhattacharyya 系数的最大值BCk反映了该特征跟踪结果的有效性。本文方法首先对k 个特征的跟踪结果根据BCk的值进行可靠性判断,如果BCk得小于阈值T1(本文实验取0.7),则表明该特征的本次跟踪结果受到了剧烈干扰,结果不可靠,确定目标位置y1时不应该考虑该特征,该特征选择过程公式化为

假定经过(12)式运算,共有l (l≤N)个特征可信度较高,则根据这l 个特征单独跟踪的结果来自适应加权确定目标位置y1,权系数由这l 个特征的BCk归一化自适应确定,过程如(13)式所示。从式中可以看出,本文方法当前帧的跟踪结果综合考虑了每个特征的跟踪结果,如果某个特征的BCk值为0,则该特征不参与定位目标; 如果某个特征的BCk值较大,则最终定位结果更依赖于该特征。

为了说明多特征相结合这一策略的有效性,图1(a)、(b)给出了一组相对应的可见光和红外图像,取图中矩形方框的位置和尺寸作为模板,分别在图中沿十字线的水平方向从左向右和垂直方向从上向下移动矩形中心,计算在各中心时,矩形区域与模板的相似性系数,可得到下列性能曲线,如图1(c)、(d)所示。多个特征的结合能够克服单一特征不稳定的缺点,从图中可以看出,利用多个特征得到的相似性系数曲线更加平滑稳定,且峰值唯一,在复杂环境下有利于Mean Shift 算法迭代找到准确的目标中心。

2.3 目标模板模型更新

基本均值漂移跟踪算法[3]是基于目标模板模型基本不发生改变这一假设的,跟踪过程中一直采用初始目标模板模型,并无模型更新机制。但在实际场景中,由于目标自身的运动、视角的变化以及环境条件的改变,都会使得固定的目标模板模型不能长时间稳定地跟踪目标,因此需要对目标模板模型进行及时动态更新,以适应目标的变化。目标模板模型更新存在的问题是如果前一帧的目标模板模型不能准确的描述目标,在当前帧获得的跟踪结果往往也不可靠,用不准确的跟踪结果去更新目标模板模型会导致跟踪结果的进一步恶化,最终丢失目标。

图1 特征相似性系数曲线Fig.1 Feature similarity coefficient

本文目标模板模型采用多个特征进行描述,利用特征间的互补性,降低了模型更新处理的难度。在每一帧中不更新整个模型,而是对k 个特征分别处理,有选择的进行更新,这样既避免了错误更新造成的模型漂移,又保证了模型对目标及场景变换有足够的适应性。

首先在当前帧(记为第t 帧)跟踪结果y1处,以y1为中心取目标区域,对该区域计算k 个特征对应的目标模型pk(t),并按(9)式计算该模型与目标模板模型的相似度BHCk(t),具体更新方法分为:

1)如果BHCk<T1,如(12)式所示,说明该特征的本次更新结果受到了干扰,不更新该特征的模型,仍采用前一帧该特征的模型。

2)如果当前帧第k 个特征对应的BHCk(t)值与前一帧该特征对应的BHCk(t -1)值的差值大于阈值T2(本文实验取0.1),则表明目标的该特征已发生变化,更新该特征对应的模型。

更新策略可将公式化为

式中:α 为模型更新速度因子,其取值范围为α∈[0,1].

则本文方法流程概括如下:

1)初始帧手动选择或通过目标检测方法得到目标位置,计算目标模板的多特征模型描述。

2)假定前一帧目标位置为y0,按(11)式,利用k 个特征单独进行定位。

3)按照(13)式,计算当前帧的跟踪结果y1.

4)根据(14)式,更新目标模板模型。

5)将y1赋值给y0,返回步骤2),实现视频序列的跟踪。

3 实验结果与分析

为了测试本文方法的有效性,采用实际拍摄的多个真实场景视频序列进行测试。视频序列来源于OTCBVS 数据库中Dataset 03 图像序列,具体参数为:红外传感器为Raytheon PalmIR 250D,可见光传感器为Sony TRV87 Handycam; 红外图像为8 位灰度表示,大小为320 像素×240 像素; 可见光图像为24 位彩色表示,大小为320 像素×240 像素。实验中核函数选用Epanechnikov 核函数,初始目标在第1 帧中手动选择。

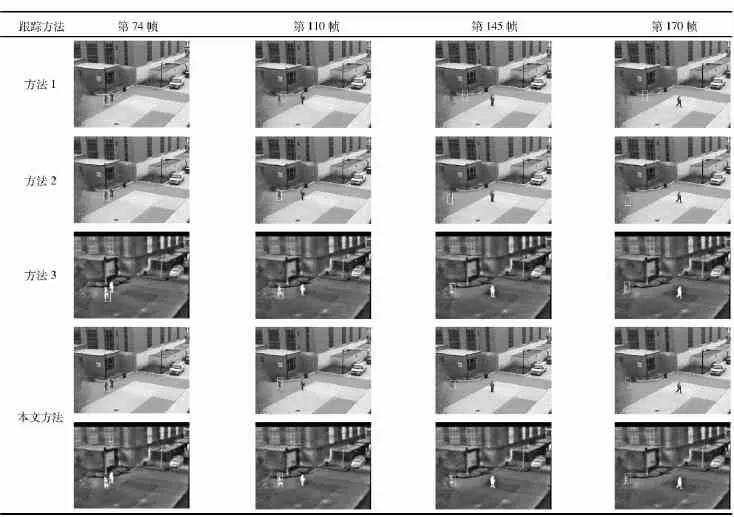

实验1 对序列A 进行跟踪,跟踪对象为行人,实验中对比了采用单个特征进行跟踪的结果。方法1为可见光序列仅采用颜色特征的均值漂移跟踪方法; 方法2 为可见光序列仅采用纹理特征的均值漂移跟踪方法; 方法3 为红外序列仅采用灰度特征的均值漂移跟踪方法。表1给出了跟踪结果的部分图像帧,各行依次为方法1、方法2、方法3 和本文方法的部分跟踪结果,本文方法同时在可见光序列和红外序列中标出目标;各列依次为第74 帧、第110 帧、第145 帧和第170 帧。

表1 序列A 在不同方法下的跟踪结果Tab.1 Tracking results by using different methods

从表1可以看出,跟踪初始时各种方法均能够跟踪到目标;在第110 帧时基于颜色特征的方法1跟踪错误,随后丢失目标;在第145 帧时目标被树枝遮挡,基于纹理特征的方法2 产生很大的误差,随着遮挡程度逐渐加剧,最终丢失目标; 在跟踪过程中,方法3 利用红外序列的灰度特征,在发生遮挡时,目标特征产生较大变化,依然能够跟踪到目标;而本文方法在此过程中始终能够稳定地跟踪到目标。

以上方法在实验1 序列前100 帧均能够有效跟踪目标,因此表2比较了以上方法对于序列前100帧的平均计算时间。从表2可以看出,本文方法由于采用了多个特征和模型更新,计算时间有所增加,在MATLAB 7 环境下仿真,平均每帧耗时约10 ms.在实际系统应用中,可参考文献[11]的研究,对核函数估计、Bhattacharyya 系数和迭代权值的计算进行优化,避免开方、除法等大量浮点运算,减少计算量,进一步提高跟踪性能。

表2 不同方法的时间性能比较Tab.2 Performance comparison of different methods

实验2 对另一场景的序列B 进行跟踪,对象为行人,背景变化包括了光照变化、阴影和类目标干扰(指其他行人干扰),对比方法与实验1 相同,选取序列第301 帧作为跟踪的起始帧。表3给出了跟踪结果的部分图像帧,各行依次为方法1、方法2、方法3 和本文方法的部分跟踪结果,本文方法同时在可见光序列和红外序列中标出目标; 各列依次为第350 帧、第405 帧、第503 帧和第590 帧。

表3 序列B 在不同方法下的跟踪结果Tab.3 Tracking results by using different methods

从表3可以看出,跟踪初始时各种方法均能够跟踪到目标; 在第405 帧时,目标进入阴影区域,基于颜色特征的方法1 跟踪错误,随后丢失目标;在第503 帧时,搜索区域内出现其他行人目标干扰,基于红外序列的亮度特征的方法3 无法区分,随后跟踪到其他行人目标,产生错误;而本文方法在此过程中始终能够稳定地跟踪到目标。

从以上实验可以看出,本文方法利用从红外和可见光传感器提取的多个特征进行跟踪,能够适应跟踪过程中目标及背景的变化,实现复杂环境条件下的目标稳定跟踪。需要说明的是,本文方法要求图像序列在跟踪处理前已经过图像配准,图像配准属于另一个研究方向,在此不做讨论,本文选用的实验序列已经过配准。

4 结论

本文提出了一种红外和可见光图像目标跟踪方法,利用双感器的互补性,提高跟踪的稳定性。采用红外图像灰度、可见光图像颜色和纹理3 个具有一定互补性的特征,建立目标的多特征模型描述,提高目标模型的可靠性; 在均值漂移跟踪算法框架内,根据相似性度量进行自适应融合得到跟踪结果;通过选择性的目标模型更新方法,实现了对长时间跟踪中目标自身变化的自适应。实验结果表明,在光照变化、阴影、背景纹理复杂及存在类目标干扰等复杂情况下,本文方法能够实现有效稳定的跟踪。

References)

[1]侯志强,韩崇昭.视觉跟踪技术综述[J].自动化学报,2006,32(4):603 -617.HOU Zhi-qiang,HAN Chong-zhao.A survey of visual tracking[J].Acta Automatic Sinica,2006,32(4): 603 -617.(in Chinese)

[2]Nummiaro K,Koller-Meier E,Van-Gool L.An adaptive colorbased particle filter[J].Image and Vision Computing,2003,21(1):99 -110.

[3]Comaniciu D,Ramesh V,Meer P.Kernel-based object tracking[J].IEEE Transactions on Patten Analysis and Machine Intelligence,2003,25(5): 564 -575.

[4]Serby D,Koller-Meier E,Van-Gool L.Probabilistic object tracking using multiple features[C]∥Proceedings of 17th International Conference on Pattern Recognition,Cambridge: UK,2004:184 -187.

[5]Brasnett P,Mihayhova L,Bull D.Sequential monte carlo tracking by fusing multiple cues in video sequences[J].Image Vision Computing,2007,25(8): 1217 -1227.

[6]Perez P,Vermaak J,Blake A.Data fusion for visual tracking with particles[C].Proceedings of the IEEE,2004,92(3): 495 -513.

[7]Collins R T,Liu Y X,Leordeanu M.Online selection of discriminative tracking features[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2005,27(10): 1631 -1643.

[8]王永忠,梁彦,赵春晖,等.基于多特征融合自适应融合的核跟踪方法[J].自动化学报,2008,34(4): 393 -399.WANG Yong-zhong,LIANG Yan,ZHAO Chun-hui,et al.Kernel-based tracking based on adaptive fusion of multiple cues[J].Acta Automatic Sinica,2008,34(4): 393 -399.(in Chinese)

[9]Ojala T,Pietikainen M,Maenpaa T.Multiresolution gray-scale and rotation invariant texture classification with local binary patterns[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2002,24(7): 971 -987.

[10]Comaniciu D,Meer P.Mean shift: a robust approach toward feature space analysis[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2002,24(5): 603 -619.

[11]邸男,朱明.一种复杂背景下的实时目标跟踪方法[J].中国图象图形学报,2009,13(9):1758 -1765.DI Nan,ZHU Ming.An algorithm for real-time tracking target in complex environment[J].Journal of Image and Graphics,2009,13(9):1758 -1765.(in Chinese)