上下文广告中的一种文本分类方法

赵 耀,陈志敏

(扬州大学 信息工程学院,江苏 扬州 225127)

0 引言

随着互联网的普及和电子商务的迅猛发展,广告已成为电子商务中极为重要的一部分业务.广告给出版商、广告商、网站等带来的巨大利润使得人们更加重视广告推荐方法的应用.广告的推荐方法作为推荐系统中最为关键的部分,很大程度上决定了推荐效果的优劣.[1]上下文广告中文本分类的关键之一是分类器的创建.在传统的先验学习框架中,分类器的首要任务是在一个标签过的数据上训练一个数据模型,然后用这个模型对测试数据集分类.通常在这种框架下,此学习算法必须依赖大量的标签数据,而实际上高质量的标签数据很难获取,尤其对新类别中的学习任务而言.在不同但是相关的类别中存在大量的标签数据,当这些标签数据过期而再从类似的信息源中获取新数据比较困难,在动态变化的网页环境下这种情况尤其严重.传统学习方法不能很好地解决这种问题,如文献[2]所描述,因为特征项之间的联系有很大的不同,因此传统模型直接应用于对网页的分类效果很差.传统的分类器学习都是假设给分类数据类别做标签,包括监督学习和半监督学习的方法都这样使用过.监督学习关注于哪里的标签数据比较充裕.NBC(native bayesian classifier)[3]和SVM(support vector machines)[4]是其中两种最为有效的方法.半监督学习认为标签数据太少而不能建立一个好的分类器,但可利用大量的未标签数据和少部分标签数据来提高分类器性能,如转换学习[5]和基于EM(expectation-maximization)的方法[6]等.无论是监督学习还是半监督学习,都需要标签数据和非标签数据有相同的分布;然而,此问题中标签数据和非标签数据均来自不同的类别,它们的基本分布也是不同的,这就违背了传统分类学习的最基本的设想.修改选择实例的方法是另一个与跨领域分类相关的工作.如果设想类别的差异仅仅是由于实例选择的方法不同,而其他因素都忽略,就能简单地应用这个理论去解决跨领域分类问题.以上方法最初应用在经济学中,后来才应用于机器学习.ZADROZNY提出了一个修改选择实例的两步方法,BLITZER等也分析了基于即时权重的跨领域学习,然而这些算法都没有充分调查测试数据的丰富结构.[7]

在本文中,笔者仅就上下文广告中的文本分类方法进行研究,旨在找到性能更好的分类算法来实现上下文的广告匹配,本文的重点放在交叉类别的文本分类上.从两个相关但是不同的类别中选取数据集DL和DU,这里的DL是一个已有类别中的标签数据,而DU是一个新类别中需要被分类的数据集.假设DL中的标签和即将在DU中预测的标签都是同一个类标签C中的,本文的目标是完全利用旧类别数据DL及其标签来准确地对DU中的文档分类.这里提出一个对交叉类别分类的方法NLSA(new latent semantic analysis).假设两个类别是相关的,那么它们会使用一些共同的标题.这里的关键思想是将LSA(latent semantic analysis)[8]扩展到建立一个主题链接,然后在这两个类别中转换共同的主题.利用NLSA模型,可将两个类别中共有的模型作为先验知识抽取出来,再通过预测的相关标题转换到测试类别中,最后把这些知识和在测试类别中对文本分类的未标签数据的新知识相结合,用在与训练类别不同的测试类别中.

1 算法NLSA

1.1 算法思想

在本文中,借用半监督聚类的方法处理NLSA中在同一个聚类和无需在同一个聚类的情况.半监督聚类是在一些传统的通过一部分标签数据提供的限制下建立的聚类,它在合适的限制聚类目标函数中找到平衡.本文的分类算法通过训练数据获得限制,以提供一个类结构.下面将在理论和实验的基础上证明这种算法对于跨领域分类的有效性,而且还利用从原类别训练数据中获得的标签知识帮助目标领域中的文档进行分类,这也是传统的半监督聚类算法尚未解决的问题.

首先,将PLSA(probabilistic latent semantic analysis)应用于标签和未标签的数据.利用一些隐藏的PLSA的可能性作为标题(或者分类器中设置的类别)在训练和测试类别文档中建立链接,然后在关联的概率模型下进行学习.这样,在新建立的基于相邻表的模型中,文档中的特征项都是相关的,训练数据中规律的标题标识与支持这些主题测试文档一样清楚.随后,这些主题就作为训练和测试领域中的桥梁,而且越早从训练数据中获得的优先知识在文档的限制条件下越早地被封锁,包括属于同一个聚类的必须链接限制的和不属于同一个聚类的不能进行的链接.这些先验知识被学习分类器学习和应用到不同领域的测试数据集上.应用上述算法,得到一个包括所有数据的相似性和训练数据的目标函数,而EM算法就是应用重复的最大化这样的目标函数来获得测试数据的最终类目.

1.2 问题定义

假设每一个训练数d都是一个文本文档,而且从一个主题集C={c1,c2,…,ck}中分配一个唯一的输出标签.一个词汇集W={w1,w2,…,wv},假设每一个输入文档都将表示成一个词汇特征向量的特征项频率.这些标签数据是DL={d1,d2,…,dm},每一个dl∈DL都会分配一个标签.测试数据是预测的一个未标记文档集DU={d1,d2,…,dn},假设训练集DL和测试集DU相关但不在同一个类别中.本文算法的目的是利用训练集DL在其他类别中尽可能准确地将标签ci分配到du中.

1.3 NLSA 算法

随机初始化P(d1|z),P(d1|w),P(du|w),因为DL和DU中的文档通常由特征项构成,故用NLSA分别在DL和DU上分解成z和w.通过观察DL和W,可在DL×W 上执行一次PLSA得到P(d1|w)和P(du|w),这里的DL,DU分别来自不同类别,可以得到

并定义文档dl与du的相似度为

假设y是代表一个文档类别或者隐藏特征的函数,那么y(d)为一文档的类别,y(z)是通过一个隐藏特征值表示的类别.对于DU类别中的每一个文档d和z,可以得到

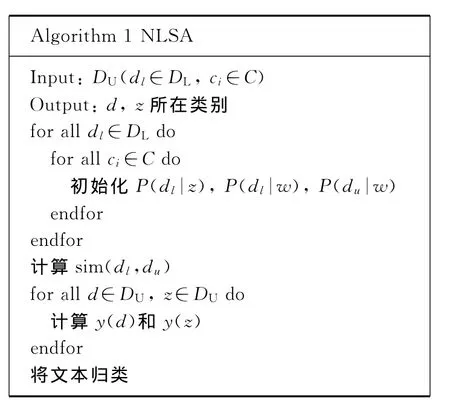

NLSA算法的具体步骤描述如下,见图1.

2 实验

2.1 测试数据集

为了检测算法NLSA的总体性能,笔者选取复旦大学李荣陆博士提供的中文语料库作为本次测试数据集.实验选取15个类别中的3 518篇作为训练语料,856篇作为测试语料,将NLSA 与NB(native bayesian),SVM(support vector machines),KNN-SVM(k-nearest neighbor support-vector machines),TSVM(transductive support vector machines)测试集进行比较,结果如表1所示.

图1 NLSA算法的具体步骤Fig.1 Steps of NLSA algorithm

2.2 实验结果与分析

由表1可见,因为SVM和NB的监督方法并未考虑测试集与训练集在不同的类别上,所以这两种算法的性能相对较差;而半监督方法TSVM由于能够预测测试数据,所以获得比监督方法稍好的性能[9];然而这些方法都是假设测试集与训练集在同一个类别,而未完全利用不同领域中训练数据的结构信息;因此,半监督不是最好的算法[10].在传统的潜在语义分析概率基础上进行扩展,将标签数据和未标签数据相结合,用共有的主题作为桥梁构建一个概率模型,实验结果证明其性能要好于其他现有的分类算法.

表1 5种算法的准确率比较Tab.1 Comparison of precisionwith 5algorithms

3 结语

本文提出一种与主题关联的NLSA算法来处理文本分类中的交叉类别问题.通过将一个类别中对文档学习到的知识转换到另一个类别中使用,对其他文档进行分类.[11]该方法在传统的潜在语义分析概率基础上进行扩展,将标签数据和未标签数据结合起来,用共有的主题作为桥梁建立一个概率模型.实验结果证明:将NLSA算法应用在上下文广告的文本分类中,性能要优于其他现有的分类算法.

[1]RIBEIRO-NETO B,CRISTO M,GOLGHER P B,et al.Impedance coupling in content-targeted advertising[C]//Proceedings of the 28th Annual International ACM SIGIR Conference on Research and Development in Information Retrieval.New York:ACM,2005:496-503.

[2]王国才,张聪.一种基于粗糙集的特征加权朴素贝叶斯分类器 [J].重庆理工大学学报,2010,24(7):86-90.

[3]JI Xiang,XUwei.Document clustering with prior knowledge[C]//Proceedings of the 29th Annual International ACM SIGIR Conference on Research and Development in Information Retrieval SIGIR 06(2006).Washington,USA:ACM,2006:405-412.

[4]JOACHIMS T.Text categorization with support vector machines:learningwith many relevant features[J].Comput Inf Sci,1998,1398(23):137-142.

[5]NIGAM K,MCCALLUM A K,THRUN S,et al.Text classification from labeled and unlabeled documents using EM [J].Mach Learn,2000,39(2/3):103-134.

[6]YANG Yi-ming.An evaluation of statistical approaches to text categorization[J].J Inf Retr,1999,1(1/2):69-90.

[7]COHN D,CARUANA R,MCCALLUM A.Semi-supervised clustering with user feedback [R]//Computer Science Technical Report.New York:Cornell University,2003:16-21.

[8]康楠,金蓓弘,李京.面向Blog的兴趣挖掘和推荐系统 [J].计算机工程,2008,34(2):72-74.

[9]AHN H J.A new similarity measure for collaborative filtering to alleviate the new user cold-starting problem[J].Inf Sci,2008,178(1):37-51.

[10]许海玲,吴潇,李晓东,等.互联网推荐系统比较研究 [J].软件学报,2009,20(2):350-362.

[11]何中市,刘里.基于上下文关系的文本分类特征描述方法 [J].计算机科学,2007,34(5):183-186.