单幅图像深度信息的提取

赵信宇,朱晓蕊,余锦全

(哈尔滨工业大学,深圳 518055)

0 引言

距离信息在物体识别、路径规划以及场景复原上都有着重要应用。人类可以轻易地判断出障碍物距离我们有多远,但是对于笨拙机器人来说,这个任务就变得相当艰巨了。随着机器人导航在机器人应用领域里变得越来越重要,深度检测自然成为了研究的重点。在机器视觉领域,深度检测可以通过摄像头或者其他图像处理的方法,一般常用的是立体视觉法。但是立体视觉会受限与摄像头基线之间距离,还会受到亮度噪声的影响,利用多个摄像头将会花费更多的成本。因此,我们考虑用一个摄像头来完成深度检测的任务。

目前,相关的研究主要有Michels、Saxena以及Y.Ng等人利用监督训练法估计一维深度信息,从而实现小车在高速下的自主避障[1];Guo Hong和Lu Yi等人通过单一摄像头拍摄一系列目标物图像来估计物体深度信息[2];Gini和Marchi等人在已知室内环境的条件下,利用单个摄像头实现小车的自主运动[3]。本文主要通过模型参数的训练,从而提取出单幅图像的三维深度信息图。

1 模型建立

人类天生具有判断物体距离的能力,我们往往可以根据物体的纹理特征的变化、纹理梯度的变化、物体完整性以及物体的模糊程度来估计他们的距离。例如,在我们的视觉感知里,同一个物体在不同的距离具有不同的大小以及不同的纹理变化,在不同的距离同一物体的清晰度也将发生变化。同时,我们在判断物体远近的时候还要参考周围环境的影响,例如,如果只看到一幅图像中某一蓝色区域,那么我们将很难判断这块区域到底是天空、海洋还是某一蓝色物体的一部分。因此,我们将图像的纹理变化、纹理梯度以及模糊度作为特征提取出来,并参考图像全部信息来建立并训练模型。

1.1 特征的提取

首先,我们将图像划分成很多的小块,对应于每一小块,它具有独立的深度信息以及相关深度信息,我们要做的是提取与这些信息相关的图像特征。将图像转换到YCbCr的颜色空间里,其中Y代表亮度层,Cb和Cr为两个颜色层,很多纹理信息都包含在其亮度层里。

为了提取独立深度特征,我们应用Laws'masks[4]作为滤波器去处理图像的Y层,从而得到纹理能量作为纹理变化的特征,应用边缘检测滤波器得到图像纹理梯度变化特征,而模糊度主要体现在颜色层上,因此应用平均值滤波器处理Cb&Cr层来得到模糊度特征。我们将17个滤波器函数(9个Laws'masks、6个边缘检测滤波器以及两个颜色层)Fn(x,y),n=1,2…17作用于图像,可以得到图像的独立深度特征为:

对于图像中每一个小块,它的深度信息不仅与自身特征有关,还与周围邻域的特征有关,为了便于研究,我们将图像分层,不同层里相同大小的块包含着不同的全局信息。因此我们在提取某一块的独立特征时,应包括在不同层下的该块及其四个邻域的独立深度特征。

对应于某一块i,我们计算它的直方图,并用17个滤波器函数处理,从而得到它的特征yi,这一特征用来表征不同位置深度信息的相关性。因此,我们用yij=yi-yj作为相邻块之间的相关深度特征。如图1所示:

图1 图像分层及绝对深度特征、相关深度特征示意图

1.2 模型的建立

关于马尔科夫随机场的详细介绍请参考文献[5]。

利用马尔科夫随机场模型区建立不同块之间的深度关系,为了得到不同层之间的关系,我们定义di(s):s=1,2,3代表不同层中某一块i的深度值,其中di(s+1)=(1/5)ΣjeNs(i)∪(i)dj(s),Nj(s)为块i的四个邻域,表示高一层的深度值由低层深度值加权平均得到。我们建立高斯-马尔科夫模型如下:

其中M是最底层图像划分的块数;xi是每一块所对应的独立深度特征;θ和σ是模型参数,由于大多数物体为垂直状态分布,因此我们仅对不同行求不同的参数;Z是归一化参数。其中θ可通过最小二乘法求得,式(2)中第一项为单一块的绝对深度预测,第二项通过相邻块之间的关系对第一项进行修正。如果σ为一固定常数,则对于不通图像其修正项对结果的影响将变得不准确。因此我们令

σ2

1r=vrxi、σ22rs=urs|yijs|,对不同的行求出不同的参数,从而使得模型更为符合实际。参数训练之后,利用最大后验概率法,对新图像求式(2)最大时对应的即可[6]。

2 图像及深度图采集

我们采用LMS111激光扫描仪,配合相机采集图像及相关深度信息图,这些数据主要用于模型参数的训练。其中LMS111最大测量距离为20米,水平扫描角度为270度,工作时每隔0.5度采集一个数据,工作频率为50HZ,平均误差为30mm。由于LMS111只能采集二维信息,因此我们设计一套支架,使得LMS111扫描平面可以在竖直方向连续采集,从而实现三维信息采集。整个采集系统如图2所示。

图2 激光扫描仪采集系统

如图2所示,1为相机,用于拍摄图片;2为1:720减速箱,手柄每转一周将提供0.5度转角;3为联轴器,连接减速箱与LMS支架;4为LMS支架,将转动轴与扫描平面重合;5为LMS扫描仪;6为整体支架;7为限位卡槽,控制转角在-60到60度之间;8为轴承。采集图像及其相关深度图如图3所示:

图3 实物图及相关深度图

3 测试及误差分析

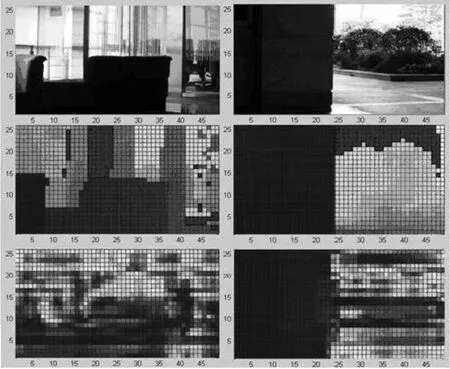

新图像测试结果如图4所示:

图4 室内室外新图像测试结果

上图为相机采集图片,中图为实际深度信息图,下图为测试图。

图5 室内场景实际平均误差分布图

表1 不同环境下的平均误差

误差是以log10为底,比如误差为0.1328,是指100.1928=1.3577,实际误差为35.77%

由图5可以看出,有较多的点误差分布在0.1461~0.1761之间。由于室内物体一般比较规则,且距离较近,因此具有较好的预测结果,而室外环境比较复杂,特别是一些不规则的物体,将很大程度到影响测试结果。

4 结论

通过提取图像特征,在高斯-马尔科夫随机场模型的基础上,利用LMS激光扫描仪系统采集的图像作为训练数据,训练模型参数并应用于提取新图像深度信息,结果表明,该方法可以实现单幅图像深度信息的提取,且误差主要分布在某个区域,这为我们进一步改善该算法打下了基础。

[1] J.Michels,A.Saxena,and A.Y.Ng.High Speed Obstacle Avoidance Using Monocular Vision and Reinforcement Learning.In ICML,2005.

[2] H.Guo and Y.Lu.Depth Detection of Targets in a Monocular Image Sequence.18th Digital Avionic Systems Conference,1999.

[3] G.Gini and A.Marchi.Indoor Robot Navigation with Single Camera Vision.In PRIS,2002.

[4] E.R.Davies.Laws' texture energy in TEXTURE.In Machine vision:Theory,Algorithms,Practicalities 3th edition.2005.Pg 756-779.

[5] Gerhard,Winkler.Image.Analysis,Random Fields and Dynamic Monte Carlo Methods:A Mathematical Introduction.Springer-Verlag,1995.

[6] Ashutosh Saxena,Sung H.Chung,and Andrew Y.Ng.Learning depth from single monocular images.In NIPS 18,2006.