基于Mean Shift的序列图像手势跟踪算法*

王 宇

(中国民航飞行学院 航空工程学院,四川 广汉 618307)

1 引言

手势生动、形象、直观,而且蕴涵着丰富的信息,是人与人沟通的重要媒介。手势跟踪则是在图像序列中确定出各帧中手势的位置、大小和方向等信息,是目前基于手势交互的重要内容。

目前,目标跟踪的算法[1-4]有很多,大体上可以分为基于匹配的跟踪和基于运动特性的跟踪。根据提取目标的特征不同,基于匹配的跟踪可分为区域匹配跟踪、轮廓匹配跟踪和特征匹配跟踪。基于运动特性的跟踪又分为基于光流的跟踪算法和运动预测跟踪算法。其中,Mean Shift算法因其计算简单、实时性好而得到了广泛应用。笔者将Mean Shift算法应用于序列图像中的手势跟踪,取得了较好的效果。

2 基于颜色直方图的Mean Shift算法

Mean Shift[5-6]是一种基于核函数密度估计的图像特征分析方法。在手势跟踪中,Mean Shift算法利用图像的颜色统计直方图作为整个搜索匹配的特征,并且采用梯度优化方法来减少特征搜索匹配的时间,实现快速的目标定位,同时利用Bhattacharyya距离作为对目标模板和候选目标的相似性函数,完成特征的匹配。

1)目标模板的表示

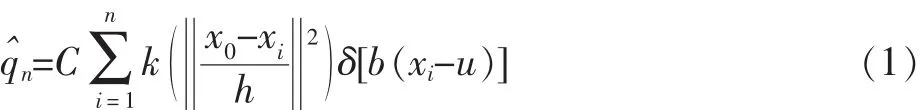

假设{xi}i=1,2,…,N表示目标模板区域中的像素位置,且目标区域的中心为x0,特征值bin的个数为m,则目标模板的特征值 u=1,2,…,m 的概率密度为

式中:k(x)为核函数,是一个各向同性的、凸的且单调递减的函数,它的作用是给目标模板区域的像素设置权值,即给远离目标模板中心的像素设置较小的权值,而给靠近目标模板中心的像素设置较大的权值。因为远离目标模板中心的像素容易受到其他目标或背景像素的影响,所以加权后的目标模板像素在进行密度估计时增加了稳健性,提高了搜索跟踪能力。函数k(x)中的的作用是为消除不同大小目标计算时的影响,将目标区域归一化。 δ(x)是 Delta 函数,δ[b(xi-u)]总的作用是判断目标区域中像素xi的颜色值是否属于第u个bin,属于则值为1,否则为0。C是一个标准化的常量系数,使得因此

2)候选模板的描述

设运动目标在第2帧及以后每帧中可能包含的目标区域为候选区域,设{xi}i=1,2,…,nh是候选区域的像素位置,当前帧中心坐标为y,候选模板的特征值u=1,2,…,m的概率密度为

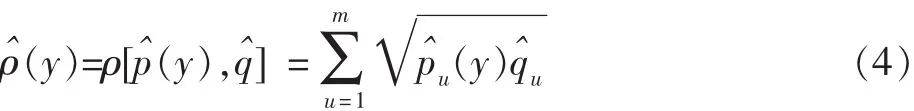

3)基于Bhattacharyya系数的相似性函数

引入Bhattacharyya系数[7]来度量候选目标和目标模板之间的相似性,其定义为

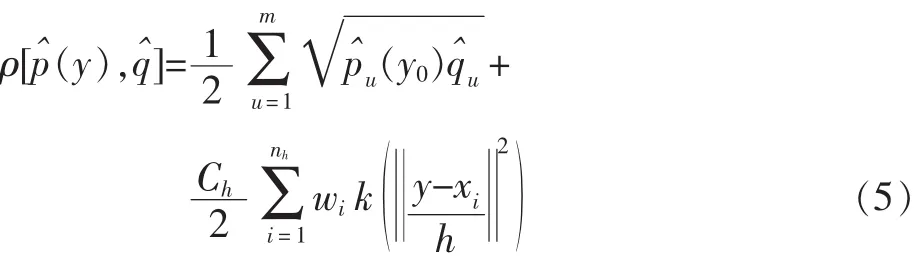

4)目标定位

其中

式(5)中第1项是与y无关的,只有第2项随y变化,所以只需要对第2项进行分析。令

要使式(5)最大就是求式(7)最大,计算式(7)的 Mean Shift向量,从候选区域中心y0递归地计算出新目标位置,即

式中:g(x)=-k′(x),Mean Shift算法是从起,向两个模型相比颜色最大的方向移动。

3 颜色概率模型

为了实现手势的跟踪,选取手势的颜色来作为跟踪特征,然后通过颜色概率模型把每帧图像转化为颜色概率分布图。常用的RGB色彩空间[8-9]并不能很好地反映视觉上的颜色感知性。由于笔者研究的是序列图像中的手势跟踪,因此这里的颜色就是肤色。由于肤色对HSV(色调、色饱和度和亮度)色彩空间的H分量很敏感,所以采用H分量的直方图建立肤色概率模型,即

式中:R,G,B分别代表RGB色彩空间中的颜色分量,这里将它们转化到HSV空间,获得H分量,并计算它的直方图。这里把H分量的数值量化到[0,255]。

4 实验过程

Mean Shift算法将颜色直方图作为跟踪特征,具有计算简单、速度快的特点。 给定目标模板并给出t-1帧中目标的位置y0,对第t帧图像进行目标搜索的过程如下:

1)初始化第 t帧中目标位置 y0,并计算以及

5 实验结果与分析

为了测试本文算法在动态场景下对目标手势跟踪的性能,选择对实际视频序列进行手势跟踪测试。实验中对各帧图像未做任何预处理。计算机配置为P3 CPU 1.8 GHz,内存512 Gbyte,开发环境为Visual C++。图1为实验室实时拍摄的手势跟踪结果。可以看出该算法在手势大小变化、手势发生旋转情况下均有较好的跟踪结果。

6 小结

笔者将Mean Shift方法应用到序列图像的手势跟踪中。实验结果表明,针对不同的动态场景,Mean Shift计算简单,实时性好,并且当目标姿态和光照发生变化时可获得较好的跟踪效果,能适应目标在图像中的复杂运动,具有广阔的应用前景。

[1]WU Y,HUANG T S.Robust visual tracking by integrating multiple cues based on co-inference learning[J].International Journal of Computer Vision,2004,58(1):55-71.

[2]TRIESCH J,MALSBURG C V D.Self-organized integrationof adaptive visual cues for face tracking[C]//Proc. the Fourth International Conference on Automatic Face and Gesture Recognition.Grenoble,France:[s.n.],2000:102-107.

[3]COMANICIU D,RAMESH V,MEER P.Kernel-based object tracking[J].Pattern Analysis and Machine Intelligence,2003,25(5):564-577.

[4]COMANICIU D,RAMESH V,MEER P.Real-time tracking of nonrigid objects using mean shift[J].IEEE Computer Vision and Pattern Recognition,2000(2):142-149.

[5]CHENG Y.Mean-shift,mode seeking,and clustering[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1995,17(8):790-799.

[6]梁静,支琤,周军.基于Mean Shift的抗遮挡运动目标跟踪算法[J].电视技术,2008,32(12):82-85.

[7]KAILATH T.The divergence and Bhattacharyya distance measures in signal selection[J].IEEE Trans.Comm.Tichnology,1967(15):52-60.

[8]RICHARD O D,PETER E H,DAVID G S.Pattern Classification[M].2nd Ed.李宏东,姚天翔,译.北京:机械工业出版社,2003.

[9]SONKA M,HLAVAC V,BOYLE R.图像处理、分析与机器视觉[M].2版.艾海舟,武勃,译.北京:人民邮电出版社,2003.