基于SAM模型的西装领设计尺寸测量方法

摘" 要:针对服装内部轮廓线对比度低、提取特征点和完整轮廓困难,导致图像内部尺寸难以测量的问题,提出一种基于SAM模型进行部件分割提取内部尺寸的方法。首先通过SAM模型分割西装领部件,然后将西装领部件近似多边形并利用LSD算法修正多边形,最后建立西装领结构模型并结合像素比例提取设计尺寸。结果表明:该方法可以从成衣图像中提取西装领款式结构图并输出相关数据,实验测量结果与测量软件相比尺寸的绝对误差在0.02~0.74 cm之间,角度的绝对误差在0.02°~0.27°之间;与实物测量相比,尺寸的绝对误差在0.05~1 cm之间,角度的绝对误差在0.06°~0.68°之间。该方法提取的西装领细部尺寸可为制版师提供数据参考。

关键词:西装领;服装部件分割;SAM模型;LSD算法;款式图提取;尺寸测量

中图分类号:TS94.17

"文献标志码:A

文章编号:1009-265X(2024)12-0083-07

DOI: 10.19398j.att.202403005

收稿日期:20240305

网络出版日期:20240620

基金项目:国家级大学生创新创业训练计划项目(202210338032);浙江理工大学科研启动基金项目(23072078-Y)

作者简介:彭周艳(1998—),女,湖南常德人,硕士研究生,主要从事服装数字化方面的研究。

通信作者:邹奉元,E-mail:zfy166@zstu.edu.cn

西装整体视觉效果受到多种因素影响,其中西装领作为整体视觉的中心,是影响整体视觉效果最关键的因素[1]。而根据款式设计图制作服装样板,对西装领这样的重要细部尺寸判断,往往要依赖样板师的经验和多次试错。机器视觉具有图像再现好、处理精度高、灵活性强等特点[2],因此采用机器视觉来帮助确定西装领细部尺寸有重要意义。

服装尺寸的测量通常是需要先检测服装特征点,然后进行特征点间的距离测量。Cao等[3]采用边缘检测算法和基于轮廓的Freeman链码角点检测进行特征点检测,进而测量尺寸;李鹏飞等[4]提出Harris算法和Susan算法相结合的角点检测算法来提高特征点检测的准确性。但传统的特征点检测算法存在特征点漏检、错检、集簇的问题,因此相关学者通过引入机器学习来检测特征点。Serrat等[5]考虑全局轮廓采用概率图形模型学习识别服装近直线化轮廓部件进而提取特征点,然后通过Lasso回归预测服装外轮廓尺寸。邓莹洁[6]及Kim等[7]采用深度学习的方法从二维图像中提取服装尺寸测量点;Paulauskaite-Taraseviciene等[8]提出基于U-Net分割模型,首先分割出服装掩膜再通过深度学习检测关键点完成服装测量,这一方法大大提高了检测精度。但上述研究只关注了服装外轮廓尺寸,未探讨内轮廓尺寸。为解决这一问题,王燕珍[9]采用定位法将服装图像映射到标准人体模型上,借助标准的参数网格利用比例关系获得内部尺寸;Li等[10]通过形状匹配定位预设服装模板内外特征点的相对位置来计算内部尺寸,其中预设的服装内部特征点为测量大量服装后总结而来,测量绝对误差在0.36~2.03 cm。虽然上述方法实现了内轮廓尺寸测量,但测量误差还不够理想。

由此,本文提出一种在控制尺寸下基于Segment Anything Model(SAM)[11]模型建立西装领结构模型并提取设计尺寸的方法。该方法首先通过SAM模型分割西装领部件,先分割可减少周围纹理的影响,提高边缘精度;然后将西装领部件近似多边形并利用Line Segment Dectctor(LSD)[12]算法修正,保留关键特征点;最后建立西装领结构模型并结合像素比例提取设计尺寸。该方法可提取出西装领设计尺寸,为制版师提供数据参考。

1" 实验

西装领尺寸测量分为三步,第一步基于SAM模型对西装领部件分割,得到西装领各部件掩膜;第二步将西装领部件轮廓多边形化并调整建立西装领结构模型;第三步,测量西装领设计尺寸。

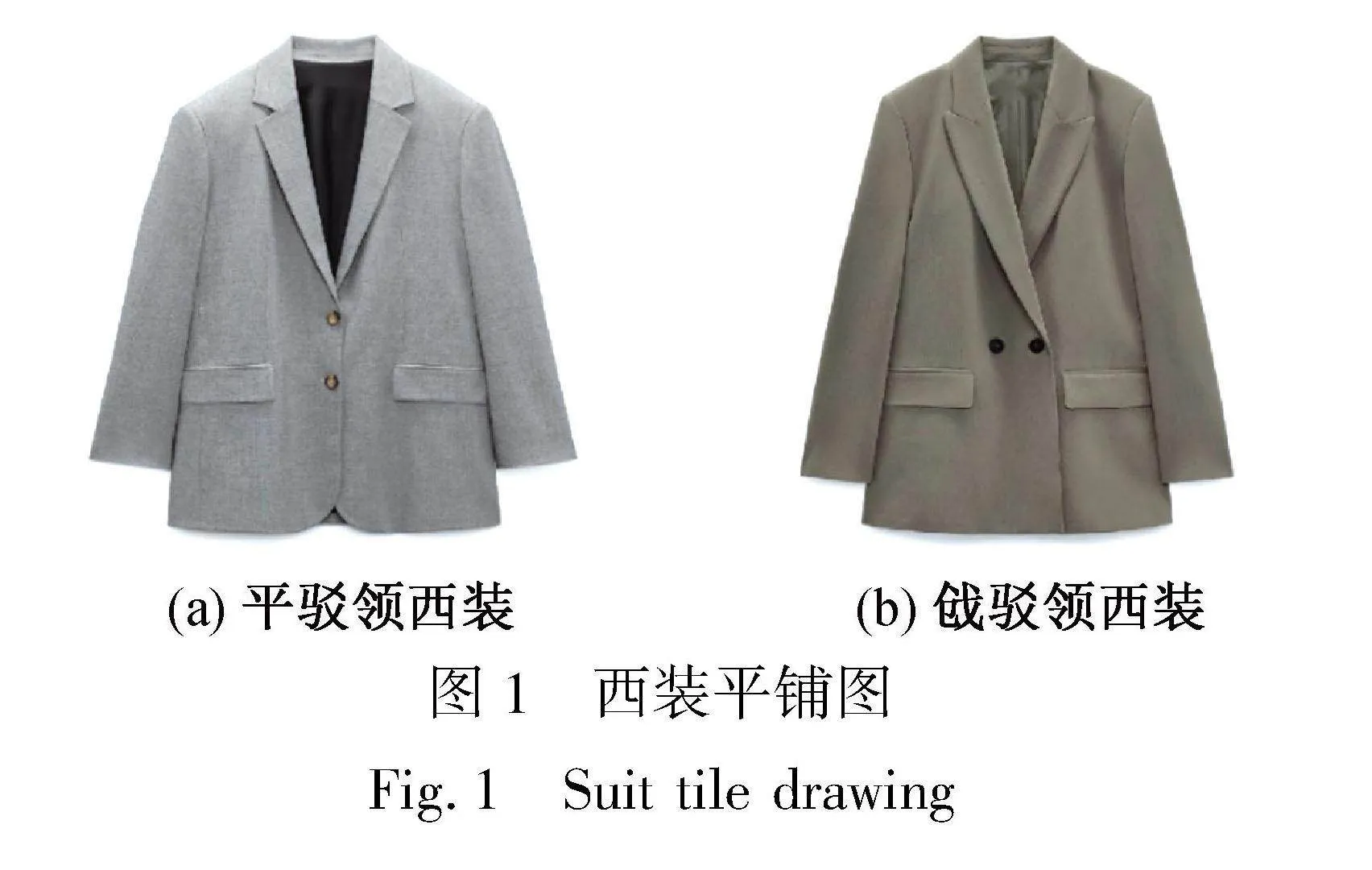

1.1" 实验对象

西装领型主要有平驳领、戗驳领、青果领,由于青果领参数较为简单,暂不做讨论。本文选择平驳领、戗驳领作为实验对象进行尺寸提取。西装平铺图如图1所示。

1.2" 西装领部件分割

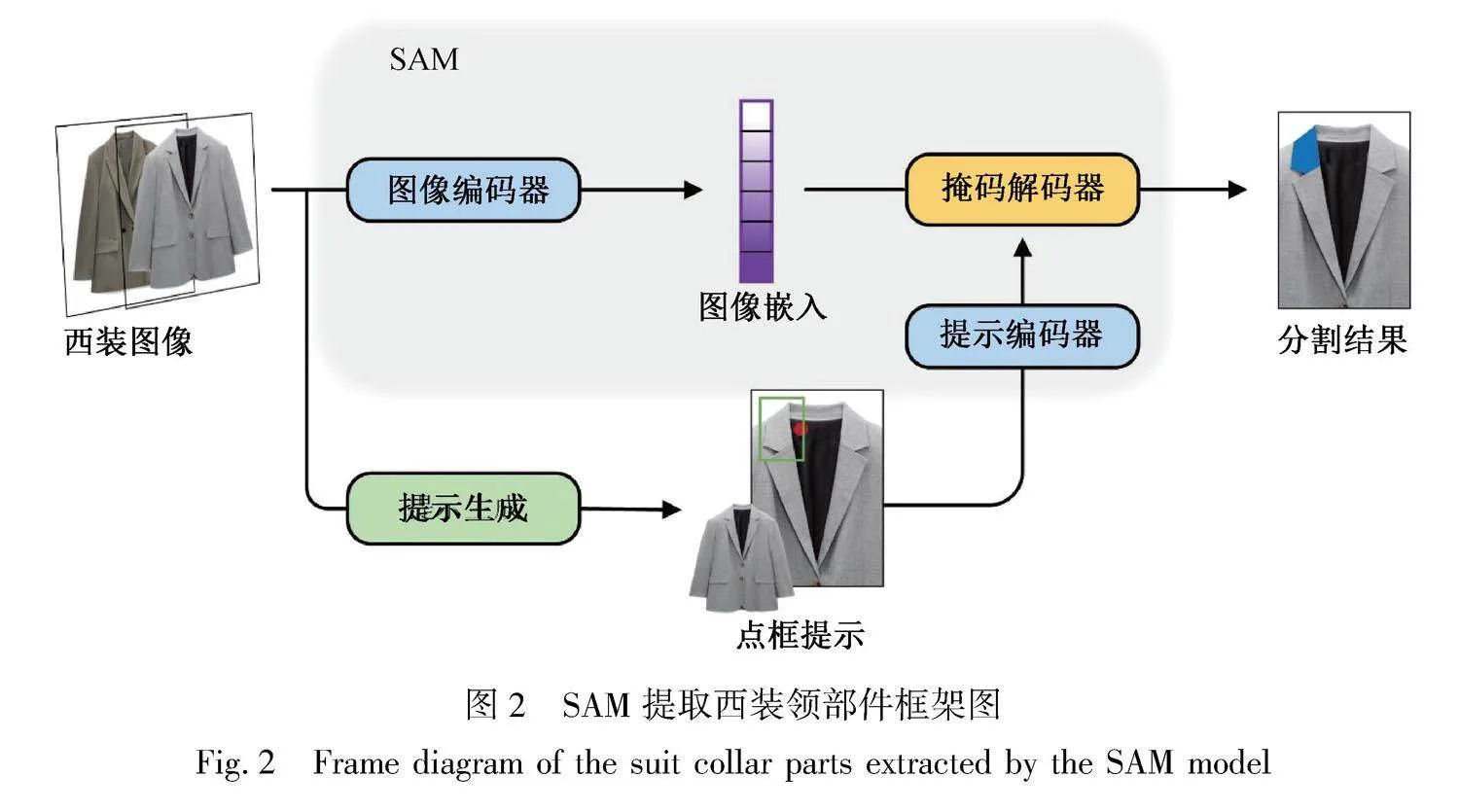

针对内部轮廓提取有杂线、不连续的问题,本文采用SAM模型对西装领翻领、驳领、领座部件依次进行交互式分割,从而更好地提取西装领内部轮廓线。SAM模型基于Transformer架构搭建,具有较强零样本泛化能力,由图像编码器、提示编码器和一个轻量级的掩码解码器3部分组成,模型原理如图2所示。

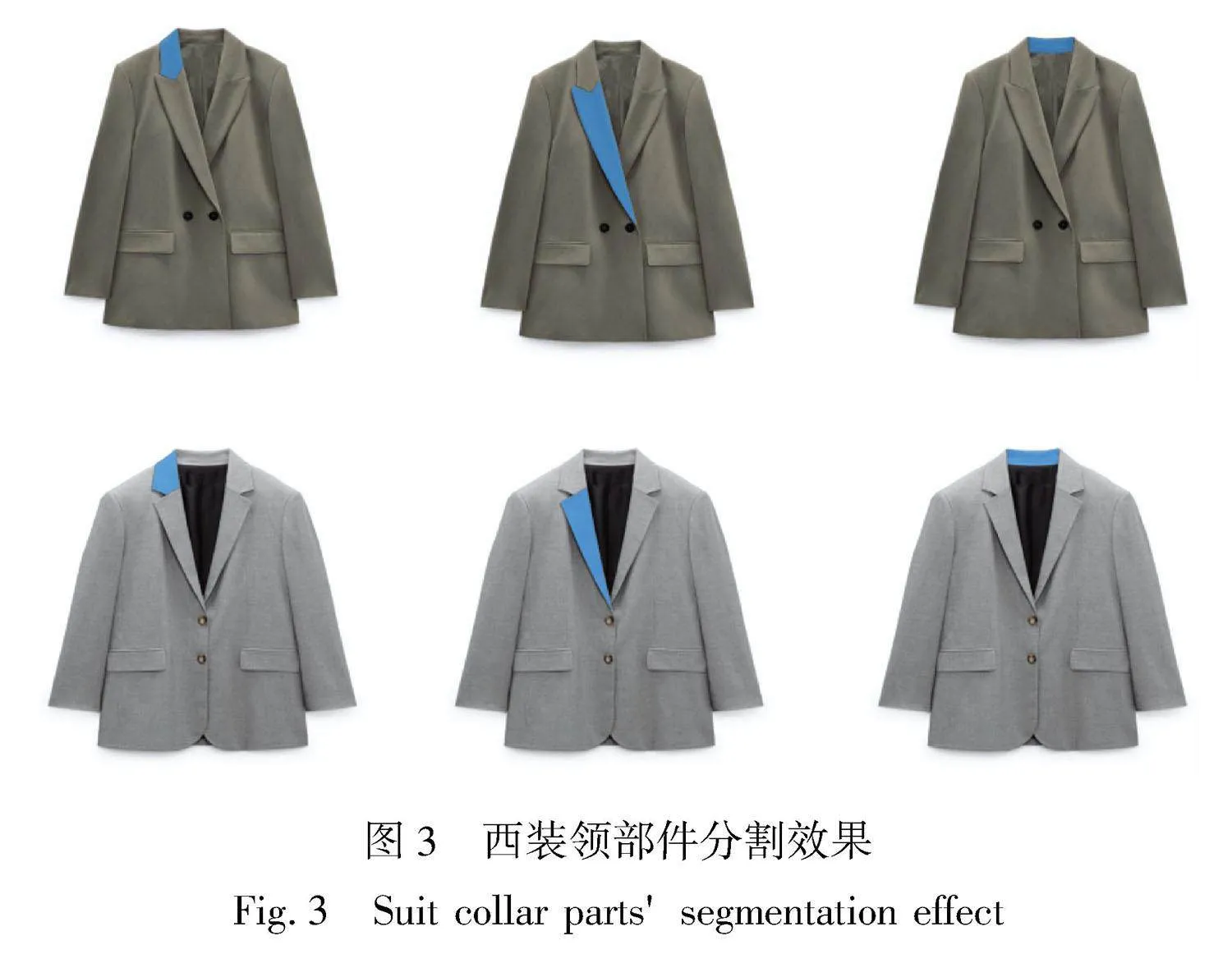

实验采用点框结合的方式,通过输入提示框确定前景,输入提示点确定背景,提示信息以位置编码的形式输入提示编码器,然后图像编码器和提示编码器将提取的信息结合到掩码解码器中,生成基于图像嵌入、提示嵌入和输出的西装领部件分割结果,并选择预测得分最高的分割掩膜进行输出,分割效果如图3所示。

1.3" 西装领模型建立

1.3.1" 西装领部件轮廓多边形化

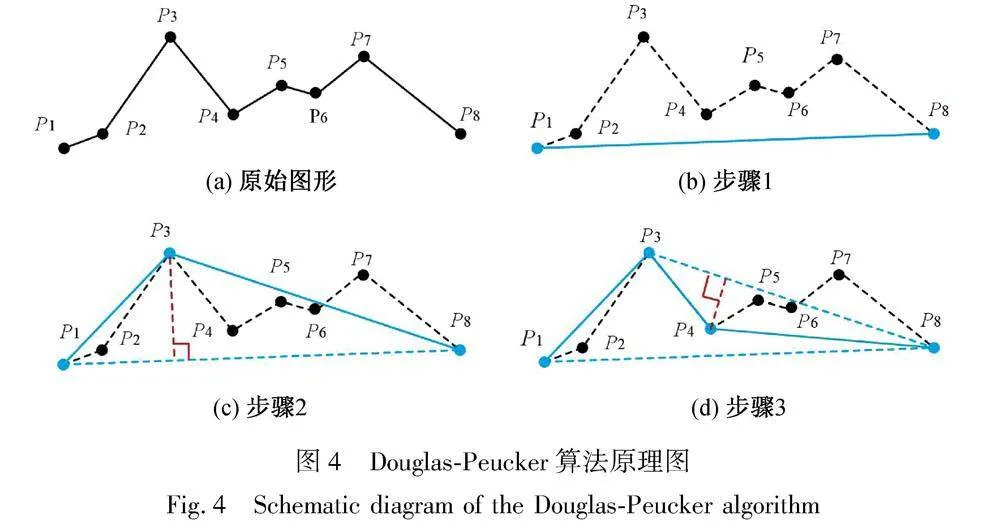

将西装领轮廓部件近似多边形提取关键特征点。Douglas-Peucker(DP)[13]算法可以将轮廓以简单、高效的方式进行近似处理,保留较少的关键点,同时保持轮廓的形状特征。因此采用DP算法对轮廓进行近似处理,算法原理如下:

a)步骤1:在图像轮廓中寻找最远距离点,连接最远点P1P8(见图4(b))。

b)步骤2:找到图像轮廓上离直线段P1P8距离最远的点P3(见图4(c)),计算其与直线段P1P8的距离d,比较距离d与预先设定阈值的大小,如果小于阈值,则该直线段作为曲线的近似,该段曲线处理完毕。

c)步骤3:如果距离大于阈值,则用P3将曲线分为两段P1P3和P3P8,重复上述操作(见图4(d)),直到满足阈值要求。

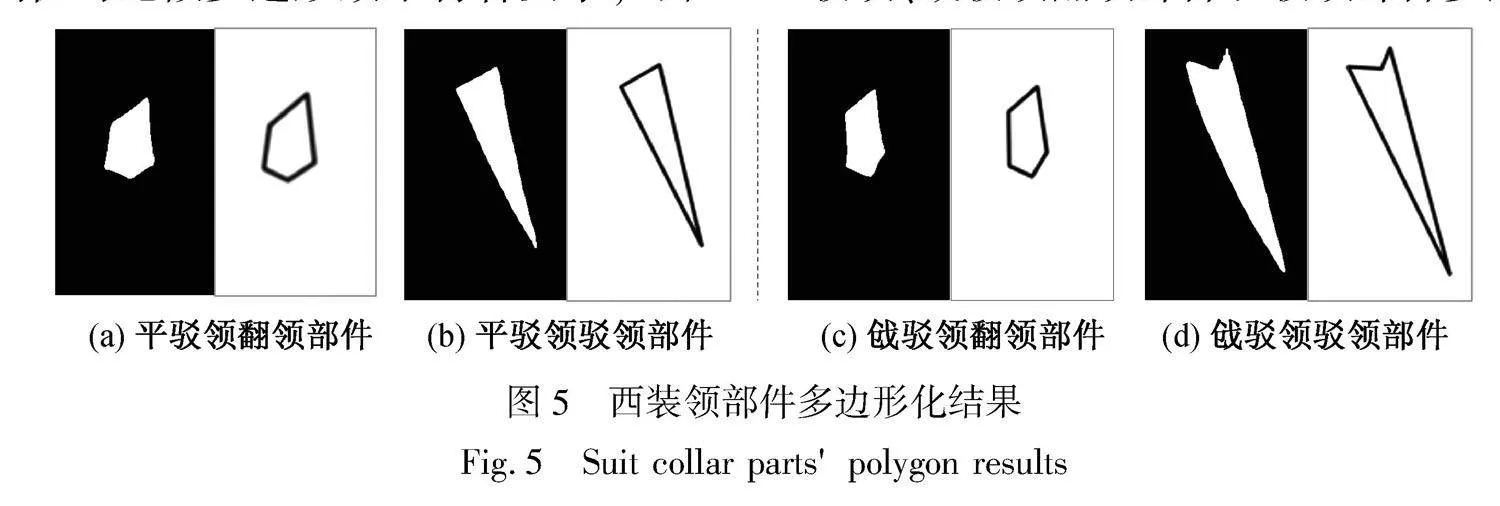

由DP算法原理可知,图像轮廓近似多边形的效果与设定的阈值有关,经反复实验,将轮廓周长的0.02倍作为阈值时近似多边形效果符合要求,可在保留较少关键点的同时保持轮廓形状特征。图5为西装领部件多边形化结果,图5(a)—(d)分别为平驳领、戗驳领翻领部件和驳领部件多边形化结果。

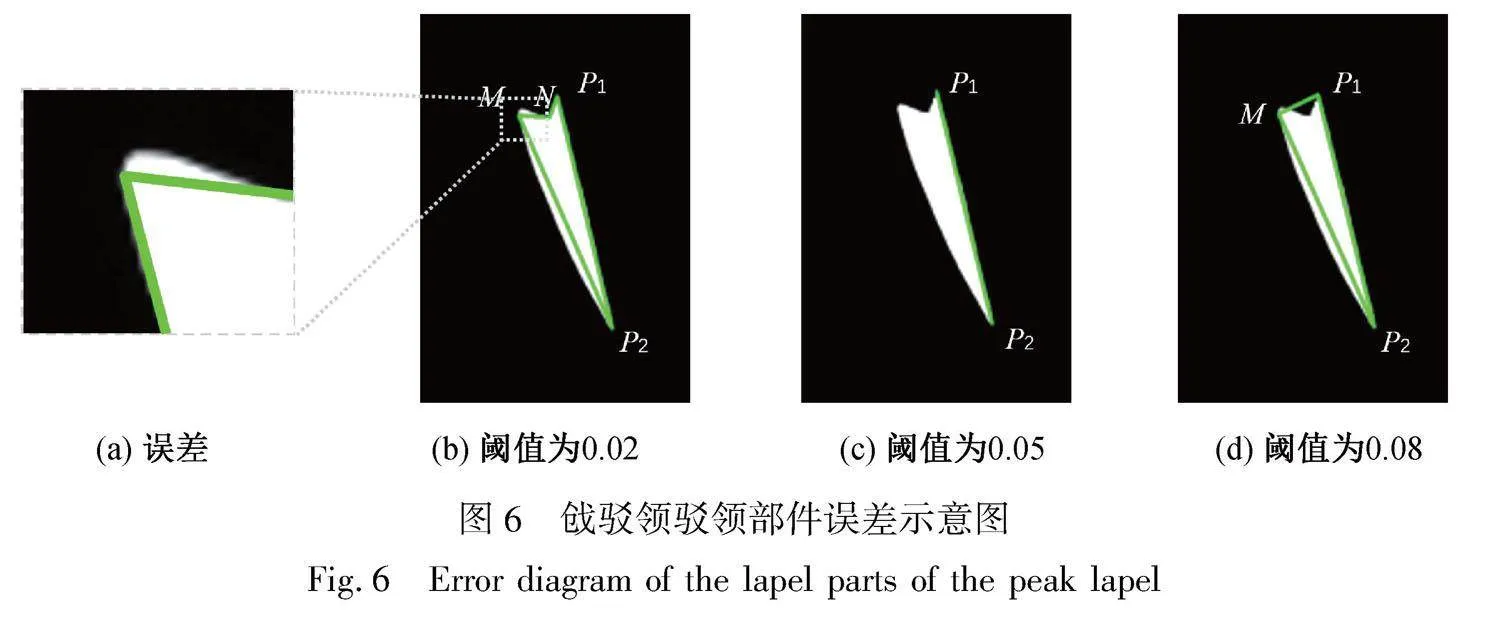

但是采用DP算法对戗驳领驳领部件近似多边形时损失了关键顶点,如图6所示。根据DP算法原理,在对轮廓近似处理时,首先连接图像轮廓最远点P1、P2点,结果如图6(c)所示;接着在轮廓中寻找距离弦P1P2的最远点,即点M,结果如图6(d)所示;最后通过阈值约束得到了如图6(b)所示近似结果,从图6(a)中可以观察到,戗驳领驳角呈现为有略微弧度的角,而以点M为驳角顶点并不能概括驳角形状。

1.3.2" 轮廓多边形调整

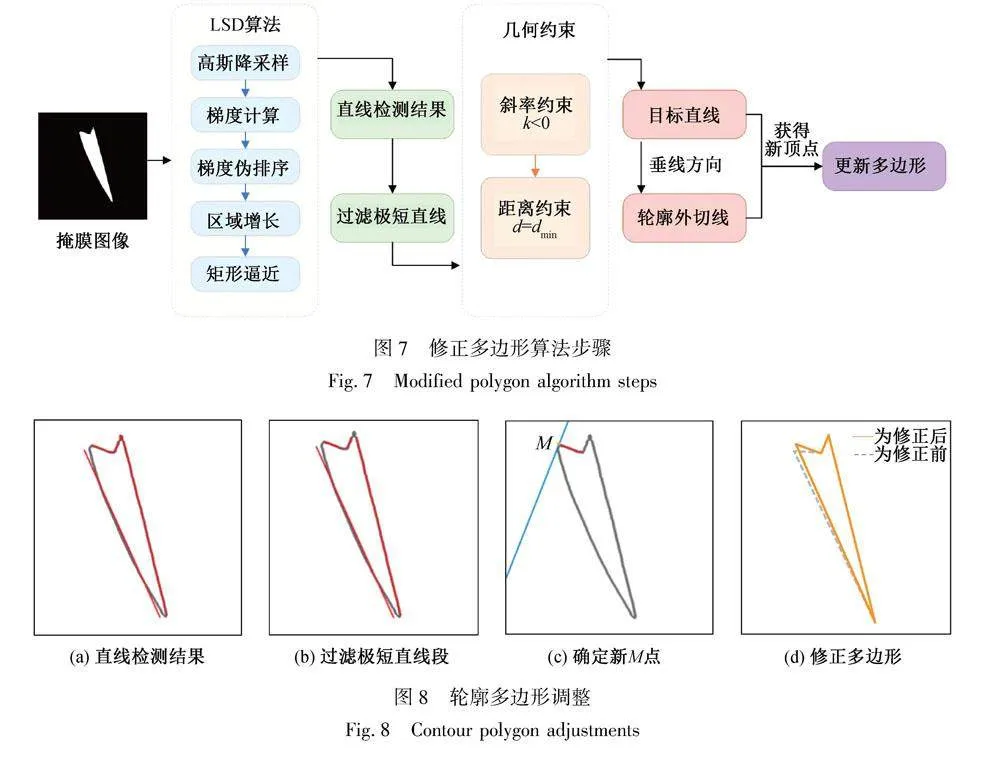

为了减少测量误差,更正M点的坐标来修正多边形。具体的修正流程如图7所示。

首先,利用LSD算法对掩膜图像进行直线段检测,LSD算法具有结果准确,算法参数能够自适应,且适合检测短线段的优点[14],因此采用LSD算法检测轮廓直线段。得到直线检测结果如图8(a),过滤极短直线段后结果如图8(b)所示。

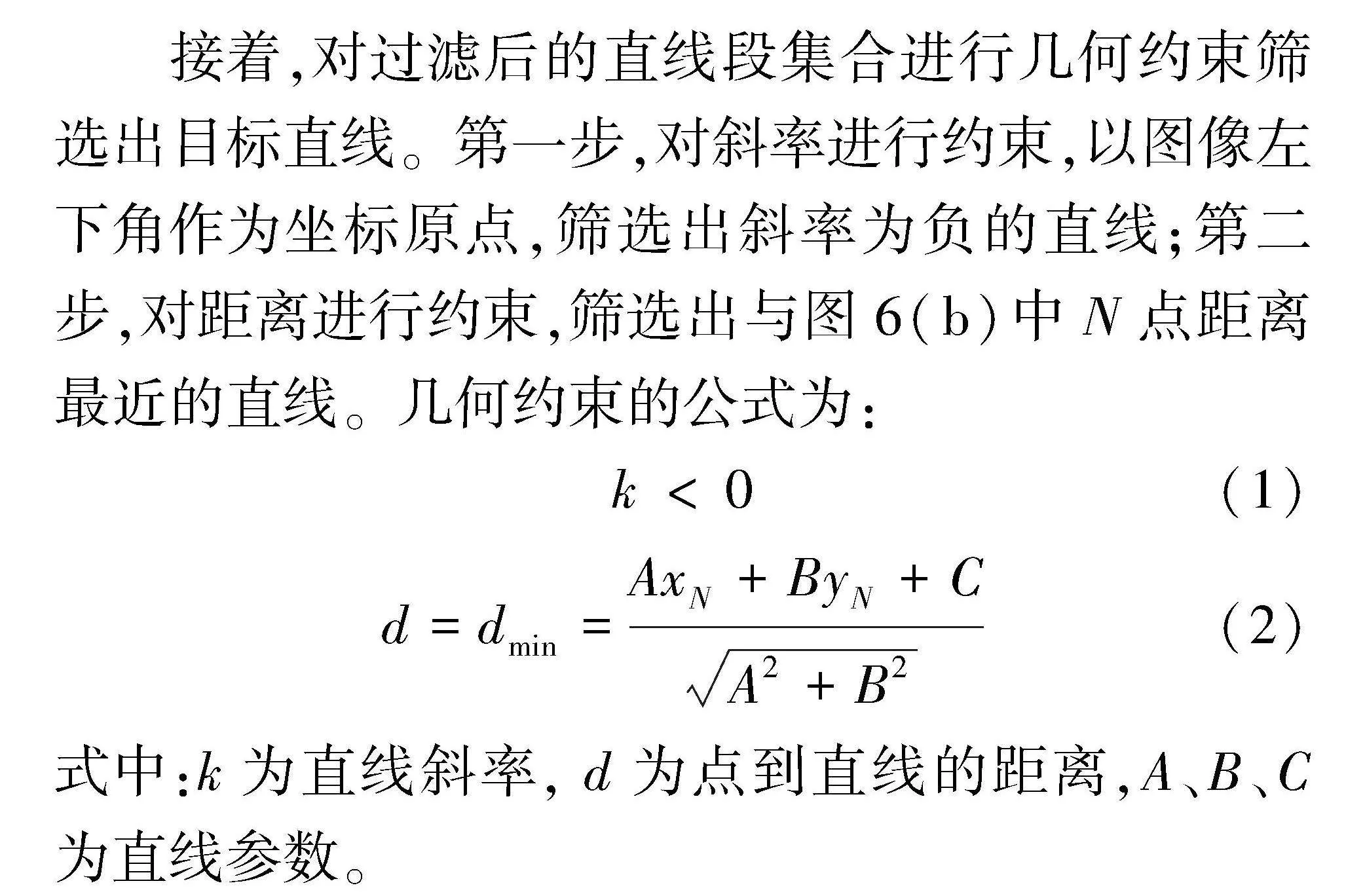

接着,对过滤后的直线段集合进行几何约束筛选出目标直线。第一步,对斜率进行约束,以图像左下角作为坐标原点,筛选出斜率为负的直线;第二步,对距离进行约束,筛选出与图6(b)中N点距离最近的直线。几何约束的公式为:

klt;0(1)

d=dmin=AxN+ByN+CA2+B2(2)

式中:k为直线斜率,d为点到直线的距离,A、B、C为直线参数。

在筛选出目标直线后,需要确定新的多边形顶点。沿着目标直线的垂线方向寻找图像轮廓的外切线,与目标直线的交点为新的M点,更新M点,如图8(c)所示,修正后的多边形如8(d)所示。

1.3.3" 建立西装领结构模型

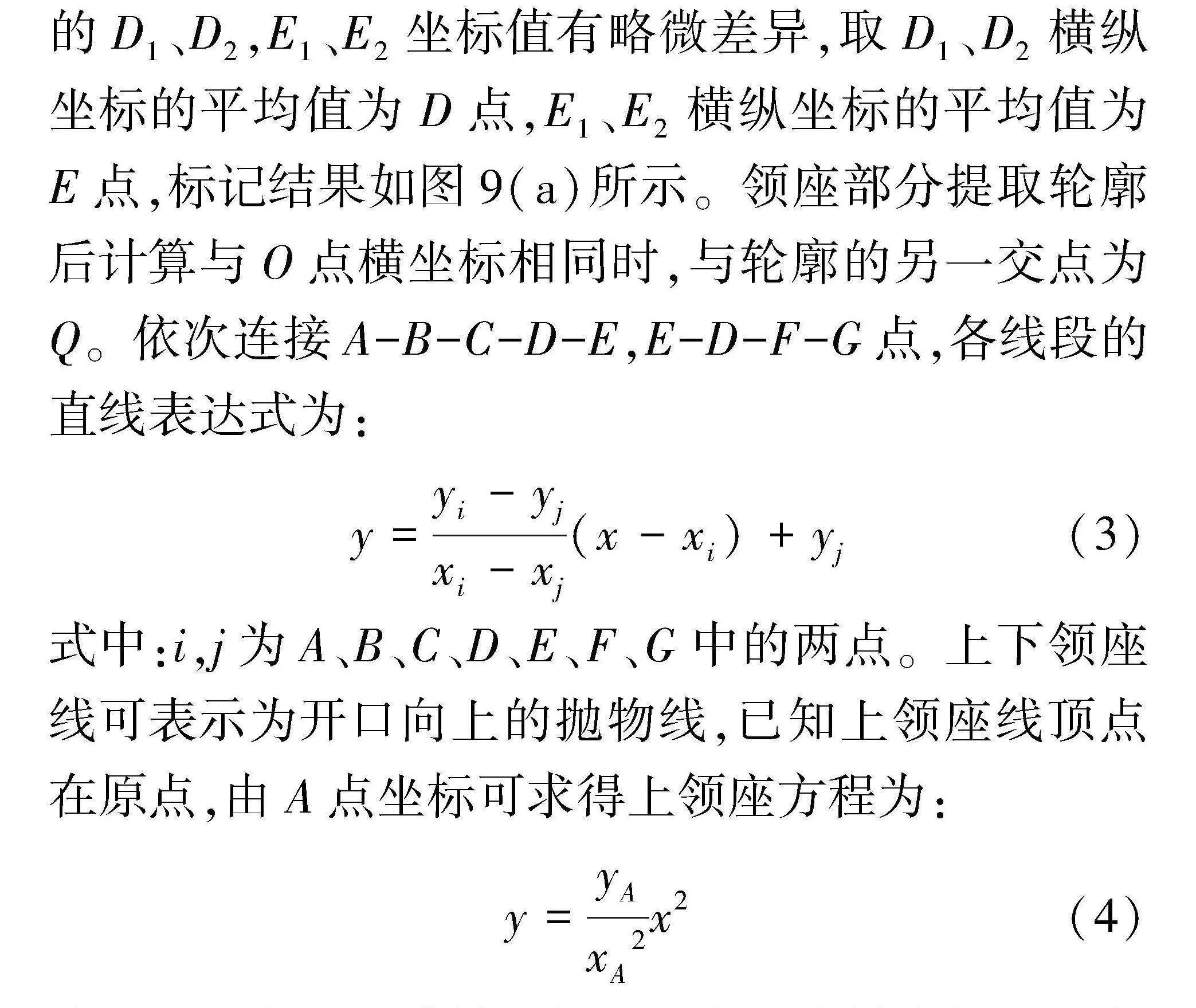

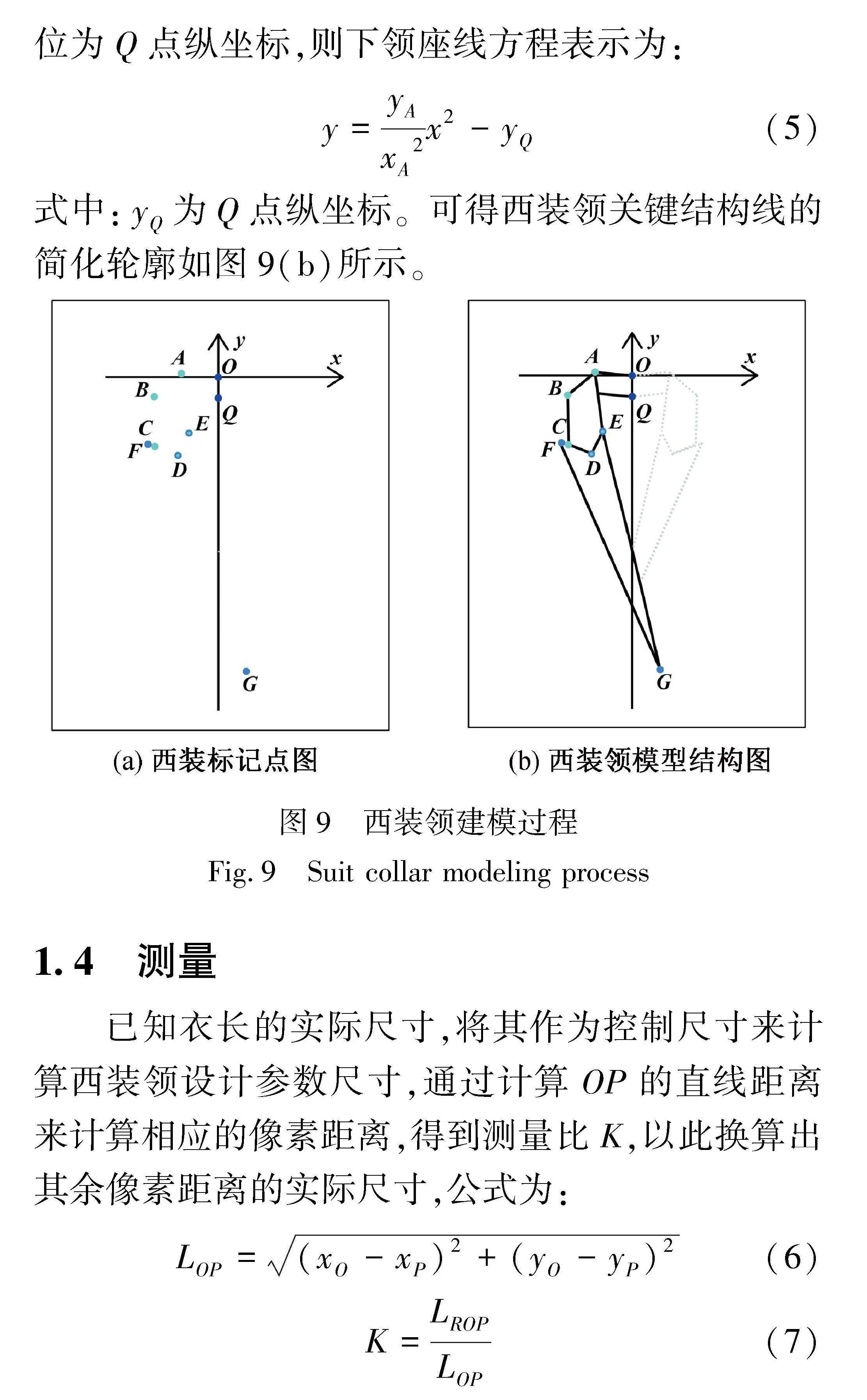

将西装领领座、翻领、驳领组合起来,构造西装领结构模型。以戗驳领为例,首先在西装图像中标定衣长,得到相应控制点O、P,并以O点为坐标原点建立直角坐标系,接着定义翻领部件的关键点A、B、C、D1、E1,以及驳领部件的关键点D2、E2、F、G。由于分割或近似多边形过程中产生的误差导致共点的D1、D2,E1、E2坐标值有略微差异,取D1、D2横纵坐标的平均值为D点,E1、E2横纵坐标的平均值为E点,标记结果如图9(a)所示。领座部分提取轮廓后计算与O点横坐标相同时,与轮廓的另一交点为Q。依次连接A-B-C-D-E,E-D-F-G点,各线段的直线表达式为:

y=yi-yjxi-xj(x-xi)+yj(3)

式中:i,j为A、B、C、D、E、F、G中的两点。上下领座线可表示为开口向上的抛物线,已知上领座线顶点在原点,由A点坐标可求得上领座方程为:

y=yAxA2x2(4)

式中:xA为A点横纵坐标;yA为A点纵坐标。下领座线可表示为上领座线向下平移的抛物线,平移单位为Q点纵坐标,则下领座线方程表示为:

y=yAxA2x2-yQ(5)

式中:yQ为Q点纵坐标。可得西装领关键结构线的简化轮廓如图9(b)所示。

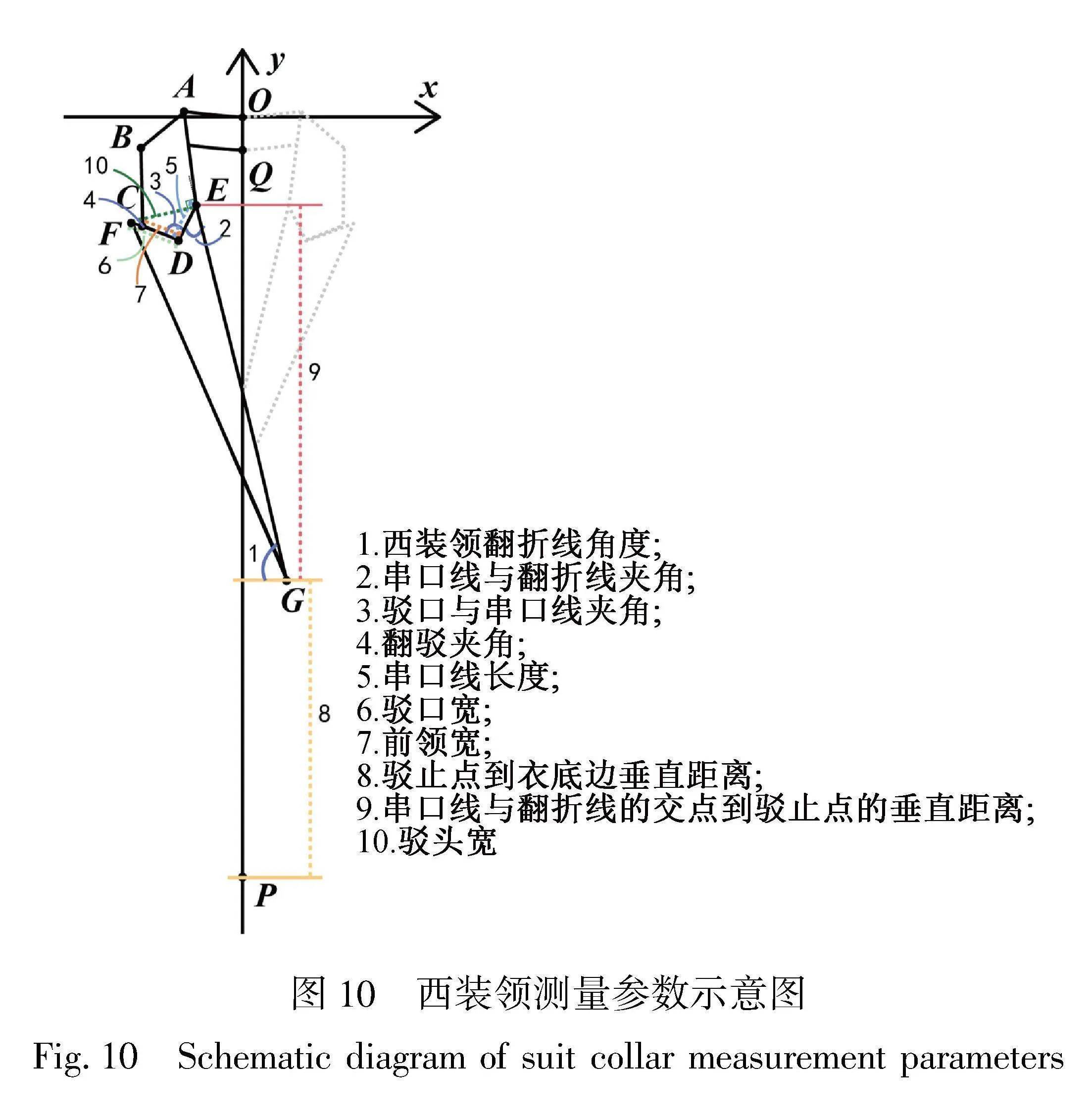

1.4" 测量

已知衣长的实际尺寸,将其作为控制尺寸来计算西装领设计参数尺寸,通过计算OP的直线距离来计算相应的像素距离,得到测量比K,以此换算出其余像素距离的实际尺寸,公式为:

LOP=(xO-xP)2+(yO-yP)2(6)

K=LROPLOP(7)

式中:LOP为像素距离, LROP为衣长OP的实际距离。

参考文献[1]和制版参数要求,对西装领的设计尺寸进行定义输出,设计尺寸为影响西装领外观造型的尺寸,因此其他因素如领座宽、松量、面料等未考虑在内,主要从款式图中读取以下指标:西装领翻折线角度、串口线与翻折线夹角、驳口与串口线夹角、翻驳夹角、串口线长度、驳口宽、前领宽、驳止点到衣底边垂直距离、串口线与翻折线的交点到驳止点的垂直距离、驳头宽。测量示意图如图10所示,即分别求图中角度∠EGH、∠DEG、∠EDF、∠CDF,距离DE、DF、CD,以及点G、P和点E、G在y轴方向的垂直距离,△FGE底边为EG时的高。利用坐标关系和三角函数可求得这些参数的像素距离和角度,驳头宽则通过应用海伦定理求解。

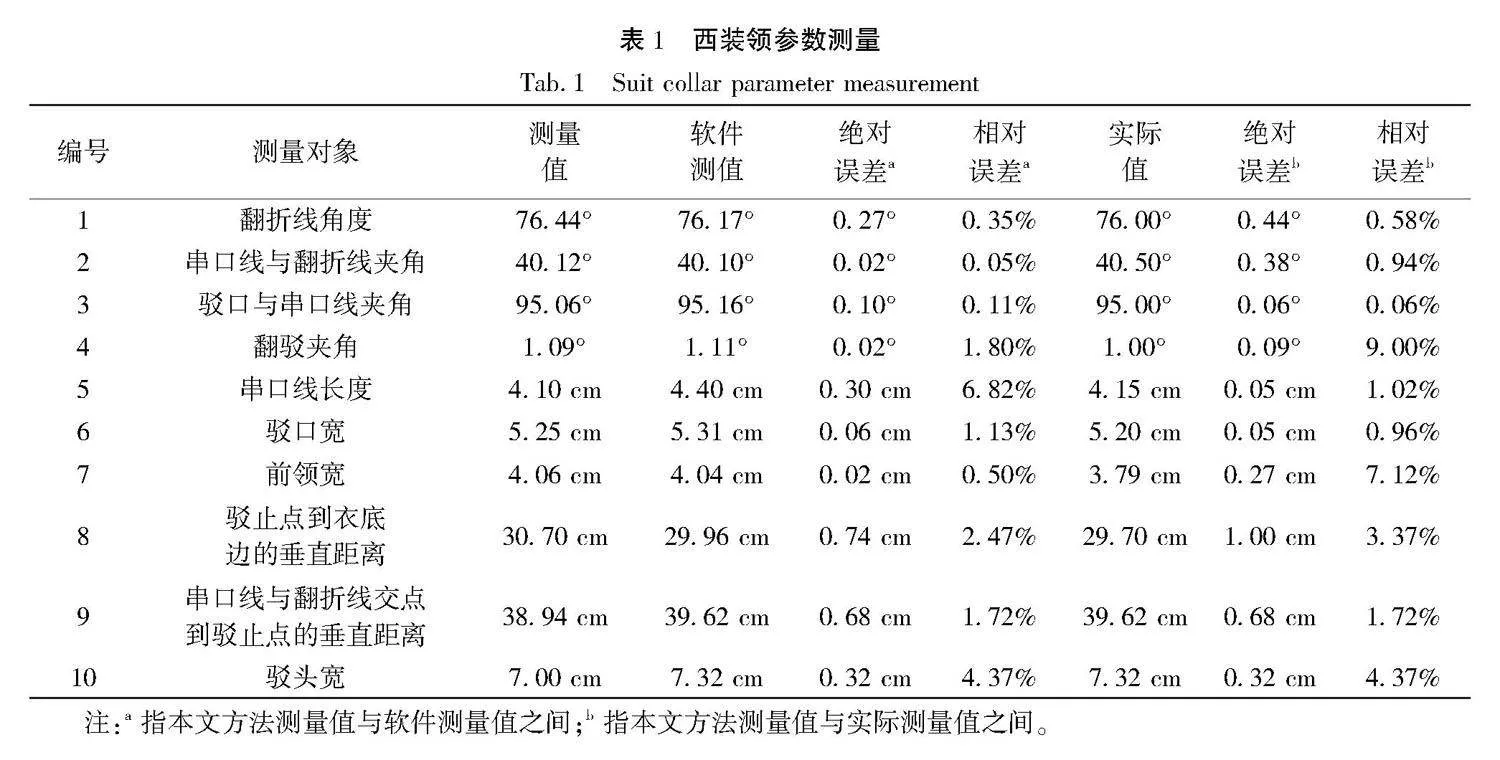

2" 验证

为了验证测量数据的准确性,在能对图像进行精密测量的Digimizer软件上进行手工测量,并对西装实物进行测量。为减少人工误差,测量结果均为测量3次后的平均值,结果如表1。

通过本方法测量的尺寸与测量软件相比,绝对误差在0.02~0.74 cm之间,相对误差在0.50%~6.82%之间;角度测量绝对误差在0.02°~0.27°之间,误差较小;与实物测量相比,尺寸的绝对误差在0.05~1 cm之间,相对误差在0.96%~4.37%之间,角度的绝对误差在0.06°~0.68°之间。实验误差在1 cm内满足服装测量的标准。其中误差最大的两个测量部位为驳止点到衣底边的垂直距离和串口线与翻折线交点到驳止点的垂直距离,原因是靠近驳止点的驳领区域面积过小,算法无法完全捕捉到驳止点的边界,从而产生了一定的误差,导致驳止点到衣底边的垂直距离测量值偏大,而串口线与翻折线交点到驳止点的垂直距离偏小。

3" 总结与展望

本文提出了一种从服装实物图中提取西装领款式参数信息的方法,首先使用SAM模型分割出西装领部件,然后对部件近似多边形并通过LSD算法修正多边形,建立西装领结构参数模型并提取了主要的设计尺寸,主要结论如下:

a)通过SAM模型对西装领部件分割,得到了西装领翻领、驳领和领座的掩膜。

b)利用LSD算法和几何约束调整西装领部件多边形结果,通过一次函数和抛物线构建了西装领结构参数模型。

c)对西装领的主要设计尺寸进行了测量,结果表明,与测量软件相比,尺寸的绝对误差在0.02~0.74 cm之间,角度的绝对误差在0.02°~0.27°之间;与实物测量相比,尺寸的绝对误差在0.05~1 cm之间,角度的绝对误差在0.06°~0.68°之间,测量误差满足服装测量的标准。

本文研究结果可为制版师提供西装领的设计尺寸参考,提高款式到样板的转换效率。另外,由于SAM模型为零样本泛化模型,本文思路可泛化应用在其他部件或服装的尺寸测量上。然而,本文所测得尺寸为平面尺寸,并不是服装样板实际尺寸,因此还需要在后期研究中探究两者之间的映射关系,并进行进一步的修正调整。

参考文献:

[1]LIN K, LIU K. Research on parametric design of men's suit lapel based on knowledge[J]. International Journal of Clothing Science and Technology, 2023, 35(5): 698-714.

[2]周奕涵, 徐一诺, 李涛, 等. 基于PSO-LSSVM算法的脸型与男西装领型适配性研究[J]. 丝绸, 2023,60(12):92-98.

ZHOU Yihan, XU Yinuo, LI Tao, et al. Research on the adaptation of face shapes and men's suit collar types based on PSO-LSSVM[J]. Journal of Silk, 2023,60(12):92-98.

[3]CAO L, JIANG Y, JIANG M. Automatic measurement of garment dimensions using machine vision[C]//Interna-tional Conference on Computer Application and System Modeling (ICCASM). Taiyuan, China. IEEE, 2010: 30-33.

[4]李鹏飞, 郑明智, 景军锋. 图像处理在衣服尺寸在线测量中的应用[J]. 电子测量与仪器学报, 2016, 30(8): 1214-1219.

LI Pengfei, ZHENG Mingzhi, JING Junfeng. Application of image processing in on-line clothes size measurement[J]. Journal of Electronic Measurement and Instrumentation, 2016, 30(8): 1214-1219.

[5]SERRAT J, LUMBRERAS F, RUIZ I. Learning to measure for preshipment garment sizing[J]. Measurement, 2018, 130: 327-339.

[6]邓莹洁,罗戎蕾.基于卷积神经网络的半身裙款式特征分类识别[J]. 现代纺织技术,2021,29(6):98-105.

DENG Yingjie, LUO Ronglei. Classification and recognition of bust skirt style and common features based on convolutional neural network[J]. Advanced Textile Technology,2021,29(6):98-105.

[7]KIM S, MOON H, OH J, et al. Automatic measurements of garment sizes using computer vision deep learning models and point cloud data[J]. Applied Sciences, 2022, 12(10): 5286.

[8]PAULAUSKAITE-TARASEVICIENE A, NOREIKA E, PURTOKAS R, et al. An intelligent solution for automatic garment measurement using image recognition technologies[J]. Applied Sciences, 2022, 12(9): 4470.

[9]王燕珍. 服装款式识别数字化表现原则[J]. 纺织学报, 2007, 28(12): 94-98.

WANG Yanzhen. Digital principles for identification of garment styles[J]. Journal of Textile Research, 2007, 28(12): 94-98.

[10]LI C, XU Y, XIAO Y, et al. Automatic measurement of garment sizes using image recognition[C]// Proceedings of the 1st International Conference on Graphics and Signal Processing. Singapore Singapore. ACM, 2017: 30-34.

[11]KIRILLOV A, MINTUN E, RAVI N, et al. Segment anything[C]//IEEE/CVF International Conference on Computer Vision (ICCV). Paris, France. IEEE, 2023: 3992-4003.

[12]XU C, DOU J, FENG Z. Positioning laser line detection algorithm of construction robot based on LSD and improved least squares method[C]//29th International Conference on Mechatronics and Machine Vision in Practice (M2VIP). Queenstown, New Zealand. IEEE, 2023: 1-6.

[13]HUANG S, WANG Y, XIAO Y, et al. Machine vision based transformer insulation pad identification detection[C]//8th International Conference on Intelligent Compu-ting and Signal Processing(ICSP). Xi′an, China. IEEE, 2023: 184-188.

[14]LIN X, ZHOU Y, LIU Y, et al. A comprehensive review of image line segment detection and description: Tax-onomies, comparisons, and challenges[J]. IEEE Transa-ctions on Pattern Analysis and Machine Intelligence, 2024, 99: 1-20.

A size measurement method for suit collar design based on a SAM model

PENG" Zhouyana," MA" Linga," SU" Huimina," PAN" Yitinga," ZOU" Fengyuana,b,c

(a.School of Fashion Design amp; Engineering; b.Key Laboratory of Silk Culture Heritage and Products

Design Digital Technology, Ministry of Culture and Tourism; c.Zhejiang Provincial Research Center

of Clothing Engineering Technology, Zhejiang Sci-Tech University, Hangzhou 310018, China)

Abstract:

As the center of the overall visual effect of a suit, the suit collar is the most crucial factor that affects the overall visual impression. In creating clothing patterns based on design sketches, the judgment of important detailed dimensions like the suit collar often relies on the experience of pattern makers and their repeated trials and errors. Therefore, using computer vision to assist in determining the detailed dimensions of the suit collar is of great significance. However, current research on clothing measurement mainly focuses on measuring the outer contour dimensions, with unsatisfactory results for measuring the internal contour dimensions.

Low contrast in the internal contour lines of clothing makes it difficult to extract feature points and complete contours and further results in the difficulty of measuring internal dimensions from images. To address this issue, a method based on the SAM model for segmenting components to extract internal dimensions was proposed. Firstly, the SAM model was used to segment the suit collar components to improve the edge accuracy. Next, the DP algorithm was used to approximate the suit collar components into polygons, and the LSD algorithm and geometric constraints were employed to correct the errors generated during the polygon approximation process. Finally, a structural model of the suit collar was established by incorporating pixel ratios to extract relevant data.

Three main conclusions are drawn. First, by segmenting the suit collar components with the SAM model, the masks of lapel, reverse collar and collar stand were obtained. Second, by using the LSD algorithm and geometric constraints to adjust the suit collar component polygon result, a suit collar structural parameter model through linear and parabolic functions was constructed. Third, the main design dimensions of the suit collar were measured, and the results showed that compared with the measurement software, the absolute error of dimensions ranged from 0.02 cm to 0.74 cm, and the absolute error of angles ranged from 0.02° to 0.27°. Compared with the physical measurement, the absolute error of dimensions ranged from 0.05 cm to 1 cm, and the absolute error of angles ranged from 0.06° to 0.68°. The measurement error met the standards for clothing measurement.

This method can provide pattern makers with reference dimensions for the suit collar, enhancing the efficiency of transitioning from design to sample. The dimensions obtained in this study are plan view sizes and not the actual dimensions of the clothing sample. In future studies, the mapping relationship between the two will be further explored to make corrections and adjustments.

Keywords:

suit collar; garment parts' segmentation; SAM model; LSD algorithm; style drawing extraction; size measurement