面向电力数据分析的隐私增强联邦学习框架

摘要:为解决模型更新攻击对联邦学习在智能电网中部署与应用的安全威胁,文章基于云边协同框架和隐私计算技术,提出一种面向电力数据分析的安全高效联邦学习框架,通过差分隐私机制为客户端训练模型参数添加噪声,以保护训练过程中模型参数的安全性;利用秘密分享算法对噪声模型参数进行安全聚合,在保证模型快速收敛的同时实现对电力数据和本地模型参数的保护。理论分析和实验结果表明,该方法能够显著提升电力数据和共享模型参数的隐私性。

关键词:联邦学习;差分隐私;秘密分享;电力数据;隐私保护

中图分类号:TP309""文献标志码:A

0"引言

电力数据的对外开放共享可有效预测国民经济的运行情况,为各行业发展提供决策依据[1]。但随着电力数据开放性增加,与用电用户关联的各类信息安全和隐私保护问题也日益凸显。联邦学习(Federated Learning, FL)是一种新颖的机器学习方法,用于解决分布式模型训练时的数据隐私泄露问题[2],作为数据流通的新范式,在满足数据隐私保护和共享分析优化权衡的条件下,实现多方联合使用数据建模,已服务于电力负荷评估、电力监控系统态势感知等场景,为电力行业的运行和发展决策提供有效支持和有力支撑[3]。

联邦学习虽然在一定程度上保障了用户隐私和数据安全,但在共享与分析电力数据上仍然面临诸多挑战[4]。一方面,与集中式机器学习方法不同,FL训练机器学习模型时不与中心服务器共享用户或设备数据,须根据全局模型更新,共享本地模型参数并在全局模型中聚合所有模型参数,这使得上传更新模型参数到中心服务器时通信开销花费较高。另一方面,电力数据通常是差异性较大的非独立同分布数据,该特点使得由电力数据训练产生的模型收敛性和性能不佳。此外,在联邦学习交换模型参数过程中极易受到梯度泄露攻击、成员推理攻击等多类攻击影响,安全性和隐私性降下。因此,设计隐私增强的联邦学习技术在保证用户信息和数据安全的前提下,实现有效的数据分析和降低通信开销是当前研究热点,其在电力数据中的应用研究也成为智能电网发展的重点。

为解决上述问题,陈嘉翊等[5]基于联邦学习和同态加密算法,提出了一种电力数据预测模型的局部保护方法,解决了数据模型训练过程中的隐私泄露问题,有效降低了网络资源开销。Ye等[6]提出了基于边缘计算和FL的系统模型EdgeFed,在不损害隐私的情况下增加用于训练深度学习模型的数据量和多样性,同时降低边缘设备的计算成本和总通信开销。Fekri等[7]提出了基于FL和长短时记忆网络的分布式负荷预测模型,归一化处理不同大小的智能电表读数,提升了模型的准确率。李宇远等[8]提出了用于保护电力物联网中用户数据安全的FL框架,通过对用户分级进行数据管理和分析的,提高模型训练效率。Liu等[9]通过提取和捕获数据的整体特征和时间特征,设计了基于FL的CNN-Attention-LSTM 模型对多种能源负荷进行预测,在保护客户端隐私的同时,保证了模型提取特征的能力。Gupta等[10]以隐私保护为导向的FedGrid框架,用于预测可再生能源的发电量和电力负荷,以实现高效的电力供应。

本文所做的工作与上述工作不同,通过将差分隐私、秘密分享与基于云边协同的联邦学习框架结合,增强电力数据的隐私性同时提高用户通信效率。利用差分隐私机制为本地客户端训练模型参数添加噪声,在此过程中设计梯度裁剪机制控制噪声引入量以确保训练模型的有效性。在上传模型参数到边缘服务器聚合时,采用秘密分享算法处理加噪模型参数,进一步确保原始数据的安全性。

1"预备知识

1.1"联邦学习

联邦学习使参与者能够联合训练共享模型而不泄露其实际数据,从而在一定程度上保护参与者的数据隐私[11],每个参与者训练一个集成的神经网络模型并通过中央聚合器对其进行更新,以分布式方式协作找到最小化全局损失函数Θ(ω)的参数[12]:

ω*=argminΘ(ω)(1)

为了找到该参数,模型服务器首先从所有节点中随机选择参与者参加联邦学习训练。所选参与者从模型服务器下载全局模型参数Θ(ω)后,使用随机梯度下降(Stochastic Gradient Descent, SGD)算法进行局部模型训练。本轮局部训练中,被选中的参与者的局部模型参数表示为:

ωi(t+1)=ω(t)-ηΘ(ωi(t))(2)

其中,ω表示全局迭代次数,η为训练步长。

在所有参与者完成本地模型训练后,将其本地模型参数以分布式方式上传到模型服务器,由模型服务器使用联邦平均算法FedAvg对全局模型进行聚合,即对收集到的模型参数进行平均处理得到新的全局模型参数。在第N轮中生成的全局模型参数如下:

ωi(t+1)=∑Ni=1Diωi(t+1)∑Ni=1Di(3)

其中,Di表示每个参与者拥有的本地数据集样本数量。

模型服务器在生成新的全局模型参数并完成本轮聚合后,将更新后的全局模型以集中方式返回给参与者,以供下一轮训练。当达到全局迭代的预定义阈值时,训练过程终止。

1.2"差分隐私

差分隐私(Differential Privacy, DP)是一种应用广泛的数据隐私保护技术[13],其核心思想是通过在原始数据或查询结果中添加随机噪声,达到提高发布数据的隐私性,降低与数据集中个人信息相关的隐私泄露风险的目的。

定义1"(ε,δ)-差分隐私。给定一个随机算法,相邻数据集和满足|D1ΔD2|≤1,即和仅有一条数据记录不同,若在相邻数据集和的任意输出结果满足:

Pr[M(D1)∈S]≤exp()Pr[M(D2)∈S]+δ(3)

则称随机算法满足差分隐私。其中,Pr[M(D1)∈S]表示数据集经过随机算法处理后输出的概率。为用于控制隐私保护级别的隐私预算,其值越小表示隐私级别越高。δ表示向数据添加噪声时违反差分隐私的概率,其值为0时,式(1)为严格意义上的差分隐私定义。

定义2"全局敏感度。给定任意函数,则该函数的全局敏感度为:

Δ=SupD1D2‖f(D1),f(D2)‖(4)

其中,‖f(D1),f(D2)‖表示数据集和之间的欧氏距离。

定义3"高斯机制。给定数据集和任意函数,若算法的输出满足:

F(D)=f(D)+N(0,Δ2σ2)(5)

其中,σ=Δ2log(1.25/δ)/为高斯分布的标准差,用于控制噪声的尺度。δ∈(0,1)表示松弛项,表示违反严格差分隐私定义的概率。

1.3"秘密分享

秘密分享是安全多方计算中主流技术,其核心思想是通过设计特殊算法将秘密值x分成个部分{x1,x2},将其中一份秘密分享给秘密共享者,在秘密恢复时由双方进行协同计算得到明文结果,由秘密分享算法和秘密恢复算法2个部分构成[14]。

秘密分享算法:对于秘密值x,秘密拥有者利用生成随机数r←RZ2l将秘密值分成[x]0=r和[x]1=x-r(bmod2l),并发送给参与计算的两方。

秘密恢复算法:参与方通过计算x=[x]0+[x]1(bmod2l)恢复秘密值。

秘密分享具有加法同态性与乘法同态性。

加法同态性:[x][y]分别是秘密值x和y的份额,秘密共享双方可计算得到[z]i=[x]i+[y]i。

乘法同态性:秘密共享双方借助三元组(a,b,c)进行乘法运算[z]=[x][y],其中c=ab。离线阶段,秘密分享方计算得到三元组([a]i,[b]i,[c]i)。在线计算阶段,秘密分享方计算出[e]i=[x]i-[a]i,[f]i=[y]i-[b]i。秘密共享双方交换并恢复e和f,最终秘密拥有者计算[z]i=-ief+e[y]i+[x]i f+[c]i。

2"面向电力数据分析的隐私增强联邦学习方法

本节对面向电力数据分析的隐私增强联邦学习方法进行详细介绍,首先定义面向电力数据分析的隐私增强联邦学习系统模型与安全需求,其次在定义模型和需求的基础上设计方案,最后分析所提方案的安全性。

2.1"系统模型与安全需求

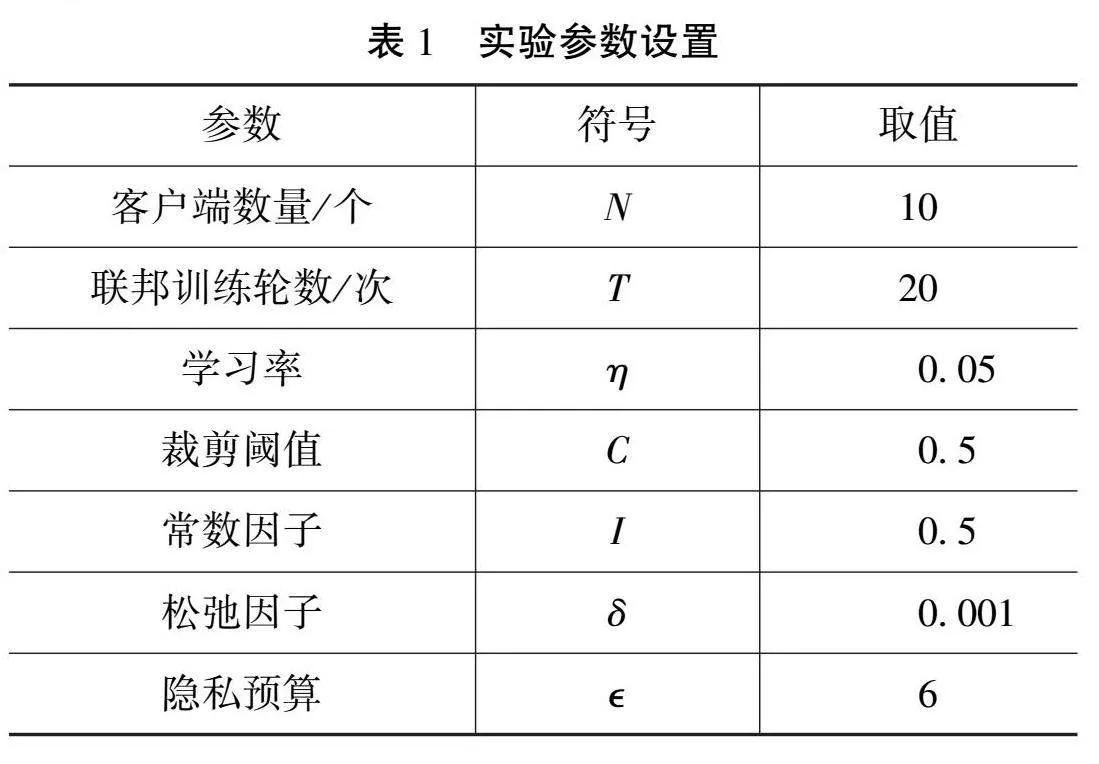

本文系统模型由4个主要实体组成,分别为电力数据拥有者(Power Data Owners, PDOs)(如电网公司、政府、银行、医院等)、边缘服务器(Edge Server, ES)、云服务器(Cloud Server, CS)以及能源服务提供商(Energy Service Providers, ESPs)(公共事业公司)。其中,PDOs各自拥有部分地区的电力数据,为实现整个地区电力数据分析以提供能源服务,需要使用拥有的数据进行联邦学习训练,在提升电力用户信息及数据隐私性的前提下,向能源服务提供商提供准确性较高的模型。

在上述系统模型中,假设提供数据的PDOs和提供服务的ESPs被认为是诚实可信的,CS和ES被认为是诚实且好奇的,任何PDOs、ESPs、CS与ES之间彼此不会共谋。具体来说,CS和ES会严格遵循协议存储由PDOs上传的模型参数,并向ESPs提供用于能源服务的聚合模型,但它们也会因好奇原始数据相关信息,而尝试使用各类手段对接收到的模型参数进行学习分析,窥探数据中包含的隐私或敏感信息。

基于上述威胁模型,所设计方案应保证联邦学习参与方的隐私性,即任何敌手都无法从联邦学习过程中获得泄露的本地数据集和由其训练出的模型参数,同时在最大程度降低计算和通信开销的基础上,保证发布全局模型的准确性,满足隐私性、效率与准确性3个方面的安全需求。

2.2"方案设计

为满足上述安全需求,在云边一体化智能电网下,本文引入了差分隐私机制和秘密分享算法,设计实现面向电力数据分析的隐私增强联邦学习方案,如图1所示。当ESPs将联邦学习任务发布到云端时,联邦学习任务由CS托管并下发任务请求到多个边缘计算节点组成的ES或直接将其发送给PDOs。若ES收到任务请求,则为PDOs分发训练所需的参数和数据。当PDOs收到训练所需的参数,则根据提供的模型训练数据集,在局部模型中对训练性能良好的特征标签添加差分隐私噪声,并利用秘密分享算法对加噪模型进行划分后上传到ES。ES聚合更新模型后,将其发送给CS进行全局聚合并将结果返回给ESPs。ESPs利用训练好的模型进行数据分析,为行业用户提供定制化的能源服务。本文方案具体实施主要包括学习任务发布、本地模型训练、安全数据聚合与聚合结果恢复4个阶段。

2.2.1"学习任务发布

假设I={1,…,i,…,I}和J={1,…,j,…,J}表示提供能源服务区域中电力数据拥有者PDOs和能源服务提供商ESPs的集合,每个PDOi(i∈I)拥有电力数据集Di(Di=|Di|为数据样本数量),每个ESPj(j∈J)负责将数据分析任务Yj。当接收到ESP发布的数据分析任务后(步骤①);CS使用随机权重初始化全局模型参数Θ,将其传递给所有参与的PDOs(步骤②)。

2.2.2"本地模型训练

在收到全局模型参数Θ后,每个PDOi使用SGD算法对本地数据集进行局部模型训练并在此过程中加入满足差分隐私保护的噪声(步骤③)。为避免引入过量噪声,使用全局模型函数Θ的L2范数Θt(ωi)=Θ(ωi)/max(1,‖Θt(ωi)‖2/C)作为裁剪标准,其中C表示梯度裁剪阈值。为增强隐私保护效果,设置C为梯度敏感度并在高斯噪声方差中引入常数因子I,保证差分隐私的不确定性,得到扰动后的梯度Θt(ωi)=Θt(ωi)+N(0,C2σ2I)。在训练本地模型时,添加噪声后,攻击者利用逆向工程方法将难以窃取客户端的原始数据信息。然而,由于云服务器CS聚合全局模型,攻击者仍然可以通过其他方式攻击CS窃取原始数据信息,即使所有来自客户端的模型都添加了满足差分隐私保护的噪声,但攻击者仍然可以利用隐私攻击来观察和分析噪声的统计属性,提取客户端的原始隐私数据。为了防止该攻击,PDOi首先将其本地数据集Di划分成大小为ζB的小批次,并通过SGD算法和扰动后的梯度对每个小数据集进行训练,得到更新参数后的模型Θ←Θi-ηΘt(ωi),η为学习率。然后,使用秘密共享协议将Θi划分为[Θi]0和[Θi]1,并将其发送给边缘服务器(步骤④)。

2.2.3"安全数据聚合

在接收到所有客户端更新参数后的模型[Θi]j后,根据秘密分享的加法同态性质计算聚合结果[ΘES]j=∑ni=1[Θi]j,将其上传到云服务器CS(步骤⑤—⑥)。

2.2.4"聚合结果恢复

CS在收到边缘服务器上传的部分聚合结果后,使用秘密恢复算法计算恢复更新参数后的模型ΘES=[ΘES]0+[ΘES]1,更新全局模型参数Θ←Θ-ηΘES,同时检测模型性能,在全局模型达到预定精度后,结束学习过程并将训练后的模型传递给相应的ESP(步骤⑦—⑧)。

2.3"安全性分析

半诚实模型和恶意模型是隐私计算中广泛使用的2种安全模型[15],半诚实敌手严格按照协议进行计算,但会试图从接收到的数据或模型中推断出额外信息,恶意敌手有能力破坏协议并窃取额外信息。在迭代训练中,边缘服务器ES可以获得基于秘密分享与差分隐私的局部模型,而云服务器CS只能收到加噪更新参数后的全局模型。在合理假设2个边缘服务器、与云服务器CS之间不存在合谋勾结的情况下,本文所提出的方案在半诚实模型和恶意模型下是安全的。

定理1.在边缘服务无合谋假设下,本文方案可以保证半诚实模型下PDOs数据的安全性。

证明:在无合谋的假设下,任意边缘服务器只能获得部分加噪密文。假设敌手破坏边缘服务器后,只能获得部分密文。根据秘密共享协议,训练模型的恢复需要和云服务器之间相互合作完成。因此,在半诚实模型下,本文提出的方案可以保证电力数据拥有者数据的安全性。

定理2.在边缘服务无合谋假设下,本文方案可以保证恶意模型下PDOs数据的安全性。

证明:同理,根据秘密分享协议,任意敌手无法从接收的加噪密文中获得任何关于原始数据的隐私信息,边缘服务器每一轮聚合的结果已被电力数据拥有者编码,在此种情况下,敌手无法从聚合结果中窃取额外信息。因此,在恶意模型下,本文提出的方案可以保证电力数据拥有者数据的安全性。

3"实验与结果分析

3.1"实验设置

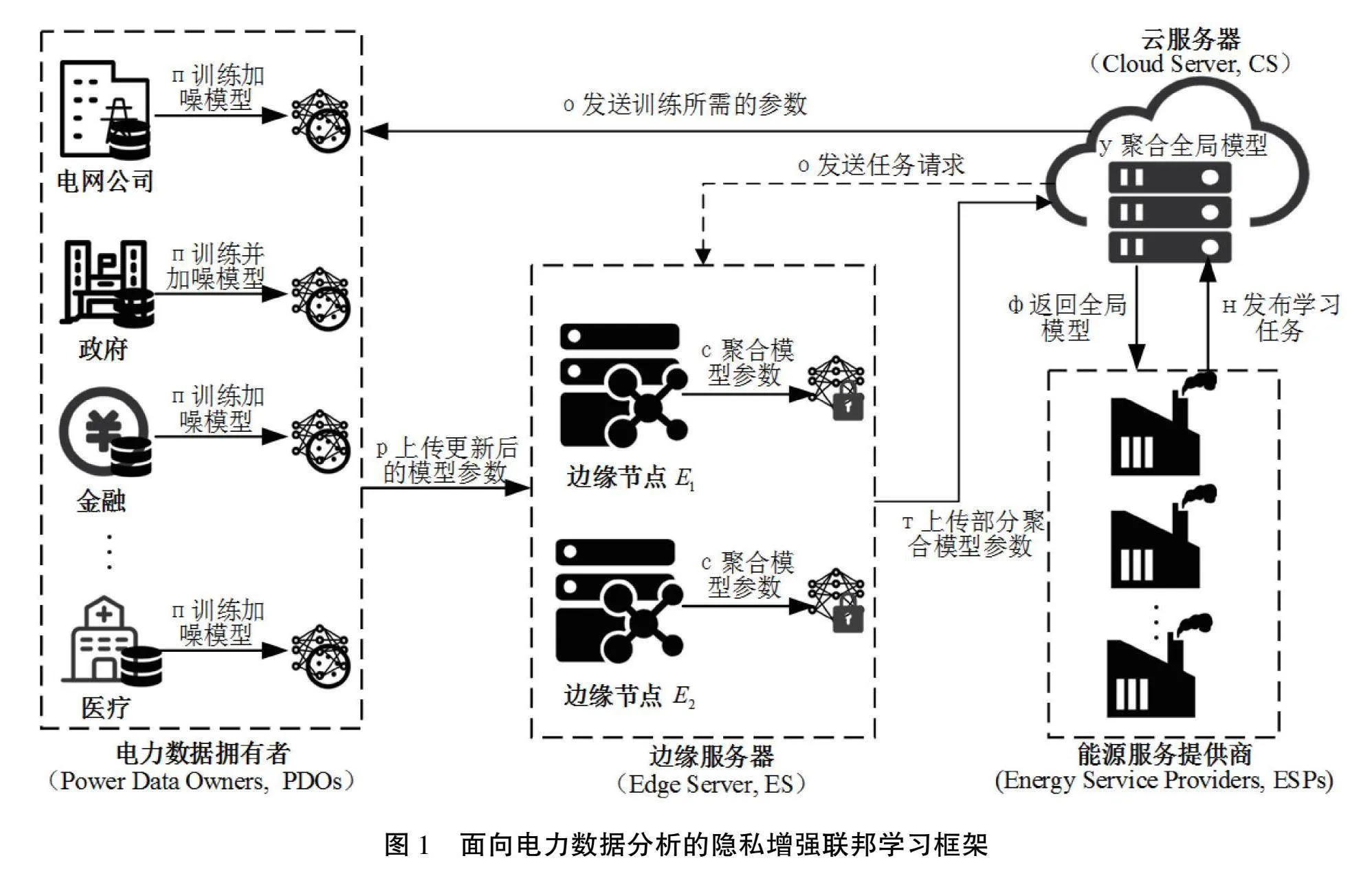

采用的实验环境如下:CPU为Intel Xeon E5-2650 2.30 GHz,GPU为NVIDIA GeForce RTX 3060,126 GB RAM,内存为8 GB,实验平台为PyTorch,网络由一个1 Gbps 延迟为 0.3 ms 的局域网(LAN) 和一个 50 Mbps 延迟为 50 ms 的广域网(WAN)组成。本文提出方法在上述实验环境下的2台参数服务器和10个客户端上进行仿真实验,实验中使用的模拟参数设置如表1所示。实验数据使用UC Irvine 机器学习库中的Individual Household Electric Power Consumption(IHEPC)数据集[16],该数据集为近4年内法国巴黎地区家庭电力使用情况,包括功率、电能等字段信息,选择DP-SGD和EdgeFed作为比较方法[6,17],从隐私性、准确率和效率3方面进行实验评估。

3.2"实验结果分析

本文提出的方法目的是增强基于电力数据的联邦学习的隐私性,同时保证发布模型的准确率以支撑后续数据分析使用,因此实验从模型准确率和隐私性2个角度进行实验分析。

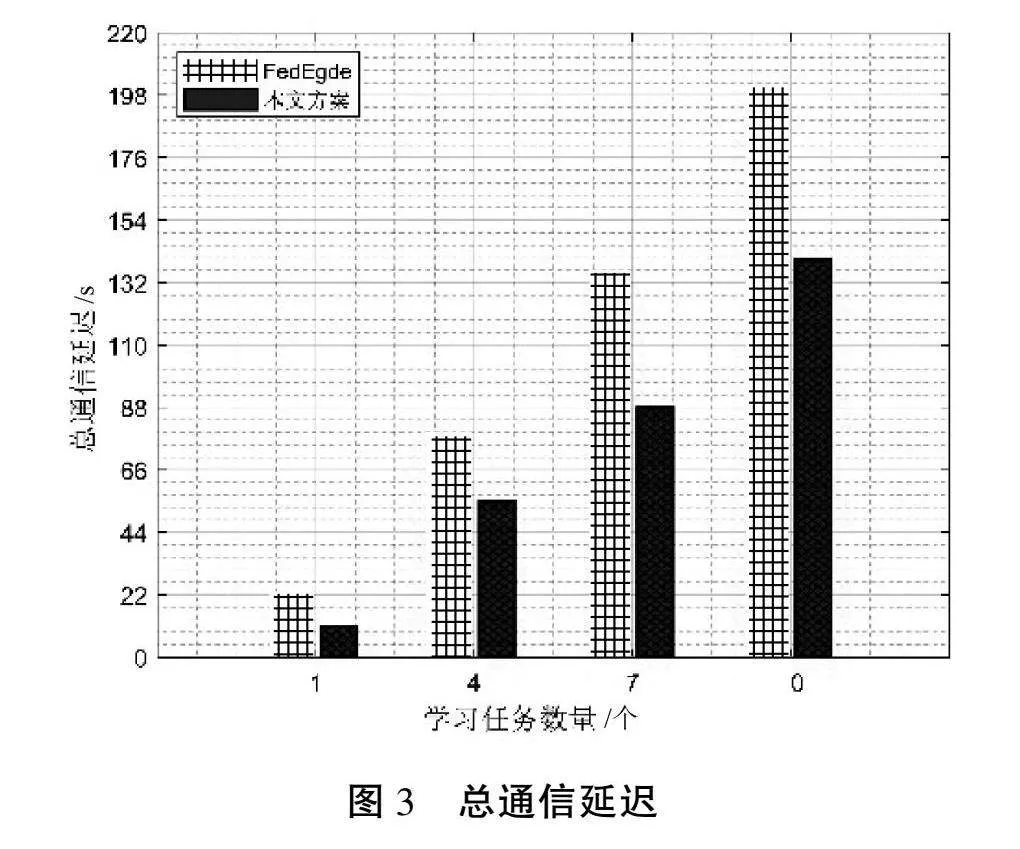

3.2.1"联邦训练轮数对隐私性分析

为了评估本文方案在增强隐私性方面的有效性,通过调整联邦训练迭代次数,分析对隐私预算ε的影响。如图2所示为在IHEPC数据集上本文方案与DP-SGD随着隐私预算的增加模型准确率的变化情况,从图中可以看出,训练迭代次数与隐私预算大小成正比,即隐私预算值越大、训练轮数越多,模型准确率越高。在隐私预算=6时,本文方案与DP-SGD达到几乎相同的最佳样本质量,也进一步说明将隐私预算设置为6是合理且有效的。

3.2.2"准确率分析

为进一步验证本文方案与差分隐私机制、秘密分享协议结合的有效性,在IHEPC数据集上通过在卷积神经网络(CNN, Convolutional Neural Network)、多层感知器(MLP, Multi-Layer Perceptron)上进行全局模型的分类准确性评估。如表2所示,本文方案在分类准确率方面优于其他2种方案,这是因为本文提出的方案在使用差分隐私机制保护模型训练过程时,通过引入常数因子到梯度裁剪机制以避免在模型中添加过多噪声,减少隐私保护对训练模型效果的影响。

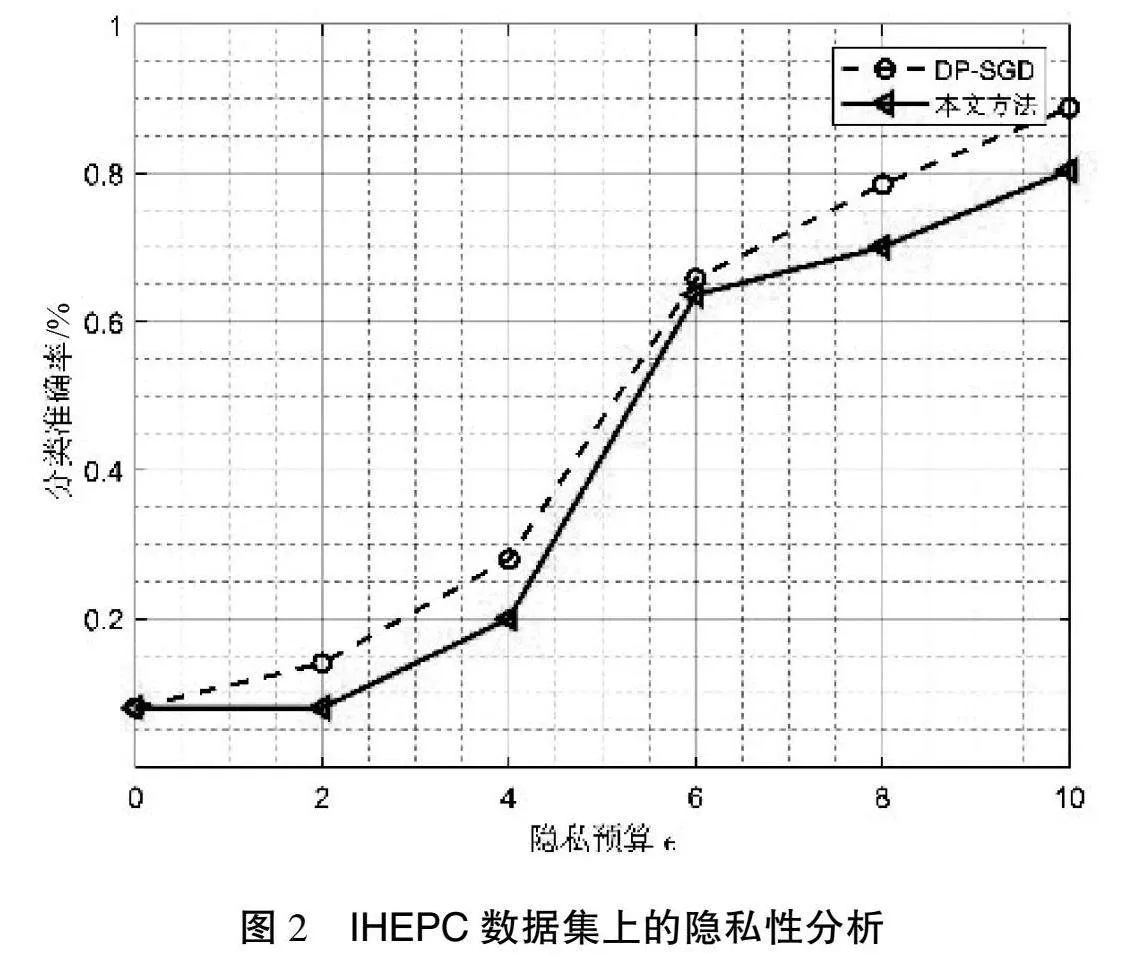

3.2.3"通信效率分析

如图3所示,学习任务数量从 1 到 10 变化时,本文方案与FedEdge方案的总通信延迟。在EdgeFed方案中,全局/本地模型更新过程直接在边缘节点和电力数据拥有者之间交换,没有考虑聚合器。从图3可以观察到,本文提出的方案可以在不同任务数量的情况下有效减少通信延迟,主要是因边缘节点中的聚合器可以改善网络连接和容量,以减少用户和云之间不可靠性和间歇性无线连接的影响,因此本文基于边缘云协作框架提出的联邦学习框架下可实现更高的通信效率。

4"结语

本文针对基于联邦学习的电力数据分析系统,结合差分隐私机制和秘密分享算法,提出了一种隐私增强联邦学习框架,以提升云边协同场景下电力数据的隐私性。通过在本地模型训练过程中添加满足差分隐私保护的高斯噪声,同时在模型参数上传时使用秘密分享算法加密数据,以有效抵抗恶意攻击者和半诚实参与者的梯度泄露攻击和成员推理攻击,同时保护联邦学习参与者的原始数据隐私。此外,还为高斯噪声设置了裁剪阈值,以确保在训练过程中添加噪声后所提模型的有效性。在UCI用电数据集的实验结果表明,本文所提出方法在确保客户端隐私性和安全性的同时,达到了与原始 FL 方法相当的测试准确率水平。

参考文献

[1]KADDOUR S M,LEHSAINI M.Electricity consumption data analysis using various outlier detection methods[J].International Journal of Software Science and Computational Intelligence (IJSSCI),2021(3):12-27.

[2]WEN J,ZHANG Z,LAN Y,et al.A survey on federated learning:challenges and applications[J].International Journal of Machine Learning and Cybernetics,2023(2):513-535.

[3]ZHAO S,BLAABJERG F,WANG H.An overview of artificial intelligence applications for power electronics[J].IEEE Transactions on Power Electronics,2020(4):4633-4658.

[4]李祉岐,张琼尹,李宁,等.新型电力系统中联邦机器学习面临的网络威胁[J].中国信息化,2024(1):49-50,48.

[5]陈嘉翊,孙晨雨,周欣桐,等.基于联邦学习和同态加密的电力数据预测模型本地保护[J].信息安全研究,2023(3):228-234.

[6]YE Y,LI S,LIU F,et al.EdgeFed:optimized federated learning based on edge computing[J].IEEE Access,2020,8:209191-209198.

[7]FEKRI M N,GROLINGER K,MIR S.Distributed load forecasting using smart meter data:federated learning with recurrent neural networks[J].International Journal of Electrical Power amp; Energy Systems,2022(5):137.

[8]李宇远,于海洋.基于联邦学习模型的电力客户隐私保护方法[J].信息技术,2023(6):184-188.

[9]LIU Y,DONG Z,LIU B,et al.FedForecast:a federated learning framework for short-term probabilistic individual load forecasting in smart grid[J].International Journal of Electrical Power amp; Energy Systems,2023(10):152.

[10]GUPTA H,AGARWAL P,GUPTA K,et al.FedGrid:a secure framework with federated learning for energy optimization in the smart grid[J].Energies,2023(24):8097.

[11]CAMPOS E M,SAURA P F,GONZLEZ-VIDAL A,et al.Evaluating federated learning for intrusion detection in Internet of Things:review and challenges[J].Computer Networks,2022,203:108661.

[12]CHEN Q,YAO L,WANG X,et al.SecMDGM:federated learning security mechanism based on multi- dimensional auctions[J].Sensors,2022(23):9434.

[13]DWORK C,ROTH A.The algorithmic foundations of differential privacy[J].Foundations and Trends"in Theoretical Computer Science,2014(3-4):211-407.

[14]KEERUP K,BOGDANOV D,KUBO B,et al.Privacy-preserving analytics,processing and data management[J].Big Data in Bioeconomy:Results from the European DataBio Project,2021(8):157-168.

[15]LU Y,ZHANG B,REN K.Maliciously secure MPC from semi-honest 2 PC in the server-aided model[J].IEEE Transactions on Dependable and Secure Computing,2023(21):3109-3125.

[16]HEBRAIL G,BERARD A.Individual household electric power consumption data set[EB/OL].(2012-08-01)[2024-07-19].https://doi.org/10.24432/C58K54.

[17]ZHAO J,CHEN Y,ZHANG W.Differential privacy preservation in deep learning:challenges,opportunities and solutions[J].IEEE Access,2019,7:48901-48911.

(编辑"沈"强)

Privacy-enhanced federated learning framework for power data analysis

DING "Yi1, YANG "Jun2, SHEN "Bo2

(1.China Electronics Technology Group Corporation, Beijing 100846, China;

2.The 15th Research Institute of China Electronics Technology Group Corporation, Beijing 100083, China)

Abstract: "To address the security threat of model update attacks on the deployment and application of federated learning in smart grids, this article proposes a secure and efficient federated learning framework for power data analysis based on cloud edge collaboration framework and privacy computing technology. By adding noise to the training model parameters of the client through differential privacy mechanism, the security of the model parameters during the training process is protected; Using secret sharing algorithm to securely aggregate noise model parameters, while ensuring fast convergence of the model, to protect power data and local model parameters. Theoretical analysis and experimental results indicate that this method can significantly improve the privacy of power data and shared model parameters.

Key words: federated learning; differential privacy; secret sharing; electricity data; privacy protection