基于深度神经网络的红外与可见光图像融合算法研究

摘要:该文提出并优化了一种基于深度神经网络的红外与可见光图像融合算法,采用感知损失和对抗性训练两种优化策略。经实验验证,优化算法在图像质量上超越传统方法。感知损失提高了融合图像的清晰度和语义信息,对抗性训练增强了真实感和细节保留。这一研究为红外与可见光图像融合领域引入了先进的深度学习方法,为相关领域的技术应用提供了有力支持。

关键词:图像融合;深度神经网络;感知损失;对抗性训练

doi:10.3969/J.ISSN.1672-7274.2024.10.012

中图分类号:TP 391.41 文献标志码:B 文章编码:1672-7274(2024)10-00-03

Research on Infrared and Visible Light Image Fusion Algorithm

Based on Deep Neural Networks

Abstract: This article proposes and optimizes an infrared and visible light image fusion algorithm based on deep neural networks, using two optimization strategies: perceptual loss and adversarial training. Through experimental verification, the optimization algorithm surpasses traditional methods in image quality. Perceived loss improves the clarity and semantic information of fused images, while adversarial training enhances realism and detail preservation. This study introduces advanced deep learning methods into the field of infrared and visible light image fusion, providing stxi4UZGpiK0aCgt4U9Fm82PlT0Xn27x8QSobKu1p8LQI=rong support for technical applications in related fields.

Keywords: image fusion; deep neural networks; perceived loss; adversarial training

1 研究背景

红外与可见光图像融合技术在军事、医疗、环境监测等领域有广泛应用。深度神经网络以其强大的特征学习能力和对复杂模式的高度抽象能力脱颖而出。在图像融合中,深度神经网络的应用有望提高图像融合的准确性和鲁棒性[1]。

本文通过对融合算法进行挑选,并且进行针对性优化,优化方法涉及参数调整、数据增强、损失函数的改进以及硬件加速的利用。通过实验与性能对比,本研究旨在验证优化方法的有效性,并为深度神经网络在红外与可见光图像融合中的应用提供实际指导。

2 图像融合算法选择与设计

过去的研究中,已经提出了多种红外与可见光图像融合的算法,每种算法都有其独特的优缺点。深度神经网络在图像融合领域的应用呈现出日益增长的趋势[2]。一些典型的网络结构如UNet、FusionNet等,以其强大的特征提取和图像重建能力成为研究热点[3]。综合考虑,本文选择UNet作为基础图像融合算法的主要原因在于其卓越的性能在语义分割任务中得到了验证。

2.1 UNet网络结构

UNet的网络架构主要分为编码器和解码器两个部分,组成U形结构,使其适用于图像融合任务。

(1)编码器(下采样部分):在编码器的每一层中的第i层的特征图,首先对其进行卷积操作(Convolution)以提取特征,然后进行最大池化操作(Pooling)以降低分辨率。

式中,ReLU(Rectified Linear Unit)是一种激活函数,用于神经网络中的每个神经元。ReLU激活函数的数学表达式简单来说,对于输入x,如果x大于零,ReLU返回x;如果x小于或等于零,则返回零。从图形上看,ReLU函数在x大于零时是一条直线,斜率为1;而在x小于等于零时,函数值为零。

(2)解码器(上采样部分):解码器的每一层包含上采样、特征图拼接和卷积操作。

式中,Concatenate表示将当前解码器层与对应的编码器层进行通道拼接,通过卷积操作进一步提取特征。上采样通过插值方法将特征图的分辨率提高,与低分辨率的编码器特征进行融合,从而保留更多的细节信息。通过层层堆叠和连接,UNet实现了对输入图像的逐层编码和逐层解码,保留了丰富的语义信息。

2.2 UNet在红外与可见光图像融合中的适应性

2.2.1 通道融合机制

在通道融合阶段,UNet通过通道拼接将编码器和解码器的特征图结合起来。

式中,表示将编码器和解码器的特征图进行通道拼接;为权重矩阵;为偏置;为激活函数。通道融合机制有助于网络更好地理解红外与可见光图像之间的相关性。

2.2.2 适应性损失函数

适应性损失函数是为了引导网络学习编码器和解码器之间更适应性的特征表示而设计的。在红外与可见光图像融合任务中,由于两种图像具有不同的传感器特性和物理特性,学习如何适应性地融合这两者的信息是关键。

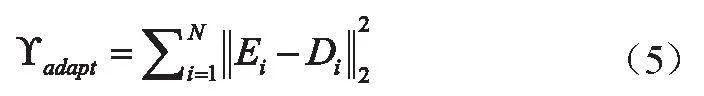

适应性损失函数通过计算编码器和解码器各层特征图之间的欧几里得距离来量化它们之间的差异。设为编码器的第i层特征图,为解码器的第i层特征图,适应性损失函数的表达式为

式中,表示欧几里得距离,度量了编码器和解码器在第i层特征上的相似性。这个损失函数的目标是最小化特征图之间的差异,从而使网络更好地适应不同层次的信息。通过加入适应性损失,网络被迫学习更具适应性的特征表示,有助于处理红外与可见光图像的差异,提升融合效果。

2.2.3 整体目标函数

整体目标函数综合考虑了均方误差损失和适应性损失,以综合性的方式引导网络学习更好的图像融合特征表示。

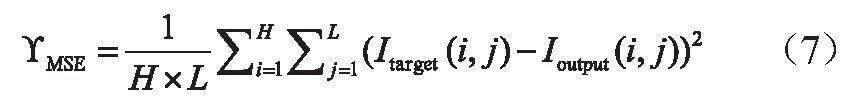

式中,为均方误差损失函数,该损失衡量了网络生成图像与真实图像之间的差异,它促使网络学习产生与真实图像相似的融合结果。均方误差损失的表达式为

式中,是真实的融合图像;是网络生成的融合图像;和分别是图像的高度和宽度。

整体目标函数用于权衡均方误差损失和适应性损失,其中是一个用于平衡两者重要性的超参数。整体目标函数的最小化旨在使网络在图像融合任务中既能够生成高质量的融合图像,又能够学习适应性更强的特征表示,以更好地处理红外与可见光图像的异质性。

3 算法优化方法

本文的主要优化方法集中在改进损失函数上。这一优化方法同时服务于提高图像融合质量和减小计算复杂度的目标,通过更精细地约束网络的学习过程,提高算法的性能和实际应用的效果。

3.1 引入感知损失

为了引入感知损失,本文在网络中添加感知层,该层基于预训练的卷积神经网络(如VGG16)中的中间层特征。感知损失衡量了生成图像和真实图像在感知层上的特征差zELX59TBc/Jy/zyE9G+/1w==异。具体而言,对于感知层上的每个位置,感知损失计算特征的欧几里得距离表达式如下:

式中,和分别表示生成图像和真实图像在感知层上的特征表示。通过最小化感知损失,网络被迫更加关注图像的感知质量,以更自然、真实地融合红外与可见光图像。

3.2 对抗性训练

对抗性训练引入了判别器网络,旨在使生成图像和真实图像在判别器层上难以区分。判别器的目标是最小化真实图像和生成图像之间的差异,而生成器则追求最大程度地欺骗判别器。对抗性训练的损失函数表达式如下:

式中,表示判别器对真实图像的判别概率;表示判别器对生成图像的判别概率。通过最小化生成器和判别器之间的对抗性损失,网络被迫学习生成更逼真、更真实的图像,提高了生成图像的质量。这种对抗性训练机制有助于使生成图像更符合真实图像的分布,从而提升图像融合效果。

4 算法实现及实验

4.1 优化方法的引入

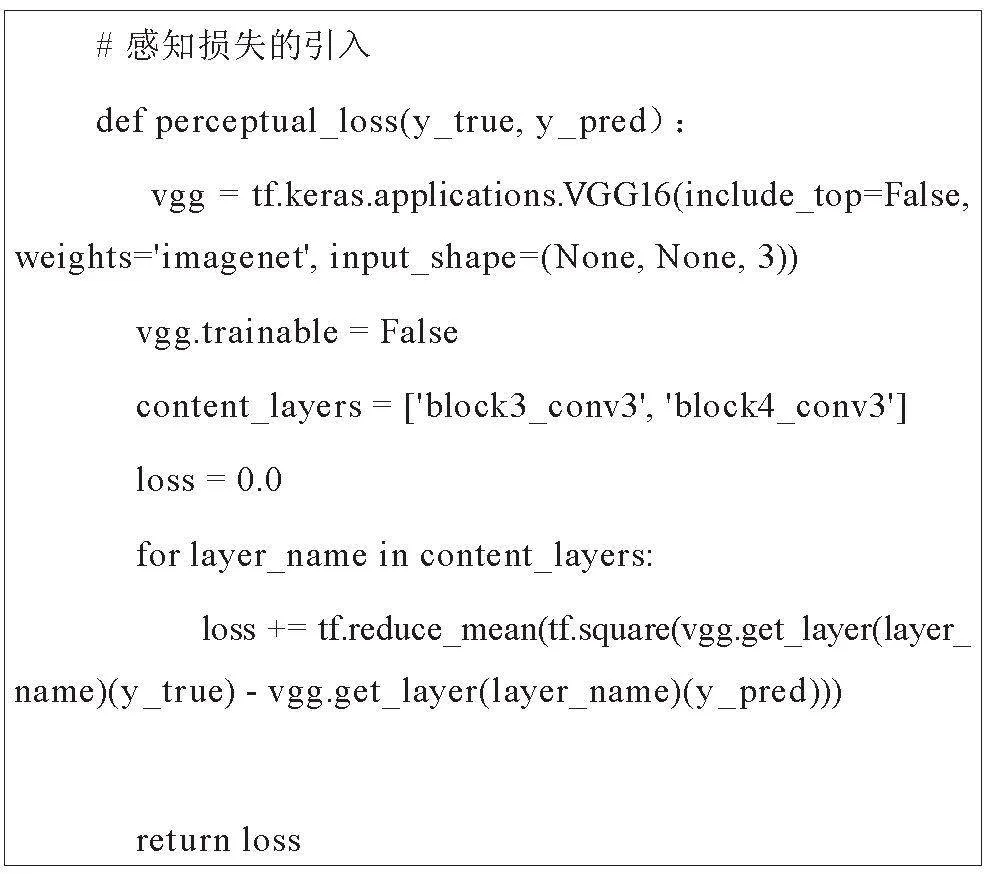

4.1.1 感知损失的引入

本文选择一种主流深度学习框架TensorFlow,使用框架提供的API或自定义UNet网络结构。这段代码实现了感知损失的引入,主要通过加载预训练的VGG16模型,选择特定卷积层作为感知层,并计算生成图像和真实图像在这些感知层上的特征差异。

4.1.2 对抗性训练的引入

上述代码段实现了对抗性训练中的对抗损失,其核心思想是通过训练生成器来生成更具迷惑性、更逼真的图像,以欺骗判别器。

(1)构建了一个判别器模型,其目标是对输入的图像进行二分类,将真实图像判别为“真”(real)而将生成图像判别为“假”(fake)。通过将判别器的可训练属性设为不可训练,确保在对抗性训练中仅关注生成器的优化。

(2)计算了生成图像和真实图像通过判别器后的预测结果,并使用二元交叉熵损失来量化生成图像欺骗判别器的能力。生成图像的对抗损失旨在使判别器更容易将其分类为“真”,而真实图像的对抗损失则使判别器更容易将其分类为“真”。

(3)通过将两者相加,形成了最终的对抗性训练损失,该损失用于生成器的训练过程,推动生成器生成更逼真的图像,以应对判别器的分类挑战。这一对抗性训练的机制有助于提升生成器的图像生成能力。

4.2 对比实验

笔者进行了四组对比实验,具体实验参数和数据,如表1所示。

实验数据表明,引入感知损失和对抗性训练的算法配置相较于原算法在PSNR和SSIM上均表现更优。同时引入这两种优化策略进一步提高了图像质量,PSNR达到31.0 dB,SSIM达到0.95。

5 结束语

本文提出并优化了一种红外与可见光图像融合算法,引入了感知损失和对抗性训练。实验证明,感知损失和对抗性训练的协同作用有效提高了融合图像的清晰度、真实感和细节保留。该研究为红外与可见光图像融合领域提供了一种先进的深度学习方法,可为相关应用和技术的进一步发展提供参考。

参考文献

[1] 王欣雨,刘慧,朱积成,等.基于高低频特征分解的深度多模态医学图像融合网络[J].图学学报,2024(1):65-67.

[2] 徐慧琳,赵鑫,于波.一种基于梯度残差网络的红外与可见光图像融合算法[J].宁夏师范学院学报,2023,44(10):104-112.

[3] 王恩龙,李嘉伟,雷佳,等.基于深度学习的红外可见光图像融合综述[J].计算机科学与探索2024,18(4):899-915.