改进PConvUNet图像修补的解包裹方法

摘" 要: 包裹相位图是描述相位信息分布的二维或三维图像,广泛应用于光学干涉和计算机视觉等领域。精密齿轮齿面由于自身形状特征、加工及使用等因素影响,在激光干涉测量中包裹相位图常出现区域分布异常的条纹,导致解包裹时出现错误,极大降低了齿面形貌的测量精度。针对此问题,提出一种包裹相位图修补的解包裹方法,在PConvUNet网络中添加了深度残差模块与CBAM注意力模块用于修补相位图中质量差的包裹相位区域。实验证明,修补后的相位图能在解包裹时有效消除相位跳变点,有效提高了干涉图像处理的精度。

关键词: 包裹相位图; 齿面干涉图像; PConvUNet; 图像修补; 条纹错切; 解包裹

中图分类号: TN247⁃34" " " " " " " " " " " " " 文献标识码: A" " " " " " " " " " " " "文章编号: 1004⁃373X(2024)05⁃0046⁃07

Unwrapping method based on improved PConvUNet image patching

DOU Enze, YANG Pengcheng, LI Xiaocheng, REN Tuo

(School of Mechanical and Electrical Engineering, Xi’an Polytechnic University, Xi’an 710048, China)

Abstract: Wrapping phase diagram is a two⁃dimensional or three⁃dimensional image describing the distribution of phase information, which is widely used in optical interference and computer vision. Due to the influence of its shape characteristics, processing and use, there are often abnormal fringes in the wrapping phase diagram of precision gear tooth surface in laser interferometry, which leads to errors in unwrapping and greatly reduces the measurement accuracy of the tooth surface topography. In view of this, an unwrapping method for patch of the wrapping phase diagram is proposed. In the method, the depth residual module and CBAM attention module are added to the PConvUNet network to patch the wrapping phase region with poor quality in the phase diagram. Experimental results show that the patched phase diagram can eliminate phase jump points effectively during unwrapping and improve the precision of interference image processing.

Keywords: wrapping phase diagram; interference image of tooth surface; PConvUNet; image inpainting; fringe miscutting; unwrapping

0" 引" 言

激光干涉测量技术作为一种高精度和非接触式的测量方法,应用于齿轮制造和质量控制领域[1]。干涉图是测量中唯一采集的数据,对干涉图的处理精度决定了测量精度。干涉图像处理中相位解包裹算法至关重要,其目标是从干涉图像中提取出相位信息,并恢复出准确的相位分布,以实现对目标物体的高精度测量[2]。

目前,经典的相位解包裹算法主要可以归为两大类:路径跟踪法和最小范数法[3]。路径跟踪法是一种局部算法,包括枝切法、质量图引导法、掩模割线法和最小不连续法,它们旨在优化解包裹路径的选择,以将解包裹错误限制在低质量的噪声区域,并避免对后续解包裹过程产生影响。然而,在齿轮制造和使用过程中,齿轮齿面通常会受到沟槽、起伏和断层等影响,同时齿面形状高度差较大,干涉图像中的条纹也非常密集。这些因素导致齿轮齿面包裹相位图中出现条纹粘连、条纹错位以及条纹剪切等情况,降低了相位的连续性,增加了解包裹的难度。枝切法[4]是一种基于搜索的解包裹算法,通过逐步剪枝搜索的方式来恢复相位的连续性。然而,当包裹相位图中存在剪切、错位和粘连条纹时,相位的连续性会受到破坏,导致枝切法难以正确恢复相位。同时剪切、错位和粘连条纹会导致相位跳变,使得枝切法无法有效地剪枝并获得准确的解包裹结果。质量图引导法[5]是一种基于图像质量评估的解包裹算法,它通过优化相位图的质量评估指标来实现解包裹。然而,在齿轮齿面存在条纹剪切、错位和粘连的情况下,质量图引导法将无法正确估计相位图的质量,从而影响解包裹结果的准确性。

为了解决传统解包裹方法对齿轮齿面包裹相位图解包裹困难的问题,目前常采用一些去噪或抗震动的方法对齿面包裹相位图进行预处理。采用小波变换去除相位图中的高频噪声[6],这种方法能够有效地去除由于非正常条件(热波、机械振动、风等)导致的随机噪声,提高相位数据的质量。然而,现有的滤波方法滤波操作只是滤除了随机噪声,对那些出现问题的异常条纹基本没有效果。图像修补方法[7⁃9]也被用于填补数据缺失或修复损坏的相位图。文献[10]提出了基于图像修补理论和质量图引导算法的相位解包裹方法,该处理过程用于纠正那些异常条纹,利用邻近条纹的相似性,借助图像修补的方法将更为合理的相位值填充到这些区域,从而得到新的、高质量的相位分布图以实现更好的相位解包和位移测量。此外,Li等人设计了一个主要由即插即用的复归特征推理模块和知识一致注意(KCA)模块组成的递归特征推理(RFR)网络[11],用于修复大面积的缺失图像。文献[12]提出了一个统一的前馈生成网络,引入新的上下文注意模块,通过学习特征表示来显式匹配和关注相关的背景斑块,显著改善了图像的内部修补结果。

本文采用深度学习的方法修补包裹相位图并进行解包裹,以提高图像修补的准确度和恢复的精度。首先,在解包裹处理之前用齿面物体像灰度法识别包裹相位图存在的剪切、错位区域;其次,对齿面包裹相位图的这些区域进行修补;最后,将处理后的包裹相位图用传统的方法进行解包裹。

1" 图像修补模型

1.1" 改进的PConvUNet网络模型

PConvUNet[13⁃14]网络针对复杂包裹相位图修复任务中存在特征提取能力不足的问题,引入深度残差模块与CBAM模块作为改进措施。在PConvUNet网络中添加了多个改进的深度残差块,使模型着重关注包裹相位图前景区域的特征并提高模型的表达能力和网络深度,更好地学习到包裹相位图的特征和纹理模式,从而提高修复质量和视觉效果。

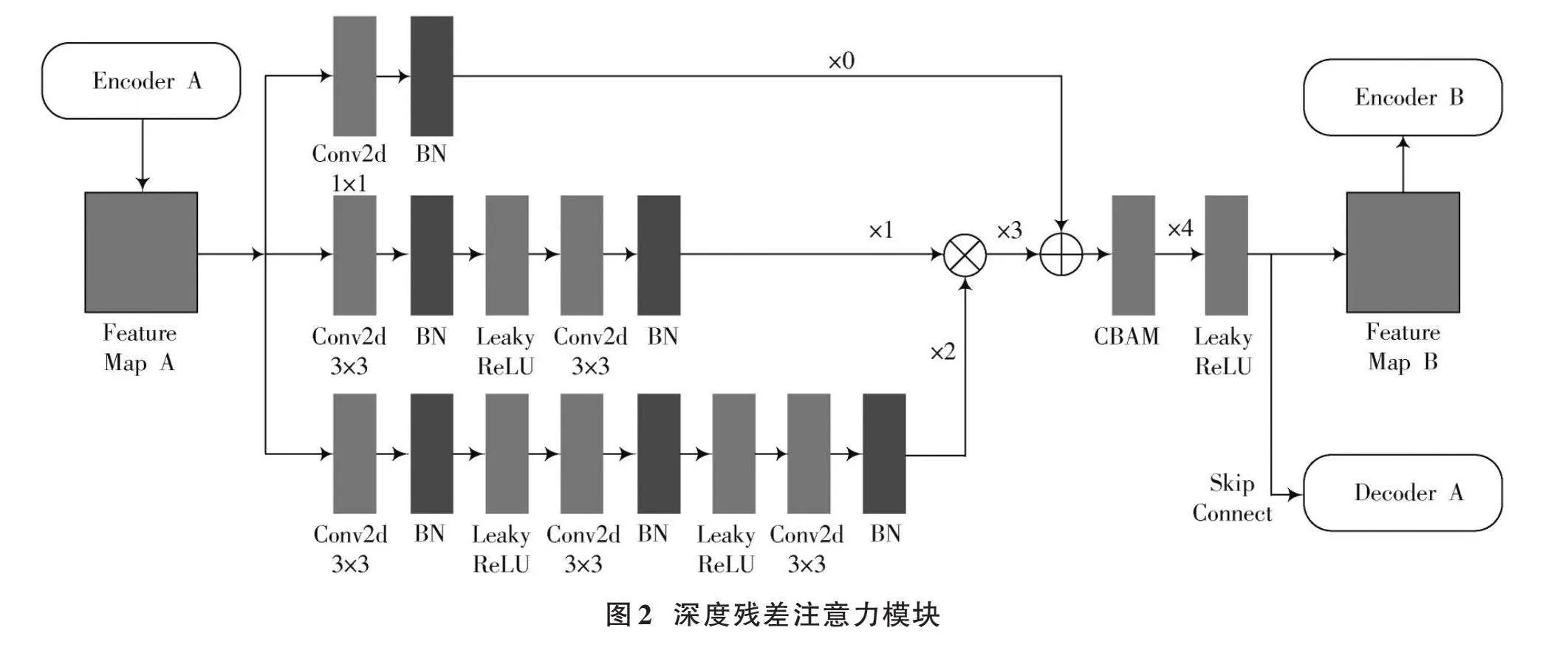

改进后的网络模型结构中引入了深度残差注意力模块,该模块位于上下层编码器之间,以增强网络的特征提取能力。深度残差模块接收卷积后的特征信息作为输入,通过融合不同深度的语义特征,在保持输入和输出特征通道数不变的情况下,将输出传递给下一层编码器,并通过跳跃连接的方式传递给解码器,实现对低层和高层语义特征的融合。这样能够更好地捕获图像中的细节信息和上下文语义。

此外,网络模型中还添加了CBAM(Convolutional Block Attention Module),聚焦于包裹相位区域以减少背景信息的干扰。CBAM模块能够自适应地调整特征图的通道权重和空间注意力,有助于提升网络对包裹相位图的关注程度和重要性。改进的PConvUnet网络模型如图1所示。

1.2" 深度残差注意力模块

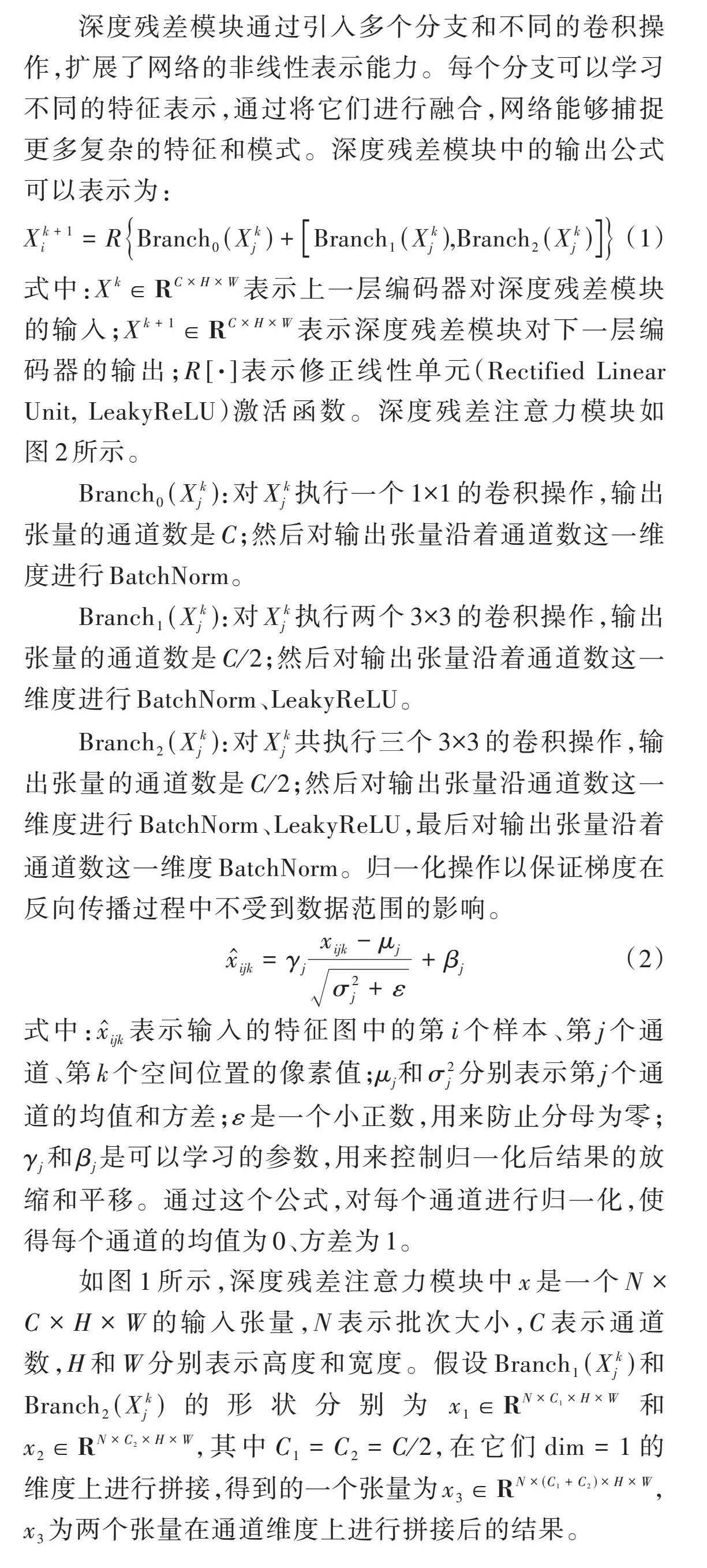

深度残差模块通过引入多个分支和不同的卷积操作,扩展了网络的非线性表示能力。每个分支可以学习不同的特征表示,通过将它们进行融合,网络能够捕捉更多复杂的特征和模式。深度残差模块中的输出公式可以表示为:

[Xk+1i=RBranch0(Xkj)+Branch1(Xkj),Branch2(Xkj)] (1)

式中:[Xk∈RC×H×W]表示上一层编码器对深度残差模块的输入;[Xk+1∈RC×H×W]表示深度残差模块对下一层编码器的输出;[R[·]]表示修正线性单元(Rectified Linear Unit, LeakyReLU)激活函数。深度残差注意力模块如图2所示。

[Branch0(Xkj)]:对[Xkj]执行一个1×1的卷积操作,输出张量的通道数是[C];然后对输出张量沿着通道数这一维度进行[BatchNorm]。

[Branch1(Xkj)]:对[Xkj]执行两个3×3的卷积操作,输出张量的通道数是[C2];然后对输出张量沿着通道数这一维度进行[BatchNorm]、[LeakyReLU]。

[Branch2(Xkj)]:对[Xkj]共执行三个3×3的卷积操作,输出张量的通道数是[C2];然后对输出张量沿通道数这一维度进行[BatchNorm]、[LeakyReLU],最后对输出张量沿着通道数这一维度[BatchNorm]。归一化操作以保证梯度在反向传播过程中不受到数据范围的影响。

[xijk=γjxijk-μjσ2j+ε+βj]" " " (2)

式中:[xijk]表示输入的特征图中的第[i]个样本、第[j]个通道、第[k]个空间位置的像素值;[μj]和[σ2j]分别表示第[j]个通道的均值和方差;[ε]是一个小正数,用来防止分母为零;[γj]和[βj]是可以学习的参数,用来控制归一化后结果的放缩和平移。通过这个公式,对每个通道进行归一化,使得每个通道的均值为0、方差为1。

如图1所示,深度残差注意力模块中[x]是一个[N×C×H×W]的输入张量,[N]表示批次大小,[C]表示通道数,[H]和[W]分别表示高度和宽度。假设[Branch1(Xkj)]和[Branch2(Xkj)]的形状分别为[x1∈RN×C1×H×W]和[x2∈RN×C2×H×W],其中[C1=C2=C2],在它们[dim=1]的维度上进行拼接,得到的一个张量为[x3∈RN×(C1+C2)×H×W],[x3]为两个张量在通道维度上进行拼接后的结果。

[x3=x1,x2]" (3)

[x4]表示将两个张量逐元素相加后的结果,[Branch0(Xkj)]的形状为[x0∈RN×C×H×W],[x0]和[x3]的形状相同,均为[x0,x3∈RN×C1+C2×H×W]。

[x4=x0+x3] (4)

通过以上的设计和改进,深度残差注意力模块可以提升网络的表示能力、梯度传播效果和信息传递效率,从而改善模型的性能和训练效果。

2" 数据集来源与模型训练

2.1" 包裹相位图数据集

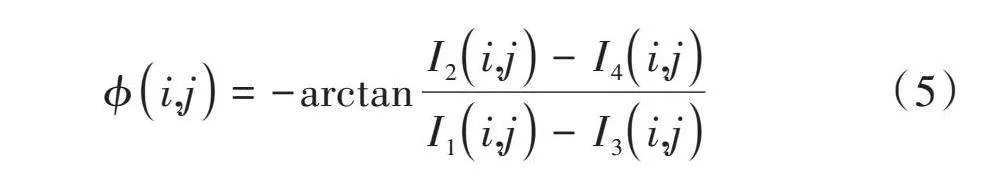

本研究测量精密齿轮齿面形状误差采用的是基于Mach⁃Zehnder干涉仪改进的移相干涉测量系统[15]。通过压电陶瓷的等步距移项,用CCD相机拍摄四步移项的齿面物体像干涉图,并根据公式(5)将四步移项干涉图的相位包裹在[-π]~[π]之间,并以灰度图形式保存。

[ϕi,j=-arctanI2i,j-I4i,jI1i,j-I3i,j]" " (5)

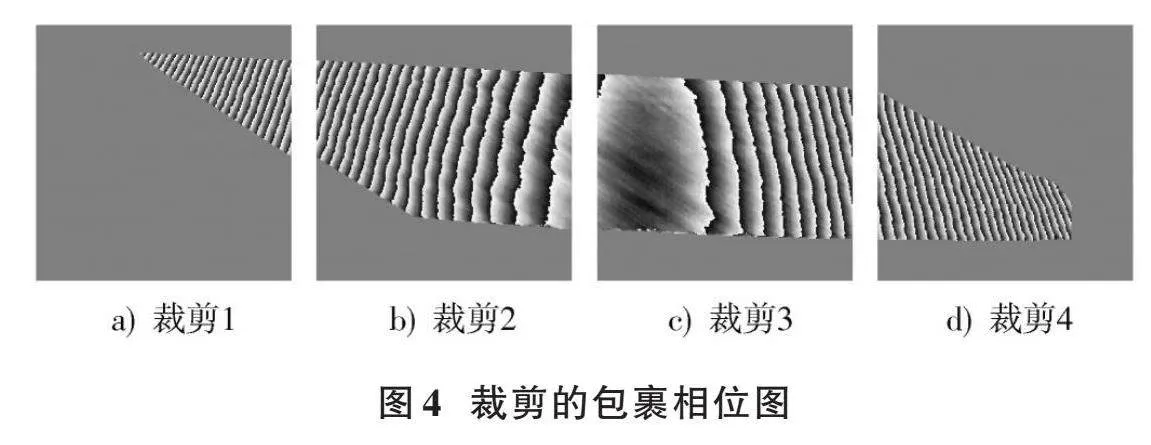

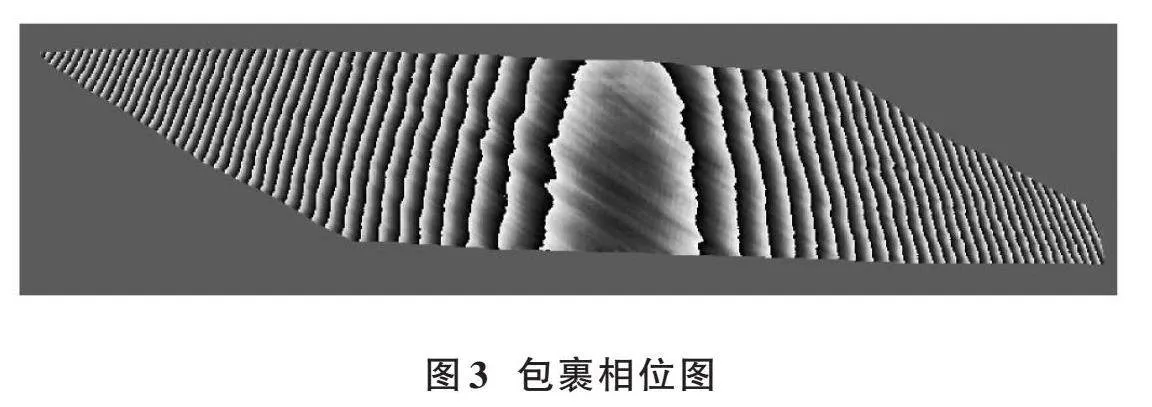

为了满足网络的输入要求,需要正方形的图片,保证网络的稳定性和有效性,因此需要对数据集进行预处理。本文将实验得到的220张1 024×256大小且质量较好的包裹相位图作为训练样本,如图3所示。将每张包裹相位图随机裁剪成4张256×256大小的图片用来制作训练数据集,如图4所示。

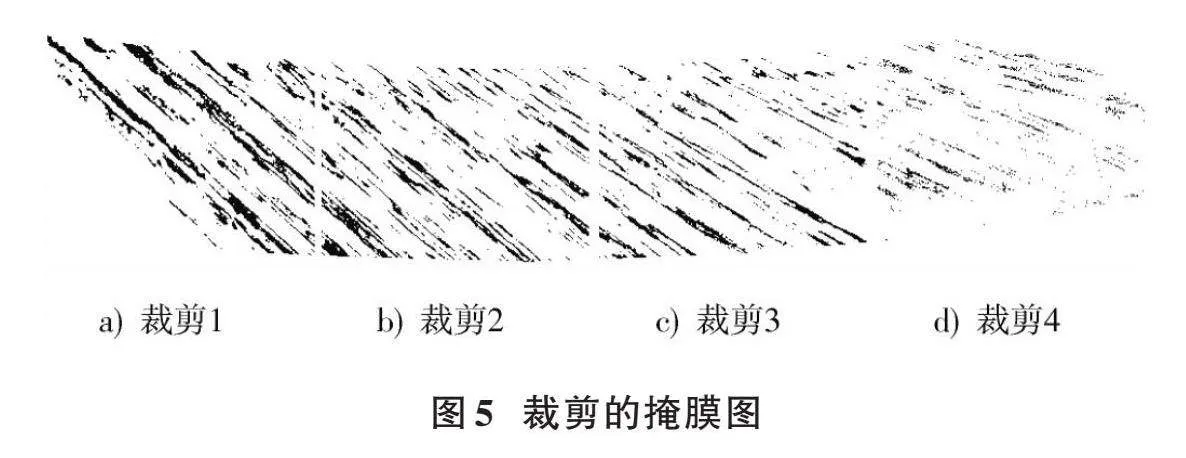

2.2" 掩膜数据集

齿面物体像灰度法[16]是一种用于识别包裹相位图中相位散斑噪声的方法。其原理是设置灰度的最小阈值[Tmin]和最大阈值[Tmax],将齿面物体像的灰度图转换为二值图像。灰度值小于最小阈值或大于最大阈值的区域被认为是散斑噪声,并将这些像素的值设置为0。在最小和最大阈值之间的区域则被认为是可靠区域,并将这些像素的值设置为1。由于包裹相位图中常常存在剪切、错位和粘连,这些问题通常是由干涉图中散斑噪声所引起。因此,可以认为散斑噪声区域包含了包裹相位图中需要修复相位的区域。通过以上处理,得到一张二值化的齿面散斑噪声图像,如图5所示,其中黑色区域代表需要修复的区域。

[Bx,y=1," " "白色,0," " "黑色," " " Tmin≤G(x,y)≤Tmax其他]" (6)

式中:[G(x,y)]是物体像中像素点[(x,y)]的灰度值;[Bx,y]为二值化掩膜图像。

在图像修复任务中,保证掩膜的多样性非常重要,因为缺失区域图案的多样性会使模型更好地学习图案信息和修补技巧。为保证掩膜的多样性以增强模型的泛化能力,数据集随机添加了不同灰度阈值处理后的齿面干涉图掩膜图像。

2.3" 损失函数

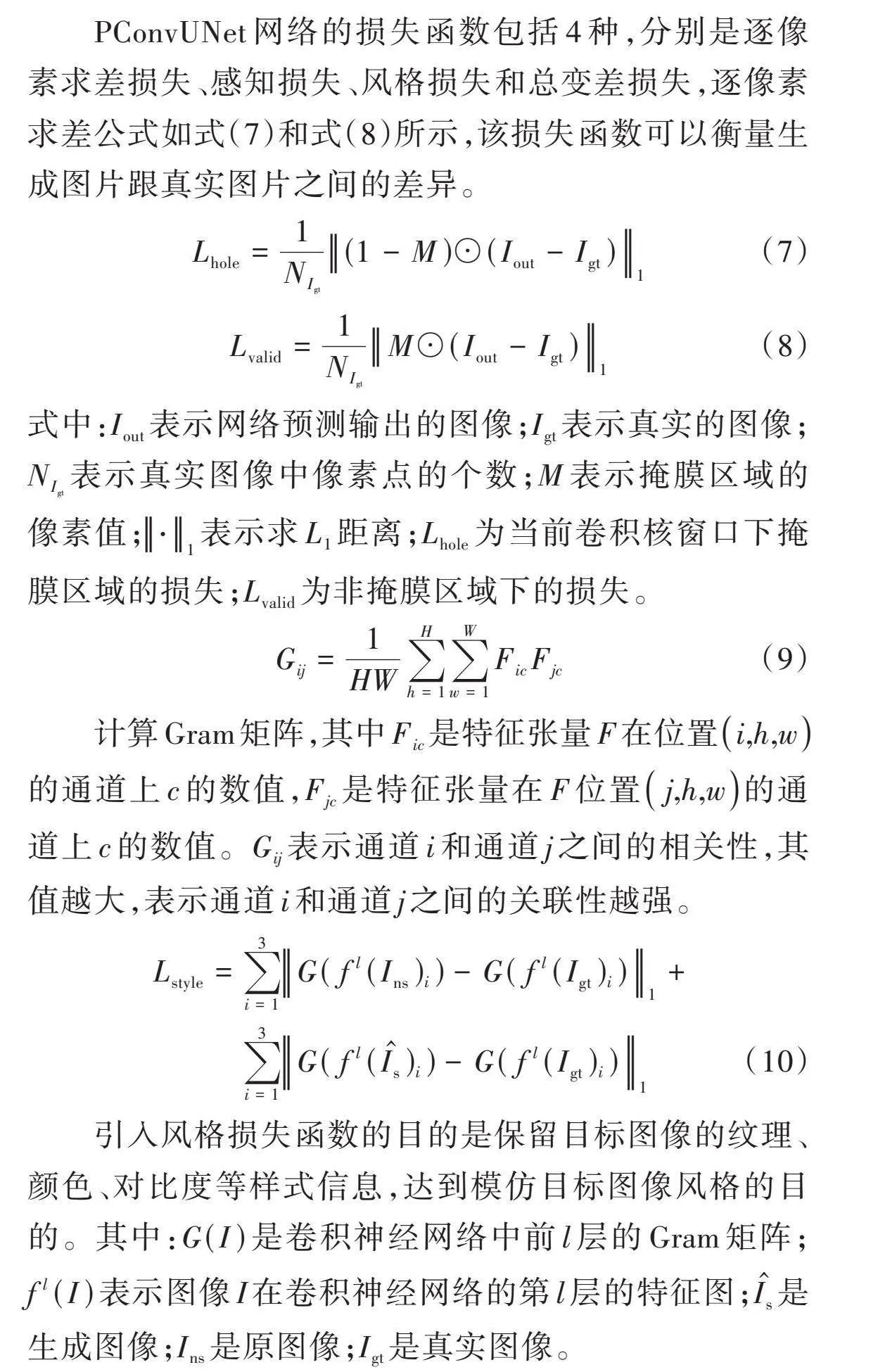

PConvUNet网络的损失函数包括4种,分别是逐像素求差损失、感知损失、风格损失和总变差损失,逐像素求差公式如式(7)和式(8)所示,该损失函数可以衡量生成图片跟真实图片之间的差异。

[Lhole=1NIgt(1-M)⊙(Iout-Igt)1] (7)

[Lvalid=1NIgtM⊙(Iout-Igt)1]" (8)

式中:[Iout]表示网络预测输出的图像;[Igt]表示真实的图像;[NIgt]表示真实图像中像素点的个数;[M]表示掩膜区域的像素值;[⋅1]表示求[L1]距离;[Lhole]为当前卷积核窗口下掩膜区域的损失;[Lvalid]为非掩膜区域下的损失。

[Gij=1HWh=1Hw=1WFicFjc]" (9)

计算[Gram]矩阵,其中[Fic]是特征张量[F]在位置[i,h,w]的通道上[c]的数值,[Fjc]是特征张量在[F]位置[j,h,w]的通道上[c]的数值。[Gij]表示通道[i]和通道[j]之间的相关性,其值越大,表示通道[i]和通道[j]之间的关联性越强。

[Lstyle=i=13G(fl(Ins)i)-G(fl(Igt)i)1+i=13G(fl(Is)i)-G(fl(Igt)i)1] (10)

引入风格损失函数的目的是保留目标图像的纹理、颜色、对比度等样式信息,达到模仿目标图像风格的目的。其中:[G(I)]是卷积神经网络中前[l]层的[Gram]矩阵;[fl(I)]表示图像[I]在卷积神经网络的第[l]层的特征图;[Is]是生成图像;[Ins]是原图像;[Igt]是真实图像。

2.4" 模型训练

本文使用PyTorch 1.12.1深度学习框架和PyThon 3.8在PyCharm编译器上进行训练。训练首先加载由ImageNet训练而来的VGG16模型来初始化权重,并采用Adam优化算法对数据集进行批归一化处理,将batch size设置为2,在数据集上以0.000 5的学习率迭代训练300 000次。

其中训练集、验证集和测试集图片数分别为662、32和5张,分辨率为256×256。在训练的过程中对该数据集进行旋转、平移变换等数据增强扩充处理,同时对输入的图片进行归一化处理,以减少网络训练所需内存。

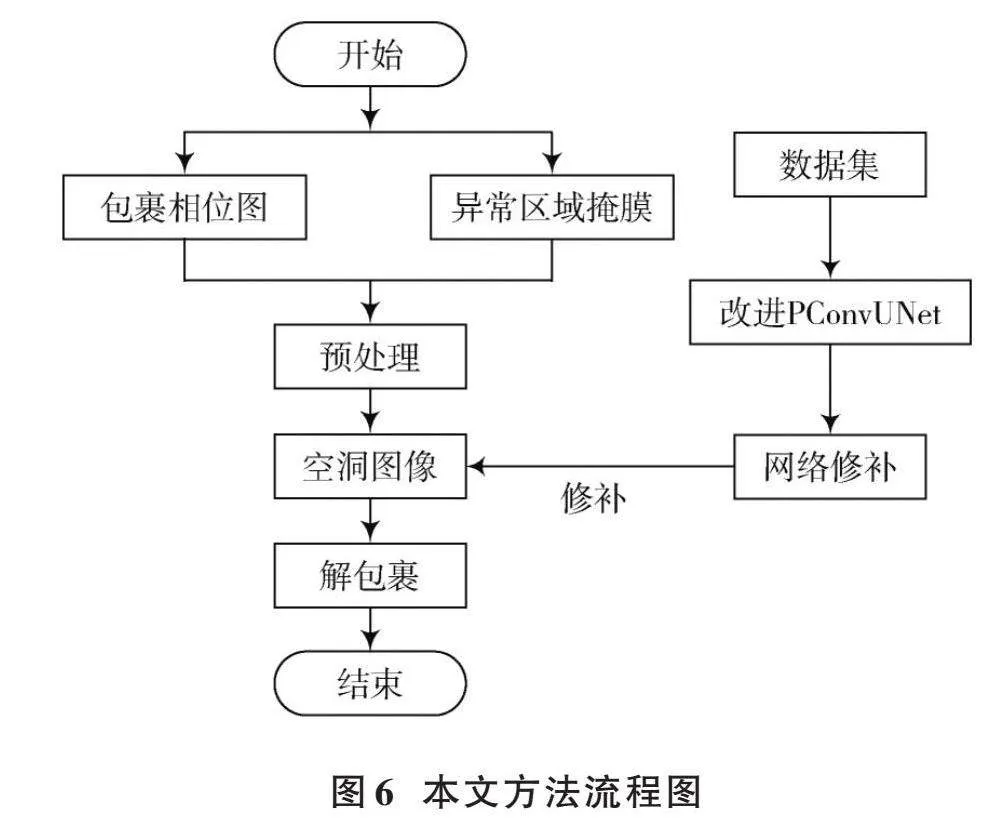

2.5" 方法流程

本文针对包裹相位图存在剪切、错位、粘连区域的现象,结合包裹相位图条纹特征,将包裹相位图和基于齿面物体像灰度法识别出的区域掩膜放入改进后的网络进行训练,用训练后的网络修补存在异常分布条纹包裹相位图,修正条纹粘连及条纹错切的问题区域,得到修补后的包裹相位图,最后使用传统的方法解包裹以提高解包裹的精准性。本文方法流程如图6所示。

3" 实验结果分析

为了验证本文改进PConvUNet网络的修补效果,将PConvUNet网络与改进PConvUNet网络进行对比实验。模型中的修复损失函数通过4种不同的子损失来指导生成图像的修复过程。对比“hole”“valid”和“style”损失函数的收敛速度与收敛程度来评价模型。PConvUNet模型与改进模型对比如图7所示。

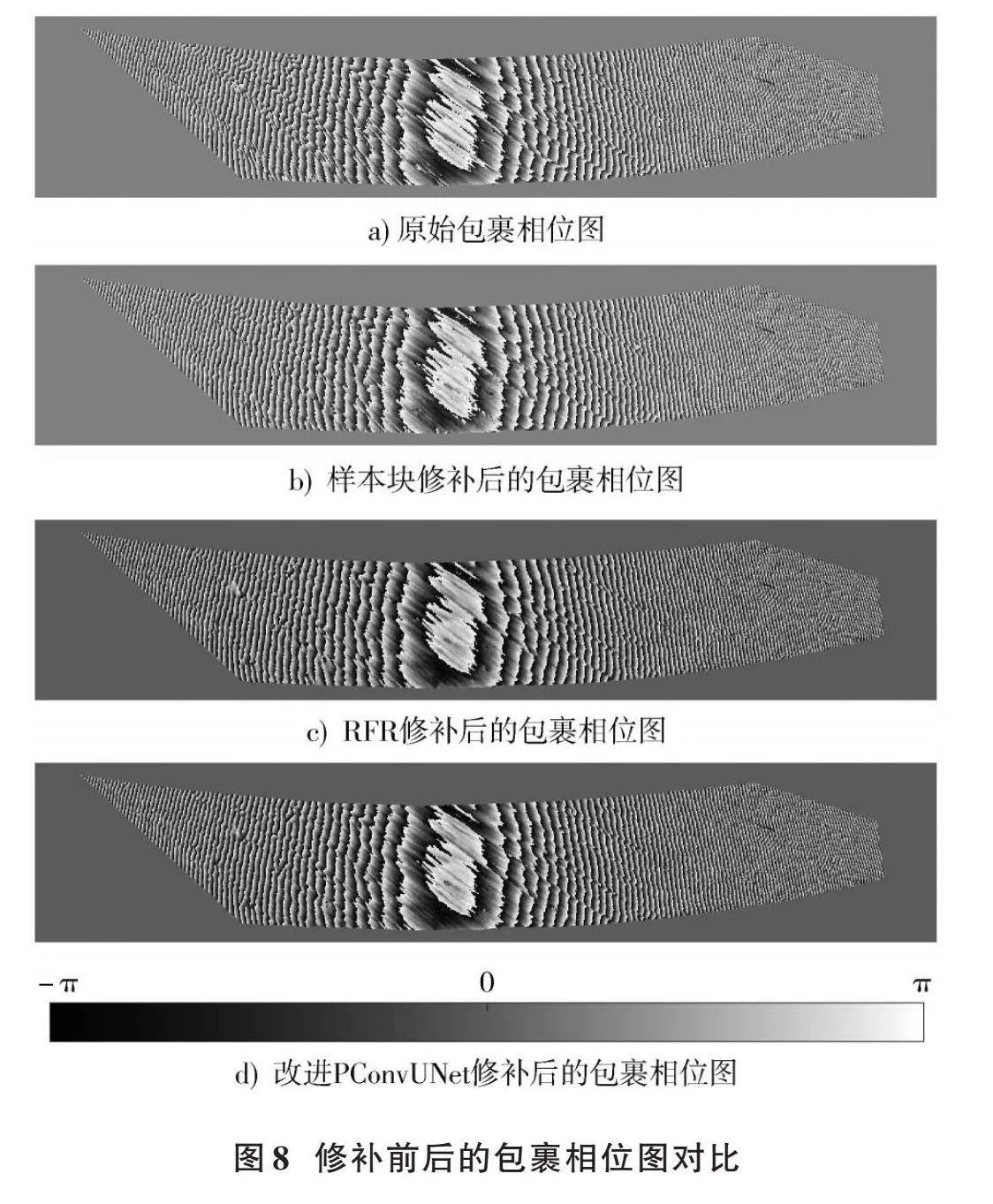

PConvUNet模型对图片的背景修补出现了错误,改进PConvUNet引入注意力模块后,背景得到一定程度的改善。改进PConvUNet网络模型的“hole”“valid”和“style”损失值更低,网络收敛速度更快,预测的结果更接近真实值。修补前后的包裹相位图对比如图8所示。

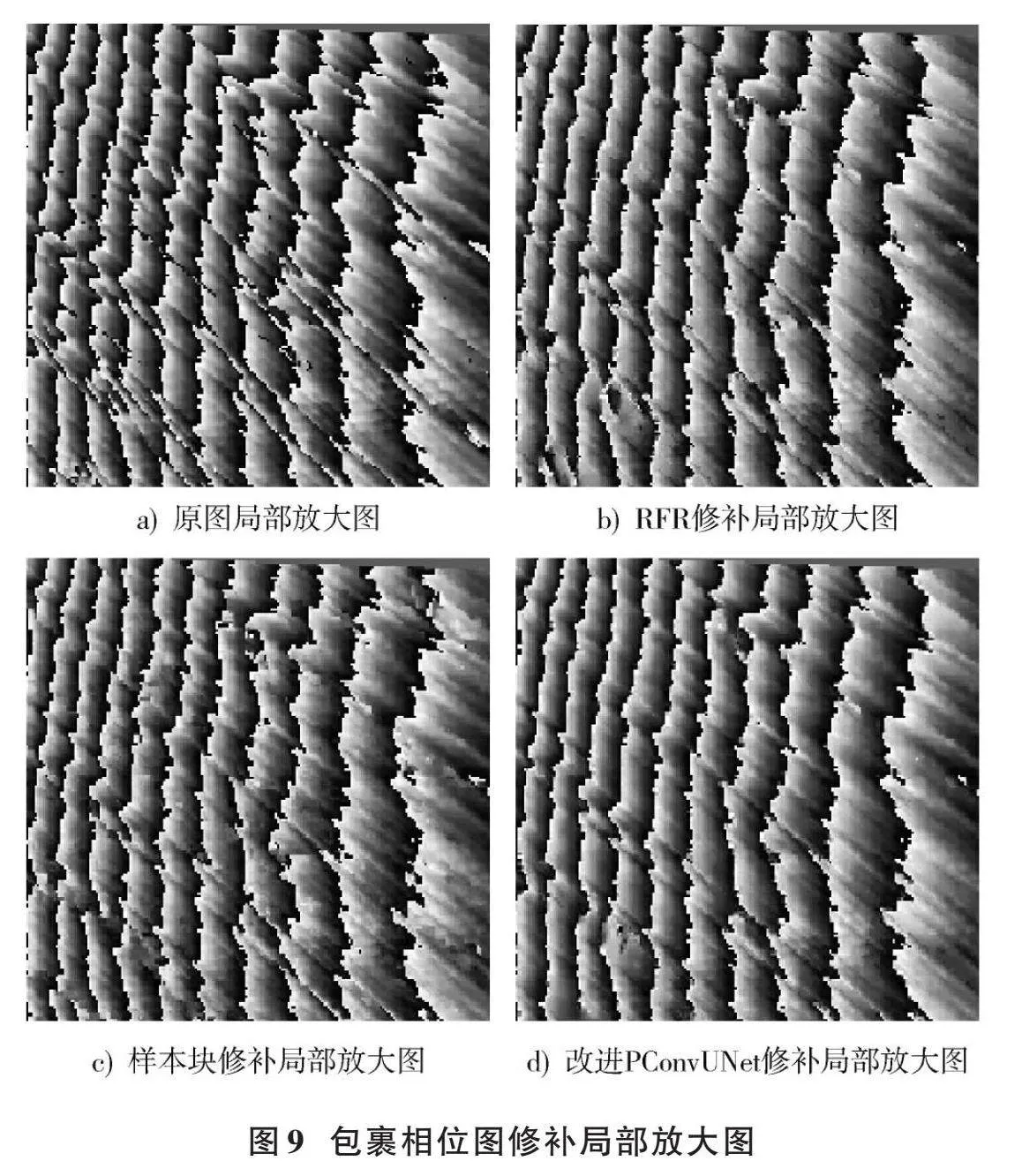

原始包裹相位图的条纹虽然在整体上具有规律性,但在很多局部区域都出现了混乱情况,包括严重的条纹错位和剪切。经过修补后,图8d)条纹纹理在整体上变得更加清晰,在局部问题区域中的条纹也得到了很好的修复。这些改进有效地降低了解包难度,使解包过程更加可靠。包裹相位图修补局部放大图如图9所示。

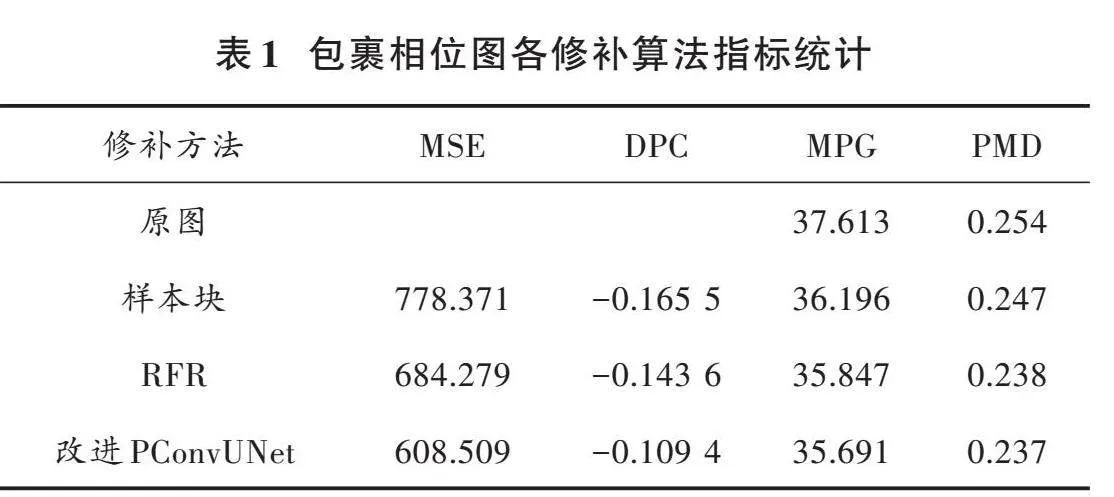

经过样本块修补的条纹纹理平滑性有一定程度的改善,而RFR与改进PConvUNet方法修补的条纹更加清晰,抑制条纹粘连、错切的能力要优于传统的样本块算法。为验证修补之后的包裹相位图修补后的性能,分别从均方误差(MSE)、差分相位相关系数(DPC)、MPG和调制度(PMD)四个方面评价,结果见表1。

在表1中:MSE是衡量两个图像之间差异的平均平方误差,它用于比较修补图像和原始图像之间的差异;差分相位相关系数是用于衡量两张图像的相位相关性的指标;MPG参数用于检测包裹相位图中的相位调制情况,值越大表示相位调制程度越高,存在较多的不规则变化;调制度可以用来评估包裹相位图的相位变化情况。较小的调制度表示相位变化较小、相位稳定性较好,而较大的调制度则表示相位变化较大、相位不稳定。改进的PConvUNet处理过后的包裹相位图MSE相对于样本块法降低了22%,差分相关系数减少了34%,且MPG和调制度指标都优于样本块的方法,这证明了改进的PConvUNet网络能够更大程度地保留条纹的细节信息,较好地保持相位的连续性,对于包裹相位图有良好的修补效果。

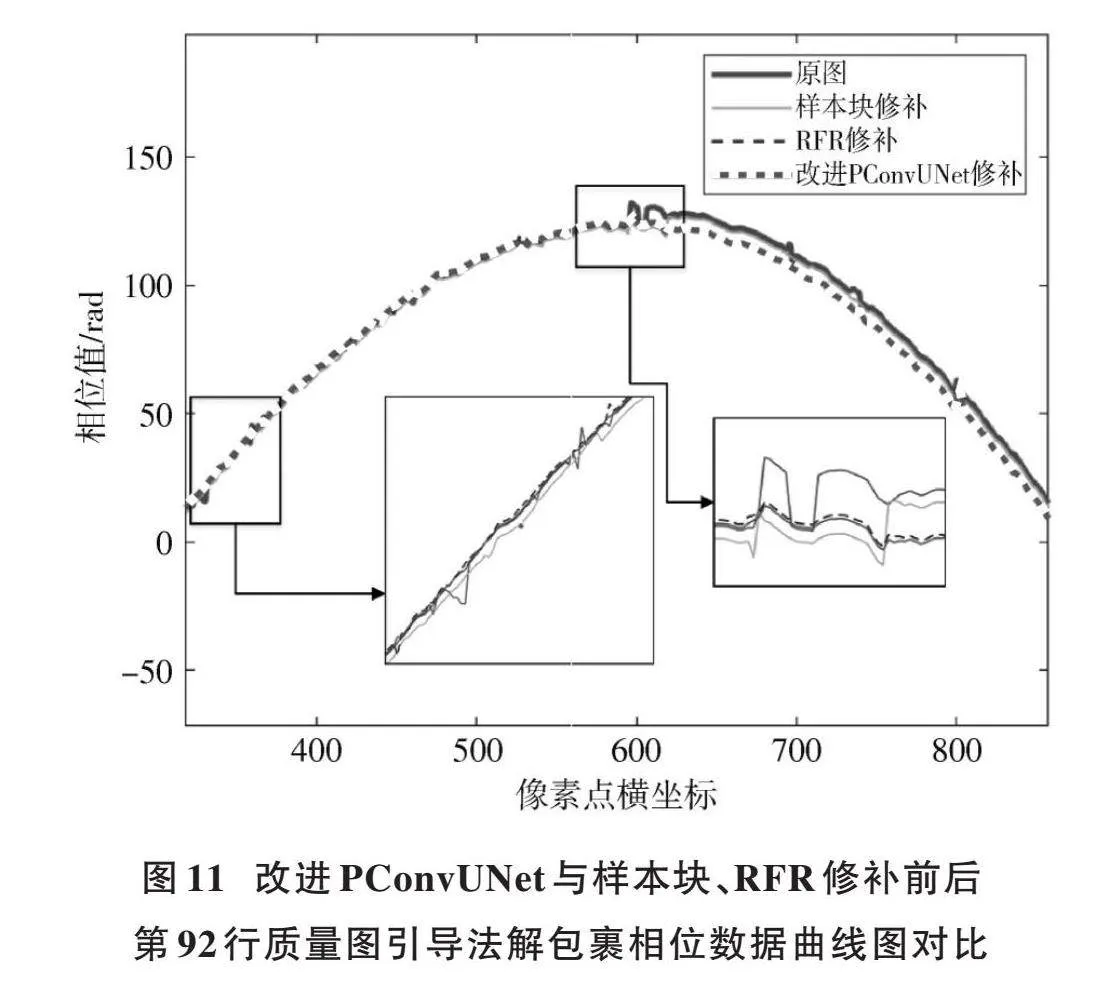

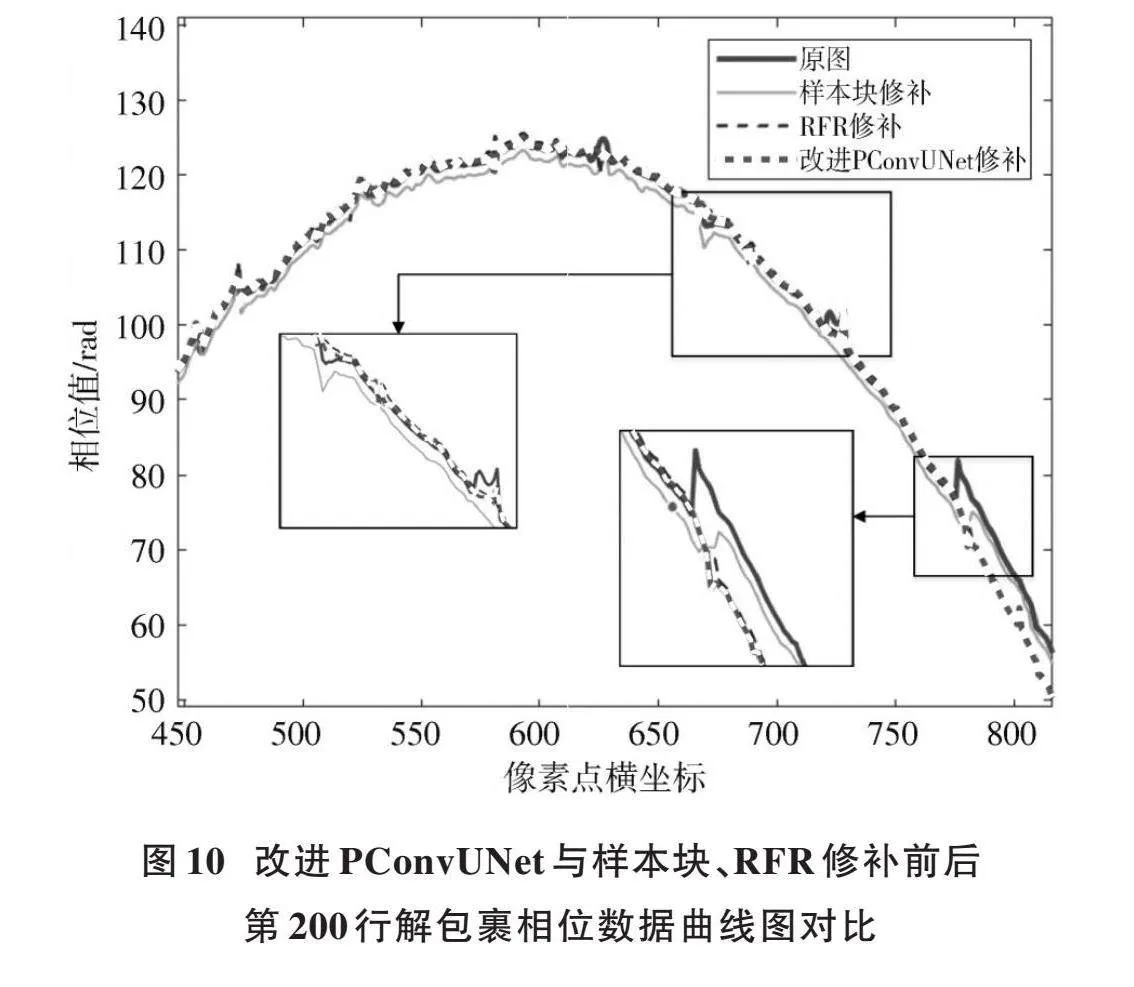

提取出质量图引导法解包裹的第200行相位数据进行分析,改进PConvUNet与样本块、RFR修补前后第200行解包裹相位数据曲线图对比如图10所示。原始包裹相位图在使用质量图引导法解包裹的结果出现错误,样本块方法修补的包裹相位图解包裹后在修补区域有轻微的相位跳变,而改进PConvUNet与RFR修补后解包结果没有出现明显错误,解包裹结果的光滑性更好。

为了进一步证明本文方法的有效性,提取质量图引导法修补后解包裹相位图的第92行相位曲线图。改进PConvUNet与样本块、RFR修补前后第92行质量图引导法解包裹相位数据曲线图对比如图11所示。可见样本块的修补方法对于相位跳变点的抑制能力有限,解包裹的相位曲线仍然存在少量不连续点。改进PConvUNet与RFR修补后的相位图解包裹后能够将原始包裹相位图的相位跳变区域更好的修正。

尽管本文方法在修复包裹相位图相位跳变区域方面表现出色,但由于实验中可用的包裹相位图数据相对有限,导致无法获得丰富多样的样本。这种数据的不充分性可能导致在网络训练过程中过拟合或欠拟合的问题出现。为了更好地解决这个问题,未来的研究可以考虑收集更多的包裹相位图数据。

4" 结" 论

针对包裹相位图条纹存在错位、粘连和剪切等问题导致的解包裹错误,本文提出了一种基于改进PConvUNet图像修补的解包裹方法,以提高解包裹的准确性。通过分析齿面包裹相位图的条纹分布特征,首先利用齿面物体像灰度法识别出齿面像异常区域,并生成相应的掩膜。随后,构建了一个数据集,将正常条纹的齿轮齿面包裹相位图和对应的掩膜随机裁剪为256×256大小,用于训练改进后的PConvUNet网络。接下来,利用训练好的网络对存在异常条纹的包裹相位图进行修补。最后,使用经典的解包裹方法对处理后的包裹相位图进行解包裹。

实验结果表明,改进PConvUNet网络相较于样本块的方法,修补后的包裹相位图的均方根误差(MSE)减少了22%,能够显著降低解包裹后相位跳变点的数量,解包裹后的相位曲线更加平滑,没有明显的相位跳变。本文还对比了改进PConvUNet网络与RFR网络修补对包裹相位图的修补效果,结果显示,经过改进后的网络对其条纹细节修补效果更好,均方根误差(MSE)减少了12%,修补的包裹相位图解包裹后,相位曲线跳变点更少,解包裹结果更加平滑。

总之,改进PConvUNet网络在包裹相位图修补和解包裹方面取得了良好的优化效果,它不仅能更好地修补包裹相位图,还能改善解包裹后相位曲线的准确性和平滑性,更好地还原了原始相位特征,具有较高的应用价值。

注:本文通讯作者为杨鹏程。

参考文献

[1] YANG P, YANG S, XIAO Y, et al. Calibration of geometric distortion based on a reference sheet in oblique laser interferometry [J]. Optik: Journal for light⁃and electronoptic, 2019, 183: 47⁃54.

[2] 王兆辉,杨鹏程,徐晋,等.齿面干涉测量系统的成像畸变分析与光路优化[J].中国机械工程,2022,33(10):1219⁃1225.

[3] GHIGLIA D C, PRITT M D. Two⁃dimensional phase unwrapping: Theory, algorithms, and software [M]. New York: Wiley, 1998.

[4] GOLDSTEIN R M, ZEBKER H A, WERNER C L. Satellite radar interferometry: Two⁃dimensional phase unwrapping [J]. Radio science, 1988, 23(4): 713⁃720.

[5] QUIROGA J A, GONZALEZCANO A, BERNABEU E. Phase⁃unwrapping algorithm based on an adaptive criterion [J]. Applied optics, 1995, 34(14): 2560⁃2563.

[6] 解辉,李猛,田建刚,等.基于小波变换的单通道信号盲分离方法[J].现代电子技术,2021,44(7):56⁃59.

[7] SUN T, FANG W, CHEN W, et al. High⁃resolution image inpainting based on multi⁃scale neural network [J]. Electronics, 2019, 8(11): 1370.

[8] LI J Y, WANG N, ZHANG L F, et al. Recurrent feature reasoning for image inpainting [C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2020: 7757⁃7765.

[9] 魏启元,吕晓琪,谷宇.改进投影变换和保留结构特征的拼接图像修复算法[J].现代电子技术,2017,40(23):38⁃42.

[10] MENG L, FANG S P, YANG P C, et al. Image⁃inpainting and quality⁃guided phase unwrapping algorithm [J]. Applied optics, 2012, 51(13): 2457⁃2462.

[11] WANG J, WANG L, HE S M, et al. SA⁃RFR: Self⁃attention based recurrent feature reasoning for image inpainting with large missing area [J]. Human⁃centric computing and information sciences, 2022, 12: 1⁃13.

[12] YU J, LIN Z, YANG J, et al. Generative image inpainting with contextual attention [C]// Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition. New York: IEEE, 2018: 5505⁃5514.

[13] LIU G L, REDA F A, SHIH K J, et al. Image inpainting for irregular holes using partial convolutions [J]. Computer vision and pattern recognition, 2018, 11215: 89⁃105.

[14] 杨小利,冯杰,马汉杰,等.基于边缘PUnet网络的虚拟视图空洞修复[J].计算机系统应用,2020,29(11):176⁃182.

[15] MA R D, LI X P, CAO H Z, et al. Alkali etched fiber Mach⁃Zehnder interferometer with compact sensor head [J]. Applied optics, 2021, 60(32): 10186⁃10190.

[16] 杨鹏程,刘洋,朱新栋,等.基于物体像的干涉条纹图像中散斑噪声的识别方法[J].应用光学,2017,38(2):221⁃226.