面向仓库货架的商品智能拣选机器人设计

张金燕,吴蓬勃,王拓,王帆

面向仓库货架的商品智能拣选机器人设计

张金燕1,吴蓬勃2,3*,王拓2,王帆4

(1.河北工程技术学院 网络与通信学院,石家庄 050091;2.石家庄邮电职业技术学院 智能工程系,石家庄 050021;3.河北省高校快递智能技术与装备应用技术研发中心,石家庄 050021; 4.石家庄邮电职业技术学院 速递物流系,石家庄 050021)

为降低仓储拣选作业的劳动强度、提高拣选准确率,设计一款可代替人工拣货的拣选机器人。基于PaddlePaddle的PP-ShiTu图像识别系统,实现货架商品的精确识别和种类的快速更新;针对低成本机械臂的视觉抓取问题,提出基于“无标定3D视觉+AGV运动控制”的货架商品抓取引导方法;采用二维码自主导航和智能升降系统实现了货架商品的搬运和立体抓取。实验证明,所设计的拣选机器人实现了货架商品的精确抓取和搬运,测试准确率达到了92.25%。基于该方法构建的智能拣选机器人,可以完成仓库货架商品的拣选和搬运。

仓库;货架;拣选;机械臂视觉抓取

近年来,随着互联网技术的飞速发展和移动通讯设备的普及,电子商务得到了快速的发展,物流则为商品在时空上的转移提供了有效途径[1-3]。电子商务的主要流程包括客户下单、信息传递、仓储配送、送达货物和确认收货等几个环节。其中,仓储配送作为最关键的一个环节,其商品的配送时效和准确性直接决定了电商的资金流转速度[1]。仓储配送作业主要包括收货、补货、拣选和包装出货等几个环节[4]。其中,拣选作业占用了大量人力,拣选的准确率则直接影响到电子商务的全流程。目前,拣选作业主要依靠大量人力完成,拣选人员体力消耗大,拣选效率低、出错率高等问题一直是困扰企业发展的难题。

随着人工智能技术的快速发展[5-6]和机械臂智能化水平的不断提高[7-8],针对仓储环境的机械臂抓取技术逐渐成为研究热点。钟晓东[9]面向仓储物流场景研制了移动机械臂抓取系统,实现了移动机械臂的二维码导航、待抓取目标的AprilTag标签识别、基于ROS的机械臂运动规划和避障。陈月月[4]面向仓储货架的补货环节,研制了基于ROS的机械臂补货系统,基于数字孪生技术实现了机械臂的运动规划,提出了使用谱聚类筛选数据的方法,进一步提高了机械臂与相机的手眼标定精度。杨刚刚[10]在移动货架周转箱的智能识别和抓取方向开展了相关研究,使用激光雷达进行货架定位,使用RGB-D相机估计周转箱姿态,使用机械臂实现了周转箱的抓取。

本文面向仓库货架拣选场景,研制可在立体空间识别、抓取和搬运货架商品的拣选机器人。基于深度学习目标检测技术实现货架商品的识别和商品种类的快速更新;基于无标定视觉引导技术实现机械臂对货架商品的抓取;通过二维码自主导航和智能升降系统实现货架商品的搬运和立体抓取。

1 系统设计

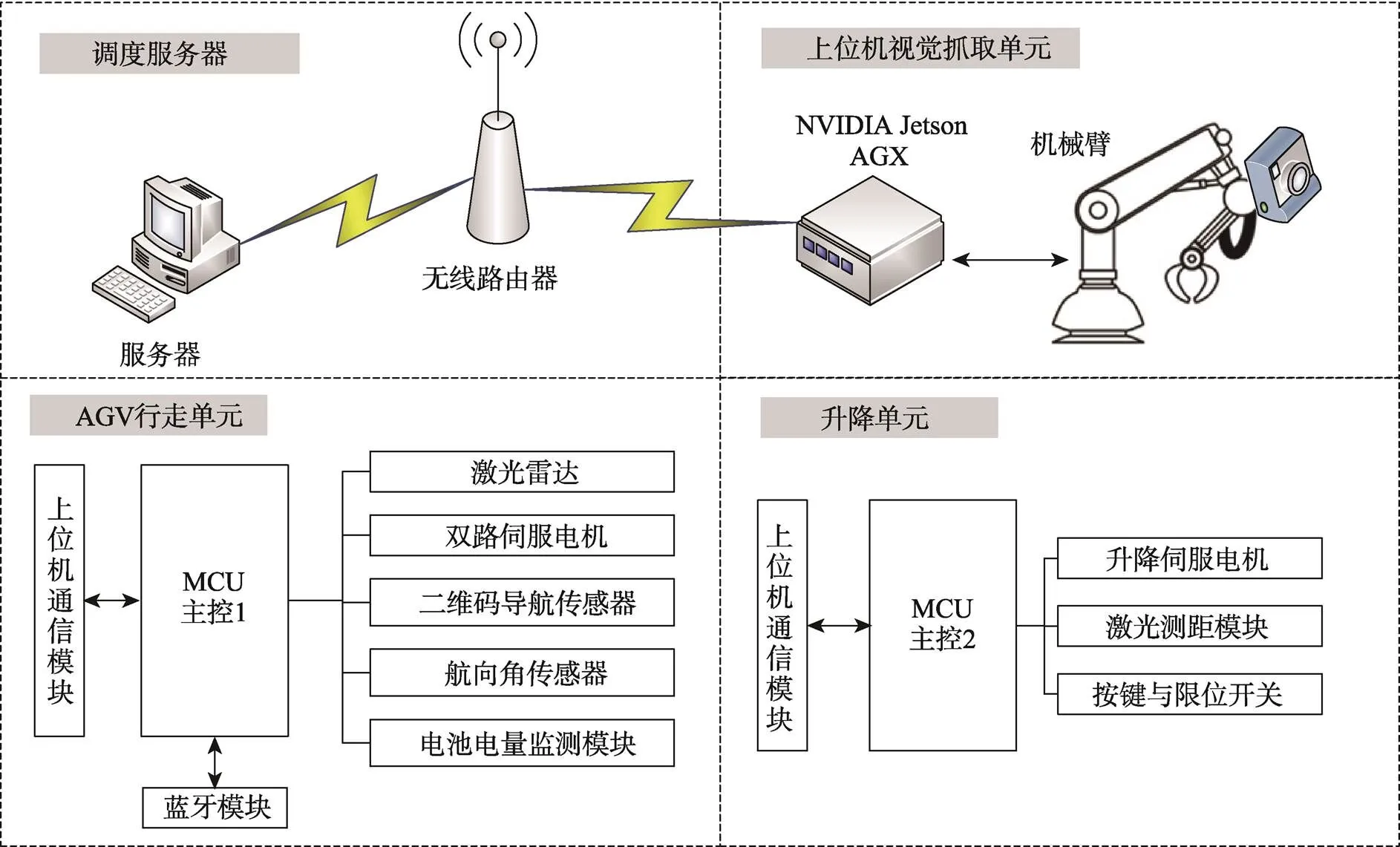

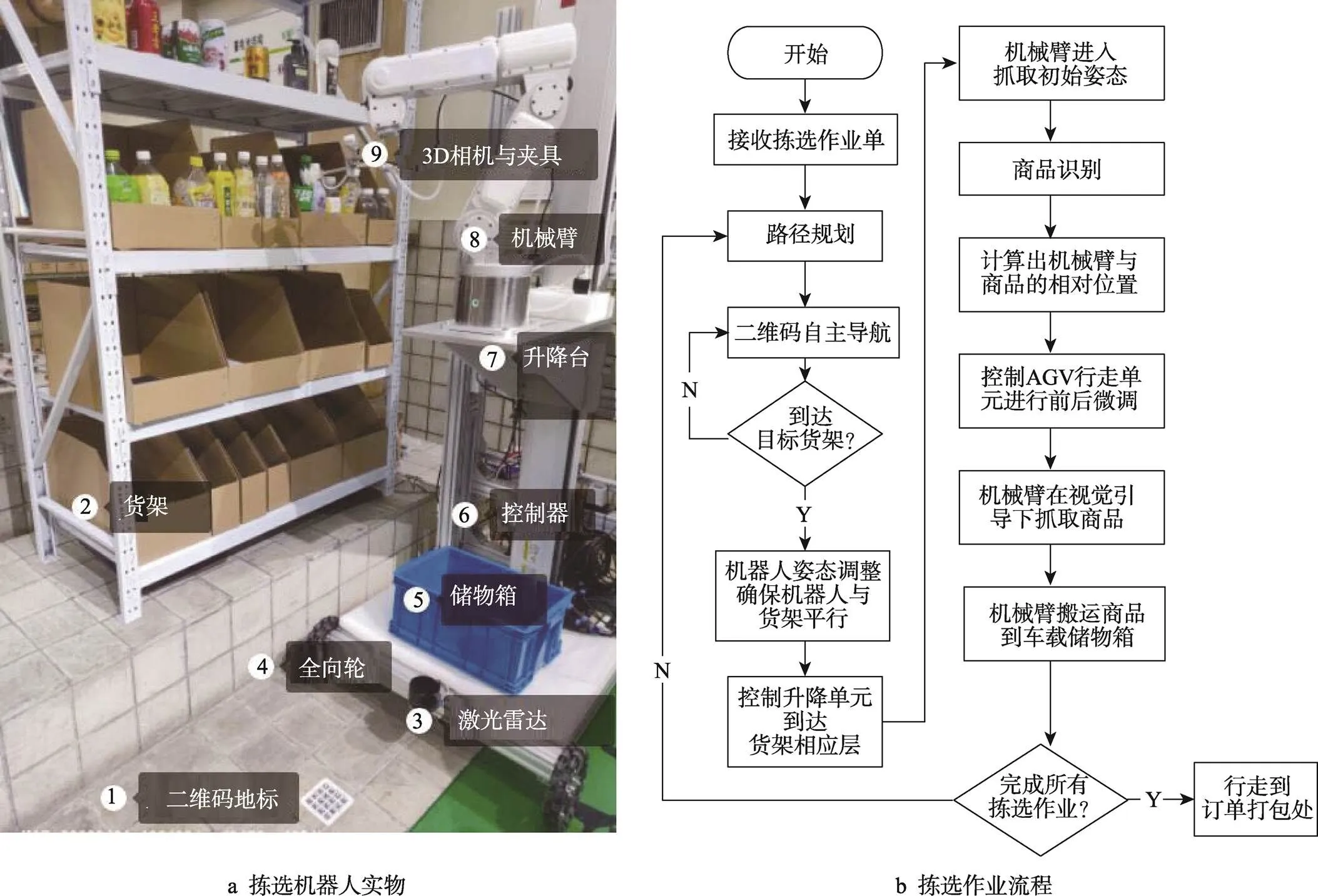

系统组成如图1所示,主要包括AGV行走单元、升降单元、上位机视觉抓取单元和调度服务器4个部分。

AGV行走单元用于实现机器人的移动控制,包括MCU主控、用于避障的激光雷达、用于行走的双路伺服电机、用于导航的二维码传感器、用于航向纠偏的IMU航向角传感器,以及电池电量监测模块、蓝牙模块和上位机通信模块。AGV行走单元既可以通过蓝牙手动遥控,也可以通过上位机进行自动控制。

升降单元用于实现机械臂的高度调整,以适应不同的货架层高。该单元主要包括MCU主控、升降伺服电机、激光测距模块、按键与限位开关等。升降单元既可通过按键进行升降控制,也可通过上位机进行自动控制。

上位机视觉抓取单元用于实现货架商品的智能识别与抓取。该单元主要包括机械臂、3D相机和上位机NVIDIA Jetson AGX(以下简称AGX)。其中,AGX为整个机器人系统的主控,可以与AGV行走和升降单元通信,可以进行商品识别和控制机械臂抓取。

图1 系统组成框图

2 基于PP-ShiTu的货架商品识别

本拣选机器人主要面向电商仓储,主要识别销量较大的瓶状、袋状和箱状商品。其中,瓶状商品数量多,种类更新频繁,采用图像识别种类;袋状、箱状商品,体积较大,数量较少,依据类别摆放到相应的库位箱中,通过二维码进行识别。本部分主要论述瓶状商品的图像识别。

本部分基于PaddlePaddle轻量级图像识别系统PP-ShiTu[11]完成货架瓶状商品的识别和种类更新。传统图像识别网络在更新识别种类时,需要再次采集大量图片,进行模型再训练,耗费大量的人力、物力和时间,造成商品种类更新速度慢。而PP-ShiTu系统则克服了以上缺点,不仅对硬件要求低,还实现了商品种类的快速更新。

PP-ShiTu系统主要包括主体检测、特征提取和向量检索3个模块,如图2所示。主体检测模块主要实现图像中前景对象的目标检测,该部分采用了更加适合移动端场景的PP-PicoDet模型。PP-PicoDet是基于PaddleDetection的目标检测模型,它以飞桨轻量级CPU网络(PaddlePaddle Lightweight CPU Network,PP-LCNet)[12]为骨干,实现了识别精度和速度的平衡,同时降低了GPU带来的系统成本的增加。特征提取模块使用度量学习方法来学习图像特征,采用加性角度间隔损失函数(Additive Angular Margin Loss,ArcMargin Loss)[13]、统一深度相互学习(Unified-Deep Mutual Learning,U-DML)损失函数和特性损失函数对度量学习进行评价。同时采用经过优化的深度哈希算法——基于稳定分布的深度监督哈希算法(Deep Supervised Hashing Based on Stable Distribution,DSHSD)[14]得到目标的二进制特征。在保证检索精度的同时,极大地降低了图像特征库的存储空间。采用Faiss作为向量搜索模块,使得该系统可以在Windows、Linux和MacOS多个系统上运行,提高了模型的通用性。PP-ShiTu基于已有图像的特征库,实现以图搜图,即:将图像库中的图像进行特征提取并放入特征库,实时捕获的图像通过主体检测、特征提取后,通过向量检索,查找最接近的图像特征,并将相应的图像标签作为识别结果。

图2 PP-ShiTu框架[11]

PP-ShiTu系统商品识别种类的更新主要包括以下3个步骤:

1)准备新的数据和标签。将采集的商品图片(如图3所示)保存到图像库目录gallery。将新增图像的路径和标签添加到图像库信息文件gallery_update。

1、内部牵制阶段。该阶段主要目的在于以职务分离和账目核对的措施实现企业账目和财务核算的清晰、准确,达成整个企业之间、各成员之间的牵制和稽核关系。内部控制源于早期企业规模较小,财务核算体系不健全,导致员工挪用、盗用公司财产等不法行为出现,为更好地保护公司的财产安全,以岗位相互监督的内部监督机制应运而生。

2)更新图像特征索引库index_update。

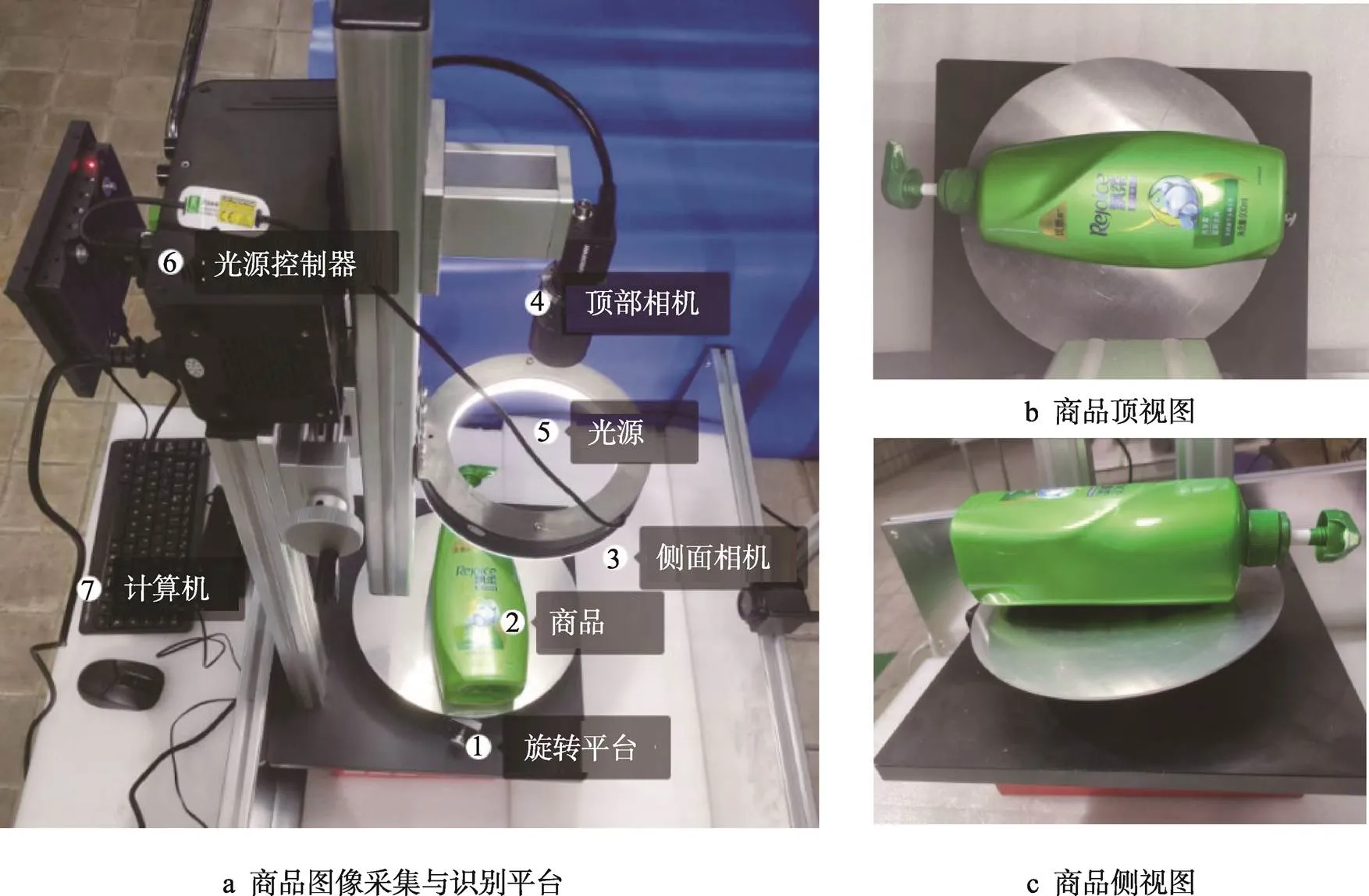

3)基于新索引库index_update进行图像识别。为提高数据采集效率和系统识别精度,本系统研制了商品数据采集与识别平台(如图4a所示),可以实现不同角度、不同光照下的图像采集和识别。平台底部为步进电机控制的360°旋转平台,旋转平台上面放置商品;可通过顶部和侧面相机采集商品图像(如图4b~c所示);顶部的光源亮度可调;左侧的计算机完成整个系统的控制、图像采集和识别。

图3 采集的商品图像

基于深度学习的fine-tune(微调)策略,如果所要识别的商品与预训练模型训练集中商品具有高度的相似性,则系统只需采集较少的数据,就可达到较好的识别效果;如果出现较大的差异,则需采集更多的图像数据,并进行重新训练。基于商品图像采集与识别平台的数据采集、训练流程,如图5所示。

图4 商品图像采集与识别平台

图5 商品数据采集与识别流程

1)第1阶段,图像采集共计循环次,每次采集张图片(本系统设定=10,=10),每个循环完成后,都将更新图像特征索引库,进行识别评估,计算置信度的均值;如果置信度均值大于设定阈值,则将更新后的图像特征索引库部署到拣选机器人,商品种类更新完成,否则,进行下一个循环的数据采集;如果采集循环次数达到次,则认定为与训练数据集商品差异较大的商品,进入第2阶段。

2)第2阶段,需采集更多的图片,将数据送到服务器进行模型训练和置信度评估,直至到达设定置信度阈值,结束数据采集;最后,将训练好的模型部署到拣选机器人。

3 货架商品的机械臂抓取

3.1 货架商品抓取引导方法

目前,视觉抓取系统的主要研究方向有:手眼标定方法、特征提取方法和基于深度学习的方法[15]。手眼标定法技术比较成熟,主要有:9点标定法、Tsai-Lenz[16]方法等。其中,9点标定法仅适用于2D场景的手眼标定;Tsai-Lenz方法广泛应用于3D场景的机械臂手眼标定,可以实现机械臂末端和相机的手眼关系标定(即求解出相机坐标与机械臂坐标的转换矩阵)。Tsai-Lenz方法的标定数据包括到达标定板时机械臂末端的坐标和姿态角(四元数或者欧拉角)、标定板在相机坐标系下的坐标和姿态角。该方法应用的前提是机械臂能够读取机械臂末端的位姿,这就导致很多低成本的机械臂因无法获取末端位姿而不能使用该方法。特征提取方法要求目标有特定的形状、颜色等特征,适应性较差,应用场景相对固定。深度学习方法通过采集大量机械臂抓取的图像来训练卷积神经网络,实现机械臂在空间运动的预测[15]。该方法具有较强的鲁棒性,可以用于复杂的工作环境,但是如果环境发生变化,则需重新采集图像进行训练,不适用于移动机器人抓取的场景。

该拣选机器人基于无标定3D视觉引导技术,结合AGV底盘运动控制,实现了机械臂对货架商品的抓取。不再计算机械臂末端和相机的手眼转换矩阵,而是通过AGV和机械臂的运动控制,使得AGV与货架平行、机械臂坐标轴与3D相机三维坐标轴平行,进而通过“3D相机测距+AGV前后运动控制”引导机械臂抓取商品。该方法既可降低系统成本,又具有良好的普适性。货架与拣选机器人相对位置关系如图6所示。

本系统设定:用于二维码导航的DM(DataMatrix,矩阵式二维条码)地标的D轴与货架平行。拣选机器人的AGV底盘依据DM定位停车,并通过二维码导航传感器获取AGV底盘与DM地标的相对位置关系,结合AGV底盘的伺服轮毂电机,调整机器人姿态,使其与DM的D方向坐标水平,从而保证拣选机器人与货架平行,为商品抓取做好准备。

图6 货架与拣选机器人相对位置关系

机械臂的R轴正方向为抓取的初始姿态,机械臂末端的3D相机D435i通过PP-ShiTu系统获取待抓取商品A3的像素坐标,结合D435i相关参数、机械臂与相机的相关位置计算出机械臂坐标系中心R到商品A3在方向的距离A。拣选机器人控制AGV底盘向D方向行走距离A。D435i再次进行图像识别并获取三维坐标。控制机械臂抓取商品并将商品搬运到车载储物箱。

货架商品抓取策略如图7所示。拣选机器人行走至商品所在货架的二维码地标位置;车载机械臂携带末端3D相机D435i进入远场观察姿态;D435i相机在大视野范围进行商品识别,获取商品中心位置图像坐标,结合D435i相机内参,计算出商品中心在相机坐标系下的物理坐标A、A和A。若A不小于设定阈值,则控制拣选机器人行走距离A,再次进行图像识别并获取三维坐标;若A值小于设定阈值,则控制机械臂完成商品的抓取和搬运。由于AGV底盘采用了高精度伺服电机,使得行走距离A误差可控制在±5 mm以内;结合抓取装置的吸盘直径尺寸(40 mm),使得本系统可适应50 mm以上宽度商品的抓取。

图7 货架商品机械臂抓取策略

3.2 货架商品抓取装置

本拣选机器人主要抓取瓶状、袋状和箱状商品。商品外包装以塑料或纸板为主,表面较平坦,多为不漏气材质,商品间隙较小。经过试验验证(如图8a所示),夹爪抓取不可行,因以本系统采用吸盘完成货架商品的抓取。

为实现商品的可靠抓取,经大量实验测试,本系统采用了“大流量气泵+逻辑阀+多波纹吸盘”的方式。系统采用了40 L/min的大流量微型气泵,在提供大吸力的同时,具备了较低的空间占用率,更加适宜车载环境。在多真空吸盘环境下,存在部分吸盘未吸着而产生漏气的情况,在吸盘和气管间添加逻辑阀,可以抑制真空压力的降低,确保正常吸附商品。采用的波纹式真空吸盘可以适配商品的多种姿态,确保可靠抓取。

对于瓶状商品,由于质量较小,采取单个波纹吸盘或者双波纹吸盘+逻辑阀的方式进行抓取(如图8b所示)。其中圆柱状商品表面不平整,需采用双吸盘方式,确保可靠抓取。对于袋状、箱状商品,表面气密性一般、面积较大、质量偏大,采用多个波纹吸盘+逻辑阀方式进行吸取(如图8c~d所示)。

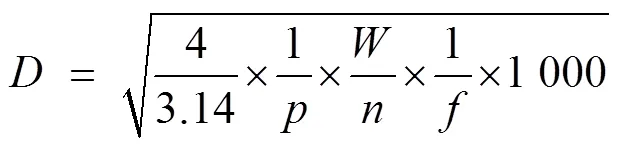

当有多个吸盘时,可根据式(1)计算真空吸盘的直径(单位为mm)。

式中:为真空压力,kPa;为真空吸盘吸附力;为吸盘数量;为安全系数,吸盘水平吸附物体时,>1/4,吸盘垂直吸附物体时,>1/8。

本系统采用的机械臂最大负载为3 kg,除去末端连接装置的质量,最大负载为2.7 kg,相应的=26.46 N。对袋状和箱状商品需水平吸附,瓶状商品需垂直吸附,这里设置安全系数=1/6,真空压力=−85 kPa,吸盘数量=3,根据计算公式可得波纹吸盘的直径为30 mm。考虑到一定的冗余,抓取装置选择3个40 mm直径的波纹吸盘。图8e显示了可抓取商品的最大质量为2.708 5 kg。

4 货架商品的搬运与立体抓取系统

拣选机器人的AGV行走单元硬件组成如图9a所示,该单元采用STM32F103RET6作为主控芯片;通过RS485总线分别连接激光雷达、二维码导航传感器、航向角传感器、双路伺服电机控制器和电池电量监测单元;通过串口连接AGX或者通过蓝牙串口模块连接手机。手机端通过App控制AGV行走单元,实现设备的手动控制。AGX作为整个拣选机器人系统的主控,可根据系统需要自主控制AGV行走单元的行走和启停。AGV行走单元软件部分基于国产开源嵌入式实时操作系统RT-Thread进行设计,创建了二维码导航与纠偏、雷达避障、上位机指令处理等多个线程,实现了拣选机器人的自主导航。

图9 AGV行走单元硬件结构

图9b为第一代AGV行走单元实物图。考虑到仓储环境中主要是货架、纸箱、行人等非吸光、非透光障碍物,系统采用了镭神M10P单线TOF(Time of Flight)激光雷达对周围障碍物进行探测。M10P扫描频率为12 Hz,角度分辨率为0.22°,每一帧有70个点的数据,每圈共计输出24帧数据。STM32通过中断方式实时接收数据,并发送到RT-Thread相应线程进行避障处理。此外,STM32通过航向角传感器修正AGV行走中的角度偏差,通过二维码导航传感器在二维码地标位置修正AGV行走中的累计误差,提高AGV行走单元的鲁棒性。

拣选机器人的升降单元用于将机械臂升降到商品所在的货架层,其硬件组成如图10所示。通过STM32可控制升降伺服电机的启停;结合激光测距模块可实时获取升降单元的高度;限位开关用于确保升降系统的安全运行;可通过手动按键、AGX自主决策方式控制升降单元的高度。

图10 升降单元硬件组成框

5 系统测试

拣选机器人系统实物如图11a所示。在地面粘贴有导航二维码,二维码读码器和航向角传感器位于机器人底盘后侧(安装位置,参见图9b);机器人底盘前面为2个全向轮,后面为2个伺服轮毂驱动轮;机器人底盘前部安装有用于避障的激光雷达,底盘上侧为储物箱;系统控制器固定在升降支架上;升降台上部安装有机械臂;机械臂末端有3D相机和夹具。

拣选机器人对货架商品的拣选流程,如图11b所示。

1)仓库调度服务器将拣选作业单(商品所在货架对应的二维码编号、商品所在货架层号、商品信息等)分别下发给各拣选机器人。

2)拣选机器人根据拣选作业单,结合商品位置与自身位置信息进行路径规划,计算出最优路径。

3)拣选机器人开始在仓库各个货架间行走、拣选商品;行走过程中,遇到障碍物能够进行躲避,遇到其他拣选机器人,能够进行避让。

4)拣选机器人到达目标货架时,通过AGV行走单元调整拣选机器人姿态,确保拣选机器人与货架平行;根据货架所在层高,控制升降机构运动到相应层;机械臂进入抓取初始姿态,使得商品处于3D相机的视野范围内,如图12a所示。

5)机械臂末端的3D相机进行商品识别,获取商品三维位置信息(如图12b所示),并根据相对位置信息控制AGV行走单元进行前后微调;机械臂在视觉引导下进行商品抓取(如图12c所示),并将其放入车载储物箱,即完成一件商品的拣选。如此循环,直至完成作业单上所有商品的拣选。最后,拣选机器人行走到订单打包处,将拣选商品交付下一个流程。

图11 拣选机器人实物与作业流程

图12 拣选机器人拣选作业过程

为测试拣选机器人的拣选性能,在货架的不同位置摆放了20个类别的商品,进行抓取搬运测试,完成20个类别商品的识别、抓取和搬运为一个循环,共进行了20个循环共计400次的商品抓取测试,测试成功次数为369次,成功率为92.25%。其中,出现抓取失败的原因,主要有:待抓取商品未进入相机视野范围;由于待抓取商品表面不平整,造成吸盘无法吸取商品;待抓取商品位于货架内侧,造成抓取距离超出了机械臂的运动范围。以上问题可以通过优化机械臂观察视角、更换更加合适的吸盘、调整地标二维码到货架距离等措施加以改进。

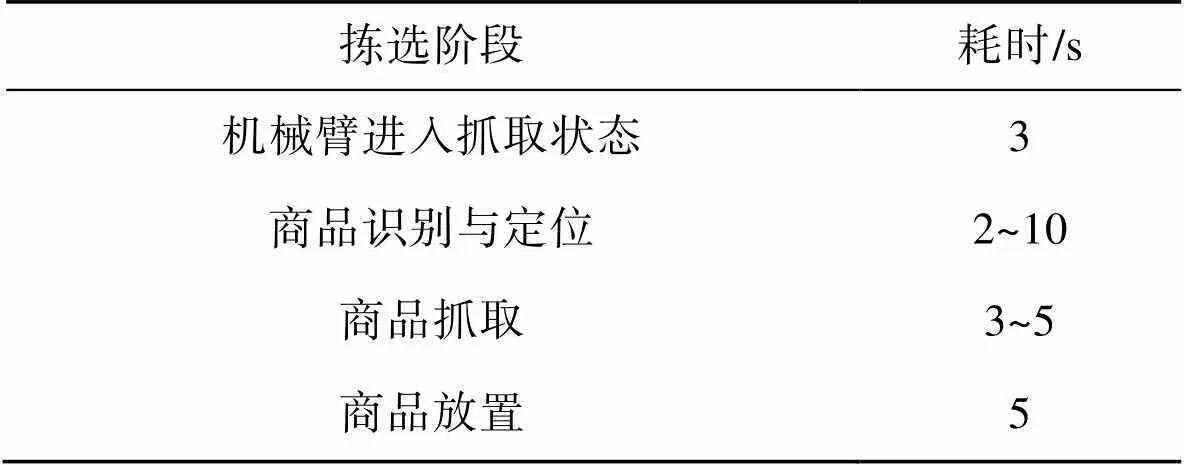

在测试中,商品识别与拣选的时效统计数据如表1所示。拣选机器人到达目标货架位置并升降到相应货架层后,机械臂从初始态进入抓取状态耗时3 s,商品识别与定位耗时2~10 s。当商品恰好位于相机视野中心位置时,耗时最短;当商品偏离相机视野中心位置时,需进行AGV前后运动,然后再次进行商品识别,耗时会相应增加。根据商品到机械臂的距离远近,商品抓取耗时在3~5 s,商品被搬运放置到储物箱耗时为5 s。需要说明的是:为提高抓取成功率,机械臂运动速度设置为最高速度的50%,因此系统耗时会有所增加。

表1 商品识别与拣选时效

Tab.1 Time of commodity recognition and picking

6 结语

本文面向仓储拣选场景,设计了一款可代替人工的拣选机器人。通过PP-ShiTu图像识别系统,成功实现了对货架商品的准确辨识和商品种类的快速更新。在应对低成本机械臂的视觉抓取方面,提出了一种基于“无标定3D视觉+AGV运动控制”的货架商品抓取引导方法。同时,利用二维码自主导航和智能升降系统,实现了对货架商品的搬运和立体抓取。

有一些问题也值得进一步研究,例如:货架料框中无序堆放商品的抓取、系统的容错机制等,可进一步提高拣选机器人的普适性和可靠性。

[1] 吴浩弘, 刘焯辉, 郭家志. 电子商务环境下物流仓储及配送模式的研究[J]. 中国物流与采购, 2022(17): 116-118.

WU H H, LIU Z H, GUO J Z. Research on Logistics Warehousing and Distribution Mode in Electronic Commerce Environment[J]. China Logistics and Procurement, 2022, 654(17): 116-118.

[2] 宋颜群, 胡浩然. 跨境电商改革对试验区企业出口的影响及作用机制研究[J]. 现代财经(天津财经大学学报), 2022, 42(4): 20-35.

SONG Y Q, HU H R. Research on the Impact and Mechanism of Cross-Border E-Commerce Reform on the Export of Enterprises in the Pilot Zone[J]. Modern Finance and Economics (Journal of Tianjin University of Finance and Economics), 2022, 42(4): 20-35.

[3] 段晶晶. 浅谈刷单行为的经济法规制[J]. 江西电力职业技术学院学报, 2021, 34(11): 149-150.

DUAN J J. On the Regulation of Economic Law on the Behavior of Brushing Bills[J]. Journal of Jiangxi Vocational and Technical College of Electricity, 2021, 34(11): 149-150.

[4] 陈月月. 基于仓储货架的ROS机械臂补货系统的设计与实现[D]. 武汉: 华中科技大学, 2021: 6-7.

CHEN Y Y. Design and Implementation of Replenishment System of ROS Robot Arm Based on Storage Shelves[D]. Wuhan: Huazhong University of Science & Technology, 2021: 6-7.

[5] 吴蓬勃, 张金燕, 王帆, 等. 快递暴力分拣行为视觉识别系统[J]. 包装工程, 2021, 42(15): 245-252.

WU P B, ZHANG J Y, WANG F, et al. Visual Recognition System of Violent Sorting Behavior in Express Delivery[J]. Packaging Engineering, 2021, 42(15): 245-252.

[6] ZHANG J M, XIE Z P, SUN J, et al. A Cascaded R-CNN with Multiscale Attention and Imbalanced Samples for Traffic Sign Detection[J]. IEEE Access, 2020, 8: 29742-29754.

[7] GOOGLE LLC. Deep Reinforcement Learning for Robotic Manipulation: America, EP3784451A1[P]. 2021-03-03.

[8] 李茂捷. 基于强化学习和元学习的机械臂抓取方法研究[D]. 南京: 南京邮电大学, 2022: 1-14.

LI M J. Research on Manipulator Grasping Method Based on Reinforcement Learning and Meta-Learning[D]. Nanjing: Nanjing University of Posts and Telecommunications, 2022: 1-14.

[9] 钟晓东. 面向仓储物流的移动机械臂抓取作业研究[D]. 济南: 山东大学, 2021: 1-8.

ZHONG X D. Research on Grab Operation of Mobile Manipulator Oriented to Warehouse Logistics[D]. Jinan: Shandong University, 2021: 1-8.

[10] 杨刚刚. 面向移动货架周转箱的识别和抓取系统研究[D]. 上海: 上海交通大学, 2020: 2-10.

YANG G G. Research on Recognition and Grasping of Turnover Box in Mobile Shelf[D]. Shanghai: Shanghai Jiao Tong University, 2020: 2-10.

[11] WEI S, GUO R, CUI C, et al. PP-ShiTu: A Practical Lightweight Image Recognition System [J]. arXiv:2111.00775, 2023: 1-8.

[12] CUI C, GAO T, WEI S, et al. PP-LCNet: A Lightweight CPU Convolutional Neural Network[J]. arXiv.2109.15099, 2023, 9: 1-8.

[13] DENG J, GUO J, YANG J, et al. ArcFace: Additive Angular Margin Loss for Deep Face Recognition[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2021, 99: 1-11.

[14] WU L, LING H, LI P, et al. Deep Supervised Hashing Based on Stable Distribution[J]. IEEE Access, 2019, 7(1): 36489-36499.

[15] LEVINE S, PASTOR P, KRIZHEVSKY A, et al. Learning Hand-Eye Coordination for Robotic Grasping with Deep Learning and Large-Scale Data Collection[J]. International Journal of Robotics Research, 2016, 37(4/5): 421-436.

[16] TSAI R Y, LENZ R K. A New Technique for Fully Autonomous and Efficient 3D Robotics Hand/Eye Calibration[J]. IEEE Transactions on Robotics & Automation, 1989, 5(3): 345-358.

Design of Intelligent Goods Picking Robot for Warehouse Shelves

ZHANG Jinyan1, WU Pengbo2,3*, WANG Tuo2, WANG Fan4

(1. School of Network and Communication, Hebei University of Engineering Science, Shijiazhuang 050091, China; 2. a. Department of Intelligent Engineering, b. Department of Express and Logistics, Shijiazhuang Posts & Telecommunications Technical College, Shijiazhuang 050021, China; 3. Hebei University Express Intelligent Technology and Equipment Application Technology Research and Development Center, Shijiazhuang 050021, China)

The work aims to design a picking robot that can replace manual picking, in order to reduce the labor intensity of warehouse picking operations and improve the accuracy of picking. Based on PaddlePaddle's PP-ShiTu image recognition system, accurate identification of goods on shelves and rapid updating of categories were achieved. A method of "uncalibrated 3D vision+AGV motion control" was proposed for guiding shelf product grabbing to solve the visual grasping problem of low-cost robotic arms. The use of two-dimensional code autonomous navigation and intelligent lifting system realized the handling and three-dimensional grasping of goods on shelves. The experiment proved that the designed picking robot achieved accurate picking and handling of goods on shelves, with a test accuracy of 92.25%. The intelligent picking robot constructed based on this method can complete the picking and handling of goods on the shelves of the warehouse.

warehouse; goods shelves; picking; robotic arm visual grasping

TP391.0

A

1001-3563(2024)05-0230-10

10.19554/j.cnki.1001-3563.2024.05.028

2023-04-04

河北省教育厅科学研究项目资助(ZC2024133)