考虑信息透明度影响的智能高铁驾驶人机界面可视化设计研究

吴永萌,吴昊泷,支锦亦

考虑信息透明度影响的智能高铁驾驶人机界面可视化设计研究

吴永萌,吴昊泷,支锦亦*

(西南交通大学 设计艺术学院,成都 610041)

驾驶界面的信息透明度是影响司机有效监督和接管智能高铁的关键设计特征。针对透明度信息增加带来的负面影响,提出智能高铁驾驶界面透明度信息的可视化设计方法。采用文献调研分析方法,分别对机器人、民防、核能、航空航天等领域的文献进行检索和分析,系统梳理透明度信息的类型、认知任务影响和可视化设计方法;分析智能高铁弹出故障界面的透明度信息,指出目前界面中存在的问题和不足,即任务流程和判断逻辑的视觉呈现不佳,告警信息紧急程度和恢复状态信息缺乏;提出基于逻辑流程图和颜色编码的可视化设计方案,并通过用户实验进行验证。发现逻辑流程可视化设计在提升情境意识、任务绩效和降低认知负荷方面有较好的作用。颜色编码可视化设计的有效性取决于是否有逻辑流程的呈现,在没有逻辑流程时,可能会降低操作正确率。可视化设计有助于降低透明度信息对认知负荷和任务绩效的负面影响,实现智能高铁的高质量人机协同驾驶。

智能高铁;人机协同;人机界面;透明度信息;可视化设计

搭载自动驾驶和智能控制等自动化技术的智能高铁将有效减轻司机劳动强度、改善旅客乘车体验、提升运行安全性和准确性、降低全寿命周期成本,是中国轨道交通发展的重要趋势。为避免自动化故障或不可预见情况下的安全隐患,我国智能高铁运营长期采用“人控为主,机控为辅”的人机协同驾驶模式。司机的主要任务是瞭望列车线路环境,盯控设备运行状态,发现异常时立即采取干预措施。驾驶人机界面是呈现系统运行状态的主要载体[1],已成为决定司机监控和应急处置质量的关键。

铁路领域事故报告显示,驾驶人机界面的设计缺陷为人机协同作业埋下了隐患[2-3]。2016年伊朗列车碰撞脱轨事故源于界面信息不足、司机不明确告警原因、拒绝接受停车信号。2018年昆士兰列车险碰撞事件源于界面信息低效、司机混淆警报风险程度、未及时接管列车。智能高铁需重视驾驶人机界面的信息呈现,以提升司机的认知可靠性,实现人和自动化的良好耦合[4]。目前,我国高速列车驾驶人机界面基于GoA1级列控系统开发,仅实现了系统的基本功能信息展示,缺乏对智能系统运行逻辑和信息呈现的统筹考虑。

自动化系统的复杂性要求提供适当数量和质量的信息,以充分支持人类操作员对自动化系统的有效监督和干预[5-7]。信息透明度是指自动化系统信息披露的程度。航空航天、民防、核能、汽车与机器人领域的学者均提出将系统当前状态、行为、意图、能力、决策、逻辑等信息进行透明化展示,以提升自动化系统的可观察性、可理解性和可预测性,帮助操作员校准信任并维持情境意识。本文针对轨道交通的智能化趋势,基于信息透明度设计理论研究智能高铁驾驶人机界面的信息可视化设计。通过分析透明度的信息类型、认知任务影响和可视化设计策略,针对现有智能高铁驾驶人机界面提出有效的可视化解决方案。

1 透明度研究现状

1.1 透明度信息类型研究

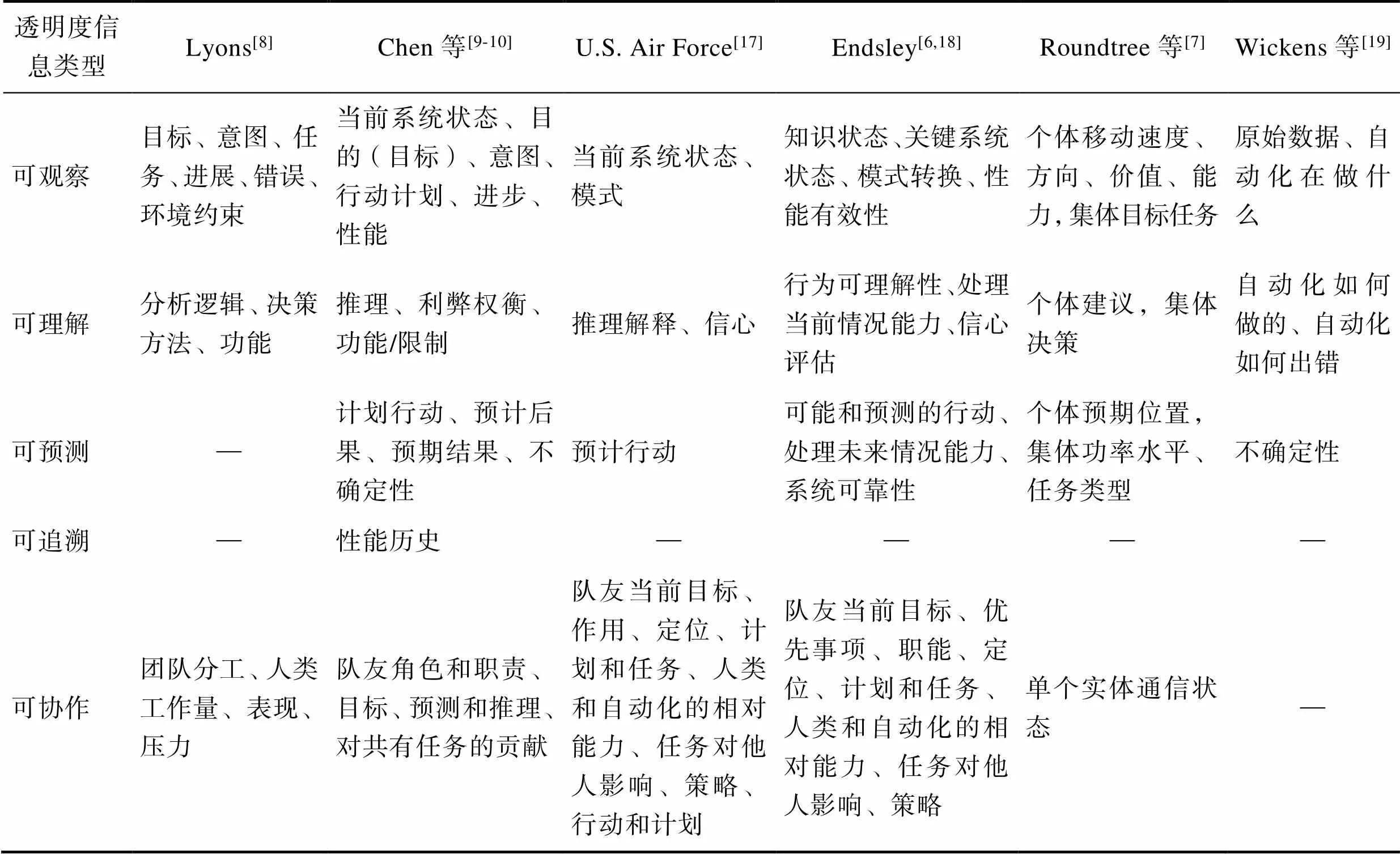

大量研究对透明度信息的类型进行了分析。Lyons[8]指出4种类型的透明度信息有助于提升对智能系统的信任和认知,包括系统意图、任务、分析原则和系统环境。Chen等[9-10]基于情境意识理论区分信息透明度的三个等级:一级透明度提供系统当前状态、目标、意图和计划;二级透明度揭示系统推理过程、原理以及规划行为时考虑的约束;三级透明度提供对系统未来状态的预测和不确定性信息。Bernstein从管理学视角指出透明度的4个组成部分:监控透明度包括有关活动或任务的信息,以支持了解目标是否正在实现;流程透明度包括底层算法和决策逻辑,以支持了解工作流程和业务政策如何执行;监督透明度主要为实时信息,以支持与系统建立实时的合作关系;披露透明度涉及信息公开,以支持了解系统数据的类型、来源及其如何被处理、存储、传输和利用。表1在上述研究的基础上梳理了5种类型的透明度信息及其所包含的相关信息。

透明度信息的认知效用在不同应用情境中有所不同。Chen等[9]发现过去、现在和未来的无人机飞行路径有助于改善情境意识,但Skraaning等[11]发现自动化系统当前与历史活动信息对情境意识没有积极影响。Stowers等[12]发现增加不确定性信息可以提高接管性能,缩短反应时间,提升情境意识,降低认知负荷,但Kunze等[13]发现认知工作量的增加与不确定性信息有关,因不确定性信息可能导致用户对系统能力的了解不完整[14]。推理信息被认为可以增加用户对系统建议的接受度[8-9],但Selkowitz等[15]发现增加推理信息并没有对情境意识产生积极影响,受任务时间约束和注意力资源限制,被试者很少关注除决策建议之外的推理信息[16]。因此,需要根据应用情景的实际需求和透明度信息的认知任务效用配置透明度信息类型。

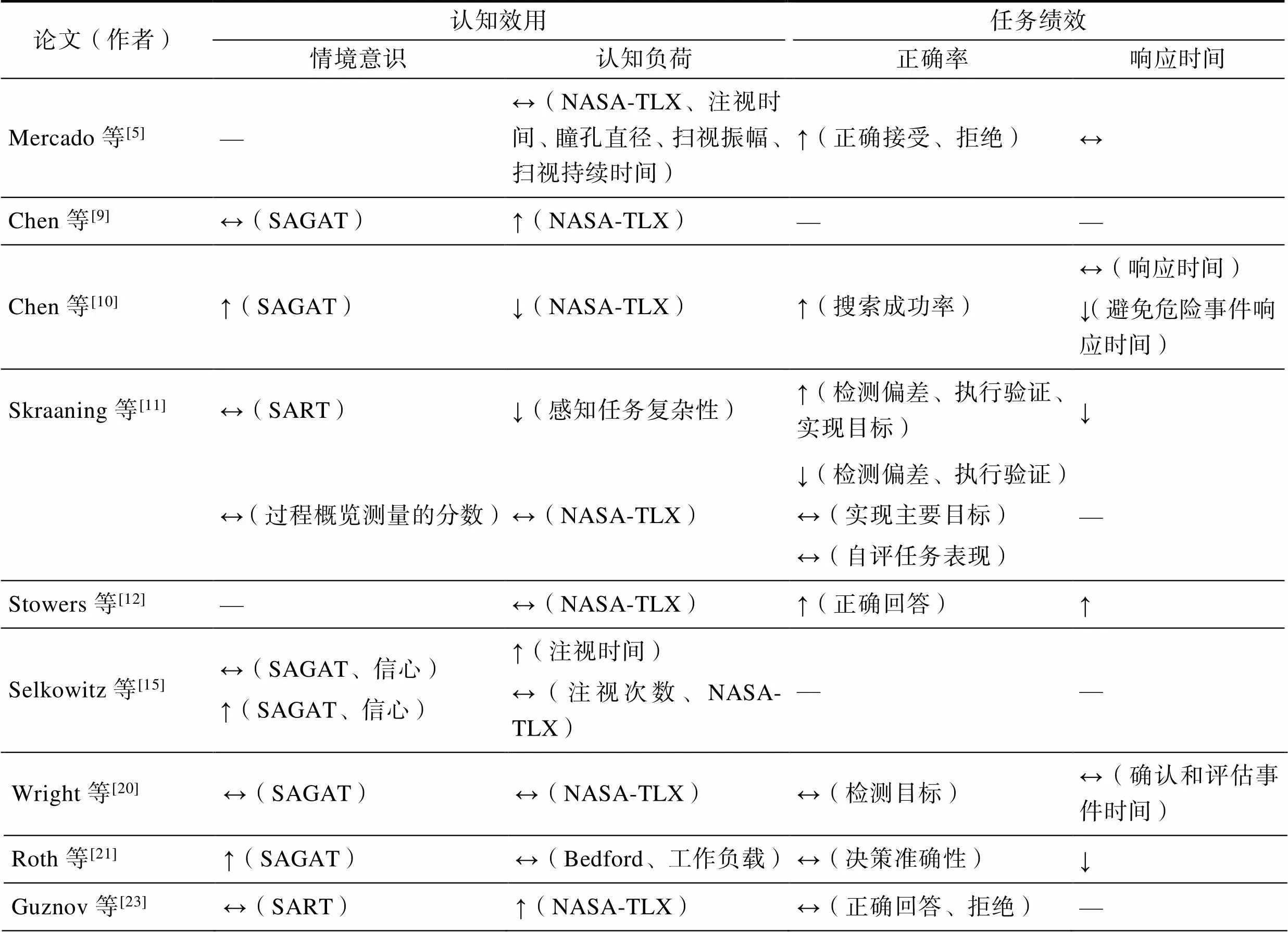

1.2 透明度信息水平的认知任务影响研究

本文聚焦透明度信息对认知(情境意识、认知负荷)和任务(决策正确率、响应时间)的影响,分析了相关研究结论,见表2。在认知层面,高水平透明度对人类操作员的情境意识有改善作用[20],也可能加剧认知负荷。针对自动化系统的监控、规划和管理等任务,添加系统可供性、潜在危险、环境限制、推理逻辑、预测和不确定性等透明度信息有助于提高情境意识[15,21]。相较于单一信息,提供状态(什么设备失效)和诊断(为什么失效)的详细信息有助于改善情境意识[11]。当自动驾驶系统提供支持理解的中等水平透明度信息时,用户的情境意识最佳,但同时认知负荷也最高[22]。增加呈现高水平透明度信息的图标、文本数量会增加界面复杂性,将带来额外的阅读负荷并导致注意力分散[23]。

表1 透明度信息类型

Tab.1 Types of transparency information

表2 高水平透明度的认知与任务影响研究

Tab.2 Research on the cognitive and task impact of high level transparency

注:“↑”表示改善/增加;“↔”表示没有影响;“↓”表示下降/减少

在任务层面,高水平透明度对决策正确率有改善作用,对搜索和决策的时间效率有一定的负面影响。Mercado等[5]发现透明度水平提升可以显著提升决策正确率、增加信任度和感知可用性。李奕洁等[24]发现高水平透明度会带来更高的正确率增益、更小的人机最优绩效差异。Helldin等[14]发现传感器精度和不确定性信息提高了对自动分类器的信任和对分类任务的绩效,但导致了工作量增加和决策延迟。高水平透明度导致了更长的响应时间[25]和注视持续时间[15]。但透明度水平与任务绩效并不呈简单的线性关系。Dadashi等[2]发现透明度信息越少,接受和清除告警的任务响应时间越少,但出错概率并不随信息增加而降低,信息量中等时出错概率最小。李馨雨[16]发现具备故障原因和处置信息的中等透明度模式具有最佳的驾驶任务绩效。

根据认知资源有限理论,高水平透明度要求用户投入额外的认知努力以适应信息量的增加,这增加了认知负荷[10]。任务绩效的差异进一步反映了透明度信息对认知的矛盾影响[20]。高水平透明度通过改善情境意识提升了决策正确率,却因为信息量的增加影响了响应时间。

1.3 透明度信息的可视化设计原则研究

智能系统应该为用户提供直观的、有助于理解复杂透明度信息的视觉效果,允许用户快速理解信息,然后返回其他任务[28]。目前,透明度信息的相关可视化设计策略主要包括关联信息集成、渐进式披露和不确定性沟通等,有助于最大限度地避免高水平透明度带来的认知负荷过载。

关联信息集成是指将概念关联的信息片段集成在相近位置显示,有助于提高操作者处理信息的能力。Selkowitz等[29]通过定位、箭头、图标等视觉元素整合自主机器人小队的位置、航向和当前行动等信息,使操作人员能够在一个地方获得关于自主机器人的多种信息。Skraaning等[11]对比了基于不同显示类型(随机网状、饼状)和距离(分离式、集成式)的信息可视化界面,发现可靠性信息的整合有助于提升用户信任。针对无人机集群系统,Roundtree等[7]发现独立显示个体信息容易导致信息超载,阻碍操作员对集体现状、行动推理以及预测结果的理解,集体状态的抽象可视化有助于减少工作负载和人为错误。关联信息集成策略的关键在于利用简单的元素和符号加强信息的整合感知能力,以便用户快速认知系统的关键信息和逻辑关系。

渐进式披露是指基于用户认知需求和期望对信息优先级进行排序,在初期提供具有最大解释力或对决策有贡献的主要信息,并随着人机互动的发展逐渐加入更多解释信息,如推理过程、关联关系等,以避免信息过量[30]。渐进式披露包括2种模式:1)交互模式,收到操作员请求后提供信息,Vered等[31]发现相较于固定顺序推送模式,需求驱动的交互模式有效提高了任务绩效,保持了情境意识,且不增加响应时间;2)适应模式,根据人机互动的动态发展主动识别需求并展示信息。相比交互模式,适应模式的自动驾驶系统被认为智能性更高、心理工作量更低,且在响应速度方面更具优势[32]。

不确定性沟通是指以图形方式显示不确定性信息与相关数据。Kunze等[33]发现基于颜色和动画的变量有助于传达明确的紧迫性顺序,获得较高的主观偏好评级。Beller等[34]指出紧急情况下的不确定性沟通既能改善操作员的监控行为,也能提高接管后的驾驶安全性,明显降低最小碰撞时间。Helldin等[35]发现获得高分辨率不确定性信息的司机可以更快地接管自动驾驶车辆,并且信任校准效果比对照组更佳。不确定性的可视化主要通过抽象、可操作的视觉变量呈现,包括位置、面积或长度、形状、色调、饱和度、清晰度、运动频率等[33]。

2 智能高铁弹出故障界面的透明度信息及可视化设计

复兴号CR400BF系列列车是“中国标准”动车组首批成员之一,是搭载先进控制平台和统一操作界面的智能动车组。对复兴号列车驾驶界面进行分析,发现弹出故障界面的主要信息和任务操作指示以纯文本格式显示,对驾驶员识别故障信息和任务流程造成了一定的困难,见图1。现有弹出故障界面主要包含故障状态和处理措施2种信息类型。故障状态信息包括故障编号、故障车厢、故障代码和故障名称,属于可观察透明度信息类型。处理措施信息由任务流程和判断逻辑构成,属于可理解透明度信息类型。当前弹出故障界面的主要问题在于:1)对可理解透明度信息的可视化呈现不足。文字呈现的判断逻辑,不利于司机识别和判断;2)缺乏可预测维度的透明度信息。缺少对告警信息紧急程度和恢复情况的呈现。为实现对任务执行的预期结果的判断,司机需要跳转到其他界面。

图1 现有列车弹出故障界面

根据现有透明度信息的可视化设计原则,提出从2个方面优化弹出故障界面的透明度信息显示:1)优化可理解透明度信息的视觉呈现。根据处理措施的任务顺序和判断逻辑进行可视化设计;2)增加可预测维度的透明度信息。增加对告警信息紧急程度和告警恢复情况的可视化呈现。基于上述策略提出可视化设计方案,见图2。首先,根据关联信息集成的可视化设计原则,采用逻辑流程图将任务流程和判断逻辑进行可视化,利用矩形表示操作任务,箭头表示顺序,菱形表示判断任务,文字表示判断条件,见图2①。其次,根据不确定性沟通的可视化设计原则,采用颜色将故障紧急程度和故障恢复情况进行可视化。其中,红色表示需要立即停车的故障,黄色表示可以继续行车的故障,绿色表示故障已恢复。紧急程度在故障发生信息导航栏、故障名称、故障警示图标、故障处理措施中呈现,见图2②;恢复情况在故障告警图标中呈现,见图2③。

图2 弹出故障界面可视化设计方案

3 实验评估

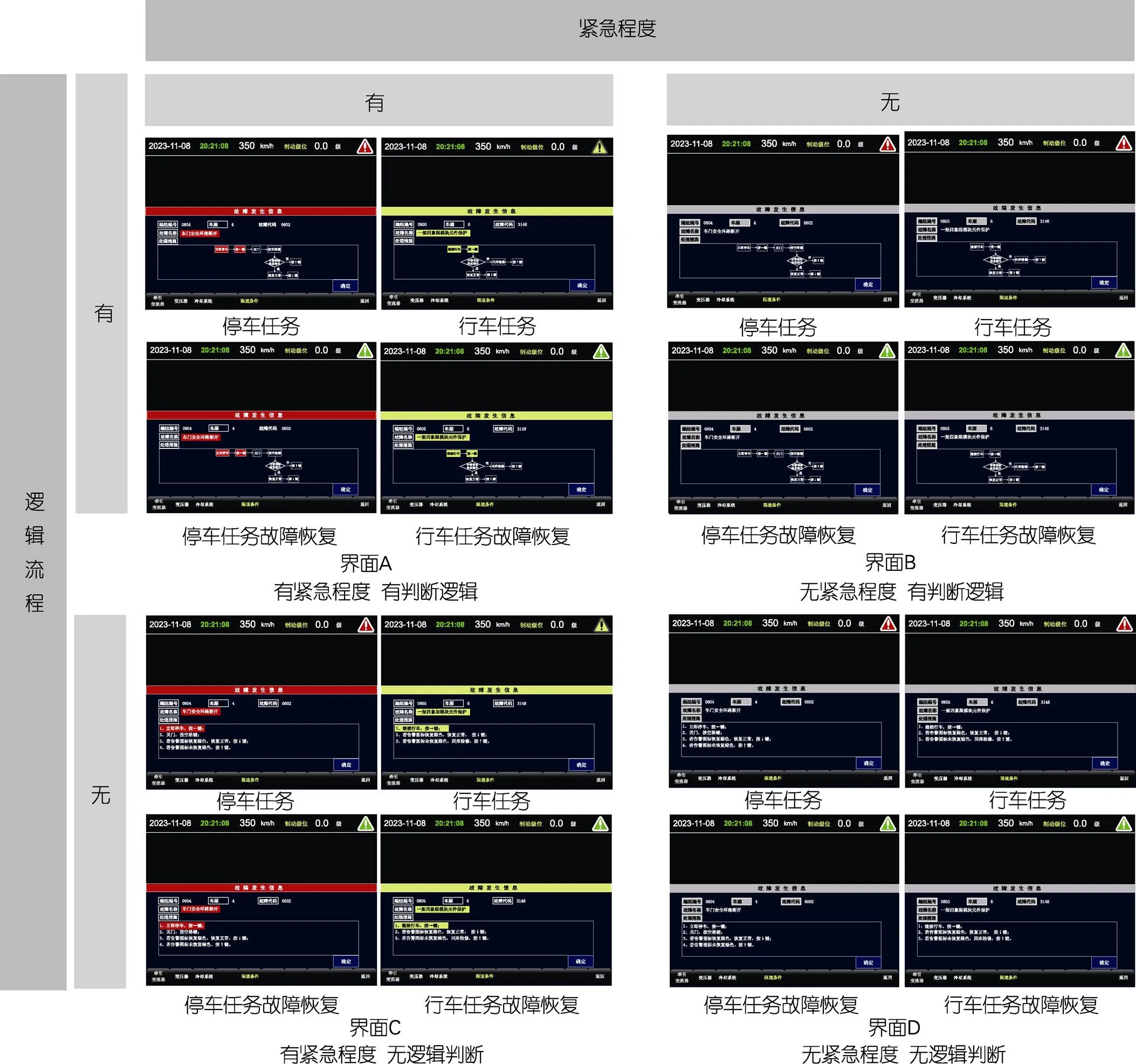

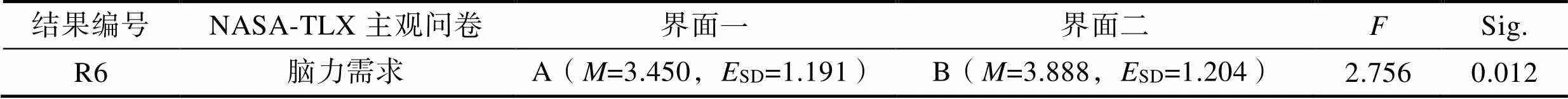

为验证智能列车弹出故障界面可视化设计方案的有效性,采用混合实验设计进行评估验证。自变量为2种可视化设计(逻辑流程和紧急程度),见图3。有逻辑流程可视化的界面采用逻辑流程图显示故障处置任务流程,如图3的A、B界面所示;无逻辑流程可视化的界面采用文字显示故障处置任务流程,如图3的C、D界面。有紧急程度可视化的界面采用红色、黄色和绿色表示故障的紧急程度和恢复情况,如图3的A、C界面所示;无紧急程度可视化的界面只用红色、灰色、绿色显示,如图3的B、D界面所示。实验设置车门安全环路断开和一架四象限模块元件保护2种故障模式。2种故障模式需执行不同的处理措施,需被试者判断立即停车或继续行车,对应非常紧急和次要紧急2种故障紧急程度。为保证实验对比效果,所有处理措施均简化为键盘按键。

3.1 实验任务与流程

实验设置常态驾驶任务和应急处置任务。常态驾驶任务是瞭望线路环境、盯控设备运行状态。列车在整个实验期间保持自动驾驶状态,天气情况设置为浓雾,能见度低于200 m。被试者需集中注意力在列车屏幕的中央位置,注视列车行径轨道消失点,查看线路信号灯以及是否有异物侵限,并用余光扫视显示屏以观察车速和制动等级等驾驶状态信息。

应急处置任务是注意故障信息界面是否弹出,并根据弹出界面中指示的流程进行列车故障应急处置的模拟操作。故障信息界面会在常规任务执行1~3 min内随机弹出。为避免学习效应,不同可视化设计的弹出故障界面以随机顺序显示。在弹出故障界面出现时,被试者需根据故障提示完成3个判断任务和相应按键操作:1)观察故障内容,根据提示判断是否需要立即停车或继续行车,停车按左键,行车按右键;2)判断是否需要执行关门操作,如需关门按空格键;3)观察告警图标查看故障恢复情况,判断是否恢复列车的正常运行,恢复正常运行按下键,回库检修按上键。记录被试者的每次按键和反应时。

3.2 实验数据

为分析不同可视化设计对被试者认知和任务的影响,实验收集主观问卷和客观行为数据。主观问卷采用SART情景意识量表和NASA-TLX认知负荷量表。SART量表采集被试者对情境不稳定程度、情境复杂程度、情境可变程度、精神唤醒程度、注意力集中程度、注意力分配程度、精力剩余程度、获得信息的数量、获得信息的质量、情境熟悉程度等指标的主观评价。另外,要求被试者口头回答任务暂停时的列车车速和制动等级,作为对SART问卷的补充。NASA-TLX量表采集被试者对完成任务的脑力需求、身体负担、时间需求、努力程度、任务绩效、挫败感等指标的主观评价。客观行为数据通过心理学实验软件E-Prime 3.0采集,记录被试者判断停车或行车任务、执行关门操作、判断故障恢复情况的按键和反应时长,计算按键正确率和反应时。

图3 实验对比的可视化设计方案

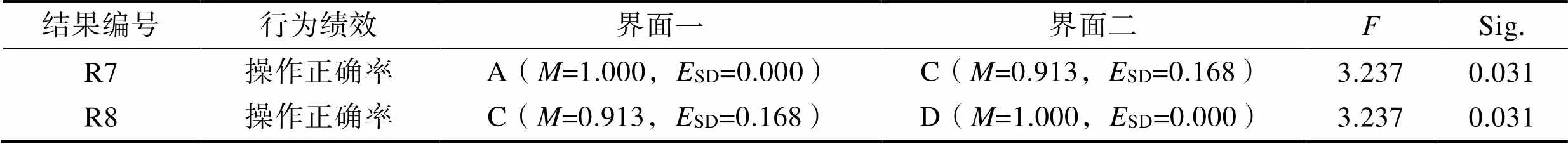

3.3 实验环境

实验在半实物仿真模拟驾驶装置进行,如图4所示。模拟驾驶装置由司机操纵台、线路场景显示器和仿真计算机组成。司机操纵台参照CR400BF型高速动车组司机操纵台进行搭建,操纵台上的司机主操纵手柄、控制开关、按钮以及ATP和TCMS显示屏等硬件与实车基本相同,ATP和TCMS显示界面按照CR400BF型动车组的真实界面进行设计。线路场景显示器由3块24英寸LED显示屏组合而成,位于操纵台前方,用于展示动车组前方线路、车站和周边建筑物等虚拟场景。实验路段选取新京哈线路,北京城南机场至哈尔滨北段轨道。已有研究指出半实物仿真驾驶台与真实驾驶环境所得数据不存在显著差异。一台17.3英寸的双显微型计算机用于显示弹出故障界面,并使用键盘进行实验操作。

图4 半实物仿真模拟驾驶装置

3.4 实验流程与被试者

实验流程主要包括实验内容告知、基本信息录入、模拟训练、正式实验和主观问卷填写。被试者通过10 min模拟训练熟悉列车驾驶模拟器,进行故障应急处置的模拟练习直到操作熟练。正式实验共进行16次式,单次式持续3 min;每次式实验结束后,被试者填写主观问卷,休息2 min后开始下一次式,总实验持续时长大约为70 min。为降低界面暴露顺序带来的学习效应,4类界面以随机顺序呈现。

实验共招募20名被试者,其中10名男性,10名女性。平均年龄为22.7岁(SD=2.58)。所有被试者都有正常或矫正后正常的视力,学历在本科及以上,对列车驾驶系统有一定的认知与使用经验。

4 实验结果

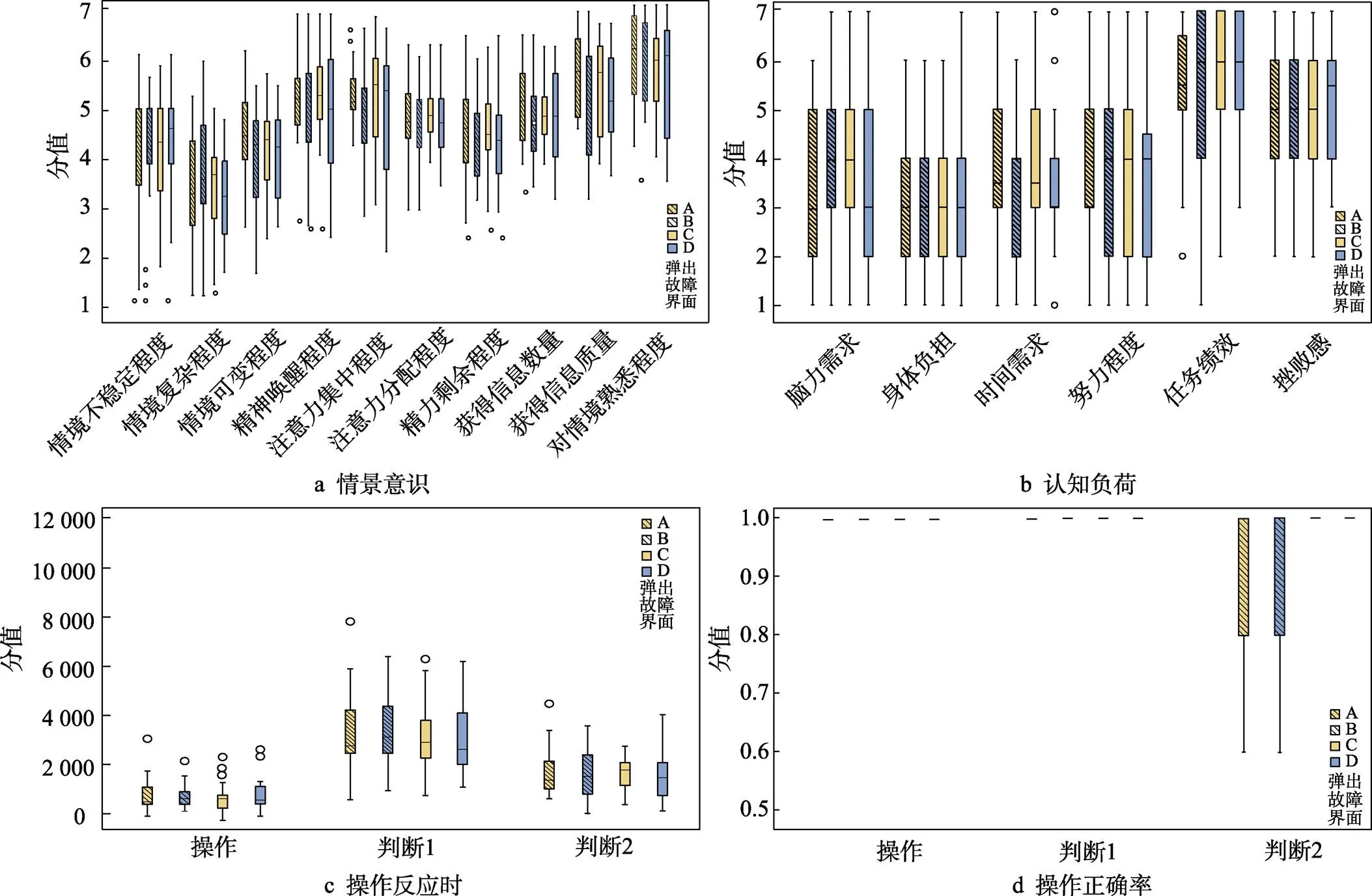

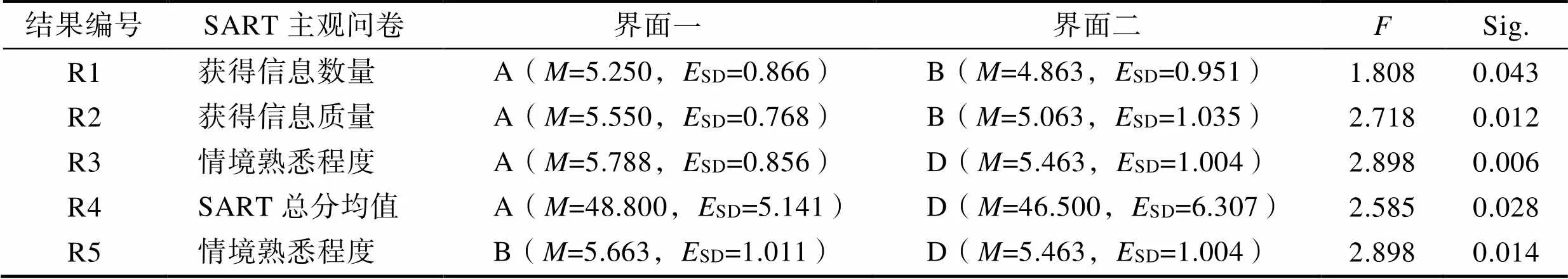

采用IBM SPSS Statistics 27进行数据分析。主观问卷和行为绩效数据的箱线图如图5所示。采用重复测量方差分析对比使用不同可视化界面时被试者情景意识、认知负荷和反应时、操作正确率的差异,发现可视化界面对被试者的情景意识、认知负荷和操作正确率产生了影响。

4.1 情境意识

界面A和B的SART问卷成对比较结果显示,被试者对获得信息数量、获得信息质量2个指标的主观评价有显著差异,见表3。在弹出故障界面有紧急程度(A)时,被试者获得信息数量、获得信息质量高于无紧急程度(B)时。该结果说明,在有逻辑流程时,增加紧急程度颜色区分会提高用户获得信息的数量和获得信息的质量。

图5 主观问卷和行为绩效数据箱线图

表3 可视化界面成对比较结果(情景意识)

Tab.3 Comparison results of visualization interface pairwise (situational awareness)

界面A和D、B和D的SART问卷成对比较结果显示,被试者对情境熟悉程度的主观评价有显著差异,见表3。描述性统计结果显示,在弹出故障界面有逻辑流程和紧急程度(A)或有逻辑流程(B)时,被试者的情境熟悉程度高于无逻辑流程和紧急程度(D)时。上述结果说明,逻辑流程和紧急程度颜色区分会提高用户的情境熟悉程度。在没有紧急程度颜色区分显示时,增加逻辑流程会提高用户的操作正确率和情境熟悉程度。

4.2 认知负荷

界面A和B的NASA-TLX问卷成对比较结果显示,被试者对脑力需求指标的主观评价有显著差异,见表4。描述性统计结果显示,在弹出故障界面有紧急程度颜色区分(A)时,被试者反馈的脑力需求低于无紧急程度(B)时。该结果说明,在有逻辑流程显示时,弹出故障界面的紧急程度颜色区分有助于降低被试者的脑力需求。

4.3 操作正确率

界面A和C、C和D的成对比较结果显示,被试者的操作正确率有显著差异,见表5。描述性统计结果显示,在弹出故障界面有逻辑流程(A)时,被试者的操作正确率高于无逻辑流程(C)时。该结果说明,在有紧急程度颜色区分时加入逻辑流程会提升用户的操作正确率。在弹出故障界面无紧急程度(C)时,被试者的操作正确率高于有紧急程度(D)时。该结果说明,在没有逻辑流程显示时,增加颜色区分紧急程度会降低用户的操作正确率。

表4 可视化界面成对比较结果(认知负荷)

Tab.4 Comparison results of visualization interface pairwise (cognitive load)

表5 可视化界面成对比较结果(操作正确率)

Tab.5 Comparison results of visualization interface pairwise (rate of correct operation)

4.4 实验结论

1)针对任务流程和判断逻辑的逻辑流程可视化设计在提升情境意识、任务绩效和降低认知负荷方面有较好的作用。结果R3、R4显示,有逻辑流程、有紧急程度颜色区分的故障弹出界面在驾驶员对情境的熟悉程度、情境意识总体得分上都高于原始的故障弹出界面。结果R5、R7显示,在加入紧急程度颜色区分时,加入逻辑流程显示有助于提升驾驶员对情境的熟悉程度;在没有紧急程度颜色区分时,加入逻辑流程显示有助于提升驾驶员的操作正确率。尽管受到影响的指标有所不同,但结果趋势一致,说明逻辑流程的可视化设计适用于弹出故障界面。

2)针对告警信息紧急程度和恢复状态的颜色编码可视化设计的有效性取决于是否同时有逻辑流程的呈现。结果R1、R2、R6显示,在有逻辑流程时,加入紧急程度颜色区分有助于提升驾驶员获得的情境信息数量和质量,减少对驾驶员的脑力需求。结果R8显示,没有逻辑流程时,加入紧急程度颜色区分反而降低了驾驶员的操作正确率。因此,在弹出故障界面应用颜色编码的可视化设计需要搭配逻辑流程来呈现。

5 结语

本文系统梳理了透明度信息的类型、认知任务影响和可视化设计方法。针对智能列车现有以纯文本格式显示的弹出故障界面,进行了透明度信息分析并提出了针对性的可视化设计方案,通过实验收集被试者的情景意识、认知负荷和任务绩效,由此评估了设计方案。由数据分析得知,逻辑流程的可视化设计适用于智能列车的弹出故障界面,但应用颜色区分紧急程度的可视化设计需要搭配逻辑流程呈现,否则可能会降低操作正确率。本文的创新点在于优化了智能列车弹出故障界面已有透明度信息的视觉呈现,并且增加了可预测维度的透明度信息。为提高驾驶员任务绩效、降低认知负荷,实现高质量人机协同驾驶的目标提供了界面设计参考。

[1] 郭北苑, 易子旺, 杜昊. 高铁ATO对驾驶任务效能的影响研究[J]. 人类工效学, 2022, 28(3): 1-5. GUO B Y, YI Z W, DU H. The Influence of ATO on Driving Performance Caused by ATO[J]. Chinese Journal of Ergonomics, 2022, 28(3): 1-5.

[2] DADASHI N, GOLIGHTLY D, SHARPLES S. Seeing the Woods for the Trees: The Problem of Information Inefficiency and Information Overload on Operator Performance[J]. IFAC-PapersOnLine, 2016, 49(19): 603- 608.

[3] RAD M. Human-Factors and Automation-Related Accidents in the Railway Industry[C]. International Conference Hazards 31: Process Safety and loss Prevention, 2021.

[4] VANDERHAEGEN F, BURKHARDT J M, FANG W N, et al. Human Factors and Automation in Future Railway Systems[J]. Cognition, Technology & Work, 2021, 23 (2): 189-192.

[5] MERCADO J E, RUPP M A, CHEN J Y C, et al. Intelligent Agent Transparency in Human-Agent Teaming for Multi-UxV Management[J]. Human Factors, 2016, 58(3): 401-415.

[6] ENDSLEY M R. From here to Autonomy[J]. Human Factors, 2017, 59(1): 5-27.

[7] ROUNDTREE K A, CODY J R, LEAF J, et al. Human-Collective Visualization Transparency[J]. Swarm Intelligence, 2021, 15(3): 237-286.

[8] LYONS J B. Being Transparent about Transparency: A Model for Human-Robot Interaction[J]. AAAI Spring Symposium - Technical Report, 2013,: 48-53.

[9] CHEN J Y, PROCCI K, BOYCE M, et al. Situation awareness-based agent transparency[J]. US Army Research Laboratory, 2014: 1-29.

[10] CHEN J Y C, BARNES M J, WRIGHT J L, et al. Situation Awareness-Based Agent Transparency for Human-Autonomy Teaming Effectiveness[C]//SPIE Defense+Security. Proc SPIE 10194, Micro- and Nanotechnology Sensors, Systems, and Applications IX, Anaheim, CA, USA. 2017, 10194: 362-367.

[11] SKRAANING G, JAMIESON G A. Human Performance Benefits of the Automation Transparency Design Principle: Validation and Variation[J]. Human Factors, 2021, 63(3): 379-401.

[12] STOWERS K, KASDAGLIS N, RUPP M A, et al. The IMPACT of Agent Transparency on Human Performance[J]. IEEE Transactions on Human-Machine Systems, 2020, 50(3): 245-253.

[13] KUNZE A, SUMMERSKILL S J, MARSHALL R, et al. Automation Transparency: Implications of Uncertainty Communication for Human-Automation Interaction and Interfaces[J]. Ergonomics, 2019, 62(3): 345-360.

[14] HELLDIN T, OHLANDER U, FALKMAN G, et al. Transparency of Automated Combat Classification[C]// International Conference on Engineering Psychology and Cognitive Ergonomics. Cham: Springer, 2014: 22-33.

[15] SELKOWITZ A R, LAKHMANI S G, CHEN J Y C. Using Agent Transparency to Support Situation Awareness of the Autonomous Squad Member[J]. Cognitive Systems Research, 2017, 46: 13-25.

[16] 李馨雨. 基于系统透明度的高速列车驾驶界面信息组织模式研究[D]. 北京: 北京交通大学, 2021. LI X Y. Research on Information Organization Mode of High-Speed Train Driving Interface Based on System Transparency[D]. Beijing: Beijing Jiaotong University, 2021.

[17] U.S. AIR FORCE. Autonomous horizons[M]. Washington, DC: United States Air Force Office of the Chief Scientist, 2015: 84-88.

[18] ENDSLEY M R. The Divergence of Objective and Subjective Situation Awareness: A Meta-Analysis[J]. Journal of Cognitive Engineering and Decision Making, 2020, 14(1): 34-53.

[19] WICKENS C D, HELTON W S, HOLLANDS J G, et al. Engineering Psychology and Human Performance[M]. New York: Routledge, 2021.

[20] WRIGHT J L, CHEN J Y C, LAKHMANI S G. Agent Transparency and Reliability in Human–Robot Interaction: The Influence on User Confidence and Perceived Reliability[J]. IEEE Transactions on Human-Machine Systems, 2020, 50(3): 254-263.

[21] ROTH G, SCHULTE A, SCHMITT F, et al. Transparency for a Workload-Adaptive Cognitive Agent in a Manned– Unmanned Teaming Application[J]. IEEE Transactions on Human-Machine Systems, 2020, 50(3): 225-233.

[22] AVETISYAN L, AYOUB J, ZHOU F. Investigating Explanations in Conditional and Highly Automated Driving: The Effects of Situation Awareness and Modality[J]. Transportation Research Part F: Traffic Psychology and Behaviour, 2022, 89: 456-466.

[23] GUZNOV S, LYONS J, PFAHLER M, et al. Robot Transparency and Team Orientation Effects on Human–Robot Teaming[J]. International Journal of Human–Computer Interaction, 2020, 36(7): 650-660.

[24] 李奕洁, 张玲, 黄琪璋, 等. 系统透明度信息对人机信任和协同决策的影响[J]. 包装工程, 2023, 44(20): 25-33. LI Y J, ZHANG L, HUANG Q Z, et al. Impact of System Transparency Information on Human-Machine Trust and Collaborative Decision Making[J]. Packaging Engineering, 2023, 44(20): 25-33.

[25] HUSSEIN A, ELSAWAH S, ABBASS H A. The Reliability and Transparency Bases of Trust in Human- Swarm Interaction: Principles and Implications[J]. Ergonomics, 2020, 63(9): 1116-1132.

[26] PANGANIBAN A R, MATTHEWS G, LONG M D. Transparency in Autonomous Teammates[J]. Journal of Cognitive Engineering and Decision Making, 2020, 14(2): 174-190.

[27] BHASKARA A, DUONG L, BROOKS J, et al. Effect of Automation Transparency in the Management of Multiple Unmanned Vehicles[J]. Applied Ergonomics, 2021, 90: 103243.

[28] VORM E S, COMBS D J Y. Integrating Transparency, Trust, and Acceptance: The Intelligent Systems Technology Acceptance Model (ISTAM)[J]. International Journal of Human–Computer Interaction, 2022, 38(18/19/20): 1828-1845.

[29] SELKOWITZ A R, LARIOS C A, LAKHMANI S G, et al. Displaying Information to Support Transparency for Autonomous Platforms[C]// Advances in Human Factors in Robots and Unmanned Systems. Cham: Springer, 2017: 161-173.

[30] MILLER C A. Trust, Transparency, Explanation, and Planning: Why We Need a Lifecycle Perspective on Human-automation Interaction[M]. New York: Academic Press, 2021: 233-257.

[31] VERED M, HOWE P, MILLER T, et al. Demand-Driven Transparency for Monitoring Intelligent Agents[J]. IEEE Transactions on Human-Machine Systems, 2020, 50(3): 264-275.

[32] ZANG J, JEON M. The Effects of Transparency and Reliability of In-Vehicle Intelligent Agents on Driver Perception, Takeover Performance, Workload and Situation Awareness in Conditionally Automated Vehicles[J]. Multimodal Technologies and Interaction, 2022, 6(9): 82.

[33] KUNZE A, SUMMERSKILL S J, MARSHALL R, et al. Augmented Reality Displays for Communicating Uncertainty Information in Automated Driving[C]// Proceedings of the 10th International Conference on Automotive User Interfaces and Interactive Vehicular Applications. Toronto, ON, Canada. ACM, 2018: 164–175.

[34] BELLER J, HEESEN M, VOLLRATH M. Improving the Driver-Automation Interaction: An Approach Using Automation Uncertainty[J]. Human Factors, 2013, 55(6): 1130-1141.

[35] HELLDIN T, FALKMAN G, RIVEIRO M, et al. Presenting System Uncertainty in Automotive UIs for Supporting Trust Calibration in Autonomous Driving[C]// Proceedings of the 5th International Conference on Automotive User Interfaces and Interactive Vehicular Applications. Eindhoven, Netherlands. ACM, 2013: 210–217.

[36] 王建民, 汪巧凤, 张俊. 自动驾驶中基于透明度的人机界面设计研究[J]. 包装工程, 2023, 44(14): 152-161. WANG J M, WANG Q F, ZHANG J. Human-Machine Interface Design Based on Transparency in Autonomous Driving Scenes[J]. Packaging Engineering, 2023, 44(14): 152-161.

Visualization Design of Intelligent High-speed Train Driving Interface Considering the Impact of Information Transparency

WU Yongmeng, WU Haoshuang, ZHI Jinyi*

(School of Design, Southwest Jiaotong University, Chengdu 610041, China)

Information transparency in the driving interface is a key design feature that affects the driver's ability to effectively supervise and take over an intelligent high-speed train. To solve the negative impacts brought by the increase of transparency information, the work aims to propose effective visualization design methods for transparency information design of intelligent high-speed train. By the method of literature research and analysis, the literature in the fields of robotics, civil defense, nuclear energy, aerospace, etc. was searched and analyzed respectively, to systematically sort out the types of transparency information, the cognitive task impacts, and the visualization design methods. By analyzing the information transparency of the pop-up fault interface for the intelligent high-speed train, the problems and deficiencies in the current interface were pointed out, i.e., poor visual presentation of task flow and judgment logic, and lack of urgency of the alarm information and its recovery status. The visualization design of transparency information was proposed through logic flowchart and color coding, and verified through user experiment. It was found that the logic flow visualization design had a better effect in enhancing situational awareness and task performance and reducing cognitive load. The effectiveness of color-coded visualization designs relied on the presentation of a logical flow and the absence of a logical flow may reduce the rate of correct operation. Visualization design helps to reduce the negative impact of transparency information on cognitive load and task performance and to achieve high-quality human-machine collaboration in intelligent high-speed train.

intelligent high-speed train; human-machine collaboration; human-machine interface; transparency information; visualization design

TB472

A

1001-3563(2024)04-0040-09

10.19554/j.cnki.1001-3563.2024.04.004

2023-09-20

国家自然科学基金(52175253);中国美术学院文创设计智造实验室开放基金(CAADAI2022B001);西南交通大学新型交叉学科培育基金项目(YG2022008);四川省社会科学重点研究基地现代设计与文化研究中心(MD22E016)