深度融合网络在街道场景中的应用

许鸿奎,郭文涛,李振业,郭旭斌,赵京政

(1.山东建筑大学 信息与电气工程学院;2.山东省智能建筑技术重点实验室,山东 济南 250101)

0 引言

图像语义分割是计算机视觉领域的重要研究方向之一,作为像素级别的分类任务,将图像中每个像素分配类别标签。在传统的语义分割任务中,通过运用数字图像处理和数学等领域的知识,对输入的图像进行特征提取,这些特征包括低层次的属性,如颜色、纹理和轮廓。在提取过程中,常采用的方法为阈值方法[1]、聚类方法[2]、图划分[3]等。但是传统算法只能提取大量的低级特征,并且分割后准确率低。随着深度学习技术的兴起,卷积神经网络被应用于图像分割,其性能大大优于传统的基于手工特征的图像分割方法。

近年来,大量的网络模型结构被提出,如AlexNet[4]、GoogLeNet[5]、ResNet[6]、VGG[7]等,使得语义分割领域飞速发展。2015 年,Long 等[8]提出全卷积神经网络(Fully Convolutional Networks,FCN),基于VGG 分类网络,人们通过将全连接层替换为卷积层,开创了全卷积神经网络在端到端图像语义分割中的应用。然而,仅依赖深层次网络特征往往导致边界粗糙和语义分割不准确等问题。为解决这一问题,人们开始融合不同层次的信息,采用自上而下的方式精细化特征,将浅层细节信息与深层语义信息相结合,以提高分割结果的准确性。

1 相关工作

在语义分割中,空间细节信息和深层语义信息是相互矛盾的。浅层特征提供了丰富的细节信息,但语义信息相对较少;而深层网络特征包含丰富的语义信息,但缺乏足够的空间细节信息。因此,如何平衡这两种信息成为语义分割研究的核心任务,旨在获取更准确且细致的分割结果。

1.1 编码器—解码器结构

一般而言,编码器通常是一个重复空间约简的深度网络,为提取上下文信息,解码器通过插值或转置卷积恢复分辨率。如2017 年,Badrinarayanan 等[9]提出的SegNet 网络就是一个标准的编码器解码器结构。同年提出的Deep-Lab[10]网络消除了ResNet 中的一些下采样操作,以保持高分辨率,并利用具有大膨胀的卷积以扩大感受野。从那时起,一系列如DeepLabV2[11]、DeepLabV3[12]、PSPNet[13]和DenseASPP 等[14]网络结构被提出。

另一方面,编码器结构可以是在ImageNet 上预先训练的轻量级骨干,也可以是从头训练的高效变体,如ERFNet[15]和ESPNet[16]。FANet[17]通过快速注意模块和整个网络的额外下采样实现了速度和准确性之间的良好折衷。SFNet[18]提供了一个流对齐模块以对齐相邻层的特征映射,以便更好地融合。

1.2 双分支结构

编码器—解码器架构减少了计算量,但由于在重复下采样过程中会丢失一些信息,无法准确地通过反采样恢复,从而影响了语义分割的准确性。为了缓解这一问题,旷视科技团队提出了一种双路径结构。网络结构为BiseNet[19],一条路径用来提取空间特征信息,另一条路径用来提取丰富的语义信息。因为两者的特征维度不同,为了空间信息和语义信息更好地融合,提出了特征融合模块FFM 和注意力优化模块ARM。2019 年,Li 等[20]提出一种通过子网和子级联的方式聚合判别性特征网络结构DFANet,采用深度多尺度特征聚合和轻量级深度可分离卷积。2021 年,Hong 等[21]提出DDRNet 网络结构,一种双分支深度融合的网络结构用来实现语义分割。

1.3 上下文信息

语义分割的另一个关键是如何捕捉更丰富的上下文信息。分层空间金字塔池(ASPP)由不同速率的分层卷积层组成,可处理多尺度的上下文信息。PSPNet[13]中的金字塔池化模块采用4 个不同大小的全局池化层以聚合多尺度特征。DANet[22]同时利用了位置注意和通道注意,进一步改进了特征表示。OCNet[23]利用自注意力机制探索对象上下文,对象上下文被定义为属于同一对象类别的一组像素。以上工作都在探索如何获得更加丰富的上下文信息和空间信息与上下文信息之间的有效融合。

本文主要贡献包括两个部分:①提出了一种深度融合空洞金子塔(Deep Fusion Atrous Spatial Pyramid Pooling,DFASPP),通过此模块捕获丰富的上下文信息;②为了高效地整合浅层空间细节信息和深层语义信息,提出了一个“语义融合模块”(Semantic Fusion Module,SFM)。通过构建不同层次特征像素之间的位置对应关系,这个模块能够自底向上地逐级融合深浅层次特征,从而实现更全面的信息利用。

2 本文方法

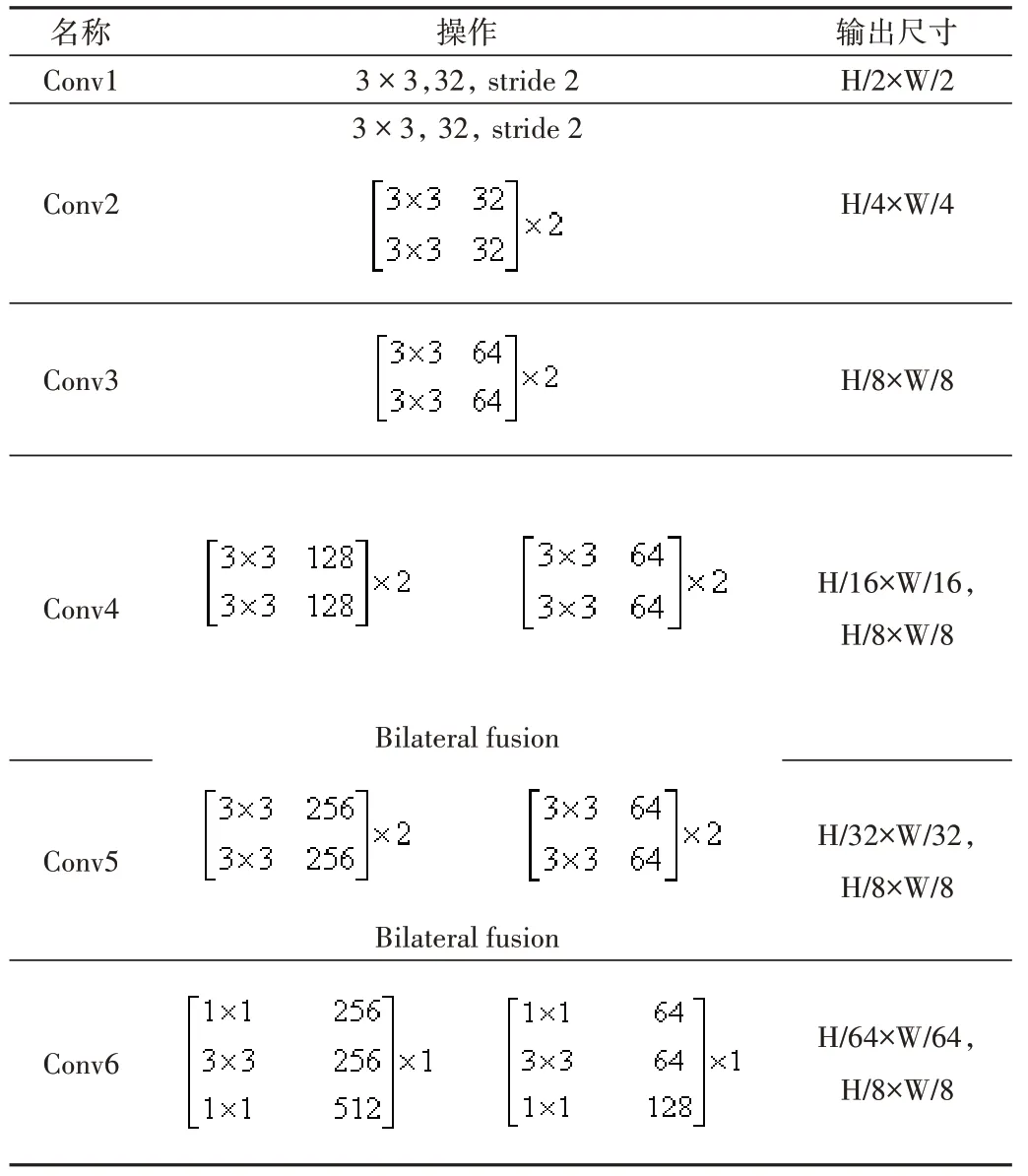

如图1 所示,本文方法整体网络结构为双分支。主干网络为DDRNet-23slim,详细信息如表1所示。其中,“RB”表示顺序剩余基本块;“RBB”表示单个剩余瓶颈块;“Seg.Head”表示分割头;“DASPP”表示深度融合空洞金字塔;“SFM”表示语义融合模块;黑色实线表示有数据处理的信息路径(包括上采样和下采样),黑色虚线表示没有数据处理的信息路径。

Table 1 Structure of DDRNet-23slim表1 DDRNet-23slim结构

Fig.1 Network structure图1 网络结构

在网络结构中,先通过两个顺序剩余基本块将图片提取到原图片的1/4、1/8,然后产生平行分支。在主干网络结构中继续通过顺序剩余基本块提取图片到1/16、1/32,再通过一个剩余瓶颈块将图片压缩到原图像的1/64。通过设计一个深度融合空洞金字塔提取多尺度的上下文信息。本文所设计的深度融合空洞金字塔中扩张率分别采用1、5、7。在另一分支结构中不再改变图片的分辨率,一直保持原图片大小的1/8,让图像保留丰富的空间信息。在空间信息与语义信息融合阶段,采用了一个语义融合模块指导融合,以确保融合的有效性。将融合后的特征图采用双线性插值方法上采样到原始图片大小,再通过Softmax 分类器将其分类,得到最终分割结果,完成语义分割任务。

2.1 深度融合空洞金字塔

空洞卷积在语义分割网络结构中有着广泛应用,它能够在扩大感受野的同时降低其计算量。在语义分割检测任务中,一方面感受野大了可以检测分割大目标,另一方面分辨率高了可以精确定位目标,还能捕获多尺度上下文信息,设置不同的膨胀率时其感受野不同,能够获得多尺度信息。

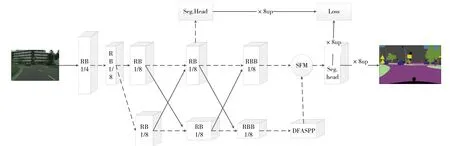

空洞卷积又名扩张卷积,向卷积层引入了一个称为“扩张率(Dilation Rate)”的新参数,该参数定义了卷积核参数之间的间距。换句话说,相比原来的标准卷积,扩张卷积多了一个超参数称之为扩张率,指卷积核各点之间的间隔数量。正常卷积的扩张率为1,膨胀卷积的感受野计算公式如下:

其中,Fi代表膨胀卷积的感受野大小,i表示膨胀因子大小。

图2(a)展示了一个标准的3×3 卷积模型,其扩张率为1,感受野大小为3×3。图2(b)描绘了扩张率为2 的3×3 卷积模型,其感受野扩展为7×7。而图2(c)呈现了一个扩张率为3的3×3卷积模型,其感受野进一步增大为15×15。这些模型通过调整扩张率来改变感受野大小,从而影响了卷积操作的局部感知范围。

Fig.2 Schematic diagram of cavity convolution图2 空洞卷积示意图

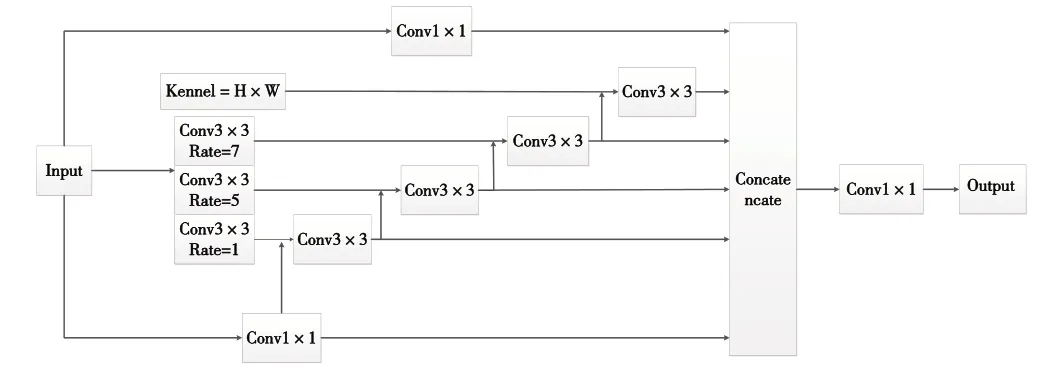

在Chen 等[12]的语义分割模型DeepLabv2 中,提出了一种空洞金字塔结构,通过不同的膨胀率同时对输入图片进行上下文信息提取,然后将其拼接融合。传统的空洞金字塔结构内部之间的关联性小,于是本文提出一种深度融合空洞金字塔(见图3),所设计的深度融合空洞金字塔,通过不同膨胀率的空洞卷积对图像进行多尺度的信息提取,同时输入特征图和全局平均池化生成的语义信息也被加以利用。在多尺度信息融合过程中,采用多个3×3 的卷积以层次残差的方式将不同尺度的上下文信息进行融合。以原图像的1/64 分辨率作为输入,通过3 个膨胀率分别为1、5、7 的空洞卷积,然后采用层次残差的方式将输入特征图、池化图和空洞卷积图融合,将不同尺度的上下文信息更加紧密地融合,其输入写为x,输出为y:

Fig.3 Pyramid structure of deep fusion cavity图3 深度融合空洞金字塔结构

其中,C1×1为1×1 卷积,C3×3为3×3 卷积,U 为上采样操作,DC 为空洞卷积,rate 为膨胀率,Pglobɑl为全局平均池。最后,使用1×1 卷积将所有特征映射连接和压缩。此外,还添加了1×1投影快捷方式,便于优化。

2.2 语义融合模块

在语义分割网络中,深层特征虽然富含语义信息,但图像分辨率较低;相反,浅层特征包含丰富的空间细节信息,却缺乏足够的语义信息。这两种信息对分割任务而言至关重要,因此如何有效利用这两种信息成为语义分割研究的关键所在。

在融合不同分辨率的特征时,通常需要对低分辨率特征进行上采样。然而,简单的双线性插值上采样操作往往导致不同分辨率特征之间的像素无法有效“对齐”,从而使得深层次的高语义特征在向浅层次的高分辨率特征传递时产生无效语义信息,融合效果不尽人意。为了解决这一问题,Li 等[18]提出了一种名为SFNet 的特征融合网络。该网络通过自主学习预测不同分辨率特征之间的“语义流”信息,能够将粗略的特征矫正为具有更高分辨率的精细特征,从而实现不同分辨率特征之间的像素“对齐”。通过这种方式,SFNet 能够有效地将语义信息从深层传输到浅层,实现不同分辨率特征之间的有效融合,进而提升语义分割性能。

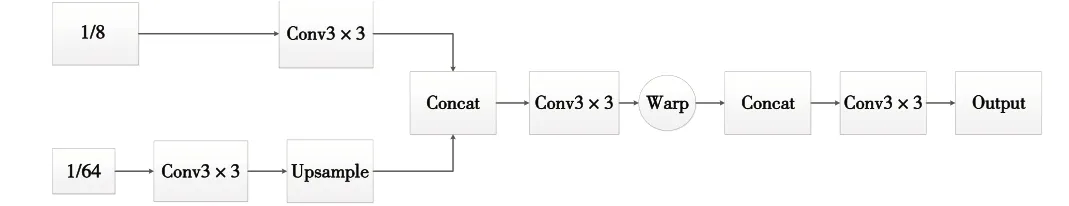

基于以上工作,本文设计了一个语义融合模块将深层次的语义信息与浅层次的空间特征进行多层次、深层次的融合。如图4 所示,语义融合模块中以原图像的1/64 作为深层输入,记为Fd;以原图像的1/8作为浅层输入,记为Fh。首先,将深层次特征Fd进行一个1×1 的卷积进行通道降维,然后通过上采样恢复到Fh尺寸大小。而Fh是通过一个3×3 的卷积后与Fd进行拼接融合,经过3×3 的卷积预测,获得二维偏移量Ff,其尺寸是原图像的1/8。在Ff 中,每个像素位置都包含水平和竖直方向的偏移信息,通过这些二维偏移量,可以确定不同分辨率特征间像素的相对位置关系。接下来,利用二维偏移量Ff 对深层次特征进行Warp 操作,得到新的特征Fw,然后将Fw 与Fh 进行拼接融合。这种融合方式有效地整合了不同分辨率的特征,进一步提升了模型性能。最后,将拼接后的特征利用1×1 的卷积融合以完成最后的输出。其操作可表示如下:

Fig.4 Structure of semantic fusion module图4 语义融合模块结构

其中,Upsample 表示以双线性插值的方式进行上采样;f3×3、f1×1表示3×3和1x×1的卷积操作;Concat是指对两个特征进行通道上的拼接操作,将它们的通道维度合并在一起。Warp 是一种空间变换操作,它根据偏移量生成空间网格,并利用这个网格对图像进行重新采样,从而实现图像的空间变换。这种Warp 操作可以有效地对图像进行对齐和校准,从而提升特征融合效果。

将深层特征Fd通过1×1 卷积和双线性插值上采样后与3×3 卷积的浅层特征Fh进行拼接融合,再经过3×3 的卷积得到二维偏移量Ff。

将得到的二维偏移量Ff对深层次的特征进行空间变换上采样得到特征Fw。

将原始的浅层特征Fh与变换后的Fw进行拼接融合,然后通过一个1×1 卷积进行输出。通过这样的操作使得浅层次的空间信息与深层次的语义信息融合得更加充分,加强了特征通道的信息表达。

3 实验与结果分析

3.1 实验环境

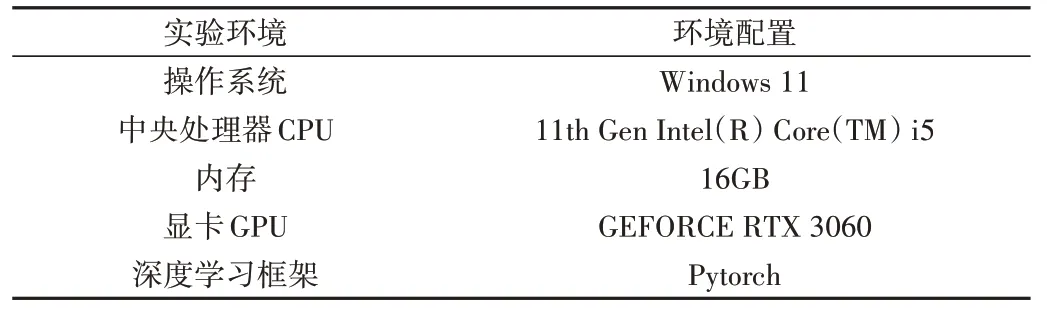

实验环境选择CPU 为Intel 处理器,内存为16GB,GPU 为RTX3060,深度学习框架为Pytorch。具体实验配置如表2所示。

Table 2 Software and hardware experiment configuration environment表2 软硬件实验配置环境

3.2 实验数据集

本文采用大规模城市街道场景语义分割数据集Cityscapes[24]作为实验数据。Cityscapes 数据集主要针对自动驾驶领域,包含了50 个不同城市街道场景的图像,其中5 000 幅图像具有精确标注,20 000 幅图像具有粗略标注。该数据集涵盖了34 个不同的街景类别,本实验中只专注于19 个类别的检测和评估。对于实验评估,仅使用精确标注的5 000 幅图像,并将其划分为3 个部分:2 975 幅用于训练,500 幅用于验证,以及1 525 幅用于测试。所有图像的分辨率均为1 024×2 048。

3.3 评估指标

在本次实验评估中,采用了平均交并比(Mean Intersection over Union,mIoU)作为评估算法性能的主要指标,mIoU 是图像语义分割任务中的标准度量方法。对于单个类别,交并比(Intersection over Union,IoU)计算的是真实标签与预测值之间的交集和并集之比。而mIoU 则是所有类别IoU 的平均值,用于全面评估算法在所有类别上的性能。采用mIoU 作为评估指标,可以更准确地衡量算法在语义分割任务中的效果。具体计算公式如下:

3.4 网络参数设置

本次实验的网络结构为双分支,其提取特征信息的主干网络结构为DDRNet-23slim,图像预处理将图片大小都调整为1 024×1 024 作为网络输入。采用随机梯度下降法(Stochastic Gradient Descent,SGD),学习率初始值设为0.01,动量为0.9,权重衰减为0.000 5,batchsize 设置大小为32,进行500 个epoch 进行训练。测试采用的输入图片尺寸为2 048×1 024。

3.5 对比试验

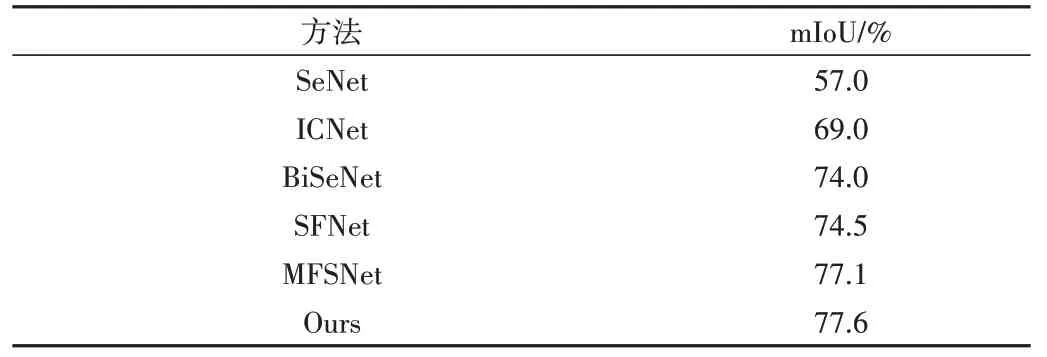

在Citycapes 数据集上将本文方法同ICNet、BiSeNet、SFNet、MFSNet 等一系列先进的网络结构进行对比。为保证实验公平性,采用相同的实验设备和实验环境。输入图片的尺寸均为2 048×1 024。性能比对采用平均交并比加以衡量。

通过表3 可以看出,所设计的深度融合网络结构相较于SeNet、ICNet、BiSeNet、SFNet、MFSNet 等轻量级网络结构有着较大提升,在Citycapes 数据集上得了77.6%的平均交并比。

Table 3 Performance comparison of each method表3 各方法性能比较

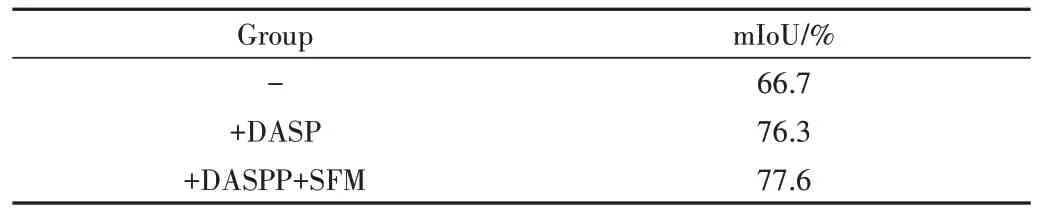

Table 4 Comparison of ablation experiments表4 消融实验比较

3.6 消融实验

为了检验各模块对分割精度的影响,本文基于相同的实验环境和实验参数,在Citycapes 数据集上做了消融实验。通过对比发现,在不加任何模块时,其产生的平均交并比为66.7%,而加上设计的深度融合空洞金字塔模块进行进一步的语义信息提取后平均交并比达76.3%,再加上一个语义融合模块进行指导空间信息与语义信息的有效融合,其平均交并比达77.6%。

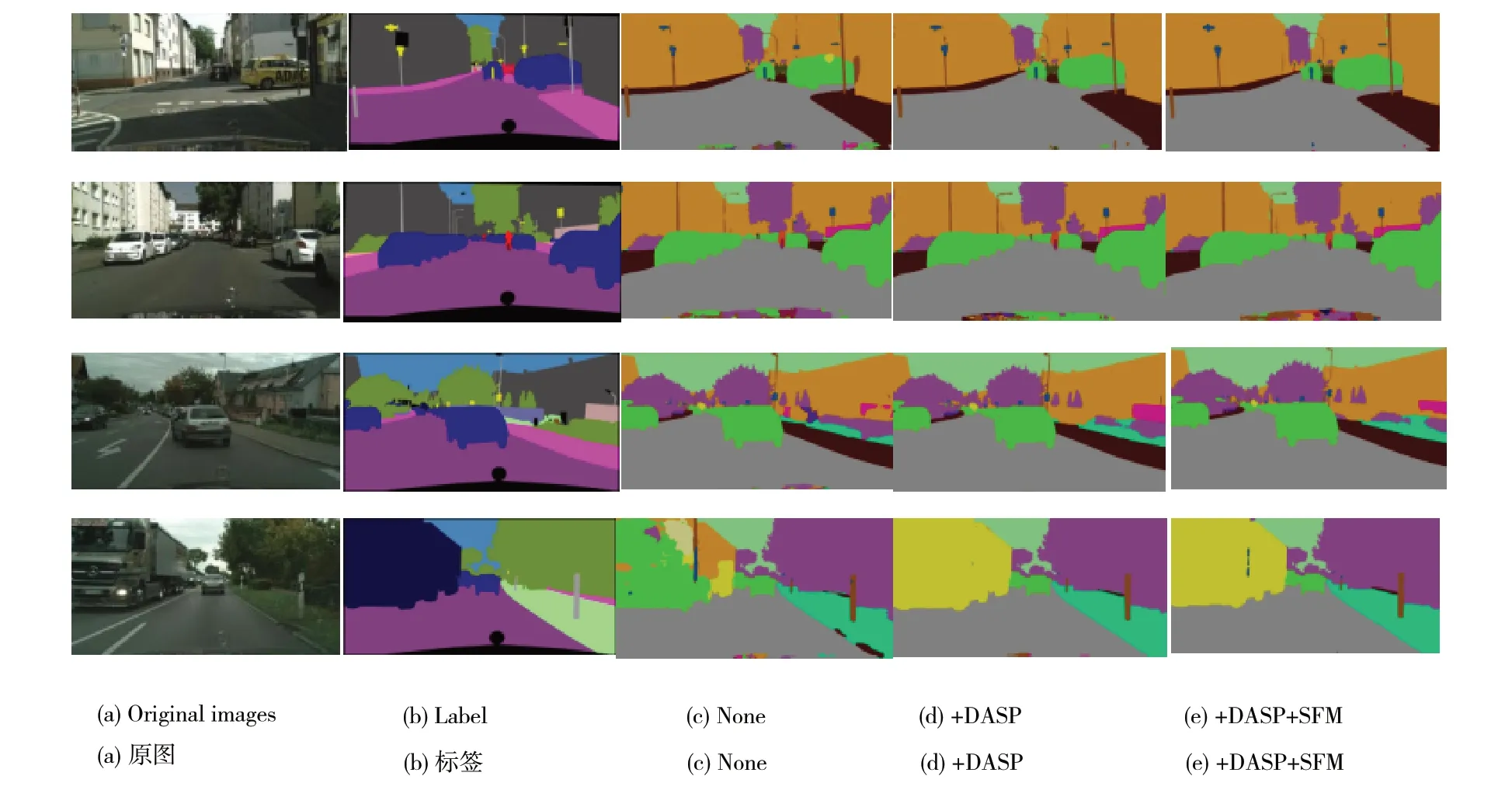

3.7 分割结果可视化

为了更加直观地展示本文方法所带来精度上的提升,在Citycapeas 数据集上进行分割可视化。图5 中,(a)为原图,(b)为标签,(c)为不加任何模块,(d)为加上深度融合空洞金字塔,(e)为加上深度融合空洞金字塔和语义融合模块。可以看出,在不添加模块时,其分割的物体边缘信息不明显,物体之间容易混合;加上本文所设计的模块后,其分割精度有明显提升。

Fig.5 Visualization on Citycapeas dataset图5 Citycapeas数据集上可视化

4 结语

本文设计了一个深度融合的空洞金字塔模块和一个语义融合模块应用于语义分割任务。利用深度融合空洞金字塔捕获不同尺度目标上下文信息,通过层次残差的方式进行深度融合,在保持图像分辨率不变的前提下,降低网络参数数量并增强图像的全局语义信息表达能力。使用语义融合模块将浅层空间信息与深层次语义信息进行有效融合,通过实现深层语义信息与浅层细节信息的互补,在Cityscapes 数据集上获得了优异的分割精度,并通过可视化方式展示了本文方法的分割效果。未来,将继续致力于提升模型对不同物体的分割精度,并进一步简化模型,以增强其在实际应用中的可行性,同时提高应用效率,加快模型训练进度。