基于细粒度信息集成的意图识别和槽填充联合模型

周天益 范永全 杜亚军 李显勇

摘 要:意图识别和槽位填充是构建口语理解(SLU)系统的两项主要任务,两者相互联合的模型是对话系统的研究热点。这两个任务紧密相连,槽位填充通常高度依赖于意图信息。针对最近联合模型中:固定阈值很难在不同领域中选择出正向的投票,且复杂的意图信息不能充分地引导槽位填充的问题。提出了一种基于细粒度信息集成的意图识别和槽填充联合模型。其中,将由意图解码器获取的意图信息与各单词的编码表示拼接,形成意图引导的集成编码表示,从而为单词级槽位填充提供细粒度的意图信息。同时,通过计算最大意图得分和最小意图得分的中间值获得逻辑自适应阈值,并用其代替固定阈值。逻辑自适应阈值可随不同意图标签的得分分布而变化。通过在两个多标签数据集上的实验结果验证了提出的模型的性能。

关键词:意图识别; 槽位填充; 联合模型; 双向LSTM

中图分类号:TP311 文献标志码:A

文章编号:1001-3695(2023)09-017-2669-05

doi:10.19734/j.issn.1001-3695.2023.01.0015

Joint model of intent detection and slot filling based on

fine-grained information integration

Zhou Tianyi, Fan Yongquan, Du Yajun, Li Xianyong

(School of Computer & Software Engineering, Xihua University, Chengdu 610039, China)

Abstract:Intent detection and slot filling are two main tasks for building a spoken language understanding(SLU) system, the joint model of the two tasks is the research hotspot of the dialogue system. These two tasks are closely tied and the slots often highly depend on the intent. For the recent joint model: the fixed threshold is difficult to extract the positive votes in different domains. And the complex intent information guides the slot filling insufficiently. This paper proposed a fine-grained information integrated model for multiple intent detection and slot filling. Among this model, the intent information obtained by the intent decoder was concatenate with the encoding representation of each token to form an intent guided integrated encoding representation, so as to offer fine-grained intent information for the token-level slot prediction. At the same time, calculating the median of the maximum intent score and the minimum intent score to obtain the logic-adaptive threshold, and used it replace the fixed threshold. The logic-adaptive threshold can vary with the score distribution of different intent labels. Experimental results on two multi-label datasets verifies the performance of the proposed model.

Key words:intent detection; slot filling; joint model; Bi-LSTM

0 引言

口語理解(SLU) [1]是面向任务对话系统的关键组成部分。它通常包括意图识别[2]和槽位填充[3]两个子任务。意图识别任务主要是识别用户的意图,槽位填充任务主要是从自然语言中提取语义成分。通常,意图识别和槽位填充是分开实现的,但直观地说这两个任务并不是独立的,槽位填充通常高度依赖于意图信息[4]。给定一个与音乐相关的话语“listen to classical music”,其中每个单词都有不同的槽位标签,而整个话语则对应一个意图标签。该话语的意图标签为listen_to_music,则话语更可能包含槽位标签music_name而非槽位标签movie_name。因此,如何正确且有效地建模意图识别与槽位填充之间的交互是目前探索的重点。由于意图识别和槽位填充之间的强相关性,许多基于多任务学习框架的联合模型被提出。Liu等人[5]提出了一个基于注意力的RNN模型,但其仅应用了一个联合损失函数来隐式链接这两个任务,模型实际上并未使用意图信息来引导槽位填充。王宇亮等人[6]提出了基于意图—槽位注意机制的意图理解算法。此算法通过槽位选通机制建模意图和槽位之间的显式关系,在单标签场景中取得了成功,而本文的工作则聚焦于多标签场景下的联合建模。

多标签意图识别可以识别话语中的多个意图,因此引起了越来越多的关注。Xu等人[7]探索多标签意图识别,然而,文献[7]仅考虑了意图识别,而忽略了槽位填充任务。Gangadharaiah等人[8]首次使用具有槽门机制的多任务框架来联合建模多标签意图识别和槽位填充,但其仅将多个意图信息整合为一个复杂的意图信息来引导所有的槽位填充,而并未提供准确且有效的意图信息。Qin等人[9]提出了一种自适应交互模型(AGIF),槽位填充由AGIF中的多意图信息指导,但其仍使用固定阈值筛选对意图标签的正向投票。尽管以上模型实现了不错的性能,但仍面临两个问题:a)这些模型采用固定的阈值进行意图识别,但在不同的领域,每个单词的意图分类得分分布是不同的,在某些领域,大多数单词的意图分类得分太低,而在其他领域,单词的意图分类得分太高,因此固定阈值很难在不同领域有效地选择正向的投票;b)这些模型简单地将多个意图信息整合为一个复杂的意图信息来引导槽位填充,并没有为单词级槽位填充提供准确有效的意图信息。

本文提出了一种基于细粒度信息集成的多意图识别和槽位填充联合模型。在两个公共数据集MixSNIPS[10]和MixATIS[11]的实验结果表明本文模型获得了实质性的改进。本文引入了一种新的阈值确定方法,以选择适合于各领域的阈值。本文提出的逻辑自适应阈值通过适应不同意图标签的得分分布来计算出合适的阈值,从而进行有效的投票选择,并且其比固定阈值更加通用;提出一个细粒度信息集成模块,其中细粒度意图信息与话语的编码表示相结合来引导单词级槽位填充;通过在两个公开的多标签数据集MixATIS和MixSNIPS上进行的实验,表明模型的性能实现了实质性的提升。

1 模型框架

模型的结构如图1所示,其中包含一个共享的自注意力编码器[12]、一个单词级意图识别解码器、一个基于细粒度信息集成的槽位填充解码器。共享的自注意力编码器由两部分组成。其中之一是双向LSTM,用于前向和后向理解输入话语以生成带有序列特征的隐藏状态;另一个是自注意力机制,用于感知长度可变序列的上下文信息。最后将双向LSTM的隐藏状态和自注意力结果拼接作为输入话语的编码表示。多标签意图识别由基于逻辑自适应阈值的单词级意图识别解码器实现。在细粒度信息集成模块中意图信息被用来引导槽位填充。本文用意图标签和输入话语的编码表示来计算意图—单词相关性分数。接着,将意图标签、意图—单词相关性分数和输入话语编码表示三者结合起來,形成意图引导的集成编码表示。最后,将携带细粒度意图信息的集成编码表示用于槽位预测。

1.1 自注意编码器

在口语理解中,单词的标签不仅由自身含义决定,还由上下文决定。为了捕获此类依赖关系,意图识别和槽位填充使用相同的自注意力编码器。在自注意力编码器中,使用双向LSTM和自注意力机制来获得话语的序列特征和上下文信息,这些特征和信息对序列标记任务均有帮助。

2 实验

2.1 数据集

本文在两个公开的多标签数据集上进行了实验。一个关于音乐和天气的数据集MixSNIPS、一个关于航空旅行的数据集MixATIS。数据集的划分如表1所示。

2.2 基线模型

本文模型与以下主流的基线模型进行了比较:

a)Attention BiRNN[5]。Liu等人提出了一种基于对齐RNN的槽填充和意图识别联合模型。

b)Slot-Gated Atten[4]。Goo等人提出了一种槽位门控联合模型,考虑了槽位填充和意图识别之间的相关性。

c)Bi-Model[15]。Wang等人提出了双向模型来模拟意图识别和槽位填充之间的双向交互。

d)SF-ID Network[16]。E等人建立了SF-ID网络在两个任务之间建立直接连接。

e)Stack-Propagation[17]。 Qin等人采用栈传播的框架,显式地将意图信息引导槽填充。

f)Joint Multiple ID-SF[8]。Gangadharaiah等人提出了一种具有槽位门控机制的多任务框架,用于多意图识别和槽位填充。

g)AGIF[9]。 Qin等人提出了一种自适应交互网络来实现多标签意图识别,实现了目前最好的性能。

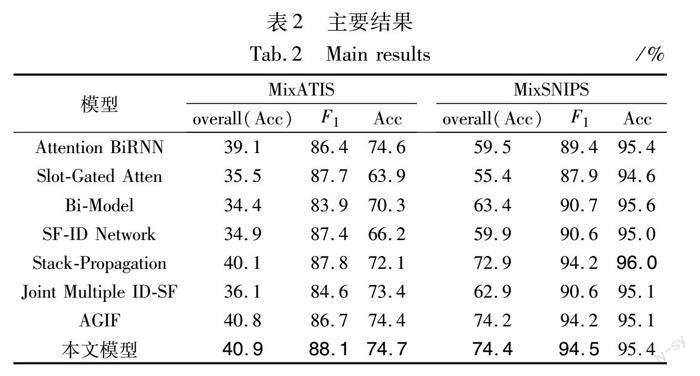

2.3 主要结果

本文使用F1值来评估槽填充的性能表现。意图识别的性能通过accuracy来评估,句子级的语义分析水平通过overall accuracy来评估。overall accuracy表示意图识别结果和槽位填充结果同时正确的比率。表2给出了实验结果,可以看出:a)对于意图识别,本文模型在accuracy上优于基线AGIF,这意味着所提出的逻辑自适应阈值成功地为特定领域选择了适当的阈值,因此可以提高意图识别性能;b)与AGIF相比,本文的模型分别在 MixATIS 和 MixSNIPS上实现了overall accuracy的提升,表明本文提出的细粒度信息集成模型可以更好地捕捉意图和槽位之间的相关性,从而提高模型对口语理解的性能。

2.4 结果分析

2.4.1 联合训练

为验证联合训练的有效性,意图识别和槽位填充使用独立的编码器。细粒度信息集成模块中的意图标签被随机初始化。意图—单词相关性得分均设置为0.5。其他组件保持不变,称此模型为模型-IL。由表3可得,模型-IL在没有共享参数的情况下表现不佳,并且在两个数据集上的总体性能都有所下降。尽管MixSNIPS上的accuracy几乎不变,但overall accuracy和F1值仍在下降。这一结果可以从两个方面解释:a)具有相关性的任务可以通过联合学习相互促进;b)准确且有效的意图信息可以引导槽位填充,从而进一步提升模型性能。

2.4.2 细粒度信息集成

去除细粒度信息集成模块,并将话语编码表示直接输入到槽感知的双向LSTM中来进行消融实验。将其称为表3中的模型-FGII。由表3可得,在MixATIS和MixSNIPS数据集上,F1分别下降了1.3%和0.8%。表明细粒度信息集成可以获得准确有效的意图信息,从而引导槽位填充。

2.4.3 逻辑自适应阈值

直接使用固定阈值来代替逻辑自适应阈值进行意图识别,以验证逻辑自适应阈值的效果,本文将其称为表3中的模型-LAT。由表3可得,缺乏逻辑自适应阈值分别导致两个多标签数据集上的overall accuracy下降了1.0%和0.7%。这意味着逻辑自适应阈值可以选择适当的阈值以适应特定的话语和领域。

2.4.4 可视化

为直观地理解细粒度信息集成模块的功能,对其中的意图—单词相关性得分进行了可视化。如图5所示,竖轴为预测的意图标签,横轴为输入话语。颜色越深,即相关度越高。绐定话语“Rate this album 5 points and when is just before night- fall playing”和其意图标签“RateBook”和 “SearchScreeningEvent”。可以清晰地发现意图—单词相关性得分成功地集中在正确的意图上,这意味着细粒度信息集成模块可以将与槽位相关的意图信息结合起来。简而言之,本文模型恰当地将意图信息“RateBook”用于槽位“Rate,this, album, 5, points”的预测。类似地,将“SearchScreeningEvent”的意图信息用于槽位“when,is,just,before,nightfall,playing”的预测。

2.4.5 实例研究

如图6所示,图(a)为来自MixATIS的实例,图(b)为来自MixSNIPS的实例。当意图—单词相关性分数大于0.5时,即相关性较强时,将意图标签与单词相连。由图6可得,各意图标签均为其相关的单词提供了准确且有效的细粒度意图信息,从而克服了以往模型提供复杂意图信息而导致歧义的问题,并且对两个实例预测的槽位标签均得到了正确的结果,表明本文的模型性能得到了实质性的提升。

3 结束语

本文提出了一种基于细粒度信息集成的意图识别和槽填充联合模型,在意图识别解码器中使用逻辑自适应阈值以选择适合于不同话语的阈值,克服固定阈值的问题;提出的逻辑自适应阈值能随着不同的意图得分分布而变化,并且比固定阈值更加通用。通过细粒度信息集成獲得的集成编码表示可以建模槽位和意图之间的交互,有效地为单词级槽位填充提供细粒度的意图信息。此外,意图—单词相关性分数的可视化为本文模型提供了一定的可解释性。在两个公开的多标签数据集上的实验结果表明,本文模型的性能有实质性的提升。未来计划结合更多的知识并探索新的架构,以更好地模拟单词、意图、槽位和其他文本特征之间的交互,从而获得更好的口语理解性能。

参考文献:

[1]魏鹏飞, 曾碧, 汪明慧, 等. 基于深度学习的口语理解联合建模算法综述[J]. 软件学报, 2022,33(11):4192-4216. (Wei Pengfei, Zeng Bi, Wang Minghui, et al. A survey of joint modeling algorithms for oral comprehension based on deep learning[J]. Journal of Software, 2022,33(11): 4192-4216.)

[2]郑思露, 程春玲, 毛毅. 融合实体信息和时序特征的意图识别模型 [J]. 计算机技术与发展, 2022,32(11): 171-176. (Zheng Silu, Cheng Chunling, Mao Yi. Intention recognition model integrating entity information and temporal features[J]. Computer Technology and Development, 2022,32(11): 171-176.)

[3]刘振元, 许明阳, 王承涛. 基于数据增强和字词融合特征的实体槽位识别[J]. 华中科技大学学报:自然科学版, 2022,50(11): 101-106. (Liu Zhenyuan, Xu Mingyang, Wang Chengtao. Entity slot recognition based on data enhancement and word fusion features[J]. Journal of Huazhong University of Science and Technology:Natural Science Edition, 2022, 50(11): 101-106.)

[4]Goo C W, Gao Guang, Hsu Y K, et al. Slot-gated modeling for joint slot filling and intent prediction[C]//Proc of Conference of North American Chapter of the Association for Computational Linguistics: Human Language Technologies, Volume 2 (Short Papers). 2018.

[5]Liu Bing, Ian L. Attention-based recurrent neural network models for joint intent detection and slot filling[C]//Proc of the 17th Annual Conference of International Speech Communication Association.2016: 685-689.

[6]王宇亮, 杨观赐, 罗可欣. 基于意图—槽位注意机制的医疗咨询意图理解与实体抽取算法[J]. 计算机应用研究,2023,40(5):1402-1409. (Wang Yuliang, Yang Guanci, Luo Kexin. Intention understanding and entity extraction algorithm for medical consultation based on intention-slot attention mechanism[J]. Application Research of Computers, 2023,40(5):1402-1409.)

[7]Xu Puyang, Sarikaya R. Convolutional neural network based triangular CRF for joint intent detection and slot filling[C]//Proc of IEEE Workshop on Automatic Speech Recognition and Understanding. Piscataway,NJ:IEEE Press,2013.

[8]Gangadharaiah R, Narayanaswamy B. Joint multiple intent detection and slot labeling for goal-oriented dialog[C]//North American Chapter of Association for Computational Linguistics. 2019.

[9]Qin Libo, Xiao Xu, Che Wanxiang, et al. AGIF: an adaptive graph-interactive framework for joint multiple intent detection and slot filling[C]//Proc of IEEE Workshop on Automatic Speech Recognition and Understanding. Piscataway,NJ:IEEE Press, 2020.

[10]Coucke A, Saade A, Ball A, et al. Snips voice platform: an embedded spoken language understanding system for private-by-design voice interface[EB/OL]. (2018). https://arxiv.org/abs/1805.10190.

[11]Hemphill C T, Godfrey J J, Doddington G R. The ATIS spoken language systems pilot corpus[C]//Proc of Darpa Speech & Natural Language Workshop. 1990.

[12]Qin Libo, Wei Fuxuan, Xie Tianbao, et al. GL-GIN: fast and accurate non-autoregressive model for joint multiple intent detection and slot filling[EB/OL]. (2021-06-03). https://arxiv.org/abs/2106.01925.

[13]Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need[EB/OL].(2017). https://arxiv.org/abs/1706. 03762.

[14]Yang Peng,Ji Dong,Ai Chengming,et al. AISE: attending to intent and slots explicitly for better spoken language understanding[J]. European Journal of Medicinal Chemistry: Chimie Therapeutique, 2021, 211(1):106537.

[15]Wang Yu, Shen Yilin, Jin Hongxia. A bi-model based RNN semantic frame parsing model for intent detection and slot filling[C]//Proc of Conference of North American Chapter of Association for Computatio-nal Linguistics: Human Language Technologies, Volume 2 (Short Papers). 2018.

[16]E Haihong, Niu Peiqing, Chen Zhongfu, et al. A novel bi-directional interrelated model for joint intent detection and slot filling[C]//Proc of the 57th Annual Meeting of Association for Computational Linguistics. 2019: 5467-5471.

[17]Qin Libo, Che Wanxiang, Li Yangming, et al. A stack-propagation framework with token-level intent detection for spoken language understanding[C]//Proc of Conference on Empirical Methods in Natural Language Processing and the 9th International Joint Conference on Natural Language Processing. 2019: 2078-2087.

收稿日期:2023-01-13;修回日期:2023-03-17 基金項目:国家自然科学基金资助项目(61872298,61802316,61902324);四川省科技厅资助项目(2023YFQ0044,2021YFQ008)

作者简介:周天益(1998-),男,江苏常州人,硕士研究生,主要研究方向为意图识别;范永全(1976-),男(通信作者),河南淅川人,副教授,硕导,博士,主要研究方向为大数据与人工智能(fyq@mail.xhu.edu.cn);杜亚军(1967-),男,四川巴中人,教授,硕导,博士,主要研究方向为大数据与人工智能;李显勇(1984-),男,四川达州人,副教授,硕导,博士,主要研究方向为Web信息挖掘、社交网络分析.