AIGC 技术在人工智能电影创作中的应用策略研究

陈焱松

北京师范大学艺术与传媒学院,北京 100875

1 人工智能电影的概念

在人工智能(AI)及其相关支撑技术不断发展迭代的当下,人工智能电影(Artificial Intelligence Film)成为一种对电影未来形态的想象,成为一种“由来已久却又不断生出新增内容的动态指涉”[1]。在这个指涉过程中,人工智能电影实际上不断与人工智能技术进行耦合关系建构,并呈现出内涵与外延的复杂样态。

目前学界对于人工智能电影的概念定义往往从两个维度进行界定,一方面是作为电影的人工智能,即电影叙事内容以人工智能为题材,涉及到了数字人角色、科幻母题探讨、AI 主导社会形态等多个层面,诸如《大都会》(Metropolis,1927)、《2001:太空漫游》(2001: A Space Odyssey,1968)、《银翼杀手》(Blade Runner,1982)、《人工智能》(Artificial Intelli-gence:AI,2001),《她》(Her,2013)等都展现了人工智能要素对于电影艺术的参与式渗透。另一方面则是作为人工智能的电影,即人工智能技术参与到电影创作形式与流程中,“由人工智能算法自动生成剧本或辅助完成视听工作流程的电影”[2]。

学者李岩认为,作为人工智能的电影大致分为两种形式,一种是人类仅提供训练模型和初始调参,由算法独立自行完成的影像作品,另一种是以提升影像制作的生产力或创造力为目标,由人类作者以AI 算法为工具而完成的影像作品[2]。两种逻辑都彰显出人工智能生成方式对于电影的艺术介入,只是在创作的独立性和辅助性程度上有所区别。因此,作为人工智能的电影,其核心是针对人工智能生成方式的探讨,也就是说本文所提出的“人工智能电影”实际上是对“作为人工智能的电影”的统一称谓。

2 AIGC 技术发展对于电影创作的影响

2.1 人工智能技术发展的四个阶段

人工智能概念自1956 年在达特茅斯会议被首次提出之后,逐渐成为一门涉及广泛的计算机交叉学科及前沿科学,但其核心意旨仍然是让作为机器的计算机能够像人一样思考。在人工智能的发展历程中,这种思考路径不断迭代更新,主要表现为四个重要阶段。

第一阶段为早期发展时期,出现在20 世纪50 年代中期至60 年代末期,聚焦于将逻辑推理能力赋予计算机系统,出现了包括机器定理证明、跳棋程序、表处理语言(List Processing,LISP)等一系列内容;第二阶段为知识工程时期,出现在20 世纪70 年代初期至80年代末期,聚焦于知识表达的应用问题,由此出现模拟人类专家的知识和经验解决特定领域问题的专家系统,同时也提出了卷积神经网络(CNN),促使人工智能技术进一步走向实用化;第三阶段为机器学习(ML)时期,出现在20 世纪90 年代至21 世纪初期,聚焦于利用计算机对数据进行分析的理论和方法,利用经验改善系统自身的能力,出现了监督学习(Supervised Learning,SL)、无监督学习(Unsupervised Learning,UL)、强化学习(Reinforcement Learning,RL)等众多理论,进而出现包括1997 年IBM 深蓝超级计算机战胜了国际象棋世界冠军卡斯帕罗夫在内的一系列标志性事件;第四阶段为深度学习(DL)时期,出现在2010年至今,伴随大数据、云计算、互联网、物联网等信息技术发展及泛在感知数据和图形处理器等计算平台的推动,以深度神经网络(DNN)为代表的人工智能技术飞速发展,大幅跨越了科学与应用之间的“技术鸿沟”。

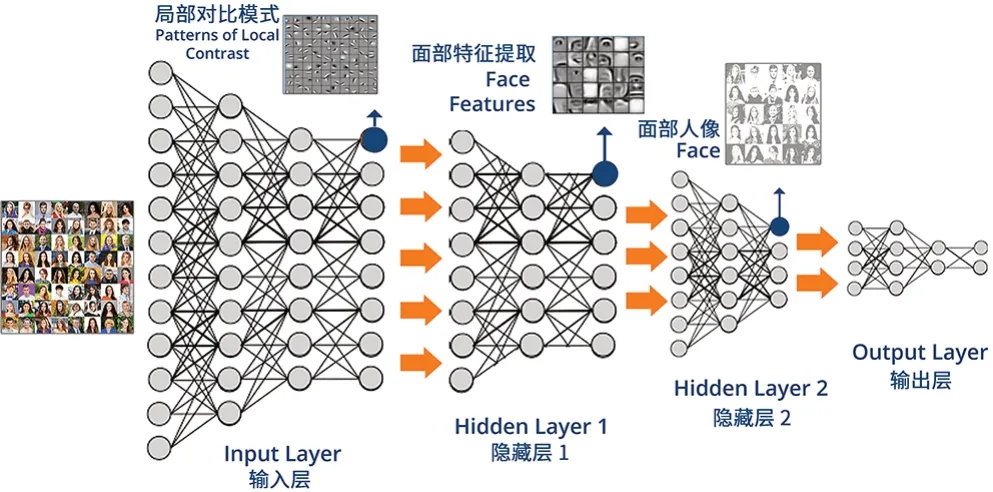

其中,所谓的深度神经网络的计算过程一般是从最左侧的输入层开始,从左往右计算,逐层向前直到最右侧的输出层产生运算结果。如果结果值和目标值有差距,再从右往左算,逐层向后计算每个节点的误差,并且调整每个节点的所有权重,反向到达输入层后,又重新向前计算,重复迭代以上步骤,直到所有权重参数收敛到一个合理值。如图1 展现出深度神经网络的运行机制,在人脸识别任务中对于不同层级的神经网络对图像信息的抽取差异,即当输入海量的人脸数据集之后,底层网络主要是对图像中局部纹理进行捕捉,而随着层数的递增,模型开始根据下层收集到的纹理信息对人脸中的局部结构(如眼睛、耳朵等)进行建模,而顶层将综合上述局部特征对人脸在图像中的位置进行确定,最终达成人脸识别的目的。

图1 深度神经网络的运行机制①

2.2 从决策式AI、分析式AI 到生成式AI 的模式转向

在经历早期发展时期、知识系统时期、机器学习时期、深度学习时期四个阶段之后,人工智能的重点研究领域完成了从决策式AI、分析式AI 到生成式AI的转变。所谓的人工智能生成内容(Artificial Intelligence Generated Content,AIGC)即是指通过人工智能方法生成文本、图像、音频、视频等多媒体内容,也是当前深度学习领域最热门的方向之一。

从技术本源来看,AIGC 技术主要分为基于规则与基于学习两大角度。其中,基于规则的AIGC 是指使用预先定义好的规则和逻辑来生成内容,如语法、句型、结构等,它们通常需要人为设定参数和约束,以保证内容的合理性和一致性。基于学习的AIGC则是指使用机器学习(ML)算法来从大量的数据中学习和提取特征和规律,然后根据这些特征和规律来生成内容。这种技术通常不需要人为地设定参数和约束,而是依赖于数据的质量和数量。

一般而言,之前的决策式AI 或分析式AI 是针对学习数据中的条件概率分布,针对已有数据进行分析、判断、预测,主要应用于物体识别、文本翻译、智能推荐、自动驾驶等领域;而生成式AI 与其他类型AI 的主要区别在于其不仅能够对已有的数据进行分析、判断、决策,还更加强调学习归纳之后进行演绎创造,并生成全新内容的过程,即学习数据中的联合概率分布,主要是基于历史进行模仿式、缝合式创作。

2.3 AIGC 技术视野下的电影创作

《科学》杂志在总结2022 年的年度突破时,将AIGC 技术与“黄金眼”空间望远镜(Golden Eye)、巨型细胞(A surprisingly massive microbe)等成果列入榜单,并重点提出了AI 开始入侵曾经被认为是人类独有的领域,一个是艺术表达,一个是科学发现[3]。

从艺术表达的角度来看,早在1957 年,莱杰伦·希勒(Lejaren Hiller)和伦纳德·艾萨克森(Leonard Isaacson)就完成了历史上第一支由计算机创作的弦乐四重奏《伊利亚克组曲》(Illiac Suite)。此后,继用户生成内容(UGC)、专业生产内容(PGC)之后,AIGC成为AI 艺术创作领域的核心,它在机器学习(ML)模型的基础上,根据一定的训练集从而创建全新的输出内容,就像人类创建新的事物一样,可用于包括音频、代码、图像、文本和视频等内容创作领域。作为涵盖文本、图像、音频、视频的综合性艺术,电影也成为了AIGC 可拓展的全新领域。

(1)横向影响:文本、图像与视频

从横向对比来看,AIGC 技术目前对于文本、图像等单一领域展现出巨大的艺术潜质,但对于视频领域(尤其是电影创作领域)的介入仍然处在技术迭代发展的进程中,而市面上现存的视频解决方案还具有一定的局限性。例如,Runway 的GEN-1 在视频生成视频(Video-to-Video)的过程中,前景人物的动作时常影响背景场景的连续性,GEN-2 在文本生成视频(Text-to-Video)的模型下仅能通过文字提示词和单一图像来进行限定,仍然缺乏一定的可控性。其中,《瞬息全宇宙》(Everything Everywhere All at Once,2022)中运用Runway 生成超现实的场景实际上是通过简单的跳接场景来规避了连续性和可控性的问题。又如,Stable Diffusion 通过包括ControlNet编辑器、Deforum 插件、mov2mov 插件、TemporalKit+EbSynth 流程完成从静帧图片到动态影像的生成,但是其画面闪烁、人脸失真等问题仍然明显。再如于6月30 日正式全面开放的Wonder Studio 则是提取了视频中的人物动作,同时进行抠像并合成为CG 画面,甚至新功能可以将提取的动作导入至渲染引擎软件中进行再处理,但它只针对动态人物,对于场景的生成作用不大。

(2)纵向影响:从工具思维到创作思维

从纵向衍生来看,AIGC 对电影的介入则呈现出从工具思维到创作思维的转向。AIGC 在其发展初期往往被运用在电影创作领域的周围,包括分析现有脚本的大型数据集,使用该数据生成新的原创故事,从而节省时间和资源;通过AI换脸、换声、分镜制作、数字人模拟虚拟角色等操作,降低拍摄风险,提高内容观赏性;分析演员的过往表现数据及社交媒体活动,以提高选角决策的准确性和效率等。这种对于电影领域的介入是典型的工具思维,直到以Transformer 大模型为基础的新一波AIGC 技术发展浪潮的到来,人工智能电影制作的概念才从单纯的工具层面走入艺术创作层面。

3 AIGC 技术视野下人工智能电影的应用策略分析

尽管目前AIGC 对于视频影像的解决方案存在一定局限性,人工智能电影还处于一个相对新兴和探索的阶段,还没有出现太多的商业化或广泛流行的例子。但是,一些实验性或创新性作品的出现,展示了AIGC 技术在人工智能电影创作中的可能性和潜力。正如电影评论者纳文·乔希(Naveen Joshi)认为,电影行业为人工智能技术的实际应用准备了六个基本入口,按照传统的电影创制流程,分别为剧作脚本输出、前期制作的简化辅助、选角、配乐编曲、剪辑、后期宣传[4]。面向未来,在AIGC 及其支持技术不断发展的当下,人工智能电影也呈现出多样化的创作应用逻辑与策略。

3.1 以风格化驱动的空间生成策略

就目前通用的AI 视频生成技术来看,较好的生成式视频模型仍然也只能生成几秒钟的内容,因而导致目前人工智能影片呈现出静止图像堆叠、简单视频混剪、视听语言抽象的风格趋势。因此从更广阔的技术发展角度来看,人工智能电影的艺术创作可能性并不能放置在现有阶段浅层的“辅助性创作”之中,而是应该进入深层次的“风格化创作”逻辑。一般而言,AIGC 技术视野下人工智能电影的风格化驱动的核心在于空间生成,即同时呈现出离线渲染(Pre-rendering)、实时渲染(Real-time Rendering)[5]两种思维模式。

(1)离线渲染的逻辑

从离线渲染的角度,人工智能电影的本体仍然是传统电影,即同样受到视觉画框、时间剪辑、空间切换等影像美学逻辑的影响。例如,Netflix 与小冰公司日本分部(Rinna)、WIT STUDIO 共同创作的《犬与少年》是AIGC 技术辅助商业化动画片的首个发行级别作品。该作品采用了一种名为“原始人工智能”的定制系统进行该片的背景绘制,在协作式的背景艺术创作过程中,动画师向AI系统提供提示和布局,接着AI 生成相应的图像,最后由动画师加以调整并与其他元素融合,最终这一迭代过程为团队提供了实现动画中所需场景外观和感觉的高效方式[6]。

格伦·马歇尔(Glenn Marshall)创作的AI 电影《乌鸦》(The Crow)(图2)获得2022 年“戛纳短片电影节”(Cannes Short Film Festival)的最佳短片奖。作品通过将舞蹈短片《Painted》输入OpenAI 创建的神经网络CLIP 中,通过从文本映射到图像的算法模型,生成一段“荒凉景观中乌鸦”影像视频[7]。该电影讲述了一个舞者变成乌鸦的故事,观众跟随乌鸦在由AI 生成的荒凉贫瘠的末世景观中,观看其短暂的舞蹈,直至其不可避免地消亡。

图2 AI电影《乌鸦》剧照②

(2)实时渲染的逻辑

从实时渲染的角度,人工智能电影的本体呈现出影游融合的可能性,同时能够更好地与VR 电影等新兴形式相适应,由AIGC 技术实时生成电影场景,使得影像空间不再是固定的空间,而成为一种不断增殖的空间。腾讯AI Lab 在2023 游戏开发者大会(Game Developers Conference)上展示了利用AIGC 技术的三维游戏场景自动生成解决方案,从零开始迅速搭建一座3D 虚拟城市的过程,所建虚拟城市面积达到25 平方公里,包含13 万米路网、4416 栋建筑以及超过38 万个室内映射[8]。按照游戏研究者的观点来看,生成式场景填补了AIGC 三维内容生成要素中的最后一环[9]。与三维模型内容生成相似,生成式场景存在传统Landscape 生成和神经辐射场(Neural Radiance Fields,NeRF)生成两条技术路线的差异。对于传统Landscape 生成而言,多见由AI 生成颜色图像继而生成深度图,进而导入渲染引擎生成Landscape;对于NeRF 生成而言,英伟达(NVIDIA)和多伦多大学共同推出的NeuralField-LDM,使用神经辐射场和生成模型,提供了复杂开放世界3D 场景的建模和编辑能力。

如图3 所示,AIGC 电影作品《Given Again》由音乐人Jake Oleson 创作,作品描述了作者在父亲去世后的混乱和沉思。作品所有序列都是完全使用Luma AI 的NeRF 技术创建的。在技术应用程序中,可以轻松捕捉物体、风景或整个场景,然后将其转化为详细的3D 环境。NeRF 技术是通过深度神经网络分析从不同角度拍摄的图像或视频,学习物体的底层3D 结构。然后,机器通过预测3D 空间中每个点的颜色和外观,即可合成高质量、高精度的模型。

图3 AIGC 电影作品《Given Again》截图③

3.2 以代理性驱动的智能角色策略

在AIGC 技术辅助下,人工智能电影中的人物可以不再是被规定的状态,而成为具备一定自我意识的生物体,即成为一个智能体角色(Agent)。例如,Hugging Face 研发人员Thomas Simonini 曾将语言模型GPT-3 接入到Unity 3D 中,让AI 控制游戏非玩家角色(Non-player Character,NPC)直接与玩家语音对话;开发者Bloc 则为游戏《骑马与砍杀2:霸主》(Mount & Blade Ⅱ: Bannerlord)加入了使用ChatGPT的MOD 模组,取代游戏原本NPC 的对话机制,让玩家可以实时打字交互,而NPC 则会做出个性化回应,从而实现动态回复。

(1)技术难点:智能化程度与资源占用程度

就目前现有的生成式技术来说,智能体角色的实现拥有诸多难点。其一,从智能化程度来看,现有的基于AIGC 技术的智能体角色可能受到人类先验知识或者故有偏见的影响,并依赖于人类的专家知识及先验信息来定义和划分角色,因此现存的智能体角色在面对新颖或者复杂的环境时缺乏灵活性或鲁棒性。其二,从资源占用程度来看,智能体角色的实现需要大量额外的计算量与存储资源进行驱动,同时也需要更多的参数和模型进行表示与学习,因此需要引入一定的协调机制,包括降低多智能体任务的复杂度、将单一智能体功能划分在不同角色上、减少智能体与智能体之间的冲突和干扰等,来维持角色与角色、角色与场景的一致性与平衡性,从而实现最优的解决方案。

(2)AIGC 电影智能角色的建构路径:决策、记忆、行动

正如游戏中的NPC 一样,未来AIGC 电影中的智能体角色将具备决策、记忆、行动等多维能力。其中,决策是底层能力,是电影智能角色通过对一定范围内的剧本背景、角色小传等信息的输入与学习所做出的反馈;记忆是中层能力,是电影智能角色对已发生、已经历的场景、人物、事件的搜集及调用;行动则是电影智能角色基于其自身对于决策、记忆及其他信息的理解所最终做出的复杂行为。以下两个案例实际上从不同的角度提出了对于未来AIGC 电影智能体角色的建构路径。

2023 年4 月,斯坦福大学及谷歌研究人员[10]创建出一个类似于《模拟人生》(The Sims)的微缩RPG 风格的名为“Smallville”的二维虚拟世界,同时在其中架设了包括房屋、咖啡馆、公园和杂货店在内的多种社会化场景,并以俯视的方式表现出来。此外,研究者同时利用社会互动的大语言模型(Large Language Model,LLM)、ChatGPT API 及其他自定义代码生成了25 个拥有独立行为意识的代理角色,并使其以高度逼真的行为独立生活。代理角色们会在醒来后承担不同工作,甚至会自发在小型社群中发起对话,提出自己的意见,并能够不断记住并思考过去的日子。

2023 年5 月,Wang 等[11]基于开放世界游戏《我的世界》(Minecraft)的既定框架,创设出一个由大语言模型(LLM)驱动的具备终身学习能力的智能体角色。为了让智能体VOYAGER 具有上述能力,研究者通过向GPT-4 输入多种类型的提词(Prompt)的方式,提出了三个关键组件。其一是自动教程(Automatic Curriculum),以最大化智能体的探索;其二是技能代码库(Skills Library),用以存储和检索复杂行为;其三是迭代提示机制(Iterative Prompting Mechanism),能结合游戏反馈、执行错误和自我验证来改进程序。

3.3 以涌现性驱动的自动事件策略

从应用逻辑来看,自动事件的建立需要基于前文所提到的生成式场景、智能体角色为技术基础,同时通过AIGC 技术生成自动化事件,并与用户进行多维交互,从而驱动人工智能电影的涌现属性。乔治亚理工大学交互计算学院教授马克·里德尔(Mark Riedl)在《人工智能故事生成导论》(An Introduction to AI Story Generation)一文中解释了如何从“非机器学习型”的叙事系统到“基于机器学习”(尤其是其中的神经网络阶段)叙事系统的转向[12]。

一方面,所谓的“自动事件”并不是利用AIGC 生成剧本的逻辑,而是不依赖于预先设计的剧本或情节,由角色行为和互动产生的电影剧情的涌现方法。在伦敦科幻电影节上映的电影《Sunspring》是一部由AI 编剧本杰明(Benjamin)撰写,并由真人参与表演的作品。该片使用了ChatGPT 来根据一些关键词生成剧本,讲述了一个发生在未来失业横行的世界里,三个年轻人之间复杂而诡异的爱情故事。尽管剧本所写的每个句子都很完整,但是组合起来就显示出逻辑的混乱。

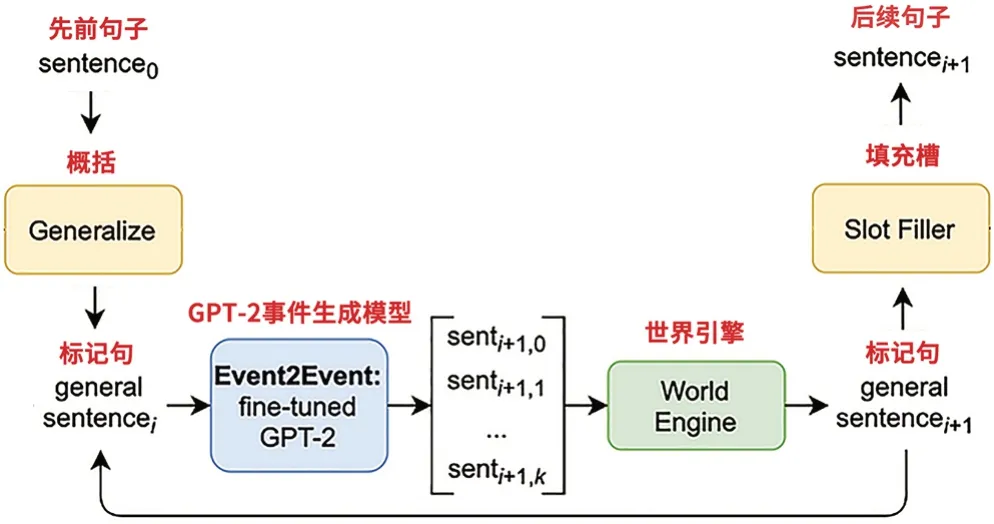

另一方面,“自动事件”也不是全要素生成电影叙事,而是在既定的逻辑框架下,探索AIGC 电影可能性的一种策略。正如马里兰大学计算机科学专业助理教授劳拉·马丁(Lara Martin)等人建议采用GPT-2神经语言大模型(目前已发展到GPT-4),并使用因果关系的推理来约束自动化事件生成[13]。如图4 所示,GPT 作为大语言模型(LLM),可以根据先前单词符号的历史,概率性地生成故事的后续。马丁的系统会解析生成的后续,并使用VerbNet 来推断读者对该句子的前提条件和影响会有什么认识。如果后续句子的前提条件没有得到故事中先前句子影响的支持,那后续句子就被拒绝。如果前提条件得到支持,那么该句子所产生的影响,就会更新一套描述世界的类似逻辑化的命题。这些命题之所以从VerbNet中提取,正是因为它们是基于读者从阅读句子中可以推断出的内容,可以被认为是一个简单的读者模型(Reader Models)。通过追踪这个假设性的读者模型,这个系统就不太会再以对读者没有意义的方式,从一个事件过渡到另一个事件。④

图4 劳拉·马丁所提出的神经符号性故事生成系统架构⑤

正如中国电影家协会副主席、中国电影导演协会副会长尹力在演讲中所说的,“科技给电影插上翅膀,但无论如何,记录时代、反映现实,表达普通人的情感,永远是电影的希望所在”[14]。因此,以动态故事文本、交互人物对话为特点的自动化事件并不再是一种符号化故事,而是一种经过良好组织的数据库故事,尤其依赖于作者之前对于电影情节叙事这一系统的先验理解与认知。

4 总结与展望

从Runway 举办AI 电影节,到翠贝卡电影节开始关注AI 电影单元,人工智能电影在生成式AI技术加持下呈现出新的创作视野。本文旨在从更广阔的技术发展角度着手,提出虚拟现实媒介是人工智能电影的适用媒介之一,并提出了以风格化驱动的空间生成策略、以代理性驱动的智能角色策略、以涌现性驱动的自动事件策略,为AIGC 技术视野下人工智能电影的应用逻辑提出新的创作可能性。

面向未来,如何针对AIGC 大模型进行基于特定内容域的“微调”,成为AIGC 电影走入深度叙事的先决条件,也是提升AIGC 电影准确度与艺术性的重要前提。人工智能电影必将逐步解决叙事节奏的随机性及缺乏人类独特的生物性情感构建等显性问题,并在AIGC 的多模态工具支持下,呈现出更加多样化的创作逻辑及应用策略。

注释

①图片来源:https://blog. goodaudience. com/cnn-for-rnns-agentle-approach-to-use-cnns-for-nlp-53ab80768d43。

②图片来源:https://www.bilibili.com/video/BV1NW4y1b7HC/?vd_source=360a6591c70d54f3a901ee39a996b84c。

③图片来源:http://jakeoleson.com/given-again。

④相关的中文翻译参见https://mp. weixin. qq. com/s/TJc-GIe7c2MX9JxHxK9r1Lw。

⑤图片来源:https://www.psyxel.com/mark-riedl-intro-ai-storygeneration/。