基于轻量级语义信息融合的动作识别方法

束 阳,李汪根,高 坤,王志格,葛英奎

(安徽师范大学 计算机与信息学院,安徽 芜湖 241002)

0 引 言

近些年来,动作识别在计算机视觉领域上扮演着愈来愈重要的角色,充满了挑战性和吸引性。目前,动作识别在视频监控、人机交互、体育运动[1-2]等领域都有着远大的前景。传统的基于RGB[3]图像的动作识别容易受到各种因素的干扰:如光暗程度、摄像机角度和人体自身遮挡或其他遮挡等,往往会造成关键信息的丢失。而当前主流的基于人体骨骼数据的动作识别方法[4-5]仅仅关注关节的坐标位置信息,不受这些因素的干扰,因而在动态变化的复杂环境中具有良好的适应性、鲁棒性和稳定性。而且,基于人体骨架数据的动作识别计算量远小于RGB图像,这使其应用在灵活的移动设备上成为可能,具有广大的应用前景。

早期的用于人体骨架的建模,如递归神经网络[6](Recurrent Neural Network,RNN)和卷积神经网络[7](Convolutional Neural Network,CNN)等。这些模型可以同时提取人体关节之间的时空信息,却不能表现非欧式空间下关节间的图形关系,不适用于探索重要关节之间的相关性,导致训练网络时大量动作信息丢失。并且,基于RNN的方法需包含大量的计算参数,效率低。

随着图卷积网络(Graph Convolution Network,GCN)[8]的出现,研究人员发现,基于GCN的模型比其他模型具有更好的性能。Yan等人[9]首先提出时空图卷积神经网络(Spatial Temporal Graph Convolutional Networks,ST-GCN),骨架数据表示为图形数据,自然骨架连接用于构建每个骨架图的邻接矩阵。Shi等人[10]认为不同的关节之间也具有相关性,固定的图形拓扑结构会限制模型的性能,因此提出双流自适应图卷积神经网络(Two-Stream Adaptive Graph Convolutional Networks,2s-AGCN),其中引入了自我注意系数和自我学习的图形残差掩码来捕捉不同关节之间的关系。同时,添加骨骼流以提高2s-AGCN的性能。在此基础上,Sun等人[11]提出基于骨架动作识别的多流快慢图卷积网络(Multi-stream slowFast graph convolutional networks for skeleton-based action recognition,MSSF-GCN),其中除了关节的坐标信息外,还引入了五个高阶序列,包括骨骼边、关节和骨骼边的空间差异和时间差异,以增强人类行为的表示。Fang等人[12]认为平等的对待骨架的每一帧需要一个大规模GCN模型来建模,这会造成大量的冗余信息,因此提出基于骨架动作识别的时空慢快速图卷积网络(STSF-GCN),STSF-GCN包含快速路径和慢速路径,可以有效地捕获长程和短程时空联合关系,以更低的计算成本实现更先进的性能。多流网络虽然动作分析的准确度较高,但由于参数量过高和计算量过大,导致其不易在移动设备上应用。

早期,在机器翻译和图像识别等领域,Ashish等人[13]和Zheng等人[14]已经利用了与语义相关的显式探索。他们分别对序列中标记的位置进行编码和将组索引编码为卷积信道表示,借此来保留任务中的时序信息。最近,Zhang等人[15]提出了语义引导的神经网络(semantics-guided neural networks for efficient skeleton-based human action recognition ,SGN),在GCN模型中显性地添加了骨骼关节和帧索引的语义信息,以保留空间身体结构的重要信息和动作在时间上的连贯性,对模型性能的提升起到很大的作用。Jing等人[16]提出了一种轻量级多信息图卷积神经网络(LMI-GCN)。引入由语义信息(关节类型和帧索引)拼接成的自适应图,来聚合重要关节特征,并且提出一种分流设计的时间卷积块来降低模型参数量和计算量,然而却没有充分地利用语义信息。网络参数量较高,导致不适合应用于实际场景。

针对以上问题,该文以LMI-GCN为基线,通过多信息输入模块提取骨架重要数据信息,并提出能充分利用语义信息来提取骨骼关节特征的图卷积模块。而且,网络模型中的自注意力时间模块在提升模型性能的同时减少了参数量,总体来说,LSIF-GCN比文献[16]模型复杂度更小,识别精度更高,模型效率更强。

主要贡献如下:(1)提出一种高效的基于轻量级语义信息融合的人类骨骼动作识别方法(LSIF-GCN);(2)提出的“瓶颈型”的图卷积模块,充分利用了语义信息以提高模型性能;(3)针对基线中的分流时间卷积块,引入了压缩和激励(SE)模块[17]并且使用再分组的方法,使模型更小,识别精度更高;(4)在目前流行的NTU-RGB+D60[18]和NTU-RGB+D120[19]大规模数据集上进行多次实验证明LSIF-GCN是一种高效的轻量级方法。

1 模型结构

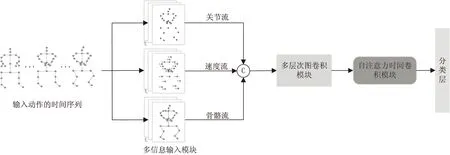

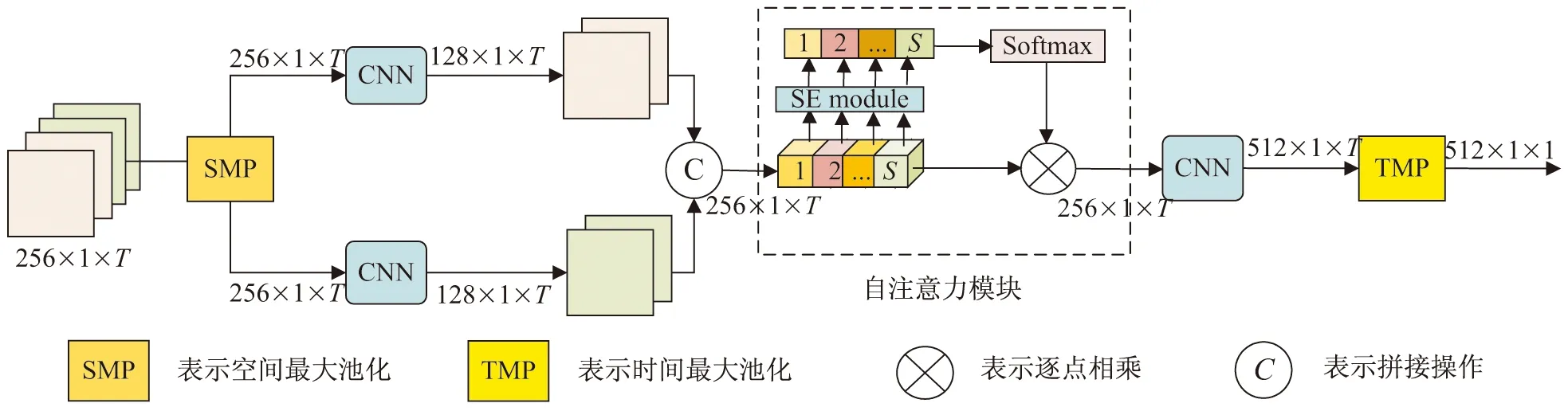

该文提出一种多层次高级语义融合的骨骼动作识别模型,网络的整体结构如图1所示。网络模型整体结构由三部分组成,分别是多信息输入模块、图卷积模块和自注意力时间卷积模块。

图1 LSIF-GCN整体模型框架

1.1 多信息输入模块

根据先前的研究[20-21]表示,骨骼边信息对基于人体骨架的动作识别至关重要。该文在数据预处理阶段提取了六种输入序列信息,分别是关节位置信息、关节相对位置信息、关节速度信息、骨骼边信息、骨骼边速度信息和骨骼边加速度信息。

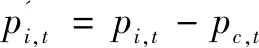

假设Gt(V,E)表示第t帧的人体骨架图,其中V表示所有关节点的集合,E表示所有骨骼边的集合。可以从原始骨架坐标获得关节数据,表示为:

pi,t=(xi,t,yi,t,zi,t)∈3

(1)

式中,i=1,2,…,N,t=1,2,…,T。pi,t表示第t帧中关节i的3D坐标位置,N是关节点总数量,T是骨骼序列帧的总数。

关节相对位置可以通过从其他关节的坐标减去中心关节的坐标得出。对于不同的应用场景和不同任务,中心关节可以进行调整。如果更多关注集中在手上的动作细节,如手势识别,可以将中心关节设定为指关节或腕关节。考虑到该文关注的是对人体各种动作的识别,因此,将动作序列的脊椎上部和下部,以及手掌腕部三个关节点确定为中心关节,捕捉相似动作之间的细微差别,如式(2)所示。

(2)

其中,pc,t表示的是中心关节点。骨骼边指的是人体骨架各个关节点之间的自然连接拓扑图,是有大小和方向的向量,在人体骨骼动作识别中起着重要的作用。把远离中心关节的关节点称为目标关节点,把靠近中心关节的关节点称为源关节点。可以表示为:

ei,t=pi,t-ps,t

(3)

其中,ei,t表示骨骼边信息,ps,t表示源关节点。为了更好地了解关节和骨骼的变化信息,提升模型的性能,引入了速度信息和加速度信息。速度信息指相邻帧之间的关节坐标位置和骨骼边位置的变化,加速度信息表示骨骼速度在相邻帧之间的差值,如式(4)所示。相邻帧之间时间差值为1,由于时间是线性的,所以帧差的数量会少一个,为此,该文在速度和加速度信息的第一帧中添加一个值为0的向量。

(4)

式中,v表示关节速度信息,v'表示骨骼边的速度信息。a表示骨骼边的加速度信息。

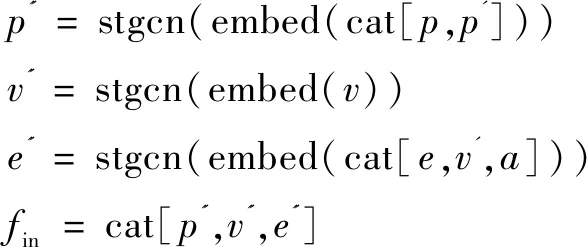

文献[16]对输入信息的处理是将四种信息均先编码到高维空间后再进行相加融合,一定程度上减少了模型的参数量和计算成本,但是相加融合会使一部分信息丢失。因此,该文先在低维空间中对输入信息进行通道维度的拼接融合,再编码到高维空间,通过文献[21]提出的stgcn模块对输入数据进行特征提取和降维。最后,将三种输入数据进行拼接融合,作为图卷积模块的输入。经过数据预处理后的输入特征主要分三类:(1)关节流;(2)速度流;(3)骨骼流。

(5)

式中,p''表示关节流,v''表示速度流,e''表示骨骼流。fin表示下一层的输入,cat表示拼接操作,embed是编码操作,由两个1×1的卷积组成,达到升维的目的。stgcn是图卷积操作,如式(6)所示。

(6)

1.2 图卷积模块

在之前的工作中[15,22-23],已经证实将高级骨骼关节的语义信息引入到图卷积中,对模型性能的提高起到显著的作用。早期工作[15,23]是简单的把语义信息与输入信息进行融合,然而随着图卷积层的深入,某些重要的语义信息会丢失,模型的效率也会下降。

针对这一问题,文献[16]提出了一种简单的自适应图G。图G是网络训练数据过程中自动学习而来,可以聚合不同通道权重的关节特征。然而,图G聚合的通道有所单一,语义信息优势不能完全表现出来。

因此,该文提出一种“瓶颈型”结构的四层图卷积模块,前两层图卷积提取特征并降维,后两层图卷积在提取特征的同时进行升维。“瓶颈型”的四层图卷积结构不仅比基线方法[16]提出的三层图卷积的参数量低,模型性能也好。

如图2所示,为了匹配四层图卷积,充分利用语义信息,该文提出一种新的多通道自适应图G。图G使用了四层卷积进行学习,利用卷积核参数的自动学习机制,可以根据模型训练过程中输入数据的变化不断自适应调整,如式(7)所示:

(7)

其中,sp和st分别指的是关节类型和帧索引语义信息,cat指的是通道拼接操作。Gj是训练不同通道的学习图,j=1,2,3,4。conv是1×1的卷积。通过多层卷积操作得到图Gj后,再将其输入到图卷积中。

fout=σ(conv(fin⊗Gj)+conv(fin))

(8)

如式(8)所示,fin和fout分别为图卷积的输入和输出,⊗表示矩阵相乘,σ为Relu激活函数,conv为1×1的卷积,具有不同的训练权重。

1.3 自注意力时间卷积模块

众所周知,分组卷积可以减少卷积操作的参数量,但缺陷却是不同组的特征图之间不能进行通信,这会降低网络的特征提取能力。受文献[24]的启发,该文提出了一个自注意力时间卷积模块,如图3所示。

图3 自注意力时间卷积模块

在时间卷积模块中,首先对输入信息最大池化以聚合关节空间信息,再将信息在通道维度上分成多组,每一组使用的卷积核依次增大,如卷积核大小为1×1,1×3,以获取不同尺度的感受野,提取不相邻帧之间的特征信息。考虑到使用大卷积核所产生的参数量和计算量也会随之增大,因此,对每一组再次进行分组卷积,如卷积核为1×3时,分组数量为2,在经过不同大小的卷积后,在通道上进行拼接。然后,通过SE注意力模块对每组的通道的权重值进行提取,对每组的权重值进行Softmax归一化并加权,再将这些组进行拼接。自注意力模块的结构如图3虚线框所示。

最后,在经过一个1×1卷积进行特征提取和通道升维后,通过时间的最大池化聚合全局帧特征。

2 实 验

2.1 数据集

NTU RGB+D 60数据集[18]:NTU 60是当前主流的基于骨架动作识别的数据集之一,包含从40个不同的主题和3个Microsoft Kinect V2深度摄像头同时捕获的60个动作类别的56 880个骨架序列。每个骨架序列包含25个关节的三维空间坐标。该数据集提供了两个评估基准:交叉主题(Cross-Subject,CS)和交叉视角(Cross-View,CV)。CS由40名受试者完成动作,其中一半受试者用于培训,其余用于测试。CV选择摄像机2和3捕获的样本进行训练,其余用于测试。

NTU-RGB+D 120数据集[19]:NTU 120是一种大型室内捕捉的3D人体动作识别的公共数据集。该数据集是NTU RGB+D 60数据集在动作类别和演员人数上的拓展,包含106名演员参与的114 480个动作视频。该数据集共有120个动作类别,包括82种日常生活,12种医疗条件和26种两人互动情况下的动作。该数据集有两个评估基准:交叉主题(Cross-s-Setup,SS)。CS根据视频中的不同演员将此数据集划分为训练集(63 026个视频)和验证集(50 919个视频)。SS是根据视频编号奇偶来划分数据集。54 468个偶数视频作为训练集,59 477个奇数视频作为测试集。

2.2 实验细节

在多信息输入阶段,将三类信息流在通道维度上编码到64维,通过公式(5)降到48维后进行拼接,拼接得到的通道维数为144。在图卷积模块中,每层图卷积的输入维数分别为144、128、64和128,最终输出维度为256。对于空间和时间语义信息,本文对它们拼接后形成的自适应图G进行升维,维度大小与每层图卷积的输入维度相同。值得注意的是,最终输出数据与图G通过相加融合后输入自注意力时间卷积模块。关于时间卷积的过程,已在1.3节中详细阐述。最后,使用全连接层与Softmax进行输出,输出维度是对应的数据集类别数。

将模型中epoch的数量设置为120,将一个epoch的批量大小设置为64,初始学习率设置为0.001,并在迭代过程中不断减小。当迭代次数为80、100时,学习率下降十倍。同时,也使用Adam对模型进行优化,其中权重衰减为0.000 1。交叉熵损失用于训练网络。该文帧索引取值为25,实验取3次测试的最佳结果,以对比其他模型的最佳结果。

实验环境配置:处理器为Intel i5-10400F,内存为32G,显卡为单块NVIDIA RTX 3060ti,操作系统为Ubuntu 20.04,编程语言为Python 3.8,开发环境是Cuda 11.3和Pytorch 1.7。

2.3 实验结果与分析

目前大多数主流方法使用的是多流多信息融合的输入方式,这导致模型参数量成倍增长,模型变得更为复杂。因此,在引入多信息的同时,该文尝试通过在通道维度上进行拼接来最小化参数量。

表1显示的是不同的输入信息流对模型性能的影响,其中joint表示关节流,velocity表示速度流,bone表示骨骼流。通过表1的实验结果验证得到以下两点结论:一是使用三流融合输入在CS和SS上的识别精度高于双流融合输入和单流的信息输入;二是对比多流网络[10,21]参数量成倍增长,所提信息融合方法在仅仅增加了约1/7的参数量和不足1/2的GFLOPs情况下,大幅度提升了模型的性能。GFLOPs表示推理一个样本所需的浮点运算量,单位为十亿次。

表1 LSIF-GCN在NTU 120两种评估方式上的对比

在表2中,w/o stgcn表示在多信息输入模块中没有使用stgcn模块,w/o G表示在多层次卷积模块中没有使用多通道的自适应图。表2实验结果表明,如果不使用stgcn,模型在CS和SS基准上的准确度会分别下降0.5百分点和0.4百分点。如果不使用多通道的自适应图G,模型准确度会分别下降2.4百分点和2.3百分点。原因是分别消去stgcn和G后,原来的图卷积就变成了普通的卷积,模型聚合不同关节特征之间的能力就会变弱,从而导致模型在NTU 120数据集两种基准上的准确度也随之下降。

表2 NTU 120上stgcn模块和多通道自适应图的有效性对比

表3显示在“瓶颈型”图卷积模块中,探究不同层数的图卷积操作对模型性能的影响。其中,LSIF-GCN(three)表示LSIF-GCN使用三层图卷积,每层的输出通道数分别是128、64、256。LSIF-GCN(five)表示模型使用五层图卷积,每层的输出通道数分别是128、64、128、144和256。该文采用的是四层图卷积结构,每层的输出通道分别为128、64、128和256。实验结果表明,使用四层图卷积时,模型能更充分利用语义信息,效果更好。

表3 在NTU 120上不同图卷积层数对模型性能的影响

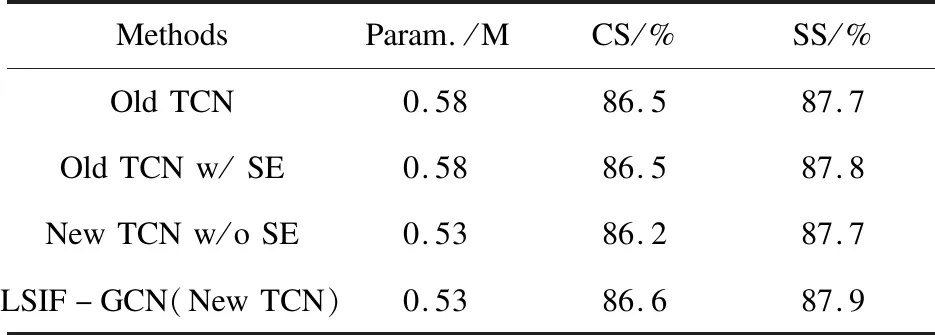

如表4所示,对比于基线模型[16]的时间卷积模块,所提模型在CS和SS基准上分别高出0.1百分点和0.2百分点,模型参数量也低于基线模型。其原因有以下两点:一是将原来分组后的通道再次分组可以降低模型参数量,而在参数量较少的情况下,分组卷积相当于正则化操作,从而防止模型出现过拟合;二是注意力模块能自动学习不同通道特征的重要程度,增强特征提取能力,从而提高模型性能。其中,Old TCN表示文献[16]使用的时间卷积网络,Old TCN w/ SE表示在该方法的基础上引入了SE注意力模块。New TCN表示该文使用的时间卷积网络,New TCN w/o SE表示在时间卷积上只使用再分组的方法,而不引用SE注意力模块。

表4 在NTU 120上时间卷积模块和注意力模块有效性对比

图4显示LSIF-GCN和SGN[15]以及LMI-GCN[16]两种模型在NTU 120数据集CS基准上的收敛情况对比。为了公平对比,三种模型的超参数设置和数据预处理方法均保持一致。从图中可以得出结论,所提模型的收敛速度和收敛程度均优于另外两种模型。

图4 在NTU 120数据集CS评估中收敛性的对比

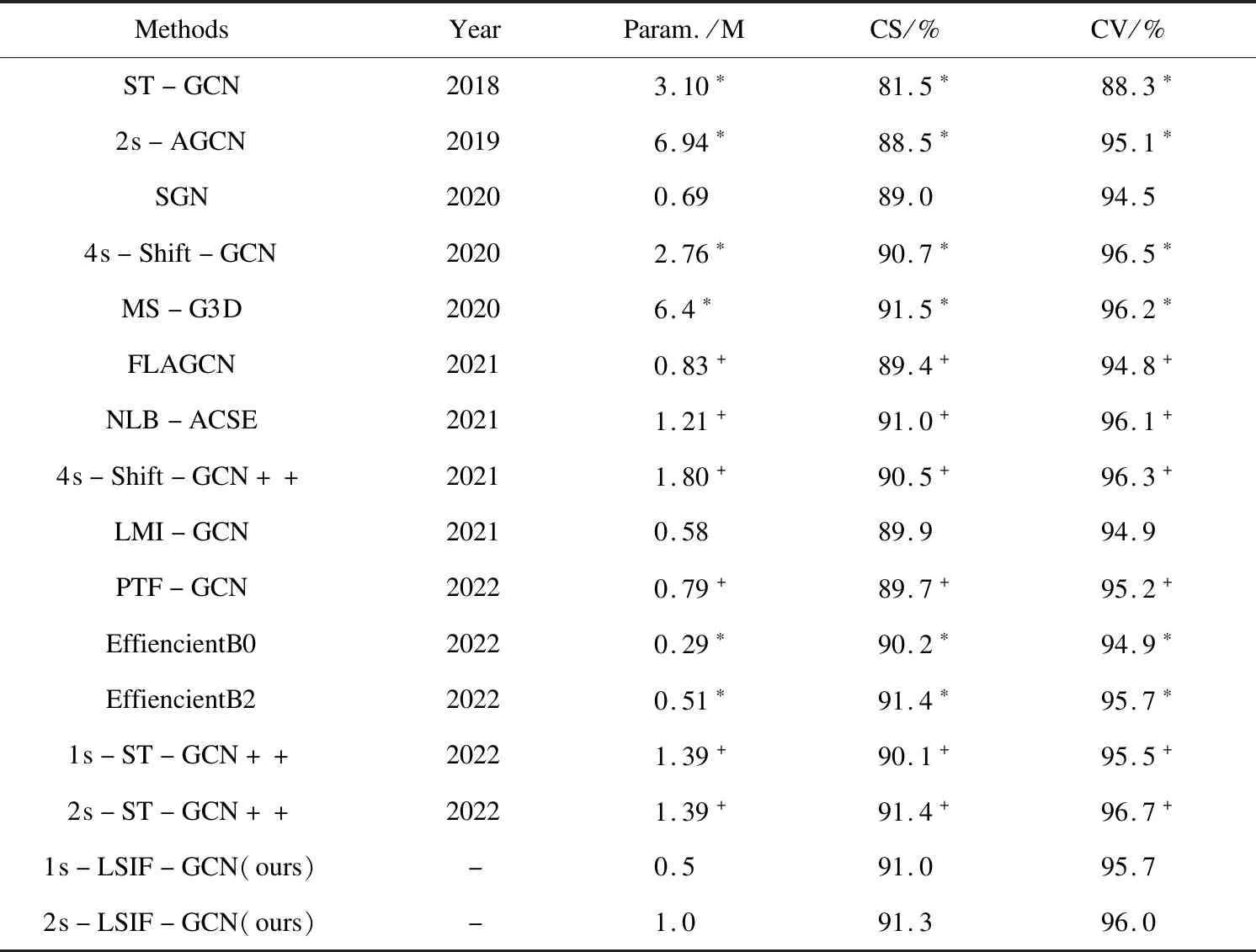

在NTU RGB+D 60数据集的CS和CV基准上,与最近一些主流的方法[9-10,15-16,21-29]进行了比较。从表5可以看出,LSIF-GCN在两种基准上的最佳性能分别是91.0%和95.7%。表中有三种典型的方法值得注意。第一,对比于目前最为流行的基于骨骼的动作识别基线模型ST-GCN[9],单流网络1s-LSIF-GCN在CS和CV基准上分别高出9.5百分点和7.4百分点。第二,2020年的SOTA方法MS-G3D[25],在CS和CV评估基准上的识别准确度比1s-LSIF-GCN 均高出0.5百分点,而参数量却是文中的13倍。第三,EffiencientB0[21]和EffiencientB2[21]是目前使用图卷积的轻量级SOTA方法。单流网络1s-LSIF-GCN参数量比EffiencientB0高,但在两种基准上的准确度均高出EffiencientB0模型0.8百分点。对比于EffiencientB2方法,双流网络2s-LSIF-GCN在CS基准上低0.1百分点,而CV的识别精度高出0.3百分点。

表5 在NTU 60上与一些主流方法的比较

为了验证所提模型的性能,在NTU-RGB+D 120数据集的CS和SS基准上比较了LSIF-GCN与最近几年的SOTA方法在准确性、模型参数量和GFLOPs上的效率。表6实验结果显示,第一个基于骨架动作识别的图卷积模型ST-GCN的模型参数量和GFLOPs分别是单流网络1s-LSIF-GCN的5.84倍和20.92倍。在模型参数量方面,1s-LSIF-GCN仅低于EffiencientB0,但在SS识别精度上却高出2.9百分点。而对比于所有模型的GFLOPs,除了SGN[15]与1s-LSIF-GCN相当外,其余模型均远高于文中方法,而在CS和SS评估基准上,该文比SGN分别高出7.4百分点和6.4百分点。在多流网络(2s-AGCN[10]、4s-Shift-GCN[26]、4s-Shift-GCN++[27]、2s-ST-GCN++[28])中,双流网络2s-LSIF-GCN的模型参数量和GFLOPs也达到了最低,SS识别精度也仅比2s-ST-GCN++低 0.6百分点。总体来说,文中方法在识别精度和模型复杂度(参数量和GFLOPs)上,达到了先进的水平,相比于大多数的SOTA方法,更适用于资源有限的移动设备和实际应用场景。

表6 在NTU-RGB+D 120数据集上与SOTA方法的准确度、参数量和GFLOPs的比较

3 结束语

针对传统的动作识别模型参数量较高和计算成本较大的问题,通过通道维度上的拼接操作将多种输入信息进行融合,避免了各种特征之间的相互干扰,提高了特征的利用率,同时提出了一种能够充分利用语义信息的“瓶颈型”的四层图卷积模块,并且将激励和压缩(SE)模块融入到时间卷积模块中,通过再分组的方法,提高模型效率的同时降低了模型的参数量。最后,在目前主流的动作识别数据集的实验结果表明,该模型在计算成本、模型参数量和识别精度上,与其他的主流方法对比,具有一定的优越性。

在未来工作中,笔者将针对特定场景更加注重细微动作间的区分,如手势识别,将该方法应用于特定场景中。