基于深度学习的林地澳洲坚果检测识别

罗鑫 王艳艳 刘学渊 李加强 杨汉蛟 何超

摘要:为实现对林地澳洲坚果的准确检测,以园林环境下的澳洲坚果为研究对象,提出一种基于深度学习的检测模型。在Faster R-CNN基础上搭建检测模型,对比VGG16、Resnet-50、Resnet-101等多种主干网络的特征提取性能,在Resnet-50网络的基础上构建特征金字塔网络(Feature Pyramid Network, FPN)结构,并使用双线性插值ROI Align替换原来的ROI Pooling池化,提高模型对小尺寸物体的检测效果。结果表明,改进的Faster R-CNN模型能有效检测出复杂场景中的林地澳洲坚果目标,其检测精度达到98.89%,相比原始方法提高6.56 %,与SSD、YOLO v3等目标检测算法相比有明显的精度优势。该研究充分表明该模型对园林下的澳洲坚果有良好的检测效果,且具有检测精度高、鲁棒性强的优点。

关键词:澳洲坚果;目标检测;深度学习;Faster R-CNN;特征金字塔网络

中图分类号:S776.01文献標识码:A文章编号:1006-8023(2023)02-0113-08

Macadamia integrifolia Detection and Recognition in

Orchards Based on Deep Learning

LUO Xin1, WANG Yanyan1, LIU Xueyuan1, LI Jiaqiang1, YANG Hanjiao2, HE Chao1,2*

(1.School of Machinery and Transportation, Southwest Forestry University, Kunming 650224, China;

2.Dehong Vocational College, Dehong 678400, China)

Abstract:For accurate detection of Macadamia integrifolia in orchards, this paper proposed a deep learning-based detection model and took Macadamia integrifolia in the orchard as the research object. The detection model was built based on the Faster R-CNN algorithm, and the feature extraction performance of various backbone networks such as VGG16, Resnet-50 and Resnet-101 was compared. The Feature Pyramid Network (FPN) structure was constructed based on Resnet-50 and the original ROI Pooling was replaced by the ROI Align method, which effectively improved the detection performance of the model for small-sized objects. The results showed that the improved Faster R-CNN model could effectively detect the Macadamia integrifolia in complex scenes with a detection accuracy of 98.89%, an improvement of 6.56 % compared to the original method, and a significant accuracy advantage over other detection methods such as SSD and YOLO v3. It showed that the proposed model was good for detecting Macadamia integrifolia in orchards with high accuracy and strong robustness.

Keywords:Macadamia integrifolia; object detection; deep learning; Faster R-CNN; Feature Pyramid Network

收稿日期:2022-08-07

基金项目:国家自然科学基金项目(51968065);云南省教育厅科学研究基金项目(2022Y571);云南省高层次人才培养支持基金项目(YNWR-QNBJ-2018-066, YNQR-CYRC-2019-001)

第一作者简介:罗鑫,硕士研究生。研究方向为林果目标检测。E-mail:luox9707@163.com

*通信作者:何超,博士,教授。研究方向为机器视觉、新能源汽车。E-mail:hcsmile@163.com

引文格式:罗鑫,王艳艳,刘学渊,等.基于深度学习的林地澳洲坚果检测识别[J].森林工程,2023,39(2):113-120.

LUO X, WANG Y Y, LIU X Y, et al. Macadamia integrifolia detection and recognition in orchards based on deep learning[J]. Forest Engineering, 2023,39(2):113-120.

0引言

澳洲坚果(Macadamia integrifolia)是经济价值较高的食用干果之一,在我国云南、广西等地广泛种植[1];截至2020年,云南澳洲坚果种植面积超26.6万hm2,种植面积位居世界第一[2]。及时、高效地采收是确保澳洲坚果产品质量的关键。澳洲坚果成熟后自然掉落,需要迅速收集并烘干保存,以防产生霉变[3-4]。现阶段的澳洲坚果采收仍然依赖于大量的人工,随着种植面积不断扩大,人工采收的成本将越来越高,果农也将面临更高强度的采收劳动作业。

农林机械和自动化技术是提高生产力和产品质量的有效方法,可以有效缓解季节性的劳动力短缺,也是现代农林业的发展趋势[5]。目标检测技术作为实现自动化采收的关键技术,主要分为基于特征算子的传统图像处理方法和基于卷积神经网络(CNN)的深度学习方法。园林环境中的光照条件、遮挡状况和复杂背景等因素会严重影响检测效果,这也是传统图像处理方法难以克服的问题[6]。近年来,随着以卷积神经网络为主的深度学习方法的应用,目标检测性能得到显著提高[7-9]。

目前已有许多国内外学者利用深度学习算法进行农林产物的目标检测研究。在目标检测领域常用的深度学习方法主要包括以YOLO算法为代表的一阶段检测算法和以Faster R-CNN算法为代表的两阶段检测算法。Suo等 [10]利用YOLO v3、YOLO v4算法实现对猕猴桃的检测识别,检测精度分别为91.1%、91.9%,对单幅图像的检测耗时分别为21.7、25.5 ms,YOLOv4的检测精度较高,但是对单幅图像的检测耗时明显增加,二者的检测性能较为接近。Zhang等 [11]采集了大量的大豆叶部病害图像并建立大豆叶病害检测数据集,使用Faster R-CNN算法实现了大豆叶部病害的检测识别,对细菌性斑点病等常见叶部病害的平均检测精度达到83.34%,但对于复杂场景下的叶部病害检测效果不好。Parvathi等 [12]利用Faster R-CNN检测椰果的成熟程度,对比多种深度学习检测方法,Faster R-CNN达到89.4%的最高检测精度,试验表明Faster R-CNN适用于椰果的成熟度检测,对复杂背景下的小尺度个体也有较强的检测能力。樊湘鹏等[13]以VGG16作为Faster R-CNN的主干网络,并在卷积层加入批归一化处理对原算法进行改进,实现了园林环境下的青皮核桃的检测识别,检测精度达到91.25%,但是没有与其他算法进行对比,缺乏客观全面的性能分析。

基于深度学习的目标检测技术在农林领域已有广泛应用,但是针对澳洲坚果检测识别的相关研究较少,也缺少用于澳洲坚果检测的图像数据集。因此,本研究以云南德宏地区为主要研究区域,采集大量的林地澳洲坚果图像并制作目标检测数据集,基于深度学习方法搭建目标检测模型,实现了园林环境中的澳洲坚果检测,为坚果自动化采收提供目标检测技术支持。

1材料与方法

1.1研究区域

本研究为实现澳洲坚果的检测识别,采集了云南部分地区的坚果图像,建立了澳洲坚果目标检测图像数据集。研究区域主要为云南德宏芒市地区(97°31′~ 98°43′E, 23°50′~25°20′N),是云南省澳洲坚果主要种植区之一。澳洲堅果在温度为20~25 ℃、年降水量不少于1 000 mm和海拔800~1 200 m的地方生长,产量最高[14];德宏州境内多数地区的海拔为800~1 300 m,年均气温18.4~20.3 ℃,年降水量1 436~1 709 mm,地形以山地为主,光照充足,是比较理想的澳洲坚果种植地[15]。先后选取了帕底(海拔800 m,山地陡坡为主)、遮放(海拔880 m,山地缓坡为主)、三台山(海拔1 200 m,山地缓坡为主)等地区的澳洲坚果种植园进行数据采集,区域内的树种主要包含O.C(Own Choice)、农试344(Kau)、A16(Hidden Valley A16)等,树龄为8~12年,是比较有代表性的澳洲坚果种植区域。

1.2图像数据集

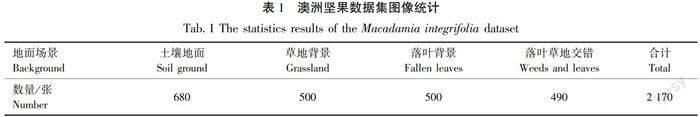

图像采集在2021年7—9月进行,在自然光照条件下,选择晴天、阴天和雨天等不同天气状况,于9:00—12:00、14:00—18:00进行图像采集。拍摄时,相机距离澳洲坚果0.5~1.0 m,离地距离在1.0~1.5 m,相机与水平方向的夹角为45°~90°,在多个方向进行拍摄采集,最终得到2 170幅图像,图像分辨率处理为768×576(保持宽高比4∶3不变),数据集样本统计结果见表1,部分图像如图1所示。

1.3数据处理与数据增强

利用LabelImg图像标注软件对数据集进行标注,按照PASCAL VOC2007格式储存标注信息,并按照8∶1∶1的比例将数据集划分为训练集、验证集和测试集。

卷积神经网络需要大量的图像数据才能有效地提取出待检测物的图像特征[16]。使用数据增强方法能有效扩充图像数据集,避免过拟合问题,提高检测模型的泛化能力[17],因此,本研究使用了几何变换、颜色调整等数据增强方法对图像数据进行扩充,图像增强效果如图2所示,扩充后的数据集共包含17 360幅图像。

1.4Faster R-CNN检测算法及其改进

Faster R-CNN[18]是一种典型的端到端的二阶段目标检测方法,主要分为候选区域生成阶段和目标检测阶段。Faster R-CNN检测模型结构如图3所示,输入图像经过主干网络提取特征信息并生成特征图,候选区域生成网络以特征图作为输入,使用一系列固定尺寸的先验框在特征图上进行区域搜索,初步判断先验框内是否存在目标物并得到待检测物的相对位置,对先验框进行筛选得到若干候选框并将其映射回特征图;候选框在特征图上的对应区域为感兴趣区域(Region of Interests, ROIs),通过特征图池化将感兴趣区域ROIs缩放到统一尺寸并作为分类器的输入,使用softmax分类函数判定区域内物体的所属类别,并使用逻辑回归函数得出物体的准确位置,最终得出检测结果。

澳洲坚果个体在图像中的像素占比较小,这些小目标个体的特征模糊,易导致漏检;此外,园林地面环境较为复杂,有许多颜色、形状与澳洲坚果相近的干扰物,容易导致错误识别。为提高模型的检测识别精度,本研究对原始Faster R-CNN模型进行改进。

1.4.1构建特征金字塔网络结构

输入图像经过主干网络生成一系列的特征图。深层特征图有丰富的语义信息,但缺乏空间信息;浅层特征图的空间信息丰富,但语义信息较为缺乏[19]。在原始Faster R-CNN模型中只使用深层特征图进行目标检测,导致模型对澳洲坚果小目标个体的检测效果不佳。本研究在主干网络上构建特征金字塔网络结构 [20],将底层特征图和高层特征图进行特征融合以提高模型对小目标个体的检测能力。

FPN结构主要分为3个部分,如图4所示,左侧的主干网络部分用于提取不同尺度的特征图(C1、C2、C3、C4、C5),中间的横向连接部分主要用于统一特征图的尺度,便于进行特征图拼接,右侧的特征增强部分用于特征图融合,生成新的特征图(P2、P3、P4、P5、P6),作为后续的区域生成网络和分类器的输入;其中,conv1、conv2_x、…、conv5_x是主干网络Resnet-50的子模块,M2、M3、M4、M5是经过特征拼接得到的特征图,P2、P3、…、P6是提取得到的新特征图,RPN_P2、RPN_P3、…、RPN_P6指的是与P2、P3、…、P6对应的区域生成网络。

1.4.2ROI Align池化

为了提高模型的检测准确度,本研究使用ROIAlign替换原来的ROIpooling方法。原Faster R-CNN算法在池化过程使用的ROIpooling函数包含了2次量化取整操作,这导致候选框位置发生偏差,会影响目标物的定位精度,此外,量化取整导致浮点位置处的特征信息丢失,将影响检测精度[21]。ROIAlign利用双线性插值法进行池化运算,保留了浮点位置处的特征信息,避免了因量化取整而引起的候选框位置偏差,可以获得更加准确的目标检测效果。

2结果与分析

2.1试验环境及训练参数

本试验在ubuntu 18.04 LTS操作系统(64位)中运行,处理器(CPU)为Intel Core i7-9700@3.40 GHz,运行内存为64 GB;显卡(GPU)采用NVIDIA GeForce RTX 2080 SUPER,8 GB显存;编程语言使用Python3.8,采用Pytorch1.10开源深度学习框架,使用Anaconda3进行环境配置并安装了CUDA11.1.0运算构架和cuDNN8.0.5.39深度学习加速库。

使用基于VOC数据集的预训练权重进行模型训练,利用预训练权重对网络参数进行初始化,再利用本研究构建的澳洲坚果数据集对检测网络进行微调。使用带有动量参数的随机梯度下降法(SGD)对检测模型进行参数优化,动量Momentum=0.9,初始学习率为lr=0.005,每3个epoch进行一次学习率衰减,衰减倍率因子gamma=0.33,batch_size=4。

2.2模型评价指标

为了评价模型对澳洲坚果目标的检测识别效果,选取平均精度(Average Precision,AP,公式中用AP表示)作为模型检测精度的评价指标,通常用于表示某一个检测模型在特定数据集上的检测精度;选取单幅图像检测耗时作为模型检測速度的评价指标。模型的平均精度AP与精准度(Precision,公式中用Pre表示)、召回率(Recall,公式中用Re表示)有关,召回率反映了检测器对正样本的覆盖能力,精准度反映检测器预测正样本的精准度,计算公式如下。

Pre=TPTP+FP。(1)

Re=TPTP+FN。(2)

式中:TP为被正确地检测为坚果的正样本的数量;FP为被错误地检测为坚果的正样本的数量;FN为被正确地检测为其他物体的负样本的数量。

每个交并比(Intersection Over Union,IOU,公式中用Iou表示)阈值有对应的精准度和召回率,通过选取不同的Iou阈值,可绘制出模型的精准度-召回率曲线(P-R曲线)。交并比Iou的计算公式为

IOU=A(Bpred∩Btruth)A(Bpred∪Btruth)。(3)

式中:A为面积函数;Bpred为预测边界框;Btruth为真实边界框。

平均精度AP等于P-R曲线与横纵坐标轴之间围成的面积大小,计算公式为

AP=∫10Pre·Red(Re)。(4)

2.3结果与分析

2.3.1主干网络对模型性能的影响

不同的主干网络对输入图像的处理方式不一致。本研究从数据集中选取1 200张图片用于模型训练,目的是探究VGG16[22]、Resnet-50、Resnet-101[23]等不同主干网络对检测模型性能的影响,并作为改进Faster R-CNN模型的试验依据。

主干网络对Faster R-CNN模型的影响见表2,由表2可以看出,使用VGG16作为检测模型的主干网络时,其检测精度与Resnet网络相比无明显优势,而使用VGG16网络的检测耗时比Resnet网络高出近60%,这是因为VGG16网络中采用了大量的3×3卷积核并包含了3个全连接层,导致VGG网络参数较多,图像检测的耗时较长。与Resnet-50相比,Resnet-101网络的深度更深,模型参数较多,有更强的特征提取能力。然而,从表2的试验结果来看,两者的检测模型精度基本相同,但是Resnet-101的检测耗时明显增加。综合来看,使用Resnet-50作为模型的主干网络有较好的检测性能。

使用不同主干网络对同一图片进行检测,检测效果如图5所示,VGG16网络对环境中的干扰物体的区分辨别能力较弱,并存在明显的错误识别现象。由图5(a)可知,在第一行图片中,VGG16网络将地上的青色石块错误检测为坚果;在第二行图片中,VGG16网络将右上角的落叶错误检测为坚果。而Resnet-50和Resnet-101的检测效果较为接近,仅在检测结果的置信度方面有细微差异。通过对比多种主干网络对模型检测精度和检测时间的影响,并结合不同主干网络对澳洲坚果的实际检测效果,本研究最终选择Resnet50网络作为改进Faster R-CNN模型的主干网络。

2.3.2不同改進方式对模型性能的影响

为提高检测模型对林地澳洲坚果的检测能力,本研究在原始Faster R-CNN基础上进行了改进。在Resnet-50主干网络基础上构建特征金字塔网络结构,并将原来的ROI Pooling池化方式替换为采用双线性插值的ROI Align。由图6可知,2种改进方式对检测模型精度均有一定程度的提升。采用特征金字塔网络结构的检测模型有较高的检测精度,P-R曲线与坐标轴围成的面积最大;采用ROI Align池化的检测模型P-R曲线在原始Faster R-CNN之上,表明换用ROI Align对模型的检测精度也有一定提升。

不同改进方式对模型性能的影响见表3,原Faster R-CNN的检测精度为92.04%,构建FPN结构使检测精度提高了2.8 %;采用ROI Align替换原有的池化方式使检测精度提高了近1个百分点。在检测速度方面,2种改进方式均导致模型的检测时间有所增加,但依然保持较快的检测速度。通过实验对比可以看出,构建FPN结构和采用ROI Align池化有助于进一步提高检测模型的性能。

2.3.3改进Faster R-CNN模型的检测性能

对比了不用主干网络和不同改进方式对Faster R-CNN检测性能的影响,确定了以Resnet-50为最佳主干网络,在Resnet-50的基础上构造特征金字塔网络结构并用ROI Align替换原来的池化方式。在数据增强图像数据集上进行改进Faster R-CNN模型的训练,并与SSD[24]、YOLO v3[25]等检测模型进行性能对比。

交并比(IOU)代表预测结果与真实结果的重合度,在模型评估时选取的IOU数值越大对模型预测的准确度要求越高。由表4分析得出,在不同IOU值条件下,改进模型的检测精度均高于原始Faster R-CNN、SSD和YOLO v3等方法。当IOU=0.50时,改进模型的检测精度相对原始方法提升了6.85%,相对于SSD、YOLO v3等方法提高了8个百分点,在检测精度方面有明显的优势。由表5可以看出,改进Faster R-CNN模型对不同尺度物体的检测精度明显高于原始Faster R-CNN、SSD和YOLO v3等方法。相对于原始Faster R-CNN方法,改进模型对小目标物体(区域面积小于 322)的检测精度提高了15个百分点,对图像中的中、小型物体有更强的检测性能。

澳洲坚果体积小并且没有明显的外观特征,离镜头远的坚果目标的特征更加模糊,非常不利于检测识别,通过改进原始Faster R-CNN算法,提高了检测模型在复杂园林环境下的坚果检测能力。园林环境中的澳洲坚果检测效果如图7所示,从检测结果来看,改进后的Faster R-CNN模型对处在树荫、草地和落叶等复杂场景下的澳洲坚果均保持较好的检测效果,有良好的鲁棒性,有效地实现了复杂园林场景下的澳洲坚果物体检测识别。

3结论

目标检测技术是实现澳洲坚果自动化采收的关键技术,本研究以德宏芒市帕底、遮放和三台山等地区的澳洲坚果园林为研究区域,对不同海拔地区的多个品种、树龄的林地澳洲坚果进行图像数据采集,构建一个澳洲坚果目标检测数据集,并基于Faster R-CNN算法搭建目标检测模型实现林地澳洲坚果的检测识别。考虑到澳洲坚果个体尺寸较小、所处环境复杂等因素,对原始Faster R-CNN算法进行了改进。

1)为提高检测模型对澳洲坚果特征的提取能力,对比分析了VGG16、Resnet-50和Resnet-101等主干网络对模型检测性能的影响,并对比了不同主干网络的实际检测效果,选取Resnet-50作为改进模型的主干网络。

2)采用特征融合技术,在Resnet-50主干网络的基础上构建特征金字塔网络结构,将不同层级的特征图进行特征融合,提高了模型对小目标个体的检测能力。改进模型的检测精度达到98.89%,与原始FasterR-CNN、SSD和YOLO v3等方法相比分别提高了6.85%、8.39%、8.28%,有明显的精度优势。

3)采用ROI Align替换原来的ROI Pooling池化操作,保留了浮点位置处的特征信息,能获取更准确的目标检测结果。

试验结果表明,改进Faster R-CNN模型的检测精度及定位精度均有效提高。本研究所提方法有助于开发澳洲坚果自动化采收装备,为实现澳洲坚果自动化采收提供目标检测技术。

【参考文献】

[1]TU X H, WU B F, XIE Y, et al. A comprehensive study of raw and roasted macadamia nuts: Lipid profile, physicochemical, nutritional, and sensory properties[J]. Food Science & Nutrition, 2021, 9(3): 1688-1697.

[2]乔进超,卢娜,黎思琦,等.云南澳洲坚果产业可持续发展研究综述[J].南方农机,2021,52(14):38-40,50.

QIAO J C, LU N, LI S Q, et al. Review on sustainable development of Macadamia nut industry in Yunnan[J]. China Southern Agricultural Machinery, 2021, 52(14): 38-40, 50.

[3]WALTON D A, WALLACE H M. The effect of mechanical dehuskers on the quality of macadamia kernels when dehusking macadamia fruit at differing harvest moisture contents[J]. Scientia Horticulturae, 2015, 182: 119-123.

[4]TRUEMAN S J. The reproductive biology of macadamia[J]. Scientia Horticulturae, 2013, 150: 354-359.

[5]MARINOUDI V, SORENSEN C G, PEARSON S, et al. Robotics and labour in agriculture: a context consideration[J]. Biosystems Engineering, 2019, 184: 111-121.

[6]SALEEM M H, POTGIETER J, ARIF K M. Automation in agriculture by machine and deep learning techniques: a review of recent developments[J]. Precision Agriculture, 2021, 22(6): 2053-2091.

[7]LECUN Y, BENGIO Y, HINTON G. Deep learning[J]. Nature, 2015, 521(7553): 436-444.

[8]XU Y Y, LI D W, XIE Q, et al. Automatic defect detection and segmentation of tunnel surface using modified Mask R-CNN[J]. Measurement, 2021, 178: 109316.

[9]陈钦柱,姚冬,黄松.基于卷积神经网络和优化GoogleNet架构的监控视频火灾探测[J].自动化技术与应用,2021,40(9):124-129.

CHEN Q Z, YAO D, HUANG S. Fire detection of surveillance video based on convolutional neural network and optimized GoogleNet architecture[J]. Techniques of Automation and Applications, 2021, 40(9): 124-129.

[10]SUO R, GAO F F, ZHOU Z X, et al . Improved multi-classes kiwifruit detection in orchard to avoid collisions during robotic picking[J]. Computers and Electronics in Agriculture, 2021, 182: 106052.

[11] ZHANG K K, WU Q F, CHEN Y P. Detecting soybean leaf disease from synthetic image using multi-feature fusion faster R-CNN[J]. Computers and Electronics in Agriculture, 2021, 183: 106064.

[12]PARVATHI S, TAMIL SELVI S. Detection of maturity stages of coconuts in complex background using Faster R-CNN model[J]. Biosystems Engineering, 2021, 202: 119-132.

[13]樊湘鹏,许燕,周建平,等.基于改进卷积神经网络的在体青皮核桃检测方法[J].农业机械学报,2021,52(9):149-155,114.

FAN X P, XU Y, ZHOU J P, et al. Green walnut detection method based on improved convolutional neural network[J]. Transactions of the Chinese Society for Agricultural Machinery, 2021, 52(9): 149-155, 114.

[14]徐凡迪,白海东,樊绍光,等.澳洲堅果繁育系统研究进展[J].世界林业研究,2022,35(5):37-41.

XU F D, BAI H D, FAN S G, et al. Research advances in Macadamia breeding system[J]. World Forestry Research, 2022, 35(5): 37-41.

[15]蔡文良,冯岩晃,李富荣,等.德宏澳洲坚果幼树栽培技术[J].热带农业科学,2022,42(3):1-6.

CAI W L, FENG Y H, LI F R, et al. Cultivation of immature Macadamia trees in Dehong[J]. Chinese Journal of Tropical Agriculture, 2022, 42(3): 1-6.

[16]闫建伟,赵源,张乐伟,等.改进Faster-RCNN自然环境下识别刺梨果实[J].农业工程学报,2019,35(18):143-150.

YAN J W, ZHAO Y, ZHANG L W, et al. Recognition of Rosa roxbunghii in natural environment based on improved Faster-RCNN[J]. Transactions of the Chinese Society of Agricultural Engineering, 2019, 35(18): 143-150.

[17]孫哲,张春龙,葛鲁镇,等.基于Faster R-CNN的田间西兰花幼苗图像检测方法[J].农业机械学报,2019,50(7):216-221.

SUN Z, ZHANG C L, GE L Z, et al. Image detection method for broccoli seedlings in field based on Faster R-CNN[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(7): 216-221.

[18]REN S Q, HE K M, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[19]彭明霞,夏俊芳,彭辉.融合FPN的Faster R-CNN复杂背景下棉田杂草高效识别方法[J].农业工程学报,2019,35(20):202-209.

PENG M X, XIA J F, PENG H. Efficient recognition of cotton and weed in field based on Faster R-CNN by integrating FPN[J]. Transactions of the Chinese Society of Agricultural Engineering, 2019, 35(20): 202-209.

[20] LIN T Y, DOLLAR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). July 21-26, 2017, Honolulu, HI, USA. IEEE, 2017: 936-944.

[21]HE K M, GKIOXARI G, DOLLAR P, et al. Mask R-CNN[C]//2017 IEEE International Conference on Computer Vision (ICCV). October 22-29, 2017, Venice, Italy. IEEE, 2017: 2980-2988.

[22]SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[EB/OL]. 2014: arXiv: 1409.1556. https://arxiv.org/abs/1409.1556.

[23]HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). June 27-30, 2016, Las Vegas, NV, USA. IEEE, 2016: 770-778.

[24]LIU W, ANGUELOV D, ERHAN D, et al. SSD: single shot MultiBox detector[M]//Computer Vision-ECCV 2016. Cham: Springer International Publishing, 2016: 21-37.

[25]REDMON J, FARHADI A. YOLOv3: an incremental improvement[EB/OL]. 2018: arXiv: 1804.02767. https://arxiv.org/abs/1804.02767