?成式??智能正在改变?切当炒作消失会剩下什么?

OpenAI很明显知道自己在做什么。2021年底,只有几个人的研究小组在OpenAI旧金山办公室讨论了一个想法,随后他们创造了OpenAI的文本到图像模型的新版本:DALL-E。

这是一个可以将简短的文字描述转变为图片的人工智能模型,你可以让它生成梵高画的狐狸,或者是披萨做的柯基。

OpenAI的联合创始人和首席执行官山姆·奥特曼告诉《麻省理工科技评论》:“我们会创造一些新东西,然后我们都必须体验它一段时间,几乎总是这样。我们要试图弄清楚它将是什么样子的,被用于做什么。”

但这次不行。当他们修改模型时,每个参与其中的人都意识到这是一件特别的事情。“很明显,这就是我们的产品,”山姆说,“(这一点)没有任何争论,我们甚至从来没有开会讨论过。”

但没有人能够预测这款产品将会引起多大的轰动。山姆说:“这是第一个被每个普通用户带火的人工智能技术。”

DALL-E2在2022年4月发布。5月,谷歌官宣了(但没有发布)它自己的两种文本到图像的模型,Imagen和Parti。

然后是Midjourney公司推出了一个为艺术家制作的文本到图像模型。8月,英国初创公司StabilityAI向公众免费发布了开源模型StableDiffusion。

尝鲜的用户蜂拥而至。OpenAI在短短2个半月内就吸引了100万用户。超过100万人开始通过付费服务DreamStudio使用StableDiffusion;更多的人通过第三方应用程序使用StableDiffusion,或在他们自己的电脑上安装免费版本。

StabilityAI的创始人易马德·莫斯塔克表示,他的目标是拥有10亿用户。

在2022年10月,我们看到了第二轮热潮:谷歌、Meta等公司发布了文本到视频模型,可以创建短视频、动画和3D图像。

这种发展速度令人驚讶。在短短几个月的时间里,这项技术登上了媒体头条和杂志封面,社交媒体上到处都是讨论的人和有关的话题,话题的热度高居不下,但同时也引发了强烈的反弹。

伦敦国王学院研究计算创造力的人工智能研究员迈克·库克说:“这项技术令人惊叹,它很有趣,这是新技术该有的样子。

但它发展得如此之快,以至于你的理解根本赶不上它的更新速度。我认为,整个社会要花上一段时间来消化它。”

艺术家们陷入了这个时代最大的动荡之中。有些人会失去工作;有些人会找到新的机会。一些人选择诉诸法律,因为他们认为,训练模型所用的图像被滥用了。

曾在梦工厂等视觉效果工作室工作过的数字艺术家,唐·艾伦·史蒂文森三世说:“对于像我这样接受过技术训练的人来说,这非常可怕的。

“我会说天呐,这是我的全部工作,”他说,“我在使用DALL-E的第一个月就陷入了生存危机。”

尽管一些人仍沉浸在震惊之中,但包括史蒂文森在内的许多人正在寻找使用这些工具的方法,并预测接下来会发生什么。

令人兴奋的事实是,我们不知道接下来会发生什么。原因是,虽然创意产业从娱乐媒体到时尚、建筑、市场营销等,将最先感受到影响,但这项技术将把创造力赋予每个人。

从长远来看,它可以用于产生几乎任何东西的设计,从新型药物到服装和建筑。生成式的革命已经开始。

神奇的?命

对于曾从事电子游戏和电视节目制作的数字创作者查德·纳尔逊来说,从文本到图像的模型是一个千载难逢的突破。

他说:“这项技术可以让你在几秒钟内将脑海里的灵光一闪变成一个原型。你创造和探索的速度是革命性的——超过了我30年来经历过的任何一个时刻。”

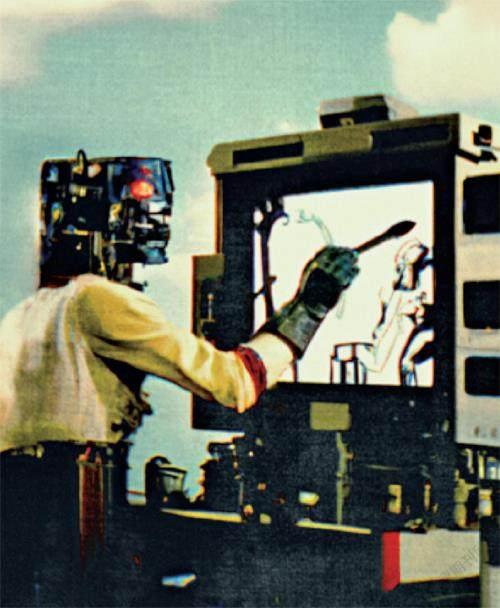

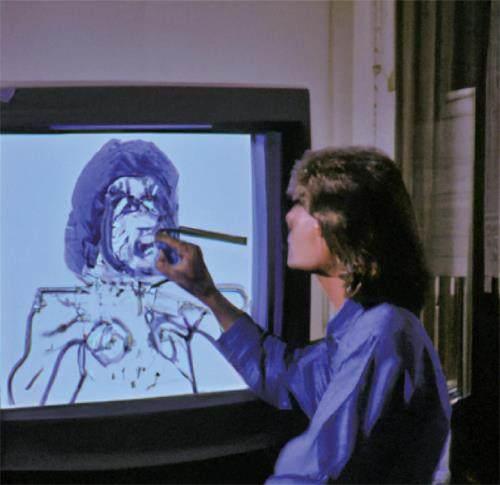

在模型刚出的几周里,人们就开始使用这些工具进行原型创造和头脑风暴,从杂志插图和营销布局到电子游戏环境和电影概念。

人们制作了同人作品,甚至是整本漫画书,并在网上不断分享。山姆甚至用DALL-E来设计运动鞋,就在他把设计图发在推特上之后,有人为他制作了一双。

纹身艺术师兼计算机科学家艾米·史密斯一直在使用DALL-E模型来设计纹身。“你可以和客户一起坐下来,一起进行设计,”她说,“我们正处于一场革命之中。”

数字和视频艺术家保罗·特里洛认为,这项技术将使关于视觉效果的头脑风暴更容易、更快速。

“人们都在说,这是特效艺术家或时装设计师的末日,”他说,“我不认为这是任何职业的终局。相反,我认为它意味着我们不必在晚上和周末加班。”

图片公司则采取了不同的立场。Getty已经禁止了人工智能生成的图像;Shutterstock公司已经与OpenAI签署了一项协议,将DALL-E嵌入其网站,并表示将成立一个基金,对那些成果被模型当作训练数据的艺术家进行补偿。

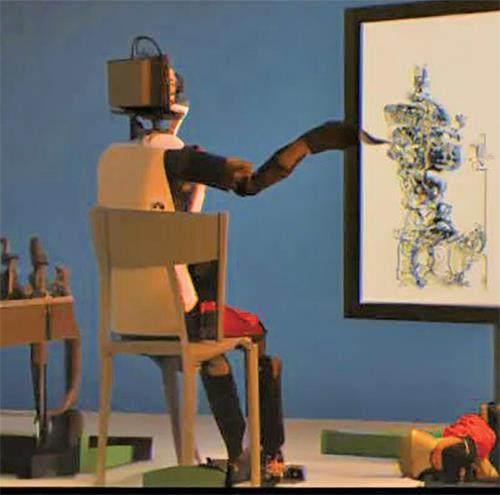

史蒂文森说,他在动画工作室制作电影的每一步都尝试了DALL-E,包括角色和环境的设计。

有了DALL-E,他能够在几分钟内完成多个部门的工作。他说:“对于那些因为技术太贵或太复杂而无法从事创造工作的人来说,这是令人振奋的。但如果你不愿意接受改变,那就太可怕了。”

纳尔逊认为未来还会有更多的事情发生。最终,他认为这项技术不仅会被媒体巨头所接受,也会被建筑和设计公司所接受。不过,他认为人工智能模型还没有准备好。

“现在就像你有一个小魔法盒子,一个小巫师,”他说。如果你只是想继续生成图像,那足够了,但如果你需要一个创造性的合作伙伴,那还不够。

他说:“如果我想让它创造故事和构建世界,它需要对我正在创造的东西有更多的认知。”

这就是问题所在:这些模型仍然不知道自己在做什么。

?盒?

为了了解原因,让我们看看这些程序是如何工作的。从外部来看,模型是一个黑盒子。

你输入一段简短的文字描述,又可以被称为一段提示,然后等待几秒钟,你就会得到一些(或多或少)符合提示的图像。

你可能不得不调整你的文本,让模型产生一些更接近你的想法的东西,或者不断打磨一个偶然得到的结果,这已被称为“提示工程”。

为了获得最细致的、样式独特的图像,一段描述可以多达几百个单词,而选择正确的单词已经成为一项有价值的技能。相关的网络市场如雨后春笋般涌现,专门买卖那些能够产生理想结果的文字提示和描述。

文字提示可以包含指示模型选择特定风格的短语,比如“ArtStation的流行趋势”,这是在告诉人工智能模仿ArtStation网站上流行的图像(通常是非常详细的)风格,这个网站上有成千上万的艺术家展示他们的作品;而“虚幻引擎”则会激活类似电子游戏的图像风格。

用户甚至可以输入特定艺术家的名字,让人工智能制作出模仿他们风格的仿制品。当然,这让一些艺术家非常不高兴。

外表之下,文本到图像模型有两个关键组成部分:一个经过训练的、将图像与描述图像的文本配对的神经网络,以及另一个被训练成从零开始生成图像的神经网络。其核心思想是让第二个神经网络生成能让第一个神经网络接受的图像。

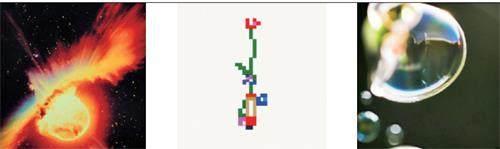

新模型背后的重大突破在于图像生成的方式。DALL-E模型的第一个版本使用了OpenAI语言模型GPT-3背后的技术,通过预测图像中的下一个像素来生成图像,就像预测句子中的单词一样。这可以实现目的,但效果不好。

“它没有给人一种神奇的感觉,”山姆说,“它能运转本身就很神奇了。”

相反,DALL-E2模型使用了一种叫做扩散模型的东西。扩散模型是一种神经网络,经过训练后,它可以通过去除训练过程中添加的像素化噪声来清理图像。

这个过程包括拿到一张图片,改变其中的几个像素并重复多次,直到原始图像被擦除,最后只剩下随机的像素。

“如果你这样做一千次,最终图像看起来就像是没有信号的电视上面的雪花,”比约恩·欧蒙说。他在德国慕尼黑大学研究生成式人工智能,帮助建立了StableDiffusion背后的扩散模型。

然后训练一个神经网络逆转这个过程,并预测给定图像的低像素化版本会是什么样子。结果是如果你给一个扩散模型一堆像素,它会尝试生成稍微更干净的图像。

把清理后的图像放回去,模型就会产生更干净的图像。当这个过程足够长,模型就可以把雪花图像变成高分辨率图片。

文本到图像模型的诀窍是,这个过程是由语言模型引导的,该语言模型负责将文字提示与扩散模型产生的图像相匹配。这将扩散模型推向了語言模型认为的匹配度更高的图像。

但这些模型并没有摆脱文本和图像之间的联系。如今,大多数文本到图像的模型都是在一个名为LAION的大型数据集上进行训练的,该数据集包含了从互联网上提取的数十亿组文本和图像。

这意味着你从文本到图像模型中得到的图像,是真实网络世界的抽象,它包含了被偏见(和色情)扭曲的网络内容。

还有一点值得注意,目前最流行的两种模型,DALL-E2和StableDiffusion之间有一个微小但关键的区别。

DALL-E2的扩散模型适用于全尺寸图像,而StableDiffusion则使用了一种由欧蒙和他的同事发明的被称为“潜在扩散”的技术。

后者作用于神经网络中编码图像的压缩版本,即所谓的“隐空间”中,其中只保留了图像的基本特征。

这意味着StableDiffusion需要的算力更少。与运行在OpenAI高性能服务器上的DALL-E2模型不同,StableDiffusion可以在性能尚可的个人电脑上运行。

创造力的爆炸式增长和新应用程序的快速开发,在很大程度上是由于StableDiffusion不仅是开源的,程序员可以自由地改变它,在开源代码的基础上构建它并以此赚钱,而且它足够轻巧,人们在家就能运行。

重新定义创造?

对一些人来说,这些模型是向通用人工智能(AGI)迈进的一步。AGI指的是未来具有通用或甚至类似人类智能的人工智能,当然,你也可以认为它是一个被过度炒作的概念。OpenAI已经明确了其实现AGI的目标。

出于这个原因,OpenAI的联合创始人山姆并不关心DALL-E2现在正与大量类似的工具竞争,其中一些是免费的。

“我们是要制造AGI的,而不是图像生成器,”他说,“我们的工具将契合一个更广泛的产品路线图。这只是AGI能做的一件小事。”

这是一个乐观的想法,因为许多专家认为,今天的人工智能永远不会达到那个水平。就基本智能而言,文本到图像的模型并不比支撑它们的语言模型更智能。

像GPT-3和谷歌的PaLM这样的工具,会从他们所训练的数十亿个文档中获取文本模式。类似地,DALL-E和StableDiffusion可能只是复制了在数十亿个网络样本中发现的文本和图像之间的关联。

虽然社交媒体上有许多眼花缭乱的成果,但如果我们不断尝试,总会发现不尽如人意的地方。

这些模型会犯下愚蠢的错误,比如你想要“河里的鲑鱼”,它会生成“漂浮在河上的生鱼片”,或者你想要“蝙蝠飞过棒球场”,它会给你一张“有飞行的哺乳动物和一根木棍”的图片。

这是因为它们所使用的技术,完全不能像人类(甚至大多数动物)那样理解我们的世界。

即便如此,让这些模型学习更好的技巧可能只是时间问题。库克说:“人们说它现在不太擅长做某件事,没问题,等再烧一亿美元之后,它很可能就会做了。”

OpenAI就是这样做的。山姆说:“我们已经知道如何让模型的性能提高10倍。我们知道,它在遇到一些逻辑推理任务时会表现很差。我们将列出一个待办问题清单,然后推出一个新版本来解决当前出现的所有问题。”

如果关于智能和理解的说法被夸大了,那么创造力呢?就人类而言,我们说艺术家、数学家、企业家、幼儿园的小孩子和他们的老师都是创造力的典范。但要了解这些人的共同之处,是很难的一件事。

对一些人来说,最重要的是结果。另一些人则认为,事物的制造方式,以及在这个过程中的动机——是最重要的。

尽管如此,许多人还是认可玛格丽特·博登给出的定义

她是英国苏塞克斯大学一位有影响力的人工智能研究员和哲学家,她将创造力这个概念归结为三个关键标准:要有创意,一个想法或人工制品需要是新的、令人惊讶的和有价值的。

除此之外,创造性是你第一眼看到就能意识到的东西。“计算创造力”领域的研究人员将他们的工作描述为:如果使用计算机产生的成果,可以被认为是人类能够凭一己之力创造出来的东西,那它就会被认为是具有创造性的。

因此,史密斯很高兴地称这种新一代的生成式模型具有创造性,尽管它们会犯一些愚蠢的错误。

她说:“很明显,这些图像中的创新并不受任何人类输入的控制。从文本到图像的转换往往是令人惊讶和美丽的。”

在澳大利亚莫纳什大学研究计算创造力的玛丽亚·特蕾莎·拉拉诺,同意文本到图像的模型扩展了以前的定义,但她并不认为它是有创意的。

拉拉诺指出,当用户经常使用这些程序时,结果可能会开始变得重复。

这意味着它们没有完全符合创造力的部分或全部要求,这可能是该技术的一个根本性限制。

本质上,文本到图像的模型生产出的图像,依据的是数十亿张已经存在的图像。也许机器学习只会产生(或模仿)它在过去所接触到的东西的图像。

这对计算机图形学来说可能并不重要。Adobe已经开始在Photoshop软件中加入文本到图像的生成功能;类似Photoshop但开源的Blender已经有一个StableDiffusion插件;OpenAI正在与微软合作,为Office办公套件开发一个从文本到图像的小组件。

正是在这种互动中,在这些熟悉的生产力工具的未来版本中,用户才真正地体会到了影响:来自那些不取代人类创造力,但却能增强创造力的机器。

“我们今天看到的创造力来自于系统的使用,而不是系统本身,”拉拉诺说道。

这一观点得到了其他計算创造力研究人员的赞同。这不仅仅关乎于机器所做的事情,更多的是他们是怎么做的。把他们变成真正的创意伙伴,意味着推动他们更加自主,赋予他们创造性的责任,让他们去策划和创造。

许多相关的工具很快就会接踵而至。有人已经编写了一个叫做CLIP询问器的程序,它可以分析一个图像,并给出一段用于生成更多类似图像的提示。

另一些人则在使用机器学习,调整短语和词汇使得提示的效果更好,让生成的图像有更高的质量和保真度——这也有效自动化了提示工程,一个刚出现几个月的工种。

与此同时,随着图像不断涌现,我们也看到了其他方面的影响。库克说:“互联网现在永远被人工智能制作的图像污染了。我们在2022年制作的图片,将是从现在开始制作的任何模型的一部分。”

这些工具将对创意产业和整个人工智能领域将产生哪些持久性影响,我们将拭目以待,生成式人工智能已经成为另一种表达工具。

OpenAI联合创始人山姆说,他现在会在私人短息中使用生成的图像,就像使用emoji表情符号一样。他说:“我的一些朋友甚至都懒得去生成图像,他们会直接输入提示文本。”

但从文本到图像的模型可能只是一个开始。生成式人工智能最终可能被用于建筑设计和开发之中,这又被称为“文本到X(图片之外的某种事物)”。

“人们会意识到,技术或工艺不再是障碍,唯一的限制是他们的想象力,”纳尔逊说。

计算机已经在几个行业中被使用,以生成大量可能的设计,然后人们会筛选出那些可能有效的设计。

文本到X的模型将允许人类设计师从一开始就微调生成过程,使用文字引导计算机跳过无数的选项,以获得更加令人满意的结果。

计算机可以召唤出充满无限可能性的空间,文本到X将让我们用词汇来探索这些空间。

“我认为这是可以流传下去的东西,”山姆说。“图像、视频、音频、最终,一切都会被生成。我认为它将会无处不在。”