基于优化SIFT算法的农田航拍全景图像快速拼接

刘媛媛,何 铭,王跃勇,孙 宇,高雪冰

•农业信息与电气技术•

基于优化SIFT算法的农田航拍全景图像快速拼接

刘媛媛1,3,何 铭1,3,王跃勇2,3※,孙 宇1,3,高雪冰1,3

(1. 吉林农业大学信息技术学院,长春 130118;2. 吉林农业大学工程技术学院,长春1 30118;3. 吉林农业大学智慧农业研究院,长春 130118)

为了快速准确获取大面积农田图像信息,提高保护性耕作秸秆还田监测效率和准确性,该研究提出一种基于优化SIFT(scale-invariant feature transform)算法的农田航拍全景图像快速拼接方法。首先对高分辨率图像进行降采样处理,针对图像的重叠区域进行有效检测;然后采用基于梯度归一化的特征描述符对特征点进行匹配,同时通过渐进样本一致算法去除误匹配,精准计算拼接转换模型;最后采用基于最佳拼接线的多分辨率融合算法进行图像融合,得到全景拼接图像。试验结果表明:该文方法在图像配准阶段与传统SIFT算法和SURF(speeded up robust feature)算法相比,特征点数量分别减少了97%和90%,运行时间减少了94%和69%,平均匹配效率为65.17%,约为SIFT算法的4倍,SURF算法的9倍;与APAP(ss-projective-as-possible)、SPHP(shape-preserving half-projective)和AANAP(adaptive as-natural-as-possible)算法相比,该方法拼接图像的信息熵、平均梯度和图像对比度均有明显提高。与传统方法相比,该文分层拼接方法提高了全景拼接图像的清晰度和融合效果,解决了传统方法中出现的错位和重影问题,其中全景图像的信息熵、平均梯度小幅提高,对比度明显提高,拼接时间大约缩短了90%以上。研究结果可为保护性耕作秸秆还田监测提供科学参考。

无人机;图像处理;全景拼接;SIFT算子;特征点匹配;图像融合

0 引 言

秸秆覆盖还田能够杜绝秸秆焚烧产生的大气污染,同时还能起到增肥增产作用,对农业生产、生态环境有积极影响[1-3]。为了更好地实行秸秆还田补贴政策,准确评估秸秆还田率极其重要。目前,国内主要采用人工拉绳法来测量秸秆覆盖率,效率低、精度差。因此,采用计算机视觉技术解决田间秸秆覆盖率精准检测问题十分重要[4-6]。近几年,无人机航拍技术不断发展与普及,其具有快速、灵活、操作方便、影像分辨率高等优势,得到广泛应用[7-8]。受到无人机飞行高度和相机成像视场的限制,无人机获取的单幅图像难以完全覆盖目标区域,为了满足秸秆覆盖率及地理信息检测对大面积全景图像的要求,需要利用图像拼接技术,对无人机采集的序列图像进行全景拼接。图像拼接技术最初由SUTHERLAND[9]提出。1975年KUGLIN等[10]提出通过傅里叶变换把原始图像变换到频域区,通过归一化互动功率谱计算相邻图像间的平行和旋转量,最后得到拼接图像。

图像配准是序列图像拼接的关键。HARRIS等[11]提出了Harris特征点检测器,对像素直接进行处理,通过角点计算特征点,像素精度高,鲁棒性好,但其不具有尺度不变性,对图片的明暗程度比较敏感,在纹理角点丰富的场景下检测效果较差。LOWE等[12]提出了尺度不变特征变换(scale-invariant feature transform, SIFT)算法,该算法匹配精度高,有良好的尺度不变性以及较强光照及视角变化的鲁棒性,但特征点计算量大,特征描述子计算过程复杂度高,无法满足图像快速拼接要求。BAY[13]对SIFT算法的兴趣点提取及其特征向量描述进行改进,提出了高鲁棒性局部特征点检测(speeded up robust feature,SURF)算法。与SIFT算法相比,SURF算法充分利用积分图像,大大减少了计算复杂度和计算量,计算速度更快,但算法稳定性差且对尺度和旋转的变化容忍度低。MOREL等[14]提出了一种仿射尺度不变特征转换(affine scale invariant feature transform,ASIFT)算法,该算法建立一种仿射模型对SIFT算法中仿射变换匹配计算进行改进。RUBLE等[15]提出了ORB(oriented FAST and rotated BRIE)算法,该算法在图像匹配计算中速度更快。但也不具备尺度不变性,在很多应用上都有着很大的不足。

国外关于图像拼接的研究主要集中在拼接相邻两幅图像[16]或同行多幅图像生成全景图像[17-18]的简单情况。目前,国内研究人员对无人机航拍图像拼接的研究也取得快速发展。贾银江等[19]提出了一种基于图像锐化的自适应修改采样步长的非极小值抑制拼接算法。沈跃等[20]提出了基于Kinect彩色和深度双信息特征源的图像拼接方法,能够有效克服光照、风吹等环境因素的影响,避免了图像缺失、亮暗差异、重影等拼接错误。吴如梦等[21]提出根据无人机航拍过程中自身的参数和摄像头的参数信息,使用SURF算法对预处理后的图像进行特征检测的方法。王红君等[22]提出了基于改进SPHP算法的无人机遥感图像全景拼接方法。王艳等[23]通过改进SIFT算法提出一种基于GA-SIFT算法的航拍图像拼接方法。目前已有遥感图像拼接软件如Pix4、ENVI、Agisoft等对图像具有较高要求,图像重叠率必须为80%以上,在对大面积农田图像拼接时,所需图像数据较多,耗时较大,无法满足快速拼接要求。

针对上述问题,本文结合航拍秸秆农田图像特点,对多幅高分辨率图像拼接方法展开研究,提出了一种基于优化SIFT算法的秸秆农田全景图像快速拼接方法,针对图像重叠区域提取秸秆目标特征点,并在特征匹配阶段对匹配点进行筛选,利用渐进样本一致(progressive sample consistency,PROSAC)算法去除误匹配点,实现精准匹配,最后采用基于最佳拼接线的多分辨率融合算法进行图像融合,得到高分辨率的农田区域全景图像。

1 航拍农田图像快速拼接算法

1.1 算法流程

为了准确、快速地计算农田秸秆还田率,通过无人机航拍采集低空高分辨率图像,结合航拍秸秆农田图像特点提出了一种基于优化SIFT算法的农田航拍全景图像快速拼接算法,为大面积秸秆还田率检测及地理信息检测提供大面积区域图像信息是非常有价值的[24-26]。本算法流程如图1所示。

图1 航拍农田图像快速拼接算法

首先,通过对无人机获取的低重叠率秸秆农田序列图像进行滤波和增强处理;其次,运用优化SIFT算法检测图像重叠区域的特征点,获取特征描述子MN-SIFT[27];然后,根据尺度还原后的特征点描述子进行特征点匹配,利用渐进样本一致算法对匹配结果优化,剔除其中的误匹配;最后,计算图像投影转换模型,采用基于最佳缝合线的多分辨率图像融合算法进行图像融合,生成全景拼接图像。

1.2 重叠区域检测

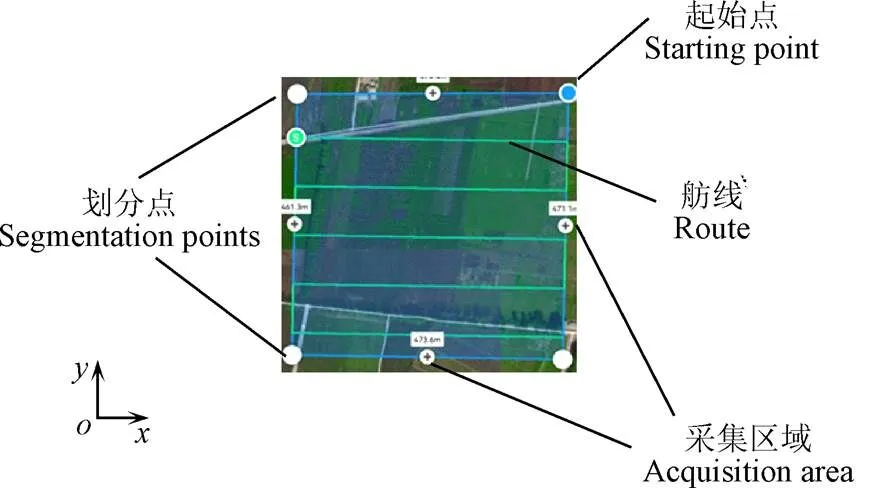

无人机采集的相邻图像之间存在旁向重叠和航向重叠(本文均为20%),用于拼接的有效区域仅为重叠区域。传统的SIFT和SURF算法为全局特征提取,即对图像的全部区域进行特征提取,会在重叠区域外检测出大量无效特征点,增加了算法计算量,从而导致特征检测效率低、耗时长。因此,为提高检测和匹配效率,实现快速拼接,在进行特征点检测前,需要判定相邻图像之间的重叠区域,确定特征检测的有效区域。由于图像采集过程中无人机按照设置航线飞行,如图2所示,相邻图像之间相对位置,无较大偏转,根据航线方向和重叠率,可计算出航向(轴)和旁向(轴)重叠区域在图像中的坐标。根据所求坐标,仅对图像重叠区域进行特征检测,图3为相邻航拍图像重叠区域示意图。

图2 无人机图像采集

图3 相邻航拍图像重叠区域示意图

1.3 特征点提取

本文根据不同视角和时间采集农田航拍图像,具有纹理、投影、光度和非线性强度变化,且图像中秸秆特征相似,颜色接近,特征匹配难度较大。直接采用传统SIFT算法检测和匹配特征点,存在特征点冗余、耗时长、配准效率低等问题。因此,本文对SIFT算法进行改进,只针对重叠区域(有效区域)进行特征提取,去除了无效区域大约80%的特征点,在此基础上对图像进行降采样处理,以降低图像的分辨率,减少SIFT特征检测的计算量;针对秸秆图像的纹理特征采用一种新的特征描述子,可以更好地匹配秸秆特征,提高配准精度。具体步骤为:

1)图像降采样处理。根据降采样系数,对输入图像中每行每列间隔点取样。由于不同场景中的航拍图像信息丰富度不同,降采样系数的取值也不同。

2)尺度空间极值点检测。搜索所有尺度的图像位置,通过高斯微分函数识别潜在的尺度和旋转不变的兴趣点。二维图像的尺度空间(,,)定义为尺度可变高斯函数(,,)与原图像(,)的卷积,如式(1)~(2)。

式中,为横纵坐标,为尺度大小。

3)精确定位特征点。通过拟合三维二次函数获得极值点,确定特征点的位置和尺度,同时过滤低对比度特征点和不稳定的边缘响应点,以增强匹配稳定性,提高抗噪声能力。

式中min和max是图像区域内获得的梯度幅值最小值和最大值,(,)表示像素位置。

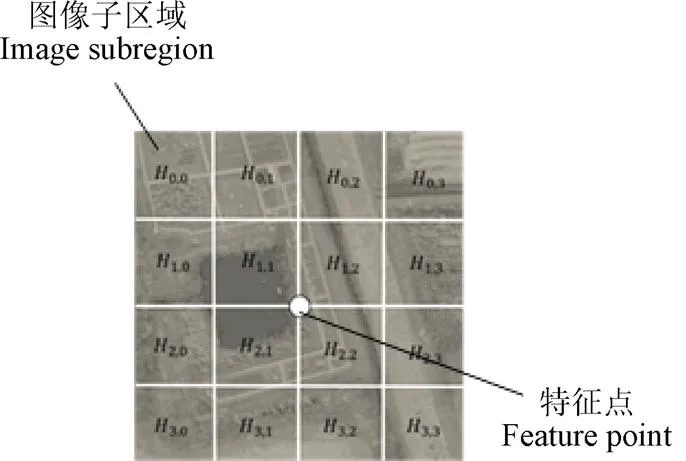

以特征点为原点,构建41×41(像素)的图像区域(,),并将其分成4×4个子区域,如图4所示。

图4 构建图像子区域

将该区域(,)与[−1,0,1]和[−1,0,1]T进行卷积,分别获得水平和垂直方向梯度F和F。由式(4)~(5)得到梯度幅值(,)和特征方向(,)。

通过取余运算,将方向(,) 分为8个等级,(,)由式(7)计算,根据(,)计算特征直方图h,如式(8)所示。

式中Ì[0,7],函数在除0以外的点都等于0。当()=1时,为主方向,否则为其他方向:

最后,将每个子区域特征直方图h串联,形成一个不受尺度、旋转和光照等影响的MN-SIFT特征描述子。

改进算法去除了特征检测中大量无效特征点,用少量精准特征点实现高质量配准,解决传统SIFT算法耗时长、匹配效率低的问题,并对秸秆农田航拍图像的旋转变换、尺度缩放、亮度变化具有较好的鲁棒性。

1.4 特征点匹配

在特征匹配前,根据降采样系数对提取到的特征点坐标和尺度进行等比例还原,将检测出的特征点还原到原始图像中,保证后续高分辨率图像拼接的精度,利用还原后的特征点描述子MN-SIFT对特征点对进行相似度度量,生成匹配点对。特征点匹配的筛选标准为特征点间的欧氏几何距离,见式(10),选取欧氏几何距离最小的两个特征点,计算最小两个欧氏几何距离的比值并与特定阈值进行比较(式(11))。在两向量夹角较小时,两向量的欧氏距离可通过向量的点积运算近似得出。

式中和分别代表参考图像和目标图像中的特征点,D和D分别代表维特征描述子。

式中1和2分别是特征点最近邻点和次近邻点的欧氏距离。若比值小于特定阈值(通常为0.4~0.6之间),则认可这一对匹配点,反之则剔除。

通过相似性度量可以实现图像特征点的快速匹配,但不可避免会产生误匹配,严重时会导致后续拼接图像发生重影、错位等情况。为解决这一问题,本文采用渐近样本一致算法进一步优化匹配结果,筛选得到精准的匹配特征点对。

1.5 基于最佳缝合线的多分辨率融合

航拍秸秆农田图像中信息多、细节复杂,本文将多分辨率融合算法与最佳缝合线法[28]相结合,提出基于最佳缝合线的多分辨率融合算法。

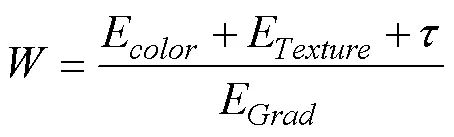

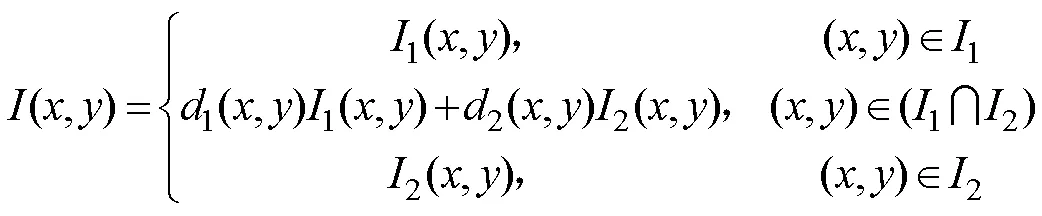

最佳缝合线法[28]通过能量函数(式(12))计算,融合颜色差异、梯度差异和纹理复杂性,在待融合图像间的重叠区域搜索最佳缝合线,将重叠区域图像划分为过渡区域和缝合线区域,构建掩膜图像和模板图像。

式中表示最终权重,E表示色差,E表示梯度差,E表示纹理差,表示惩罚。

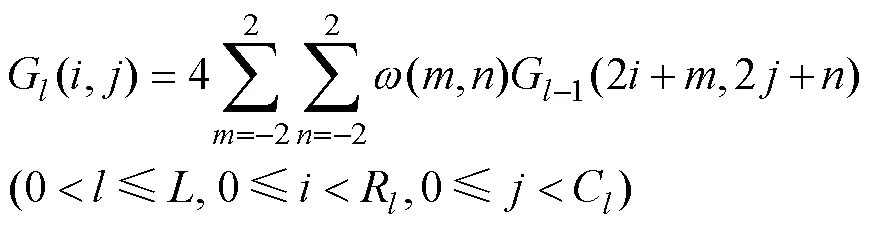

利用金字塔变换对掩膜图像和模板图像进行8层金字塔操作,通过高斯滤波器(,)对图像卷积操作,然后经过下采样构建高斯金字塔,将高斯金字塔的每一层图像减去上一层经过上采样和高斯卷积之后的图像,各层差值图像组成拉普拉斯金字塔L,见式(13)~(15)。其中代表层数,和分别代表行和列数,为高斯金字塔最大层数,为拉普拉斯金字塔最大层数。

采用渐入渐出算法对掩膜图像金字塔中相对应的每层图像分别进行融合,将两张融合图像分别定义为1和2,融合后图像为,如式(16)。其中1(,)、2(,)为权值函数,1(,)+2(,)=1,(,) 表示距边界的距离最终构建成新的拉普拉斯金字塔。

拉普拉斯金字塔逆变换可以将融合后的拉普拉斯金字塔逐层恢复成其对应的高斯金字塔,然后使用插值法将其与模板图像结合,得到融合图像,如式(17)。

本文融合算法有效去除拼接拼接过程中出现的鬼影和虛影现象,能够避免图像信息丢失,保留图像细节信息,实现图像的高质量拼接。

1.6 分层拼接策略

全景拼接中多图拼接的核心是求拼接序列中所有图像的投影模型,对其组合,但由于误差累计,严重影响拼接效果。本文提出多幅图像的分层拼接策略,降低多图拼接累积误差,提高全景图像质量。具体思路是:由于无人机航拍作业时同一路线的图像之间的相对位置关系明确,偏转角度较小,转换模型累计误差也较小,所以采用按航线进行分层,其首要任务是拼接每一层图像,然后将每一层的结果全景拼接,形成完整全景图像。

2 图像拼接试验结果与分析

2.1 图像采集与试验设备

无人机遥感图像数据来自3个不同的试验区,包括吉林省长春市吉林农业大学教学科研基地(125°37′57.38″E,44°16′33.64″N);吉林省长春市农业机械研究院试验基地(43°52′6.83″E,125°30′19.67″N);吉林省长春市二道区三道镇和平农场(125°30′39.87″E,43°52′27.21″N)。采集时间为3月中下旬-4月上旬和10月中下旬-11月中下旬,晴天,采集时间集中在上午9:00-11:00和下午13:00-15:00。采集设备为大疆M200 V2无人机搭载X5S增稳云台。无人机飞行高度为120 m,图像横纵重叠率均为20%,图像大小为5 280×2 970(像素),共200张。试验环境为Windows10操作系统,Intel(R) Core(TM) i5-7300 CPU 2.50 GHz,GTX 1050,内存为8 GB。

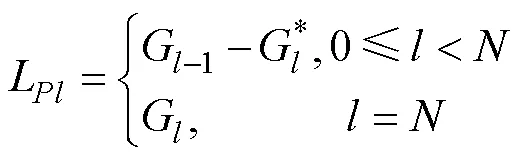

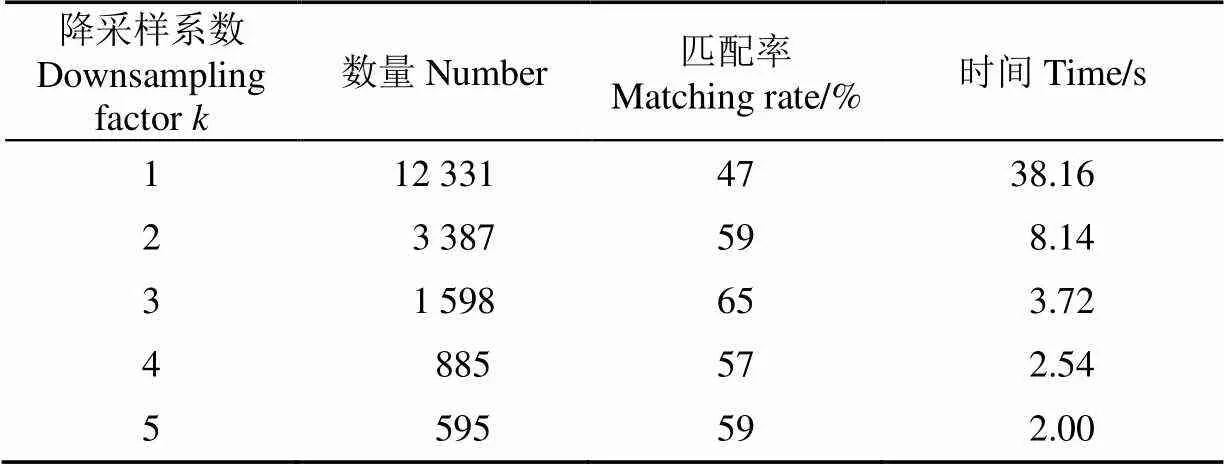

2.2 降采样系数选择

为获得较为理想的特征点数目和匹配率,需要不断改进降采样系数值,经过对多张不同地块的单张秸秆图像进行试验,统计多次试验后图像特征点检测数量、匹配率(匹配点数量/特征点数量)和运行时间的平均值,如表1所示。由表1可知,值越大,特征点数目越少,时间越短。当值为3时,单幅图像特征点匹配点数量适中,速度较快,且匹配率最高,满足快速拼接要求,因此本文取= 3。

表1 特征匹配结果统计

2.3 特征点检测与匹配

为验证本文方法的配准效果,选取具有复杂背景和特征差异的航拍图像,分别采用传统SIFT、SURF和本文算法进行特征点检测与匹配,试验结果如图5所示。统计3种算法的特征点数量、匹配点数量、匹配率(匹配点数量/特征点数量)和运行时间,如表2所示。

由图5可以看出,传统SIFT算法检测出了大量特征点,但大部为无效特征点(图5a)。采用SURF算法的特征点数量较传统SIFT算法减少,但也有大量无效特征点,且特征点分布不均匀(图5b)。本文优化算法的特征检测结果与传统SIFT算法,仅对重叠区域检测,去除了大量无效特征点,大大提高了检测和匹配效率(图5c)。

图5 特征检测结果对比

表2 特征配准结果

从表2的特征点数量和匹配率结果可知,本文算法检测出的特征点数量相较于传统SIFT和SURF算法分别减少了97%和90%,且匹配率(匹配点数量平均值/特征点数量平均值之比)为65.17%,远高于其他两种算法。此外,本文算法大大降低了运行时间,比传统SIFT和SURF算法节约了94%和69%的时间,极大地提高了特征检测与匹配的效率,单幅平均检测时间约为3.72 s,达到快速检测的目的。

2.4 图像拼接

2.4.1 单幅图像拼接

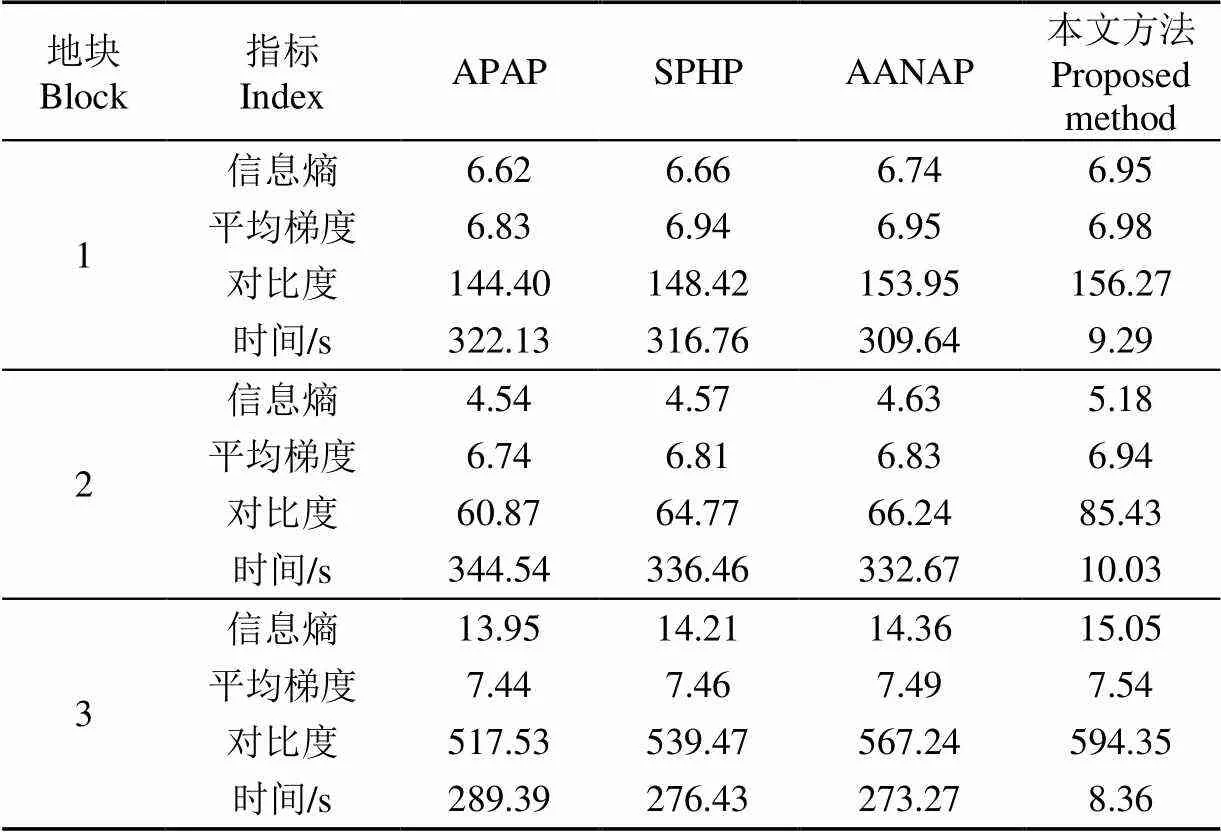

本文采集的秸秆农田图像背景比较复杂,除秸秆外还包含道路、房屋、车等。为验证本文快速拼接方法的有效性,将两幅图像的拼接结果与当前优秀的图像拼接方法进行了比较,包括APAP[16],SPHP[17],AANAP[18]算法。试验图像尺寸为5280×2970(像素),图像之间的重叠率为20%。

利用不同算法对3个地块的图像进行拼接试验,拼接结果如图6所示,图中红框标注同一图像位置的拼接细节。可以看出,本文算法实现了良好的融合效果和高质量拼接。

图6a和图6b在拼接区域有明显错拼,且出现模糊、错位现象,图像质量相对较低。图6c在拼接区域虽然无明显错拼和现象,但图像细节模糊,有重影现象,图像质量一般。图6d在拼接区域过渡自然、清晰,图像质量相对较高。

采用信息熵(I)[29]、平均梯度(C)[30]和图像对比度(I)对拼接图像质量进一步评估。

信息熵表示图像所包含的平均信息量的多少,熵值越大则所含信息量越多,效果越好,计算式为

式中代表图像,P表示在图像中灰度值为的像素在图像总像素数量中所占的比例,是灰度等级,一般取256。

平均梯度也称为清晰度,反映图像中的微小细节反差与纹理变化特征,值越大越清晰,计算式为

式中()表示图像对应像素(,)的灰度值。

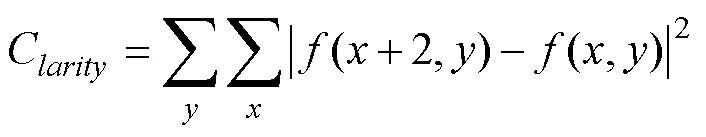

图像对比度表示图像黑与白的比值,表示从黑到白的渐变层次。比值越大,图像色彩越丰富,图像质量越好,计算式为

式中d(i,j)=|i-j|,为相邻像素间灰度差,Pd为相邻像素间的灰度差d的像素分布概率。

图6拼接图像的评价指标计算结果如表3所示。由表3可知,与其他方法相比本文方法拼接后的图像的信息熵、平均梯度小幅提高,对比度明显提高,图像质量更高,在多组试验中的表现都明显优于其他方法。此外,与其他方法相比,本文方法的拼接时间有较大改善,拼接效率明显提高,满足快速拼接的要求。

表3 拼接性能比较

2.4.2 多幅图像拼接

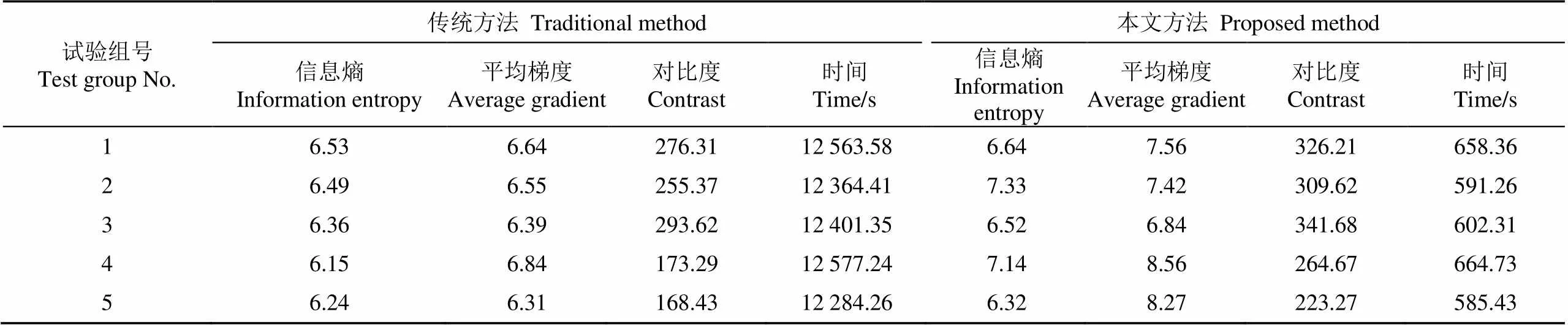

为验证多幅高分辨率图像分层拼接策略及本文方法的有效性,针对具有复杂背景的高分辨率秸秆农田航拍图像,分别采用传统方法和本文方法进行5组试验,并对全景拼接结果进行比较和分析,部分结果示例如图7所示。

由图7可以看出,本文方法对背景复杂、特征差异大的3组随机图像都取得了很好的拼接效果。矩形框标注图像中的拼接细节,放大图像细节可以看出,本文方法生成的图像整体质量较高,细节清晰,拼接效果自然,没有出现错位和重影现象。而用传统方法拼接后的图像整体质量较低,有明显的重影、错位和模糊现象。2种方法的评价指标结果见表4。

由表4可知,本文方法生成的全景图像的信息熵、平均梯度提高约10%,对比度提高约20%,整体耗时降低90%以上。根据主观和客观指标评价,可以看出,本文方法的拼接质量较高,提高了拼接后图像的清晰度和融合效果,也解决了传统方法中出现的错位和重影问题。

图7 全景拼接对比图

表4 多图拼接性能比较

3 结 论

本文基于无人机采集的秸秆农田航拍数据,提出了一种基于优化SIFT算法的农田航拍图像快速拼接方法,通过特征点数量、运行时间以及图像质量等指标验证本方法的高效性,结果如下:

1)在特征检测阶段,本文算法只针对重叠区域(有效区域)进行特征提取,去除了无效区域大约80%的特征点,在此基础上对图像进行降采样,降低图像的分辨率,在保证拼接质量的条件下进一步减少了特征点的数量;与传统SIFT算法和SURF算法相比,特征点数量减少了97%和90%;运行时间减少了94%和69%,满足快速拼接检测的要求。

2)在特征匹配阶段,本文算法对提取到的特征点坐标和尺度进行等比例还原,保证了图像信息完整和拼接的精度;使用新的特征描述子进行匹配,有效提高了特征点检测精度,匹配率(匹配点数量/特征点数量)为65.17%;与传统SIFT算法和SURF算法相比有较大提升;并且通过PROSAC算法进一步去除误匹配,提高了转换模型的精度,拼接图像的质量。

3)通过基于最佳缝合线的多分辨率图像融合算法有效去除鬼影、虚影,能够避免图像信息丢失,保存图像细节信息完整。本文方法在单幅图像的拼接中实现了良好的融合效果和高质量的拼接,与其他拼接方法相比,该方法的性能优于其他广泛使用的优秀方法。

4)针对高分辨率秸秆图像的多图拼接,提出了一种多幅高分率航拍图像的分层拼接策略。与传统方法相比,本文的快速拼接方法生成的全景图像,其信息熵、平均梯度提高约10%,对比度提高约20%,图像整体的拼接精度和质量有明显提高。最后将本文整体的航拍全景图像的快速拼接方法与传统方法相比,在提高拼接图像质量的同时,整体耗时降低90%以上,满足快速拼接检测的要求。

本文方法能够在复杂背景条件下针对无人机航拍图像中的重叠区域快速准确地提取秸秆目标特征点,能在特征匹配阶段区分秸秆和杂波等其他干扰源,实现匹配点的精确匹配,最后采用基于最佳缝合线的多分辨率图像融合算法进行图像融合,提高了图像质量,实现图像的全景拼接,但在时间上仍有进一步提高的空间。该方法也可以应用于遥感和农业监测领域,生成用于作物评估和预测的实时全景图像。

[1] 田慎重,张玉凤,边文范,等. 深松和秸秆还田对旋耕农田土壤有机碳活性组分的影响[J]. 农业工程学报,2020,36(2):185-192.

TIAN Senzhong, ZHANG Yufeng, BIAN Wenfan, et al. Effect of deep loosening and straw return on the organic carbon activity fraction of rototilled farmland soils[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(2): 185-192. (in Chinese with English abstract)

[2] 汪可欣,付强,张中昊,等. 秸秆覆盖与表土耕作对东北黑土根区土壤环境的影响[J]. 农业机械学报,2016,47(3):131-137.

WANG Kexin, FU Qiang, ZHANG Zhonghao, et al. Effects of straw mulching and topsoil tillage on soil environment in the root zone of northeastern black soil[J]. Transactions of the Chinese Society of Agricultural Machinery, 2016, 47(3): 131-137. (in Chinese with English abstract)

[3] 王忠江,王泽宇,司爱龙,等. 秸秆与沼肥同步翻埋还田对秸秆腐解特性的影响[J]. 农业机械学报, 2017,48(6):271-277.

WANG Zhongjiang, WANG Zeyu, SI Ailong, et al. Effect of simultaneous reburial of straw and methane fertilizer on the decomposition characteristics of straw[J]. Transactions of the Chinese Society of Agricultural Machinery, 2017, 48(6): 271-277. (in Chinese with English abstract)

[4] 刘媛媛,孙嘉慧,张书杰,等. 用多阈值多目标无人机图像分割优化算法检测秸秆覆盖率[J]. 农业工程学报,2020,36(20):134-143.

LIU Yuanyuan, SUN Jiahui, ZHANG Shujie, et al. Detection of straw cover with multi-threshold multi-objective UAV image segmentation optimization algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(20): 134-143. (in Chinese with English abstract)

[5] 刘媛媛,周小康,王跃勇,等. 改进U-Net模型的保护性耕作田间秸秆覆盖检测[J]. 光学精密工程,2022,30(9):1101-1112.

LIU Yuanyuan, ZHOU Xiaokang, WANG Yueyong, et al. Improved U-Net model for straw cover detection in conservation tillage fields[J]. Optics and Precision Engineering, 2022, 30(9): 1101-1112. (in Chinese with English abstract)

[6] 刘媛媛,张硕,于海业,等. 基于语义分割的复杂场景下的秸秆检测[J]. 光学精密工程,2020,28(1):200-211.

LIU Yuanyuan, ZHANG Shuo, YU Haiye, et al. Straw detection algorithm based on semantic segmentation in complex farm scenarios[J]. Optics and Precision Engineering, 2020, 28(1): 200-211. (in Chinese with English abstract)

[7] 李欣璐,凌灿权. 无人机遥感技术在农情监测中的应用[J].现代农业装备,2022,43(5):45-51.

LI Xinlu, LING Canquan. Application of UAV remote sensing technology in agricultural situation monitoring[J]. Modern Agricultural Equipment, 2022, 43(5): 45-51. (in Chinese with English abstract)

[8] 刘忠,万炜,黄晋宇,等. 基于无人机遥感的农作物长势关键参数反演研究进展[J]. 农业工程学报,2018,34(24):60-71.

LIU Zhong, WAN Wei, HUANG Jinyu, et al. Research progress on the inversion of key parameters of crop growth based on UAV remote sensing[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2018, 34(24): 60-71. (in Chinese with English abstract)

[9] SUTHERLAND I E. Sketchpad a man-machine graphical communication system[J]. Simulation, 1964, 2(5): R-3-R-20.

[10] KUGLIN C. The phase correlation image alignment methed[J]. Proc. Int. Conference Cybernetics Society, 1975: 163-165.

[11] HARRIS C G, STEPHENS M. Harris C, Stephens M. A combined corner and edge detector[C]//Alvey Vision Conference. 1988.

[12] LOWE D G. Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision. 2004, 60(2): 91-110.

[13] BAY H T. Surf: Speeded up robust features[J]. Computer Vision and Image Understanding, 2008, 110(3): 346-359.

[14] MOREL J M, Yu G. ASIFT: A new framework for fully affine invariant image comparison[J]. SIAM Journal on Imaging Sciences, 2009, 2(2): 438-469.

[15] RUBLEE E, KABAUI V, KONOLIGE K, et al. ORB: An efficient alternative to SIFT or SURF[C]//International Conference on Computer Vision. Barcelona: IEEE Pree, 2011: 2564-2571.

[16] ZARAGOZA J, CHIN T J, BROWN M S, et al. As-projective-as-possible image stitching with moving DLT[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2013, 36(7): 2339-2346.

[17] CHANG C H, SATO Y, CHUANG Y Y. Shape-preserving half-projective warps for image stitching[C]//IEEE Conference on Computer Vision and Pattern Recognition, Columbus, OH, USA. 2014: 3254-3261.

[18] LIN C C, PANKANTI S U, RAMAMURTHY K N, et al. Adaptive as-natural-as-possible image stitching[C]//IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Boston, 2015: 1155-1163.

[19] 贾银江,徐哲男,苏中滨,等. 基于优化SIFT算法的无人机遥感作物影像拼接[J]. 农业工程学报,2017,33(10):123-129.

JIA Yinjiang, XU Zhe’nan, SU Zhongbin, et al. UAV remote sensing crop image stitching based on optimized SIFT algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(10): 123-129. (in Chinese with English abstract)

[20] 沈跃,朱嘉慧,刘慧,等. 基于深度和彩色双信息特征源的Kinect植物图像拼接[J]. 农业工程学报,2018,34(5):176-182.

SHEN Yue, ZHU Jiahui, LIU Hui, et al. Kinect plant image stitching based on depth and color dual information feature sources[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2018, 34(5): 176-182. (in Chinese with English abstract)

[21] 吴如梦,方挺,李文钦. 基于SURF特征的无人机航拍图像拼接方法[J]. 现代制造技术与装备,2019(8):34-36.

WU Rumeng, FANG Ting, LI Wenqin. SURF feature-based stitching method for UAV aerial images[J]. Modern Manufacturing Technology and Equipment, 2019(8): 34-36. (in Chinese with English abstract)

[22] 王红君,刘一鸣,岳有军,等. 基于改进SPHP算法的无人机遥感图像拼接技术[J]. 计算机工程与设计,2020,41(3):783-788.

WANG Hongjun, LIU Yiming, YUE Youjun, et al. UAV remote sensing image stitching technique based on improved SPHP algorithm[J]. Computer Engineering and Design, 2020, 41(3): 783-788. (in Chinese with English abstract)

[23] 王艳,祁萌. 基于 GA-SIFT 算法的无人机航拍图像实时拼接[J]. 测绘通报,2021(8):28-32,47.

WANG Yan, QI Meng. Real-time stitching of UAV aerial images based on GA-SIFT algorithm[J]. Mapping Bulletin, 2021(8): 28-32, 47. (in Chinese with English abstract)

[24] 刘杰,游品鸿,占建斌,等. 改进SIFT快速图像拼接和重影优化[J]. 光学精密工程,2020,28(9):2076-2084.

LIU Jie, YOU Pinhong, ZHAN Jianbin, et al. Improved SIFT fast image stitching and ghosting optimization algorithm[J]. Optics and Precision Engineering, 2020, 28(9): 2076-2084. (in Chinese with English abstract)

[25] ZHANG W, WANG Y, LIU Y. Generating High-Quality Panorama by View Synthesis Based on Optical Flow Estimation[J]. Sensors, 2022, 22(2): 470.

[26] DENG L, YUAN X, DENG C, et al. Image stitching based on nonrigid warping for urban scene[J]. Sensors. 2020, 20(24): 7050.

[27] SALEEM S, BAIS A, SABLATNIG R. Towards feature points based image matching between satellite imagery and aerial photographs of agriculture land[J]. Computers and Electronics in Agriculture, 2016, 126: 12-20.

[28] LU J, XU Y, GAO Z. An improved method of an image mosaic of a tea garden and tea tree target extraction[J]. 2022, 4(1): 231-254.

[29] 王茜,宁纪锋,曹宇翔,等. 基于SIFT算法的无人机遥感图像拼接技术[J]. 吉林大学学报(信息科学版),2017,35(2):188-197.

WANG XI, NING Jifeng, CAO Yuxiang, et al. UAV remote sensing image stitching technology based on SIFT algorithm[J]. Journal of Jilin University (Information Science Edition), 2017, 35(2): 188-197. (in Chinese with English abstract)

[30] 沈跃,朱嘉慧,刘慧,等. 基于彩色和深度信息结合K-means聚类算法快速拼接植株图像[J]. 农业工程学报,2018,34(23):134-141.

SHEN Yue, ZHU Jiahui, LIU Hui, et al. Fast stitching of plant images based on color and depth information combined with K-means clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE). 2018, 34(23): 134-141. (in Chinese with English abstract)

Fast stitching for the farmland aerial panoramic images based on optimized SIFT algorithm

LIU Yuanyuan1,3,HE Ming1,3,WANG Yueyong2,3※,SUN Yu1,3,GAO Xuebing1,3

(1.,,130118,;2,,130118,;3.,,130118,)

Straw mulching has been a common measure for black land conservation in the northeastern plains of China. It is a great significance of an effective solution to reduce soil erosion for environmental protection and sustainable development in modern agriculture. However, it is difficult to calculate the coverage rate at one time, due to the wide area of crop cultivation. Therefore, it is a high demand for the rapid acquisition of image information on a large area of farmland, in order to improve the efficiency and accuracy of straw mulching. Fortunately, aerial drone images and videos can be widely used in various fields, such as agricultural monitoring, weather forecasting, and geographic mapping. Among them, the application of remote sensing technology focuses mainly on the crops and soil in agriculture. The spectral patterns of the ground can be utilized to monitor the crops and soil in the field. Specifically, the spectral characteristics of the ground are used to monitor the growth of crops, crop quality, crop pests, and diseases. The high-resolution images can be collected by unmanned aerial vehicle (UAV) aerial photography. The panoramic stitching can be selected for rapid and accurate access to the large-area farmland image information. Therefore, it is of great practical significance to agricultural intelligence, particularly for the high efficiency and accuracy of straw cover monitoring of conservation tillage. In this study, a fast-stitching method was proposed for the aerial panoramic images of the fields using the optimized scale-invariant feature transform (SIFT) algorithm. Firstly, the high-resolution image was down-sampled to effectively detect the overlapping regions of the image. The gradient normalization-based feature descriptors were then used to match the feature points. The false matches were removed by the progressive sample consistency algorithm, in order to accurately calculate the stitching conversion model. Finally, the multi-resolution fusion algorithm was used for the high-quality stitched imageusing the best stitching line. The experimental results show that the improved algorithm reduced the number of feature points by 97% and 90%, the running time by 94% and 69%, and the average matching efficiency by 65.17% in the image alignment stage, respectively, compared with the traditional SIFT and Speeded Up Robust Feature (SURF) algorithm, which was about 4 times that of SIFT algorithm, and 9 times that of SURF algorithm, respectively. Compared with the as-projective-as-possible (APAP), the shape-preserving half-projective (SPHP), and the adaptive as-natural-as-possible (AANAP) algorithms, the new algorithm significantly improved the information entropy, the average gradient, and image contrast of the stitched image. More importantly, the stitched image was of higher quality with more than a 90% reduction in the running time, particularly with better overall performance. The systematic evaluation demonstrated that the layered stitching method significantly improved the clarity and fusion effect of the panoramic stitched images, compared with the traditional. Moreover, there was no misalignment and ghosting that appeared in the traditional. Specifically, the information entropy and average gradient of the panoramic images were slightly improved to increase the contrast by about 20%, indicating a higher stitching efficiency than before. The overall stitching time was also shortened by about 90% or more. The research structure can also provide a scientific reference to monitor the conservation of tillage with straw returning.

UAV; image processing; panoramic stitching; SIFT operator; feature point matching; image fusion

10.11975/j.issn.1002-6819.202210135

TP751.1

A

1002-6819(2023)-01-0117-09

刘媛媛,何铭,王跃勇,等. 基于优化SIFT算法的农田航拍全景图像快速拼接[J]. 农业工程学报,2023,39(1):117-125.doi:10.11975/j.issn.1002-6819.202210135 http://www.tcsae.org

LIU Yuanyuan, HE Ming, WANG Yueyong, et al. Fast stitching for the farmland aerial panoramic images based on optimized SIFT algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2023, 39(1): 117-125. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.202210135 http://www.tcsae.org

2022-10-18

2022-12-12

国家自然科学基金资助项目(42001256);吉林省科技厅技术创新引导项目(20220402023GH);吉林省科技厅重点科技项目(20230202039NC,20220203004SF);吉林省发展和改革委员会创新项目(2019C054);吉林省教育厅科学技术研究项目(JJKH20220339KJ)

刘媛媛,博士,副教授,研究方向为农业信息化图像和视频信号处理。Email:liuyuanyuan1980@126.com

王跃勇,博士,副教授,研究方向为田间保护性耕作机械及智能系统。Email:yueyongw@.jlau.edu.cn