基于视觉引导的采样系统设计

杨忠炯,邹绍昕,周立强

(1.中南大学 机电工程学院,长沙 410083;2.中南大学 高性能复杂制造国家重点实验室,长沙 410083)

0 引言

国内金属行业的质检部门需对供应商车辆运输的矿粉进行采样,通常是在矿粉堆的不同位置进行人工采样作为该批次的样本,样本化验结果作为该批次矿粉的定价依据。现有的采样方式很大程度上还依赖于人工,国内对于采样系统的研究发展落后于欧美等发达国家[1]。实现采样自动化要解决的技术问题是准确检测出采样区域,并在采样机器人基础坐标系得到采样点坐标。通过视觉引导的方式,协助机器人到目标点进行工作,这种方法可以有效地提高生产线的工作效率和自动化水平[2-5],特别是对于一些人工操作危险复杂的工作,具有非常重要的意义。

文中依据实际项目提出了一种基于SSD的采样区域检测算法,并基于激光定位灯实现图像坐标系到机器人基础坐标系的坐标转换,并通过现场实验对采样系统的精度和可靠性进行了验证。

1 系统硬件组成

1)相机采用hikvision的MV-CA032-10GC型号的工业相机,靶面积为1/1.8英寸,使用千兆网线与上位机通讯,相机安装在采样现场的正上方。

2)镜头采用mindvision的MV-LD-4-4M-G型号的定焦镜头,焦距为4mm,镜头畸变率小于0.5%,靶面积为1/1.8英寸。

3)激光定位灯为工业用激光灯,型号为G0028,输出功率为400mw,波长为532nm,投射绿色光斑。

4)工控机采用Lenovo的工控机,负责从CMOS相机采集的图像中识别采样区域、生成随机采样点、进行图像坐标系到实际坐标系的转换、TCP通讯以及PLC控制等。

5)采样机器人为三自由度导轨式机器人,电机采用siemens的SIMOTICS S-1FK7紧凑型的永磁同步电机,并通过PLC控制电机以及液压系统控制采样机器人进行采样。

采样系统整体如图1所示,工业相机和激光定位灯固定在顶部,且激光定位灯垂直向下投射绿色光斑,激光定位灯所在位置为采样机器人原点,采样机器人可沿着导轨在xw、yw方向运动,当车辆停靠时,采样机器人可沿zw方向进行采样工作,zw方向采样深度根据电机转矩传感器进行控制。

图1 采样系统组成

2 基于SSD的采样区域检测

2.1 SSD算法的核心思想

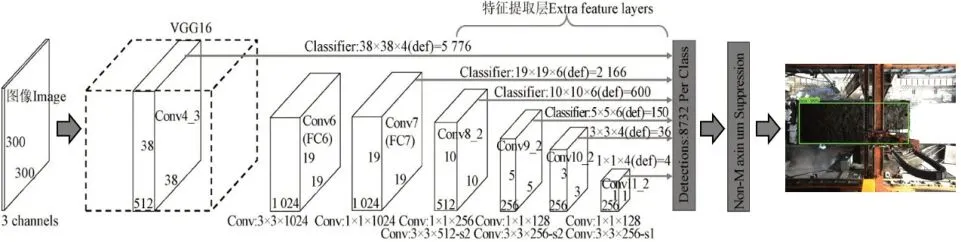

SSD[6]网络是目标检测中常用的one-stage类算法,能够在保证检测精度的同时,大大提升检测速度,且SSD网络内置有数据增强的方法,如剪裁、放大、缩小等,SSD模型的网络结构如图2所示。

图2 SSD模型的网络结构

其主要思路是使用VGG16作为基础网络,在此基础上使用卷积层、池化层等结构,得到多尺度预测特征图,在图像的预测特征图中进行多次采样,并在6个预测特征图层根据不同尺寸和长宽比生成共8732个默认框(defalut box),大尺度的预测特征图用于检测小目标物,小尺度的预测特征图用于检测大目标物,可覆盖所有待检测目标,对默认框内的目标类别进行预测,并对默认框的边界进行回归,再使用非极大值抑制[7],得到最后的检测结果。

2.2 训练结果

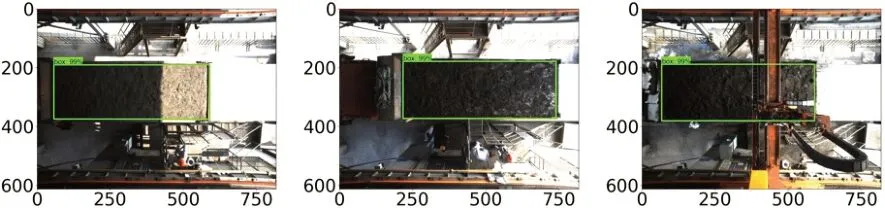

通过相机采集5127张现场图片,数据集中包括不同光线强度、不同时间段的情况下所有运输车辆的俯视拍摄图,并通过数据扩增的方式对每张图片进行亮度调整、对比度调整、添加噪声、图像翻转、图像模糊的操作,每张图片可额外扩充5张图片,得到共30762张训练样本,对采样区域数据集进行标注后进行训练,训练后的模型对现场的运输车辆进行采样区域检测,结果如下图所示。

图3 SSD模型的检测结果图

SSD的检测结果将用于引导采样机器人进行采样,因此对预测框的精度要求高,预测框若超出实际采样范围,会造成安全问题。将IoUG定义为预测框与真实框交集的面积除以真实框面积所得到的比值,若预测框超出采样范围、未检测出采样范围或IoUG<0.8,则认为检测失败;若0.8≤IoUG≤1且未超出采样范围,则认为检测成功,则对1000张测试集图片进行检测,结果如表1所示。

表1 SSD模型对于采样范围的检测情况

使用数据扩增之前,由于运输车辆出现的时间段限制,同一车辆在不同光线强度以及对比度的数据集较少,导致52张测试集图像都无法在图像中检测中采样范围,并且42张测试集图像的预测框超出采样范围,61张测试集图像的预测框IoUG<0.8,使用数据扩增后,成功率从84.5%提高到97.6%,表明使用数据扩增能有效提高检测成功率,由于待检测目标为大目标且场景稳定,使用数据扩增后的SSD模型可用于采样范围的检测,对于检测失败的情况,人工可在控制界面对预测框进行修正,确保采样机器人在采样范围内工作。

3 随机采样点的产生规则

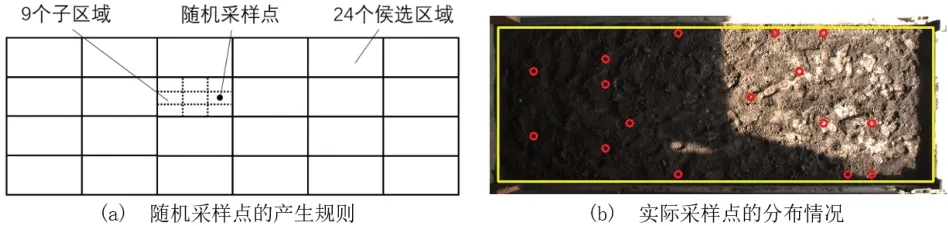

由于现场采样要求采样点为16个,且满足均匀随机分布,按图4(a)的规则产生采样点。

图4 随机采样点的生成

将SSD模型检测出的采样区域按4×6方式划分为24个候选区域,通过随机函数在24个候选区域中选取16个待采样区域,再将每个待采样区域按3×3方式划分为9个子区域,通过随机函数在9个子区域的选取一个子区域的中心点作为随机采样点。现场随机采样点的产生结果如图4(b)所示,每次生成的16个采样点都满足随机均匀分布的要求,可避免出现在矿粉内掺假的现象。

4 视觉定位模型

机械人视觉定位方法通常是将棋盘靶标固定于机器人法兰末端,使得棋盘靶标随机器人运动而运动,相机拍摄处于不同位姿下的棋盘靶标,从而标定相机与机器人之间的位姿关系[8],采样机器人为导轨式且相机安装在顶部,无法通过手眼标定的方式来进行坐标转换。文中提出一种易部署且满足采样精度要求的视觉定位模型,用于引导采样机器人移动到随机生成的采样点位置进行采样。

4.1 绿色激光点的识别

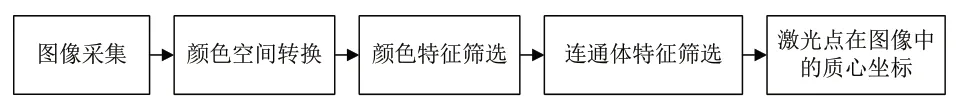

绿色激光定位灯投射在采样平面后,在图像中找到绿色激光点在图像中的位置,图像处理过程如图5所示。

图5 图像处理流程图

4.1.1 颜色特征筛选

在OpenCV中将原图从RGB颜色空间转换到HSV颜色空间,根据绿色在HSV颜色空间中的范围,从原图中提取出绿色像素点,并进行灰度化、二值化、形态学膨胀等操作,得到二值化图像,不同光线强度下绿色激光点的识别结果如图6(a)所示。

图6 颜色特征筛选后的图像

颜色特征筛选后,得到的二值化图像中仍存在其他连通体区域,如图6(c)所示,仅通过颜色特征无法直接从图像中得到绿色激光点的位置,还需根据二值化图像中的连通体特征进一步筛选。

4.1.2 连通体特征筛选

需根据激光点连通体特征[9],从二值化图像中唯一确定绿色激光点的质心位置坐标,并将绿色激光点的质心作为图像坐标系原点,选取以下3个连通体特征进行筛选:

1)连通体质心位置:(xM,yM)指二值化图像中单个连通域质心坐标在图像中的坐标,OpenCV坐标系是以左上角为原点,横向为x,纵向为y。

2)连通体面积特征S:指二值化图像中单个连通域的像素个数。

3)连通体圆形度特征θ:指二值化图像中单个连通域的面积与最小外接圆面积之比。

式中,L为连通体长轴,i为二值化图像中连通体序号,n为二值化图像中连通体总数;xmin、xmax为绿色激光点质心坐标x方向的极限位置,ymin、ymax为绿色激光点质心坐标x方向的极限位置,xmin、xmax、ymin、ymax可在最低采样平面以及最高采样平面情况下测得;Smin、Smax为绿色激光点连通体的极限面积,θmin代表绿色激光点连通体圆形度的最小值,Smin、Smax、θmin可根据现场环境设定;Pi为所有连通体的圆形度特征和面积特征进行加权后计算得到的最大值,α为连通体圆形度权重系数,β为连通体面积权重系数。

二值化图像中的连通体需满足式(2)的条件,对于所有满足式(2)的连通体,通过式(3)得到目标连通体Pi,Pi对应的第i个连通体为绿色激光点对应的连通体,该连通体的质心坐标为绿色激光点的中心坐标,并将绿色激光点的质心作为图像坐标系原点,对绿色激光点的识别结果如图7所示,对于照射在采样平面的绿色激光点,通过都能在图像中都找到其位置,为后续的坐标转换提供可靠信息。

图7 现场图片中绿色激光点的识别结果

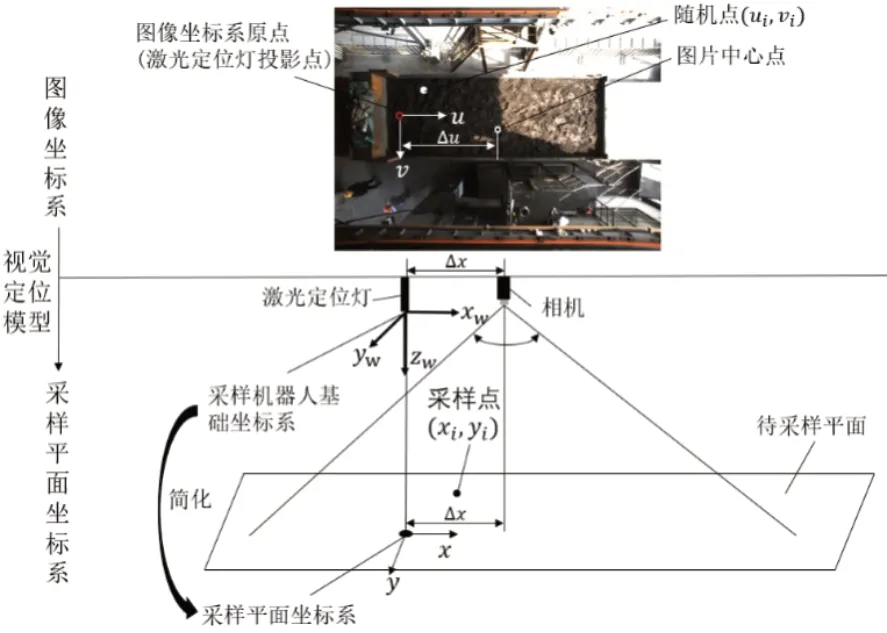

4.2 坐标转换

在采样机器人基础坐标系中,采样机器人的运动原点为激光定位灯所在位置,由于采样机器人z方向采样深度根据电机转矩传感器进行控制,且绿色激光点垂直投射在采样平面,可将三维的采样机器人基础坐标系简化为二维的采样平面坐标系,采样平面坐标系的原点为激光定位灯在采样平面投影点的质心位置,因此可通过采样平面坐标系的坐标点(x,y)控制采样机器人到对应位置采样。

图8 坐标转换示意图

因相机中心与激光定位灯中心的横向距离Δx可通过测量得到,且图像坐标系中,图片中心点与绿色激光点质心的横向像素距离Δu也可通过计算得到,16个采样点的计算如下:

式中,Kt为图像坐标系到采样平面标系的转换系数,Δx为采样平面坐标系中的常量,Δu随采样平面高度变化,采样平面越高Δu越大,i为采样点序号,(xi,yi)T为采样平面坐标系中的采样点,(ui,vi)T为图像坐标系中按规则随机生成的点。

图像坐标系中16个随机采样点换算到采样平面坐标系后,通过TCP通讯的方式从工控机传输到PLC,进而引导采样机器人到对应位置进行采样。

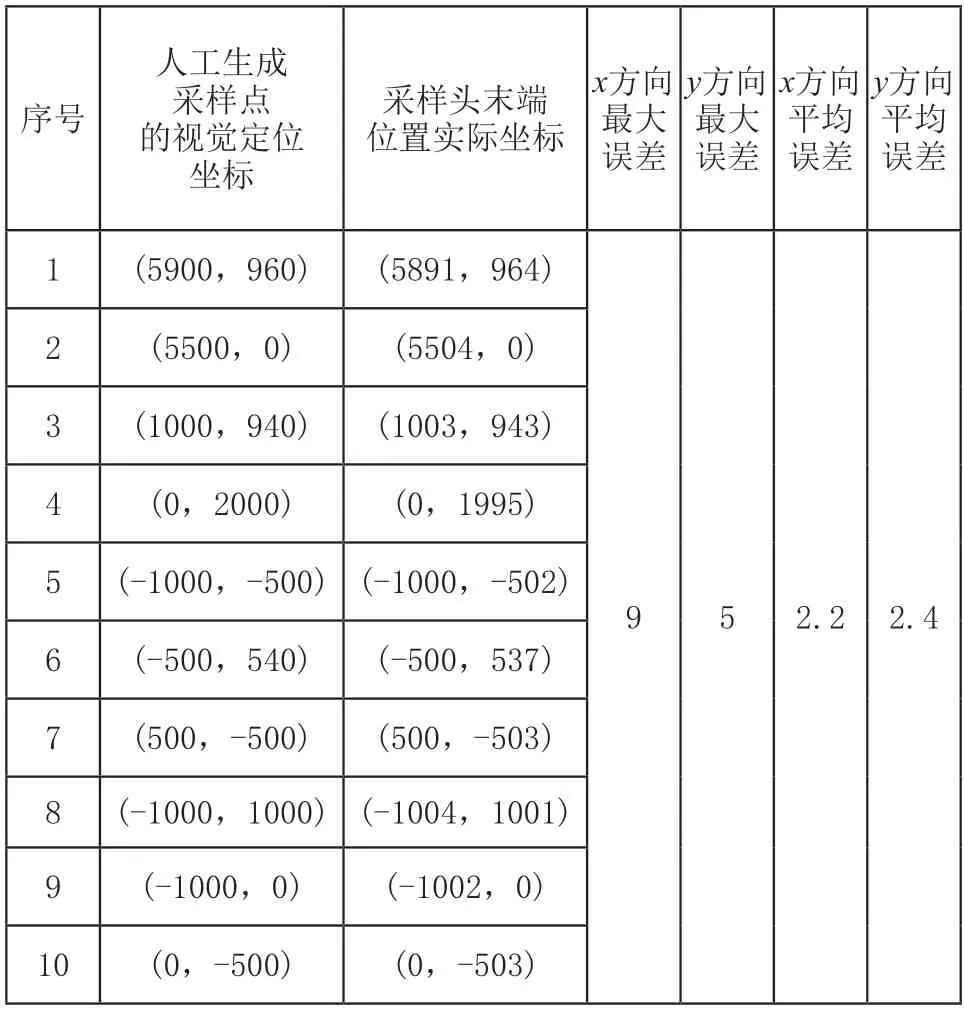

5 实验结果

采用人工方式在图像中生成采样点,对视觉定位的精度进行多次实验,每次实验选定10个采样点进行视觉定位误差实验,进行三次实验,共测试30个采样点,且30个采样点均匀分布在整个采样平面,计算x、y方向的最大误差以及平均误差,第一次的实验结果如表2所示,视觉引导采样实验如图9所示。

表2 视觉定位结果与采样头实际位置(mm)

图9 视觉引导采样实验

实验的定位误差结果如图10所示,30个采样点在x方向的最大绝对误差为9mm,y方向的最大绝对误差为7mm,误差产生原因是由于绿色激光点质心的识别精度、机器人运动误差等因素造成,采样过程是在采样区域随机生成取样点进行采样,采样点不能超出采样区域,根据采样点的产生规则,在极限情况下,随机生成的边缘点距离采样区域边界在x方向有167mm裕量,y方向上有87mm裕量,因此不会出现采样点超出采样范围的情况,该采样精度可满足现场采样要求。

6 结语

针对半封闭式空间的采样环境,文中提出一种视觉引导的采样系统用于三自由度导轨式采样机器人,主要的研究成果如下:

1)基于SSD目标检测算法实现采样区域检测,可从采集的图像中自动识别出采样区域。

2)根据采样要求,提出一种随机采样点的产生规则,并且生成的采样点满足随机均匀分布。

3)基于激光定位灯提出一种视觉定位模型,实现从图像坐标系到采样机器人基础坐标系的转换,进而引导采样机器人到对应随机点进行采样。

通过现场实验验证了采样系统的可行性,采样点的分布以及定位精度均满足现场采样要求,对提高采样自动化具有重要意义。