基于深度学习的电力设备红外与可见光图像配准

付 添,邓长征,韩欣月,弓萌庆

基于深度学习的电力设备红外与可见光图像配准

付 添,邓长征,韩欣月,弓萌庆

(三峡大学 电气与新能源学院,湖北 宜昌 443002)

针对现有电力设备红外与可见光图像配准难度大、配准时间长等问题,提出一种基于深度学习的电力设备红外与可见光图像配准融合的方法。本文将特征提取与特征匹配联合在深度学习框架中,直接学习图像块对与匹配标签之间的映射关系,用于后续的配准。此外为了缓解训练时红外图像样本不足的问题,提出一种利用红外图像及其变换图像学习映射函数的自学习方法,同时采用迁移学习来减少训练时间,加速网络框架。实验结果表明:本文方法与其他4种配准算法相比性能指标均有显著提升,本文平均准确率为89.909,同其余4种算法相比分别提高了2.31%、3.36%、2.67%、0.82%,本文平均RMSE(Root Mean Square Error)为2.521,同其余4种配准算法相比分别降低了14.68%、15.24%、4.90%、1.04%,算法平均用时为5.625s,较其余4种算法分别降低了5.57%、6.82%、2.45%、1.75%,有效提高了电力设备红外与红外可见光图像配准的效率。

图像配准;深度学习;自学习;深度神经网络;电力设备

0 引言

电力设备作为电力系统的重要组成部分,它的运行状态往往决定着整个电力系统的安全与稳定[1-2]。通过电力设备的红外图像可以判断其是否发生故障,但是红外图像往往轮廓不够清晰,而可见光图像信息丰富,细节也更全面,因此图像融合技术应运而生,将红外和可见光图像进行融合后,就可以得到既符合人们的视觉特性,又不受光照强度的影响,还包含了两幅源图像细节信息的融合图像[3-6]。然而在实际应用中,红外与可见光图像不可能完全一样,因此在进行图像融合前需要进行配准,根据红外与可见光图像上的特征信息,利用变换参数,将红外与可见光图像变换到同一坐标系下。

随着深度学习的发展,深度学习技术也被引入到了红外与可见光图像配准领域。文献[7-9]利用神经网络来提取特征学习相似度度量,虽然提高了算法的性能,但收敛速度缓慢。文献[10-12]利用深度学习方法解决了医学图像配准问题,取得了令人鼓舞的结果。文献[13-15]首次利用深度神经网络的方法来度量两个图像块的相似性。文献[16-20]利用深度强化学习将图像配准转化为迭代求解最优动作序列的过程,但这类深度迭代算法收敛速度缓慢。文献[21-22]将深度特征与传统算子结合以提高精度,但在过程中增加了冗余。文献[23]使用CNN(Convolution Neural Network)网络对图像进行特征提取来实现多模图像配准。总的来说,这些配准框架都需要获得尽可能多的局部特征点来进行变换模型的估计,这可能会导致相应的特征点的缺乏,造成配准失败。

本文提出一种基于深度学习的电力设备红外与可见光图像配准方法。与传统方法不同,本文将特征提取与特征匹配联合在深度学习框架中,在提高电力设备红外与可见光图像匹配精度的同时具有较低的时间复杂度。

1 本文方法

1.1 网络结构

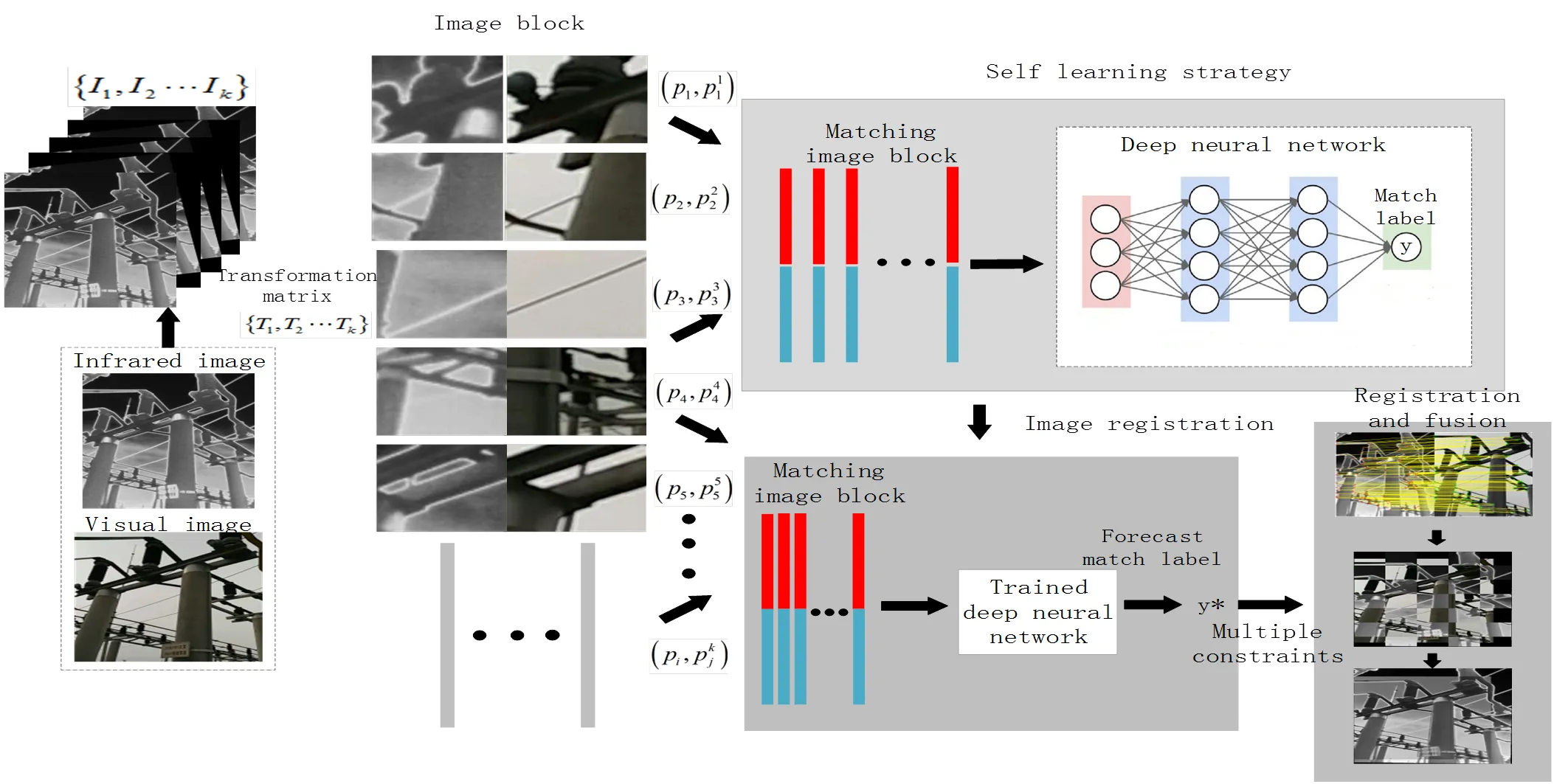

本文提出的红外与可见光配准框架如图1所示。本文将特征提取与特征匹配联合在深度学习框架中,直接学习图像块对与匹配标签之间的关系。将红外与可见光图像块对作为神经网络的输入,输出的是相对应的匹配标签,然后,利用训练好的神经网络预测新的红外与可见光图像块对的匹配标签。本文的网络框架主要包括两个部分:第一部分是提取红外与可见光图像块的特征点并自发学习特征匹配函数,完成深度神经网络的训练,第二部分是红外与可见光图像配准。首先为红外与可见光图像块对分配不同的匹配标签,用于训练深度神经网络。然后利用训练好的神经网络预测待配准图像中图像块对的匹配关系,最后,剔除错误的匹配点对,计算待配准图像的变换矩阵,配准并融合图像。

1.2 自学习策略

由于配准框架需要获得尽可能多的局部特征点来进行匹配标签的预测,但是,与可见光图像不同,红外图像的获取十分困难,为了尽可能地从红外图像中获得局部特征点,从而使神经网络得到充分的训练,本文提出一种自学习策略,具体步骤如下:

1)特征点检测。本文以红外与可见光图像块对为训练神经网络的样本,而图像块对是以特征点为中心选取的,因此得到准确有效的特征点是关键。由于视角或传感器的原因,红外与可见光图像存在一定程度的外观差异,传统方法检测到的特征点可能包含严重的异常值,进而在后续的配准中产生大量的误匹配,深度学习恰好解决了这个问题,卷积神经网络可以自适应地学习红外与可见光图像块中具有不变特征的信息,并以此为特征点,这些特征点与图像大小、光线、视角无关。以这些特征点为中心的图像块也会有明显的特征显示,使用这样的训练样本来训练神经网络可以保证神经网络的优良性能,大大提高后续配准精度。

图1 图像配准融合深度学习框架

2)变换图像。利用一组变换矩阵{1,2, …,}对红外图像进行尺度变换、旋转、平移,得到一组变换的红外图像{1,2,…,I}。

3)选取训练样本。首先利用卷积神经网络提取可见光图像中的特征点,一共有个特征点{1,2,…,x},然后利用卷积神经网络同样提取变换红外图像{1,2,…,I}的特征点,也可以得到个特征点{1,2,…,x}。则可见光图像与变换的红外图像I的匹配点对为{(x,x),=},不匹配点对为{(x, x),≠}这里=(1,2,…,),==(1,2, …,)。最后,根据特征点选取图像块集,可见光图像块集为{1,2, …,p},变换的红外图像I的图像块集为{1,2,…,p},则可以得到匹配的图像块对为{(p, p),=},不匹配的图像块对为{(p, p),≠},训练样本表示为{(p, p),y},其中匹配标签y为:

于是得到1个匹配的正样本和-1个不匹配的负样本,为了保证神经网络的训练性能,必须要维持正负样本的平衡,本文的做法是在-1个负样本中随机选取1个负样本与正样本对应,达到样本平衡。图2为自学习策略中训练样本的生成方案。

2 训练过程

一般的深度学习网络训练过程是从随机初始化参数开始,然后使用BP(Back Propagation)算法调整整个网络的参数,利用随机梯度下降算法使损失函数最小化。然而这个过程会导致过度拟合,并且训练成本较高,为此我们采用两步训练策略来缓解这些问题。一开始,由于没有可用的深度学习模型,我们应用玻尔兹曼机来训练深度学习网络,只用一个图像对(1,1),即最初的学习,经过训练的深度学习模型不仅可以配对1和1,而且还学习了红外图像和可见光图像的某些共性属性,因此,它可以通过迁移学习作为其他图像的训练网络。

2.1 初始学习

预训练时将数据的先验信息带入参数初始化中,可以防止过拟合,同时具有较好的范化性能[24]。根据这一思想,应用无监督的预训练,即限制性玻尔兹曼机(Restricted Boltzmann Machine, RBM,)[25],来初始化深度学习网络参数。

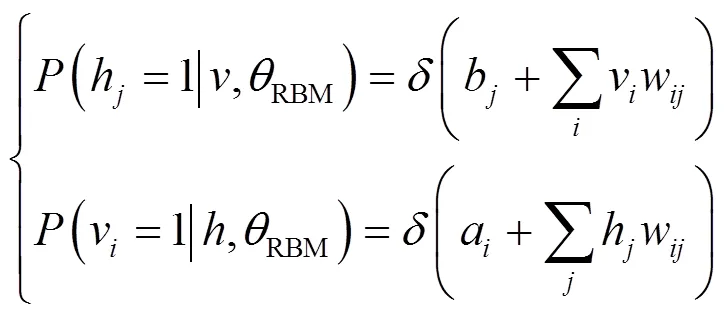

RBM学习输入数据的分布特性,它由输入层和特征提取层组成。它将输入单元记为∈{0,1},将特征提取单元记为∈{0,1},则联合概率分布和能量函数可表示为:

图2 自学习策略中训练样本的生成方案

由于RBM的独立性,输入单元和特征提取单元的激活概率更新为:

式中:是sigmoid函数,()=1/(1+exp(-))。

2.2 迁移学习

对于一幅新的未配准图像,如果通过本文提出的自学习从头开始训练网络,会耗费大量的时间,因此,我们提出利用迁移学习的方法减少训练时间,提高训练网络拟合新图像的可靠性。迁移学习是将源网络作为目标网络的初始状态,然后利用目标数据对目标网络进行微调的过程。这样不仅提高了网络的范化性能,而且大大减少了训练的时间。在本文中,我们有一个经过训练的网络,它在初始学习后学习同质数据的某些属性。按照同样的思路,我们将已有的深度学习网络作为初始网络,然后利用新图像中相应的匹配标签对网络进行微调。

3 配准

3.1 去除外点

在匹配步骤中,将可见光图像1和红外图像1中所有的图像块对{p, p}输入训练后的神经网络中,预测匹配标签,如果标签为1,则以匹配的图像块对的中心点作为图像匹配的初始特征点。由于图像块的尺寸很小,我们可能会在1和1之间发现多个相似的图像块对。这种一对多匹配混淆了变换矩阵的计算。因此,我们应用一个全局约束来删除这些假匹配点。本文在RANSAC(Random Sample Consensus)[26]算法的基础上做出如下改进,本文通过上述训练好的图像块匹配模型来判定配准点对的特征,弱化了求解参数模型时的多迭代对算法耗时的影响。然后针对RANSAC算法对每次生成的单应性矩阵进行合理性判定而造成的处理效率问题,通过快速舍弃不合理的矩阵来减少单应性矩阵验证和特征点检测时间。最后通过更新样本集再次求解矩阵,使得产生的单应性矩阵是最优的结果。如图3所示,改进SANSAC算法的运行时间为0.06s,与传统的SANSAC算法0.09s相比提高了33%。

3.2 几何变换

通过全局约束删除假匹配点后,得到图像块之间准确的对应关系,由对应关系求得匹配变换矩阵。通过匹配变换矩阵,可以拟合出红外与可见光图像块之间的变换参数,对图像块进行重采样,使得红外与可见光图像置于统一坐标系中。相似性变换可以定义为:

式中:(e)、(e)分别为相似变换系数;(e)权重函数,红外与可见光图像棋盘图如图4所示。

4 实验结果及其分析

4.1 配准融合评价指标

1)准确率(Accuracy, ACC)[27]是指匹配标签预测为正样本的样本数目和不匹配标签预测为负样本的样本数目占总的样本数目的比例,其表达式为:

图4 红外与可见光图像棋盘图

2)精度(Precision,)[27]是指匹配标签预测为正样本中正确预测的比例,其表达式为:

3)召回率(Recall,)[27]是指正样本被正确预测的比例,其表达式为:

式中:TP表示将匹配标签预测为正样本;TN表示将匹配标签预测为负样本;FP表示将不匹配标签预测为正样本;FN表示将不匹配标签预测为负样本。

4)F-measure[20]是一个综合指标,用来度量分类方法的性能,其表达式为:

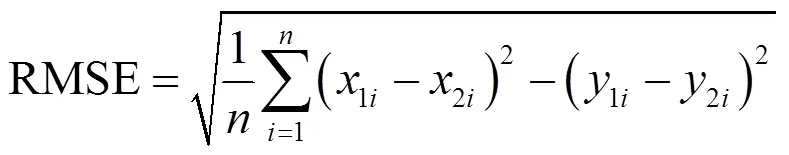

5)均方根误差(root mean square error, RMSE)可以衡量配准算法的精度,均方根误差越小说明配准效果越好,其定义为:

式中:(1i,1i)为红外图像匹配点坐标;(2i,2i)为对应的可见光图像匹配点坐标;为匹配点对数。

4.2 敏感性分析

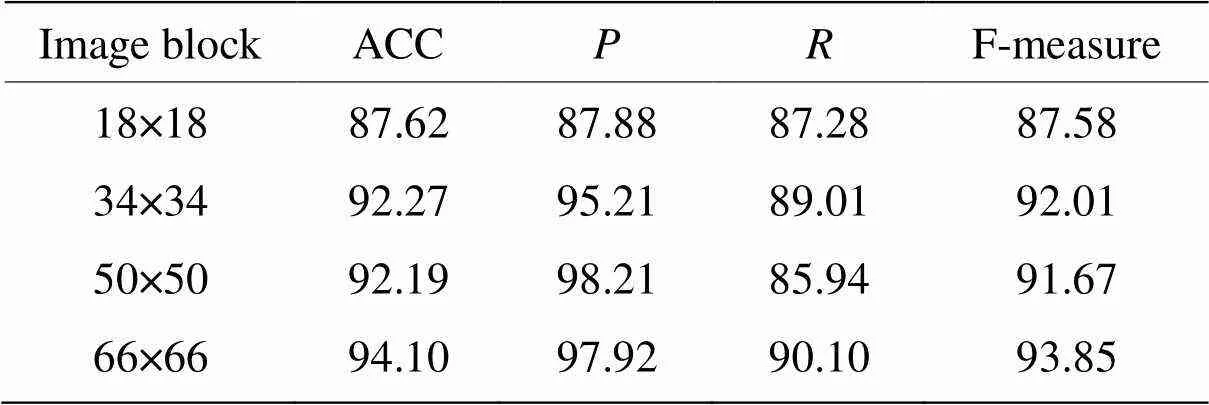

为了评估不同图像块大小对深度学习模型的影响,依次选取18、34、50、66大小的图像块进行4组相互独立的实验,实验结果如表1所示。

表1 不同图像大小对模型的影响结果

由表1可知,随着图像块大小逐渐增大,ACC、、和F-measure整体趋势是呈上升趋势的。这是因为图像块对越大,细节信息就越丰富,物体的轮廓也越清晰,匹配的准确率也随之增大。但并不意味着图像块越大越好,因为图像块对越大,神经网络的训练时间和训练难度也会随着增大,应用其预测匹配标签的时间也会随着增大。

4.3 实验结果分析

为了验证本文算法,选择了较为先进的4种算法进行对比,对比算法为CSS(Curvature Scale Space)算法[28]、CNN(Convolution Neural Network)算法[29]、DSGAN(Generative Adversarial Network for Distant Supervision)算法[30]、DVGG(Difference of Gaussian with VGG)算法[31]。图5是5组采用本文算法实现的红外与可见光图像配准融合效果图,由图可知本文算法的配准精度高,融合后的图像边缘清晰,能够清楚反映电力设备的红外图像特征和可见光图像特征。

表2给出了5组实验数据下5种算法的配准结果对比,从数据中我们可以看出,本文算法的ACC、RMSE均有明显提高,本文平均ACC为89.909,同其余4种算法相比分别提高了2.31%、3.36%、2.67%、0.82%,由于精确度更高,所以匹配效果更好。本文平均RMSE为2.521,同其余4种配准算法相比分别降低了14.68%、15.24%、4.90%、1.04%,由于平均均方根误差系数更小,说明本文配准算法具有优越性。

表3给出了5组实验数据下5种算法的配准时间对比,从数据中我们可以看出,本文算法具有较低的时间复杂度。本文算法平均用时为5.625s,较其余4种算法分别降低了5.57%、6.82%、2.45%、1.75%,平均匹配时间更少、鲁棒性更强。

图5 电力设备红外与可见光图像配准融合

表2 不同配准算法配准结果对比

5 结论

本文提出了一种用于电力设备的红外与可见光图像配准融合的深度学习框架,这种端到端架构直接学习图像块对与其匹配标签之间的映射函数。为了弥补红外图像数据量小的问题,提出一种利用红外图像及其变换图像学习映射函数的自学习方法,不需要依赖于其他数据,并且应用迁移学习方法进一步提高了映射函数的准确性,降低了训练成本。实验结果表明,本文的方法具有优越性,平均匹配时间更少,满足电力系统在线检测的实时性。

表3 不同匹配算法时间对比

[1] 张旭, 魏娟, 赵冬梅, 等. 电网故障诊断的研究历程及展望[J]. 电网技术, 2013, 37(10): 2745-2553.

ZHANG Xu, WEI Juan, ZHAO Dongmei, et al. Research history and prospect of power grid fault diagnosis [J]., 2013, 37(10): 2745-2553.

[2] 刘晓康, 万曦, 涂文超, 等. 基于红外可见光图像配准的电力设备分割算法[J]. 计算机与现代化, 2020(8): 26-30.

LIU Xiaokang, WAN Xi, TU Wenchao, et al. Power equipment segmentation algorithm based on infrared and visible image registration[J]., 2020(8): 26-30.

[3] 王鲲鹏, 徐一丹, 于起峰. 红外与可见光图像配准方法分类及现状[J]. 红外技术, 2009, 31(5): 270-274.

WANG Kunpeng, XU Yidan, YU Qifeng. Classification and status quo of infrared and visible image registration methods[J]., 2009, 31(5): 270-274.

[4] 赵洪山, 张则言. 基于文化狼群算法的电力设备红外和可见光图像配准[J]. 光学学报, 2020, 40(16): 1-14.

ZHAO Hongshan, ZHANG Zeyan Infrared and visible image registration of power equipment based on cultural wolf swarm algorithm[J]., 2020, 40(16): 1-14.

[5] MA J Y, JIANG X Y, FAN A X, et al. Image matching from handcrafled to deep features: A survey [J]., 2021, 129(1): 23-79.

[6] 徐全飞, 冯旗. 基于SURF和矩阵乘法的超大规模遥感图像亚像素配准算法研究[J]. 红外技术, 2017, 39(1): 44-52.

XU Quanfei, FENG Qi Research on subpixel registration algorithm of super large scale remote sensing image based on surf and matrix multiplication[J]., 2017, 39(1): 44-52.

[7] WU G R, KIM M, WANG Q, GAO Y Z, et al. Unsupervised deep feature learning for deformable registration of MR brain image[C]//16, 2013: 649-656.

[8] CHENG X, ZHANG L, ZHENG Y F. Deep similarity learning for multimodal medical images[J]., 2018, 6(3): 248-252.

[9] Simonovsky M, Gulierrez-Becker B, Mateus D, et al. A deep metric for multimodal registration[C]//19th2016: 10-18.

[10] Kabus S, Netsch T, Fischer B, et al. B-spline registration of 3D images with Levenberg-Marquardt optimization[C]//,2004, 5370: 304-313.

[11] TANG L S, Hamarneh G, Celler A. Co-registration of bone CT and SPECT images using mutual information[C]//, 2006: 116-121.

[12] MIAO S, WANG Z J, LIAO R. A CNN regression approach for real-time 2D/3D registration[J]., 2016, 35(5): 1352-1363.

[13] HAN Xufeng, LEUNG T, JIA Y, et al. MatchNet: Unifying feature and metric learning for patch-based matching[C]//2015(CVPR), 2015: 3279-3286, Doi: 10.1109/CVPR.2015.7298948.

[14] Krebs J, Mansi T, Delingette H, et al. Robust non-rigid registration through agent-based action learning[C]//20th, 2017: 344-35.

[15] Dosovitskiy A, Fischer P, Ilg E, et al. FlowNet: learning optical flow with convolutional networks[C]//, 2015: 2758-2766.

[16] LI H W, WANG B H, LI L. Research on the infrared and visible power-equipment image fusion for inspection robots[C]//2010 1st, 2010: 1-5.

[17] 李寒, 王库, 刘韶军. 基于灰度冗余和SURF算法的电气设备红外和可见光图像配准[J]. 电力系统保护与控制, 2011, 39(11): 111-115, 123.

LI Han, WANG Ku, LIU Shaojun. Infrared and visible image registration of electrical equipment based on gray redundancy and surf algorithm[J]., 2011, 39(11): 111-115, 123.

[18] 姜骞, 刘亚东, 方健, 等. 基于轮廓特征的电力设备红外和可见光图像配准方法[J].仪器仪表学报, 2020, 41(11): 252-260.

JIANG Qian, LIU Yadong, FANG Jian, et al. Infrared and visible image registration method of power equipment based on contour feature[J]., 2020, 41(11): 252-260.

[19] 李云红, 罗雪敏, 苏雪平, 等. 基于改进CSS的电力设备红外与可见光图像配准[J]. 激光与光电子学进展, 2021, 11(24): 1-15.

LI Yunhong, LUO Xuemin, SU Xueping, et al. Infrared and visible image registration of power equipment based on improved CSS [J]., 2021, 11(24): 1-15.

[20] Taylor S, Drummond T. Binary histogrammed intensity patches for efficient and robust matching[J]., 2011, 94(2): 241-265.

[21] MA W, ZHANG J, WU Y, et al. A novel two-step registration method for remote sensing images based on deep and local features[J]., 2019, 57: 4834-4843.

[22] YE F, SU Y, XIAO H, et al. Remote sensing image registration using convolutional neural network features[J]., 2018, 15: 232-236.

[23] LIU X L, JIANG D S, WANG M N, et al. Image synthesis based multi-modal image registration framework by using deep fully convolutional networks[J]., 2019, 57(5): 1037-1048.

[24] 周微硕, 安博文, 赵明, 等. 基于几何不变性和局部相似特征的异源遥感图像配准算法[J]. 红外技术, 2019, 41(6): 561-571.

ZHOU Weishuo, AN Bowen, ZHAO Ming, et al A registration algorithm for heterogeneous remote sensing images based on geometric invariance and local similarity [J]., 2019, 41(6): 561-571.

[25] Salakhutdinov R, Hinton G E. Deep Boltzmann machines[C]//12th, 2009: 448-455.

[26] 杨琼楠, 马天力, 杨聪锟, 等. 基于优化采样的RANSAC图像匹配算法[J]. 激光与光电子学进展, 2020, 57(10): 259-266.

YANG Qiongnan, MA Tianli, YANG Congkun, et al. RANSAC image matching algorithm based on optimized sampling[J]., 2020, 57(10): 259-266.

[27] 李航. 统计学习方法[M]. 北京: 清华大学出版社, 2012.

LI Hang.[M]. Beijing: Tsinghua University Press, 2012.

[28] 朱英宏, 李俊山, 汤雨. 基于CSS角点提取的红外与可见光图像匹配算法[J].系统工程与电子技术, 2011, 33(11): 2540-2545.

ZHU Yinghong, LI Junshan, TANG Yu. Infrared and visible image matching algorithm based on CSS corner extraction[J]., 2011, 33(11): 2540-2545.

[29] 岳国华, 邢晓利. 基于卷积神经网络和校正网络相结合的遥感图像配准方法研究[J]. 计算机应用与软件, 2021, 38(11): 185-190.

YUE Guohua, XING Xiaoli. Research on remote sensing image registration method based on convolution neural network and correction network[J]., 2021, 38(11): 185-190.

[30] FU J, LI W S, XU L M. DSAGAN: A generative adversarial network based on dual-stream attention mechanism for anatomical and functional image fusion [J]., 2021, 576: 484-506.

[31] 王少杰, 武文波, 徐其志. VGG与DoG结合的光学遥感影像精确配准方法[J]. 航天返回与遥感, 2021, 42(5): 76-84.

WANG Shaojie, WU Wenbo, XU Qizhi. An accurate registration method of optical remote sensing images based on VGG and DoG[J]., 2021, 42(5): 76-84.

Infrared and Visible Image Registration for Power Equipments Based on Deep Learning

FU Tian,DENG Changzheng,HAN Xinyue,GONG Mengqing

(College of Electrical and New Energy, China Three Gorges University, Yichang 443002, China)

A registration fusion method of infrared and visible images of power equipment based on deep learning is proposed that aims at problems with difficult and long registration time of infrared and visible images of existing power equipment. In this study, feature extraction and feature matching are combined in a deep learning framework to directly learn the mapping relationship between image block pairs and matching labels for subsequent registration. In addition, a self-learning method using infrared image and its transform image to learn the mapping function is proposed to alleviate the problem of insufficient infrared image samples during training Simultaneously, transfer learning is used to reduce the training time and accelerate the network framework. The experimental results show that the performance index of this method is significantly improved compared with the other four registration algorithms. The average accuracy of this method is 89.909, which is 2.31%, 3.36%, 2.67%, and 0.82% higher than that of the other four algorithms, respectively. The average RMSE of this method is 2.521. Compared with the other four registration algorithms, the algorithm is reduced by 14.68%, 15.24%, 4.90%, and 1.04%, respectively. The average time of the algorithm is 5.625 s, which is reduced by 5.57%, 6.82%, 2.45%, and 1.75% respectively. The efficiency of infrared and visible image registration of the power equipment must be effectively improved.

image registration, deep learning, self-study, deep neural network, power equipment

TP391.41

A

1001-8891(2022)09-0936-08

2021-12-05;

2022-02-09.

付添(1994-),男,湖北云梦人,硕士研究生,主要从事图像处理,图像配准研究。

邓长征(1980-),男,湖北宜昌人,博士,副教授,主要从事图像处理,智能在线检测研究。E-mail:814496537@qq.com。