大田甘蓝作物行识别与对行喷雾控制系统设计与试验

韩长杰 郑 康, 赵学观 郑申玉 付 豪 翟长远

(1.新疆农业大学机电工程学院,乌鲁木齐 830052;2.北京市农林科学院智能装备技术研究中心,北京 100097;3.国家农业智能装备工程技术研究中心,北京 100097)

0 引言

农业机械自动对行技术能有效提高机具的定位精度、作业效率、降低漏作面积、减少劳动强度[1-3],被广泛用于收获[4]、喷药[5]、除草[6]等农业生产中。自动对行技术的核心是作物行识别与对行控制。机器视觉具备感知实时性强[7]、信息丰富[8]、成本低[9]等特点,广泛应用于作物行识别[10-13]。国内外研究人员基于机器视觉对作物行识别开展了深入的研究,提出了多种有效方法[14-16]。陈子文等[17]将不同Hough变换累加值获得的拟合直线投影到参数空间,通过K-means方法聚类参数空间数据,利用最优累加阈值下参数空间中的聚类质心作为识别的作物行。陈娇等[18]利用垂直投影获取作物行定位点并采用Hough变换对多行作物进行检测,算法耗时为219.4 ms。Hough变换可解决由于作物行的非平行性而难以建立感兴趣区域的问题,但Hough变换适应性有限,并且其计算量大,计算时间长。最小二乘法相较于Hough变换实时性表现较好,该方法通过对特征点集做最小二乘拟合获得作物行中心线,通常获取特征点集的方式分为条带分割法和移动窗口法。MONTALVO等[19]利用移动窗口法提出了一种高杂草密度玉米田作物行检测方法,在处理效率上优于经典的Hough变换。但上述方法受算法耗时、田间环境等因素限制,精准性与鲁棒性有待进一步提高。而且,均未针对作物行的缺苗情况进行针对性研究,难以满足实际作业需求。

作业机具在行走过程中,机具与作物行相对位置不固定、对行机构惯性大,要求对行控制系统能够快速响应,稳定运行[20-22]。常见的控制方法包括PID控制[23-24]、模糊控制[25-26]、最优控制[27-29]等。DONG等[30]设计了白芦笋收获机器人的行间导航系统,利用PID控制器实现轨迹跟踪。陈军等[31]在获得机具运动的期望值与目标值基础上,利用最优控制进行控制实现。然而上述方法在参数调整、克服大延时、非线性模型上的应用具有局限性。

本文提出一种多作物行自适应ROI的识别算法,融合垂直投影与条带分割法寻找特征点,进行最小二乘直线拟合。根据作物行中心线几何关系构建偏移补偿模型,选择经典PID中的PD控制,以期使机构执行量在田间偏差快速变化时得到强化调节。

1 对行喷药系统组成与工作原理

1.1 系统结构组成

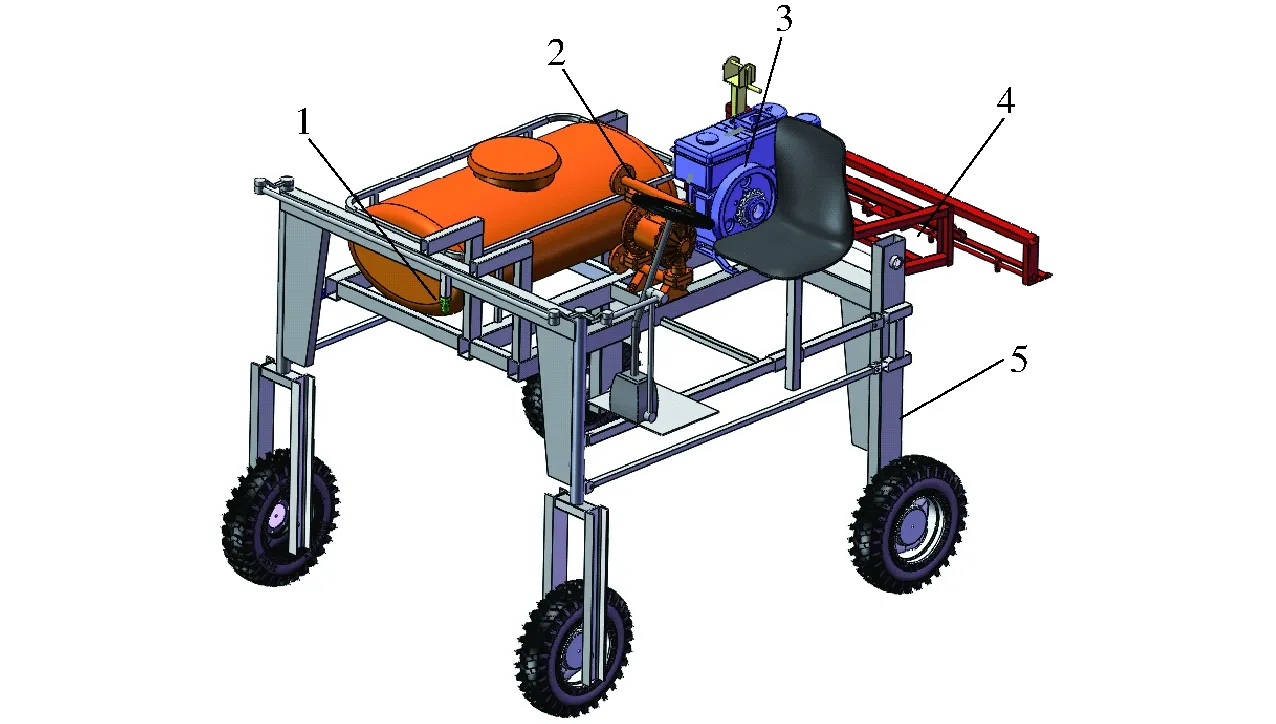

大田对行喷雾机结构如图1所示,主要由工业相机、供药系统、动力系统、对行机构、行走总成组成。喷雾机轮距为1.5 m,轴距为1.66 m。供药系统采用三缸柱塞泵,额定工作压力为8 MPa,流量为1.35 L/min。动力系统采用风冷柴油机,额定功率为33 kW,以保证机具在田间稳定运行。喷雾机幅宽为1.8 m,左右移动最大行程0.44 m,能提供4行喷雾。视觉采集设备为工业相机(LPCP10190_1080P型,新佳华电子有限公司),采集像素为1 920像素×1 080像素,焦距为2 mm,视场范围为1 320 mm×1 050 mm,安装在车体前部中心位置,距离地面0.9 m。

图1 对行喷雾机结构示意图Fig.1 Composition of row-oriented sprayer system1.工业相机 2.供药系统 3.动力系统 4.对行机构 5.行走总成

1.2 对行机构设计

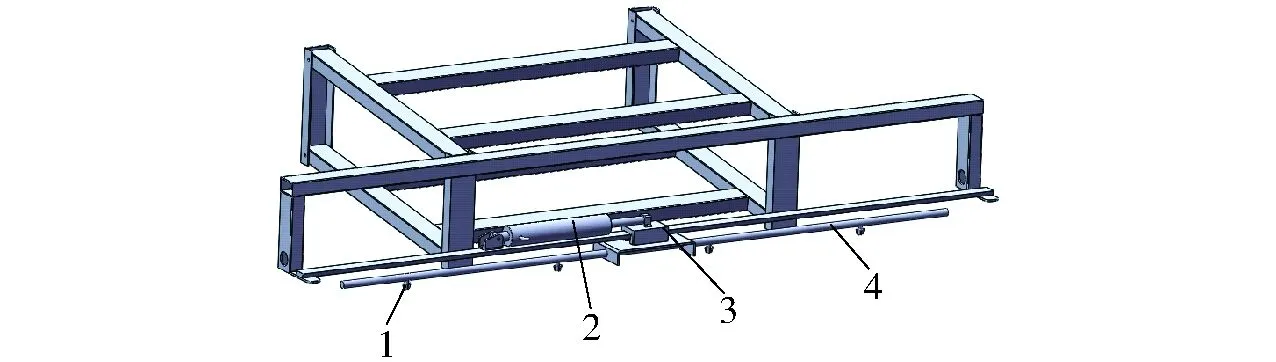

对行机构结构如图2所示,对行机构安装在喷雾机高度调整支架上,电动推杆一端固定在滑动模块的直线轨道上,另一端与移动滑轨的滑块连接,滑块通过固定件连接喷杆。当系统接收到执行信号时,电动推杆带动滑块做往复直线运动,实现对行动作。电动推杆选用LUILEC可编程电动推杆,行程为0.44 m,供电电压12 V,推力100 N时,速度可达0.18 m/s。

图2 对行机构结构示意图Fig.2 Structure diagram of row-oriented mechanism1.喷头 2.电动推杆 3.滑动模块 4.喷杆

1.3 控制系统软件设计

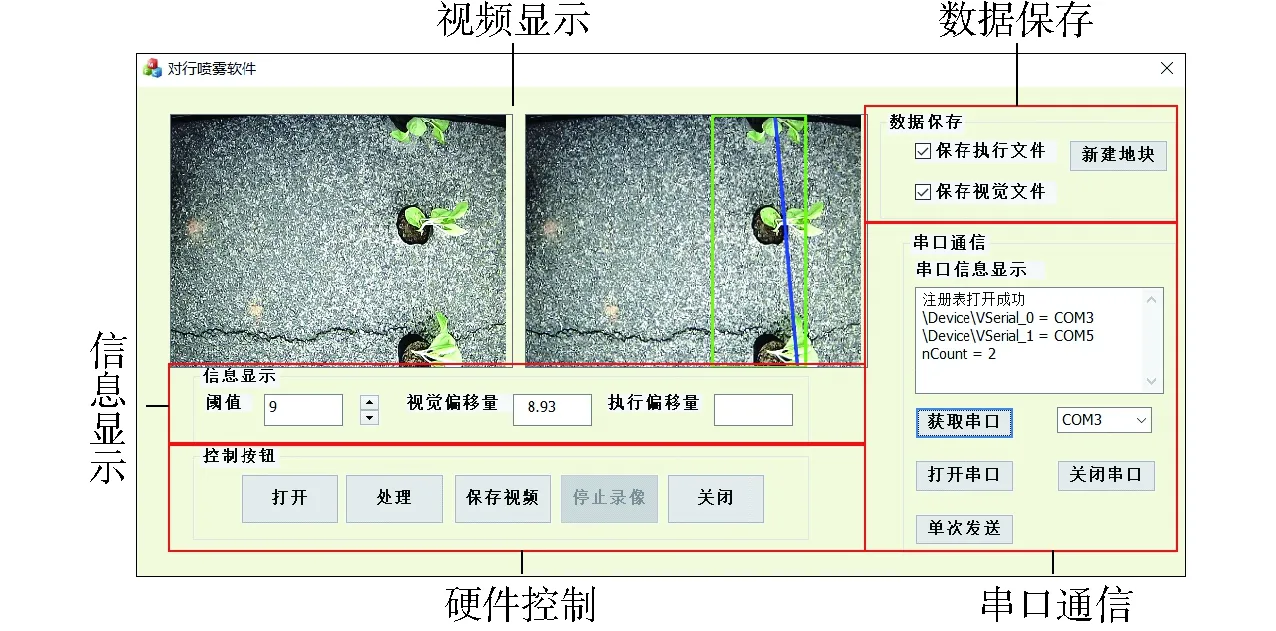

控制系统软件开发环境为基于MFC框架的Visual Studio软件,采用图像处理库 OpenCV进行算法实现。该软件主要实现甘蓝作物行实时检测、获取作物行偏移信息后与控制端的同步交互、在线保存试验数据的功能。如图3所示,软件界面包括视频显示窗口、信息显示窗口、硬件控制窗口、数据保存窗口、串口通信窗口。系统工作时,在视频显示窗口的左侧显示监控画面,右侧显示作物行识别画面;信息显示窗口可实时展示分割阈值、视觉检测偏移量、对行执行偏移量;硬件控制窗口通过点击按钮可实现工业相机的打开关闭、算法处理、视频保存等功能;数据保存窗口通过新建地块按钮保存每次试验的视觉检测偏移量和对行执行偏移量;串口通信窗口可与下位机进行实时通信。

图3 控制系统软件界面Fig.3 Control system software interface

1.4 控制系统设计

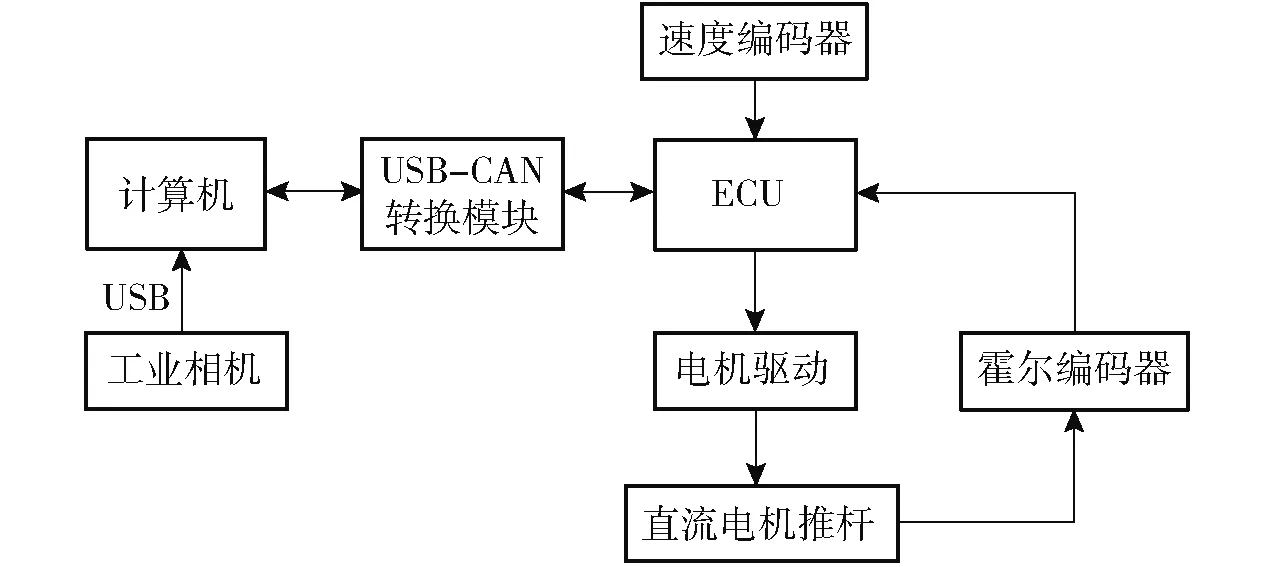

对行喷雾控制系统组成如图4所示,工业相机采集图像经USB传输至计算机,计算机的控制系统软件实时计算作物行偏移量,并通过USB-CAN转接方式与电子控制单元(Electronic control unit,ECU)通信,其中计算机、ECU通过USB-CAN转换模块连接。同时,安装的速度编码器采集机具行驶速度v1传输至ECU,根据偏移补偿模型 ECU获得对行机构响应速度v2。ECU通过电机驱动采用脉宽调制(Pulse-width modulation,PWM)控制直流电机速度调节推杆横移速度,利用霍尔编码器实时获得推杆偏移量,反馈至ECU,实现位移闭环控制。

图4 对行控制系统组成Fig.4 Composition of row-oriented control system

2 基于机器视觉的作物行识别

2.1 图像预处理

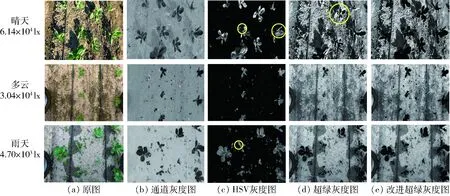

田间图像信息复杂,图像背景包含杂草、土壤、沙砾等;同时田间采集的图像颜色特征提取会受光照不均、阴影、反射等因素影响。为实现作物与背景可靠分割,采用4种不同的分割算方法在不同天气情况下做比较,选择效果最优的算法。

(1)Lab颜色空间的a通道表示从绿色到红色的过渡。将采集的数字图像从RGB颜色空间转换为Lab颜色空间,而后将Lab颜色空间分离成L通道、a通道、b通道,利用a通道对绿色信息的敏感性,将彩色信息与灰度信息分离,a通道灰度图如图5b所示。

(2) HSV颜色空间由色调、饱和度、亮度3个通道描述。为获得目标作物的颜色分割,根据 HSV颜色空间范围,将H通道、S通道、V通道设置在绿色阈值范围内,对HSV图像进行掩模操作,得到其灰度图,如图5c所示。

(3) RGB颜色空间可分离成3个独立的颜色分量,利用超绿算子在3个颜色分量前乘以对应的权重,得到超绿 (Extra green,ExG)计算式为

ExG=2G-R-B

(1)

灰度图像如图5d所示。

(4)通常绿色作物颜色分量G的亮度远高于颜色分量R、B,土壤颜色分量B的亮度高于颜色分量R、G,由此做出相应的颜色分量组合G-R、G-B,进行与操作,得到改进ExG计算式为

I=(G-R)&(G-B)

(2)

图5 灰度图比较Fig.5 Grayscale images in different ways

改进超绿灰度图像如图5e所示。由图5可知,Lab-a分割算法在晴天和多云天气条件下可将目标作物较为完整的分离,但在雨天条件下存在较多的噪声,同时Lab-a算法耗时107 ms。利用HSV分割算法,可以使目标作物与土壤背景明显分割,但部分图像有不同程度的叶面孔洞,并且HSV分割算法在4种分割算法中耗时最多。ExG算法的灰度图像在晴天光照下作物叶片存在过度分割的现象,给后期处理增加难度。改进的ExG算法展现出较好的分割效果,作物叶片分割完整清晰,较小的干扰噪声被有效抑制。通过统计以上4种算法耗时得到Lab-a算法耗时107 ms,HSV算法耗时260 ms,超绿ExG算法耗时19 ms,改进的ExG算法耗时24 ms,综合考虑算法的分割效果、算法耗时、后期形态学处理复杂度,选择改进的ExG算法作为作物与土壤背景分割方法。由于使用固定阈值很难达到作物与背景分割,故使用最大类间方差求取动态阈值。改进ExG分割算子记为

(3)

式中T1——G-R阈值T2——G-B阈值

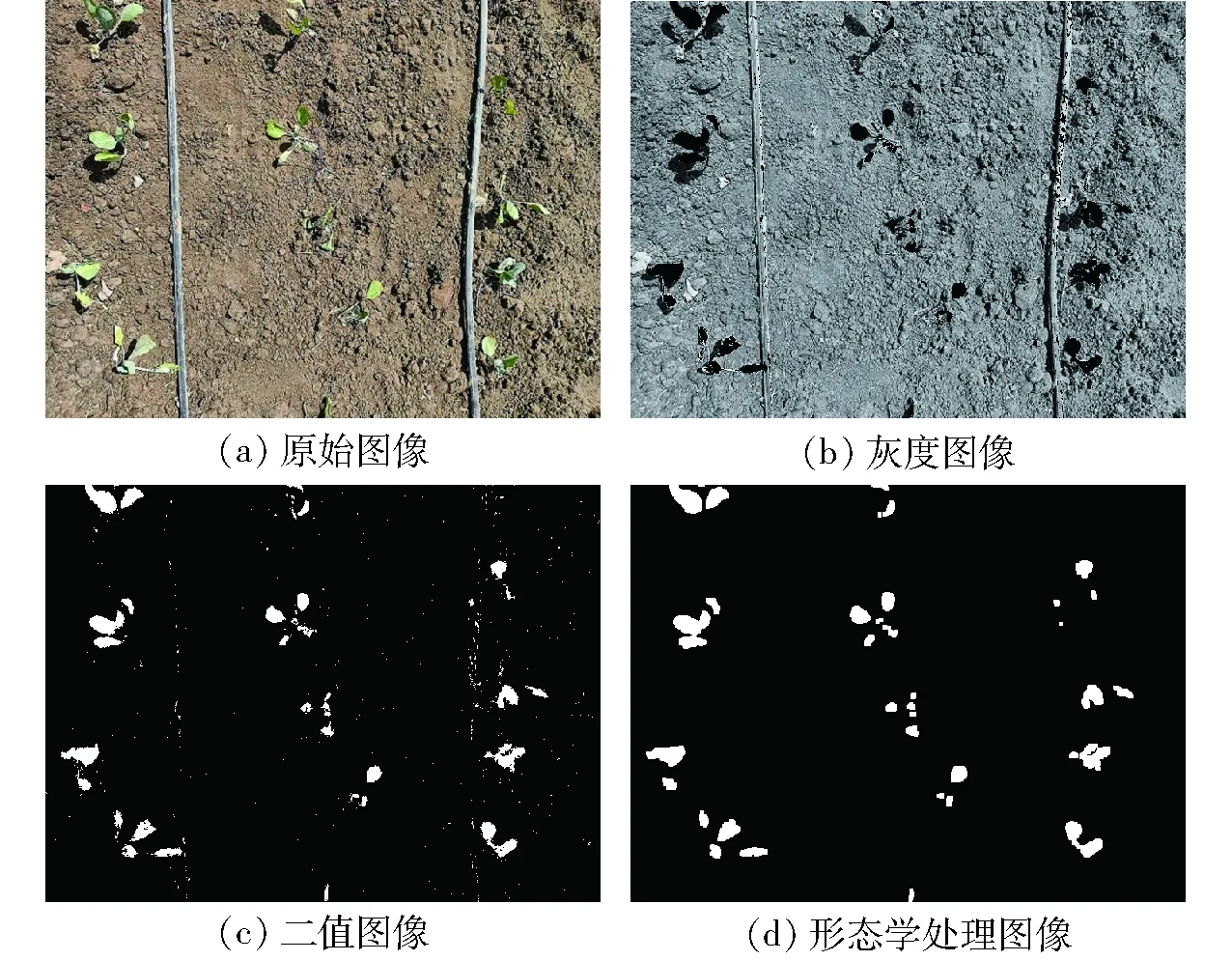

由于前期分割算法效果良好,形态学处理仅需对二值图像先进行闭运算消除噪声,后进行开运算填充部分孔洞,结果如图6所示。

图6 二值化效果Fig.6 Binary image and morphological processing image

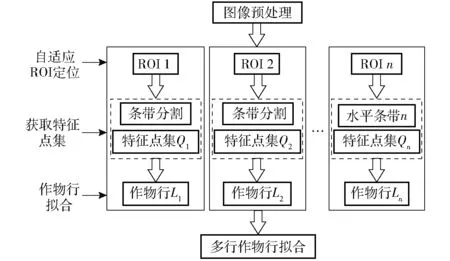

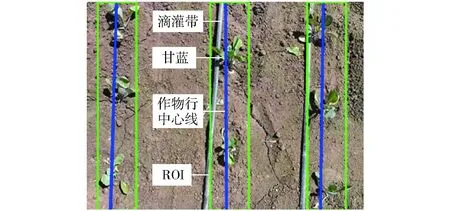

2.2 作物行检测

为实时准确获取作物行中心线,算法应具有抗噪声干扰、耗时短等特点。通过建立多作物行自适应感兴趣区域(Region of intresting,ROI)确定多作物行位置,能有效减少非行内噪声影响;利用条带分割与限定阈值垂直投影的方式获取ROI内的特征点,可以避免在获取特征点时分类算法耗时长的问题。对各个特征点集做最小二乘拟合提取作物行中心线,可提升算法处理效率。

2.2.1自适应ROI

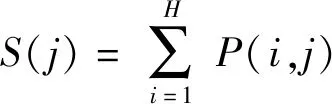

甘蓝采用机械化移栽定植的方式,其种植特点可以为作物行定位提供视觉特征。本文采用垂直投影法对预处理图像进行ROI划分。已知预处理图像宽度为W,高度为H,垂直投影表达式为

(4)

式中 (i,j)——垂直投影点的坐标

P(i,j)——垂直投影的目标像素

S(j)——第j列目标像素的累加值

由于株间距大、田间噪声、叶片分离,造成垂直投影存在很多间断的细小波峰,为避免细小波峰的干扰,采用均值滤波对垂直投影直方图进行平滑处理,滤波结果如图7所示。

图7 垂直投影滤波效果Fig.7 Projected images with filter

图8 算法分析Fig.8 Algorithm analysis diagram

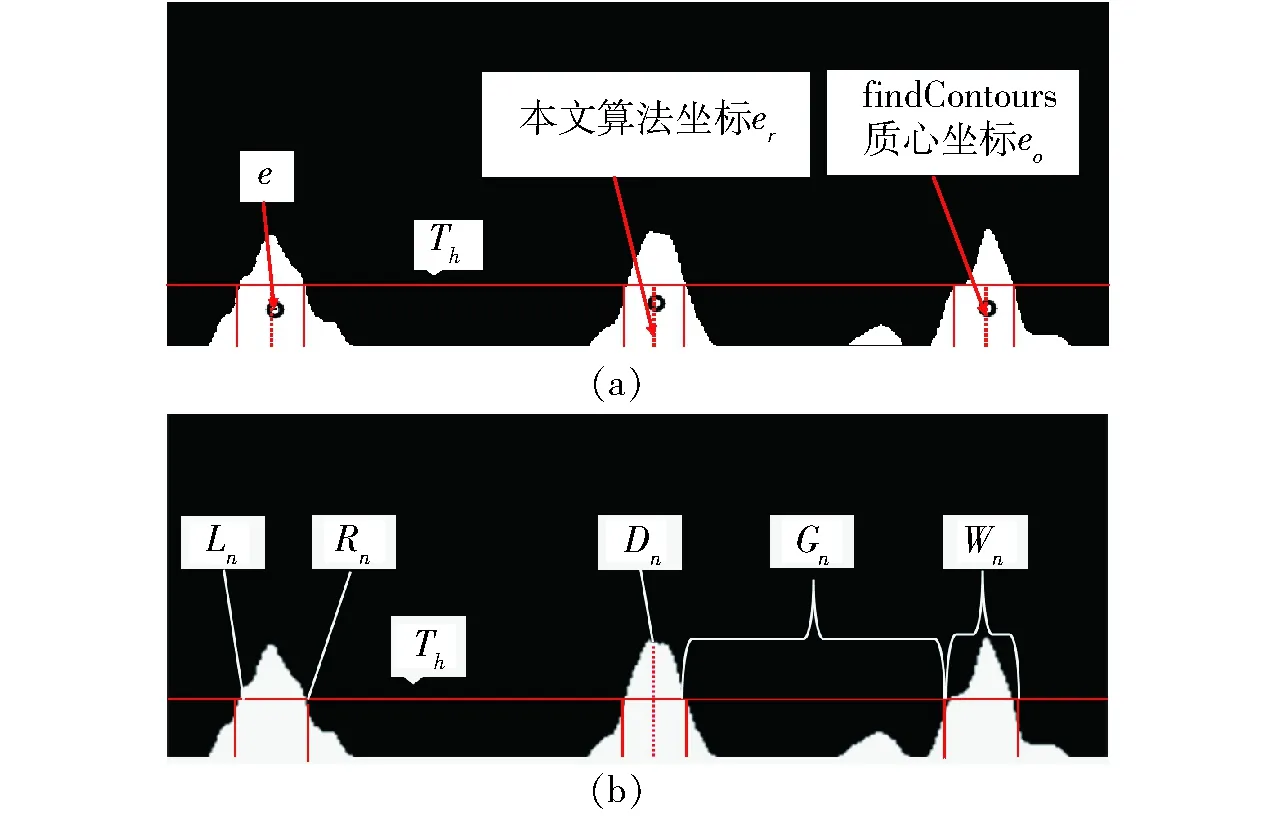

表1 系数选择Tab.1 Coefficient selection

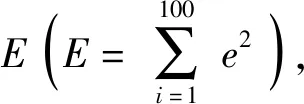

由图8可得到数学表达式为

(5)

式中Ln——上升沿边界

Rn——下降沿边界

S(j)max——目标像素最大累加值

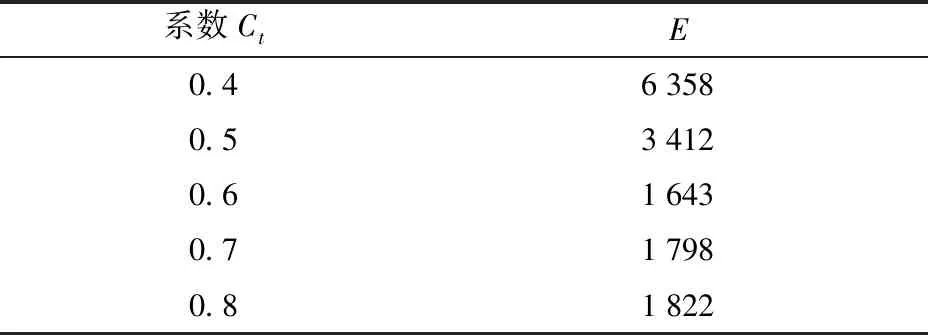

如图8b所示,上下沿边界之间的宽度为Wn,各个宽度之间的间隙为Gn,两个上下沿边界的中心为作物行感兴趣区域定位点Dn。当Wn小于上下边界之间的平均宽度时,将该宽度上下边界坐标舍去。当Gn小于各个宽度之间的间隙平均值时,将该间隙两侧上下沿宽度合并。由此,根据Dn的位置获得ROI的定位点,建立自适应ROI,定位效果如图9所示。

图9 ROI定位图Fig.9 Images with ROI located

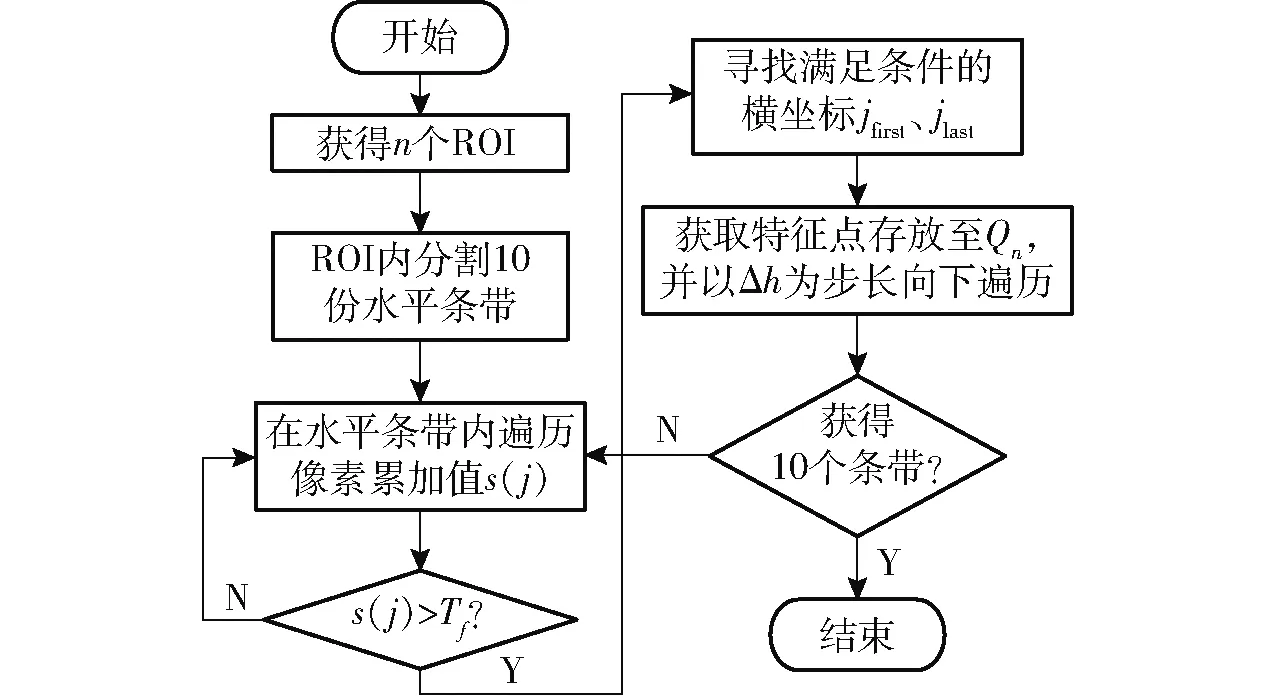

2.2.2特征点集获取

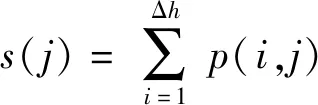

特征点获取技术路线如图10所示,确定ROI位置后,需要在ROI内寻找特征点。将每个ROI进行条带分割,并对条带内像素进行垂直投影处理。已知ROI宽度为w,高度为h;ROI内条带尺寸为w×Δh,ROI内条带个数为m=h/Δh,m取10。条带垂直投影的数学表达式为

(6)

式中p(i,j)——条带中目标像素

s(j) ——条带中目标像素累加值

图10 特征点获取技术路线图Fig.10 Feature point acquisition technology roadmap

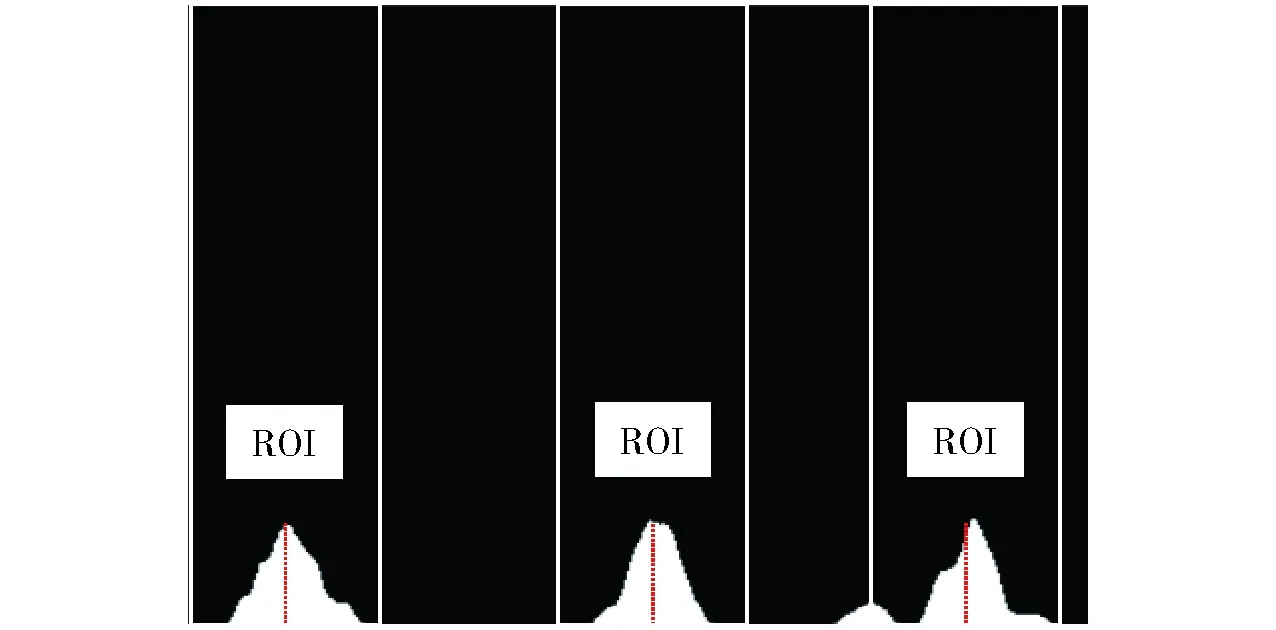

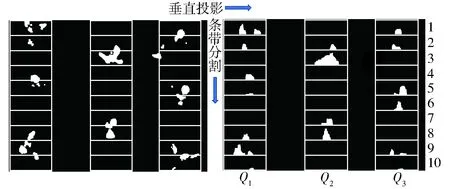

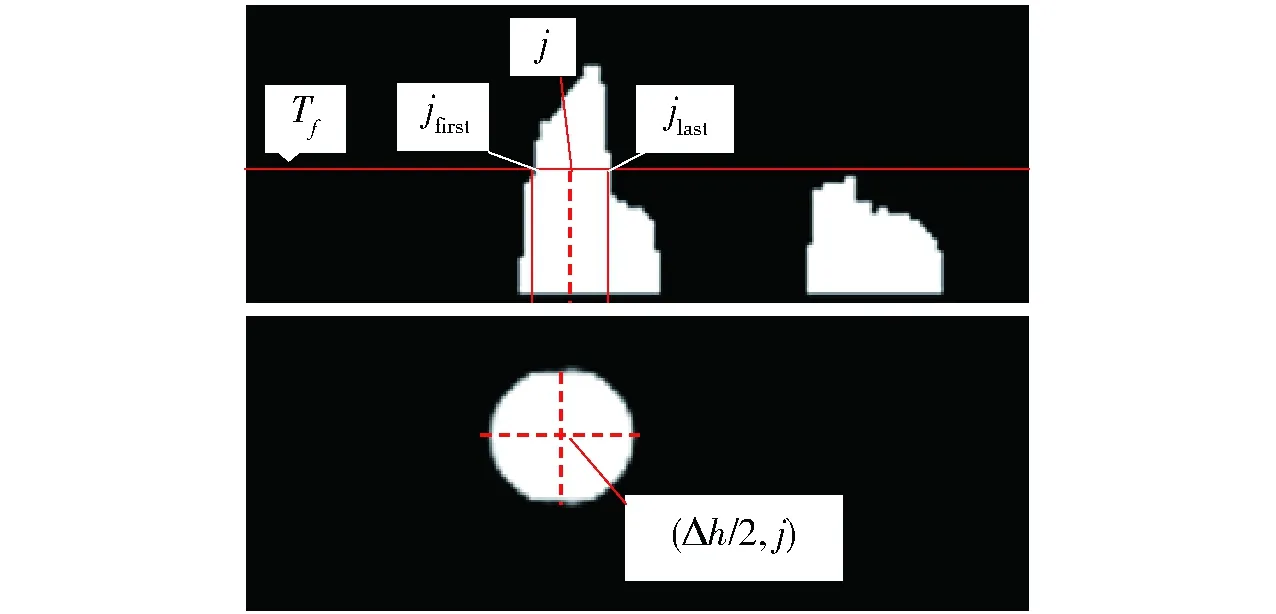

在预处理图像中列向叶面面积占比越大,垂直投影中列向目标像素累加值越高。算法设计如下:从左至右遍历条带s(j),当s(j)小于限定阈值Tf时,将其排除统计范围;反之,继续遍历,直至遍历出满足大于限定阈值Tf的列高s(j),并记录该列高的横坐标j。实际情况中,有若干个符合条件的列高,故将第1个符合条件列高的横坐标jfirst和最后1个符合条件列高横坐标jlast两者求和取中值,确定作物行特征点(Δh/2,j)坐标。并在ROI内以步长Δh向下遍历,得到若干特征点,并存放至特征点集Qn,直至将ROI内所有水平条带遍历完成方可结束,算法效果如图11所示。

图11 条带分割的垂直投影图Fig.11 Image of projected stripes

在典型条带(Q1,1)中,限定阈值过滤了不符合要求的垂直投影,保留了叶片面积占比较大的垂直投影,寻找到满足限定阈值条件的首个与末个的列高并记录横坐标,并取两者中值。对满足条件的取值范围进行重绘,可以看出垂直投影中值坐标恰与特征点位置对应(图12)。

图12 典型条带(Q1,1)示意图Fig.12 Typical strip of (Q1,1)

2.2.3作物行拟合

作物行拟合流程如图13所示,预处理图像经过自适应ROI定位,建立若干个ROI窗口,每个ROI通过水平条带的划分获取作物行特征点,将各自ROI内的特征点存入对应的特征点集Qn。由于特征点的非线性分布,不能获得精确的函数,但可以通过最小平方和误差寻找特征点的最佳函数拟合。在获得作物行特征点集参数Qn(xi,yi)条件下,假设拟合中心线的参数估计量为a、b,直线方程为

yi=axi+b(i=1,2,…,n)

(7)

其中

(8)

(9)

由式(8)、(9)反解出a、b的最佳组合,获得最小二乘拟合直线。

图13 作物行拟合流程图Fig.13 Procedure of crop-row fitting

在作物行检测中(图14),3个作物行取得了3个特征点集,利用最小二乘拟合,将拟合直线重映射到原图像,自适应ROI框选出各个作物行位置范围,作物行中心线穿过每个作物的质心,寻找出最优路径。

图14 作物行检测图Fig.14 Image of final crop-row detection

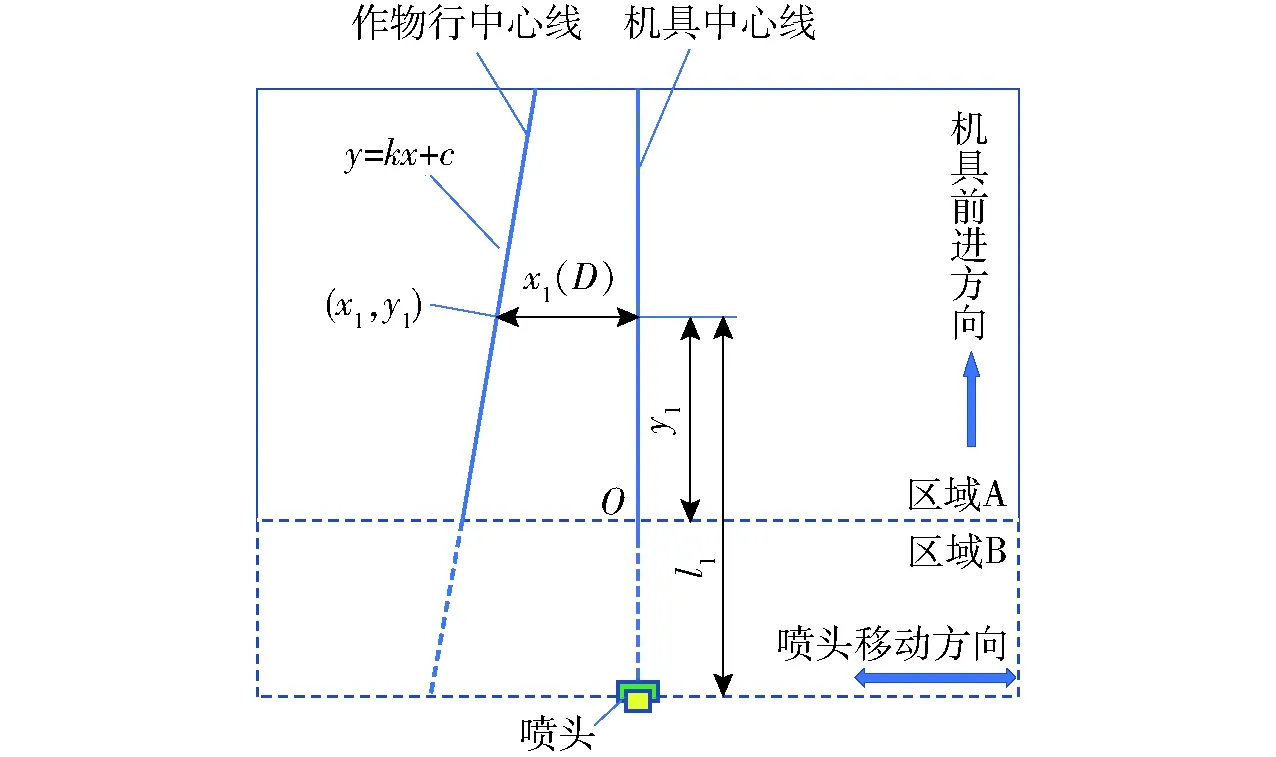

3 偏移量补偿模型与对行控制实现

为实现对行喷雾,需要计算作物行偏移信息。作物行偏移量为喷雾机喷头在水平方向上与作物行中心线的直线距离。在偏移量补偿模型中(图15),区域A为相机视场区域,区域B为视场盲区。作物行中心线为y=kx+c,点(x1,y1)为区域A内作物行中心线上一点到绝对坐标系O的相对坐标,D为该点到喷头的横向实际距离,可得

(10)

图15 偏移量补偿模型Fig.15 Offset compensation model

工业相机安装在喷雾机前端,喷头安装在喷雾机尾部,两者之间存在一定距离,即点(x1,y1)到喷头的纵向实际距离为l1。由此可知,对行执行机构接收到执行信号时不能立即执行,需要调速控制。安装在喷药机地轮上的速度编码器得到机具速度为v1,为保证执行机构的运动稳定性,需要将对行延时执行时间t1设置安全边界,即

(11)

只有当机具前进l1所用时间满足安全边界条件时,对行机构才能执行完成补偿偏移量D。据此可以建立偏移量补偿模型,得到对行机构响应速度为

(12)

为提升偏移量补偿模型的响应速度,引入基于PID控制轨迹追踪算法。根据上述推导的对行机构运动模型,设计位置控制环,即

(13)

式中d——偏移量误差

kp、ki、kd——比例系数、积分系数、微分系数

Δd0——第1次偏移量误差

O——PWM控制信号占空比

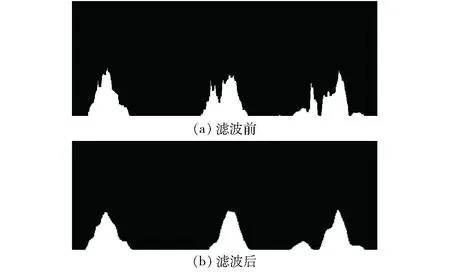

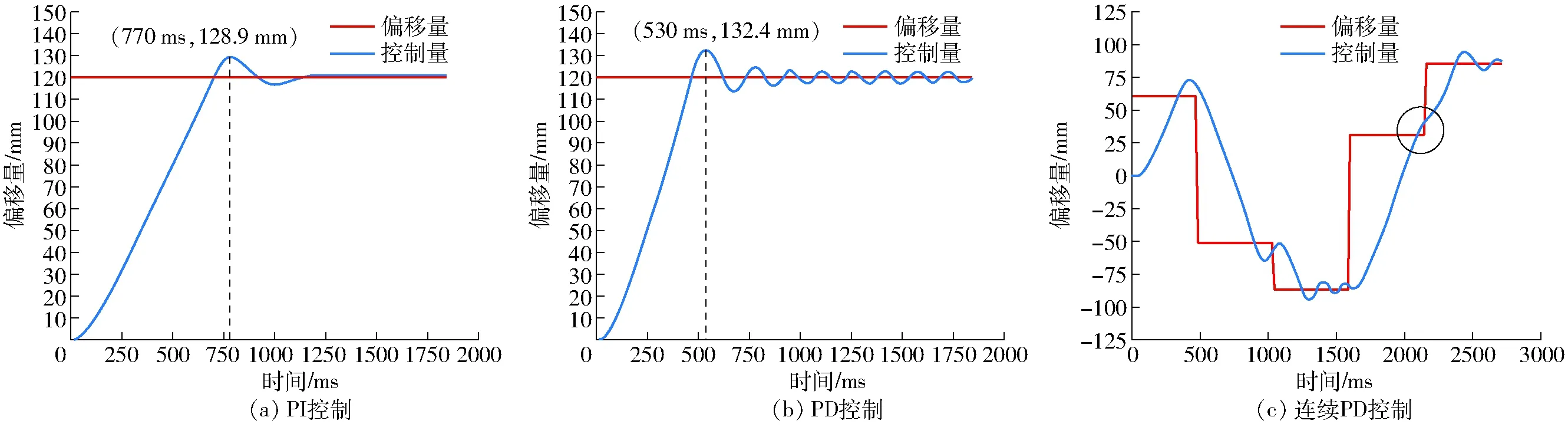

图16 PI、PD控制比较Fig.16 Comparison of PID controls

并对PI控制、PD控制进行对比分析,通过将指定的偏移量与实际的控制量以10 ms为周期实时打印并保存至计算机,结果如图16a、16b所示,目标量在120 mm时,PI控制、PD控制的最大偏差值分别为8.9、12.4 mm,PI控制响应时间为770 ms,PD控制的响应时间为530 ms,并且在该段时间内PD控制的平均稳态误差为2.9 mm。如图16c所示,在机具行进过程中对行执行机构频繁动作,控制系统给推杆电机的信号为频繁阶跃的状态,系统常出现未达到稳态就响应下次的情形,系统侧重于较短的响应时间,并且稳态误差相对于对行喷雾处于接受范围内,因此选择PD控制。为减少误差调节过程中出现的振荡、失稳现象,使得执行机构响应速度在短时间内快速强化,将积分系数ki置零,通过手动整定,得到比例系数kp为1.5,微分系数kd为20。

4 试验与结果分析

4.1 作物行识别试验

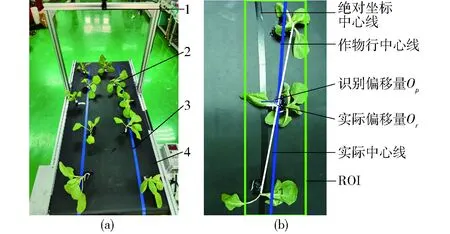

工业相机固定在同步带中心线上方80 cm处,进行实时拍照。在同步带粘贴绝缘胶带作为绝对坐标中心线,并在绝对坐标中心线-10~10 cm范围内布置甘蓝行,每行布置10枚植株,与绝对坐标中心线的偏移量采用计算机提供的随机数。甘蓝植株通过自制的苗托固定在同步带平台的皮带上,通过驱动器调节同步带速度,以模拟喷药机与地面的相对运动。

为验证识别算法的准确性,分别进行了单行和双行作物行识别对比试验,每种情况进行10组重复试验,识别单行、双行作物图像各80幅。根据相机视场像素宽度与物理宽度进行图像测距标定,以此统计图像的识别偏差、识别偏差平均值、识别准确率。实验室试验如图17所示,甘蓝与绝对坐标中心线的坐标已知,连接两株作物可以得到一条实际中心线,该条线与绝对坐标中心线的截距是实际偏移量Or;识别算法得到的作物行中心线与绝对坐标中心线偏移量为识别偏移量Op,实际偏移量与识别偏移量之差的绝对值为识别偏差Ep,当识别偏差大于5 cm视为识别无效。针对两行作物时能够完整提取两行作物行中心线视为识别有效。

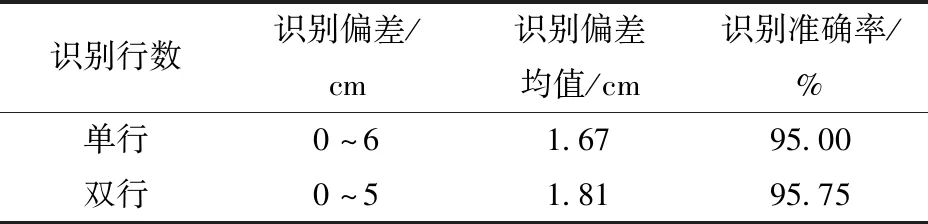

统计结果如表2所示,单行识别偏差为0~6 cm,双行识别偏差为0~5 cm,由于叶片倒伏超出ROI范围,改变了拟合线的权重,导致偏差范围增大。在单行识别时,识别偏差均值为1.67 cm;在双行识别时,识别偏差均值为1.81 cm,单、双行识别偏差均值并无明显差别,说明在双行情况下识别效果依然稳定,识别准确率均在95.00%以上,满足识别要求。

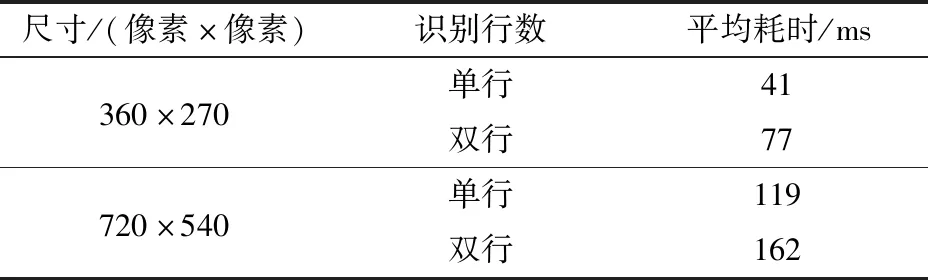

不同像素的图像耗时对比结果如表3所示。

图17 实验室试验Fig.17 Laboratory test1.工业相机 2.甘蓝幼苗 3.绝对坐标中心线 4.同步带

表2 实验室试验结果Tab.2 Laboratory test results

表3 算法耗时Tab.3 Algorithm time-consuming statistics

由表3可知,算法最小平均耗时为41 ms;算法最大平均耗时为162 ms,可以满足实时提取作物行中心线。对比单、双行可以看出,目标像素越多,算法耗时越久。理论上,双行平均耗时是单行平均耗时的两倍,但从表3的720像素×540像素可以看出,双行耗时明显小于单行耗时的两倍,由于识别算法提出的自适应ROI,仅在ROI区域内进行算法处理,不对整幅图像进行处理,提升了双行识别的运算速度。

4.2 缺苗鲁棒性与光照强度试验

4.2.1缺苗鲁棒性试验

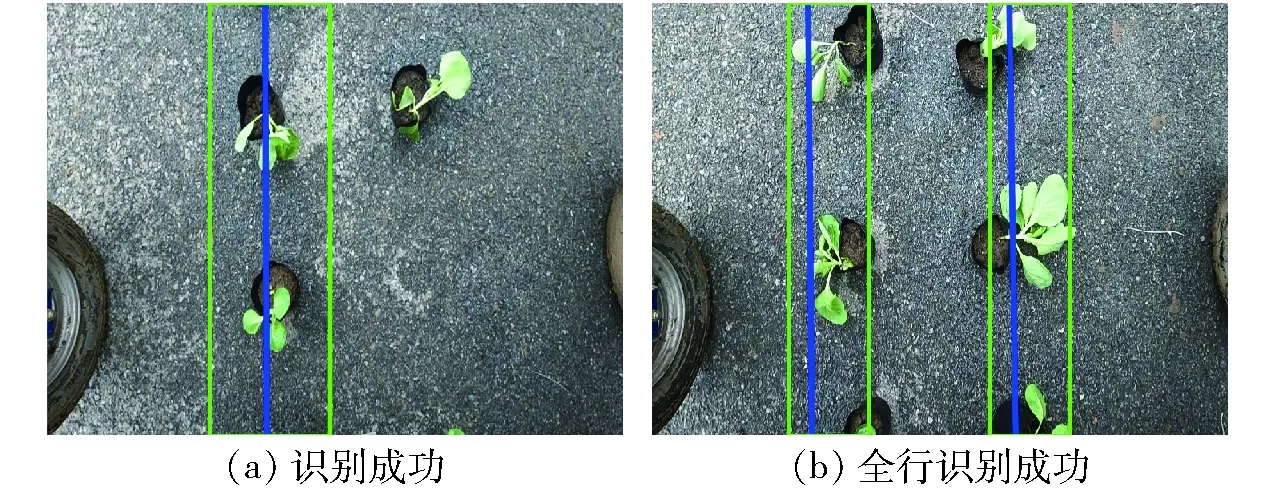

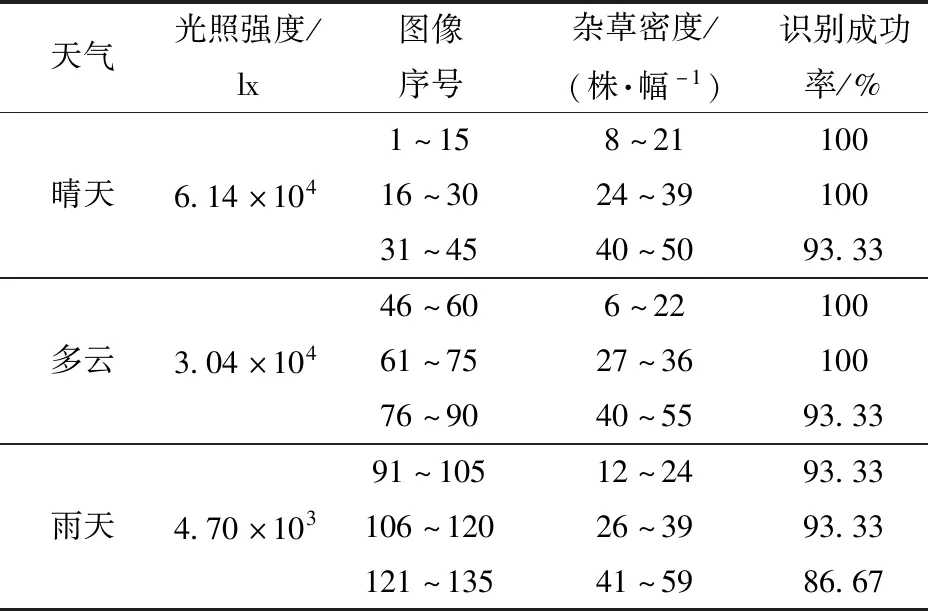

场地试验在小汤山国家精准农业研究示范基地开展,采用视频采集及离线处理的方式进行。视频采集设备为GoPro相机HERO_9,采集分辨率为1 920像素×1 080像素,视频输出格式为MP4。为评估算法缺苗情况的鲁棒性,结合旱地移栽机械的性能指标[32],考虑不同程度的缺苗情况,将作物行设置为重度(缺苗率15%)、中度(缺苗率10%)、轻度(缺苗率5%)。考虑单、双行对比,在水泥地布置缺苗的单、双作物行。当机具朝作物行方向前进时,打开GoPro相机录像,完成视频采集。视频利用Free Video to JPG Converter软件以10帧/s的频率转换为JPG图像,对321幅图像进行处理,单行情况下,识别算法能够识别作物行并提供作物行偏移量,视为识别成功;双行情况下,场地试验如图18所示,在缺苗条件下能够识别一条及以上的作物行中心线并提供作物行偏移量,视为识别成功,当识别算法能够识别图像中所有作物行时,视为全行识别成功。

图18 场地试验Fig.18 Pavement test

场地试验结果如表4所示,单行重度缺苗情况下识别准确率仅为87.37%;双行重度缺苗情况下识别准确率为93.11%,说明在重度缺苗的情况下,双行识别准确率优势明显,主要是识别算法的多行自适应ROI设计能够在多行缺苗时提供一条及以上的作物行中心线,提升了识别的准确率,保证算法在极端条件下的稳定性。对比单行识别准确率与双行的全行识别准确率,在各个缺苗情况下,双行的全行识别准确率均高于单行识别准确率。在轻度缺苗情况下,单行识别准确率为93.33%,双行的全行识别准确率96.83%,由于多行因素可以给识别算法提供更多的颜色信息,使得全行识别准确率得到提升,说明了识别算法在多行条件下有较好的适应性。

表4 场地试验结果Tab.4 Pavement test results %

4.2.2光照强度试验

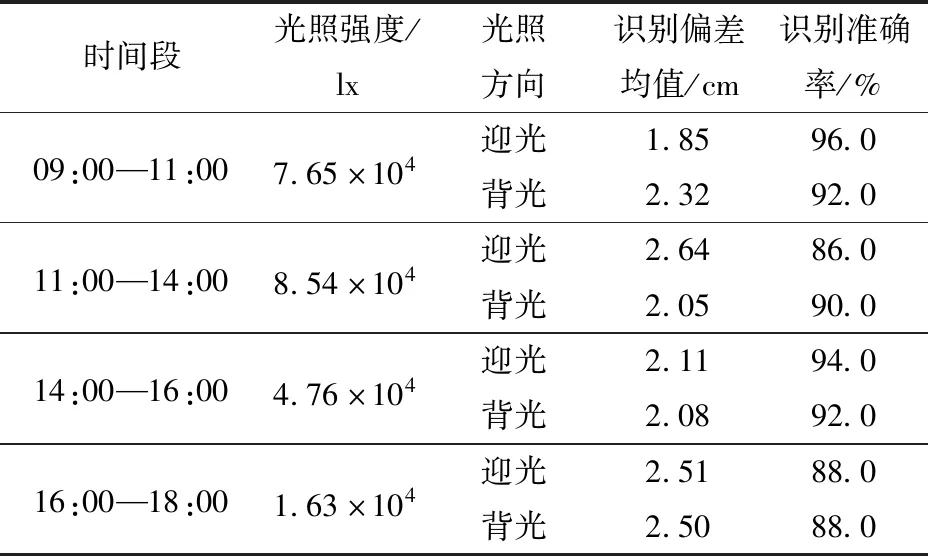

为研究光照强度对识别算法的影响,在小汤山国家精准农业研究示范基地基于作物行识别算法进行全天不同时段的光照试验。利用小型气象站获取田间光照强度信息,在田间按照株距40 cm、行距35 cm布置双行甘蓝行,每行50株,并在行间居中处放置位置坐标尺,记录每个植株在位置坐标尺的坐标,得到作物行的实际偏移量。工业相机安装在大田对行喷雾样机前端中心线处。机具行走时,识别系统实时保存识别偏移量,实际偏移量与识别偏移量之差的绝对值为识别偏差。当识别系统提供一条及以上作物行中心线且识别偏差小于5 cm,视为识别准确。

不同光照强度试验结果如表5所示。在7.65×104lx的迎光条件下,算法识别效果最好,在8.54×104lx的迎光条件下,算法识别效果最差,说明当光照过于强烈会影响前期的目标分割,进而影响作物行定位效果。当光照强度在1.63×104lx时,算法识别准确率普遍较低,如图19d、19h所示,由于光照强度不足,迎光、背光都会在机具与作物上产生阴影,导致光照不均,影响识别定位效果。当光照强度在4.76×104lx时,迎光、背光的试验结果较为均衡,说明在合适的光照条件时识别算法的结果较为稳定。结合表5、图19可以看出,在时间段11:00—14:00、16:00—18:00内时,过低、过高的光照强度对识别准确率存在消极影响,在时间段09:00—11:00、14:00—16:00内试验的识别准确率均不小于92.0%,识别偏差均值也相对较低,说明在合适、均匀的光照条件下,算法识别效果会有明显提升。

表5 不同光照试验结果Tab.5 Light intensity test results

图19 光照测试结果示意图Fig.19 Light intensity test results

4.3 田间试验

4.3.1识别算法田间试验

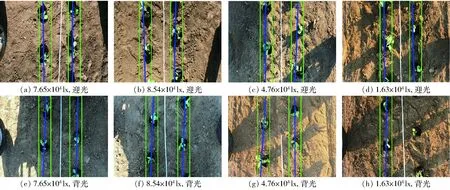

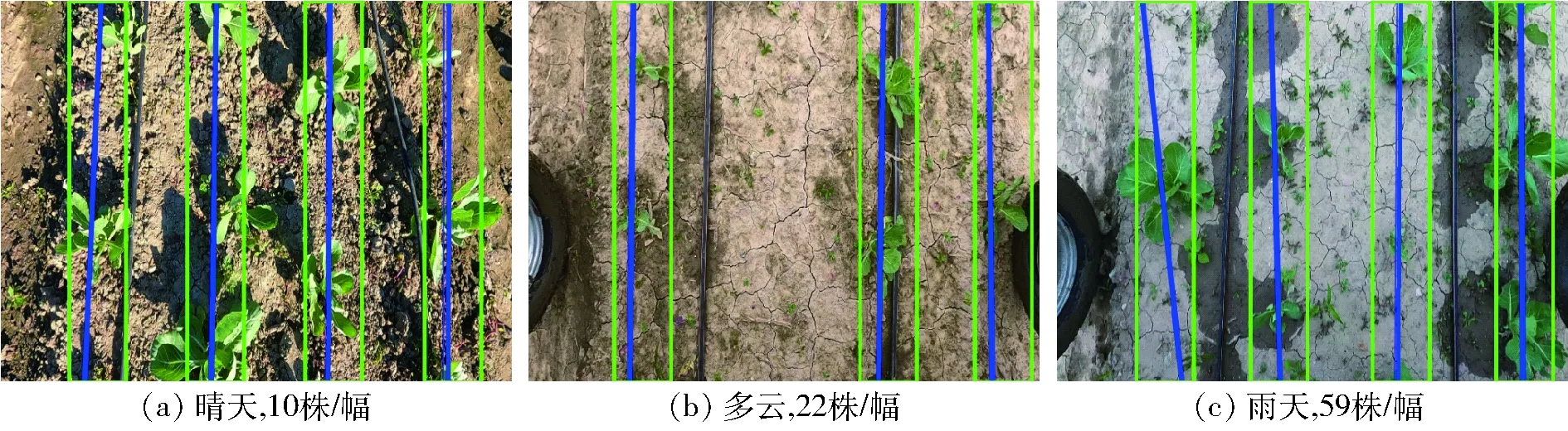

为探究田间不同天气、不同杂草密度下算法的识别效果,利用GoPro相机采集晴天、多云、雨天甘蓝作物行视频,并对视频进行分帧处理。在3种天气条件下,对不同杂草密度区间各取15幅图像作为试验材料,通过人工计数得到每幅图像的杂草数量。利用识别算法对图像进行处理,当识别结果可提供一条及以上的作物行中心线,且与人工提取中心线的偏移误差小于20像素时(720像素×540像素),视为识别成功[14-17]。

杂草试验结果如表6所示,在晴天、多云环境下,杂草密度为8~39株/幅时,识别成功率为100%,如图20a、20b所示,合适的光照条件、较小的杂草密度,使得识别算法对目标作物的分割定位准确,为作物行拟合奠定好的基础。雨水条件下,受光照条件影响算法识别成功率整体下降,当杂草密度为41~59株/幅时,算法识别成功率仅为86.67%,如图20c所示,杂草密度的上升,增加了作物行识别难度。总体上,伴随着杂草密度的递减、光照强度达到合理区间,识别成功率呈上升趋势。在不同天气、不同杂草密度下,算法的识别成功率较为稳定,算法平均识别成功率为95.56%,可为对行喷雾作业提供视觉引导。

表6 杂草试验结果Tab.6 Weed pressure test results

图20 杂草测试Fig.20 Weed test results

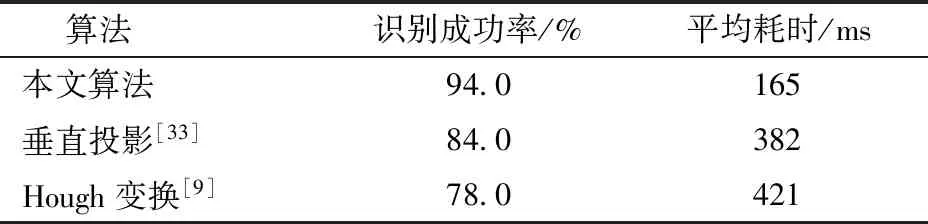

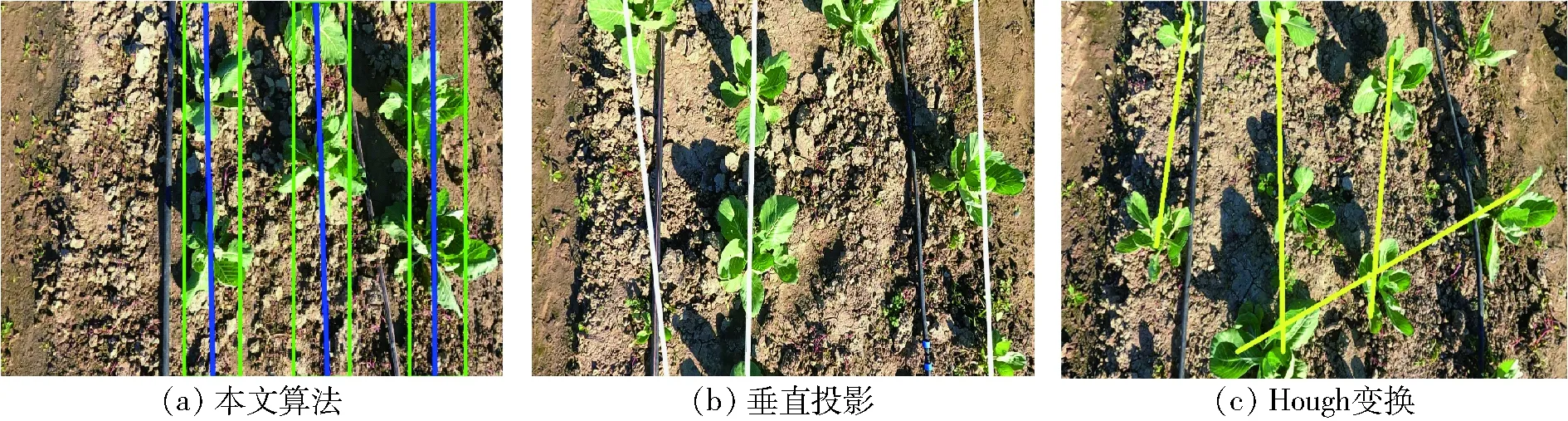

利用采集的50幅田间图像,将本文算法与其他作物行识别算法进行比较。由表7可知,垂直投影的识别成功率为84.0%,平均耗时为382 ms,Hough变换的识别成功率为78.0%,平均耗时为421 ms。垂直投影法受限于作物行特征点的聚类问题,使得垂直投影法在算法耗时上不占优势。如图21c所示,在直线拟合时,Hough变换需要控制的参数较多,时常出现拟合线串行的情形,对识别成功率影响较大。本文算法利用自适应ROI实现区域内垂直投影,避免了耗时较大的聚类过程,提高了作物行识别的实时性。

表7 算法比较Tab.7 Algorithm comparison

图21 不同算法结果对比Fig.21 Results of algorithm comparison

4.3.2系统田间试验

图22 田间试验Fig.22 Field test

田间试验在小汤山国家精准农业研究示范基地的甘蓝试验田进行。如图22所示,甘蓝田为起垄种植,垄宽1.5 m,垄距0.6 m,每垄种植4行甘蓝,行距0.4 m,株距0.35 m。工业相机安装在大田对行喷雾样机前端中心线处,为记录喷杆的运动轨迹,在喷杆的喷头中间固定沙漏,并在两作物行间布置位置坐标尺。控制系统部署于车载计算机,试验时,大田对行喷雾机匀速向前行驶,对行机构接收指令带动沙漏在作物行间留下撒沙痕迹。撒沙完成后,人工量取每株甘蓝与沙痕的横向偏移,并记录当前位置坐标。

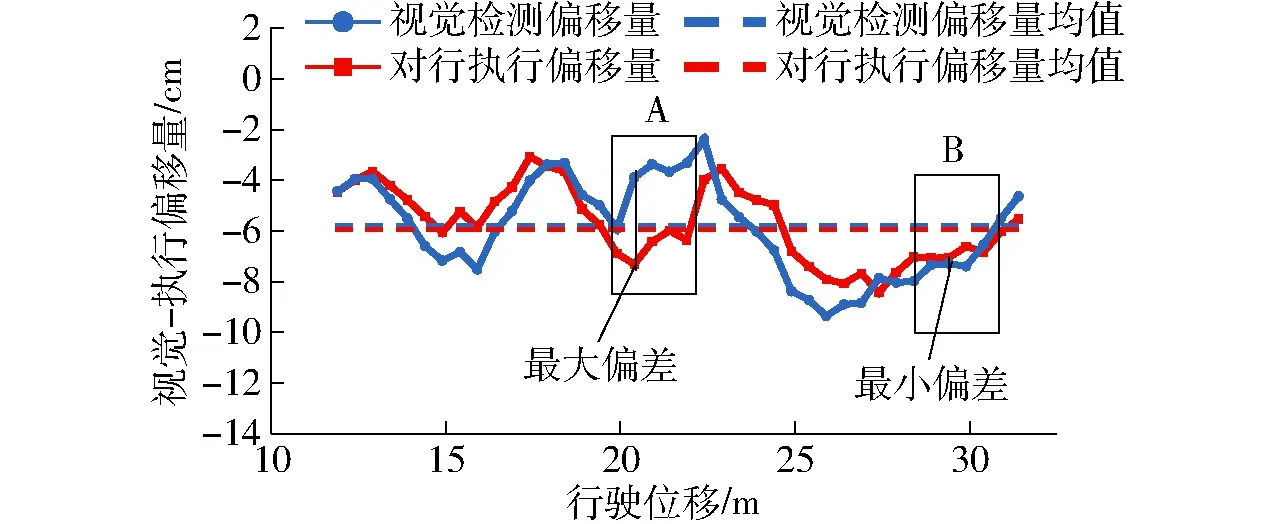

图23 视觉-执行偏移量拟合图Fig.23 Fitting line diagram of visual-execution offset

通过记录喷雾机行驶的视觉检测、对行执行偏移量,选取典型位移段中的40组样本点绘制视觉-执行偏移量拟合点线图,如图23所示。整体上,对行执行偏移有明显地向视觉检测偏移贴近趋势。当行驶位移在A段时,该段的视觉检测偏移量与对行执行偏移量偏差大于其他段偏差,最大偏差达到3.42 cm,主要是该段有缺苗情况,对行机构调整时间相对减少造成的。当行驶位移在B段时,该段偏差小于其他段偏差,最小偏差为0.22 cm,由于该段种植条件好,使得执行机构无需过多调整。统计视觉检测偏移量均值为-5.77 cm,对行执行偏移量均值为-5.92 cm,两者的均值偏差为0.15 cm,可见当视觉信号发出后,对行执行机构能及时响应,稳定执行。

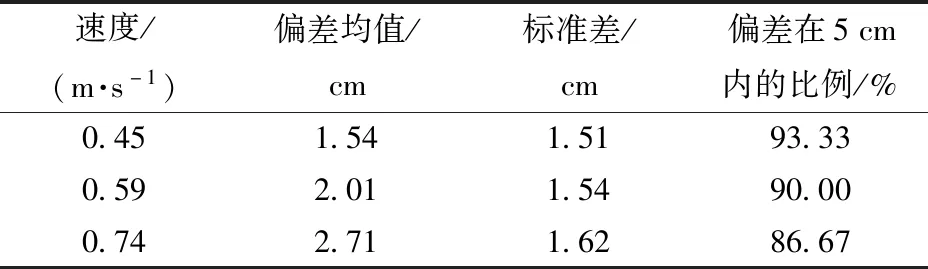

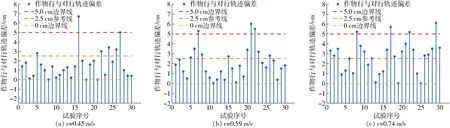

作物行与对行轨迹偏差如表8所示,在不同车速下作物行与对行轨迹偏差分别为1.54、2.01、2.71 cm,随着车速的增大,作物行与对行轨迹的偏差均值与标准差有增大趋势;图24为不同车速下作物行与对行轨迹的偏差。由图24a、24c可知,随着车速增加,偏差在0~5 cm波动范围随之扩大,在5 cm以上的偏差样本数量增多,对行精度也随之下降。由于沙漏与喷杆是刚性连接,车速越大,喷杆振动越剧烈,沙漏也会伴随车体晃动,反映在地面对行轨迹有一定的时滞;其次,对行执行机构在额定功率下,车速增大,电机的加速度增加,机构执行速度下降,致使偏差增大。

表8 作物行与对行轨迹偏差统计Tab.8 Offset statistics of crop-row and following track in comparison

综上可知,车速变化会影响对行质量。当车速为0.74 m/s时,偏差在5 cm内的比例为86.67%,满足喷雾机对行作业需要。当车速为0.45 m/s时,对行偏差均值为1.51 cm,偏差在5 cm内的比例为93.33%,试验结果最佳。

图24 不同车速下轨迹偏差Fig.24 Diagrams of offset at different velocities

5 结论

(1)以生长早期甘蓝为研究对象,进行了作物行识别算法研究与对行喷雾控制系统设计,搭建了基于视觉的对行喷雾控制系统。

(2)进行了基于视觉的作物行识别方法研究,提出了多行自适应ROI的定位方法、基于限定阈值垂直投影特征点的作物行提取方法。根据已知作物行中心线几何关系,构建对行机构的偏移量补偿模型,获得对行追踪PID控制方法。

(3)作物行识别试验结果表明,实验室条件下作物行识别准确率在95.00%以上,图像处理平均最快耗时为41 ms。缺苗鲁棒性试验结果表明,自适应ROI设计提升了识别算法的识别效果,在多行缺苗条件下识别准确率不小于93.11%,说明算法具有较强的鲁棒性。全天光照试验表明,在09:00—11:00、14:00—16:00时间段内试验的识别效果最佳。在田间针对识别算法的杂草测试中,试验整体平均识别成功率为95.56%,说明较为稳定,识别效果能够为田间作业提供视觉引导。田间试验结果表明,田间环境下,对行偏差均值为1.54 cm,偏差在5 cm内的比例达93.33%,说明该系统田间适应性强,能有效快速地获取作物的特征信息,准确地检测出作物行,实现精准对行控制。