无人驾驶环境感知中多源数据融合应用综述

祖国强 何俏君 张志德 徐伟

(1.广东省智能网联汽车创新中心有限公司,广州 511400;2.广州汽车集团股份有限公司汽车工程研究院,广州 511400)

主题词:多源数据融合 感知 卡尔曼 深度学习

DS Dempster Shafer

ROI Region of Interest

RoarNet Region Approximation Refinement Network

AVOD Aggregate View Object Detection

MV3D Multi-View 3D Object Detection

MCU Microcontroller Unit

SoC System on a Chip

1 前言

随着汽车保有量的持续增加,交通事故日益高发,这给人们出行甚至城市发展都带来了严峻的挑战,而以无人驾驶为核心的新型智能交通系统在一定程度上改善了交通运输的效率,提高了行车的安全性。通常,依据无人驾驶系统的功能定义,可将无人驾驶系统分为4大主要功能模块:感知融合、融合定位、路径规划和决策控制。其中,感知融合模块以摄像头、激光雷达、毫米波雷达传感器的原始数据为输入,并根据各传感器的感知特性对信息进行融合,以获得更准确的自车位姿信息、状态信息以及道路、障碍物、行驶区域周边环境信息。感知融合模块是无人驾驶系统中其它模块的源头,整个无人驾驶系统的性能很大程度上有感知融合模块的性能决定。在感知融合模块,常用的传感器有摄像头、毫米波雷达、激光雷达。不同的传感器有不同的优缺点及特定用途,通过对目前国内外感知领域研究现状调查发现以下结论。

摄像头在无人驾驶系统中是必不可少的。其优点主要有2方面:(1)摄像头成本低,且是最接近于人类感知环境的传感器;(2)摄像头输出具有丰富的语义信息,同时基于深度学习的目标检测算法已趋于成熟,可以最大程度的挖掘其中信息,获取尽可能准确的感知信息,比如物体的类别、交通牌信息、车道线信息等。但是摄像头还存在一些缺点:实时性差、易受环境(光线、天气)影响、不能准确地检测前车速度和车距,以获得精确的环境细节信息、纵向方向上的分辨率较低。

毫米波雷达是无人驾驶系统中最成熟的传感器,其优势在于环境适应性强,可直接获取目标准确的速度、距离、角度信息,可以弥补摄像头的不足,但是雷达输出的障碍物列表噪声较大、漏检率与误检率较高、同时存在无法给出跟踪目标的类别信息、尺寸信息。

激光雷达与毫米波雷达不同,使用工作频率更高的激光束,因此具有分辨率高、隐蔽性强的优点。然而,其工作时受天气的影响较大,相较于在晴天的感知效果,激光雷达在雨、浓烟、浓雾的异常天气里感知距离大幅缩短,对异常天气的鲁棒性较差。

对于单一类型的传感器来说,某一采样时刻只能获取环境的1个片面数据,数据量少,其信息只能描述环境的局部特征。同时,单一类型的传感器有自己的局限性,虽然可以通过改进系统硬件性能或优化算法,来提升单一传感器的性能,但是仍不能满足在复杂交通工况中的对感知性能的要求。而多源传感器系统通过多类型、多视角传感器获得更多种类和数量的数据,因此能够更加全面的描述环境,这是因为多源传感器之间的互补数据不仅扩展了单源传感器的性能(图1)及空间上的观测范围,还提高了系统的感知维度与感知准确度,增强了环境适应能力与分辨能力,更重要的是增强了系统应对不同天气情况、光照情况的鲁棒性。

图1 多源数据融合示意

多源数据融合的具体过程如下:

(1)多源传感器独立工作获得观测数据;

(2)对各传感器数据进行预处理;

(3)对预处理之后的数据进行信息提取,获取观测对象的特征信息;

(4)在数据融合中心使用特定算法对观测对象的多源信息进行融合,获得对环境的一致性描述。

2 多源数据融合算法

多源数据融合算法是感知融合领域的核心内容。通过对多源数据在数据级、特征级、目标级不同层次进行融合处理,可以获得目标的高精度描述。目前主流的融合算法有加权平均法、贝叶斯方法、卡尔曼滤波原理、DS证据理论推理和深度学习,不同的算法有不同的适用环境及各自的优缺点。

2.1 加权平均法

加权平均法比较简单、直观,多个传感器独立探测的数据,乘上相应的权值,然后累加求和并取平均值,将其结果作为融合结果。该方法较容易实现,实时性好。但是,其权值的分配和取值有一定的主观性,且方法过于简单,融合效果不够稳定,实用性较差。

2.2 贝叶斯方法

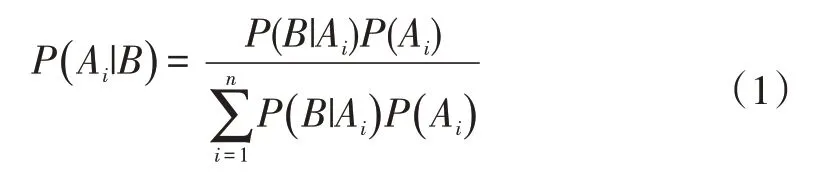

贝叶斯方法基于先验概率,并不断结合新的数据信息得到新的概率,其公式如式(1)。

贝叶斯方法的主要局限性在于其工作基于先验概率,而先验概率往往需要通过大量的数据统计来实现。

2.3 卡尔曼滤波理论

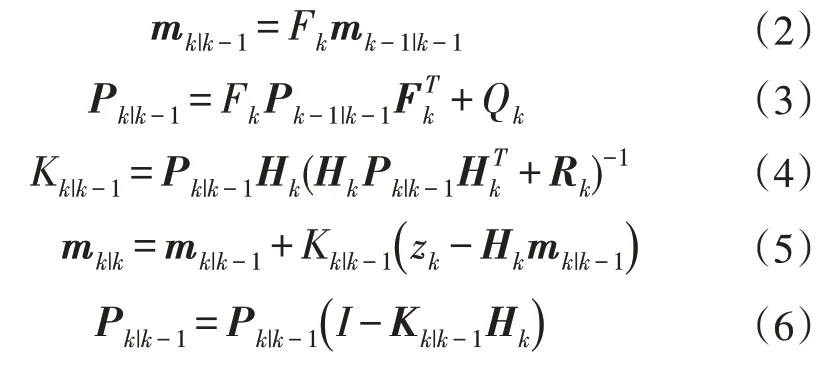

卡尔曼滤波理论是1 种利用线性状态方程,通过系统输入的观测数据,对系统状态进行最优估计的算法,卡尔曼滤波法能合理并充分的处理多种差异很大的传感器信息,并能适应复杂多样的环境。基于卡尔曼滤波的递推特性,不仅可以对当前状态进行状态估计,而且可以对未来状态进行预测,通过状态估计、状态预测的不断迭代实现对被测状态的最优估计。卡尔曼滤波算法常用的公式如下。

式中,是状态矩阵,是状态协方差矩阵,是卡尔曼增益矩阵,其中下标11为上一时刻数值,1为当前时刻数值;F是前后时刻的状态转移矩阵;Q是当前时刻的预测噪声协方差;H是观测矩阵到状态的转移矩阵;R是传感器的噪声协方差矩阵;z是传感器测量向量。

2.4 DS证据理论

DS证据理论是基于贝叶斯估计方法,Dempster首先通过构造1个不确定性推理模型,将命题的不确定性转化为集合的不确定性,Shafer在此基础上对其进行了完善。其最大特点是将“区间”转化为“点”,用“点估计”的方法描述不确定信息,算法的灵活度高是该方法最大的特点。而DS证据理论的缺点主要有3点:(1)算法的时间复杂度与样本量的平方成正比,这意味着运算量会随样本数量的增加而指数增长;(2)证据理论的判决规则常常有很大的主观性;(3)证据理论在多源输入存在冲突时效果不好,因此在无人驾驶多源数据融合系统构建时需要着重考虑如何解决证据冲突问题。

2.5 深度学习方法

深度学习模型的底层原理是基于现代神经科学,由大量模拟人类神经的基本处理单元组成,因此又称为深度学习网络。在训练阶段,网络的输入参数是传感器的原始数据,网络输出与人为标注的真值之间的误差以方向梯度传递的方式更新网络参数,通过大量数据、多次迭代训练以优化网络参数,进而消除非目标参量的干扰,完成相应的智能任务。模型具有较强的容错能力与自适应能力,且能够模拟复杂的非线性映射,例如深度学习中的卷积神经网络可基于摄像头图形进行目标检测,进而得到目标的运动、位姿特征信息。在无人驾驶过程中存在着大量不确定信息,比如多传感器数据及其噪声、行人车辆等目标的突发状况,对这些不确定信息的融合过程等同于不确定性的推理过程。而深度学习网络可以通过获取的传感器信息,迭代优化网络权值,获得不确定推理机制,因此无人驾驶感知融合领域常使用深度学习方法进行信息融合。

3 多源数据融合的层次

根据多源数据融合的输入数据的抽象程度可将多源数据融合技术划分为目标级融合(后融合)、特征级融合和数据级融合(前融合)3个层次(图2)。

图2 多源数据融合的3个层次

3.1 目标级融合

目标级融合先提取原始数据中的目标信息,并产生目标的跟踪列表,然后融合模型将来自不同传感器的跟踪列表进行关联匹配,最终得到完整的多源跟踪列表。该方法只对目标信息进行融合,不受传感器类别的限制,能够保证实时性。其主要优势在于模块化,所有与传感器相关的细节都在传感器后处理模块进行处理,而融合模块只需抽象地处理数据。但是该方法在融合之前已进行特征提取,信息存在一定程度上的损失,因此其准确度最差。

目标级融合最常用的算法就是卡尔曼滤波算法,融合框架一般有2种形式。

(1)该框架在收到任意一个传感器信号的时候就进行1次更新,该方法对不同传感器等同看待,对不同传感器数据用同样的方法进行处理,不同传感器之间的区分仅在于初始化参数以及噪声矩阵,这会导致误差延续的问题,比如视觉传感器的错误估计会向下传递影响后续的处理结果(图3)。

图3 贯序更新卡尔曼滤波融合框架

(2)另一种框架为同步更新(图4),主要有2个特点:(1)允许时延,等待多传感器数据,进行同步;(2)根据不同传感器的特性,融合不同传感器精度更高的数据(毫米波雷达的速度信息或视觉结果的分类信息),相当于进行滤波处理。

图4 同步更新卡尔曼滤波融合框架

3.2 特征级融合

特征级融合接收的是原始数据提取后的特征信息,根据目标已有特征对融合特征进行匹配,获得目标的信息。信息丢失相对于目标级融合有所减少,其准确性有所提升。在特征提取方面主要基于深度学习,主流的方法有RoarNet、AVOD、MV3D、FPointNet。陈毅等首先将点云数据前向投影形成二维深度图,并将深度图的分辨率提高至与图像分辨率一致,然后使用深度学习目标检测算法分别对相机图像和深度图进行目标检测,最后根据改进的DS 证据理论对检测结果进行特征级融合。

3.3 数据级融合

数据级融合接对多源原始数据进行融合,然后从融合后的数据中进行特征提取,因此该方法又称像素级融合(前融合),数据级融合充分利用了多源传感器的原始数据,不存在信息丢失的问题,理论上可以获得对目标最准确的描述,但是正因为该融合模型接收的是原始数据,所以对系统通信带宽的要求很高。

表1 为上述3 种融合层次的优缺点,数据融合的层次越高,用于融合的信息抽象性越强,模块化越好;融合层次越低,融合的信息越全面,但数据量大,对各信息间的配准性(时间同步、空间同步)要求高。融合层次的选择主要在于融合精度和融合速度的取舍。廖岳鹏分别建立3 种层次数据融合算法,通过对比发现对多传感器进行数据上的融合能够更加有效地提升融合模型性能。

表1 3种融合层次的性能比较

4 数据处理方式

在无人驾驶感知领域,融合系统可根据模型的数据处理结构分为3类:分布式、集中式和混合式。从融合信息的损失程度来看,分布式结构的损失最高;而在融合处理的复杂度方面,混合式结构最复杂。无论是哪种融合数据处理结构,都提升了传感器的环境感知能力。

4.1 分布式

分布式融合的本质是基于分布式结构的融合算法,主要利用了假设生成和假设验证的思想。分布式融合结构中的处理单元分布在各独立节点,在对传感器的原始数据进行初步处理之后再送入统一的信息融合中心,通过对融合数据进行多维优化、组合、推理,以获取最终结果。

分布式融合结构的一般做法是将其中1个传感器检测的目标生成可供其它传感器识别的感兴趣区域(ROI)。然后,用另一个传感器来验证ROI 内是否包含目标。在包含毫米波雷达和摄像头的融合系统中,毫米波雷达扫描速度快,适用于对目标的状态进行初步估计,基于毫米波雷达生成的目标列表可供其它传感器验证ROI。该结构不仅可以通过雷达目标信息使感兴趣区域缩小了目标检测范围、缩短视觉处理时间。同时,基于计算机视觉的目标识别算法可以对雷达检测的目标进行杂波剔除,从而减小雷达的误报,提高目标识别精度。但是,该方案仅对目标存在的概率进行融合,对信息存在一定程度的浪费。

4.2 集中式

集中式融合的核心思想是不确定推理,首先对每个传感器设置各自的置信度,然后汇总多源信息,最后基于一定的融合规则输出融合结果。在集中式融合结构中,多源传感器的原始数据不进行任何处理直接送入信息融合中心。该结构充分利用多源信息具有较高的融合精度,同时可以将融合步骤模块化。

陈云坤等通过对毫米波雷达与双目视觉的误差分配不同的权重,通过加权平均计算出最后的融合结果。Sang等为提高多目标识别的精度,将图像数据和点云数据作为卷积神经网络的输入,使用DS证据理论算法对目标的候选框进行融合。胡远志等首先在图像上采用深度学习框架识别车辆目标,然后将点云投影至图像,将目标与点云进行关联,从而确定目标的深度信息,并利用点云信息提高目标的置信概率,提高识别精度。

4.3 混合式

混合式同时具有分布式和集中式2 种结构,兼顾2 者的优点,能够根据不同需要灵活且合理地完成信息处理工作。算法的可靠性与融合的精度虽然有所提升,但随着传感器数量的增多,信息的冗余程度与系统的复杂程度也会随之增加。

Chavez-Garcia 等使用混合式融合结构对毫米波雷达、摄像头、激光雷达3 种传感器的信息进行融合,首先以激光雷达检测的目标生成感兴趣区域,然后对毫米波雷达和摄像头数据中的感兴趣区域进行目标检测,最后用DS 证据理论算法对感兴趣区域检测的目标信息进行融合。

5 多源数据融合的关键问题

随着自动驾驶的逐渐落地,为逐步提升自动驾驶的自动化程度,主要的途径就是增加感知传感器的数量与种类,从而获得车辆对环境更加准确的信息。而不同数据源对环境的描述有其自身的空间坐标系与时间坐标系,随着数据源的增加,为了满足自动驾驶在多种复杂环境下的正常使用,如何将多源数据融合在同一个时间系统和同一个空间系统,实现真正意义上的同步是多源数据融合的关键问题。

5.1 空间同步

空间同步是对多传感器的自身坐标系进行联合标定,建立坐标转换关系,从而保证不同传感器在同一坐标系下对同一目标进行识别。陈云坤等在空间维度上介绍了毫米波雷达与摄像头相对位置关系,然后在此基础上介绍了理想条件、非理想条件下坐标系之间的转换关系以及摄像头的畸变矫正方法。

5.2 时间同步

时间同步是指1个系统的各个模块都要同步到系统的主时钟源,整个系统的运行基于同1个时间基点。在自动驾驶环境感知系统中,正确运行的1个重要问题就是要保证获取的数据精确、时间同步,算法的基准是所有的数据都是在同一时间点获取,否则应用功能无法保证做出正确的预判,可能造成自动驾驶的严重事故。

文献[12]采用基于时间戳的同步方式,在接收点云信息和图像信息时会附加系统当前时刻的时间戳,缓存摄像头采集的图像信息,当获取激光雷达的点云信息之后,根据点云信息的时间戳从缓存中找最邻近的图像信息,然后将点云信息和图像信息同时送入处理函数进行信息融合,完成2种传感器信息的时间同步。文献[37]在分析自动驾驶域控制器复杂架构的基础上,结合应用算法对获取数据时间同步的要求,以包含1 个MCU 和2 个SoC 的域控制器为研究对象,详细介绍了域控制器和外部主时钟源控制器的时间同步方法、域控制器片内异构的时间同步方法、域控制器和外部传感器控制器的时间同步方法,保证整个域控系统的运行基于同1个时间基点。

6 发展趋势

考虑到无人驾驶在复杂交通工况中对感知性能的高要求,以及深度学习的快速发展,相信基于深度学习的集中式、数据级、端到端融合框架将成为后续的主流方式。该融合框架可以最大程度的保留原始数据的信息,最大可能的提升感知的性能。但是,该框架要想达到理想的性能也在两方面存在挑战。其一是不同传感器数据类型不同,难以做到数据空间内的理想化同步;其二是不同品牌的传感器产生的数据特性不尽相同,难以获得深度学习训练所需的大量数据集,导致框架的鲁棒性较差。