DeepLabv3+ 和 PSPNet 算法对防尘网自动识别的适用性研究

李 夏 ,李 媛 ,张 博

(1.水利部信息中心,北京 100053;2.北京化工大学化学工程学院,北京 100029;3.航天科工集团智慧产业发展有限公司,北京 100854)

0 引言

“围绕落实最严格的生态环境保护制度,实行最严格的水土保持监管”是水土保持工作在当下及今后一段时期的重要任务。2018 年水利部党组水利行业强监管要求将生产建设项目造成的人为水土流失作为监管的重中之重[1-2]。卫星遥感对地观测系统以其周期短、时效性高、观测范围广等特点在生产建设项目监管中具有显著优势。基于卫星遥感影像结合无人机巡查及地面实地勘察,开展在建生产建设项目水土保持监管,是生产建设项目水土保持事中事后监管的重要探索与实践。基于遥感技术开展生产建设项目水土保持监管,最为关键的是通过分析下垫面地物光谱纹理等特点总结出目标地物的表征特征,构建基于地物特征的自动识别模型,提高生产建设项目发现的效率和精度。生产建设项目在施工建设过程中,典型表现为大面积的裸露地表和要求布设的临时水土保持措施。水土保持措施包括工程、植被和临时拦挡措施。工程和植被措施大多在项目建设后期建成,并且形态多样,通过遥感自动识别难度较大。临时拦挡、排水措施目标较小,需要优于 0.2 m 的无人机影像识别。临时植被措施覆盖度低,与裸露地表容易混淆。临时苫盖措施(防尘网)面积大,纹理清晰,地物边界明显,可以作为生产建设项目的识别目标。基于高分辨率影像的目标识别已取得了较大的进展,传统方法多基于遥感影像中地物的表象特征。李霞、徐涵秋等[3-4]采用 NDSI 和 NDISI 指数法,解决裸土信息和建筑用地信息混淆的问题,查明了福建区域地表裸土分布的时空变化情况,但传统方法无法利用图像深层特征的语义信息,且无法实现目标地物的自动化识别。近年来,深度学习语义分割网络模型(FCN,Segnet,RefineNet,PSPNet,DeepLabv3+)被广泛应用于遥感影像的目标自动识别,其中 PSPNet(Pyramid Scence Parsing Network),DeepLabv3+ 应用最为广泛且识别结果明显优于其他。刘培等[5]使用 PSPnet 算法实现尾矿库结构分割,得到了尾矿库内部结构(坝体及库区),为尾矿库分布信息提取提供了技术支持;武花等[6]提出了一种融合多特征改进型 PSPNet 模型,提高了复杂场景下建筑物提取的精度;陈周等[7]基于 World View 影像,使用DeepLabv3+ 对城市绿地进行分割研究,然后在分割基础上进行城市绿地信息提取,结果表明 Ostu,MeanShift,FNEA 分割算法相比 DeepLabv3+ 的分割性能最好;郝明等[8]基于 DeepLabv3+ 深度网络,利用生成的数据集进行无人机影像建筑物变化迁移学习,最终实现建筑物变化检测。综上所述,PSPNet,DeepLabv3+ 对遥感影像中的目标识别均取得了显著成效,但二者均未曾应用于生产建设项目,且对于在建生产建设项目特征地物(防尘网)的识别,哪种方法更适用还未有相关研究。基于此,本研究使用 2 m 分辨率的 GF-1 融合影像,分别使用 PSPNet,DeepLabv3+ 识别在建生产建设项目中的防尘网,并对比分析 2 种方法的优劣及识别结果精度,从而筛选出最优方法,旨在提出一种在建生产建设项目防尘网遥感监管的新模式。

1 研究区及数据概况

1.1 研究区概况

本研究以山东省济南市生产建设项目分布较为集中的区域作为研究对象。研究区位于 36°40′N,117°00′E,占地面积为 10 244 km2,地处鲁中南低山丘陵与鲁西北冲积平原的交接带,海拔高度为 5.0~1 108.4 m,属暖温带半湿润季风气候,雨热同季,年降水量为 550~950 mm,7—9 月降水量约占年降水总量的 60%,年平均气温为 11~14℃。土壤类型为显域性棕壤、褐土,以及隐域性潮土、砂姜黑土、水稻土、风砂土 6 个土类,地表土质疏松易发生水土流失[9]。近几年,随着济南市经济迅速发展、城市化进程的加快,城镇建设、公路、供水、输变电等生产建设活动频繁剧烈,严重破坏地表植被,水土流失频发。

1.2 数据概况

遥感影像采用高分一号卫星(GF-1)影像,该卫星搭载 2 台多光谱传感器(2 m 分辨率全色/8 m分辨率)和 4 台多光谱宽幅传感器(16 m 分辨率),多光谱传感器包括蓝、绿、红和近红外 4 个通道。本研究获取的是 2017 年 6—9 月的 GF-1 影像,该时期扰动地块与其他地物的差异较为明显,利于进行生产建设项目防尘网的提取。数据预处理包括辐射定标、大气校正、几何校正、融合(全色和多光谱波段)、镶嵌及裁剪等步骤。

2 生产建设项目影像特征分析

遥感影像通过空间位置的不同及灰度值的差异表示不同地物的差异,这是区分影像中不同地物的物理基础。对象特征分析是基于高分遥感影像开展信息提取分析的首要环节。防尘网在影像中具有以下共性特征:1)光谱特征。防尘网在绿波段均有较高的反射率,与其背景环境差异明显,使用的光谱特征为 Mean,Brightness,Max。2)几何特征。防尘网整体形状较为规则,网格边缘清晰,使用的几何特征为 Asymmetry,Border index,Compactness,Shape index。3)纹理特征。图斑内防尘网纹理分布较为均匀,使用的纹理特征为 GLCM_Con,GLCM_Asm。防尘网遥感影像和部分实地照片如图 1 所示,因防尘网实地照片相似,故选 3 张典型实体照片作为示意。

3 研究方法

3.1 样本构建

将 GF-1 影像多光谱波段(红、绿、蓝波段)和全色波段融合生成的遥感影像作为基础数据,采用人机交互的标注方式,获取海量防尘网样本,此过程共生成 1 153 个样本。

1)样本数据获取。深度学习是高度数据依赖型算法,其性能往往随着数据量的增加而不断增强,样本数据是制衡最终提取效果的决定因素之一[10]。针对防尘网的特定位置信息,在济南市 2017 年高分影像上获取影像数据。

2)样本标注。防尘网的检测需求是确定其位置、面积和形状。通过人机交互方式,根据防尘网在影像的实际形状进行标记。对所有标注的样本进行校验,并对边界标记不准确、标注错误及其遗漏标记的样本进行修正。

3)野外调查。针对不同表现特征的生产建设项目防尘网开展外业调查工作,共完成 80 个调查。

4)样本裁切。由于 GPU 内存有限,模型输入图像尺寸受限,需要将图像裁剪为 512 像素×512 像素的切片图像。

图 1 防尘网示意图

5)数据增强。为达到较好的训练效果,需进行样本增强,实现网络参数的调优。数据增强的方法包括以下 3 种:a.将影像及标签数据分别旋转不同角度(30°,60°,90°,120°,150°,180°,210°,240°,270°);b.对影像及标签数据做镜像处理(上下、左右);c.对影像及标签数据做模糊处理(左上、左下、右上、右下、中心)。经过数据增强后,生成最终的样本集,并将其以 8∶2 的比例随机分为训练集与验证集。

3.2 模型构建

基于融合影像的不同尺度数据,分别使用DeepLabv3+ 和 PSPNet 进行训练,识别生产建设项目防尘网信息。

3.2.1 DeepLabv3+

DeepLabv3+ 模型把 ASPP 模块应用 Encoderdecoder 网络执行语义分割任务[11]。在编码阶段,首先应用 ResNet 网络提取原图像特征,在 Xception 网络中引入 ASPP 模块,在多个比率、视野范围上,通过深度卷积网络得到图像级特征图,利用池化操作编码多尺度的上下文信息,探测多尺度下的卷积特征,解决物体鲁棒分割问题[12]。由于 ASPP 方法参考了遥感影像不同尺度的特征图,并且空洞卷积的使用加强了提取稠密特征的能力,因此该结构具有可以提取遥感影像高层特征的优点,但是该方法存在池化和有步长的卷积,导致遥感影像的边界信息严重丢失[13-15]。

因此,在解码器阶段,借鉴 FCN 的跳步连接方式,连接低层和高层特征,修复遥感影像尖锐边界的问题。其中,通过低层次特征的引入增强影像特征非线性表达能力,有效缓解 DeepLabv3+ 模型在小尺度防尘网目标提取方面所出现的孔洞问题。利用 48 通道 1×1 卷积对低层次特征图卷积,再融入ASPP 采样的高层次特征图,从而实现模型更好的优化。基于 DeepLabv3+ 模型的遥感影像分类识别框架如图 2 所示。

图 2 基于 DeepLabv3+ 模型的遥感影像分类识别框架图

3.2.2 PSPNet

PSPNet 采用空间金字塔网络结构,不仅增强了多尺度信息的融合,而且减小了局部和全局的损失。该结构是一种综合多尺度场景的网络架构,包括卷积层和金字塔池化 2 个部分,具有多方面的优势,不仅架构简单,而且灵活性强。其中,卷积层集成了不同的经典网络架构,如 AlexNet,VGGNet,GoogleNet 和 ResNet等,实现从低层到高层特征的逐步抽象。金字塔池化部分提供优于像元场景解析的全局上下文关系,对卷积层模块最后1 层抽象特征进行多尺度的池化和卷积,并将多尺度池化/卷积特征进行上采样到卷积层最后一层,判定每 1 个像元类型的归属,实现防尘网全局到局部的细节信息[16-17]。基于 PSPNet 模型的遥感影像分类识别框架如图 3 所示。

图 3 基于 PSPNet 模型的遥感影像分类识别框架图

3.3 结果优化

结果优化主要是针对检测结果中的孔穴、孤岛、分离图斑等影响分类结果和精度的噪声问题,应用形态学优化算法,实现消除噪声、填补孔穴、合并图斑的效果,在最大程度保留影像信息的同时进行分类结果的形态优化。根据目标大小及检测影像分辨率,在检测结束后,对结果矢量像元数小于一定阈值的图斑过滤,减少部分小图斑对统计结果的干扰。

3.4 精度评价

3.4.1 评价方法

3.4.1.1 评价对象

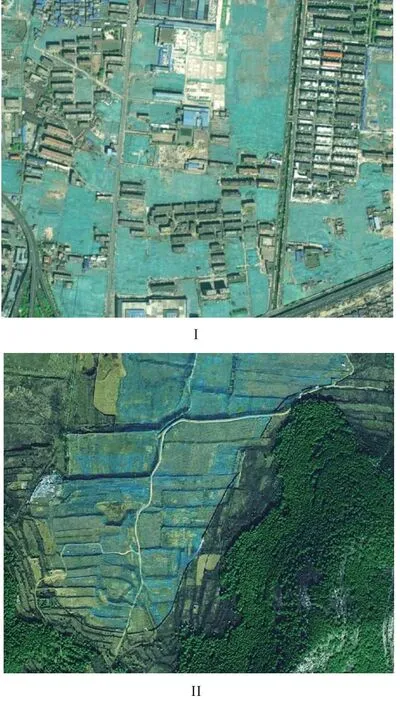

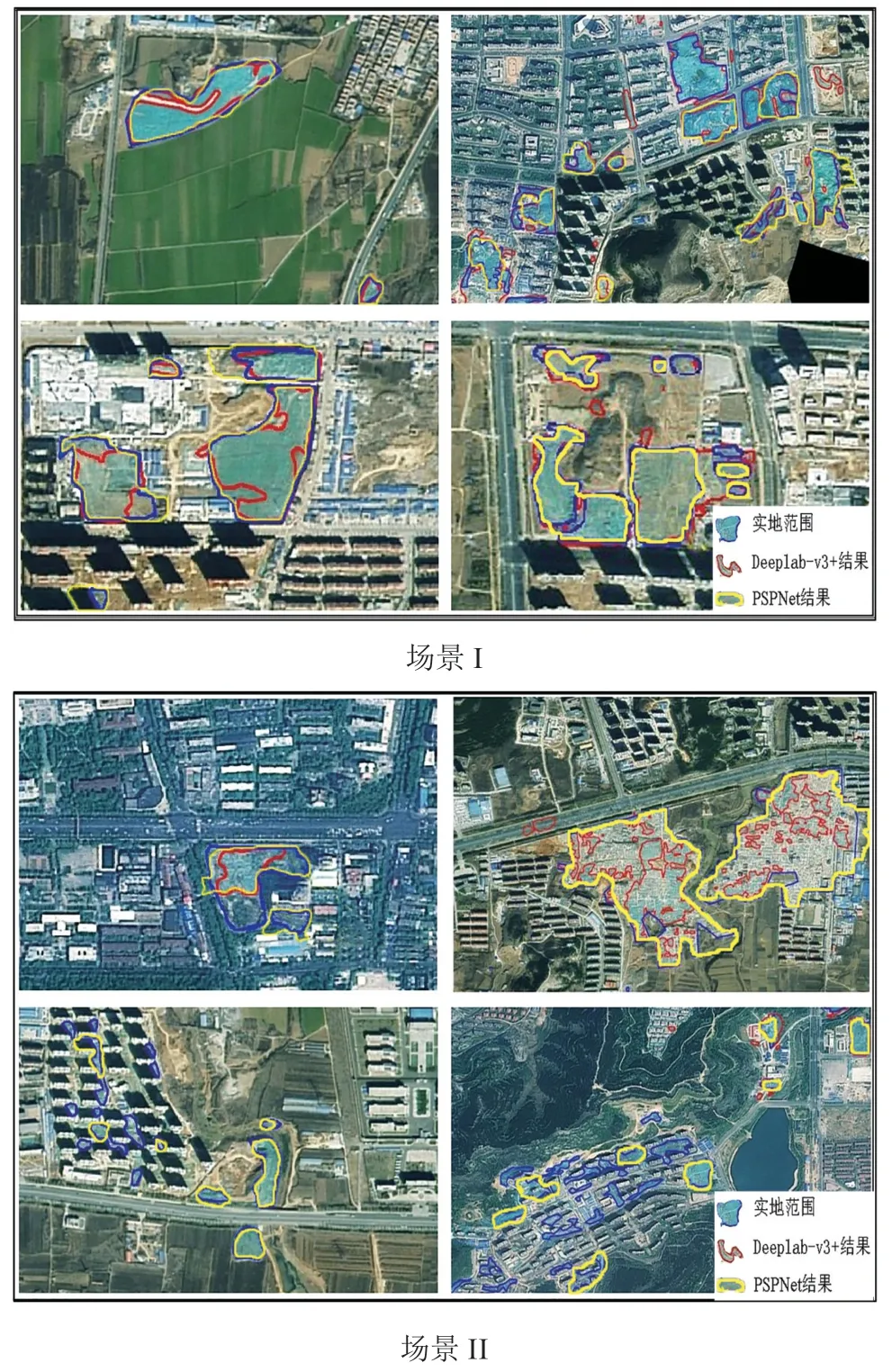

遥感影像中防尘网分布及遮挡情况的差异对于其识别具有不同程度的难度,本研究采用不同难易程度的场景(Ⅰ,Ⅱ)作为评价对象,分别采用DeepLabv3+ 和 PSPNet 提取场景Ⅰ,Ⅱ 防尘网边界,综合全面评价这 2 种方法对防尘网识别的适用性。场景Ⅰ较简单,其色差明显、边缘清晰、图斑内颜色分布较为均匀;场景Ⅱ较难,防尘网与其背景环境差异较小,纹理不明显且颜色与植被相近,具体对比如图 4 所示。

图 4 不同场景下的防尘网

3.4.1.2 评价基准

依据实践经验和专业知识,以 2 m 分辨率的遥感影像为数据源,通过人工识别的方法提取防尘网,并将其作为模型精度评价的基准分别对 DeepLabv3+和 PSPNet 进行精度评价。

3.4.1.3 评价指标

像素级语义分割的评价指标主要包括以下 4 个:

1)精确率P。精确率即预测结果中正类占总正类的比例,计算公式为

式中:TP为将正类预测为正类数;FP为将负类预测为正类数。

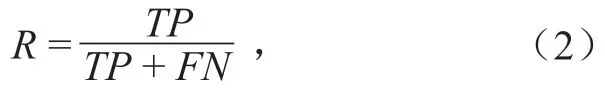

2)召回率R。召回率是所有正类中被预测为正类的比例,计算公式为

式中:FN为将正类预测为负类数;TN为将负类预测为负类数。

3)综合评价指标F1。F1是精确率(P)和召回率(R)的加权调和平均,是信息检索领域的常用的一个评价标准,可衡量分类器的综合性能,F1越高说明模型越好,F1计算公式为

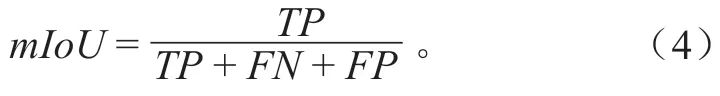

4)平均交并比mIoU。mIoU是各类别的IoU(交并比)计算累加后进行平均,可作为全局评价指标,则mIoU计算公式为

3.4.2 DeepLabv3+ 和 PSPNet 结果对比分析

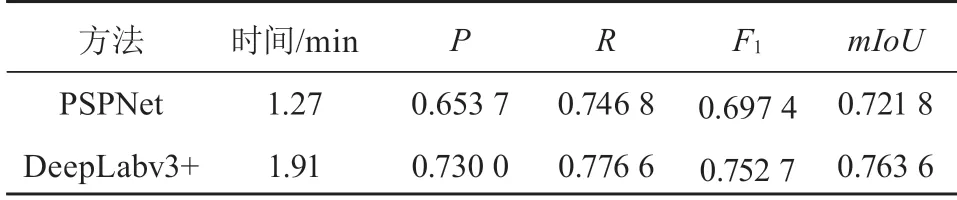

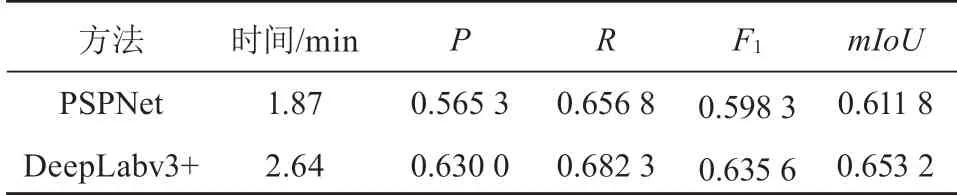

选取 2 个不同难易程度的场景,分别采用DeepLabv3+ 和 PSPNet 提取防尘网边界,并通过语义分割评价指标评价其结果精度,具体如表 1 和 2所示。结果表明:DeepLabv3+ 模型对于不同场景下防尘网提取结果的精确率、召回率、F1值及mIoU均优于 PSPNet 模型。

表 1 简单场景下(场景 I)同模型防尘网识别精度

表 2 复杂场景下(场景 II)不同模型防尘网识别精度

DeepLabv3+,PSPNet 模型对场景Ⅰ,Ⅱ下的防尘网检测结果如图 5 所示。结合实地考察数据,对 DeepLabv3+,PSPNet 模型防尘网检测结果进行分析可知:三者重合度较高,但与 PSPNet 模型提取结果相比,DeepLabv3+ 与 2 m 分辨率遥感影像人工目视解译的结果更为一致(蓝色为人工标注真值,红色为 DeepLabv3+ 检测结果,黄色为 PSPNet 检测结果)。进一步对比分析,不难发现 DeepLabv3+分割性能更优,其分割边缘光滑,与防尘网实地边界高度吻合,较人工标注结果边界更加准确(场景Ⅰ);对于防尘网与背景环境区别相对不明显,防尘网颜色较淡或与植被颜色相近的情况(场景 Ⅱ),受背景环境影响存在一定的漏检和错检,就检测结果而言,其精度仍优于 PSPNet 模型。

图 5 不同场景下的防尘网检测结果对比

4 结语

对比分析 DeepLabv3+,PSPNet 2 种深度学习算法对在建生产建设项目典型地物目标(防尘网)识别的适用性,结果表明:

1)分析不同项目类型、施工阶段生产建设项目水土保持措施布设的特点及其在遥感影像中的表象特征,发现防尘网可作为在建生产建设项目识别的重要地物类型。

2)基于 GF-1 遥感影像,分别采用 DeepLabv3+和 PSPNet 方法识别防尘网,结果表明 DeepLabv3+模型对不同场景下防尘网的整体提取结果均优于PSPNet 模型。DeepLabv3+ 分割性能较好,其分割边缘光滑,与防尘网实地边界吻合度高。与专家解译的结果相比,解译结果边界基本一致。

3)后续需要针对不同区域海量的遥感数据构建大量的样本集,通过深度学习模型训练精度较高的检测模型,可用于全国生产建设项目监管工作。