基于并联卷积与残差网络的图像超分辨率重建

王汇丰,徐岩,魏一铭,王会真

(兰州交通大学 电子与信息工程学院,兰州 730070)(∗通信作者电子邮箱xuyan@mail.lzjtu.cn)

基于并联卷积与残差网络的图像超分辨率重建

王汇丰,徐岩*,魏一铭,王会真

(兰州交通大学 电子与信息工程学院,兰州 730070)(∗通信作者电子邮箱xuyan@mail.lzjtu.cn)

现有的图像超分辨率重建算法可以改善图像整体视觉效果或者提升重建图像的客观评价值,然而对图像感知效果和客观评价值的均衡提升效果不佳,且重建图像缺乏高频信息,导致纹理模糊。针对上述问题,提出了一种基于并联卷积与残差网络的图像超分辨率重建算法。首先,以并联结构为整体框架,在并联结构上采用不同卷积组合来丰富特征信息,并加入跳跃连接来进一步丰富特征信息并融合输出,从而提取更多的高频信息。其次,引入自适应残差网络以补充信息并优化网络性能。最后,采用感知损失来提升恢复后图像的整体质量。实验结果表明,相较于超分辨率卷积神经网络(SRCNN)、深度超分辨率重建网络(VDSR)和超分辨率生成对抗网络(SRGAN)等算法,所提算法在重建图像上有更好的表现,其放大效果图的细节纹理更清晰。在客观评价上,所提算法在4倍重建时的峰值信噪比(PSNR)和结构相似性(SSIM)相较于SRGAN分别平均提升了0.25 dB和0.019。

视觉效果;超分辨率重建;并联结构;残差网络;感知损失

0 引言

超分辨率重建(Super-Resolution, SR)是通过低分辨率(Low-Resolution, LR)图像来产生纹理细节清晰、视觉效果更好的高分辨率(High-Resolution, HR)图像。在医疗成像[1]时产生低分辨率图像会影响对病灶的观察,在卫星遥感拍摄[2]时,获得的图片分辨率较低会对后续工作有不良影响。图像超分辨率重建可以获得更多有效信息,超分重建在计算机视觉领域不可或缺。

目前,超分辨率重建主要有传统方法和深度学习的方法。传统方法包含插值法、重构法等。插值法[3]是利用图像自身的相似属性进行插补来获取高频图像,将重建图像逼近到较好的效果,最常用的方法有最近邻插值和双三次插值(Bicubic)。这类方法简单有效、复杂度低、速度快,但在图像的纹理细节较多区域效果不佳。重构法是预先假设将低分辨率图像当作采样图像预估出效果不错的高分辨率图像,此类方法如最大后验概率(Maximum A Posteriori, MAP)法[4]是把重建图像看作统计学问题,在重建过程中加入先验信息进行约束,能够保证重建结果,但需要依赖先验信息完成且涉及到很大的计算量。随后,将机器学习应用于超分辨率重建取得了重大突破,如稀疏表示法[5]优化局部和局部的相邻图像块之间连接性,进而使得图像局部与全局之间更具有兼容性,但重建图像质量和计算复杂度均与字典大小相关,当字典不够完备时,重建图像的边缘缺乏细节信息,整体效果模糊。

近年来深度学习迅速发展,Dong等[6]首次将卷积神经网络用于超分辨率重建问题中,提出了超分辨率卷积神经网络(Super-Resolution Convolutional Neural Network, SRCNN)算法,重建效果相较于插值法、重构法和基于学习的方法有着显著提升,但是对低分辨率图像信息利用不充分,通过逐步加深网络层让LR-HR的映射能力更强,拥有更大的感受野,能够融入更多的背景信息,然而网络层加深也会带来问题。Kim等[7]把残差网络引入到图像超分辨率重建中,提出了深度超分辨率重建网络(Very Deep convolutional network for Super-Resolution, VDSR)模型,抑制深层网络问题,加速收敛;但其模型是卷积层的简单堆积,不能有效提取图像信息。Lim等[8]移除残差模块中的归一化层和激活函数层,提出增强深度残差网络结构,减少了计算量;但是无法有效利用浅层特征。Zhang等[9]提出了密集残差网络,该网络是将密集连接网络和残差网络[10]相结合,这样可以使信息提取充分;但会使得参数增加,计算量增大。深度学习算法可以有效地恢复图像,但需要平衡网络深度、增强提取信息能力和降低计算复杂度等。

对于简单的网络堆积,重建图像的效果未得到很好的改善,本文提出了一种图像超分辨率重建算法,将并联卷积和残差网络相结合,结合后的网络不易发生梯度爆炸或消失,避免网络退化。其中,并联卷积网络在提取特征时,获得了更加丰富的特征,还可加快特征提取速度。然后,在并联子网络中引入自适应残差网络,可以加强输出特征的信息完备性,优化网络性能。最后,在整个网络中加入全局残差,以补偿颜色信息缺失。实验结果表明,本文算法网络复杂度较低,对图像恢复效果好。

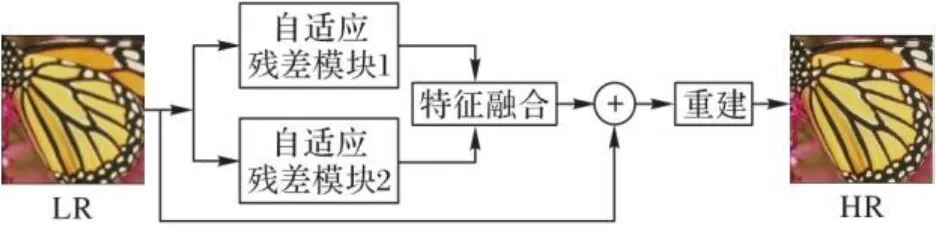

1 本文算法

卷积神经网络有着良好的学习性能,在超分辨率重建中有好的效果。现有的网络结构深度较深,网络复杂度高,随着网络加深特征提取能力下降,信息丢失严重。在保证提取特征丰富的前提下,本文设计了并联结构与残差思想结合的超分辨率重建网络。首先,并联神经网络可以同时提取不同的特征信息,这样会提取出更加丰富的特征,还可加快提取速度。自适应残差网络是依据残差思想来设计的,不仅可以解决网络深度问题,还可以解决梯度消失等问题,让网络模型训练起来更易收敛,训练时根据所需进行特征补充。全局残差主要用于补偿丢失的颜色,网络加深会让颜色退化或者失真,直接通过全局残差网络从低分辨率图像来补充损失的信息。本文算法的整体网络结构如图1所示。

图1 本文算法的整体网络结构Fig. 1 Overall network structure of proposed algorithm

1.1 并联卷积网络

本文设计的并联卷积网络是两个大小和深度不同的网络结构,通过两个不同的卷积网络分别提取特征,最后将所获得的特征信息进行融合,这样便可获得更加丰富的特征。在信息流动过程中随着网络深度加深会有损耗,所以在并联的网络模型中对各自的卷积神经网络加入跳跃连接,有效地让特征重复使用。如图1~2所示,在并联网络中,整个特征信息提取网络分为相同卷积核特征提取网络和不同卷积核特征提取网络。相同卷积核特征提取模块中,均使用的卷积核,这样就会有更少的参数量和更小的计算量;而在不同卷积核特征提取模块中采用和的卷积核,将和的卷积核混合使用,保证参数量较少的同时具有较大的感受野。通过这两个模块进行特征提取,这样获得的特征信息更丰富有效。为了获得更加有效的特征,本文网络均采用步长为1进行提取特征。提取特征信息时,为保证特征图输入输出大小一致,对特征图周围进行填充,填充与输出特征图大小之间的关系为:

在整个并联的网络中,每个网络将前几个卷积输出特征信息进行跳跃连接,可以将特征信息重复使用,补偿随层数增加时丢失的特征,使提取的特征信息更加丰富并且增强网络结构内部信息流动性。跳跃连接与残差网络连接方式不同,残差网络是直接进行相加操作,相加操作是将像素相加进行特征融合,而跳跃连接是按照维度将特征信息拼接(通过CAT方式连接)起来进行特征融合。不同的方式都是对特征信息的整合,利用了丰富的特征信息,重建出的图像效果更好。

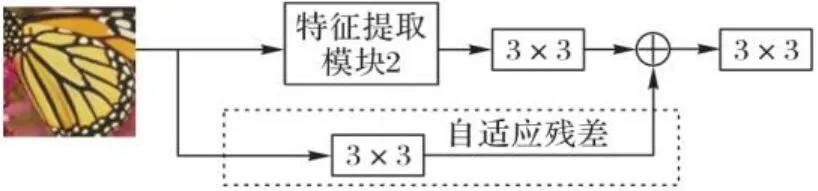

1.2 自适应残差网络

为了进一步提取特征,引入残差思想以提高网络质量。如图2所示,在并联网络不同层分别引入自适应残差网络,通过自适应残差网络增强输出特征的丰富性,避免梯度消失,其本质仍然是既有残差网络的效果,又可增加特征提取的多样性。如图3所示,在主网络中自适应残差网络是一个的卷积核和一个的卷积核,其中的卷积核是用于整合信息和对卷积核通道数进行升维或者降维,这样方便与主网络进行相加操作。如图4所示,在副网络中自适应残差网络是一个的卷积核,与后面输出的维度一致,所以不需要加入的卷积核。在每一个残差网络中权值共享,减少计算的参数量,自适应残差就可在反向传播更新权值后,获得所需要的特征。这样并联网络可以获取更加丰富有效的特征信息,最后进行特征信息融合。

图2 并联卷积模块Fig. 2 Parallel convolution module

图3 自适应残差模块1Fig. 3 Adaptive residual module 1

图4 自适应残差模块2Fig. 4 Adaptive residual module 2

针对颜色丢失或失真,在网络末层引入直接残差的方式,提高重建后高分辨率图像的保真度。全局残差还可以在末层补充特征信息,有助于重建图像有更好的效果。选择颜色比较明显的图像在去除全局残差模块(Global Residual, GR)和未去除全局残差模块进行对比,未去除全局残差模块的图像相较于去除全局残差模块有着更好的颜色。颜色作为图片信息,表明全局残差模块不仅可以提高重建后高分辨率图像的保真度,还可以在末层补充特征信息有助于重建图像有更好的效果,如图5所示。

图5 有无全局残差模块的网络重建效果对比Fig. 5 Comparison of network reconstruction effects with and without global residual module

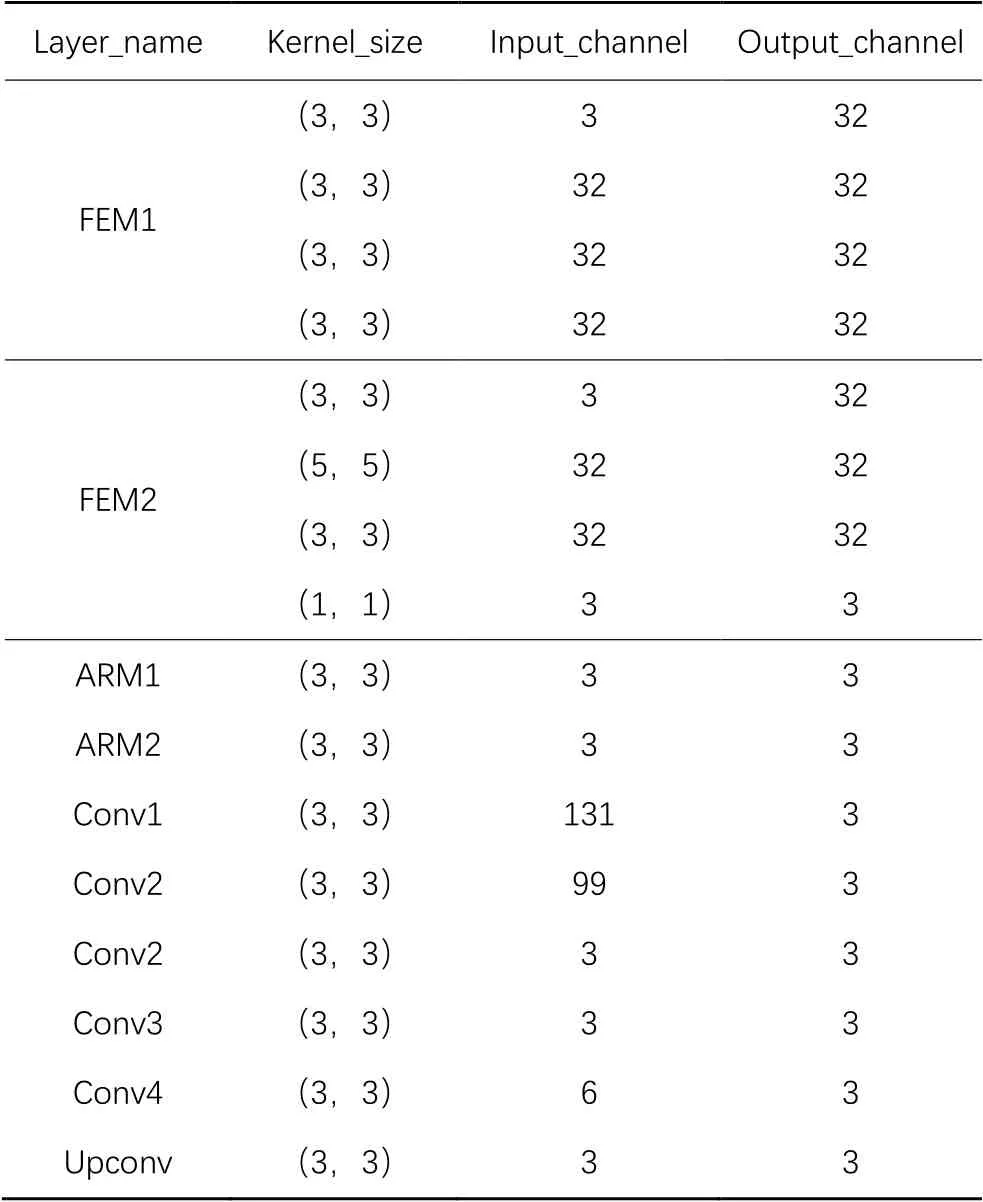

表1给出了本文算法的网络结构和卷积核参数设置,Layer_name表示卷积模块和卷积核名称,卷积层中有两个特征提取模块(Feature Extraction Module, FEM)和相对应的自适应残差模块(Adaptive Residual Module, ARM),Conv是所使用的独立卷积核,Upconv是反采样操作;Kernel_size则为对应卷积核尺寸大小;Input_channel和Output_channel分别表示输入通道数和输出通道数。输入图片为低分辨率图像、尺寸小,输入通道为3,设定输出通道为32,其余参数可由网络模型中上一通道数、步长(本文步长全部为1)和根据所需加入填充由式(1)计算得出。

表1 网络结构和卷积核参数Tab. 1 Network structure and convolution kernel parameters

1.3 损失函数

为了增强重建后图像的语义特征,引入感知损失,感知损失是在深度特征级别上约束原始图像和重建图像。深度特征由神经网络提取,并随着网络加深获得图像更加深层的语义特征信息,监督深度特征的差异进行惩罚,重建图像可以保留原图像中更高级别的语义特征信息。感知损失只是轻微提升质量,主要还是通过网络结构来提升。由于均方损失具有的均值回归特性可保证像素间良好的一致性,因此可有效缓解细节平滑效应。均方损失和感知损失表达式如式(2)、(3)所示:

2 实验与结果分析

2.1 数据集

本文实验采用DIV2K数据集[11],该数据集包含来自网络的不同高质量图像(2K分辨率),主要用于图像复原任务[12]。将数据集中的800张图像进行编码用于训练模型,采用验证集中的100张图像用于在模型训练中进行验证。使用单一数据集具有不公平性,因此采用Set5[13]、Set14[14]、Urban100[15]和BSDS100[16]这四个测试集用于测试训练模型的效果。将数据集中的每张图像进行下采样来降低图像分辨率作为LR图像,将原图的高分辨率图像作为HR图像,让其一一对应成为图像对用于训练。

2.2 实验环境

实验硬件设备为AMD Ryzen7 4800H,处理器基准频率为2.9 GHz,加速频率为4.2 GHz,16 GB内存,NVIDIA GeForce RTX2060 6 GB显卡。在Windows 10操作系统下安装Anaconda3,然后在Python3.7中搭建深度学习框架Pytorch。

2.3 结果分析

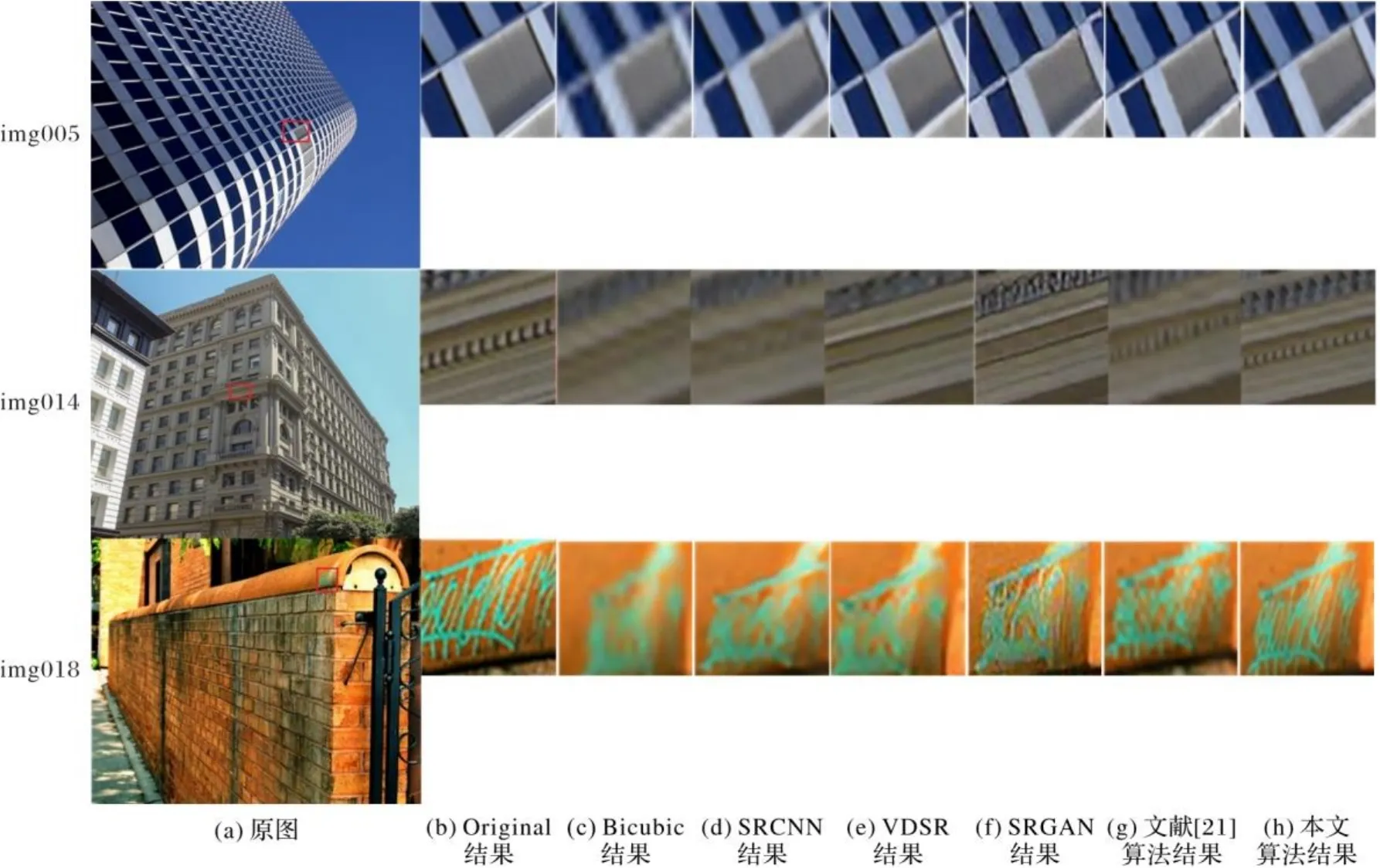

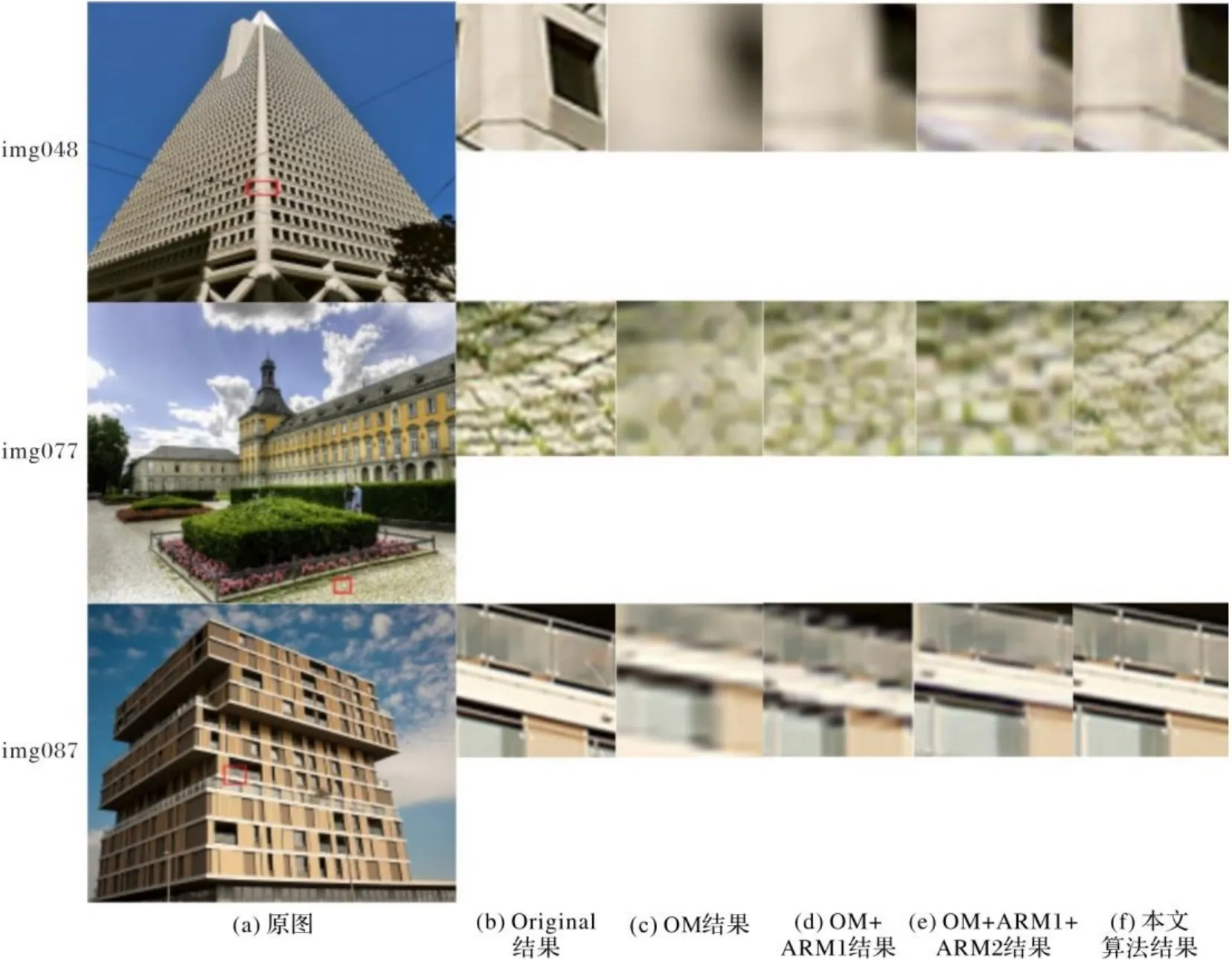

本文网络使用可以自适应优化的Adam优化器[17]优化参数。初始化学习率为0.000 1,epochs初始设置为200。将训练好的网络模型在数据集Set5、Set14、Urban100和BSDS100上进行测试对比。为验证本文算法的图像超分辨率重建效果,将其分别与Bicubic、SRCNN[18]、VDSR[19]、超分辨率生成对抗网络(Super-Resolution Generative Adversarial Network, SRGAN)[20]、文献[21]算法等进行对比,均采用DIV2K数据集进行训练。在Urban100中选出img005、img014、img018这三幅图像进行对比,可以看出Bicubic重建后图像信息丢失严重,效果也最差。SRCNN算法重建出的图像与Bicubic重建出的图像相比,整体效果明显提升,但是网络层数少、提取的特征较少,恢复出的细节信息也少。VDSR的网络层较深,并加入了残差网络,重建后的图像效果较好,但是网络单一使得内部信息流通差,一些细节纹理会丢失。而对于SRGAN而言,在网络模型训练时加入了感知损失,改善重建后图像的整体视觉效果,但是依旧缺乏了细节信息。文献[21]算法相较于其他对比算法有着更好的细节效果,但整体效果表现一般。本文算法不仅可以恢复出不错的整体效果,而且在一些边缘或者细节的地方也有着更好的效果。不同算法重建图像的主观效果对比如图6所示。

图6 不同算法重建图像的主观效果对比Fig. 6 Subjective effect comparison of images reconstructed by different algorithms

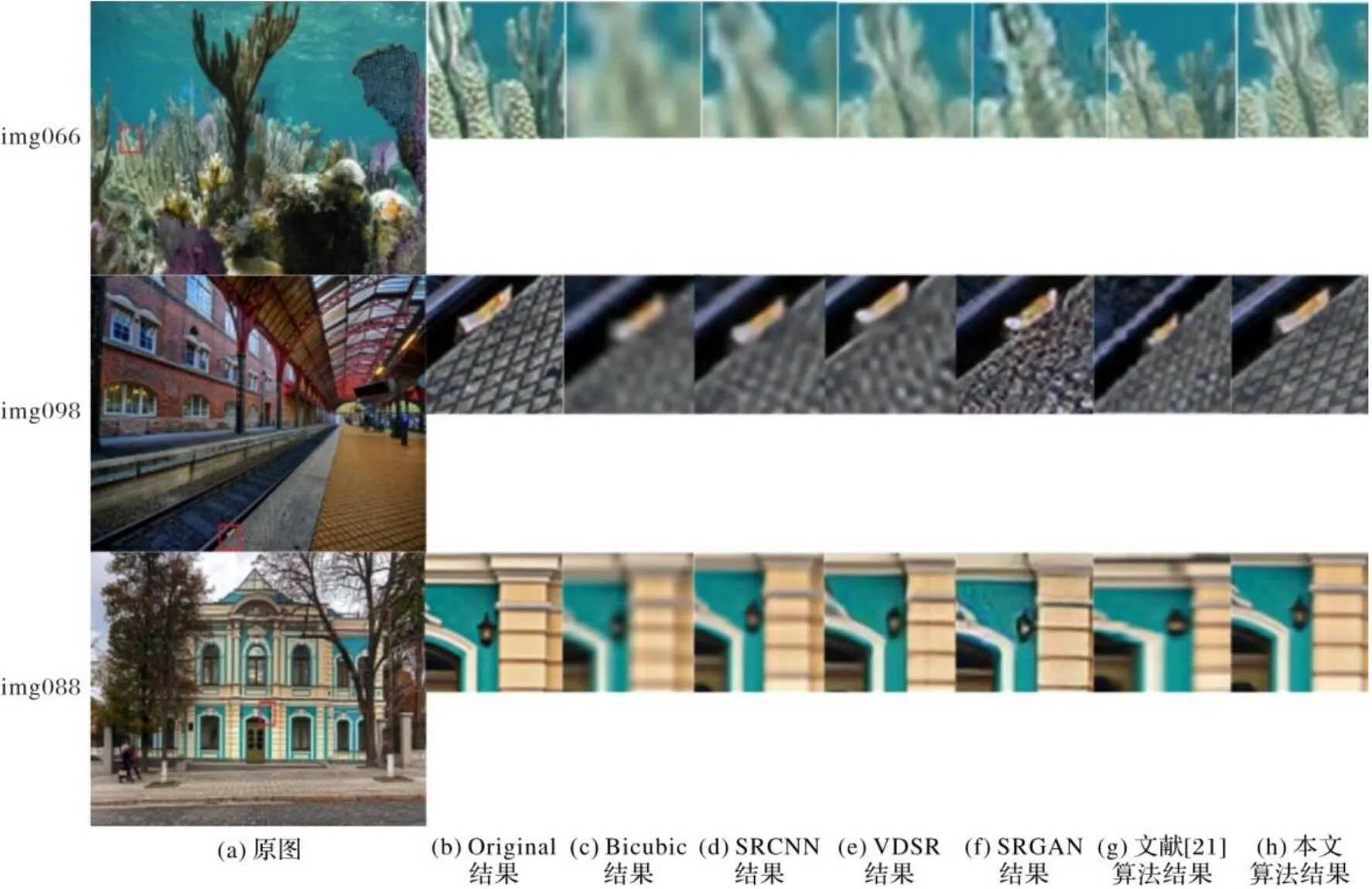

为了进一步对比这些算法的重建效果,比较更加细节的图像区域。从Urban100中选出img066、img088和img098三幅图像通过区域放大进行比较。从Bicubic中可以看出,重建图像是模糊的,呈现不出细节纹理。对于SRCNN,放大图像有着基本细节轮廓,效果提升明显,但是不能完全清晰看出细节纹理。对于VDSR,整体效果均有所改善,已经有着不错的细节信息。跟其他算法相比,SRGAN提升了整体效果,但细节较少,甚至出现部分失真现象。本文算法在提升整体效果的同时,改善了图像信息中的细节纹理,这样使得重建后的图像效果可以均衡提升。如图7所示,三幅图像有着不同的场景,可从中得到相同的比较效果。

2.4 客观评价

本文使用图像重建质量评定中最常用的峰值信噪比(Peak Signal-to-Noise Ratio, PSNR)[22]和结构相似性(Structural SIMilarity, SSIM)[22]评价重建质量。PSNR是基于误差敏感的图像质量评价,数值越大表示重建后图像质量越好;SSIM是根据重建图像与原图在独立亮度、对比度和结构等方面进行比较,局部处理后获得更加精确的结果,当结果越接近1时,表明重建后的图像效果越好。结合这两种评价指标进行分析,避免单一客观评价与主观评价相反的问题。

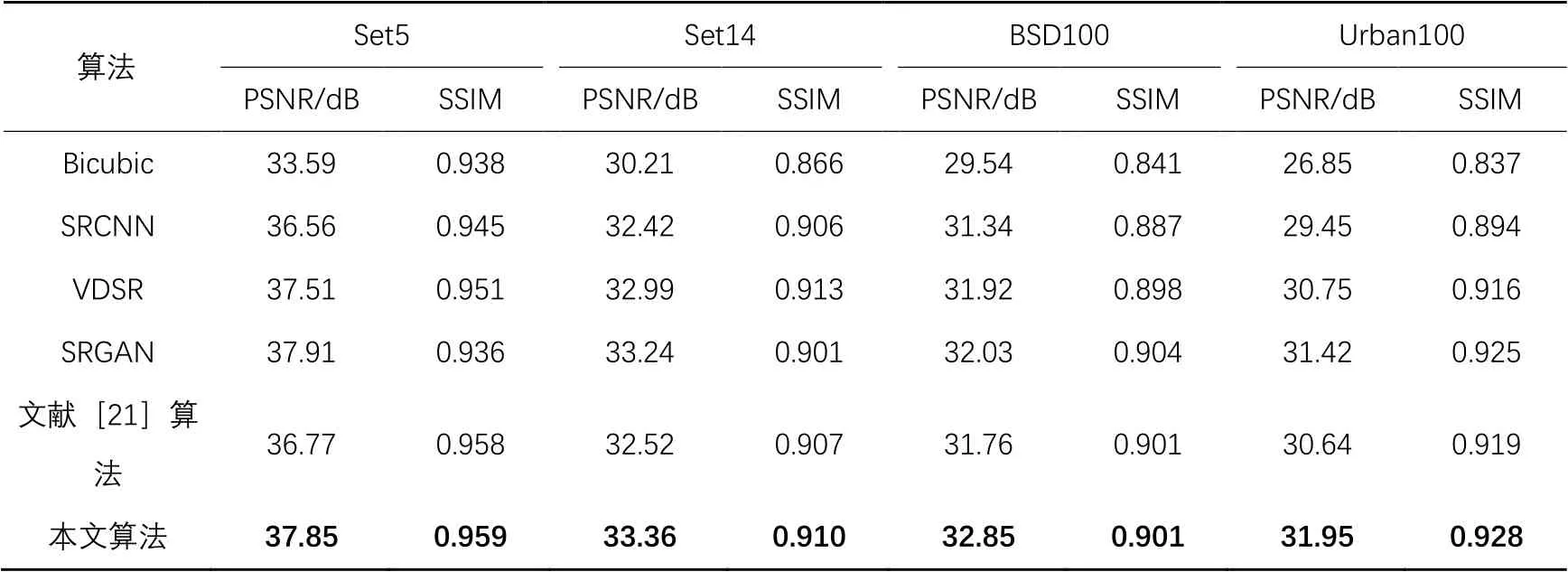

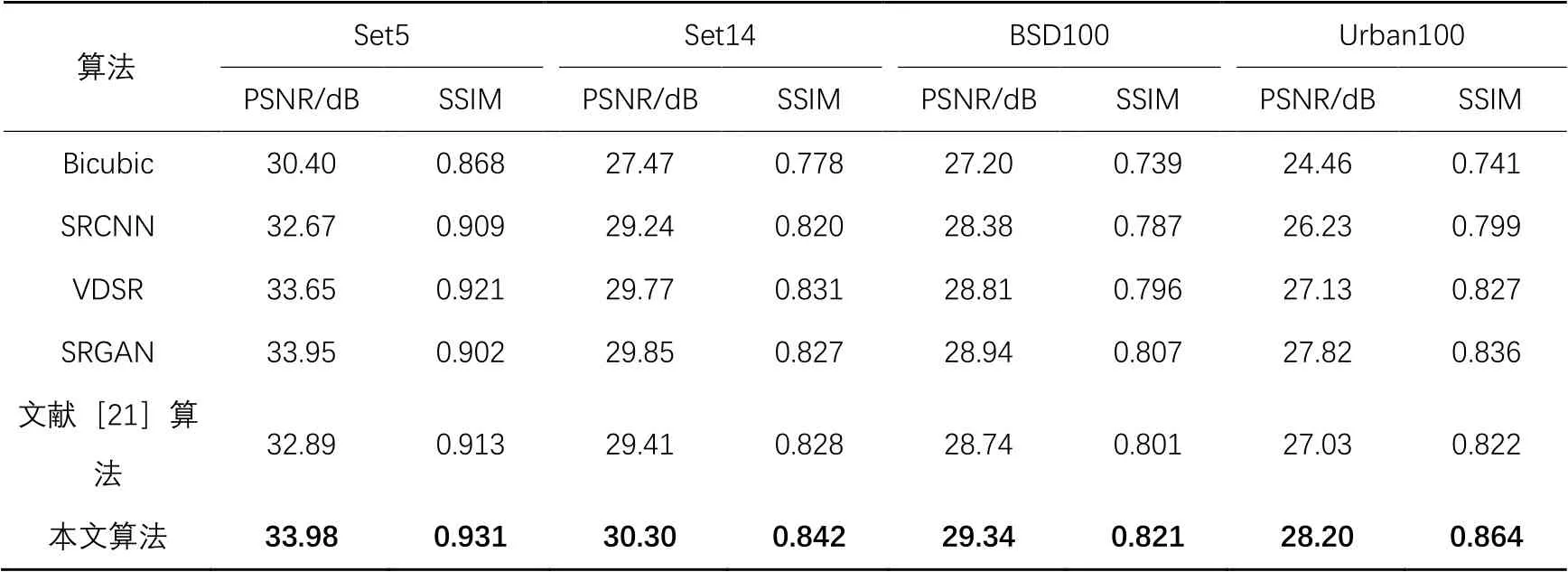

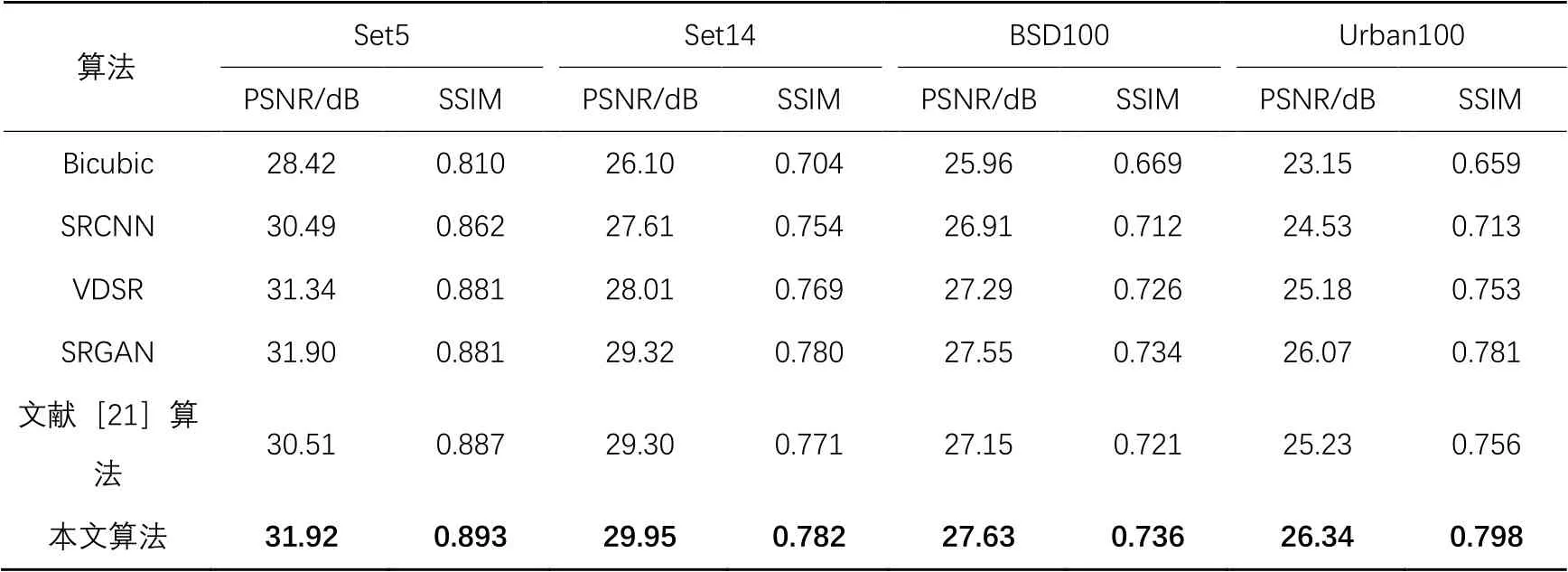

本文算法有着较高的PSNR值和SSIM值,在2倍中,本文算法的PSNR相较于SRGAN平均提升了0.35 dB,其SSIM相较于文献[21]算法平均提升了0.035;在3倍中,本文算法的PSNR和SSIM相较于SRGAN分别平均提升了0.315 dB和0.022;在4倍中,本文算法的PSNR和SSIM相较于SRGAN分别平均提升了0.25 dB和0.019。上述结果表明本文算法能够提升重建后图像视觉效果,不同算法在2倍、3倍、4倍上的结果对比分别如表2~4所示。

图7 不同算法在Urban100测试集上的重建效果局部放大对比Fig. 7 Local amplification comparison of reconstruction effect of different algorithms on Urban100 test set

表2 不同算法在2倍上的PSNR、SSIM对比Tab. 2 Comparison of PSNR and SSIM of different algorithms on ×2

表3 不同算法在3倍上的PSNR、SSIM对比Tab. 3 Comparison of PSNR and SSIM of different algorithms on ×3

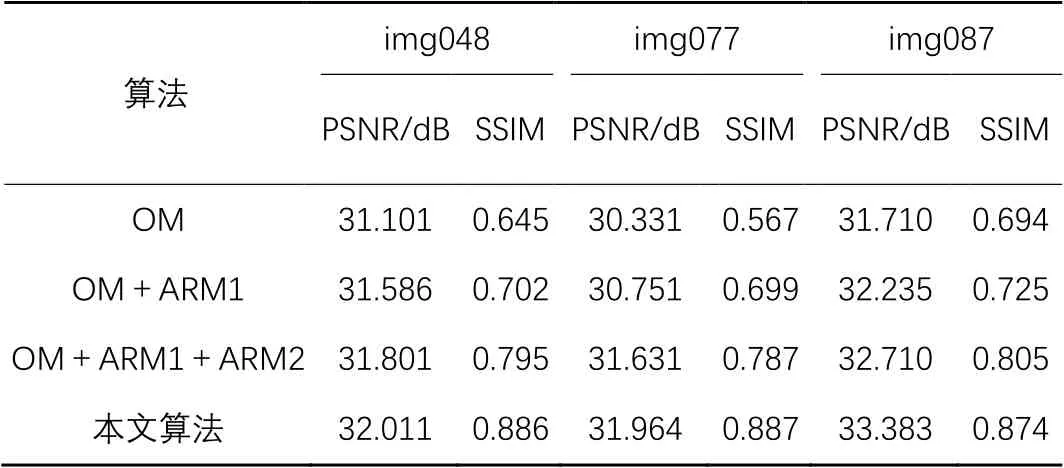

2.5 消融实验

为了验证两个自适应残差模块(ARM)和全局残差模块(GR)的有效性,设计了消融实验。在总网络模型基础上移除掉这三个模块后成为原始模型(Original Model, OM),对比原始模型+自适应残差模块1(OM+ARM1)、原始模型+自适应残差模块1+自适应残差模块2(OM+ARM1+ARM2)、原始模型+自适应残差模块1+自适应残差模块2+全局残差模块(本文算法)的结果。

将训练好的各个组合模块进行测试对比,并选择Urban100数据集中的img048、img077和img087进行比较分析,可以看出移除模块后会让重建图像质量下降,丢失大量细节特征,变得模糊。上述结果表明加入模块后可以很好地提升网络的有效性,重建出更高质量图像,具体效果对比如图8所示。

表4 不同算法在4倍上的PSNR、SSIM对比Tab. 4 Comparison of PSNR and SSIM of different algorithms on ×4

图8 消融实验中在Urban100测试集上不同算法的重建效果对比Fig. 8 Reconstruction effect comparison of different algorithms in ablation experiment on Urban100 test set

通过客观分析可以看出,本文网络模型测试出的PSNR和SSIM值均优于缺失模块的网络,相较于原始模型分别平均提升了1.557 0 dB和0.240 3,相较于原始模型+自适应残差模块1分别提升了0.928 6 dB和0.167,相较于原始模型+自适应残差模块1+自适应残差模块2分别提升了0.405 3 dB和0.080。综上可得,本文算法中的自适应残差模块和全局残差模块有助于提升算法性能,整体数据表现如表5所示。

表5 消融实验中不同算法的PSNR、SSIM对比Tab. 5 Comparison of PSNR and SSIM of different algorithms in ablation experiment

3 结语

本文设计了一种基于并联结构结合残差思想用于图像超分辨率重建的网络模型,在并联结构中以不同的卷积组合可以捕获更丰富的信息,并联方式也加快了信息获取和网络收敛。并联结构中加入的自适应残差网络和全局残差网络,让整个网络结构的全局信息得以补充;内部引入跳跃连接使整个网络信息流通性加强,避免了一些重要特征的丢失,也进一步增强了高频信息的提取。本文算法不仅注重局部与全局信息融合,也重视低级语义信息与高级语义结合,最后加入感知损失,提升了整个网络重建图像的质量。实验结果表明,相较于Bicubic、SRCNN、VDSR、SRGAN以及文献[21]算法,本文算法在整体视觉效果上有明显的改善,也减轻了边缘结构的锯齿效应,在客观评价的PSNR和SSIM值上也有着不错的表现。在以后的研究中可以进一步通过拓宽和加深网络结构来改进网络,也可以尝试引入更多的方法来改善网络性能。

[1] SHI W Z, CABALLERO J, LEDIG C, et al. Cardiac image super-resolution with global correspondence using multi-atlas PatchMatch [C]// Proceedings of the 2013 International Conference on Medical Image Computing and Computer-Assisted Intervention, LNCS 8151. Berlin: Springer, 2013: 9-16.

[2] HU M G, WANG J F, GE Y. Super-resolution reconstruction of remote sensing images using multifractal analysis [J]. Sensors, 2009, 9(11): 8669-8683.

[3] ZHU S Y, ZENG B, LIU G H, et al. Image interpolation based on non-local geometric similarities [C]// Proceedings of the 2015 IEEE International Conference on Multimedia and Expo. Piscataway: IEEE, 2015: 1-6.

[4] SCHULTZ R R, STEVENSON R L. Extraction of high-resolution frames from video sequences [J]. IEEE Transactions on Image Processing, 1996, 5(6): 996-1011.

[5] PELEG T, ELAD M. A statistical prediction model based on sparse representations for single image super-resolution [J]. IEEE Transactions on Image Processing, 2014, 23(6): 2569-2582.

[6] DONG C, LOY C C, HE K M, et al. Learning a deep convolutional network for image super-resolution [C]// Proceedings of the 2014 European Conference on Computer Vision, LNCS 8692. Cham: Springer, 2014: 184-199.

[7] KIM J, LEE J K, LEE K M. Accurate image super-resolution using very deep convolutional networks [C]// Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2016: 1646-1654.

[8] LIM B, SON S, KIM H, et al. Enhanced deep residual networks for single image super-resolution [C]// Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition Workshops. Piscataway: IEEE, 2017: 1132-1140.

[9] ZHANG Y L, TIAN Y P, KONG Y, et al. Residual dense network for image super-resolution [C]// Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE,2018: 2472-2481.

[10] 梁敏,王昊榕,张瑶,等.基于加速残差网络的图像超分辨率重建方法[J].计算机应用,2021,41(5):1438-1444.(LIANG M, WANG H R,ZHANG Y, et al. Image super-resolution reconstruction method based on accelerated residual network [J]. Journal of Computer Applications, 2021, 41(5): 1438-1444.)

[11] HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition [C]// Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE,2016: 770-778.

[12] 唐艳秋,潘泓,朱亚平,等.图像超分辨率重建研究综述[J].电子学报,2020,48(7):1407-1420.(TANG Y Q, PAN H, ZHU Y P, et al. A survey of image super-resolution reconstruction [J]. Acta Electronica Sinica, 2020, 48(7): 1407-1420.)

[13] ABUDU RAHIMAN V, GEORGE S N. Single image super resolution using neighbor embedding and statistical prediction model [J]. Computers and Electrical Engineering, 2017, 62(1): 281-292.

[14] ZEYDE R, ELAD M, PROTTER M. On single image scale-up using sparse-representations [C]// Proceedings of the 2010 International Conference on Curves and Surfaces, LNCS 6920. Berlin: Springer, 2010:711-730.

[15] MARTIN D, FOWLKES C, TAL D, et al. A database of human segmented natural images and its application to evaluating segmentation algorithms and measuring ecological statistics [C]// Proceedings of the 2001 8th IEEE International Conference on Computer Vision. Piscataway: IEEE, 2001: 416-423.

[16] HUANG J B, SINGH A, AHUJA N. Single image super-resolution from transformed self-exemplars [C]// Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE,2015: 5197-5206.

[17] PEREYRA M, SCHNITER P, CHOUZENOUX É, et al. A survey of stochastic simulation and optimization methods in signal processing [J]. IEEE Journal of Selected Topics in Signal Processing, 2016, 10(2): 224-241.

[18] YUAN Y, LIU S Y, ZHANG J W, et al. Unsupervised image super-resolution using cycle-in-cycle generative adversarial networks [C]// Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops. Piscataway: IEEE, 2018:814-823.

[19] LEDIG C, THEIS L, HUSZÁR F, et al. Photo-realistic single image super-resolution using a generative adversarial network [C]// Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE, 2017: 105-114.

[20] 南方哲,钱育蓉,行艳妮,等.基于深度学习的单图像超分辨率重建研究综述[J].计算机应用研究,2020,37(2):321-326.(NAN F Z, QIAN Y R,XING Y N, et al. Survey of single image super resolution based on deep learning [J]. Application Research of Computers, 2020, 37(2): 321-326.)

[21] 刘月峰,杨涵晰,蔡爽,等.基于改进卷积神经网络的单幅图像超分辨率重建方法[J].计算机应用,2019,39(5):1440-1447.(LIU Y F, YANG H X,CAI S, et al. Single image super-resolution reconstruction method based on improved convolutional neural network [J]. Journal of Computer Applications, 2019, 39(5): 1440-1447.)

[22] WANG Z, BOVIK A C, SHEIKH H R, et al. Image quality assessment: from error visibility to structural similarity [J]. IEEE Transactions on Image Processing, 2004, 13(4): 600-612.

Image super-resolution reconstruction based on parallel convolution and residual network

WANG Huifeng, XU Yan*, WEI Yiming, WANG Huizhen

(School of Electronic and Information Engineering,Lanzhou Jiaotong University,Lanzhou Gansu730070,China)

The existing image super-resolution reconstruction algorithms can improve the overall visual effect of the image or promote the objective evaluation value of the reconstructed image, but have poor balanced improvement effect of image perception effect and objective evaluation value, and the reconstructed images lack high-frequency information, resulting in texture blur. Aiming at the above problems, an image super-resolution reconstruction algorithm based on parallel convolution and residual network was proposed. Firstly, taking the parallel structure as the overall framework, different convolution combinations were used on the parallel structure to enrich the feature information, and the jump connection was added to further enrich the feature information and fuse the output to extract more high-frequency information. Then, an adaptive residual network was introduced to supplement information and optimize network performance. Finally,perceptual loss was used to improve the overall quality of the restored image. Experimental results show that, compared with the algorithms such as Super-Resolution Convolutional Neural Network (SRCNN), Very Deep convolutional network for Super-Resolution (VDSR) and Super-Resolution Generative Adversarial Network (SRGAN), the proposed algorithm has better performance in image reconstruction and has clearer detail texture of the enlarged effect image. In the objective evaluation, the Peak Signal-To-Noise Ratio (PSNR) and Structural SIMilarity (SSIM) of the proposed algorithm inreconstruction are improved by 0.25 dB and 0.019 averagely and respectively compared with those of SRGAN.

visual effect; super-resolution reconstruction; parallel structure; residual network; perceptual loss

TP391

A

1001-9081(2022)05-1570-07

10.11772/j.issn.1001-9081.2021050742

2021⁃05⁃10;

2021⁃09⁃09;

2021⁃10⁃14。

国家自然科学基金资助项目(62063014)。

王汇丰(1995—),男,甘肃天水人,硕士研究生,CCF会员,主要研究方向:计算机视觉、图像处理; 徐岩(1963—),男,甘肃兰州人,教授,硕士,主要研究方向:语音信号处理、图像处理; 魏一铭(1995—),男,河南郑州人,硕士研究生,主要研究方向:计算机视觉、图像处理; 王会真(1996—),女,甘肃白银人,硕士研究生,主要研究方向:文本处理。

This work is partially supported by National Natural Science Foundation of China (62063014).

WANG Huifeng, born in 1995, M. S. candidate. His research interests include computer vision, image processing.

XU Yan, born in 1963, M. S., professor. His research interests include speech signal processing, image processing.

WEI Yiming, born in 1995, M. S. candidate. His research interests include computer vision, image processing.

WANG Huizhen, born in 1996, M. S. candidate. Her research interests include text processing.