基于EMD-Stacking-MLR的台区配变短期负荷预测方法*

杨 秀, 胡钟毓, 田英杰, 谢海宁

(1.上海电力大学 电气工程学院, 上海 200090; 2.国网上海市电力公司电力科学研究院, 上海 200080)

0 引 言

随着社会经济快速发展,城市用电负荷不断攀升,使得台区配变设备所承担的重过载风险日趋严重,为电网安全运行埋下隐患。目前工程应用中针对配变重过载“事中监控、事后处理”的治理方法相对被动,配变经常处于重过载状态,将导致设备加速老化、使用寿命缩短。如果能在短期内准确预测配变负荷变化趋势,对电力公司准确预知配变重过载情况并及时采取措施具有重要意义。

电力短期负荷预测一直是国内外研究的热点,学者们在提高模型预测精度、泛化能力和自适应能力方面已做了大量研究工作[1],传统负荷预测方法包括ARIMA[2]、灰色模型方法[3-4]、支持向量机[5-6]、相似日法[7-8]。近年来,随着电网信息化程度不断提高,在线监测装置等终端设备对电网运行数据的采集频率和准确性也不断提升[9],以深度学习为代表的人工智能技术使负荷预测研究取得快速发展。其中,最具代表性的CNN[10]、LSTM[9-11]和DBN[12]等技术通过增加网络深度形成混合神经网络,进一步提高高维特征学习能力。然而,以上电力负荷预测研究和应用通常面向市/县等广域总负荷中短期预测,应用于台区配变负荷时其预测精度明显不足,究其原因是由于市/县等广域总负荷为各台区配变负荷叠加,高频分量、噪声在内部相互抵消,最终呈现的负荷曲线更平滑,而台区配变负荷尽管在长时间尺度内具有明显的周期特征,但短时间尺度内包含大量高频分量、噪声,随机性特征更加明显,极大地增加了预测模型的拟合难度,故需要寻求符合台区短期负荷特征、更精确的预测技术[13]。

针对强随机性、高复杂度的负荷预测,现有研究主要采用负荷分解方法和多模型融合预测方法,使用较广泛的负荷分解方法主要有:小波分析法[14]、滤波分析法、模态经验分解法(Empirical Mode Decomposition,EMD)及其衍生算法[13,15-17]。通过预测中引入负荷分解方法,分离时间序列局部特征信号,有针对性地选取预测方法单独预测,可以加强局部特征信号学习能力,提升综合预测精度。文献[13]则采用GRU神经网络和多元线性回归方法分别对不同频率时序分量进行预测,在数据包含较多噪声情况下,取得较好的预测效果。文献[14]采用小波分解将历史数据分解为多个不同特征的数据序列,结合LSTM网络实现特征提取和预测,在模型预测精度和抗噪性能提升方面效果明显,若进一步对不同分量有针对性地优化模型超参数,效果会更佳。文献[15]通过小波分解将负荷序列分解为低频和高频分量,并结合各频率分量规律,利用相似日集构建相应BP神经网络模型,根据分量特征有针对性地调整预测模型,有效改善了模型预测能力。文献[16]通过集合EMD分解负荷数据,分别对各时序分量建立不同Elman递归神经网络模型,但在实际预测中模型调参过程较复杂。文献[17]利用EMD将用户侧负荷分解为波动负荷和趋势负荷,增加相似日和UTICI热环境特征因素,以丰富波动负荷预测的输入参数,预测效果较好,若能增加量化衡量UTICI在波动负荷预测中的贡献,对强随机性负荷预测将更佳,具备工程适用性。然而,上述文献中针对高随机性的高频分量预测算法均较单一,导致预测模型泛化性不佳,通过多模型融合提升对负荷不同频率特征分量的综合预测能力成为一种有效手段。

多模型融合是将多个预测模型信息生成新模型的集成技术,可获得比单一算法更优越的性能。多模型融合方法主要有线性加权融合法、多神经网络并行的模型融合[18]、Blending和Stacking框架下的集成学习[19-21]等。文献[18]通过顶层全连接神经网络将FCNN、LSTM、ResNet神经网络模型融合为一个模型,该融合模型预测精度优于单独模型,且在工程实践中易于实现。文献[19]通过Stacking融合XGBoost算法不同参数模型构成综合预测系统,减小了XGBoost模型参数对预测精度的影响。文献[20]提出一种堆叠式XGB-LGBM-MLP模型用于处理负荷的随机变化问题,并对比了多种优化算法的模型超参数优化能力。文献[21]则通过实验发现在Stacking融合模型中引入包括LSTM、XGBoost等多个差异化预测算法,充分体现Stacking集成学习的优势。综上,采用Stacking集成学习框架实现多模型融合可以兼容多类型预测算法,拓宽模型数据观测空间,实现各算法取长补短,从而综合提高预测模型泛化能力。

针对台区配变负荷受多方面复杂因素影响,在其规律性较强的常规平稳特性负荷基础上,局部表现出较强随机特征,传统单一预测方法难以准确学习其中规律的问题,本文提出一种EMD-Stacking-MLR的短期负荷预测方法。

1 基于EMD-Stacking-MLR的负荷预测模型框架

基于EMD-Stacking-MLR的短期负荷预测模型由5部分组合:EMD分解及高低频判断,低频MLR预测,高频Stacking预测,叠加重构负荷曲线。基于EMD-Stacking-MLR的负荷预测模型框架如图1 所示。

图1 基于EMD-Stacking-MLR的负荷预测模型框架

首先通过EMD方法分解台区配变负荷数据,从高频到低频有效分离原负荷的不同时间尺度的局部特征[22],使分量中的局部特征单一化,进一步简化单独预测模型学习难度。然后利用样本熵对各IMF分量进行复杂度分析,计算得到各分量样本熵统计特性,以熵值大小为依据划分高、低频分量。

针对复杂度和随机变化率较低的低频分量,采用较简单的多元线性回归方法即可以满足预测精度要求,而且能够避免复杂的参数调试,减少模型计算量和训练时间。针对复杂度和随机变化率较高的高频分量,采用具有较强学习能力和预测精度的Stacking多模型融合方法单独预测,最大程度地挖掘规律。最后,叠加低频IMF和高频IMF预测结果,得到最终配变预测负荷曲线。

2 基于EMD的负荷高低频分解

2.1 经验模态分解

EMD方法是依据数据自身的时间尺度特征,从高频到低频将非平稳和非线性信号分解为有限个本征模函数(IMF)分量,使大部分中低频IMF分量平稳化,且各IMF分量保留了原信号的不同时间尺度的局部特征信号,与传统时频域分解方法相比具有基函数自适应性和高信噪比的优点[22]。电力负荷按其工作制可分为连续工作制负荷、短时工作制负荷、反复短时工作制负荷,即不同工作制的电力负荷其变化频率特点不同。配变电力负荷为各类工作制负荷的叠加,其中包含从高频到低频的局部特征,因此利用EMD分解配变电力负荷数据具有物理意义。通过提取其不同时间尺度以及不同频率的局部特征,实现有针对性的单独预测,减小不同特征间的干扰,可有效提升低频IMF分量预测准确性。EMD分解配变负荷时间序列流程如图2所示。

图2 EMD分解配变负荷时间序列流程

首先根据配变负荷曲线L(t),构造均值包络线m(t)。原配变负荷曲线减均值包络线分量,得到中间信号h(t)。并判断该中间信号是否满足作为IMF的两个条件(整个数据段内,IMF极值点数目m和过零点数目n,满足条件|m-n|≤1;任意时刻上、下包络线相对于时间轴局部对称。)若均满足条件,中间信号h(t)作为一个IMF分量c(t);如果不满足,则以h(t)为基础,经过若干次的迭代直到满足条件。原负荷曲线减所得IMF分量c(t)后,作为配变负荷曲线L′(t),继续进行EMD分解得到新的IMF分量,直到中间信号不过零即得到残差分量r(t)时完成EMD分解。

原配变负荷曲线可表示为各IMF分量和1个残差分量之和:

(1)

式中:ci(t)——配变负荷时间序列L(t)第i个IMF分量;

r(t)——残差分量。

本文将残差分量视作一组低频IMF分量进行低频预测。

2.2 样本熵

样本熵是衡量系统复杂度的定量描述工具之一。从时间序列复杂性的角度出发,通过规定窗口观察对比两次观察的特征向量之间的距离,用于度量系统产生新模式概率的大小,定量描述系统的复杂度和规则度。其熵值大小准确反映时间序列的复杂度和系统产生新模式的概率,样本熵值越大,时间序列越复杂,系统产生新模式的概率越大;反之,时间序列越简单,概率越小[16,23-24]。针对给定时间序列X=[x1,x2,…,xn],样本熵SampEn计算步骤:

(1)将序列按照顺序组成一组m维矢量,Xm,1,…,Xm,n-m+1,其中Xm,i=[xi,xi+1,…,xi+m-1],1≤i≤n-m+1。

(2)定义向量Xm, i和Xm,j之间的距离为两者对应元素中最大差值的绝对值,即

(2)

(4)求Bm,i的平均值Bm,即

(3)

(5)重复以上步骤(1)~步骤(4)求得Bm+1。

(6)当n为有限值时,样本熵SampEn公式为

(4)

其中,参数m为观察窗口维数,r为距离阈值。由于本文针对IMF分量时间序列ci(t)将样本熵计算仅关注其变化趋势,而样本熵的变化趋势不受m和r取值情况的影响,故参数设置为工程应用中的常规数值m=2,r=0.2Std,并将样本熵值接近于0的IMF分量划分为低频分量,其余则划分为高频分量。

3 高、低频负荷分量预测方法

通过EMD负荷分解得到的有限个高、低频分量,相比于原负荷曲线具有更简单的波动规律和明显的频率特征。高频、低频分量对应适用的预测方法不同,需分别选择适用的预测方法建立独立模型。与传统的预测方法SVM、BP、LSTM相比,利用多元线性回归方法实现低频分量短期预测可以极大简化模型复杂度,并在预测时间步长较小的条件下,可获得更高的预测精度。高频分量的预测是本研究的难点,预测模型需兼具预测精度和泛化能力。本文利用Stacking集成学习模型充分挖掘特征规律,尽量提高高频分量的预测精度和普遍适用性。

3.1 多元线性回归

根据低频IMF分量复杂度低,且曲线光滑且平缓的特点,通过多元线性回归(Multiple Linear Regression,MLR)算法进行预测,可以在高准确率的基础上提高其训练过程速度[13],从而简化EMD-MLR-Stacking预测方法针对低频分量的计算。

MLR是一种传统数学统计模型,其表达式为

Y=X·β+μ

(5)

采用最小二乘法对回归参数进行估计,可得回归函数如下

β′=(XTX)-1XTY

(6)

式中:Y——待预测时点的分量数据;

X——影响预测时点的分量数据的各历史分量数据;

β——常数和回归系数;

μ——随机扰动;

β′——预测模型的回归系数[25]。

3.2 Stacking集成学习预测方法

Stacking是一种集成机器学习算法,将不同的机器学习算法通过不同的方式结合在一起,以此获得比单一算法更优越的性能,提升预测结果准确性和泛化性[19,21]。

根据Stacking模型现有研究结论,提高第1层基学习器多样性和差异性并兼具预测性能,可以最大程度体现不同算法的优势,从不同的数据维度和算法原理构建预测模型,使得Stacking集成学习模型具有更好的鲁棒性和预测效果[21]。本文依据经负荷分解后得到的部分高频分量数据仍具有连续性的特点,即当前时刻的高频分量数据与上一时刻数据之间仍存在相关性,引入LSTM作为基学习器之一。利用其长期的保存历史输入的特点可以提高Stacking处理和预测时间序列中的间隔、延迟和周期性特征的能力。BP网络是一种按照误差逆向传播算法训练的前馈神经网络,通过不断修正每层的权重来最小化整体误差[26],引入BP作为基学习器可在集成学习模型处理低连续性特征分量时平衡减少LSTM的时序影响。从算法原理差异角度考虑,SVM算法建立在统计学习理论的VC 维理论和结构风险最小原理的基础上。SVM作为基学习器对于解决小样本、非线性及高维度的回归问题具有优势。此外,XGBoost是基于GBDT的一种优化算法,在模型中增加了二阶导数信息、正则项、列抽样,极大提升了模型防过拟合能力、训练速度。模型第2层选择简单高效的MLR算法,可以集合第1层多个学习器的学习特征结果纠正偏置,并有效防止模型过拟合。

综上所述,Stacking集成学习框架下1层基学习器选择LSTM神经网络、BP神经网络、支持向量机、XGBoost算法;2层选择MLR算法作为元学习器。即先利用多个基学习器共同学习输入特征,从不同的数据空间和角度挖掘特征规律,得到多个学习结果。然后通过Stacking 集成学习模型2层元学习器MLR算法综合以上学习结果实现模型输出。

为了防止Stacking模型过拟合需采用K折交叉验证法训练模型。Stacking模型训练流程如图3所示。

图3 Stacking模型训练流程

具体步骤如下:

(1)首先将一高频分量数据划分为初始训练集Train和初始测试集Test。

(2)采用四折交叉验证法训练基学习器。将Train随机划分为4部分(T1,T2,T3,T4),选择其中一部分为验证集P,其余部分合并为训练集,形成4种训练方案用于训练基学习器。每个基学习器将预测得到4组数据(Ri1,Ri2,Ri3,Ri4),i表示第i种基学习器算法,并能首尾拼接为数据长度完整的次训练集Train′。

(3)将各基学习器的预测结果Train′纵向合并为4维数集Train″,用于训练2层元学习器MLR,从而完成Stacking融合模型的训练,其中

(7)

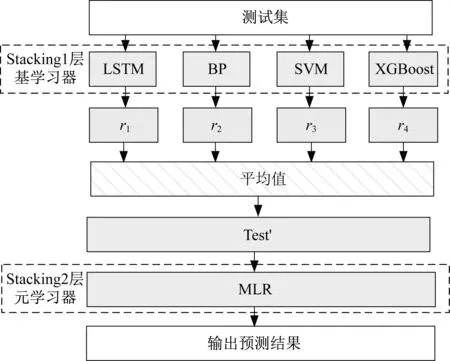

为了检验模型预测精度和有效性,将完成训练的Stacking融合模型用于预测初始测试集Test。Stacking模型预测流程如图4所示。

图4 Stacking模型预测流程

模型预测步骤如下:

(1)通过各I层基学习器预测初始测试集Test,并取预测结果(r1,r2,r3,r4)的平均值Test′作为2层元学习器MLR的测试集。

(2)以Test′为元学习器MLR模型的输入,输出最终的高频分量预测结果。

4 算例分析

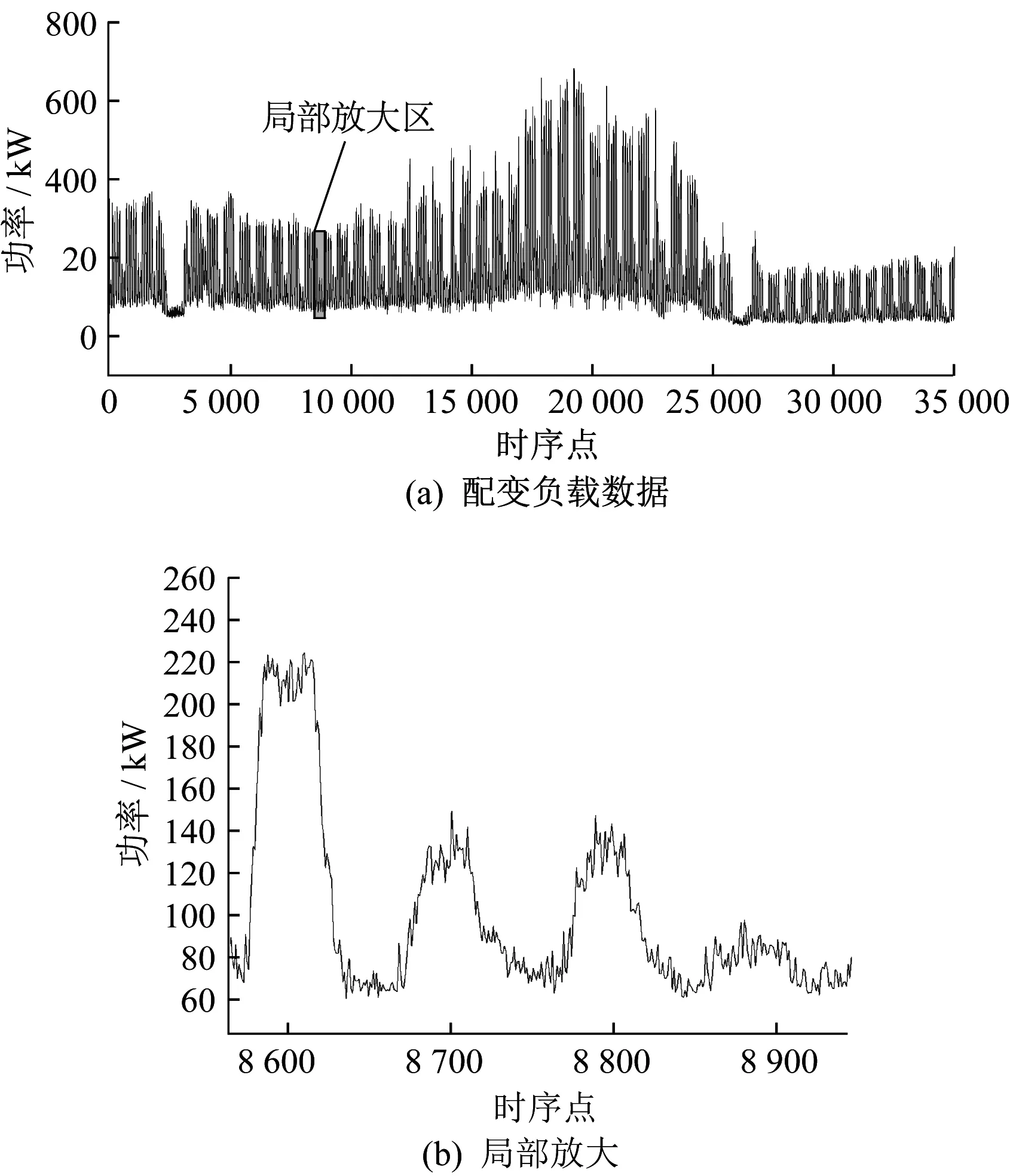

为验证文中所提方法的科学性和可靠性,实验样本为上海市浦东区某商住混合区域的10 kV台区配变负载数据,时间跨度为2017年1月1日至2017年12月31日,采样间隔为15 min。2017年样本台区配变负载数据如图5所示。由图5 中的负荷曲线局部放大图可知,台区配变负载曲线具有较明显的长周期性,但在用电峰谷区间短时间内波动较大。

图5 2017年样本台区配变负载数据

本文实验中将数据以2 h为长度做窗口滑动处理,即回溯8 个时点的数据作为“输入特征”,预测步长(30 min)后一个时点数据为“预测目标”,得到若干子时间序列数据。实验将前11个月数据划分为训练集,将12月数据划分为训练集。

首先通过经验模态分解将负载曲线长周期特征和短期波动特征分离,从而根据不同分量复杂性特点,有针对性地选择合适的预测方法。然后利用多元线性回归预测低频IMF曲线,利用Stacking集成学习预测模型预测高频IMF曲线。最后将低频分量和高频分量叠加重构,得到最终的台区配变负载预测曲线。最后,与简单LSTM和各分量模型择优的EMD叠加预测法进行对比分析,预测评价指标采用相对均方误差(RMSE),平均相对误差(MAPE)。

(8)

(9)

yi——真实值;

m——预测时点数量。

4.1 经验模态分解

将配变负荷数据做经验模态分解,得到频率由高到低的14组IMF。本文通过叠加各IMF分量得到重构曲线,利用绝对误差(AE)和平均绝对误差(MAE)计算EMD负荷分解的重构误差。

(10)

(11)

yi——真实值;

m——分解时点数量。

配变负荷经验模态分解如图6所示;配变负荷EMD分解时点重构误差如图7所示。

图6 配变负荷经验模态分解

由图7可见,各时序点的重构误差普遍较小,集中于6.00×10-9~3.50×10-8,最高重构误差仅为1.52×10-7kW,平均绝对误差为2.31×10-8kW。实验表明,EMD负荷分解能够有效保留原负荷曲线信息,重构误差数量级较小,在后续负荷预测中可以忽略重构误差的影响。

图7 配变负荷EMD分解时点重构误差

利用上述实验分解所得14组IMF时间序列数据,计算每一组的样本熵,并根据样本熵值完成IMF高频、低频分组。各组IMF的样本熵如图8所示。由图8可见,从样本IMF9样本熵0.02开始,样本熵值逐渐接近为0,且其曲线变化较平缓光滑,故将IMF9~IMF14定义为低频分量,直接使用多元线性回归对其进行预测,就能够快速高效地得到精确的预测结果。将IMF1~IMF8定义为高频分量,利用Stacking集成学习预测模型最大程度的挖掘其中规律,从而提高预测精度。其中IMF1至IMF5虽然为高频分量,但数值变化区间小,且占原负荷比重小,即其分量预测结果经过叠加后,对最终预测结果精确度影响较小。而其余分量对最终预测结果精确度影响较大,其中IMF6、IMF7和IMF14具有分量占原负荷比重较大的特点,故需要尽量提高针对上述分量的预测精度。

图8 各组IMF的样本熵

4.2 MLR预测时间步长

配变负荷数据做经验模态分解后,各分量已不具备先验经验中电力负荷与天气类型、小时、星期、月度等特征之间的强相关性特点,故输入特征为待预测时点加上预测步长后,前8个时点的历史分量数据。

由于MLR模型中影响预测时点分量数据的因素仅为历史分量数据,故需根据其预测特性,对比该模型对于不同时间跨度的预测性能。本文对低频分量中预测难度最大的IMF9和占原负荷比重最大的IMF14分别进行了单步和多步的预测实验,并计算不同预测步长下预测结果的RMSE和MAPE。其中,单步预测为提前15 min预测,多步预测为提前30 min、1 h和提前1天。实验发现分量频率较高时,MLR预测方法受预测步长影响较大,针对IMF9提前超过30 min预测将导致预测精度大幅下降,无法满足低频单分量预测结果MAPE小于10的要求,故本文将各算法统一预测步长为30 min。MLR不同时间跨度的预测结果评估如表1所示。

表1 MLR不同时间跨度的预测结果评估

4.3 Stacking基学习器相关研究

为了使得Stacking性能达到最优,需要立足于各个基模型针对各高频分量预测效果与各模型之间关联度两方面展开分析。首先,本文设计实验将各个Stacking基学习器(LSTM、BP、SVM、XGBoost算法)在IMF1至IMF8高频分量上单独预测的结果进行比较分析,并选择各个模型的最优超参数集。然后采用Pearson相关系数对每个高频分量的各基学习器模型误差差异度进行计算,以此分析不同基学习器的关联程度。

(1)Stacking预测和基学习器单独预测效果对比。本文将分量IMF1~IMF8数据分别代入各基学习器算法训练,预测出测试集的数据,并计算MAPE评价预测精度。各算法预测结果误差如表2所示。

由表2可知,各算法单独进行预测时,高频分量中IMF7、IMF8数据具有较明显的连续性特点,故相比于其他算法,LSTM算法可以有效使用前几次训练的累积信息,预测性能也较为优越。由于IMF1~IMF6变化频率更高,时间序列复杂性增大,算法预测效果明显下降。其中XGBoost算法针对以上高频分量单独预测误差普遍较其他算法低。原因在于,XGBoost善于挖掘学习深层的特征关系,使得模型训练更充分。针对不同的IMF分量,预测效果最优的算法不同,说明各算法的训练机理不同,导致其学习不同局部特征时展现的能力不同,即针对不同的IMF分量各算法适用性不同,这与前述理论相符。虽然针对IMF高频部分,根据评价指标MAPE,Stacking模型与其他一般预测方法比较,其预测精确度不是最优。但其MAPE值普遍低于单独基学习器预测的MAPE平均值。故证明,针对不同的数据集,Stacking模型比单一模型有更高的普遍适用性。

表2 各算法预测结果误差

(2)基学习器模型关联度研究。根据Stacking模型的现有研究结论,第1层基学习器差异越大,越能综合提高Stacking集成学习模型的泛化性和预测效果[21]。本文通过计算分析各基学习器算法对重要高频分量的预测误差(绝对误差AE)分布,研究各基学习器模型关联度,验证本文方法中各基学习器算法选择的合理性。各基学习器算法的IMF6和IMF7分量预测误差如图9所示。

通过分析图9中各基学习算法对重要高频分量(IMF6和IMF7)预测绝对误差AE,可见各算法的预测误差稍有差别但具有相似的趋势,可知各算法的误差相关性普遍较高。这是由于本文选择的各算法学习能力较强,且输入特征种类较单一,训练中学习到数据中的固有误差不可避免。其中XGBoost的误差分布明显较松散,但是相较其他算法,在大量时点XGBoost往往可以获得更好的预测精度,所以通过Stacking集成学习框架各算法可以发挥更有效的作用,这也进一步验证了将Stacking应用于高频分量预测的必要性。

图9 各基学习器算法的IMF6和IMF7分量预测误差

4.4 负荷曲线预测效果

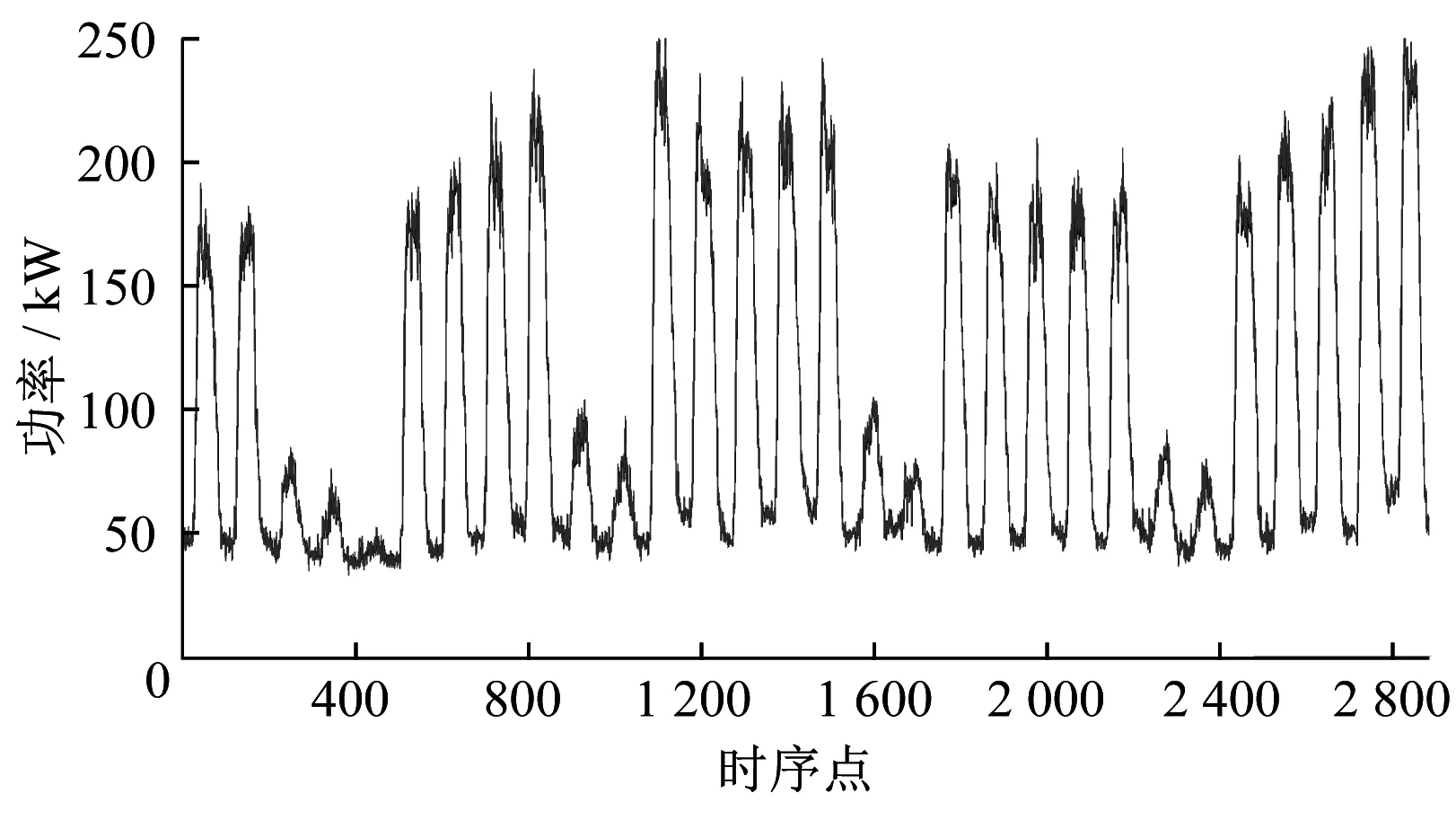

通过前述方法依次叠加由多元线性回归进行直接预测的IMF9~IMF14低频分量和利用Stacking集成学习预测模型预测的IMF1~IMF8高频分量,得到最终配变预测负荷曲线。2017年12月配变负荷预测结果如图10所示。由图10可见,在随机性较强的用电峰谷区间,采用EMD-MLR-Stacking方法预测得到的曲线均能较好地拟合配变真实负荷。

图10 2017年12月配变负荷预测结果

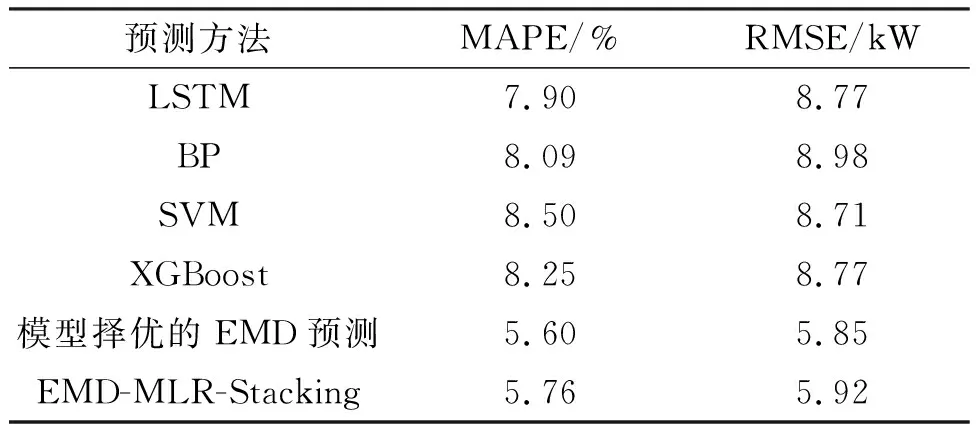

为了验证所提EMD-MLR-Stacking的有效性,本文分别搭建简单预测方法LSTM、BP、SVM、XGBoost以及各分量模型择优的EMD叠加预测法的预测模型作预测步长为30 min的负荷预测进行精度对比。2017年12月各预测模型负荷曲线预测结果评价指标如表3所示。其中,各分量模型择优的EMD叠加预测法为根据前期基学习器单独预测误差,选择各IMF分量预测效果最优的预测模型进行预测,最后将高、低频分量叠加构成预测时段负荷曲线。简单预测方法实验以历史原负荷数据为输入,直接预测输出时段负荷曲线。为了绘图清晰,本文从测试集预测结果中选取局部负荷曲线,观察各预测方法的拟合效果。各预测方法的局部负荷曲线预测结果对比如图11所示。实验结果表明简单预测方法的预测结果均有一定程度的峰值滞后的问题,这是因为其预测结果受输入量历史负荷的影响较大。基于EMD-MLR-Stacking预测比简单预测方法直接预测精确度明显更高,峰值滞后的问题明显改善。其预测精度虽然比EMD叠加预测法稍低(两者预测结果误差RMSE仅差0.07),但各分量模型择优的EMD叠加预测法是根据预测误差选择分量预测模型,即在实际应用中难以实现,而基于EMD-MLR-Stacking预测克服了各分量预测模型需要重新选择的缺点,有更高的实用性。

表3 2017年12月各预测模型负荷曲线预测结果评价指标

图11 各预测方法的局部负荷曲线预测结果对比

5 结 语

本文围绕电力负荷预测提出一种针对富含高频局部分量和噪声的EMD-MLR-Stacking负荷预测方法。实验结果表明,本文所提出方法不仅能够预测出电力负荷变化趋势,对负荷局部细节也具有较高的预测精度,对比其他常见单一预测方法,预测精度显著提升,且EMD-MLR-Stacking预测克服了一般基于EMD的预测方法中各分量预测模型及其参数需要重新选择的缺点,具有更高的实用性。