无人机飞行高度对植被覆盖度和植被指数估算结果的影响

何 勇,杜晓月,郑力源,朱姜蓬,岑海燕,许丽佳

·农业航空工程·

无人机飞行高度对植被覆盖度和植被指数估算结果的影响

何 勇1,2,杜晓月1,2,郑力源1,2,朱姜蓬1,2,岑海燕1,2,许丽佳3

(1. 浙江大学生物系统工程与食品科学学院,杭州 310058;2. 农业农村部光谱检测重点实验室,杭州 310058;3. 四川农业大学机电学院,四川 625014)

将无人机与多种成像传感设备相结合可实现田间作物表型信息的全面获取。针对田间复杂环境下无人机搭载多种成像传感设备在不同飞行高度处提取的作物信息具有差异性的问题,该研究着重探究了无人机搭载2种成像传感设备获取图像时,不同飞行高度对估算植被覆盖度以及植被指数结果的影响。首先为防止外界环境变化对获取图像质量造成干扰,通过最近邻插值算法将无人机飞行高度为25 m处获取的2个多光谱和可见光图像数据集分别退化为10个不同地面分辨率的模糊图像数据集,模拟无人机在不同飞行高度下获取的作物图像。然后获取50 m高度处的无人机图像数据集,通过皮尔逊相关性分析验证模拟数据集的有效性。最后采用随机森林模型估算不同数据集中的植被覆盖度,分类精度大于91%。结果发现,当植被覆盖度小于1/2时,随着地面分辨率的降低该指标不断被低估,反之则被高估。飞行高度50 m的真实图像与模拟图像估算植被覆盖度结果的相关系数为0.992 8,两者具有强相关性,模拟图像估算得到的植被覆盖度变化具备参考意义。植被指数估算结果中,首先对无人机图像数据集进行辐射校正、阈值分割等图像预处理,然后根据公式计算得到植被指数,最后通过假设性检验对10个图像数据集计算得出的植被指数进行分析。结果发现,可见光植被指数在飞行高度61 m时均具备显著性差异(<0.05),在飞行高度42 m时没有差异(>0.1),多光谱植被指数在10个高度下均没有显著性差异,因此为保证无人机获取数据的准确性与完整性,当无人机搭载该研究的两种相机获取作物信息时建议飞行高度为42 m。研究结果可为研究者利用无人机搭载多传感设备获取作物信息设定合适的飞行高度、减小作业成本提供参考。

无人机;植被指数;植被覆盖度;飞行策略

0 引 言

无人机(Unmanned Aerial Vehicle,UAV)作为中小型飞行平台具有不需要专用机场、起降灵活、成本低等优点,与以时效性高、不损害目标物体等特点著称的遥感技术相结合可实现复杂农田环境下高效、无损的采集作物表型信息[1],通过图谱处理技术可监测作物表型特征如植被覆盖度[2],作物高度[3-5],氮素[6-7],叶绿素[8],生物量[9-10]等,在农业领域具有广泛的应用。目前可用于无人机的机载成像传感设备大致可分为高光谱成像设备、多光谱成像设备、可见光成像设备3种,采集到的光谱信息和空间信息各有不同,总体来看可见光成像设备可获取高分辨率的作物三维信息但只可以提供R、G、B三通道的光谱信息,高光谱成像设备在光谱维可以捕捉更多的信息但受限于成像方式应用较少,多光谱成像设备由于其体积与成像方式受到研究学者的青睐[11],但只可获取部分空间信息和光谱信息。

因此为了满足不同的农情信息获取需求,研究学者采用多种成像传感设备相结合的方式采集作物信息[1,11-12]。但随着无人机搭载成像传感设备的多样性逐渐增加,不同传感设备分辨率、视场角各不相同,无人机飞行参数设定成为难题。现有的飞行参数设定大多依赖经验法则,尤其是飞行高度设定一般都是在保证飞行安全、无障碍物、获取图像清晰、无人机风场不扰动作物的情况下人为设定,往往无法最大化的提高传感设备利用效率,使得实验成本增加,耗费人力物力。因此研究不同飞行高度变化对获取作物信息准确性的影响对优化飞行策略、提高飞行效率、降低作业成本具有重要意义。

由于植被覆盖度(Fractional Vegetation Cover,FVC)是作物非常重要的生理指标,它作为一个定量化描述作物生长发育动态差异的表型参数[8,12],与冠层理化参数如叶面积指数[13]等具有非常密切的关系,还可用来评估作物的生理生化指标,如作物氮素[14]、早期活力[15]和衰老状态[16]等。同时植被指数(Vegetation Indices,VIs)可用来反演叶绿素含量[8,17]、干物质含量[18]、植被覆盖度[19]、产量[20]等,对生成处方图、指导农田增产施肥喷药至关重要。

因此本研究采用植被覆盖度和植被指数作为探究无人机飞行高度设定的参考,主要工作为针对无人机飞行高度设定往往难以兼顾搭载的多种成像传感设备性能各有不同的难题,以搭载两种不同的成像传感设备为例,研究了无人机不同飞行高度变化对估算作物植被覆盖度和植被指数结果的影响,根据信息不变性最终确定无人机最优飞行高度,实现高效、无损获取作物信息的同时提高飞行效率。

1 材料和方法

1.1 试验田和图像获取

本研究中使用多旋翼UAV[1]搭载2种传感设备(多光谱传感设备和可见光传感设备)在浙江大学西区油菜试验田进行试验(如图1所示),试验田内部小区为规则化分布,长2 m,宽1.2 m,油菜生长时期为抽薹早期。采用的UAV机身高约0.35 m,机翼圆周直径约为1.1 m,为延长续航时间使用16 000 mAh的锂电池提供动力,最长可飞行25 min,最高载质量8 kg传感设备。UAV搭载的多光谱(Multispectral,MS)成像传感设备为XIMEA的MQ022MG-CM工业相机(XIMEA,Munster,Germany),可采集400~1 000 nm范围内不连续的25个波段光谱信息(波长分别为603、611、624、632、641、649、657、666、674、679、693、718、732、745、758、771、784、796、808、827、838、848、859、868和870 nm),感光元件尺寸为11.3 mm×6.0 mm,相机镜头采用Edmund 16 mm定焦镜头(Edmund,Barrington,USA),可获取分辨率为409像素×216像素的图像,相机质量约123 g,同时该平台搭载了索尼NEX-7 (Sony,Tokyo,Japan)作为可见光(Red-Green-Blue,RGB)成像传感设备采集高分辨率图像,感光元件尺寸为23.5 mm×15.6 mm图像分辨率为6 000像素×4 000像素,镜头为索尼SEL16F28(Sony,Tokyo,Japan),相机质量约285 g。

图1 试验地点和场地分布图

多旋翼无人机分别搭载多光谱相机和可见光相机以定点采集的方式在25和50 m处采集油菜图像,重叠度设定为航向75%、旁向60%。采集当天无云无风,手动设置两个传感设备的曝光时间等参数。总共获取飞行高度25 m时高精度多光谱(MS)和可见光(RGB)图像各162张,飞行高度50 m时获取MS和RGB图像各88张。同一飞行架次的MS图像经过辐射一致性校正后利用Agisoft Photoscan软件通过特征点匹配、对齐图像、生成网格、建立正射影图等步骤进行图像拼接得到正射影像图,25 m高度处的正射影图如图2a所示。RGB图像直接通过Agisoft Photoscan进行图像拼接获取正射影图,25 m高度处的正射影图如图2b所示。利用Matlab可视化分别将多光谱和可见光正射影图根据种植小区的物理坐标分布进行批量裁剪,通过图像像素坐标与种植小区的感兴趣区域(Region Of Interest,ROI)一一对应,最终获得两种真实高度下RGB和多光谱影像各315个样本。

图2 无人机正射影像图

1.2 无人机图像处理

地面分辨率大小在无人机图像处理中至关重要,他定义了单位像素所描述的实际目标长度[21],数值越大说明地面分辨率越低,根据式(1)可知地面分辨率与飞行高度密切相关,计算式如下:

GR×FH/FL(1)

式中GR表示图像的地面分辨率,表示相机传感器的单像素尺寸,FH表示飞行高度,FL表示传感器镜头焦距。当无人机飞行高度增加时,相机传感器的单像素尺寸保持不变,传感器镜头焦距保持不变,则单位像素中描述的实际目标长度变长,涵盖的地物信息增多,使得图像的混合像元效应加剧。因此地面分辨率越高意味着可以获取更为细致的作物信息。

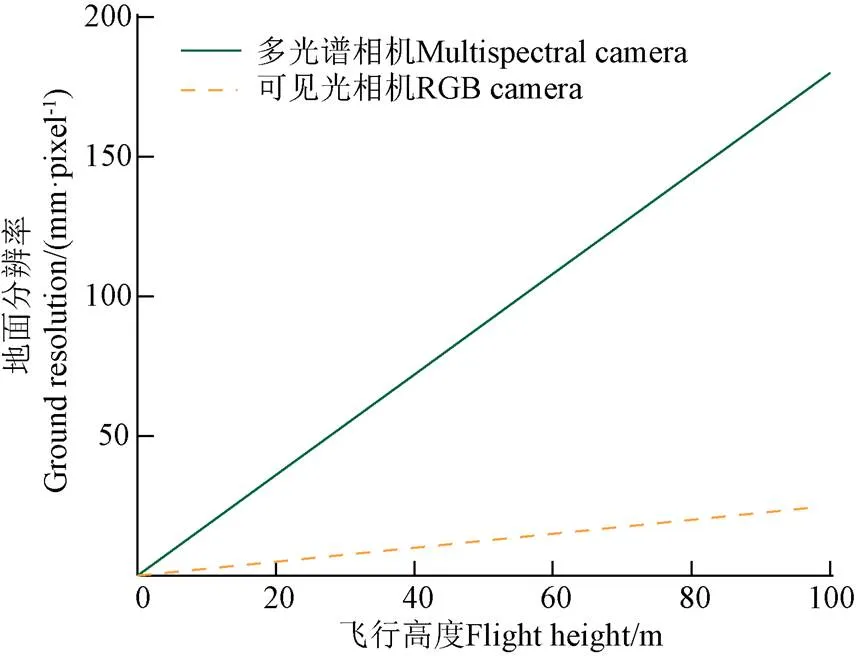

由式(1)可知,飞行高度与地面分辨率成线性关系(图 3),因此为了控制单一变量仅探究飞行高度对植被覆盖度和植被指数估算结果的影响,避免受外界环境和相机配置(如光照条件、曝光时间等)对获取图像质量造成干扰,采用最近邻插值法将获取的高分辨率多光谱图像和可见光图像(即飞行高度25 m)依次退化成为不同梯度的低地面分辨率的模糊图像,以模拟无人机在不同飞行高度处获取的图像。该方法中新插值像素点的值的确定方式是先将新插值点映射至初始图像中(图4),假设坐标是(x,y),然后计算该点和周围相邻4个像素点(0,0)、(1,1)、(2,2)、(3,3)的距离,距离数值最小的相邻像素点的值即为该点的值。

图3 多光谱相机和RGB相机不同飞行高度与地面分辨率关系图

注:x代表横坐标,y代表纵坐标,0为原点;A,B,C,D分别代表需要求得点L的相邻像素点,坐标值采用(xm, ym)(m=0,1,2,3)形式表示。xn代表求得像素点L的横坐标,yn代表所求像素点L的纵坐标。

根据式(1)设定FH=25 m,则计算得出多光谱相机的GR=43 mm/pixel,再将每个小区图像通过最近邻插值法降级为不同地面分辨率(从43~430 mm/pixel不均等的10个水平,第一水平为真实获取的图像即参考图像)的图像。25 m高度时可见光相机的地面分辨率为6 mm/pixel,运用同样方法降级为地面分辨率6~60 mm/pixel不等的10个水平的粗略图像。

1.3 随机森林估算植被覆盖度

由于随机森林[22]的像素分类模型无需大量的训练样本和动态设置阈值、在复杂光照条件(阴影和强光)下也能较好地对植被进行分割[23],因此本研究采用该算法来估算油菜的植被覆盖度(Fractional Vegetation Cover,FVC)。根据前人研究[8,13]利用高清可见光图像可计算真实的FVC,RGB图像较MS图像具备更高的空间分辨率,25 m高度时地面分辨率为6 mm/pixel,可作为真实FVC。对获取的全部可见光图像进行分类处理并计算植被覆盖度,暂不讨论多光谱图像对其的计算结果。将两种不同高度的可见光正射影图通过Matlab图像裁剪算法以不同种植小区为最小单位分别裁剪得到不同高度各315个样本图像,由于小区均匀分布当飞行高度25 m时获得每个样本大小为480像素×160像素,飞行高度50 m时样本大小240像素×80像素。随机森林分类模型的主要步骤包括构建训练集、利用所构建的训练集进行训练生成分类模型、再对所有图像像素进行分类。在不同地面分辨率的油菜小区图像中分别建立分类模型,按照2∶1的比例随机分为训练集和测试集,在训练图像上选择植被和背景类别的兴趣区域,植被的兴趣区域包含阴影叶和强光照射叶等植被,背景的兴趣区域包括土壤和农田设施等非植被场景。每个兴趣区域只能属于植被或者背景类别之一,并进行类别标记(植被标签为1,背景标签为0)。利用每个训练集数据的6个颜色特征(,,,,,)生成决策树,应用构造的树模型将像素分类为植被或背景类。然后去除背景,以植被像素除以图像像素得到最终每个小区的FVC。

1.4 部分植被指数计算

由于油菜对不同波长光的响应不同,通常表现为在绿光、近红外波段具有较强的反射效果,在蓝光、红光波段具有吸收效果,因此结合油菜不同波段的反射、吸收特性,研究者提出不同的植被指数用于增强植被信息、降低背景干扰,达到更好的对作物进行后续研究的目的[24-27]。具体实现方式是首先对获取的无人机图像数据集通过地面反射率校正板进行辐射一致性校正(式(2)),然后通过阈值分割去除背景得到不同光谱波段的作物光谱反射率曲线,通过不同光谱波段反射率进行组合运算最终得到作物的植被指数。

n=DNn×0×DN0-1(2)

式中DN0为地面反射率校正板的平均图像灰度值,0为已知的地面反射率校正板的光谱反射率,并且地面反射率校正板光谱反射率均一,DNn为光谱图像的各个像素的DN,n为求得的光谱图像的各个像素的反射率。目前遥感领域中常用的植被指数根据使用波段的不同大致可分为近红外植被指数和可见光植被指数,应用较为广泛的近红外波段范围的有归一化植被指数[28]、比值植被指数[29]和比值短波红外指数[30]等。运用可见光波段计算的主要有过绿指数[31]、归一化绿红差异指数[32]、差异植被指数[33]、可见大气阻力指数[34]及红绿比值指数[35]等。本研究基于可见光相机对比了归一化绿红差异指数、差异植被指数和过绿指数,基于多光谱相机对比了归一化植被指数和比值植被指数,分别分析了在不同地面分辨率下图像对其的影响。植被指数计算如表1所示。

表1 基于多光谱和可见光相机的植被指数

注:=/(++),=/(++),=B/(++),、、分别为红、绿、蓝通道的灰度值;R代表600~1 000 nm波段范围内的光谱反射率值。

Note:=/(++),=/(++),=/(++),,andare the DNs of Red, Blue and Green channels, respectively.Rrepresents the reflectance of a variable band in the spectral region of 600-1000 nm.

2 结果评价与飞行策略

本研究采用决定系数(2)和均方根误差(Root Mean Square Error,RMSE)两个常规指标作为估算结果的评价指标,针对不同地面分辨率图像计算得到的植被指数采用假设性检验方式判别是否具有显著性差异。将参考图像分别与9个水平图像进行假设性检验,假设2个样本为独立的随机样本并遵循正态分布,给定置信区间(1-)为0.95,显著性水平()为0.05,计算得到值。≤0.001为有极显著差异,0.001≤≤0.01为显著差异,0.01≤≤0.05为有差异,0.05<为没有差异。

当出现FHm-1高度的假设性检验结果>0.05且FHm高度的假设性检验结果≤0.05时说明该高度(FHm)及以上高度获取的作物信息与真实获得作物信息具有统计学差异,因此无人机在搭载该设备进行图像获取时应该低于FHm飞行。为了提高飞行效率降低飞行成本并获取正确的光谱图像,最优的飞行高度应设定为FHm-1。值得注意的是为了得到更为精确的飞行高度可以进行更为精细的图像退化处理研究。

3 结果与分析

3.1 模拟图像估算植被覆盖度变化

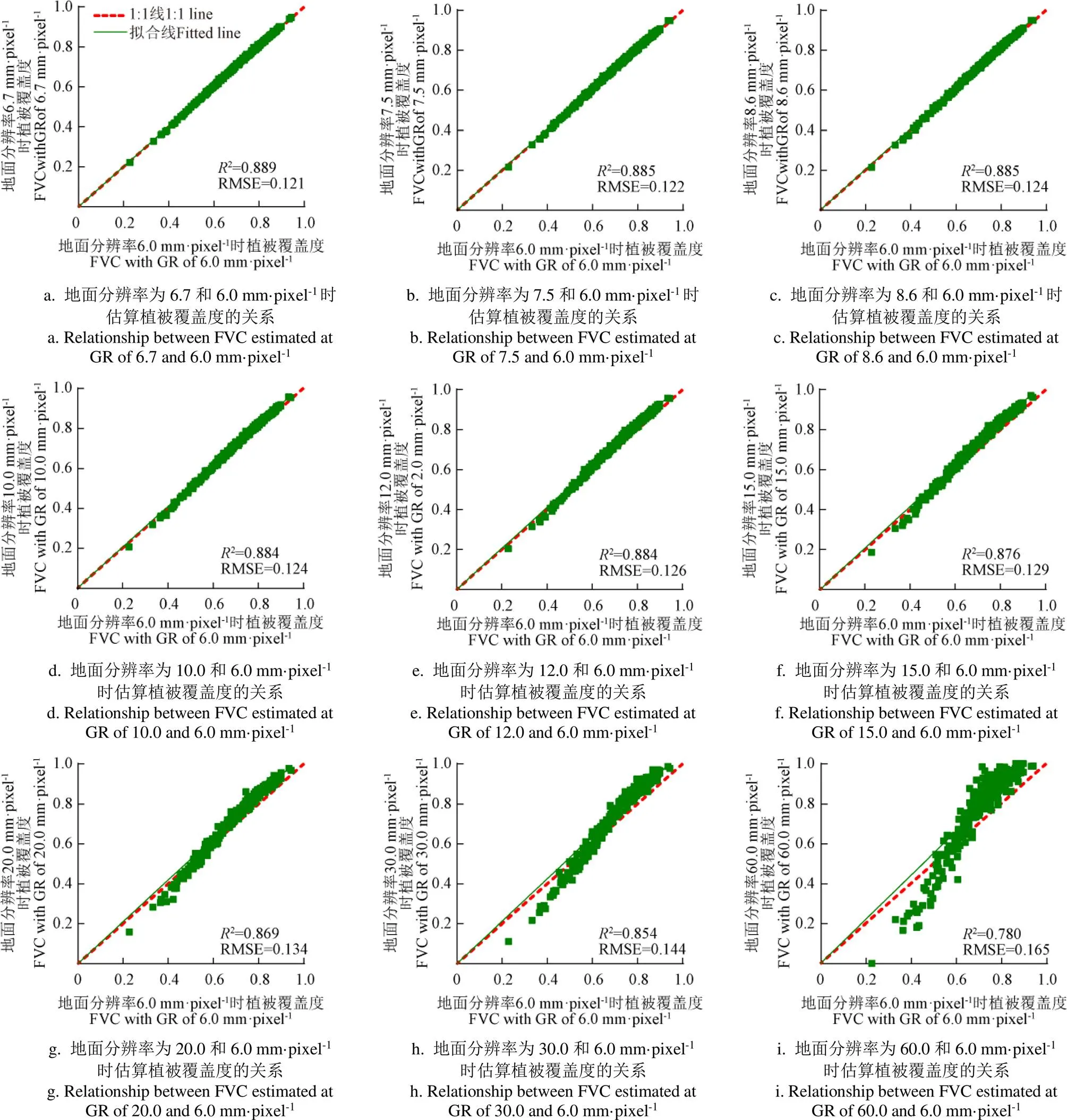

将无人机获取的高精度(飞行高度25 m)可见光图像通过最近邻插值法依次得到9个水平的低地面分辨率图像,由于不同高度获取图像特征不同,为每一个高度的可见光数据集分别建立RF分类模型,并按照2∶1随机分为训练集和测试集,测试集数据用来评估模型的分类准确性,在本研究中总体平均准确性>91%。不同地面分辨率图像植被分割效果如图5所示,可以看出,FVC准确度与地面分辨率高低息息相关,参照图像上的植被部分能够被准确地分割,随着地面分辨率的降低,植被区域的细节逐渐模糊和丢失。将低地面分辨率图像与参考图像估算得到的FVC作线性回归,如图6所示,发现随着地面分辨率降低,2不断减小,RMSE呈上升趋势,即随着飞行高度的增加对FVC计算产生的影响越大。

注:单位: mm·pixel-1。

图6 不同低地面分辨率图像与参考图像的植被覆盖度关系

选取植被覆盖度大于0.5的所有田块做统计分析,发现随着地面分辨率降低,FVC呈上升趋势并趋近于1,而对于植被覆盖度小于0.5的所有田块发现随着地面分辨率降低FVC呈下降趋势并趋近于0,分别抽取了FVC>0.5和<0.5的3个样本小区(如图7)展示了各小区的植被覆盖度随地面分辨率的变化趋势。由于没有FVC=0.5的样本小区,特别选取了FVC最接近于0.5(FVC=0.497)的样本小区,如图7b 中样本编号3所示。Hu等[36]同样验证了此结论。综上,随着飞行高度的增加,估算植被覆盖度的结果呈现规律性变化,当FVC大于0.5时估算FVC逐渐增大,当FVC小于0.5时估算FVC逐渐减小。

3.2 真实图像估算植被覆盖度变化

为了验证利用最近邻插值算法得出的不同高度图像与真实飞行高度得到的图像的差异性。采用飞行高度50 m(GR为12 mm/pixel)的真实图像作相同处理,即首先将该高度下的正射影图像首先通过Matlab根据样本进行剪裁,然后运用随机森林分类算法分割植被与背景,计算得到该高度下的不同样本的植被覆盖度,最后与模拟该高度图像的植被覆盖作皮尔逊相关性分析,结果显示相关系数为0.992 8,具有强相关性,说明模拟图像估算得到的植被覆盖度具备参考意义。

由于外界扰动作用,飞行高度50 m(GR为12 mm/pixel)时获取的原始图像和25 m(GR为6 mm/pixel)时获取的图像存在时间、光照、作物形态的差异,使得参考图像与模拟图像对植被覆盖度估算产生不同。但研究发现不同地面分辨率图像估算植被覆盖度变化的规律不变,对于真实获取的2种不同地面分辨率图像估算FVC的结果如表2所示。当FVC>0.5的样本在飞行高度50 m处得到的植被覆盖度估算结果中中位数和标准偏差均比25 m处的更高,即估算的植被覆盖度数据较25 m处整体偏高且数据更离散。当FVC<0.5的样本在飞行高度50 m处得到的植被覆盖度各项指标均比25 m处得到的更低,这与模拟图像估算植被覆盖度结果的规律相同,验证了模拟图像估算FVC的可靠性。

图7 不同样本小区估算植被覆盖度随地面分辨率的变化

表2 不同地面分辨率图像的植被覆盖度估算结果

3.3 植被指数变化

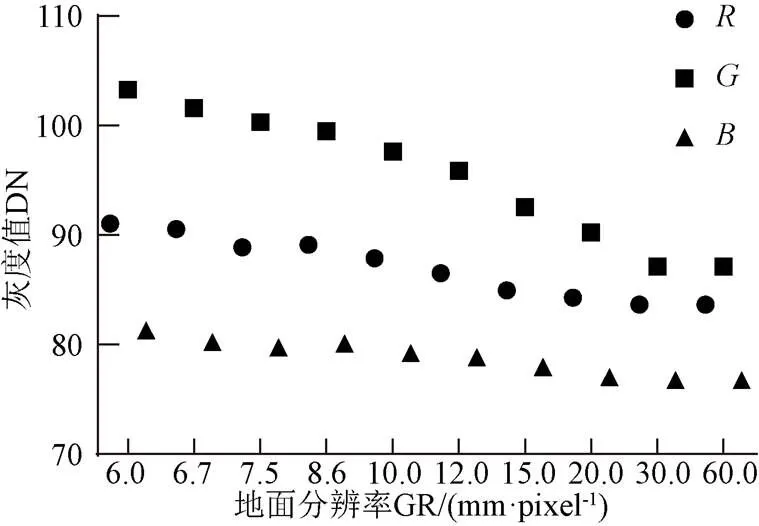

3.3.1 可见光图像

将可见光传感设备(NEX-7)在飞行高度25 m时拍摄的图像根据最近邻插值法退化成10个不同水平地面分辨率(6.0、6.7、7.5、8.6、10.0、12.0、15.0、20.0、30.0和60.0 mm/pixel)图像。研究发现随着地面分辨率降低,图像灰度值(Digital Number,DN)呈下降趋势(图8),且在大于30 mm/pixel地面分辨率时会出现一个平缓现象。将计算得到的归一化绿红差值指数NGRDI、可见光波段差异植被指数VDVI、过绿指数EXG分别作假设性检验,结果如图9所示。

图8 DN值随地面分辨率的变化

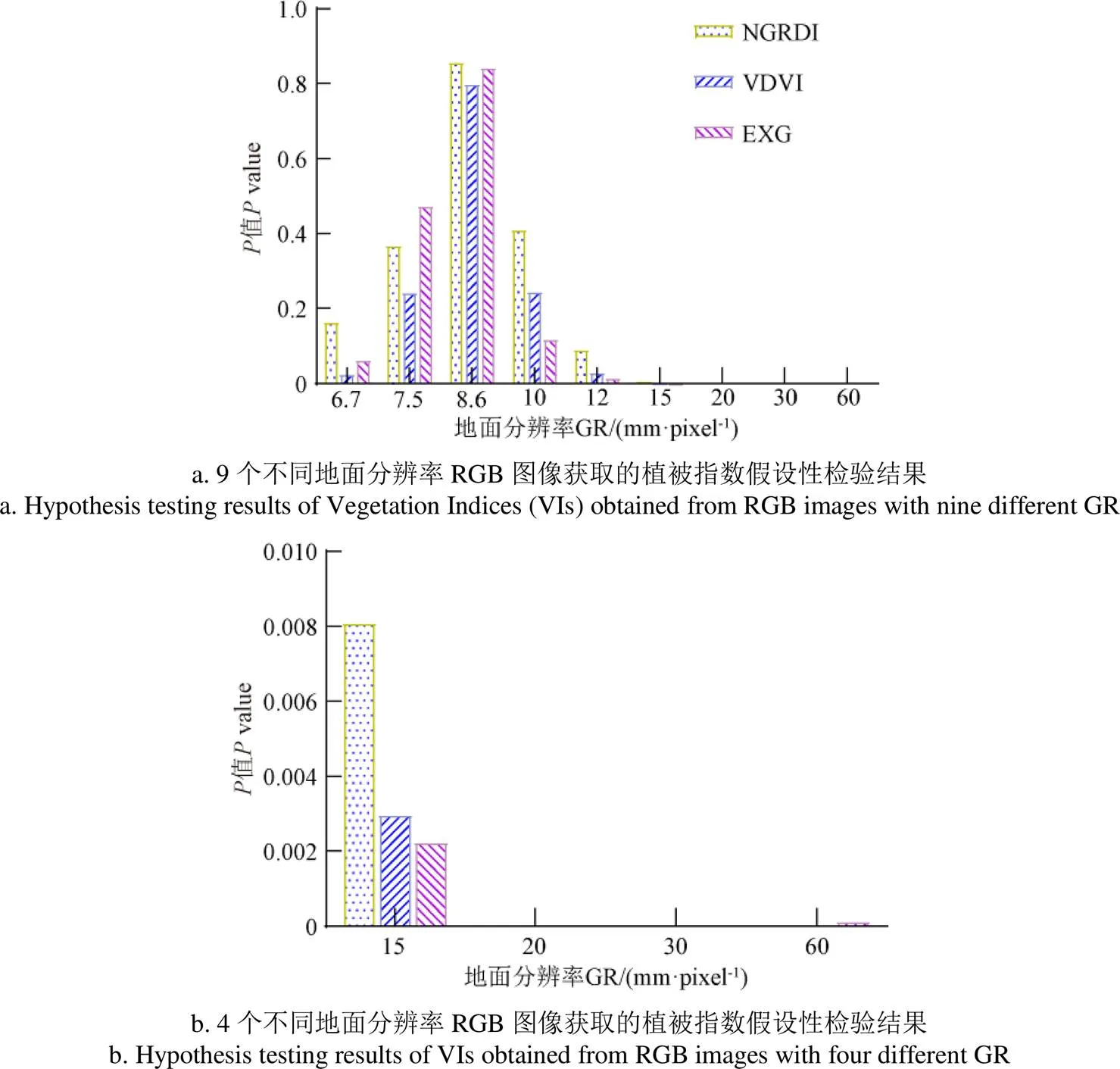

图9 不同地面分辨率RGB图像获取的植被指数假设性检验结果

当地面分辨率为10 mm/pixel时(即飞行高度约42 m)3种植被指数的值均大于0.05((NGRDI)=0.41,(VDVI)=0.24,(EXG)=0.12),即该飞行高度可见光相机获取的作物信息与25 m飞行高度相比没有差异。当地面分辨率为12 mm/pixel时(即飞行高度约50 m)(NGRDI)=0.09,(VDVI)=0.03,(EXG)=0.02,说明部分植被指数计算结果有差异(VDVI和EXG)。当地面分辨率为15 mm/pixel时(即飞行高度约61 m)3种植被指数的值均小于0.01((NGRDI)=0.008,(VDVI)=0.003,(EXG)=0.002),且后3个水平趋近于0,说明当飞行高度大于等于61 m时该可见光相机获取的作物信息与25 m飞行高度相比具有显著性差异。因此,当无人机搭载该可见光相机进行试验时,为准确的获取3种植被指数,建议飞行高度不高于61m,最佳飞行高度为42 m左右。若只需要获取准确的NGRDI,则建议飞行高度为50 m左右。

3.3.2 多光谱图像

无人机搭载的多光谱相机获取的图像波段范围为600~875 nm,将飞行高度25 m时的多光谱图像根据最近邻插值法退化成10个不同水平地面分辨率(43、48、55、62、72、86、107、145、215和430 mm/pixel)图像,根据光谱反射率计算式(2)计算得出整个小区的光谱反射率,取平均得到该小区的平均反射率光谱曲线,将不同地面分辨率水平下的得到的平均反射率光谱与参考图像下的平均反射率光谱作一元线性回归,结果发现决定系数以及均方根误差受高度影响几乎可以忽略不计(表 3)。这可能是由于多光谱相机的分辨率较可见光相机低很多,在飞行高度25 m时获取的多光谱图像可能已经出现了一定程度的作物和背景信息融合的现象,又由于实验对象为大尺度的小区冠层的平均反射率光谱,所以在飞行高度的逐步增加的前期阶段变化并不明显,但是当飞行高度大于一定高度时(即地面分辨率为430 mm/pixel),由于图像退化程度过高,图像混元现象严重,会使得获取的作物光谱信息发生明显变化(图10)。

表3 不同地面分辨率下的平均反射率光谱的线性拟合结果

图10 单小区不同地面分辨率平均反射率光谱

将不同地面分辨率图像根据公式分别计算归一化植被指数NDVI和比值短波红外指数RSI,并将低地面分辨率图像与参考图像获取的两种指数分别作假设性检验,结果如图11所示,研究发现在本研究选择的10个水平中值均大于0.5,即2个样本不具备显著性差异。由此可知,飞行高度在25 m及以上9个飞行高度时该多光谱相机获取的平均反射率光谱与植被指数差异不大。因此在无人机飞行高度的选择上可以根据搭载的可见光相机来确定最终参数,尽可能的提高作业效率降低作业成本。在前9个水平多光谱相机获取的植被指数无明显差异的原因可能是由于多光谱相机与可见光相机相比空间分辨率较低,且使用无人机搭载该相机需要减少风场对作物的扰动作用,需要保持一定的飞行高度而不能完全贴近作物,而25 m的飞行高度可能在一定程度上已超出多光谱相机获取最精准信息的临界值,有待后续研究验证。

图11 不同地面分辨率多光谱图像获取的植被指数假设性检验结果

3.4 飞行策略

基于本研究中无人机搭载的多光谱和可见光相机获取的作物图像,通过对作物表型参数中的重要指标植被覆盖度和植被指数进行计算分析,结果发现植被覆盖度估算结果会随着飞行高度的增加会呈现趋势性变化,当植被覆盖度小于0.5时随着飞行高度增加会不断被低估,反之被高估。这是由于植被覆盖度的估算精准度直接受到图像地面分辨率的影响,无人机飞行高度越高,图像地面分辨率越低,估算结果误差越大。同时结果发现由光谱反射率计算得出的植被指数在一定飞行高度内不会产生显著性差异,除非当飞行高度过高、图像混元效应过于严重时才会出现显著变化。因此,当无人机作业时,若提高飞行高度必将损失一定的植被覆盖度估算精度,但可以保证一定程度的光谱信息的准确性,综合考虑获取的作物光谱、空间信息以及无人机作业效率和成本,研究者可以根据实验目的选择合适的飞行高度。本研究中搭载的两款机载设备的试验结果表明多光谱相机信息获取的最优高度不可高于120 m,即地面分辨率为215 mm/pixel时,可见光相机信息获取的最优高度为42 m,即地面分辨率为10 mm/pixel时。综上,在42 m的高度下可以更好的发挥多光谱相机和可见光相机的数据采集优势。

4 总结与展望

无人机遥感平台通常用于在大田条件下的作物生长动态监控,同时也为作物随生长季节产生的发育状态提供一个实时的监测方法。利用无人机遥感平台搭载多种传感器获取高分辨率田间作物图像并结合数字图像处理技术提取作物表型信息和表型数据分析方法,能够为田间作物无损监测与表型评估提供有效的解决方案。进一步的,无人机作业平台通过搭载不同的传感器来实现田间作物全面生长信息监测,一般飞行高度为10~100 m不等。根据选择不同的传感设备类型获取的地面分辨率1~100 mm/pixel不等,同一传感设备获取更高的地面分辨率的图像则需要更低的飞行高度,更大的作业量和更高的作业成本。若同时搭载不同的传感器,无人机飞行参数设置则需加入设备参数各有不同如何协同合作的考量。因此为平衡无人机飞行成本和获取高地面分辨率图像的同时充分发挥各传感设备获取作物信息的能力、优化飞行参数(高度)具有必要性和重要意义。

在本研究中,通过无人机平台搭载不同的传感器(多光谱相机,索尼NEX-7相机)获取两种飞行高度的油菜冠层图像,分别为25 和50 m。利用可见光相机捕获高分辨率图像。再将在25 m处获得的图像作为参照图像,依次将该图像退化成-系列具有不同地面分辨率大小水平的图像,以模拟基于UAV的平台在不同飞行高度处采集的图像。利用基于随机森林算法对多类无人机遥感图像进行分类,计算各图像的植被覆盖度。将可见光相机在25 m处捕获的高分辨率图像的植被覆盖度作为参照植被覆盖度,以评估无人机不同飞行高度对植被覆盖度计算精度的影响。结果发现植被覆盖度会随着地面分辨率的变化而变化,且当参照植被覆盖度高于0.5时,随着飞行高度的增加FVC逐渐偏向于1,易被高估;当植被覆盖度低于0.5时,随着飞行高度的增加植被覆盖度FVC逐渐偏向于0,易被低估。并将飞行高度50 m的真实图像与模拟图像得到的植被覆盖度作皮尔逊相关性分析,相关系数为0.992 8,验证了模拟图像与真实图像具有一致性。同时针对可见光相机分析了不同地面分辨率对于NGRDI、VDVI和EXG的影响,结果表明当飞行高度不低于61 m时可见光植被指数发生显著性差异(<0.05),飞行高度42 m时没有显著性差异(>0.1)。针对多光谱植被指数分析了不同地面分辨率对于NDVI、RSI的影响,发现两类指数在飞行高度42 和61 m时均没有显著性差异,因此当无人机搭载该两种型号的成像设备高效全面的获取作物农情信息时为保证信息的准确性可设定飞行高度为42 m。

综上本研究无人机飞行高度参数设定在不要求极高植被覆盖度的情况下可以根据可见光相机在植被指数中的表现选择。本研究仅针对少类作物表型参数指标探究其与不同地面分辨率的变化关系,具有一定局限性。后期可以利用基于无人机近感的田间作物表型平台在不同飞行高度上获取实拍图像,进一步探索飞行高度对作物表型参数的影响,为设置最优飞行高度提供参考。

[1] Wan L, Cen H, Zhu J, et al. Grain yield prediction of rice using multi-temporal UAV-based RGB and multispectral images and model transfer: A case study of small farmlands in the South of China[J]. Agriculture and Forest Meteorology, 2020, 291: 1-15.

[2] Ahmed O S, Shemrock A, Chabot D, et al. Hierarchical land cover and vegetation classification using multispectral data acquired from an unmanned aerial vehicle[J]. International Journal of Remote Sensing, 2017, 38(8/9/10): 2037-2052.

[3] Iersel W V, Straatsma M, Addink E, et al. Monitoring height and greenness of non-woody floodplain vegetation with UAV time series[J]. Remote Sensing, 2018, 141: 112-123.

[4] Hu P, Chapman S C, Wang X, et al. Estimation of plant height using a high throughput phenotyping platform based on unmanned aerial vehicle and self-calibration: Example for sorghum breeding[J]. European Journal of Agronomy, 2018, 95: 24-32.

[5] 宋磊,李嵘,焦义涛,等. 基于ResNeXt单目深度估计的幼苗植株高度测量方法[J]. 农业工程学报,2022,38(3):155-163.

Song Lei, Li Rong, Jiao Yitao, et al. Method for measuring seedling height based on ResNeXt monocular depth estimation[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(3): 155-163. (in Chinese with English abstract)

[6] Wang Z, Skidmore A K, Darvishzadeh R, et al. Mapping forest canopy nitrogen content by inversion of coupled leaf-canopy radiative transfer models from airborne hyperspectral imagery[J]. Agricultural and Forest Meteorology, 2018, 253: 247-260.

[7] 王玉娜,李粉玲,王伟东,等. 基于无人机高光谱的冬小麦氮素营养监测[J]. 农业工程学报,2020,36(22):31-39.

Wang Yuna, Li Fenling, Wang Weidong, et al. Monitoring of winter wheat nitrogen nutrition based on UAV hyperspectral images[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(22): 31-39. (in Chinese with English abstract)

[8] Jay S, Baret F, Dutartre D, et al. Exploiting the centimeter resolution of UAV multispectral imagery to improve remote-sensing estimates of canopy structure and biochemistry in sugar beet crops[J]. Remote Sensing of Environment, 2019, 231: 1-17.

[9] Cen H, Wan L, Zhu J, et al. Dynamic monitoring of biomass of rice under different nitrogen treatments using a lightweight UAV with dual image-frame snapshot cameras[J]. Plant Methods, 2019, 15: 1-16.

[10] 刘建刚,赵春江,杨贵军,等. 无人机遥感解析田间作物表型信息研究进展[J]. 农业工程学报,2016,32(24):98-106.

Liu Jiangang, Zhao Chunjiang, Yang Guijun, et al. Review of field-based phenotyping by unmanned aerial vehicle remote sensing platform[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2016, 32(24): 98-106. (in Chinese with English abstract)

[11] Wan L, Li Y, Cen H, et al. Combining UAV-based vegetation indices and image classification to estimate flower number in oilseed rape[J]. Remote Sensing, 2018, 10: 1-18.

[12] Kefauver S C, Vicente R, Vergara-Díaz O, et al. Comparative UAV and field phenotyping to assess yield and nitrogen use efficiency in hybrid and conventional barley[J]. Frontiers in Plant Science, 2017, 8: 1-15.

[13] Jin X, Liu S, Baret F, et al. Estimates of plant density of wheat crops at emergence from very low altitude UAV imagery[J]. Remote Sensing of Environment, 2017, 198: 105-114.

[14] Hunt E R, Horneck D A, Spinelli C B, et al. Monitoring nitrogen status of potatoes using small unmanned aerial vehicles[J]. Precision Agriculture, 2018, 19: 314-333.

[15] Kipp S, Mistele B, Baresel P, et al. High-throughput phenotyping early plant vigour of winter wheat[J]. European Journal of Agronomy, 2014, 52(B): 271-278.

[16] Walter A, Liebisch F, Hund A. Plant phenotyping: from bean weighing to image analysis[J]. Plant Methods, 2015, 11: 1-11.

[17] Xie M, Wang Z, Huete A, et al. Estimating peanut leaf chlorophyll content with dorsiventral leaf adjusted indices: Minimizing the impact of spectral differences between adaxial and abaxial leaf surfaces[J]. Remote Sensing, 2019, 11: 1-15

[18] Yi Q, Wang F, Bao A, et al. Leaf and canopy water content estimation in cotton using hyperspectral indices and radiative transfer models[J]. International Journal of Applied Earth Observation and Geoinformation, 2014, 33: 67-75.

[19] Lin G A, Xwa B, Baj C, et al. Remote sensing algorithms for estimation of fractional vegetation cover using pure vegetation index values: A review[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2020, 159: 364-377.

[20] Zhou X, Zheng H B, Xu X Q, et al. Predicting grain yield in rice using multi-temporal vegetation indices from UAV-based multispectral and digital imagery[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2017, 130: 246-255.

[21] Yao H, Qin R, Chen X. Unmanned aerial vehicle for remote sensing applications-a review[J]. Remote Sensing, 2019, 11:1-22.

[22] Mariana B, Lucian D. Random forest in remote sensing: A review of applications and future directions[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2016, 114: 24-31.

[23] Wei G, Zheng B, Tao D, et al. EasyPCC: Benchmark datasets and tools for high-throughput measurement of the plant canopy coverage ratio under field conditions[J]. Sensors, 2017, 17(4): 1-13.

[24] Inoue Y, Guerif M, Baret F, et al. Simple and robust methods for remote sensing of canopy chlorophyll content: A comparative analysis of hyperspectral data for different types of vegetation[J]. Plant Cell and Environment, 2016, 39(12): 2609-2623.

[25] Huang S, Tang L, Hupy J P, et al. A commentary review on the use of normalized difference vegetation index (NDVI) in the era of popular remote sensing[J]. Journal of Forestry Research, 2021, 32: 1-6.

[26] 刘峻明,周舟,和晓彤,等. 频率直方图与植被指数结合的冬小麦遥感产量估测[J]. 农业工程学报,2021,37(23):145-152.

Liu Junming, Zhou Zhou, He Xiaotong, et al. Estimating winter wheat yield under frequency histogram and vegetation index using remote sensing[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(23): 145-152. (in Chinese with English abstract)

[27] 于丰华,邢思敏,郭忠辉,等. 基于特征转移植被指数的水稻叶片氮素含量定量估算[J]. 农业工程学报,2022,38(2):175-182.

Yu Fenghua, Xing Simin, Guo Zhonghui, et al. Remote sensing inversion of the nitrogen content in rice leaves using character transfer vegetation index[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(2): 175-182. (in Chinese with English abstract)

[28] Rebetzke G J, Jimenez-Berni J A, Bovill W D, et al. High-throughput phenotyping technologies allow accurate selection of stay-green[J]. Journal of Experimental Botany, 2016, 67(17): 4919-4924.

[29] Gitelson A A. Wide dynamic range vegetation index for remote quantification of biophysical characteristics of vegetation[J]. Journal of Plant Physiology, 2004, 161(2): 165-173.

[30] Das B, Sahoo R N, Pargal S, et al. Quantitative monitoring of sucrose, reducing sugar and total sugar dynamics for phenotyping of water-deficit stress tolerance in rice through spectroscopy and chemometrics[J]. Spectrochimica Acta Part A Molecular and Biomolecular Spectroscopy, 2018, 192: 41-51.

[31] Varela S, Pederson T, Bernacchi C J, et al. Understanding growth dynamics and yield prediction of sorghum using high temporal resolution uav imagery time series and machine learning [J]. Remote Sensing, 2021, 13:1- 17.

[32] Zhang J, Qiu X, Wu Y, et al. Combining texture, color, and vegetation indices from fixed-wing UAS imagery to estimate wheat growth parameters using multivariate regression methods[J]. Computers and Electronics in Agriculture, 2021, 185: 106-138.

[33] Louhaichi M, Borman M M, Johnson D E. Spatially located platform and aerial photography for documentation of grazing impacts on wheat[J]. Geocarto International, 2001, 16: 65-70.

[34] Gitelson A A, Kaufman Y J, Stark R, et al. Novel algorithms for remote estimation of vegetation fraction[J]. Remote Sensing of Environment, 2002, 80: 76-87.

[35] Zhang L, Niu Y, Zhang H, et al. Maize canopy temperature extracted from UAV thermal and RGB imagery and its application in water stress monitoring[J]. Frontiers in Plant Science, 2019, 10: 1-18.

[36] Hu P C, Guo W, Scott C, et al. Pixel size of aerial imagery constrains the applications of unmanned aerial vehicle in crop breeding[J]. Journal of Photogrammetry and Remote Sensing, 2019, 154: 1-9.

Effects of UAV flight height on estimated fractional vegetation cover and vegetation index

He Yong1,2, Du Xiaoyue1,2, Zheng Liyuan1,2, Zhu Jiangpeng1,2, Cen Haiyan1,2, Xu Lijia3

(1.,,310058,; 2.,,310058,; 3.,,625014,)

Accurate acquisition of crop information is very important for the real-time monitoring of crop growth status in crop breeding and agricultural precision management. The ever-increasing remote sensing (RS) and Unmanned Aerial vehicles (UAV) have been widely used to collect the big phenotypic data (especially image data) of various plants in a large area. Specific sensing devices are often used to obtain accurate and comprehensive information on crop growth. However, the diversity of sensing devices can bring a great challenge to the cooperation between them on UAV. It is very urgent to establish UAV flight parameters suitable for the complex field environment. In this study, an effective approach was developed to explore the effects of UAV flight height on the estimated fractional vegetation cover (FVC) and vegetation index (VI). The UAV can ultimately be utilized to collect the phenotypic data within the effective range under the multi-sensor combinations based on suitable flight height. The multispectral and high-resolution RGB cameras were simultaneously mounted on the UAV to acquire the images at a speed of 2.5 m/s. Among them, the heading and the side overlaps were set as 75% and 60%, respectively, particularly for the possibility of successful image stitching. The initial flight heights were set as 25 and 50 m, in order to exclude the wind field generated by the high-speed rotation of the UAV's paddles from disturbing the crop. The high ground resolution (GR) images were collected by the UAV at the low flight height. These images were then degraded by image processing into a series of images with different GR. The simulation was finally carried out to predict the crop images obtained by the UAV at different flight heights. As such, the impact of environmental changes on image quality was reduced, such as the light intensity. The FVC of every sample plot was estimated using Random Forest (RF). The results show that the vegetation classification accuracy was greater than 91%. The regular FVC changes were found in the different GR, due to the image blending phenomenon. Once the FVC was less than half, the indicator was constantly underestimated with the decrease of the GR. Otherwise, the indicator was overestimated. Pearson correlation analysis was also performed on the real and simulated images at a flight height of 50 m, in order to verify the feasibility of simulated images for FVC estimation. The results show that the Pearson correlation coefficient was 0.992 8 between the real and simulated images at a flight height of 50 m, indicating a high correlation. Moreover, a similar regular variation was also found in the FVC that was estimated by the real images. Five VIs (the combination of spectral reflectance) were calculated to enhance vegetation information and weaken non-vegetation one. The hypothesis testing was used to verify whether the vegetation indices had significant differences. The results show that significant differences (<0.05) occurred in the RGB VIs at a ground resolution of 15 mm/pixel (i.e., the flight height of 61 m), whereas no difference (>0.1) was found at 10 mm/pixel (i.e., flight height of 42 m). Meanwhile, the multispectral VIs were not significantly different at both ground resolutions (>0.5). Fortunately, the flight height range within 42 m presented less impact on the acquisition of RGB spectral information. Consequently, a flight height of less than 42 m can be the optimal parameter to collect the crop information using the two devices at the same time. Anyway, the spectral and spatial information using other devices at higher flight heights can also be further investigated in the future. The finding can provide a strong reference for setting the suitable flight height to obtain the crop information, in order to reduce the operating costs using multi-sensor equipment carried by UAVs.

UAV; vegetation index; fractional vegetation cover; flight strategy

10.11975/j.issn.1002-6819.2022.24.007

S24

A

1002-6819(2022)-24-0063-10

何勇,杜晓月,郑力源,等. 无人机飞行高度对植被覆盖度和植被指数估算结果的影响[J]. 农业工程学报,2022,38(24):63-72.doi:10.11975/j.issn.1002-6819.2022.24.007 http://www.tcsae.org

He Yong, Du Xiaoyue, Zheng Liyuan, et al. Effects of UAV flight height on estimated fractional vegetation cover and vegetation index[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(24): 63-72. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2022.24.007 http://www.tcsae.org

2022-09-05

2022-11-11

浙江省重点研发计划项目(021C02023)

何勇,博士,教授,研究方向为事植物-土壤-环境信息感知技术与先进传感器、精细农业与智能传感技术及装备、无人机低空遥感等。Email:yhe@zju.edu.cn