基于人机交互的全景智能化视频目标自动监测方法

李蓉

摘 要:全景智能化视频中存在多种近似的目标干扰项,且在动态活动条件下容易丢失监测目标,影响监测方法对设定目标的抓取效果,针对这一问题以人机交互为基础,设计全新的全景智能化视频目标自动监测方法。该方法以投影变换矩阵为前提,标定与配准摄像机安装节点;利用示性函数判断图像是否为背景图像,根据方向梯度公式排除近似目标干扰项;基于人机交互设置目标模板区域,通过均值偏移过程检测方法追踪监测目标所在位置,并自动恢复丢失目标,实现对全景智能化视频目标的自动监测。结果表明,对照其他3组自动监测方法,基于人机交互的自动监测,从第1帧图像开始匹配目标,抓取概率一直维持在0.9以上,监测效果远优于对照的3组方法。

关键词:人机交互;全景视频;摄像机标定;干扰目标;背景判别;自动监测

中图分类号:TP391 文献标识码:A文章编号:1001-5922(2022)01-0111-05

Automatic monitoring method of panoramic intelligent video target based on human-computer interaction

LI Rong

(Lu′an vocational andTechnical College,Changzhi 046000,Shanxi China)

Abstract:There are many similar target interference items in panoramic intelligent video,and it is easy to lose the monitoring target under the condition of dynamic activity,which affects the grasping effect of the monitoring method on the set target.Aiming at solving this problem,a new panoramic intelligent video target automatic monitoring method was designed based on human-computer interaction.Based on the projection transformation matrix,the camera installation nodes were calibrated and registered;The indication function was used to judge whether the image is a background image,and the approximate target interference term was eliminated according to the directional gradient formula;Set the target template area based on human-computer interaction,tracked the location of the monitoring target through the mean shift process detection method,and automatically recovered the lost target,so as to realize the automatic monitoring of panoramic intelligent video target.The experimental results showed that compared with the other three groups of automatic monitoring methods,the automatic monitoring based on human-computer interaction matched the target from the first frame image,and the capture probability remained above 0.9,while the monitoring effect is much better than the three groups of methods..

Key words:human computer interaction;Panoramic video;camera calibration;jamming target;background discrimination;automatic monitoring

現代社会生活依靠互联网和物联网建立沟通,越来越多的工作在网络及智能技术的支持下正常运转,其中道路交通指挥、电力输送等基本工作,对于网络的依赖程度都很大,在网络的控制下以智能化的方式,完成道路疏通、电力调度等工作,由此在这些工作中,开始出现具有全景功能监测的系统。该系统通过导入全景信息,构建满足日常工作的全景信息模型,根据模型划分不同的监测位置和监测方式,保证各项工作稳定进行[1]。然而,全景智能化视频目标受外界环境因素中大量同属性、不同属性,同类别、不同类别的干扰项影响,自身属性特征不够明显,有时会与这些干扰项之间高度类似,导致系统监测过程中丢失本来设定好的监测目标。为了保证系统的正常工作,提出将人机交互的相关技术应用到自动监测方法当中。现阶段的人机交互技术,是通过人机交互界面与系统直接交流,以并行操作的方式控制系统运行[2]。目前该技术被广泛应用到各项领域,包括人体运动过程中的动作识别、翻转课堂设计、机器人轨迹控制等,这些方法都充分发挥了人机交互技术的特点,为各自工作提供更加精准的控制。此次研究基于人机交互的全景智能化视频目标自动监测方法,利用该方法加强目标监测工作,为今后的目标识别定位研究提供参考。

1 基于人机交互的全景智能化视频目标自动监测方法

1.1 标定与配准摄像机安装位置

全景视频监测需要多台摄像机,这些摄像机分布在分布式网络当中,通过不同的拍摄方向与角度,将大量摄像机数据转变为全景数据。这一工作要求摄像机的标定与配准位置,能够满足全景监测要求。设计一个运行在分布式网络中的交互式远程标定方法,要求该方法能够预先选取待配准图像的局部位置,通过筛选匹配特征点控制匹配误差;还要求该方法能够利用匹配点完成数据筛选与信息配准,通过减少节点计算量,控制计算耗时。此项工作的本质,就是利用一个图像映射关系,将摄像机的拍摄内容匹配到基准视场中,通过缩放、平移、旋转等方法融合处理图像。设置原始图像的随机像素点坐标为a,b;经过上述变换处理后的像素点坐标为a′,b′,则通过下列公式获得原始图像与处理后图像的变换关系:

a′b′1〗=μ11μ12μ13μ21μ22μ23μ31μ32μ33〗ab1〗(1)

式中:μ11μ12μ13μ21μ22μ23μ31μ32μ33〗=A,表示投影变换矩阵,其中μ13μ23〗T和μ31μ32〗T分别用于不同行列数据在a、b坐标上的平移和透视变换。利用矩阵A对不在同一直线上的匹配点进行配对,完成对图像的投影变换[3]。这一过程中,为了解决非整数像素坐标取值困难的问题,采用双线性内插法插值运算图像;假设对图像进行N倍缩放,该图像中的随机像素点坐标不变,推算该坐标在变换处理后的图像中,生成的新坐标为a″,b″,则通过下列公式获得二者之间的关系:

a″=a′·1N

b″=b′·1N(2)

设置浮点坐标为a″+Δa″,b″+Δb″,其中a″、b″表示正整数部分;Δa″和Δb″表示小数部分,则利用双线性内插法插值运算图像时,根据4个相邻点像素值在不同方向上的内插,获得浮点坐标的像素值,即

f(a″+λ,b″+λ)=f(a″,b″)+Δa″+Δb″+

Δa″Δb″(3)

图像缩放后,根据公式(3)获得新图像的每个坐标的像素值。根据上述过程调整摄像机的安装位置,满足摄像机在分布式网络中的全景监测。

1.2 排除目标干扰项

利用摄像机获得图像后,利用人机交互平台自动检测全景智能化视频目标;但大多数视频中会频繁出现汽车、行人等动态目标,这些目标之间具有极强的相似性,当目标运动时,受相似性干扰项的影响,容易丢失监测目标,所以对单帧图像初始化,要按照每一帧的内容分类图像中的各个对象,为排除干扰项提供分类数据。但排除干扰项之前需要判定图像是否为背景图像,设计单帧初始化策略和随机更新策略,根据该策略判断图像帧数,并分析当前图像是否为背景图像,判定公式为

La″,b″=∑ni=1FGia″,b″-Ia″,b″>α〗

(4)

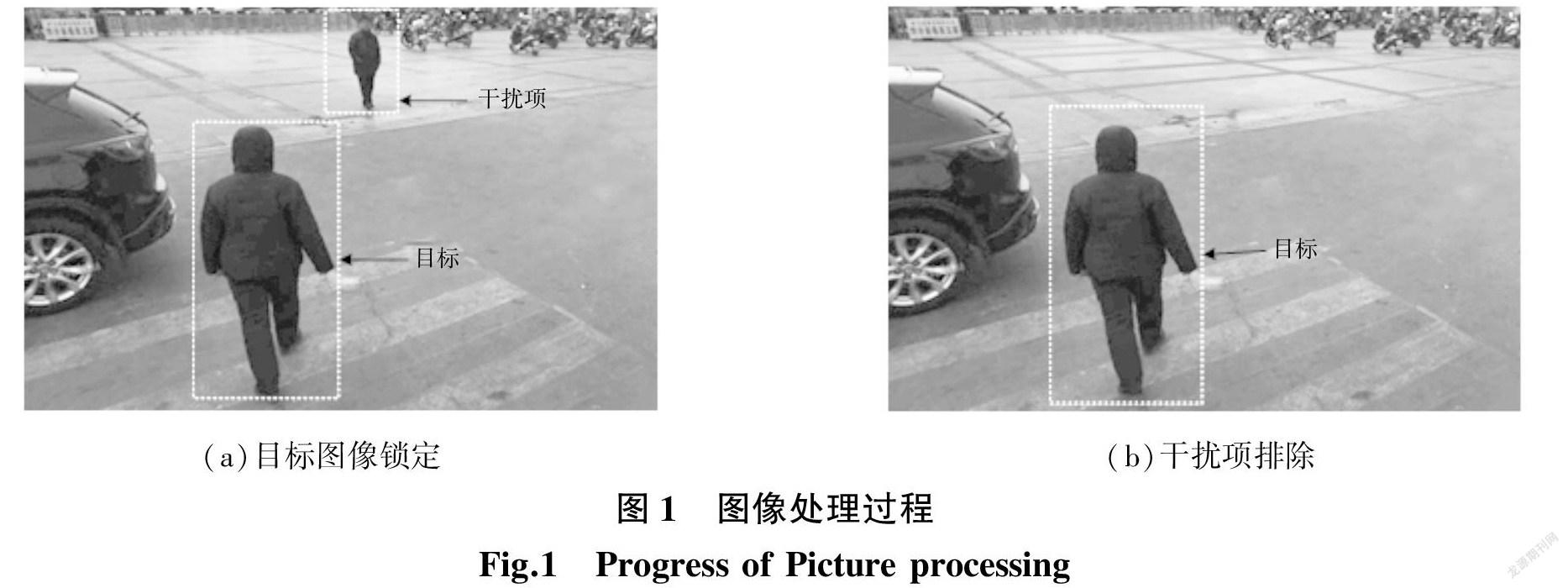

式中:F*表示示性函数;Gi*表示样本集合当中第i个样本的像素值;I*表示输入图像的像素值;α表示判断像素相似性的阈值。当所求结果L的值越大时,越能说明该点为背景的可能性就越大。根据该结果判断全景智能化视频中,每一帧图像是否为背景图像。此次研究将此项结果的标准值设置为10,当L<10时,则该帧图像为背景图像,否则为目标图像。该方法根据判定结果得到目标图像,如图1(a)所示。

根据图1可知,根据公式(4)的评价结果,获得图1(a)存在干扰项的图像。对该干扰项进行排除,这一过程需要考虑方向梯度。已知目标物的边缘轮廓最具有价值,因为监测识别需要通过不同的边缘轮廓,识别目标种类。图像的边缘可以利用不同像素点的梯度进行描述,该值通过下列方程组获得:

Haa″,b″=Ra″+1,b″-Ra″-1,b″Hba″,b″=Ra″,b″+1-Ra″,b″-1Ta″,b″=Haa″,b″2+Hba″,b″2βa″,b″=arctanHba″,b″Haa″,b″(5)

式中:Haa″,b″、Hba″,b″分别表示不同方向的边缘特征值;R*表示像素灰度值;Ta″,b″表示梯度幅值;βa″,b″表示梯度方向[4]。通过公式(5)计算每个像素的梯度,连接得到结果后生成独立的区块,实现对干扰目标的锁定,从而在图1(a)中排除,得到图1(b)的结果,实现对监测目标的精准定位。

1.3 基于人机交互自动恢复丢失目标

在实际监测过程中,尽管区分了背景环境和干扰项,但依旧存在突然丢失监测目标的情况,所以在人机交互的基础上,通过人机交互界面控制Mean Shift跟踪算法的运行,辅助对目标的自动监测。假设目标模板区域的像素位置为a*i,其中i表示位置节点编号。已知核函数为一个单调递减函数,利用该函数设置目标模板区域的像素权值,其中远离模板的像素权值较小,接近模板的像素权值较大。设置a*i处的像素灰度值为ga*i,则目标模板灰度概率的计算结果为

pi=M∑ni=1h‖a*i‖2φga*i-γ〗(6)

式中:M表示归一化常数;h*表示加权函数,也就是提出的核函数;φ*〗表示克罗内克函数,当该函数的结果φ=0时,像素节点不重叠;当该函数的结果为φ=1时,像素节点重叠。由于概率pi的最大极限值为1,那么根据公式(6)可導出归一化常数M,得到

M=1∑ni=1h‖a*i‖2(7)

根据公式(6)和公式(7),可得到人机交互控制数据,根据该数据比较目标模板和候选目标之间的相似性,该比较过程如下:

s′z=∑mi=1piz,pisz=1-s′z(8)

式中:s′z是描述模板与候选目标之间关系的Bhattacharyya系数。在被检测帧中定位目标,需要从前一帧的目标模板位置开始,将模板与目标进行比较,而不是默认初始图像为背景。因为一些目标可能运动到区域的边缘处,所以对监测的前10~20帧图像不进行目标匹配,导致这种默认存在极大的误差,影响最终的监测结果。所以人机交互过程中,考虑摄像机的拍摄位置,试试调整Bhattacharyya系数,根据目标模板和候选目标之间的线性近似,衡量目标的变形程度。操作过程中当变形结果超出数据标准时,利用均值偏移过程检测方法,计算新的目标位置,公式为

z=∑nki=1a″iuiqz′-a″L2∑nki=1uiqz′-a″L2(9)

式中:z′表示丢失前的目标位置;z表示自动恢复后获得的目标位置;ui表示权重;L表示丢失偏移量;q*表示追踪函数[5]。在上述过程的基础上,实现对丢失目标的自动恢复,至此完成基于人机交互的全景智能化视频目标自动监测。

2 应用测试

2.1 测试平台

为验证此次研究的自动监测方法具有更好的应用效果,利用高清全景视频采集与处理系统硬件平台进行应用测试,如图2所示。对图2中的平台进行12 V外部供电,设置全景镜头的环视角度为360°,在一个实验室内采集全景视频图像,并将采集结果通过VGA接口上传到显示屏。设置硬件平台的采集分辨率分别为2 592×1 944、1 922×1 080以及1 280×720。经过3组条件测试,得到的视频目标最高帧频分别为15、30和60帖。将该结果与OV5640手册中的参数数据进行对比,得到的结果与手册中的数据完全一致,表明该硬件平台可以正常应用。

平台的软件采用Visual Studio 2017+Kinect V2.0+ OpenCV3.1.0软件,采集全景智能化视频中的运动目标,从而实现智能化监测任务。由于光照会影响图像数据的获取,得到的结果存在一定程度的误差,更加接近实际监测环境,所以在本次测试当中,需要体验者完全暴露在设备的视场感应范围之内。为了降低图像运算过程中产生的内存开销,每次测试只提取一次目标位置的所在方位。按照如图3所示的过程,要求体验者按照1、2、3的顺序依次抓取并放回图3中的3组物品,利用搭建的平台执行自动监测任务。

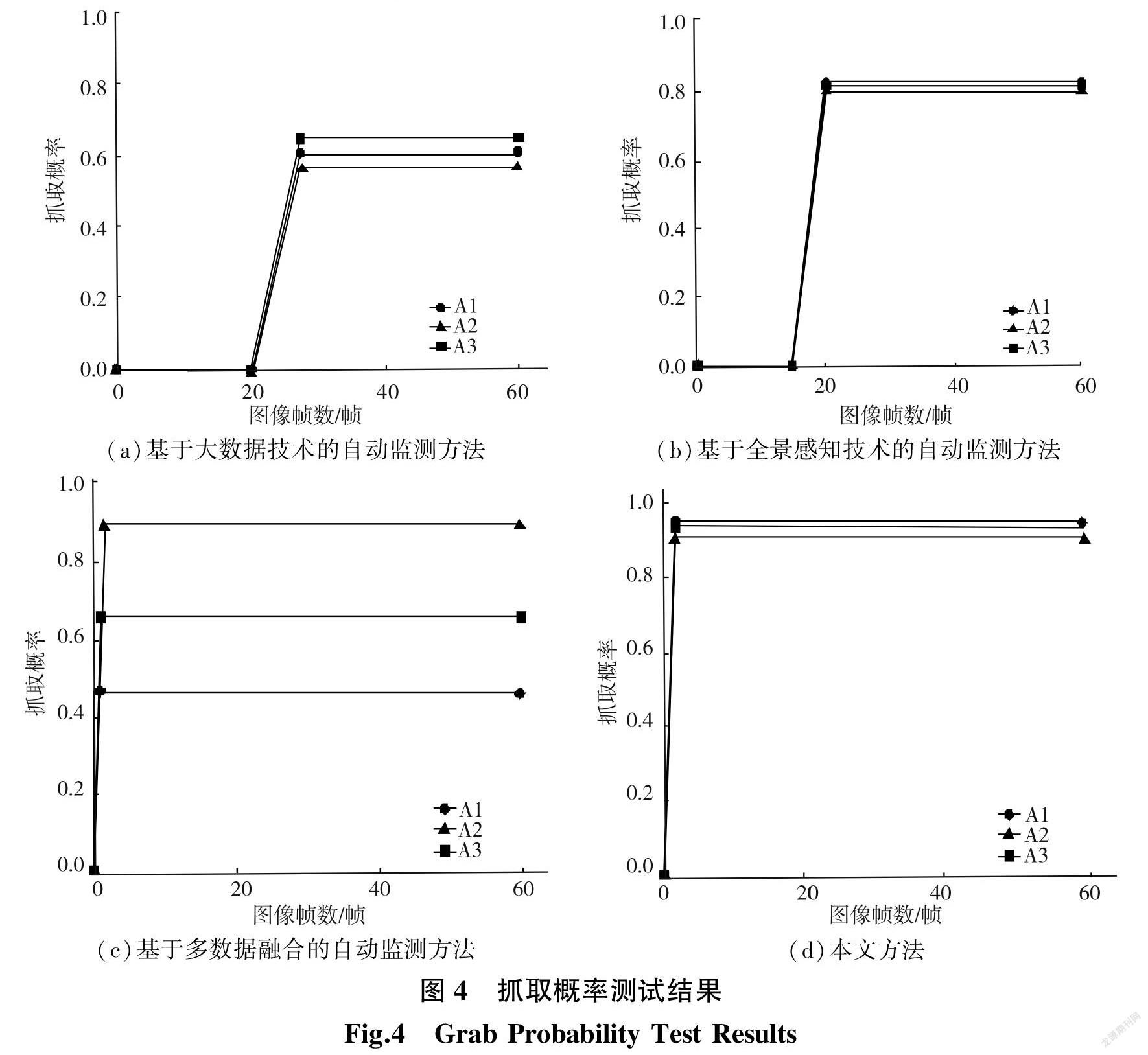

此次测试为了增强测试结果的说服性,将本文提出的自动监测方法,与3种传统自动监测方法进行比较,3组传统方法分别为基于大数据技术的监测方法、基于全景感知技术的自动监测方法、基于多数据融合的自动监测方法。利用4组方法监测体验者在抓取A1、A2、A3目标时,手部与3个物品之间的接触情况,根据监测结果统计不同方法的目标抓取概率。

2.2 目标抓取率测试

将4组方法依次与搭建的实验平台之间建立有效连接,在保证同样的测试条件下,获得4组方法的全景智能化视频目标抓取概率,图4为此次测试得到的目标抓取概率统计结果。

根据图4显示的测试结果可知,图4(a)基于大数据技术的自动监测方法,默认前20帧图像为背景图像,且对于目标图像的抓取,处于一个较小的概率。当图像帧数超过27时,目标抓取概率才有所增加,但最大值不超过0.7。图4(b)基于全景感知技术的自动监测方法面临同样的问题,但该方法只是默认前15帧图像为背景图像,总体抓取概率也接近0.8,说明该方法的全景感知技术起到了一定感知作用,但对监测结果还是有一定程度的影响。图4(c)基于多数据融合的自动监测方法,没有默认初始图像为背景图像,但其抓取概率忽上忽下,该方法的多数据融合并不稳定,难以信任该方法的监测结果。图4(d)本文方法发挥了人机交互的实时控制优势,并没有默认初始图像为背景图像,而是从第1帧图像开始,就进行目标匹配,同时抓取概率均超过了0.9,说明该方法在排除干扰项的前提下,有更好的监测效果。

3 结语

此次研究将目标干扰问题、目标丢失问题作为研究重点內容,充分发挥人机交互技术的精准控制特点,通过全新的图像处理方法,监测全景智能化视频目标,为今后监测系统的目标监控与测算工作,提供了更好的技术支持。但此次研究还存在两点不足之处,首先就是该方法的计算较为复杂,可能最终会影响监测耗时,这一点需要验证;其次是该方法针对目标干扰和目标丢失提出的,但固定区域中的目标可以是动态变化的,一旦目标消失在识别区域内,关于对不完整目标的识别定位还有待研究。在今后的研究工作中,需要测试该监测方法的使用耗时情况,并对不完整目标的识别定位方法进行详细介绍,通过轮廓特征提取与缺失数据补充工作,进一步优化对全景视频目标的自动监测。

【参考文献】

[1]艾精文,党晓婧,吕启深,等.基于物联网的具有全景功能的全维度设备状态监测系统研究[J].电力系统保护与控制,2019,47(16):122-128.

[2] 李森,谢翔,李国林,等.一种基于颜色结构光的投影仪摄像头触摸板人机交互系统[J].微电子学与计算机,2019,36(1):61-65.

[3] 晏晖,胡丙华.基于空间拓扑关系的目标自动跟踪与位姿测量技术[J].中国测试,2019,45(4):9-15.

[4] 黄微,任卫红,朱琳琳,等.基于形状上下文和方向梯度直方图特征的异源图像配准[J].信息与控制,2019,48(2):149-155.

[5] 徐秋平.基于人机交互式图割的目标快速提取[J].计算机工程与科学,2020,42(2):299-306.