基于改进U型神经网络的脑出血CT图像分割

胡 敏 周秀东 黄宏程*② 张光华 陶 洋②

①(重庆邮电大学通信与信息工程学院 重庆 400065)

②(重庆市通信软件工程技术研究中心 重庆 400065)

③(太原学院计算机科学与工程系 太原 030000)

1 引言

脑出血是指原发性脑实质出血,又称为脑血肿,占急性脑血管病的20%~30%,急性期病死率为30%~40%,在急性脑血管病中病死率最高[1]。通过磁共振(Magnetic Resonance Imaging,MRI)、计算机断层扫描(Computed-Tomography,CT)等医疗影像技术得到的器官解剖图能够客观地反映病患的病理变化情况。临床上,医生根据患者的脑部CT图像来分析是否有脑出血疾病,脑出血在CT影像上表现为高密度,而正常的脑部软组织在CT图像上表现为低密度。医生需要根据每张CT图像上表现出来的脑出血区域结合自己的经验来判定出血量等相关指标。运用图像分割技术对每张脑出血CT图像进行目标区域的分割,计算出目标区域所占面积大小,结合CT层间距以及含有脑出血部位的CT图像数,就可以计算出脑出血量占据的体积,从而更好地为手术做准备,具有较高的临床应用价值。

许多学者对脑出血图像分割进行了研究。文献[2]提出利用模糊聚类和阈值法,对脑出血图像进行粗分割,并进行3维重建,接着对重建后的图像进行超体素分割。文献[3]提出一种基于Otsu鸡群优化的局部递归分割方法,找到最佳的分割阈值,应用于脑出血CT图像分割。文献[4]提出一种结合模糊C-均值聚类与基于区域主动轮廓模型的医学影像分割算法。文献[5]提出一种基于距离正则化水平集的自动脑出血区域分割算法,从检测到的出血区域提取纹理特征,并提出基于加权灰度直方图的特征选择算法来选择最优特征用于分割。这些方法在一定的条件下具有较好的效果,但也存在不少局限。比如基于阈值的分割方法,并不能保证每次都是最好的分割阈值。基于模糊聚类的方法存在聚类中心的选取问题,如果选取的聚类中心不佳,会影响最终的分割效果。此外,以上方法调参的过程较为复杂,不利于实际的应用。

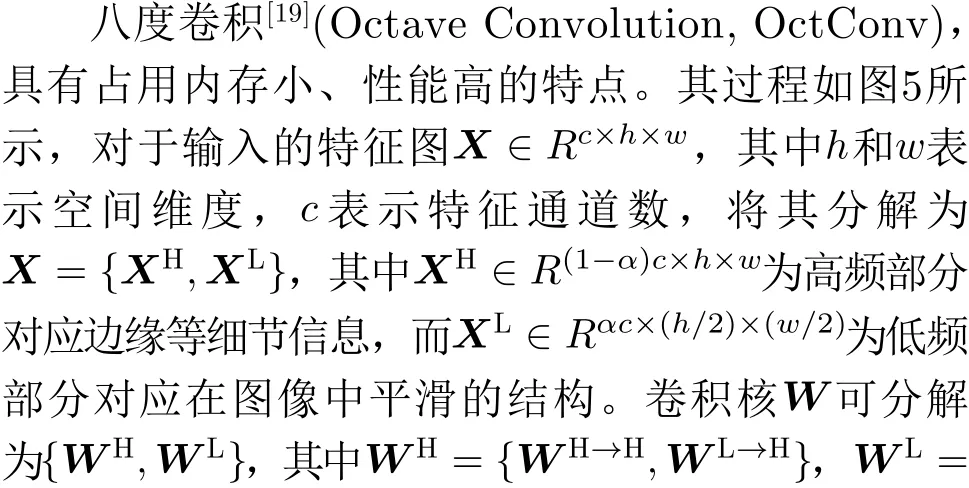

虽然上述研究成果在一些公共的数据集上有着较好的分割效果,但是应用于脑出血CT图像分割时存在局限性。人脑由于其结构的复杂性,脑出血区域在CT图像上像素特征与颅骨部位的像素特征极为相似,在分割的时候,颅骨部位的像素会对病灶区域产生干扰。此外,脑出血病灶在CT影像上存在出血位置和尺度的多变性,导致目标区域在样本上分布不均衡,在神经网络训练阶段不利于提取图像特征,从而影响分割效果。为解决此问题,本文基于编码-解码结构,提出残差八度卷积模块(Residual Octave Convolution, ROC)并将文献[18]中的混合注意力机制迁移至医学图像,设计出新的图像分割模型,用于脑出血CT图像分割;并改进了基于Dice系数的损失函数,使得模型在多尺度目标情况下特征提取时,加强困难样本的特征学习。

2 本文方法

由上述分析可知,基于CNN的相关方法有更高效的计算效率,但是针对具体的医学图像分割任务,不同的网络有其优势。由于脑部CT图像的复杂性,本文认为将U-Net网络直接用于脑出血CT图像分割存在以下两方面的局限性:

(1) U-Net中的跳跃连接使用的是长连接,这会导致网络模型在前期的低层语义中学习到的特征与高层语义中学习到的特征进行融合的时候,存在语义鸿沟问题,导致分割的精度不高。

(2) 当CT图像中存在多尺度目标且干扰信息较多的时候分割效果不佳,即数据集中目标区域的多尺度性导致特征不容易被学习。

2.1 AU-Net+网络分割模型

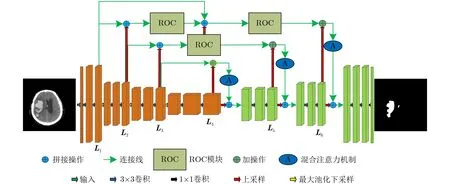

针对U-Net网络中存在的两方面的局限性,本文设计出如图1所示的分割网络,称为AU-Net+(Attention U-Net plus),该网络包含3个部分:编码器、跳跃连接和解码器。

图1 AU-Net+网络框架

AU-Net+的网络结构如表1所示,具体地,在编码器端,采用4组卷积层对图像进行卷积操作,用于提取图像的深层和浅层特征。每组卷积层包含两次卷积运算、批标准化(Batch Normalization,BN)、ReLU激活函数。并且在前3组卷积中每组卷积完成后,对特征矩阵图L1,L2,L3进行下采样。在跳跃连接部分,将特征图L2,L3进行上采样后分别与L1,L2进行拼接操作,并输入到由ROC模块组成的长短连接结构中。将L4,L5,L6分两路进行上采样操作,其中一路用于与ROC模块输出的特征图进行加操作,并随后输入到混合注意力机制中;另一路上采样得到的特征图与混合注意力机制输出的特征图进行拼接用于解码器端。在解码器端,与编码器端类似,均进行两次卷积运算,BN,ReLU激活函数。最后一层通过sigmoid函数将预测的特征图分为前景和背景两类。

当vcosφ0≥uf0时,存在一个临界角度φc,使得vn= vcosφc=uf0;当vcosφ0

表1 AU-Net+网络结构

其中,UConv2D表示进行2次3×3的卷积;EConv2D表示进行1次1×1的卷积;MaxPooling 2D为2×2的最大池化下采样;Conv2DTrans为2×2的转置卷积用于恢复特征图的尺寸;Concatenate,Add分别表示特征图的堆叠、相加操作;Roc和Attention表示将特征图输入到ROC模块、混合注意力机制模块。

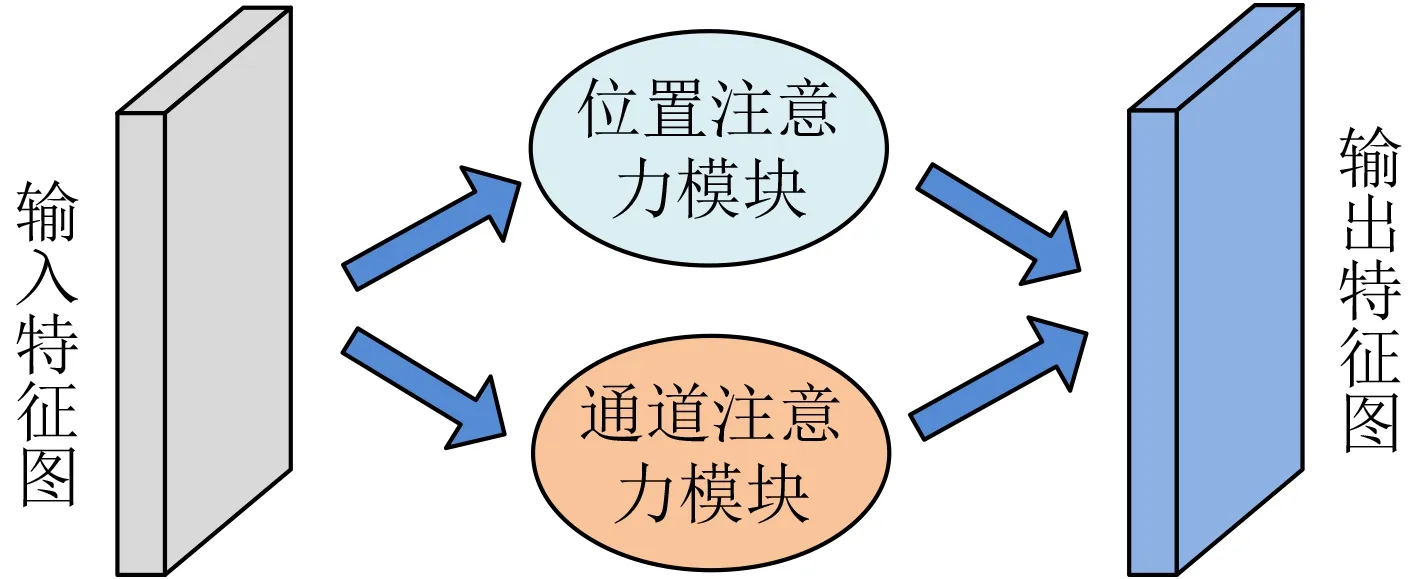

2.2 混合注意力机制

在图像分割中,注意力机制可以使得模型更加专注目标区域的特征学习。一般情况下,注意力机制可分为位置注意力机制、通道注意力机制以及混合注意力机制。位置注意力机制关注的是一张输入的特征图感兴趣位置处的特征信息。通道注意力机制是对不同的特征通道的关注程度。本文使用的混合注意力机制,将两者进行融合,表征了位置和通道两方面的特征信息,如图2所示。

图2 混合注意力机制

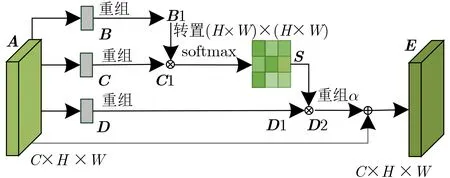

图3 位置注意力机制

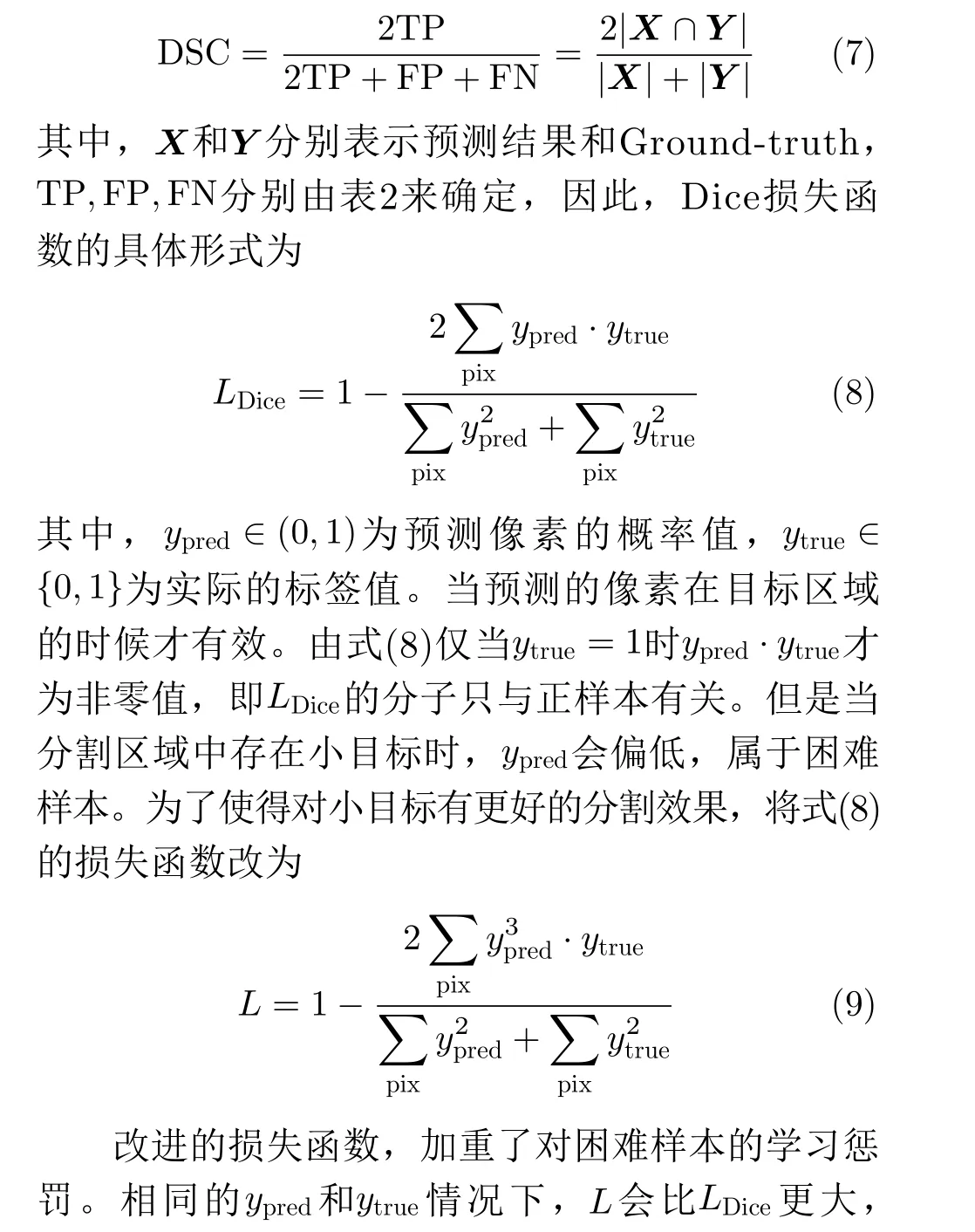

2.3 ROC模块

残差学习[12]的思想是假设神经网络的输入是X,要拟合的输出为H(X),如果把要拟合的输出设置为H(X)=F(X)+X,则拟合效果好,即网络学习的是残差,在网络复杂的情况下可以使得网络进行优化,避免梯度消失的现象。

图4 通道注意力机制

图5 八度卷积计算过程

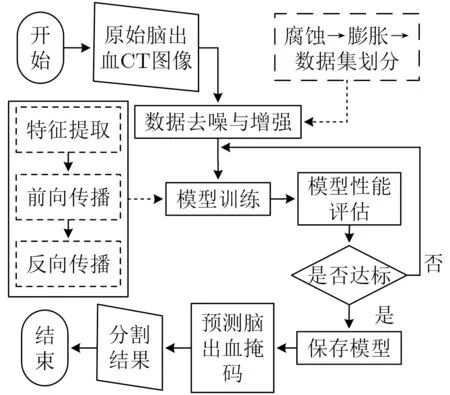

2.4 损失函数

在网络模型进行训练的时候,需要最小化损失函数来使得模型趋于收敛。Dice损失函数在2016年的V-Net[10]中首次被提出,它是一种基于Dice系数的损失函数。Dice系数可以衡量两个样本之间的重叠程度,其表达式为

图6 残差八度卷积模块(ROC)

表2 分类结果的混淆矩阵

3 实验结果

本文的实验数据由脑科医院提供,一共包含100例患者的脑部CT图像,其中每一例患者拍摄有240张脑部位CT图像。CT图像采集设备球管电压为120.00 kV,相邻两张CT层厚为1.25 mm,图像分辨率为512×512。由3位在脑出血研究领域的专业医生对每张CT图像上的出血部位的分割边缘进行人工勾勒并进行数据标注和一致性校验(Ground-truth)。

本文所采用的实验环境:P y t h o n 3.6,Keras2.2.0, Windows10, NVIDIA 4x GeForce RTX 2080Ti GPU,处理器Intel(R) Core(TM)i7-9800x CPU @ 3.80 GHz 3.79 GHz。

从原始数据集中筛选出9600组CT图像,去除了不包含有脑出血部位的CT图像,每组图像都包括含有出血部位的CT图像和医生标注的图像。按照患者划分筛选后的数据集,将其中的70例患者图像共6000张作为训练集,20例患者图像共2400张作为验证集,剩余的10例患者图像共1200张作为测试集。为了对分割结果进行量化,本文将从均交并比(mean intersection over Union, mIoU)、错误率(Volumetric Overlap Error, VOE)、召回率(Recall)、特异度(Specificity)以及Dice系数(DICE) 5个方面来衡量分割结果的优劣性。它们的计算公式分别为

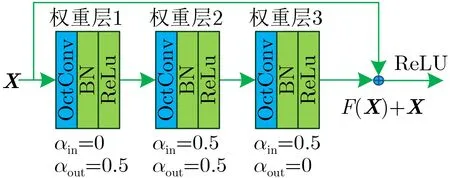

本文的实验流程如图7所示,由于CT图像在采集过程中存在采集设备电压、层间距等干扰信息。因此对CT图像依次进行结构元素为3×3的开运算、对比度指数为1.25的拉普拉斯锐化图像预处理操作。处理后的图像,如图8所示。接着,对处理后的图像进行数据集划分得到训练集、验证集以及测试集,随后在构建好的模型中进行训练,模型的训练为多次迭代操作,最终保存使得在验证集上评价指标最好的那一组模型参数。在测试阶段,读取测试集文件,加载之前保存的模型,即可预测出分割结果。

图7 实验流程图

图8 实验预处理效果对比图

3.1 实验统计结果

为了验证本文所提出网络模型的稳定性,在实验的时候,使用10折交叉验证。表3为实验所获得的mIoU, VOE, Recall, DICE以及Specificity等相关评价指标的统计结果。由表3可知mIoU, Recall,DICE, Specificity的均值都在0.85以上,其中特异性均值接近1,VOE的均值为0.021,说明模型的漏检率较低。5项指标的方差均不超过0.01,说明所提出的分割模型比较稳定。综合5项指标的均值、方差可以得出结论:所提出的模型较为稳定,并且分割效果较好,可以完成脑出血CT图像分割任务。

表3 评价指标的统计结果

图9为采取本文所提出的网络模型进行脑出血CT图像分割的结果,图9(a)—图9(c)依次为基底节区出血、脑室出血、脑干出血病例。图9中第1列为输入到分割网络的脑出血CT图像,第2列为Groundtruth,第3列为AU-Net+的分割结果。可以发现,基底节区出血CT影像上表现为密度高,边界与颅骨位置接近;脑室出血呈长条状,密度稍低;脑干出血区域较小。比较Ground-Truth和AU-Net+的分割结果分析出,不管是脑出血CT图像中的出血部位的位置、大小如何,本文所提出的AU-Net+模型有较好的分割效果。

图9 典型病例的分割结果

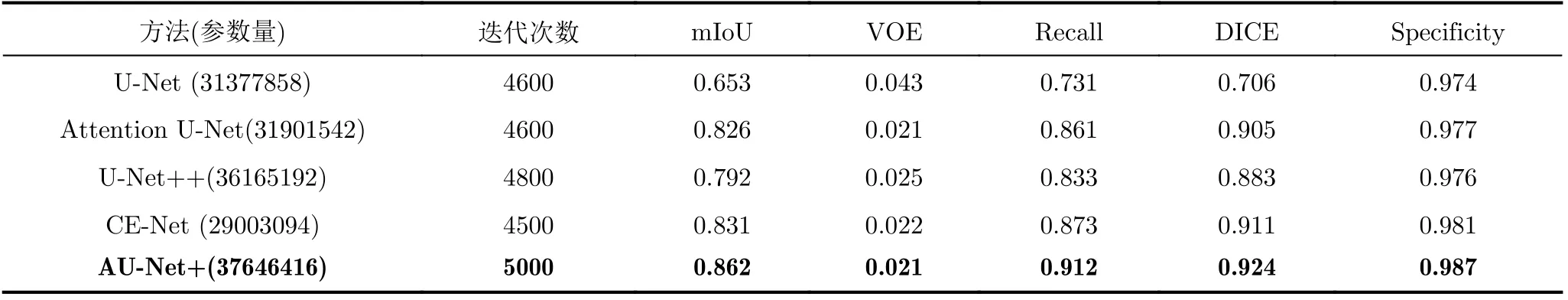

3.2 实验结果对比

为了验证本文方法AU-Net+的分割效果,与近年来在医学生物分割领域的典型方法进行对比,对比模型选择了U-Net, Attention U-Net, U-Net++以及CE-Net,分别在脑出血CT图像数据集上进行实验。训练阶段,各网络模型参数采用随机初始化的方法,并使用Adam优化算法训练模型,学习率参数设置为1e-5,通过设置Dropout因子为0.5来降低过拟合的风险。图10为AU-Net+训练过程中的loss曲线,横坐标为学习轮次,每个学习轮次中网络权重更新100次,纵坐标为损失函数值。当学习轮次大于50的时候,即迭代次数为5000次,训练集上的损失函数值趋于平缓,验证集上的损失函数值出现严重抖动,因此将AU-Net+迭代次数设置为5000。表4展示了本文提出的AU-Net+模型与其他方法的对比结果。其中,本文提出的方法的mIoU,Recall, DICE 3项指标均高于其他方法,说明本文所提的AU-Net+模型具有更好的分割性能。

表4 实验结果对比

图10 AU-Net+模型训练曲线

图11展示了不同方法在脑出血CT图像数据集上的分割结果对比图,图11(a)为输入到神经网络的原图,该病例为基底节区出血,血凝块收缩导致其在图像上表现为密度增高,图11 (b)为Groundtruth,图11 (c)—图11 (g)分别为各个方法的分割效果图。通过对比图11可以发现,基底节区出血中外渗血液会对邻近的脑组织有切割作用,从而导致分割图像中存在大目标和小目标区域病灶区域,即目标区域表现为多尺度特性。本文所提出的方法较其他方法在大目标的分割上更优。特别地,对于小目标的分割(图中的红圈部分)有明显的优势,更好地融合了深层和浅层的特征,增强了小目标区域的特征表达,分割结果与Ground-Truth最为接近。

图11 分割效果图

3.3 讨论

3.3.1 混合注意力机制和ROC结构分析

为了衡量混合注意力机制与ROC模块融合对实验结果的影响,设计出模型消融实验,即将AUNet+进行如下调整:(1) 将AU-Net+中删除混合注意力机制模块和ROC模块,记为Network_1;(2) 将AU-Net+中删除ROC模块,记为Network_2;(3) 将AU-Net+中删除混合注意力机制模块,记为Network_3;(4)将AU-Net+中的八度卷积替换为普通的卷积,记为Network_4。实验结果如表5,在mIoU指标提升上:

表5 混合注意力机制和ROC结构分析指标对比

(1) AU-Net+相比于Network_1提高了20.1%,说明使用混合注意力机制和ROC模块组成的长短连接对脑出血CT图像的分割效果有更好的提升作用。

(2) AU-Net+相比于Network_2提高了2.7%,说明使用ROC模块组成的长短连接结构比直接使用长连接效果更好。

(3) AU-Net+相比于Network_3提高了8.1%,说明混合注意力机制可以提升网络性能。

(4) AU-Net+相比于Network_4提高了2%,说明使用八度卷积的网络具有更好的分割效果。

3.3.2 参数量分析

由表6可知,本文设计的AU-Net+模型的参数量为相比于Attention U-Net模型多了5744874。参数量增多,可能会使得分割的效果更好,因此为了排除这种因素设计出1组对比实验。在Attention U-Net中加入更多的参数量,使其的参数量与AU-Net+参数量相当,称为Attention U-Net*。实验效果图如图12所示,各项评价指标如表6所示。根据实验结果,Attention U-Net在加入更多的参数量后mIoU指标反而下降,说明单纯给神经网络加入参数量不能够提升效果,反而会因为网络结构复杂导致分割效果不佳。

表6 实验结果对比

图12 实验结果分割效果图

3.3.3 损失函数对实验结果的影响分析

对比式(8)、式(9)可知,新设计的损失函数会引入更多的计算量,因此为探究ypred的指数对实验结果的影响,设计实验如下:在对比实验中,令ypred的指数分别为1, 2, 3, 4,其实验结果如图13所示。由图13可知,ypred的指数为3的时候准确率最高,但是指数太大反而会导致mIoU指标下降,随着指数增大分割耗费的时间有所增多。综合ypred的指数对分割的影响,本文将ypred的指数设置为3。

图13 ypred 的指数对分割的影响

4 结束语

为解决脑出血CT图像中出血部位大小形状差异性较大,导致分割精度较低的问题,本文以深度学习技术为基础,设计出一种基于改进U型神经网络的脑出血CT图像分割模型。本文的AU-Net+采用了由ROC模块组成的长短连接结构,可以将图像不同层次特征进行更好的融合。通过引入混合注意力机制提高了模型对病灶的特征提取能力。另外,使用改进的损失函数,使得网络模型着重学习小目标区域特征。对比实验表明本文所提模型能使脑出血CT图像分割精度得到有效提升,为辅助医生诊断,提高术前准备工作效率,提供了有效的帮助。