一种局部加权和增量字典更新的视觉跟踪方法

郑鹏根, 赵慧民, 詹 瑾*, 黄智慧, 利华康

(1. 广东技术师范大学计算机科学学院, 广州 510630; 2. 中山大学电子与通信工程学院, 广州 510275)

目标跟踪是计算机视觉研究中的热点领域,目前建立实时、鲁棒的视觉跟踪模型仍是一项挑战性的任务.视觉跟踪方法一般由目标搜索策略、特征提取和观测模型等组成.首先, 搜索策略获得候选样本后进行特征提取, 主要包括人工特征和学习特征; 然后观测模型利用特征判断候选样本是否为跟踪目标.观测模型通常分为生成式[1-2]和判别式[3-4], 前者通过目标外观模型在搜索范围内匹配最优目标位置, 后者主要研究和寻找目标和背景的决策边界.

在生成式跟踪模型中, 采用循环矩阵和快速傅里叶变换的相关滤波可提升算法速度.如Feng等[2]将Kalman滤波器(KF)与时空正则化相关滤波器(STRCF)结合用于视觉跟踪, 以克服大规模应用变化带来的不稳定性问题; Zhang等[3]提出一种基于L2范数的稀疏响应正则化项以抑制相关滤波框架中的意外峰值, 提高了对目标姿态变化的跟踪鲁棒性.以上方法跟踪效率较高, 但跟踪效果容易受边界效应的影响.而基于深度学习的跟踪方法在目标表征能力方面更有优势.如深度注意跟踪方法(deep attentive tracking, DAT)[4]能在跟踪过程中调整跟踪模型,提高跟踪准确度.但深度网络的运行效率低, 实时性能较差.孪生网络方法[5-6]将网络分为模型分支和场景分支, 通过回归和分类进行目标定位和识别, 该方法设计灵活, 提升了跟踪实时性和跟踪效率.

基于稀疏表示的跟踪方法核心是将目标跟踪视作特征空间下的匹配优化或相似性度量问题.如L1跟踪方法[7]利用稀疏表示方法建立全局目标外观模型, 对遮挡目标的跟踪效果良好,但对目标外观和背景变化的适应性较差.基于低秩稀疏表示的方法[8]增加了低秩假设, 提出一种新的结构化低秩建模算法, 用于复杂场景下的目标跟踪.基于局部稀疏表示的跟踪方法[9]将目标的局部面片分为三类, 采用判别性局部稀疏编码和局部线性回归对面片赋予不同的权重, 提高了跟踪准确性.Zhang等[10]利用目标候选区域与局部面片联合学习空间结构表示, 在搜索最佳目标区域时考虑了遮挡和噪声引起的异常值, 减小了目标整体形变的影响, 在目标姿态变化和局部遮挡的情况下仍有较好的跟踪效果.

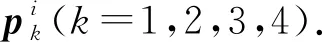

由于全局稀疏特征表示的目标跟踪模型受遮挡和背景干扰的影响很大, 其稀疏特征通常不是最优的选择, 本文提出一种基于局部加权外观表示和增量字典更新的目标跟踪方法.首先, 对第1帧目标划分局部块, 在每个局部范围内采样, 并利用LC-KSVD[11]的方法构建具有判别性的子稀疏字典; 其次, 对后续帧样本划分局部块, 利用子字典依次进行稀疏分解, 利用稀疏特征系数中的非目标成分计算样本各局部块的扰动量和权重; 最后, 综合局部权重与候选样本的重构误差, 定位出最佳的目标跟踪位置.此外, 本文拟根据扰动量检测目标干扰信息, 调节字典更新频率, 实现周期性且自适应的增量字典更新方法, 以增强跟踪模型对目标外观和背景变化的适应性.

1 方法介绍

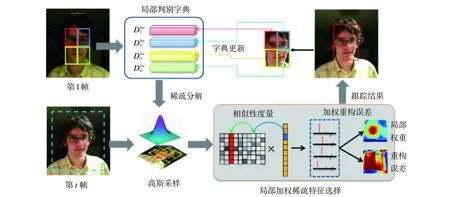

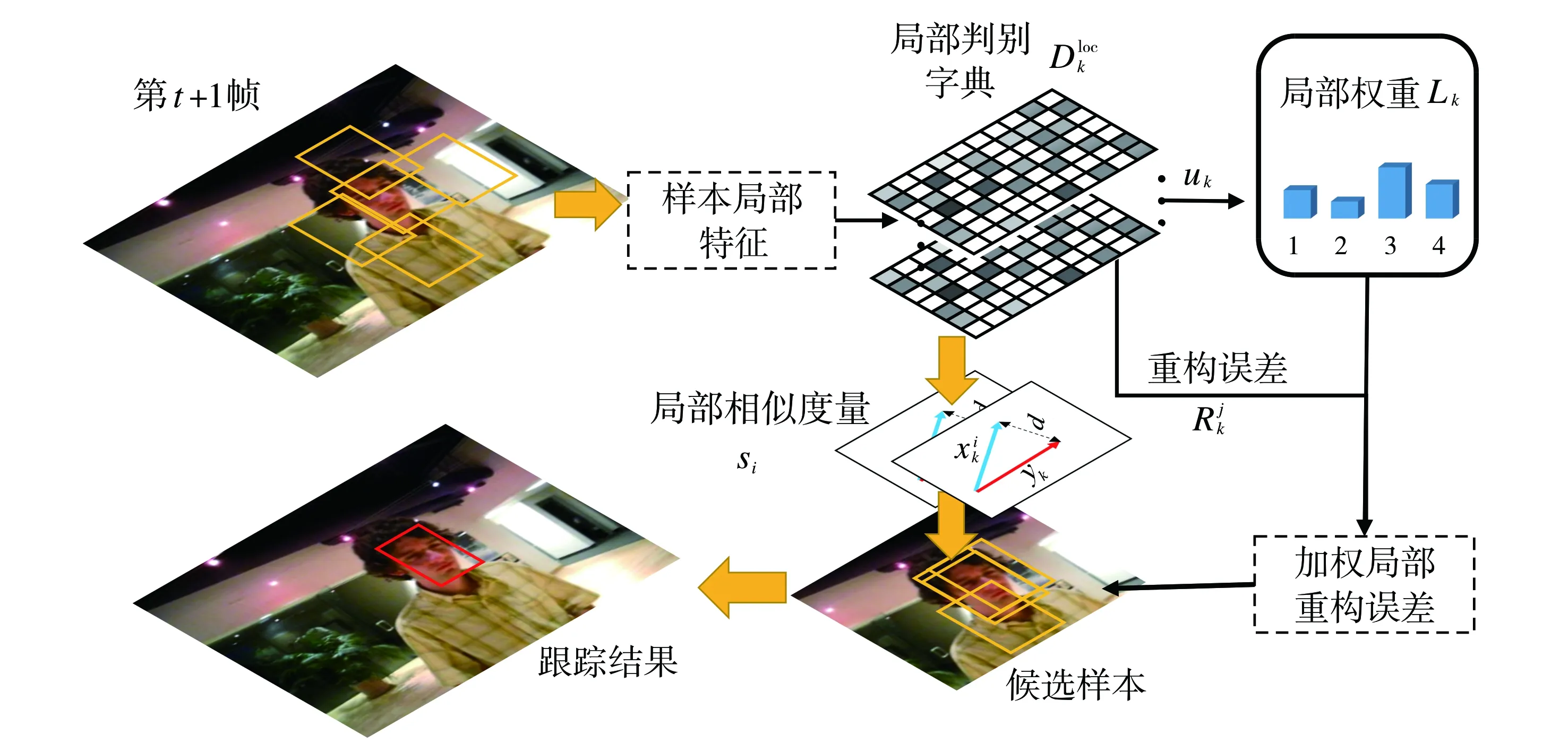

图1为局部加权和增量字典更新的跟踪方法主流程图.首先构建第1帧目标的局部外观模型, 将首帧目标划分为多个局部块, 围绕局部块中心分别进行采样, 构建每个局部块的判别字典矩阵.然后在后续帧跟踪过程中进行搜索区域采样, 用局部块的子字典分别对候选样本局部进行稀疏分解, 得到的稀疏系数用于度量样本局部的相似性, 再结合权重和重构误差定位最佳候选样本, 并以周期且增量式的方式自适应地更新原有子字典.

图1 局部加权和增量字典更新的跟踪方法主流程图

1.1 基于局部外观表示的跟踪过程

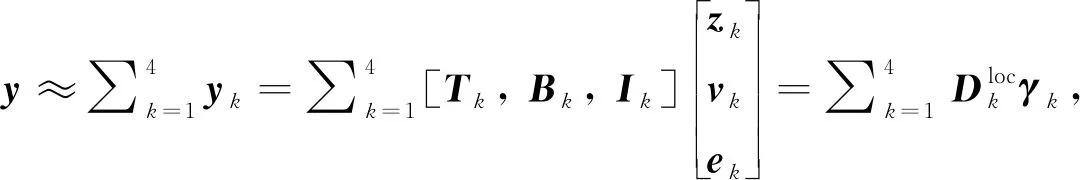

图2 基于加权重构误差的最佳样本选择过程

1.2 增量式字典更新策略

2 试验结果

2.1 试验条件

本文选择4个相关的跟踪方法进行比较, 分别为: L1-APG[7](基于全局特征、稀疏表示、模型更新的生成模型), ASLA[12](基于局部特征、稀疏表示、模型更新的生成模型), TLD[13](基于局部特征、密集采样、模型更新的判别模型), CT[14](基于全局特征、稀疏表示、模型更新的判别模型).本文采用的OTB100数据集[15]为目标跟踪测试的标准数据集之一, 由100个全标注视频组成, 包括光照变化、遮挡、快速运动等11种视频场景挑战.试验软硬件环境为: CPU为Intel(R)Core(TM) i5-3337U-1.8GHz, 内存12 GB, 开发工具为MATLAB R2017a.

2.2 结果与分析

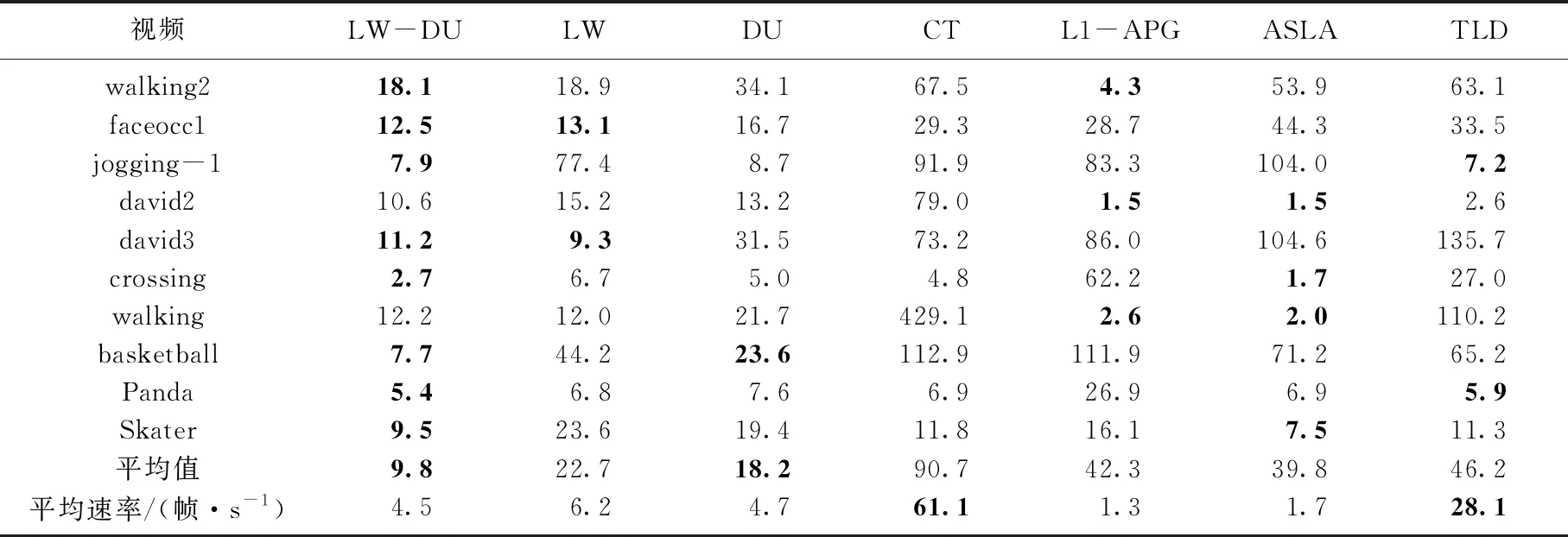

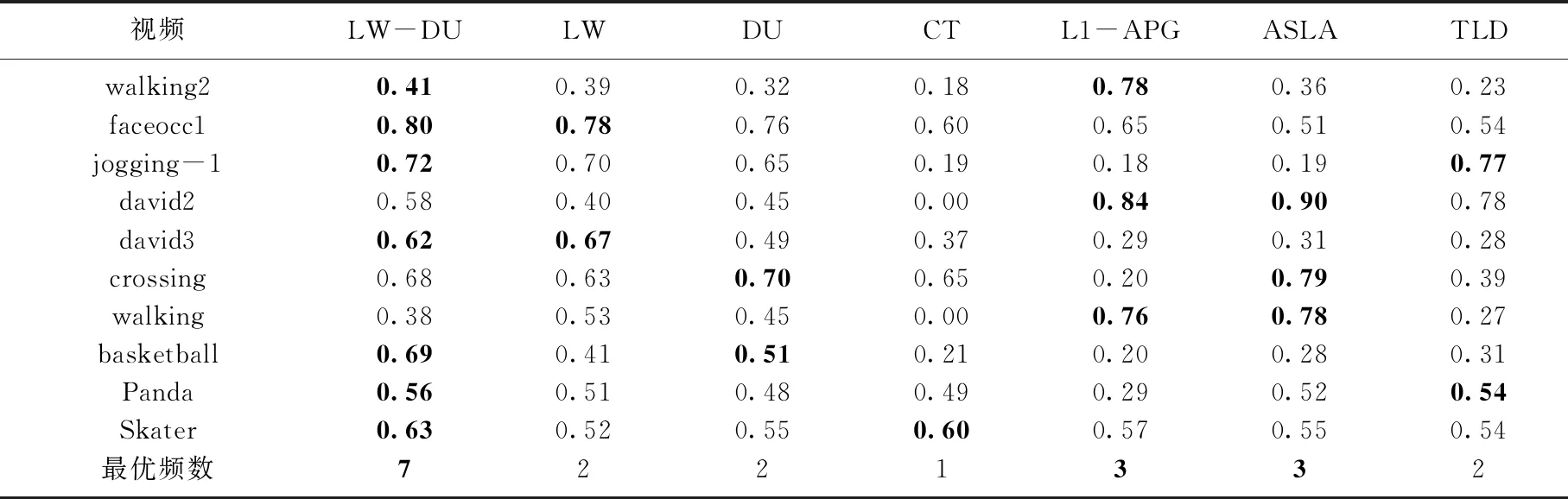

2.2.1 中心位置误差和重叠率

中心位置误差是预测目标与真实目标中心位置之间的像素距离, 误差越小效果越好; 重叠率是预测跟踪框和真实目标框的面积交并比, 重叠率越高效果越好.表1和表2分别显示了不同方法在10个视频序列中的平均中心误差和平均重叠率情况.本文采用局部加权和模型更新的方法记为LW-DU(基于局部特征、稀疏表示和判别模型), 采用局部加权而模型不更新的方法记为LW, 采用模型更新而局部不加权的方法记为DU.表1和表2的数据显示, LW-DU方法在平均中心误差平均值和重叠率最优频数上都明显优于其他方法.

表1 不同方法在各视频上的平均中心误差

1) 消融分析.如表1所示, 对于同样采用更新判别式稀疏表示模型的LW-DU和CT, 采用局部特征的LW-DU优于采用全局特征的CT, 说明判别式字典模型采用局部特征取得更好的效果.LW-DU在典型的遮挡序列walking2、basketball和david3中表现明显优于DU, 说明局部加权在目标遮挡场景中具有重要作用.表2显示了各方法在不同视频中的跟踪平均重叠率, 在目标形变和背景干扰的序列Skater、basketball、david2中, LW-DU的重叠率比LW显著提高, 表明字典更新方法可以有效提高跟踪方法在目标形变和背景干扰中的性能.

2) 中心位置误差比较.表1显示了不同方法跟踪结果的中心位置误差, CT方法和TLD方法的跟踪误差较大,目标表征能力弱, 但运行速率最快(分别是61.1和28.1帧·s-1); ASLA方法和L1-APG方法的运行效率较好, 跟踪速率最慢.本文提出的LW-DU方法的中心误差最小、跟踪效果最好, 其跟踪速率较慢主要是受稀疏分解计算量较大的影响.

3) 重叠率比较.表2中, 频数最大的前三种方法中, LW-DU和ASLA都采用了局部稀疏表示, 而本文提出的LW-DU最优频数为7, 明显优于ASLA, 说明采用局部加权能够显著提高跟踪性能.

表2 不同方法在各视频上的平均重叠率

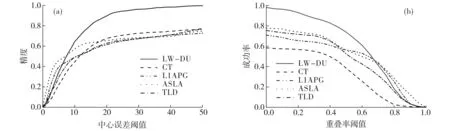

为了比较各方法在不同精度要求下的跟踪性能, 统计不同方法在试验中所有视频帧的中心位置误差和重叠率, 得到各方法在不同阈值条件下的总体精度图, 如图3所示.其中, 精度值为中心位置误差小于阈值的视频帧数与总帧数的比值, 重叠成功率值为重叠率大于阈值的视频帧数与总帧数的比值.由图3(a)可知, LW-DU方法的精度值在1~5像素的阈值段低于同为稀疏表示模型的ASLA和L1APG, 但在10~50像素的阈值段明显高于其他方法, 跟踪性能优越性明显.图3(b)的重叠成功率曲线显示, LW-DU方法明显高于的局部稀疏跟踪方法ASLA, 在阈值为0处, 该方法成功率接近1, 说明LW-DU方法极少出现丢失目标的情况.

图3 试验总体的精度(a)和重叠成功率(b)

2.2.2 跟踪性能

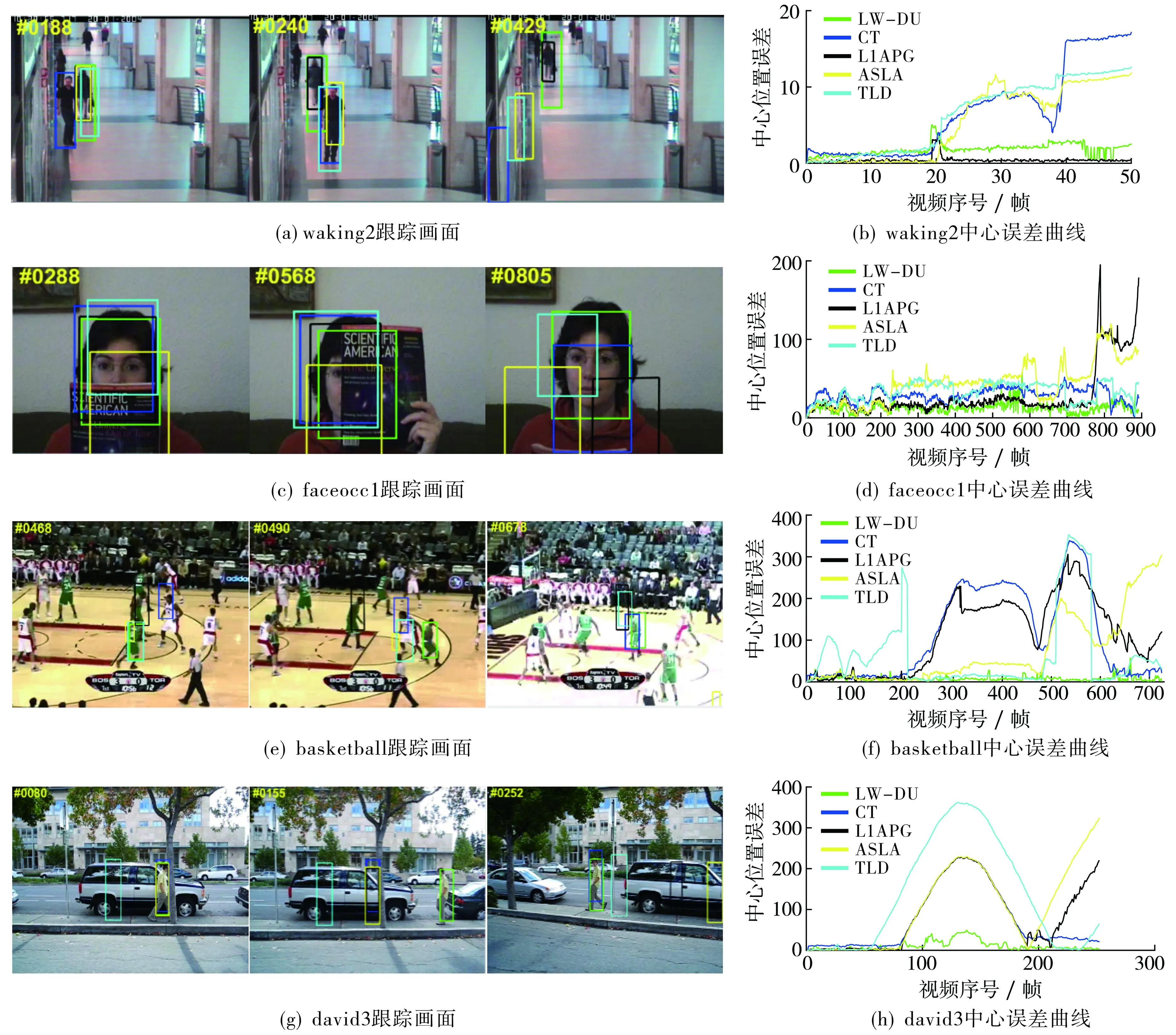

图4展示了各方法在典型视频中的跟踪画面和视频跟踪时中心位置误差的变化曲线.如图4(a)所示, 视频序列walking2中, 目标在第188帧出现尺度变化, 240帧时目标被遮挡.图4(b)的中心误差曲线显示从第200帧开始, 不同方法的跟踪结果出现明显差异, 非尺度自适应的方法TLD、CT、ASLA丢失目标, 产生漂移现象(见图4(a)第429帧), 只有本文LW-DU和尺度适应的LI-APG方法目标跟踪成功.

如图4(c)所示, 视频序列faceocc1中的目标在较长时间内被大范围遮挡, 805帧处只有LW-DU方法能正确跟踪目标, 其他方法都出现不同程度的跟踪偏移, 体现出本文自适应增量更新的有效性.图4(d)中心误差曲线显示, 在800帧附近, 不同方法结果有明显差异.模型更新容易引入非目标信息, 进而影响后续跟踪效果.

图4(e)视频序列basketball中, 目标在第468和490帧中均出现相似物体的背景干扰, 图4(f)的中心误差曲线显示不同方法的跟踪结果差别很大, 尤其是在200帧以后, 其他方法跟踪结果的误差值均较高, 而LW-DU方法始终能正确跟踪目标, 在背景明显变化的情况下仍保持良好跟踪性能.

图4(g)视频序列david3中, 背景杂乱, 会出现目标被树木完全遮挡的情况.图4(h)的中心误差曲线显示不同方法从80帧开始出现较明显的差异.TLD方法在第80帧, 由于车辆背景干扰而丢失了跟踪目标; 在155帧, 除LW-DU方法外, 其余方法均丢失了目标; 在252帧, 目标折返运动, ASLA、L1-APG、TLD方法均无法识别, 这是因为丢失目标后更新模型引入错误信息而发生了退行变化.

图4 各方法的跟踪画面及其中心位置误差的变化曲线

3 结论

本文从局部目标外观表示出发, 提出一种基于局部加权和增量字典更新的目标跟踪方法.先将目标分割为4个局部块, 并分别构建子字典; 然后在后续帧中搜索区域样本划分局部块, 通过相应的子字典分解得到稀疏系数,并据此进行相似性度量,以缩小跟踪样本范围;最后根据稀疏系数计算局部块的扰动量,得到局部块权重,再结合局部重构误差进行样本特征选择,提高目标跟踪的准确性和稳定性.此外,根据扰动量还可检测目标遮挡或偏移等情况,用以调节字典更新频率,实现字典的自适应增量更新,以应对目标外观变化.在OTB100数据集上的对比试验结果显示,本文方法能有效处理目标遮挡、姿态变化和背景杂乱的视频跟踪场景,具有良好的跟踪性能.在未来工作中将进一步完善目标的深度特征提取方法,构造融合目标传统特征和深度特征的跟踪模型.