一种基于Mask-RCNN图像分割的头足类动物角质颚色素沉积量化方法

宋自根,张佳彬,覃学标,刘必林,卜心宇

(1 上海海洋大学信息学院,上海 201306;2 上海海洋大学海洋科学学院,上海 201306)

角质颚是头足类海洋生物的主要摄食器官,蕴藏着重要的生物学信息[1-2],其色素沉积占比[3]在一定程度上反映出生物个体的生长特性。比如,角质颚[4]外部形态可较好应用于乌贼的日龄预测[5],对色素沉积占比的研究可以了解到头足类的摄食及栖息环境变化[6]。

获取角质颚色素沉积占比是研究头足类生物生长特性的重要方向之一。Hernández-García等[7]基于阿根廷滑柔鱼的角质颚,从判断角质颚翼部、侧壁、喙部等部位是否有色素沉积入手,第一次提出了角质颚色素沉积的八级定性分类标准。由于角质颚的色素沉积主要集中在喙部、翼部和侧壁位3个部位,方舟[8]通过关键部位间距离,建立了长度与色素沉积定性等级之间的映射关系,进而提出利用角质颚的特殊部位长度来评定色素沉积占比。通过特殊部位是否有色素沉积为定性描述,而通过关键点之间的长度来刻画角质颚色素沉积是定量描述,一是多种长度与分级之间的关系不够明确,二是长度也只能从某些方面刻画色素沉积的占比。

因此,本研究拟运用Mask-RCNN[9]模型对角质颚图像进行识别和分割,采用基于角质颚及其色素沉积的面积来获取角质颚的色素沉积占比,为头足类动物摄食及环境变化的研究提供参考。

1 数据与方法

1.1 图像采集

2019年,上海海洋大学“淞航号”渔业资源调查船在148°00′E~148°10′E,31°99′N-38°76′N海域,共捕获东印度洋、西印度洋和赤道鸢乌贼(Sthenoteuthisoualaniensis)以及富山武装乌贼(Enoploteuthischunii)样本共375份。乌贼样本在实验室解冻后,用镊子取出角质颚上、下颚各375个,利用清水冲洗掉表面黏液,并在胃蛋白酶溶液中浸泡2 d,以去除表面残留的有机质,然后浸泡于70%的乙醇溶液中防止脱水。在图像采集过程中,使用显微镜对角质颚进行图片拍摄。首先使用水平仪调整载玻片至水平位置,并将角质颚放置在载玻片上,并根据图片的拍摄效果随时调整灯光,以减小背景和光照对拍摄图像的干扰,最终得到角质颚上、下颚图像共750张,剔除模糊图片30张,剩下720张作为试验数据集。

1.2 图像标注

本研究使用Labelme软件[10]标注角质颚及其色素沉积的边缘轮廓。此软件是一种常见的深度学习图像标注工具,用于生成深度学习所需要的训练数据集。值得注意的是,虽然角质颚色素沉积的颜色具有一定的渐变过程,但是这种渐变过程的分界线非常明显,可以通过手动的方式对此进行标注。为了简单起见,将整个角质颚分为有色素和无色素沉积两种区域。操作过程中,使用标注目标的英文名作为标签名(图1),图像中所有的标注信息,比如标注标签、标注点坐标等均保存到与原图对应的.json文件中,使用脚本文件将.json文件转化成模型所需的数据文件,最终得到模型所需要的数据训练集。

图1 角质颚样本标注示意图Fig.1 Schematic diagram of labeled beaks samples

1.3 迁移学习

深度学习需要数据量的支撑,在数据量较小的情况下,很难通过训练提取出具有较强泛化能力的数学模型。因此,本研究针对原始富山武装乌贼只有100张样本量的情况下,采用迁移学习[11-12]方法,用于解决数据样本量不足的问题。事实上,不同地区头足类动物角质颚及其色素沉积的形态特征大致相同。角质额分为上下两片,每片均包含了喙部、翼部、头盖、侧壁和脊突5大部分,其色素沉积主要集中在喙部、翼部和侧壁3个部位,而且随着年龄的增加,其色素沉积均是从喙部尖点开始,向中间部位扩展。首先使用东印度洋、西印度洋、赤道乌贼的角质颚图像620张,对模型进行预训练,提取出角质颚形态及其色素沉积的粗粒度特征。之后,随机选取100张富山武装乌贼角质颚图片中的70张作为训练集,对预训练好的模型进行二次迁移学习,实现网络模型参数的微调,进而进一步提高了模型的预测精度。

1.4 Mask-RCNN模型

Mask-RCNN是一种目标检测深度学习算法(图2)。目标检测是使用卷积神经网络对特征[13]进行训练,然后使用训练结果对物体进行目标识别和分类,常用特征主要有HOG 特征[14]和 SIFT 特征[15]等,分类器主要有 SVM(Support Vector Machine)[16],LDA(Latent Dirichlet Allocation)[17]和Softmax分类器等。Redmon等[18]提出的YOLO算法,使用回归方法提升了模型的运算速度,使得模型具有了更强的特征泛化能力。Anguelov等[19]提出的SSD算法剔除了边界框的生成过程,进一步提高了模型的训练速度。Mask-RCNN模型是在Faster-RCNN[20]的基础上增加了一个语义分割分支,用于输出目标的掩膜,并通过损失函数来调节训练参数,实现对图像特征的深度学习。

图2 Mask-RCNN模型的结构图Fig.2 Structure diagram of Mask-RCNN model

L=lcls+lbox+lmask

(1)

式中:lcls是类别损失,lbox是位置损失,lmask是掩膜损失。

模型通过真实边框与候选框的类别差异、位置差异、掩膜差异进行训练,其中,真实边框是标记数据,候选框是预测数据。在模型训练过程中,通过损失函数(1)来调节参数,损失函数越来越小直至收敛。Mask-RCNN使用Resnet50残差网络和特征金字塔网络(Feature Pyramid Networks,FPN)[21]进行特征提取和融合。Resnet50和FPN网络经过训练后,可得到一张强语义信息和强空间信息的特征图。区域候选网络(Region Proposal Network,RPN)在特征图中生成N×N个候选框,并进行非极大值抑制(Non-Maximum Suppression,NMS),进而得到候选区域(Regions of Interest,ROI)。再通过ROIAlign将ROI调整为相同大小,其中ROIAlign是池化层,可以把原图和特征图的像素对应起来,使结果精确地映射到原图上。最后,将ROI分别送到全连接层和卷积层,用来进行掩膜mask预测、类别预测及位置回归。

2 试验方法

2.1 试验设计

针对筛选后的角质颚图片720张,首先利用Labelme软件进行轮廓数据标注,得到4个不同区域的数据集。然后使用620张东印度洋、西印度洋、赤道鸢乌贼的数据集对模型进行预训练,得到初步训练后的算法模型。再利用富山武装乌贼数据集,按7∶3比例随机选择70张作为训练集,对预训练后的模型引入迁移学习进行二次训练,来微调模型参数。利用剩下的30张作为最终测试集,使用训练后的Mask-RCNN模型,从中分割出角质颚及其色素沉积的轮廓,求出色素沉积在角质颚中的占比。具体试验流程如图3。此处以角质颚上颚试验为例,Mask-RCNN训练具体步骤如下:

图3 试验流程图Fig.3 Experimental flowchart

第1步,利用Resnet50残差网络对角质颚及其色素沉积进行特征提取,得到5个不同大小和维度的特征图。

第2步,特征金字塔网络FPN将上一步的五个特征图融合到一张特征图上。

第3步,区域候选网络RPN对特征图中的每一个位置,生成N种可能的候选框(anchor box),一共可以生成N×N个候选框。计算候选框与真实框(ground truth)的交集和并集的交并比(Intersection over Union,IOU),设置IOU上、下阈值,IOU大于上阈值为正样本,小于下阈值为负样本。从正、负样本中各选取128个样本进行特征训练,调优RPN网络层参数。

第4步,对RPN输出的候选框进行NMS,得到的ROI由ROIAlign池化为固定大小格式,再将输出的结果分别输入到2个分支中进行训练。其中一个分支网络由两个全连接层构成,用于类别分类和位置回归。另一个分支网络由全卷积网络(Full Convolutional Networks,FCN)构成,用于生成掩膜,实现Mask-RCNN检测模型的训练。

最后,通过角质颚及其色素沉积的掩膜像素点来计算色素沉积的量化占比。为了评估训练模型的分割精度,给出了每张图像的输出结果及其真实边框的IOU,进一步对得到的每一个图片IOU值进行再平均,作为模型的整体分割精度。

2.2 模型参数

使用Ubuntu16.04操作系统,服务器显卡为GTX1050Ti,显存为8GB。为了得到较好的分割效果,将初始学习率设置为0.001,动量默认为0.9。在试验过程中,不断修改迭代次数(Epoch),并根据损失函数(loss)的变化来确定Epoch(图4)。因为每次迭代可以训练6张图像,每张图像训练一次,故初始迭代次数设为12,并依据试验结果,依次倍增迭代次数。在试验过程中,对于上颚和下颚,取Epoch=12时,模型会将目标物误认为背景,此时模型欠拟合。取Epoch=36时,模型会将背景误认为目标物,模型出现过拟合。对于上颚和下颚色素沉积,取Epoch=12时,模型没有将背景误认为目标物。取Epoch=24时,模型将背景误认为目标物,模型过拟合。因此,本研究根据loss图像最终选择分割效果最好的迭代次数,对于角质颚上、下颚取Epoch=24,对于上、下颚的色素沉积取Epoch=12。上、下颚图像训练需要运行时间大约8 h,色素沉积训练时间大约5 h,训练完成后,图像分割仅需要几秒钟即可完成。

图4 loss曲线图Fig.4 Loss curve

3 结果与分析

3.1 上颚及色素沉积试验分割结果

角质颚上颚及其色素沉积的模型输出结果如图5所示,其中a为原图,b、c为轮廓输出图,d、e为色素沉积输出图。此时,轮廓掩膜所占像素点为151 232,色素沉积像素点为60 921,可以计算出样本色素沉积的量化占比为40.28%。然后分别计算所有30个测试样本图像的输出边框和真实边框的IOU,作为训练模型的量化分割精度。如图6所示,上颚轮廓的分割精度最小为92.75%,最大为94.38%,整个模型的平均精度为93.60%。色素沉积的分割精度最小为92.31%,最大精度为92.68%,平均精度为92.47%。

图5 上颚试验结果Fig.5 Experimental results of upper beaks

图6 上颚部分测试集结果Fig.6 Experimental set results of upper beaks

3.2 下颚及色素沉积试验分割结果

下颚及其色素沉积的模型输出结果如图7所示。此时,轮廓掩膜所占像素点为97 524,色素沉积像素点为54 453,可以计算出样本色素沉积的占比为55.8%。按照上述对上颚分割精度的计算过程,给出了30张下颚测试数据集的分割精度(图8),其中下颚轮廓精度最小为91.48%,最大为92.49%,整个模型的平均精度为91.78%。而色素沉积的分割精度最小为88.60%,最大为89.10%,平均精度为88.78%。

图7 下颚色素沉积试验结果Fig.7 Experimental results of lower beaks pigmentation

图8 下颚部分测试集结果Fig.8 Experimental set results of lower beaks

4 讨论

4.1 色素沉积占比方法对比

头足类动物包括鱿鱼、章鱼、船蛸、乌贼和墨鱼等的主要摄食器官即为角质颚,其形态稳定、耐腐蚀、储存信息良好,可以提取出大量的生态学信息[22]。但是角质颚体积小,形态不规则,如何测量角质颚及其色素沉积占比,一直是其研究的重要方法基础。从早期基于角质颚相关部位是否有色素沉积的定性描述,提出了色素沉积的八等级分类方法。方舟等[23]基于八等级分类,研究了角质颚色素沉积与性腺成熟度之间的相互关系,发现雌性个体色素沉积与性腺成熟度之间呈显著的正相关特征,而雄性个体则不显著。虽然这种方法为头足类动物的研究提供了很好的基础,但是具有很大的主观性,无法从数量关系上给出精确的判别标准。后来,根据角质额本身的形态特征,发展到通过角质颚特征点之间的距离,来判定色素沉积等级,如下头盖长、下喙长、下侧壁长等等,进而拟合出色素沉积等级与胴长、体质量、性腺成熟度之间的关系。陆化杰等[24]和胡贯宇等[25-26]基于此对角质颚色素沉积等级进行了划分和判定,研究了角质颚色素沉积等级变化与胴长、体质量、净重和性腺成熟度的关系。本研究基于神经网络深度学习模型,对角质额及其色素沉积进行分类识别和图像切割,通过计算相应的面积占比,实现了角质颚色素沉积的精确自动化测量,是一类量化占比计算方法。

4.2 Mask-RCNN求取色素沉积占比

随着数据量的增加和算法的发展,深度学习迅速在目标检测和目标分割领域中广泛使用。渔业信息化方面,王金凤等[27]使用深度学习模型对鱼群密度进行检测,展现了深度学习在生命科学中的应用。近些年来,Mask-RCNN的算法[28-29]运用方面也效果显著。Johnson等[30]使用Mask-RCNN模型,实现了细胞核显微图像的高效自动分割。张凯中等[31]使用Mask-RCNN模型,实现了猪群图像的精确分割。钟伟镇等[27]使用Mask-RCNN模型,对植物叶片进行分割和识别,实现了植物种类的自动识别和生长状态的自动化监测。

本研究表明,利用Mask-RCNN深度学习模型,可以自动计算出头足类生物角质颚的色素沉积占比。由于样本数据量少的不足,本研究采用迁移学习解决这一问题。而后使用labelme对数据进行标注,标注的过程需要获取角质颚的每个关键点。标注完成后,分别对角质颚及其色素沉积的数据集进行训练和测试,实现角质颚图像的精确分割,并使用分割得到的掩膜图像,自动化计算出角质颚色素沉积的量化占比。模型实验结果表明,该方法分割精度很高,无需人为干涉,可以大量批处理。此外,本研究中的深度学习方法,训练后的模型分割每张图像只需要几秒钟,体现了该方法的高效性。

4.3 试验中存在的问题

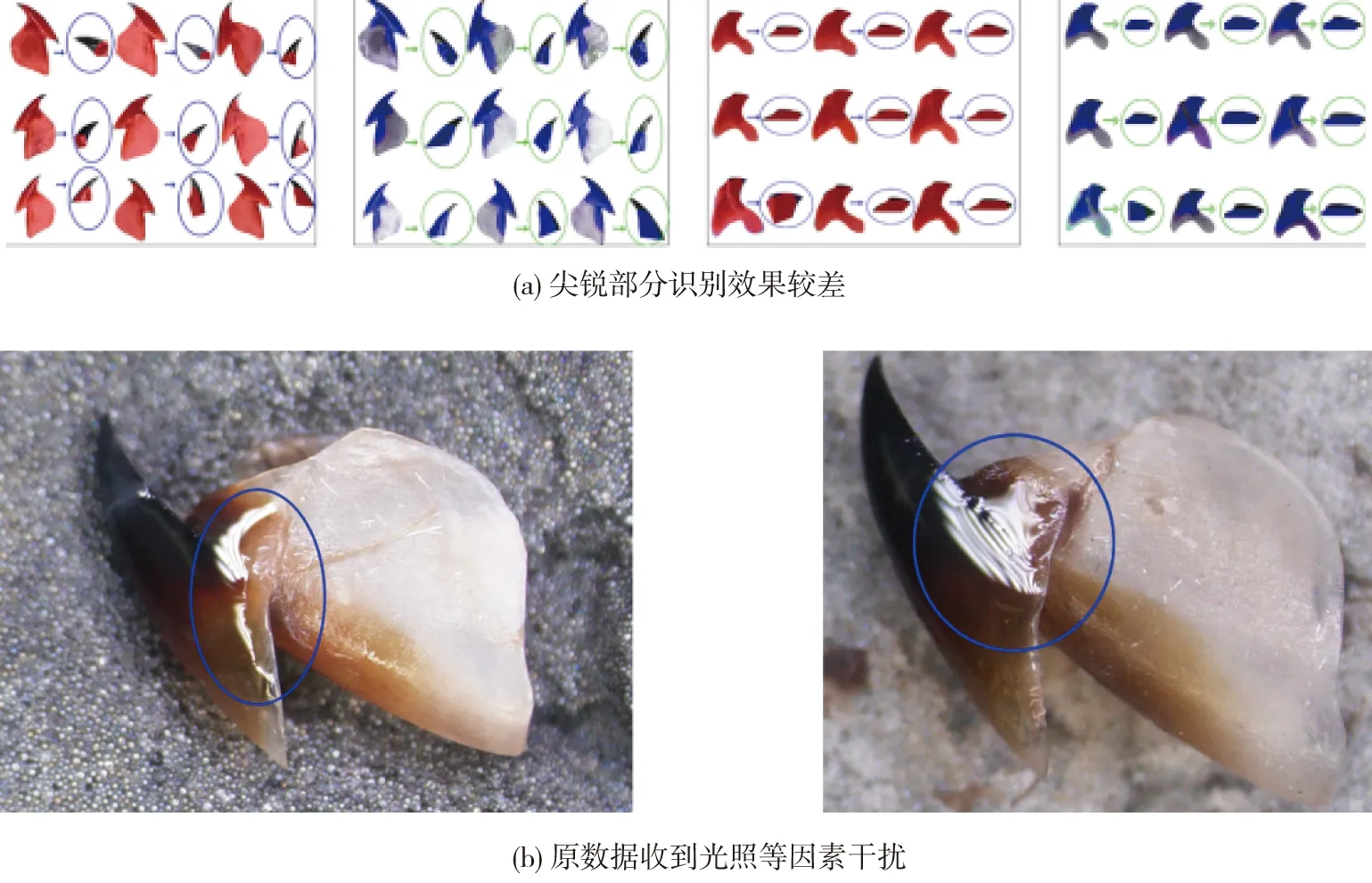

本研究算法对图像目标的尖点部分识别效果较差(图9),引起了相应的预测误差,从而对角质颚色素沉积占比的计算造成一定的误差。后续拟通过对模型进行改进,将Mask-RCNN深度学习模型与边缘分割进行结合,边缘分割对于图像中尖锐部分的提取效果很好,但不能完整的提取出图像中的所有轮廓。其次,在角质颚数据的获取上,会受到光照、拍摄角度等一些因素的干扰,这对试验结果也会造成一定的影响。后续拟通过对拍摄环境进行调整、对拍摄数据进行预处理等方法减轻这些因素的干扰。

图9 试验进一步改进部分Fig.9 Missing part of the test

5 结论

利用Mask-RCNN深度学习的神经网络模型,通过迁移学习和模型参数训练,实现了角质颚及其色素沉积的图像识别和分类切割,提出了基于面积获取和像素占比计算的色素沉积量化精确测量方法。研究结果表明,本方法可以精确自动获取角质颚色素沉积的量化占比,实现了从定性分类到定量测量的发展,促进了色素沉积与头足类动物生长因子关系的研究,也为基于色素沉积的头足类动物摄食变化及生存环境研究提供了基础。

□