文物高光谱数据采集及其多尺度多支路融合增强方法

彭进业,张涵毓,付毅豪,张群喜,刘 璐,王 珺

(1.西北大学 信息科学与技术学院,陕西 西安 710127;2.陕西历史博物馆,陕西 西安 710061;3.陕西省丝绸之路文化遗产数字化保护与传承协同创新中心,陕西 西安 710127;)

通过光学成像记录文物形貌是文物数字化最常用的方式之一。其中,最常用的方式是通过数码相机采集红、绿、蓝3个波段的信息,获取RGB三通道图像,记录现有文物的形貌特点。然而,随着光学成像方法的不断发展,越来越多的成像方式应用于文物保护分析中。其中,高光谱成像因其光谱分辨率高,可同时获取数百个连续波段的空间与光谱信息,形成文物的“光谱指纹”,广泛应用于文物鉴定、成分分析、隐含信息挖掘等文物保护分析工作中[1-3]。然而,由于成像传感器的硬件限制[4],现有设备的空间分辨率远达不到高清数码相机的分辨率,限制了高光谱数字化的发展。为了获取具有高空间和高光谱分辨率的数据,本文结合多种传感器拍摄的图像开展研究。

图像融合是提升高光谱图像分辨率的常用方法之一,结合文物数字化影像数据的特点,本文将综合高空间分辨率RGB图像(high spatial resolution RGB images,HR-RGB)的空间细节和低空间分辨率高光谱图像(low spatial resolution hyperspectral images,LR-HSI)的光谱信息,获得高空间分辨率的高光谱图像(high spatial resolution hyperspectral images,HR-HSI)。

目前,很多学者也开展了相关研究,如成分替换法、变分模型法等。由于具有自适应特征提取和学习能力,基于深度学习的图像融合效果更优。Li等人探索了卷积网络在高光谱图像超分辨率中2D和3D卷积之间的关系[5];Zhu等人通过深度渐进的零中心残差学习,融合多光谱和高光谱图像来提升高光谱图像的分辨率[6];Xiao等人利用生成对抗网络,设计了迭代细化单元,解决高光谱图像的超分辨率问题[7]。然而,图像融合的方法通常会在空间增强和光谱保真度之间进行权衡,融合结果会获得较高的光谱保真度,而空间结构比较模糊[8]。另外,在基于深度学习的图像融合方法中,大多数损失函数只在空间方面进行约束训练,导致发生光谱畸变。

综上所述,为了提高高光谱图像的空间分辨率,考虑到需要在同一场景下分别采集RGB和高光谱数据,为了降低配准难度,本文首先提出一套面向文物高光谱数字化的操作流程;其次,提出了基于多尺度多支路的RGB和HSI融合方法,主要内容如下:

1)设计多尺度空间光谱融合模块,融合RGB和HS图像在不同尺度下的特征,在保留光谱信息的同时,引入RGB的空间结构;然后,将多支路信息输入细化模块,进一步提高高光谱图像的空间分辨率。

2)设计含有光谱角指导的损失函数,从而在空间和光谱两方面对训练进行约束,避免空间结构模糊和光谱畸变。

3)与传统方法和基于深度学习的方法进行对比,并设计消融实验,证明本文方法的有效性和优越性。

1 数据采集

1.1 器材选择

1.1.1 相机选择 采集工作中选择了日本佳能公司生产的EOS 5DS数码单镜头反光相机和芬兰SPECIM公司的高光谱相机进行文物数据采集。其中,数码单反相机采用了CMOS图像感应器,尺寸为全画幅(36.0 nm×24.0 nm),传感器输出像素最大尺寸为8 688×5 792;高光谱相机可以获取204个波段的光谱带数据,输出像素为512×512。

在采集RGB图像前,应先调整好相机内部参数,保证最佳像素,设置RAW+JPEG格式记录原始RGB图像数据,同时,使用三脚架稳定相机并固定位置。采集时,快门速度不低于1/100 s,并且使用自动白平衡模式保证白平衡的统一。

1.1.2 灯光选择 由于环境对光源极高的依赖性,使得仅靠相机难以独立完成采集工作,通常还需针对性照明器材协同进行工作。在采集高光谱图像过程中,卤素灯(100~1 000 W)作为主要照明设备,用于模拟日光,在采集RGB图像时,使用普通LED灯进行照明。在使用外置光源时,光线应均匀柔和,避免对文物造成损害;同时根据采集现场的具体环境对亮度进行调节,防止出现过亮的光斑,造成图像的过曝,影响采集数据的质量。

1.1.3 其他工具 受不同光源色温不同的影响,采集的照片可能存在偏离正色的问题,因此,借助高光谱设备中自带的白板,保证在统一色温条件下还原图像正确的颜色。另外,采集使用了对文物没有损害的红外打线器,参考其在文物上投影边框划分的区域进行拍摄,保证获取同一场景下的RGB和高光谱图像,使其尽可能相匹配。同时使用三脚架、固定器作为辅助摄影器材,减少因手持设备拍摄而产生的画面抖动,残影等问题。

1.2 数据采集流程

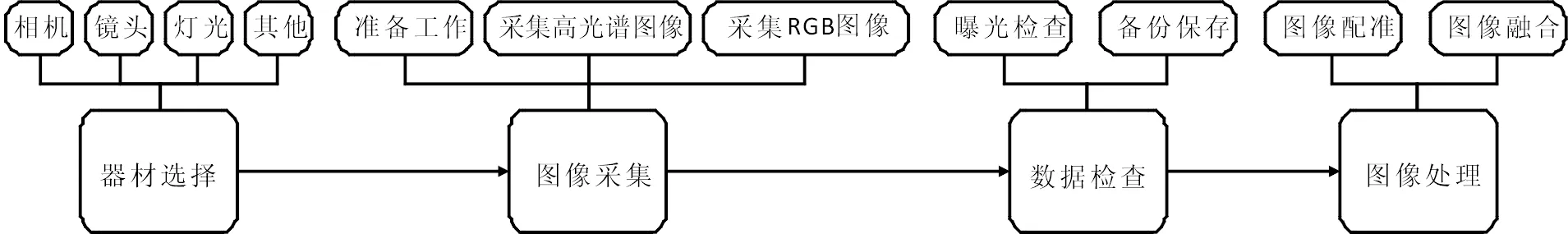

图1为本文设计的采集文物RGB图像和高光谱图像规范化操作流程。准备工作如下:

1)根据实际需求制作表格,记录拍摄时间、地点、内容以及相机参数、摄距等信息,规范填写工作记录,制定工作准则,要求工作人员遵守规范、严格执行。

2)准备整个数据采集工作中需要的所有工具:数码单反相机、高光谱相机、三脚架、红外打线器、卤素灯、白板、卷尺等。在采集文物图像数据之前,根据实际情况,使用卷尺控制采集设备与被摄文物之间的距离,固定相机三脚架,在采集过程中保持摄距不变。为了保证采集图像无变形,要求相机与被摄物完全平行,并且使镜头主轴对准被摄物的中央,避免透视变形。同时,按照图2所示的布局放置卤素灯,在被摄物左右两侧各打一束光,约呈45°照射,微调距离后保证被摄物各部位受光量一致。

数据采集流程如下:

1)采集文物的高光谱图像:首先,打开红外打线器,根据拍摄内容调整投影距离;然后,打开卤素灯,调节光源强度,避免白板过曝,对白板进行拍摄。在拍摄白板时,需佩戴纯色棉质手套,避免污染,同时不得遮挡白板,使其尽量贴近采集对象但无接触;之后,利用高光谱相机内置的功能自定义白平衡,进行色彩校正;最后,取掉白板,拍摄所选区域的多张高光谱图像,便于后期挑选高质量的数据。

图1 文物图像数据采集流程Fig.1 The acquisition process of cultural relic image data

图2 卤素灯的放置方式Fig.2 The way of halogen lamps are placed

2)采集文物的RGB图像:高光谱图像拍摄工作结束后,保持现场环境一致,保证光源强度、摄距等条件不变,更换拍摄设备为数码单反相机,采集同一区域的多张RGB图像。

3)更换拍摄内容:需要移动相关设备、器材,再次拍摄白板,保证每组数据内必须包含有实时拍摄的白板图像,并且按照准备工作中的布置要求,重新安装相关设备。

4)数据处理:采集工作结束后,对获取的文物图像数据进行检查,删除因过曝、模糊等问题无法使用的图像,检查是否拍摄齐全,确保提交的数据符合要求。同时,对原始数据按照采集内容、时间等类别进行细化分类,详细规范地命名,附有拍摄时间、内容等文件信息,RGB图像和高光谱图像分别以.JPEG和.DAT格式保存到移动数据盘,并进行备份。

2 基于多尺度多支路的融合网络

本节对采集到的RGB和高光谱数据进一步通过提出的多尺度多支路的融合网络(multi-scale and multi-branch fusion network,MMnet)融合增强,重建包含RGB空间细节和HSI光谱信息的高空间分辨率高光谱图像。

2.1 问题描述

将高分辨率高光谱图像集合表示为Z∈Rb×W×H,其中,b代表光谱带数,W和H分别为高光谱图像的长和宽;对于观测的RGB图像,可以表示为X∈R3×W×H,其中,3代表包含R、G、B 3个光谱带;LR-HS表示为Y∈Rb×w×h(b≫3,W≫w,H≫h)。本文提出的方法便是利用神经网络架构来学习输入(X,Y)和Z之间的非线性映射关系:

l(θ)=‖fw(X,Y;θ)-Z‖1。

(1)

其中,fw(·)代表整个神经网络从输入到输出的映射,θ是待优化的参数,‖·‖1为L1范数。

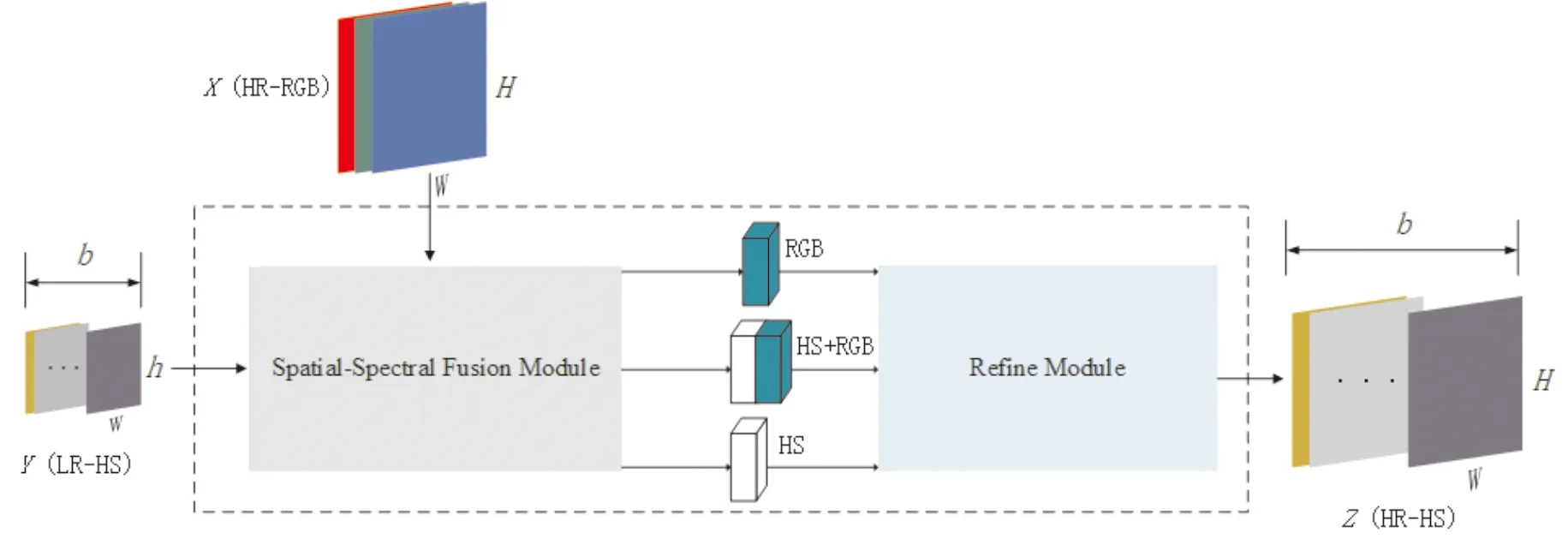

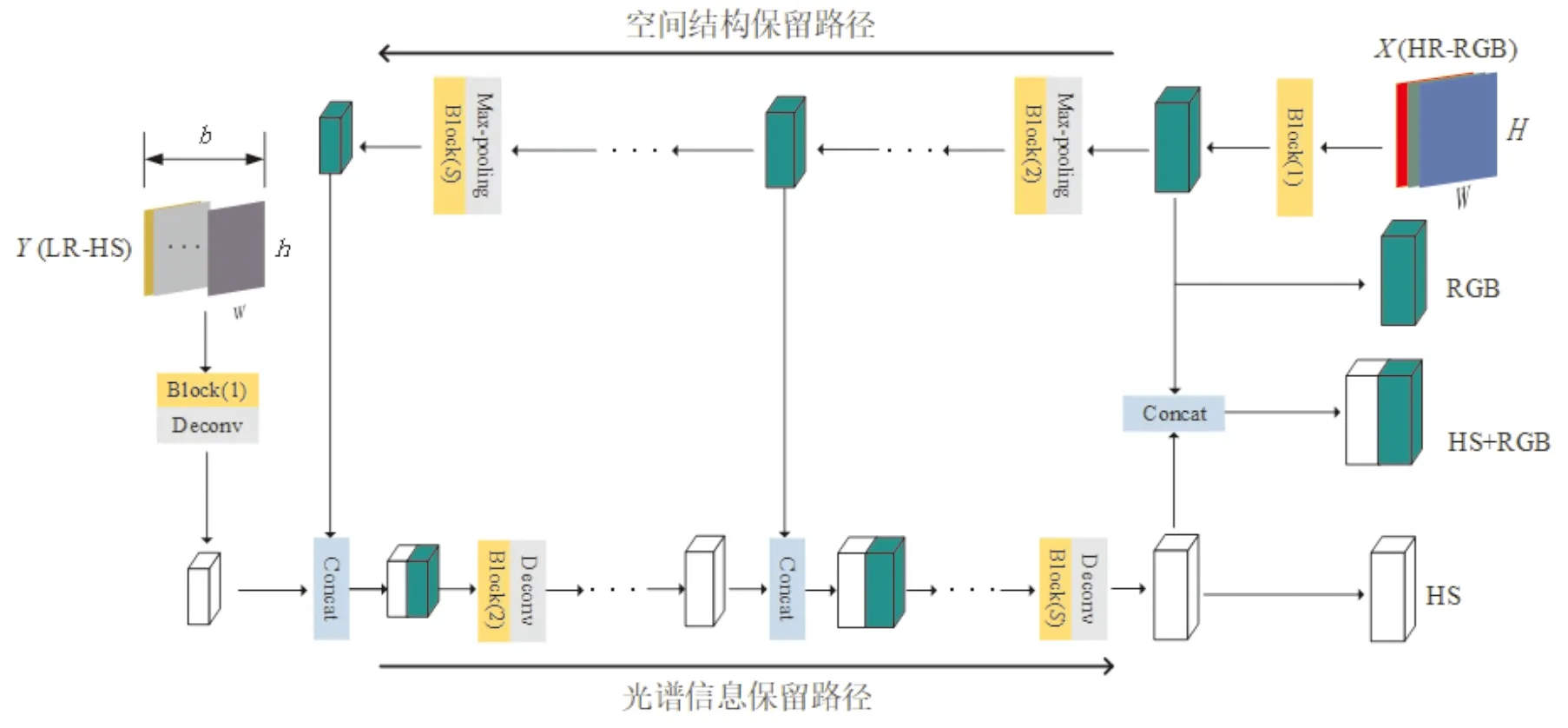

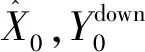

如图3所示,本文提出了一个由空间光谱融合模块和细化模块组成的多尺度多支路融合网络,将(X,Y)输入此网络中,通过空间光谱融合模块,得到RGB、RGB+HS以及HS 3个支路输出,再输入到细化模块进一步提高空间分辨率。

图3 多尺度多支路融合网络Fig.3 Multi-scale and multi-branch fusion network

2.2 空间光谱融合模块

由于观测到的HR-RGB和LR-HSI的空间结构差异很大,为了在保留HSI光谱信息的同时融入RGB的高空间分辨率结构,本文设计了一种多尺度的空间光谱融合模块。对HSI逐步上采样得到光谱相关特征,对RGB图像逐步下采样得到空间相关特征,然后,通过多尺度的方式动态融合光谱特征和空间特征,图4展示了空间光谱融合模块的结构。随着空间尺度因子2S的增加,网络分别在保留光谱和空间结构两条路径中设置S个卷积块。

在空间结构保留路径中:

(2)

(3)

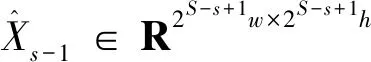

其中,Maxpools是第s个卷积层前的最大池化层,

s=2,3,…,S,Xs∈R2S-sw×2S-sh。

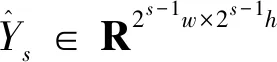

在光谱信息保留路径中

(4)

(5)

空间光谱融合模块主要采用了多尺度融合的方法:

(6)

通过堆栈形成光谱保留路径的第s+1个卷积块的输入Ys。两条路径中的每个卷积块均包含两层卷积层以及ReLU激活函数。

图4 空间光谱融合模块结构Fig.4 The architecture of spatial-spectral fusion module

2.3 细化模块

图5 细化模块Fig.5 The refine module

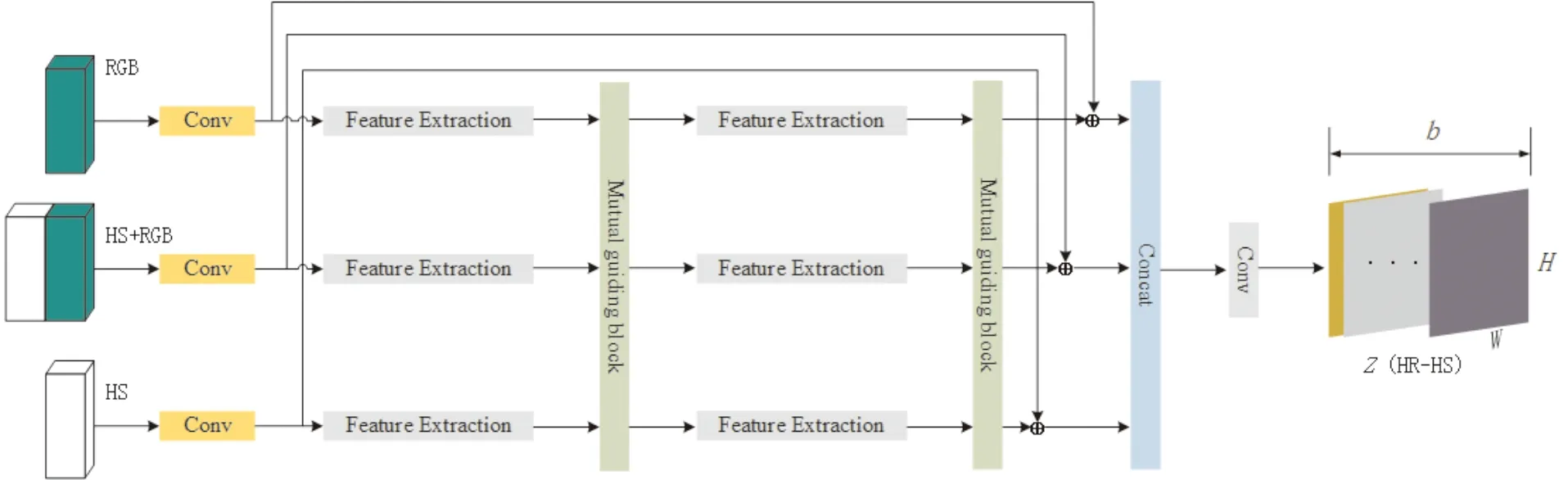

图6 互指导块Fig.6 Mutual-guiding block

Fx,Fy以及Fxy分别代表3个支路映射块的输出,以Fx为例,如式(7)所示,互指导块线性作用于Fx,

(7)

其中,⊙表示对应位置逐点相乘,A和B代表指导作用,通过图7所示的互指导块独立计算,

A=Pa([Fx;Fy;Fxy];πa),

B=Pb([Fx;Fy;Fxy];πb)。

(8)

其中,Pa(·;πa)和Pb(·;πb)分别代表A和B的指导块,[Fx;Fy;Fxy]表示3个特征的堆栈。同样地,在指导Fy和Fxy时,使用不同的串联[Fy;Fx;Fxy]和[Fxy;Fx;Fy],实现对3个输入的分别指导,从而实现对HSI空间结构的细化,输出HR-HSI。

2.4 空间光谱角指导损失函数

在训练网络过程中,本文从两方面进行约束,设计了一种空间光谱角指导损失函数,

(9)

Lspe为光谱角损失[9]:

(10)

3 实验

3.1 数据集

实验利用上文提出的面向文物RGB-高光谱图像采集技术制作数据集(以书画为例)。该数据集包含高光谱图像和同一场景下配准的RGB图像。其中,所有高光谱图像的光谱带数为204,空间尺寸为256×256像素,RGB图像空间尺寸为1 024×1 024像素。由于硬件设备限制,无法从已有的数据集中得到HR-HS图像,因此,实验遵循Wald协议[10]进行训练部分。在这种情况下,使用高斯内核对所有的原始图像过滤,并进行4倍的下采样处理,模拟LR-HSI,同时将原始的高光谱图像作为参考图像。

3.2 实验设置

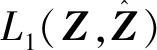

实验采用深度学习框架Pytorch实现多尺度多支路融合网络,训练过程在Nvidia GTX 3080GPU上进行。网络基于空间光谱角指导损失函数,使用随机梯度下降法进行优化,初始学习率为0.01,表1为参数列表。

3.3 性能指标

实验通过定量指标和视觉评估,对本文方法的性能进行分析。用于性能分析的指标如下:相关系数[11](CC)、峰值信噪比[12](PSNR)、谱角映射器[13](SAM)、均方根误差[14](RMSE)、综合无量纲相对全局误差[15](ERGAS)。其中,通过PSNR和CC评估目标和参考图像之间的相似性,CC的最优值为1,PSNR的指数越高,结果越好;SAM测量目标和参考图像谱向量之间的平均角度,ERGAS是基于RMSE的加权和,表示图像的保真度,这3个指标的最优值均为0,指数越低表明图像质量越高。

表1 训练网络模型使用参数表Tab.1 The parameter list of training network model

3.4 实验结果与分析

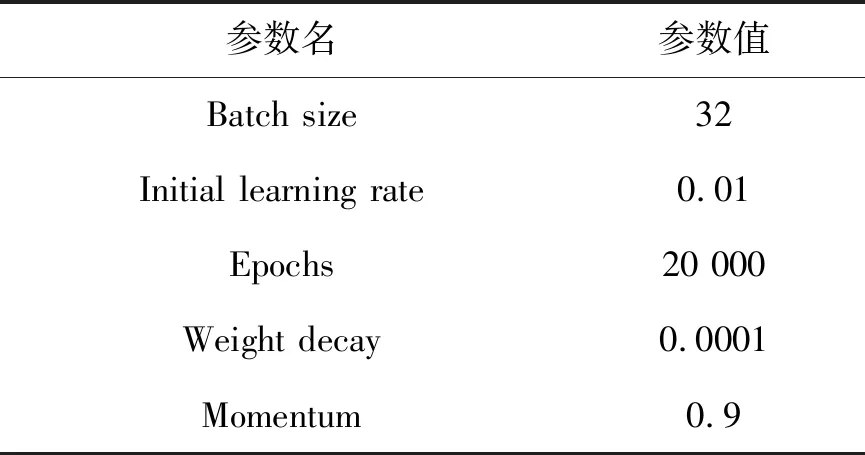

实验选用GFPCA[16]、Bayesian Naive[17]、CNMF[18]、MSSFCNN[19]4种方法作为对比,对本文方法的有效性进行了验证。同时,对比MSSFCNN+指导块,MSSFCNN+分组卷积以及本文方法,进行消融实验,进一步评估本文所提算法的优劣。

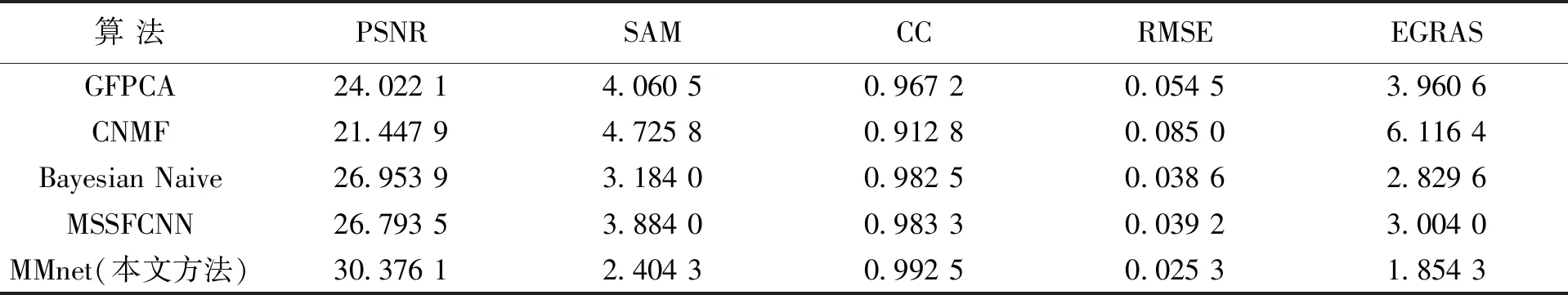

图7展示了GFPCA、Bayesian Naive、CNMF、MSSFCNN以及本文方法MMnet的实验结果比较。可以明显看出,图7C、7E和7F均有不同程度的伪影出现。同时,当进行高光谱图像超分辨率时,光谱保真度是至关重要的,图7D虽然展示了清晰的空间细节信息,但是却引入了光谱畸变,尤其是右上角部分。

为了证明本文方法提供的光谱保真效果,实验随机选取并绘制了融合前后两处样本的光谱曲线,如图8所示,红色为融合前光谱曲线,蓝色为融合后光谱曲线,可以看出,两条光谱曲线几乎重合,这也应征了融合前后光谱几乎没有发生变化。

为了进一步探究这几种方法的性能,我们使用客观指标对实验结果进行了评估。表2展现了对比方法和本文方法的指标评价结果,由对比实验结果发现,使用本文提出的基于多尺度多支路的RGB和高光谱图像融合方法得到的融合结果,既能提升LR-HSI的空间分辨率,又具有较好的光谱保真度。无论是在视觉效果,还是客观指标结果,本文方法都展现了最佳的性能。

图7 不同方法对比的视觉效果图Fig.7 Visual renderings of different methods of comparison

图8 融合结果(Result)和参考图像(LRHS)的光谱曲线Fig.8 The spectral curves of the fusion Result(Result)and the reference image(LRHS)

3.5 消融实验

现有基于深度学习的高光谱图像超分辨率网络均具有复杂的体系结构,通常具有数百万个参数,而分组卷积可以在不改变卷积次数的情况下,利用不同的卷积核,降低参数量的同时使网络学习到更多的空间细节[20]。高光谱图像波段多,冗余度较高,采用分组卷积将波段分块,从而降低冗余信息对网络学习的影响,提高该网络的性能。为了更好地验证互指导模块和分组卷积在本文方法中的有效性,实验增加了模块消融部分。将MSSFCNN作为基准网络结构,在其基础上添加本文使用的分组卷积作为MMnet-1,将MSSFCNN+互指导模块作为MMnet-2,MSSFCNN+分组卷积+互指导模块的组合即为本文提出的方法MMnet。图9展示了这4种方法的实验结果。从图9D中可以看出,在MSSFCNN中只分组卷积后的结果在空间结构上出现了模糊的情况,其空间分辨率和图9C相比明显降低,由此说明分组卷积降低了MSSFCNN实验结果精度;图9E的空间结构比图9C更清晰,说明了互指导模块的有效性。

为了更加准确地评估实验结果,表3展示了消融实验的客观指标评价。从表3中可以看出,MMnet-1各项指标效果相比于MSSFCNN均有所下降,然而,MMnet-2的各项结果是除了本文方法以外最优的。由此,视觉效果和客观指标评价均可以证明本文方法中互指导模块和分组卷积的有效性。

表2 几种方法的指标评价结果Tab.2 Evaluation index results of several methods

图9 消融实验结果的视觉效果图Fig.9 A visual rendering of the results of the ablation experiment

表3 消融实验结果的指标评价Tab.3 Evaluation index of ablation test results

4 结语

本文面向文物高光谱数字化采集需求,从器材选择、现场布置、操作过程3个方面设计了一套高光谱数据采集流程。并针对高光谱空间分辨率不足的问题,提出了一种基于多尺度多支路的RGB和高光谱图像融合方法,该方法由空间光谱融合模块和细化模块两部分组成。首先,将RGB的空间细节和HSI的光谱信息进行融合,输出RGB、RGB+HS以及HS多支路特征;然后,进一步细化,在支路特征之间相互指导,重建具有高空间分辨率的高光谱图像,同时,利用光谱角损失函数保证融合前后的光谱一致性,减少光谱畸变。实验结果证明,本文提出的MMnet方法无论在视觉效果还是客观评价指标上,在空间分辨率和光谱保真度方面均有较好的效果。