无人机多角度成像方式的饲料油菜生物量估算研究

张 建 谢田晋 尉晓楠 王宗铠 刘崇涛 周广生 汪 波,*

研究简报

无人机多角度成像方式的饲料油菜生物量估算研究

张 建1谢田晋1尉晓楠1王宗铠2刘崇涛2周广生2汪 波2,*

1华中农业大学资源与环境学院 / 宏观农业研究院, 湖北武汉 430070;2华中农业大学植物科学技术学院/ 农业农村部长江中游作物生理生态与耕作重点实验室, 湖北武汉 430070

旨在探索并评估一种通过无人机平台搭载可见光相机提取饲料油菜生物量的新方法。试验于2018年在华中农业大学油菜试验基地展开, 利用无人机搭载五相机倾斜摄影系统同时从多个角度获取油菜终花期的可见光图像, 试验共设置3种无人机飞行高度(40、60和80 m)和3种播种密度(3.00×105、5.25×105和7.50×105株hm-2), 并评估和对比了多角度和单相机垂直2种成像方式的生物量预测结果。试验首先通过无人机图像提取油菜冠层覆盖度和株高信息; 然后通过株高在覆盖面积上进行累加获得作物体积模型; 最后基于作物体积模型与实测生物量建立线性回归模型预测油菜干物质重量。结果表明, (1)在本试验设置的3个飞行高度中, 随着无人机飞行高度下降, 生物量预测精度呈上升趋势, 其中飞行高度为40 m时, 油菜生物量估算精度最佳(校正集:= 0.792, RMSE = 125.0 g m-2, RE = 13.2%; 验证集:= 0.752, RMSE = 139.1 g m-2, RE = 15.3%)。(2) 种植密度越高, 其实际生物量越小, 通过作物体积模型预测生物量的效果更好。(3) 多角度成像方式与单相机垂直成像方式在油菜生物量估测精度上没有显著差异, 两者皆在40 m高度下具有最好的生物量预测效果, 相关系数分别为0.772和0.742。以上结果表明, 基于无人机低成本可见光成像建模技术提取饲料油菜生物量是可行的, 本研究可为大田作物地上生物量信息的无损高效监测提供易于实施的解决方案和技术参考。

无人机; 生物量; 倾斜摄影; 作物体积模型; 饲料油菜

作物地上部生物量是重要的农艺性状, 其定义为单位面积内地上有机物质的总量[1], 在农业生产中, 高效、准确地估算生物量是监测作物生长状况和加强特定农艺措施(施肥、除草和收获等)决策支持系统的先决条件[1-2]。其中干物质重量是作物光合作用的产物, 与作物产量密切相关[3]。

传统的人工有损采样方式获取生物量需要大量实地调查, 效率低下且数据精度受主观因素影响较大[4]。随着低空遥感技术快速发展, 无人机(unmanned aerial vehicle, UAV)结合高分辨率数码相机由于其低成本、高灵活性和高空间分辨率等优点, 已广泛应用于作物表型信息的采集[5-7]。杨俊等[8]利用无人机数码影像计算可见光植被指数估算小麦生物量表明, 生物量与光谱指数的相关性均达到极显著水平, 其中绿红差值指数精度最高, 其相关系数为0.911。然而, 由于光谱指数对作物生长后期的变化不敏感, 导致其对生物量预测的误差增加[9]。株高作为一种容易测量且重要的农艺形态指标, 可以通过无人机获取可见光图像基于SfM (structure from motion)算法建立作物表面模型(crop surface model, CSM)得到, 常用于作物生物量、产量等性状的估测[10-11]。陶惠林等[12]通过无人机获取CSM提取冬小麦株高, 结合可见光植被指数构建回归模型估算冬小麦生物量, 与仅用植被指数预测生物量结果相比, 融入株高性状构建的模型预测效果更好, 其2= 0.819, RMSE = 0.110 kg m-2。由于作物生物量具有复杂的三维结构, 仅通过作物株高或冠层覆盖度等单个二维冠层特征无法准确地描述。因此, 目前一些研究证明通过激光雷达或者摄影测量技术构建作物三维立体模型可以提取高精度的生物量信息[13-14]。Greaves等[15]通过地面激光雷达获取点云数据探索了2种生物量预测方式, 分别为VSD法(volumetric surface differencing)和VC法(voxel counting), 其2分别为0.92和0.94。VSD法对作物覆盖区域的CSM进行三维空间积分得到作物体积。VC法通过统计单位体素的总和估算生物量, 该方法要求数据能够获取更详尽的作物内部结构信息, 其精度稍高于VSD法。然而, 由于激光雷达技术成本较高, 后期数据处理量较大, 限制了其在作物表型信息监测中的应用[16-17]。无人机平台搭载的可见光相机虽穿透能力有限, 难以构建基于体素的三维立体模型[18], 但是通过CSM数据建立作物三维模型直接提取地上群体生物量, 可获得较单一光谱和株高特征反演方法更加准确和稳定的预测结果。

基于无人机平台的倾斜摄影测量作为一个新兴的技术方法, 已广泛应用于建筑物、树木等地理实体的三维建模[19]。传统方法通过垂直角度获取的影像数据只包含地物顶部的信息特征, 缺乏详细的侧面纹理信息。而且, 通过影像进行建筑物的三维重建, 易产生墙面倾斜、屋顶位移等问题, 不利于后续的几何校正等处理[20]。倾斜摄影技术使用无人机平台搭载多台传感器, 同时从垂直、倾斜等不同角度采集图像, 通过几何校正、多视影像匹配等处理可以获得地物准确的长度、高度和面积信息[21]。而且, 相较于传统的垂直成像方式, 倾斜成像方式获得的可见光图像可以产生更多的点云数量, 可以为三维重建、纹理映射等工作提供更丰富的信息[22-23]。然而倾斜摄影测量技术很少应用于农业中作物表型信息的提取, 因此本研究采用自主集成的五相机倾斜摄影测量无人机成像平台从多个角度同时获取饲料油菜终花期的可见光图像, 比较与评估倾斜摄影与普通垂直摄影2种方式对生物量预测的差异。通过建立油菜体积模型, 与实测生物量建立回归模型估算作物生物量。本研究比较3种飞行高度(40、60和80 m)和3种油菜播种密度(3.00×105、5.25×105和7.50×105株hm-2)条件下油菜生物量干重的预测效果, 探寻在大田环境下高效无损的作物地上生物量估算方法及相应数据采集模式。

1 材料与方法

1.1 试验区概况

湖北省武汉市华中农业大学油菜试验基地(30°28′8″N, 114°21′18″E)属于亚热带风性湿润气候区。试验田选用37个饲料油菜品种(系), 设置3.00×105(密度1)、5.25×105(密度2)和7.50×105株 hm-2(密度3) 3个种植密度, 其中3.00×105株 hm-2为常规种植密度, 后两种为高密度种植方式。重复3次, 共333个小区, 每个小区面积为6 m2(2 m × 3 m), 具体试验区布置见图1-A和B。为精确获取试验田的CSM数据, 试验区均匀布置了13个地面控制点(ground control point, GCP), 利用合众思壮科技有限公司的GNSS RTK (global navigation satellite system real-time kinematic)获取其三维空间位置, 该仪器在水平方向的精度为±1.0 cm, 垂直方向精度为±2.0 cm。

A: 试验区布置; B: 小区面积和采样区域; C: 五相机倾斜摄影系统。

A: layout of experimental areas; B: plots and sampling areas; C: oblique photography system with five cameras.

1.2 多角度成像平台及无人机数据预处理

于2018年4月3日11:00—13:00采集图像数据, 试验期间天气晴朗无风, 光照稳定。成像系统的搭载平台为大疆六轴飞行器M600 (大疆创新科技有限公司, 中国), 其最大载重为6 kg, 续航时间为16 min。无人机平台搭载由5台Sony ILCE-QX1相机(日本索尼株式会社)组成的多相机倾斜摄影系统, 可同时从1个垂直方向和4个倾斜方向采集图像数据, 倾斜角度设置为15º (图1-C)。试验设置20、40、60和80 m 4个不同高度的飞行任务。由于无人机在飞行高度为20 m时收集的油菜终花期图像之间纹理特征相似, 且较低的飞行高度形成的风场会对油菜冠层产生较大的扰动, 均会对特征提取与匹配产生影响, 从而无法完成图像拼接过程, 因此试验后续只分析了40、60和80 m 3个种飞行高度获取的图像数据。飞行期间5台相机同步触发拍照, 依据高度设置拍照时间间隔为1~2 s, 飞行航向重叠度为85%, 旁向重叠度为70%。试验获取的可见光图像以24位JPG格式存储, 有效像元个数为2010万(像素5456 × 3632)。

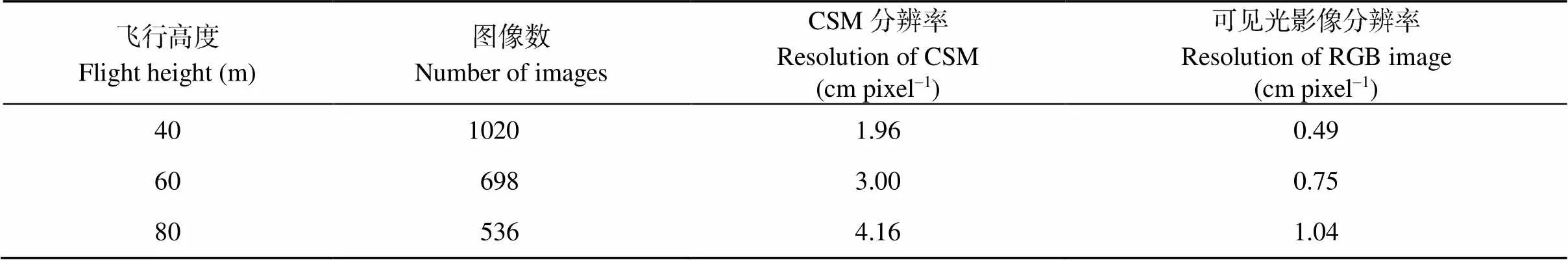

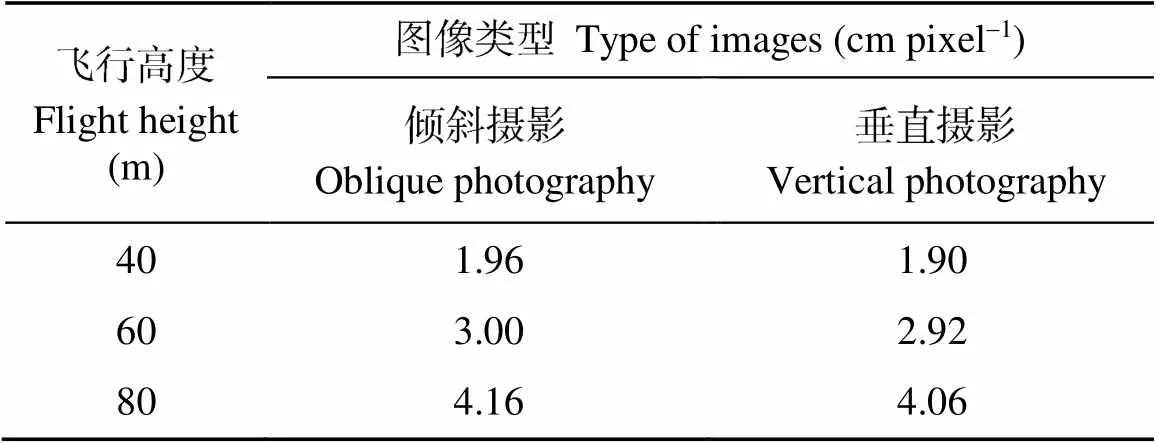

采用Agisoft PhotoScan Professional 1.4.3软件拼接生成可见光影像和CSM影像。该过程首先通过倾斜摄影系统获取的图像与对应的POS数据生成稀疏点云, 其中POS数据表征图像获取时刻的空间位置和姿态信息。然后, 导入13个GCP的坐标进行几何校正构建密集点云, 最后生成不同飞行高度下的可见光影像和CSM影像, 其具体信息见表1。

1.3 农学参数测定

试验于2018年4月10日(油菜终花期)选择油菜田的111个小区测量其油菜地上部生物量。试验首先放置1个1 m2的正方形铁框于各个小区中, 通过采挖法收获铁框内的油菜, 然后将油菜洗净后置于烘箱中105℃杀青30 min, 并在80℃条件下烘干至恒重, 称量获得油菜干物质重量。具体油菜的生物量统计信息见表2。

表1 3个飞行高度下的CSM和可见光影像信息

表2 油菜生物量统计特征值

密度1: 3.00×105株 hm-2; 密度2: 5.25×105株hm-2; 密度3: 7.50×105株hm-2。

Density 1: 3.00×105plant hm-2; density 2: 5.25×105plant hm-2; density 3: 7.50×105plant hm-2.

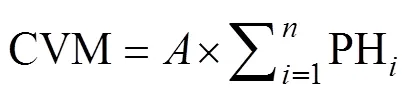

1.4 基于VSD法的油菜生物量模型建立及验证

VSD方法通过将结构化的点云数据转为立方体构建植物三维轮廓, 能够准确提取株高、生物量等作物性状[15]。本试验基于VSD方法提取油菜地上部生物量, 其具体步骤如图2所示。通过CSM影像与裸土高程的差值获取作物株高, 其中裸土高程为试验区周围水泥土地高程的均值。然后, 基于可见光图像的绿波段和红波段计算归一化植被指数(normalized difference index, NDI)[24], 并通过Otsu阈值算法[25]自动选取阈值对NDI图像进行分割, 提取绿色油菜区域。最后将试验小区内绿色油菜像元上的株高进行累加, 计算株高总和与单位像元面积的乘积, 得到作物体积模型(crop volume model, CVM), 具体公式如下:

式中,为绿色油菜像元总数,为单位像元的面积, PH为第个像元上的作物高度。

为估算油菜生物量, 本研究建立了作物体积模型与实测生物量间的线性回归模型。研究将采集的111个地面生物量数据按4∶1的比例随机划分为校正集和验证集。采用相关系数、均方根误差(root mean square error, RMSE)和相对误差(relative error, RE)评估模型的预测精度。其中越大说明模型拟合越好, RMSE和RE越小说明模型精度越高。

2 结果与分析

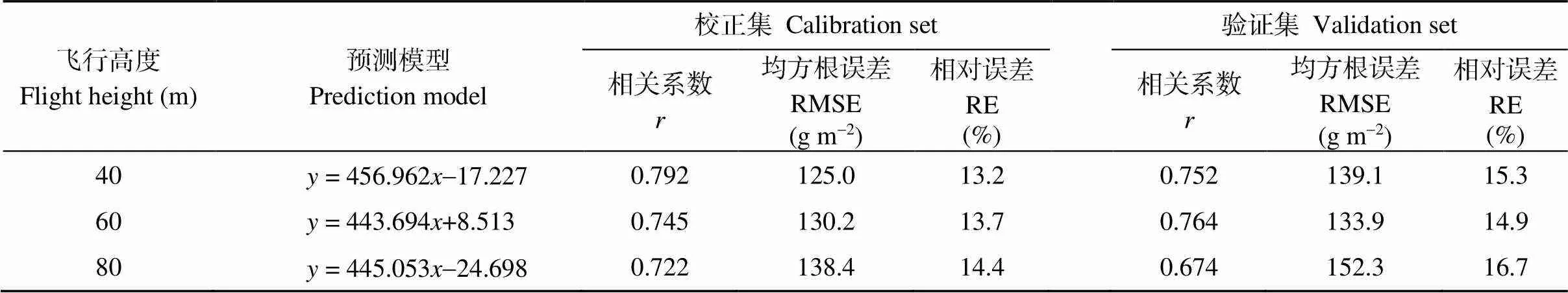

2.1 不同飞行高度下油菜生物量提取结果

本研究比较了3种飞行高度下(40、60和80 m)无人机多角度倾斜图像基于VSD方法建立油菜生物量预测模型。由表3可知, 随着成像高度的增加, 生物量预测精度逐渐下降。在本研究中, 飞行高度为40 m时, 生物量具有最佳的估算结果(= 0.792, RMSE = 125.0 g m-2, RE = 13.2%)。主要原因为: 随着飞行高度上升, 而摄影基线不变, 导致基高比减小, 图像分辨率降低, 影响冠层结构细节信息的获取和建模。此外, 干物质重量经杀青、烘干处理, 其体积与自然状态下相差较大, 会对模型精度产生一定影响。总体上, 不同高度生物量估算结果的均大于0.7, RMSE和RE分别在140 g m-2和15%以下, 说明VSD方法可以较好地预测油菜生物量。模型验证集与校正集结果的相差在0.05以内, RMSE和RE分别保持在20 g m-2和3%以内, 表明回归模型具有较好的稳定性。

A: 作物冠层高度获取; B: 作物冠层覆盖面积获取; C: 体积模型获取; XY: 作物冠层覆盖面积; Z: 作物冠层高度。

A: the acquisition of crop canopy height; B: the acquisition of crop canopy coverage area; C: the acquisition of volume model; XY: the area of crop canopy; Z: the height of crop canopy.

表3 3种飞行高度下的生物量提取结果

表示作物体积模型,表示预测的生物量。

represents crop volume model andrepresents the predicted biomass.: correlation coefficient; RMSE: root mean square error; RE: relative error.

2.2 3种种植密度下油菜生物量提取结果

不同种植密度会使作物冠层结构产生差异, 试验比较了3种不同种植密度下的油菜生物量预测精度。本试验中, 密度1具有最小的种植密度, 但是其油菜干物质重量比密度2和密度3更高(表2)。主要由于高密度种植会引起群体光照不足, 叶片光合速率降低, 造成干物质重量下降[26]。比较3种种植密度下的生物量预测结果表明(图3), 密度2和密度3的生物量估算结果接近, 在飞行高度为40 m时预测精度最好, 2种密度下均超过0.8, RMSE在120 g m-2以下。生物量预测模型在密度1时精度最差, 尤其在飞行高度为80 m时, 精度下降幅度较大,仅为0.57。密度1在3种飞行高度下的绝对误差RMSE均在124 g m-2以上, 而密度2和密度3的RMSE均保持在124 g m-2以下。

: 相关系数; RMSE: 均方根误差; RE: 相对误差; D1: 3.00×105株 hm-2; D2: 5.25×105株hm-2; D3: 7.50×105株hm-2。

: correlation coefficient; RMSE: root mean square error; RE: relative error; D1: 3.00×105plant hm-2; D2: 5.25×105plant hm-2; D3: 7.50×105plant hm-2.

2.3 多角度倾斜与单相机垂直成像2种方式估算生物量结果的比较

为比较本试验自主集成的五相机倾斜摄影系统与普通垂视摄影的地上生物量预测精度, 试验挑选了五相机中垂视相机获取的图像, 使用VSD方法计算油菜生物量。表4统计了五相机倾斜摄影系统和单相机垂直摄影获取的CSM图像空间分辨率, 其中五相机获取的CSM数据图像分辨率略低一些。通过比较2种方式下生物量的估算精度(图4), 倾斜摄影系统的生物量预测效果与垂直摄影接近, 相同飞行高度下, 两者的相关系数差距小于0.03, RMSE在11 g m-2以内, RE在2.2%以内。在飞行高度为40 m和80 m时, 倾斜摄影系统的生物量预测结果的相关系数稍高于垂直摄影, 但是垂直摄影的绝对误差和相对误差更小。而在飞行高度为60 m时, 单相机垂直摄影预测的生物量与实测值相关性更高。说明, 试验采用的五相机倾斜摄影系统相对于单个垂视相机在油菜生物量获取上并没有显著优势。

3 讨论

3.1 无完整土壤基底条件下的油菜生物量估算

本研究基于VSD方法获取油菜生物量信息, 该算法通过株高在指定面积上的累加获得作物体积模型。一般通过CSM与土壤基底的差值得到作物株高, 其中完整的土壤基底数据获取需要在作物出苗前或者收获后进行一次额外的无人机飞行任务[27], 通过该方法获得的作物株高一般具有更高的精度, 同时会增加数据获取环节的人力及时间成本。因此, 在进行作物株高和生物量等性状的提取时, 许多研究选择通过提取CSM中作物间的裸露土壤高程再进行差值得到基底数据[28-29]。而本试验中油菜已处于生长后期(终花期), 冠层叶片已经完全封垄, 难以从图像中提取足够多的裸土构建基底面, 因此采用试验区域边界的水泥地等稳定区域的高程作为基底数据。虽然缺少了播种时的田间地形基底信息, 但是该模式更加适合农业生产监测的实际情况, 在获取较好的生物量预测结果的同时, 能够降低生产成本。

表4 五相机倾斜摄影系统图像与单个垂视相机CSM的分辨率

CVM = 作物体积模型; 40 m: 无人机飞行高度为40 m; 60 m: 无人机飞行高度为60 m; 80 m: 无人机飞行高度为80 m。缩写同图3。

CVM = Crop Volume Model; 40 m: the flight height was 40 meters; 60 m: the flight height was 60 meters; 80 m: the flight height was 80 meters. Abbreviations are the same as those given in Fig. 3.

3.2 多角度倾斜与单相机垂直成像2种方式估算生物量的比较

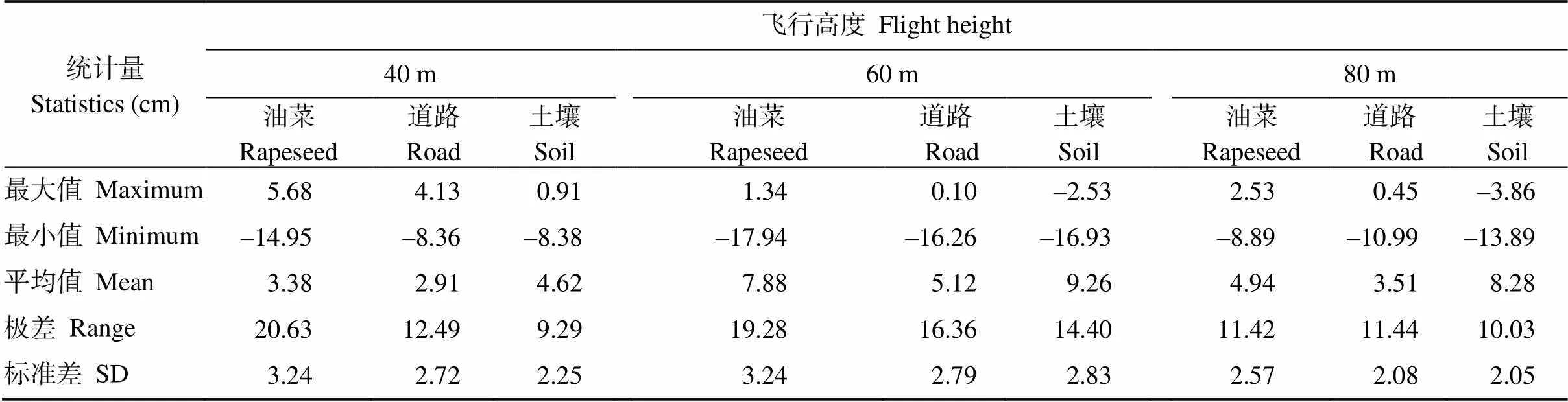

近年来, 倾斜摄影在遥感领域发展迅速, 成为地理信息采集与三维模型构建的重要手段[30]。无人机搭载4个倾斜相机和1个垂直相机可以同时采集目标区域前、后、左、右和顶部5个角度的二维相片, 可以为三维重建、纹理映射等工作提供更丰富的信息。但本研究使用倾斜和垂视摄影技术估算生物量的结果并没有显著差异。在覆盖度相同的条件下, 基于2种成像方式估算生物量的差异主要由作物株高估算的结果决定, 因此, 本研究比较了2种成像方式基于不同粗糙度地物在株高测量上的差异性。表5通过计算了3种不同飞行高度下垂直和倾斜摄影方式生成的CSM图像的差值(CSMdif), 比较3种不同粗糙度的地物(油菜、道路和土壤)在2种方式下的高度获取差异。试验分别于油菜、道路和土壤区域中产生500个随机点, 提取其在CSMdif中的数值, 然后计算3种地物下500个随机点的描述性统计量。由表5可知, 倾斜和垂直2种成像方式获取不同地物的高度差异的均值皆在10 cm以内, 而油菜冠层CSMdif的标准差在3种飞行高度下都是最大的。表明, 五相机倾斜摄影与单个垂视相机获取的CSM图像差异较小, 但与平坦的地物(道路和土壤)相比, 2种方式获取的株高仍可以在粗糙的地物中(油菜)产生相对更大的差异。

表5 五相机倾斜摄影系统与单个垂视相机获取的CSM的差异比较

平均值是基于所有数据的绝对值计算。

The mean values were calculated based on the absolute value of all data.

对于2种成像方式估算生物量差异较小的主要原因有2个: 第一, 当无人机平台飞行高度固定, 普通的垂直摄影获取的图像分辨率几乎一致。然而倾斜影像像点的分辨率沿摄影方向衰减, 不同视角获取的图像几何变形大, 在图像拼接时获取同名点的可靠性低[31]。而且, 倾斜相机较垂直相机的物距更长, 成像距离更大。在使用Agisoft Photoscan软件进行图像拼接时, 倾斜摄影组的图像获取高度是所有输入图像的地面高度均值, 导致图像分辨率更低(表4)。第二, 多角度倾斜摄影技术改变了传统航测遥感影像只能从垂直方向拍摄的局限性, 它可以捕捉地面物体更多的侧面形态信息[32], 但是无人机摄影测量方式以构建作物冠层形态为主, 在作物封行后, 倾斜摄影获取的作物侧面信息只占据建模对象的小部分。而且, 田间实际取样和VSD算法获取生物量的区域一般集中在作物群体的中心区域(图1-B), 该部分作物的真实侧面信息难以获取。同时在农业生产中, 农户为了加强对杂草的抑制, 通常会提高种植密度, 导致种植间隔变窄[28], 都限制了多角度倾斜摄影测量的优势。因此, 对于大田密植型作物的表型性状获取, 传统的正射摄影测量即可以获取较好的结果, 同时对于具备不同冠层结构特点的作物地上生物量也值得进一步研究。

[1] Zhu W, Sun Z, Peng J, Huang Y, Li J, Zhang J, Yang B, Liao X. Estimating maize above-ground biomass using 3D point clouds of multi-source unmanned aerial vehicle data at multi-spatial scales., 2019, 11: 2678.

[2] Yang G, Liu J, Zhao C, Li Z, Huang Y, Yu H, Xu B, Yang X, Zhu D, Zhang X. Unmanned aerial vehicle remote sensing for field-based crop phenotyping: current status and perspectives., 2017, 8: 1111.

[3] 任廷波, 赵继献. 施氮量对黄籽双低杂交油菜干物质积累的影响. 山地农业生物学报, 2007, 26(2): 99–104.

Ren T B, Zhao J X. Effects of different amount of applied nitrogen on dry matter accumulation of yellow seed with double low hybrid rape.,2007, 26(2): 99–104 (in Chinese with English abstract).

[4] Li B, Xu X, Zhang L, Han J, Bian C, Li G, Liu J, Jin L. Above-ground biomass estimation and yield prediction in potato by using UAV-based RGB and hyperspectral imaging., 2020, 162: 161–172.

[5] 赵必权, 丁幼春, 蔡晓斌, 谢静, 廖庆喜, 张建. 基于低空无人机遥感技术的油菜机械直播苗期株数识别. 农业工程学报, 2017, 33(19): 115–123.

Zhao B Q, Ding Y C, Cai X B, Xie J, Liao Q X, Zhang J. Seedlings number identification of rape planter based on low altitude unmanned aerial vehicles remote sensing technology., 2017, 33(19): 115–123 (in Chinese with English abstract).

[6] 杨琦, 叶豪, 黄凯, 查元源, 史良胜. 利用无人机影像构建作物表面模型估测甘蔗LAI. 农业工程学报, 2017, 33(8): 104–111.

Yang Q, Ye H, Huang K, Zha Y Y, Shi L S. Estimation of leaf area index of sugarcane using crop surface model based on UAV image., 2017, 33(8): 104–111 (in Chinese with English abstract).

[7] Zhang J, Xie T, Yang C, Song H, Jiang Z, Zhou G, Zhang D, Feng H, Xie J. Segmenting purple rapeseed leaves in the field from UAV rgb imagery using deep learning as an auxiliary means for nitrogen stress detection., 2020, 12: 1403.

[8] 杨俊, 丁峰, 陈晨, 刘涛, 孙成明, 丁大伟, 霍中洋.小麦生物量及产量与无人机图像特征参数的相关性. 农业工程学报, 2019, 35(23): 104–110.

Yang J, Ding F, Chen C, Liu T, Sun C M, Ding D W, Huo Z Y. Study on correlation of wheat biomass and yield with UAV image characteristic parameters., 2019, 35(23): 104–110 (in Chinese with English abstract).

[9] Payero J, Neale C, Wright J. Comparison of eleven vegetation indices for estimating plant height of alfalfa and grass., 2004, 20: 385.

[10] Song Y, Wang J. Winter wheat canopy height extraction from UAV-based point cloud data with a moving cuboid filter., 2019, 11: 1239.

[11] 刘治开, 牛亚晓, 王毅, 韩文霆. 基于无人机可见光遥感的冬小麦株高估算. 麦类作物学报, 2019, 39: 859–866.

Liu Z K, Niu Y X, Wang Y, Han W T. Estimation of plant height of winter wheat based on UAV visible image., 2019, 39: 859–866 (in Chinese with English abstract).

[12] 陶惠林, 徐良骥, 冯海宽, 杨贵军, 杨小冬, 苗梦珂, 代阳. 基于无人机数码影像的冬小麦株高和生物量估算. 农业工程学报, 2019, 35(19): 107–116.

Tao H L, Xu L J, Feng H K, Yang G J, Yang X D, Miao M K, Dai Y. Estimation of plant height and biomass of winter wheat based on UAV digital image., 2019, 35(19): 107–116 (in Chinese with English abstract).

[13] Walter J D C, Edwards J, Mcdonald G, Kuchel H. Estimating biomass and canopy height with lidar for field crop breeding., 2019, 10: 1145.

[14] Wijesingha J, Moeckel T, Hensgen F, Wachendorf M. Evaluation of 3D point cloud-based models for the prediction of grassland biomass., 2019, 78: 352–359.

[15] Greaves H E, Vierling L A, Eitel J U H, Boelman N T, Magney T S, Prager C M, Griffin K L J. Estimating aboveground biomass and leaf area of low-stature Arctic shrubs with terrestrial LiDAR., 2015, 164: 26–35.

[16] Ballesteros R, Fernando O J, Hernandez D, Angel M M. Onion biomass monitoring using UAV-based RGB imaging., 2018, 19: 840–857.

[17] 牛庆林, 冯海宽, 杨贵军, 李长春, 杨浩, 徐波, 赵衍鑫. 基于无人机数码影像的玉米育种材料株高和 LAI 监测. 农业工程学报, 2018, 34(5): 73–82.

Niu Q L, Feng H K, Yang G J, Li C C, Yang H, Xu B, Zhao Y X. Monitoring plant height and leaf area index of maize breeding material based on UAV digital images., 2018, 34(5): 73–82 (in Chinese with English abstract).

[18] Maimaitijiang M, Sagan V, Sidike P, Maimaitiyiming M, Fritschi F B. Vegetation Index Weighted Canopy Volume Model (CVMVI ) for soybean biomass estimation from Unmanned Aerial System-based RGB imagery., 2019, 151: 27–41.

[19] 曹洪涛, 高伟, 张海峰, 张亮, 边延凯. 无人机倾斜摄影分辨率建模与分析. 地理空间信息, 2019, 17(1): 14–16.

Cao H T, Gao W, Zhang H F, Zhang L, Bian Y K. Resolution modeling and analysis of UAV oblique photography., 2019, 17(1): 14–16 (in Chinese with English abstract).

[20] 林卉, 王仁礼. 数字摄影测量学. 江苏: 中国矿业大学出版社, 2015. pp 300–303.

Lin H, Wang R L. Digital Photogrammetry. Jiangsu: China University of Mining and Technology Publishers, 2015. pp 300–303 (in Chinese).

[21] 王卿, 郭增长, 李豪, 孙鹏. 多角度倾斜摄影系统三维量测方法研究. 测绘工程, 2014, 23(3): 10–14.

Wang Q, Guo Z C, Li H, Sun P. Three-dimensional measurement of multi-angle tilt camera system., 2014, 23(3): 10–14 (in Chinese with English abstract).

[22] Cheng T, Lu N, Wang W, Zhang Q, Li D, Yao X, Tian Y, Zhu Y, Cao W, Baret F. Estimation of nitrogen nutrition status in winter wheat from unmanned aerial vehicle based multi-angular multispectral imagery., 2019, 10: 1601.

[23] Che Y, Wang Q, Xie Z, Zhou L, Li S, Hui F, Wang X, Li B, Ma Y. Estimation of maize plant height and leaf area index dynamic using unmanned aerial vehicle with oblique and nadir photography., 2020, 126: 765–773.

[24] Gitelson A A, Kaufman Y J, Stark R, Rundquist D. Novel algorithms for remote estimation of vegetation fraction., 2002, 80: 76–87.

[25] Otsu N. A threshold selection method from gray-level histograms., 2007, 9: 62–66.

[26] 朱丽丽, 周治国, 赵文青, 孟亚利, 陈兵林, 吕丰娟. 种植密度对棉籽生物量和脂肪与蛋白质含量的影响. 作物学报, 2010, 36: 2162–2169.

Zhu L L, Zhou Z G, Zhao W Q, Meng Y L, Chen B L, Lyu F J. Effects of plant densities on cottonseed biomass, fat and protein contents., 2010, 36: 2162–2169 (in Chinese with English abstract).

[27] Bendig J, Bolten A, Bennertz S, Broscheit J, Eichfuss S, Bareth G. Estimating biomass of barley using crop surface models (CSMs) derived from UAV-based RGB imaging., 2014, 6: 10395–10412.

[28] Li J, Shi Y, Veeranampalayam-Sivakumar A N, Schachtman D P. Elucidating sorghum biomass, nitrogen and chlorophyll contents with spectral and morphological traits derived from unmanned aircraft system., 2018, 9: 1406.

[29] Feng A, Zhang M, Sudduth K A, Vories E D, Zhou J. Cotton yield estimation from uav-based plant height., 2019, 62: 393–403.

[30] 杨国东, 王民水. 倾斜摄影测量技术应用及展望.测绘与空间地理信息, 2016, 39(1): 13–15.

Yang G D, Wang M S. The tilt photographic measuration technique and expectation., 2016, 39(1): 13–15 (in Chinese with English abstract).

[31] 魏祖帅, 李英成, 陈海燕, 朱祥娥, 刘晓龙. 倾斜多视影像空中三角测量的精度分析. 遥感信息, 2017, 32(4): 6–10.

Wei Z S, Li Y C, Chen H Y, Zhu X E, Liu X L. Precision of aerial triangulation for oblique multi-vision images., 2017, 32(4): 6–10 (in Chinese with English abstract).

[32] Youngerman C Z, Ditommaso A, Curran W S, Mirsky S B, Ryan M R. Corn density effect on interseeded cover crops, weeds, and grain yield., 2018, 110: 2478–2487.

Estimation of feed rapeseed biomass based on multi-angle oblique imaging technique of unmanned aerial vehicle

ZHANG Jian1, XIE Tian-Jin1, WEI Xiao-Nan1, WANG Zong-Kai2, LIU Chong-Tao2, ZHOU Guang-Sheng2, and WANG Bo2,*

1College of Resources and Environmental Sciences, Huazhong Agricultural University / Macro Agriculture Research Institute, Wuhan 430070, Hubei, China;2Key Laboratory of Crop Physiology, Ecology and Cultivation (The Middle Reaches of the Yangtze River), Ministry of Agriculture and Rural Affairs / College of Plant Science and Technology, Huazhong Agricultural University, Wuhan 430070, Hubei, China

To obtain above-ground biomass information quickly and accurately facilitating crop growth monitoring and yield prediction, this study was to evaluate a new method to extract the biomass of feed rapeseed based on UAV with visible-light cameras. The experiment was conducted at the rapeseed experimental base of Huazhong Agricultural University in 2018. To estimate above-ground biomass of rapeseed, a UAV (unmanned aerial vehicle) platform equipped with a five-camera oblique photography system was used to simultaneously obtain images of rapeseed during final flowering period from multiple angles. Three flight altitudes (40, 60, and 80 m) and three seeding densities (3.00×105, 5.25×105, and 7.50×105plant hm-2) were carried out to assess biomass predictions in a single-camera vertical imaging pattern. Firstly, the rapeseed canopy coverage and plant height information from the image of the UAV were extracted. Secondly, the volume model of rapeseed was obtained by the addition of plant height on the covering area. Finally, a linear regression model was established based on volume model and measured biomass to predict the dry weight of rapeseed. The results were as follows: (1) With the decrease of the flight height of the UAV of the three flight altitudes, the accuracy of biomass prediction was on the rise, and when the flight height was 40 meters, the accuracy of rapeseed biomass estimation was the best (calibration set:= 0.792, RMSE = 125.0 g m-2, RE = 13.2%; validation set:= 0.752, RMSE = 139.1 g m-2, RE = 15.3%). (2) When the planting density of rapeseed was higher, the actual biomass was smaller, and the prediction of biomass had a better result by volume model. (3) There was no significant difference in the accuracy of rapeseed biomass estimation between multi-angle imaging and single-camera vertical imaging, both of which had the best results at the flight height of 40 meters with correlation coefficientsof 0.772 and 0.742, respectively. This study indicated that it was feasible to obtain images for extracting rapeseed biomass by a UAV, which could provide the reference for efficient and accurate phenotypic information of field crops.

unmanned aerial vehicle; biomass; oblique photography; crop volume model; feed rapeseed

10.3724/SP.J.1006.2021.04211

本研究由国家重点研发计划项目“大田经济作物优质丰产的生理基础与调控” (2018YFD1000900)和湖北省技术创新专项重大项目(2017ABA064)资助。

This study was supported by the National Key Research and Development Program of China “Physiological Basis and Agronomic Management for High-quality and High-yield of Field Cash Crops” (2018YFD1000900) and the Major Special Projects of Technological Innovation of Hubei Province (2017ABA064).

汪波, E-mail: wangbo@mail.hzau.edu.cn

E-mail: jz@mail.hzau.edu.cn

2020-09-16;

2021-01-21;

2021-02-25.

URL: https://kns.cnki.net/kcms/detail/11.1809.S.20210225.1144.004.html