基于双边滤波与自编码器的对抗样本防御方法

王 成,李永忠

(江苏科技大学 计算机学院,江苏 镇江 212003)

0 引言

近年来,深度学习技术获得前所未有的发展,在图像分类[1]、无人驾驶、计算机视觉[2]和自然语言处理[3]等领域得到广泛应用,不断影响并改变着人们生活。然而,深度学习作为一个复杂的软件系统,因其本身的脆弱性引发诸多安全问题[4]。对抗样本攻击就是问题之一,因其可以直接攻击深度学习模型,直接导致模型以高置信度给出一个错误分类的结果,从而带来巨大的负面影响。因此,针对对抗样本攻击的防御技术受到国内外学者的广泛关注。

目前针对对抗样本攻击的防御方法包括:Dziugaite等[5]利用图像压缩方式,用压缩的JPG 图像减少扰动,从而保证分类的准确性,但该方法在压缩图像过程中会丢失很多原始图像边缘细节,导致原始图片也会出现分类错误的情况;Zantedeschi 等[6]提出高斯数据增强方法,通过在原始数据上添加高斯噪声并进行训练,进而训练出可识别噪声的网络模型,但对抗样本噪声会随着网络深度的增加而越来越强,随机添加的噪声却不存在这一特性,因此实际防御效果不太理想。

针对以上问题,本文结合双边滤波与卷积降噪自编码器理论建立一个对抗样本防御模型,首先通过双边滤波器的保边去噪特性[7-8]对加入对抗样本的图片进行初步去噪处理,同时保留图片的边缘纹理,然后通过卷积降噪自编码器进行特征提取[9],通过计算原始图像与还原图像之间的差距,得到最小化损失函数,从而还原原始图像信息。实验结果表明,在不影响原始数据分类的情况下,本方案对对抗样本有较好的防御效果。

1 相关理论

1.1 对抗样本

对抗样本是由Szegedy 等[10]提出的,是指在自然图片上人为添加经过精心设计的微小噪声而得到的图片。人眼在看对抗样本时可以正确识别其中的区别,但分类模型会以高置信度给出错误的结果。

对抗样本自提出以来已发展出多个研究方向,如从攻击结果上,可分为定向攻击和非定向攻击;从攻击内容上,可分为白盒攻击、灰盒攻击和黑盒攻击。对抗样本的攻击方式有很多种,如Goodfellow 等[11]提出基于梯度的攻击方法(Fast Gradient Sign Method,FGSM),只需单步迭代即可产生对抗样本;Papernot 等[12]使用l0范数方式限制扰动,仅更改原图像上极小的像素区域,即可产生有效的对抗样本;Yuan 等[13]利用黑产方式让违规照片绕过主流图片检测服务,更是将对抗样本技术从实验室研究引入网络对抗实战中。

本文选取Goodfellow 等[11]提出的FGSM(快速梯度法)生成对抗样本,假设图片原始图像数据为x,模型分类结果为y,在原始图像上添加肉眼难以识别的微弱扰动η,其数学公式为:

其中,ε为一个较小的常数,θ是网络参数,J(θ,x,y)是损失函数,将添加扰动后的图像数据值与权重值相乘,得到:

Goodfellow 等[11]指出,如果变化量与梯度方向一致,将会对分类结果产生较大影响。当x为n时,模型参数在每个维度的均值为m,每个维度变化量与梯度一致,最终输出效果为εnm。虽然η很小,但累加后的输出结果与原分类结果差别很大,将其作用在激活函数上,会有较大可能影响到分类结果。

1.2 双边滤波器

双边滤波是一种非线性滤波,其同时考虑图像空间域与值域的影响,并解决了高斯滤波存在的在突变像素边缘上边缘被模糊的问题。

求解最优双边滤波去噪后的图片N(x,y),也即求解原始图像I(i,j)在高斯距离权值ws(i,j)与高斯像素相似度权值wr(i,j)乘积作用下得到的最优结果。

在求解ws(i,j)与wr(i,j)时,需要分别考虑d与δ、ζ与c之间的空间距离差和像素差,以及σs与σr之间的相似度方差和空间方差。

进一步通过控制滤波的窗口范围Ω,对图片进行归一化处理:

从而计算出经过双边去噪器去噪后的输出图片:

1.3 卷积降噪自编码器

自编码器是一种典型的无监督网络模型,由编码器、隐含层、解码器组成,编码器将输入从高维转为低维,解码器再将数据从低维转为高维并输出,同时使用反向传播算法进行微调,这就是自编码器的数据压缩及特征提取过程。

研究人员在对自编码器进行研究的过程中,提出如降噪自编码器[14]、稀疏自编码器[15]、栈式自编码器等多个变种模型,本文采用的卷积降噪自编码器网络结合了卷积神经网络在图像处理以及自编码器在无监督学习中的优势,能够有效重构有损的输入数据。实现方案为将加噪后的图片作为输入送入编码器中,并进行卷积与池化操作,也即编码过程,然后通过反卷积与反池化操作对数据进行还原重构,也即解码过程。文献[16]对卷积降噪自编码器的卷积与池化过程、反卷积与反池化过程进行了详细介绍。

在卷积降噪自编码器中,假设加入噪声后的输入为x~,通过编码器h对数据进行降维处理,利用激活函数S(·)产生编码器第k个卷积核的输出:

解码器输出为:

其中,b1、b2与W1、W2分别为编码层和解码层的偏置及权重,为了使隐含层尽可能保留原始数据特征,其代价函数表示为:

2 基于双边滤波与卷积降噪自编码器的对抗样本防御技术

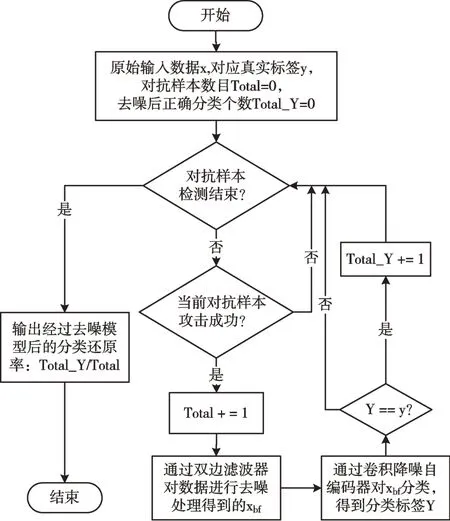

根据上述理论,本文提出基于双边滤波与卷积降噪自编码器的对抗样本防御技术,其基本思想为:在获取的数据集上添加对抗样本扰动,之后对扰动后的图片进行双边滤波保边去噪,实现数据预处理的目的,再将处理后的图片送入卷积自编码器中进行训练;通过反向传播,对比输出图片与原始图片的差距,计算损失函数,进行梯度下降迭代优化,更新参数权重;最后通过预训练模型对输出的图片进行分类,对防御效果进行直观展示。防御模型包括数据预处理、特征提取、模型分类3 部分。对抗样本防御流程如图1 所示。

Fig.1 Adversarial sample defense process图1 对抗样本防御流程

2.1 数据预处理模块

首先将图片数据集记载到模型中,将其转换为tensor数据类型并进行后续运算,然后在数据集中添加FGSM 对抗样本扰动,最后利用OpenCV 库文件自带的BilterFilter 函数对原始数据进行初步保边滤波,完成数据预处理过程。

2.2 特征提取模块

若将输入数据设为X={x1,x2,…,xn},定义好前向传播的网络参数,经过卷积降噪自编码器输出的数据为Z={z1,z2,…,zn},通过MSELoss 函数计算输出数据与输入数据间的差值,通过梯度下降法更新整个网络的权重参数。具体更新步骤如下:

Step3:根据上述步骤获得更新后的权重,进而使得代价函数J(W,b)尽可能小。

2.3 分类模块

基于前两部分内容的铺垫,最后利用卷积神经网络(CNN)作为分类器[17]。被对抗样本攻击成功的数据通过本模型后成功实现去噪,其去噪后标签值与原始值一致,则表明防御成功。对抗样本分类还原流程如图2 所示。

3 实验结果分析

3.1 实验数据预处理与参数设置

本实验采用经典的图像实验数据集MNIST(手写数字识别数据集),在实验过程中选取20%的训练集以及全部测试集进行测试验证,并训练一个结构如表1 所示的卷积神经网络作为被攻击的分类器,利用FGSM 攻击算法在训练集和测试集上添加无定向攻击扰动。

Fig.2 Adversarial sample classification and restoration process图2 对抗样本分类还原流程

Table 1 Convolutional neural network structure表1 卷积神经网络结构

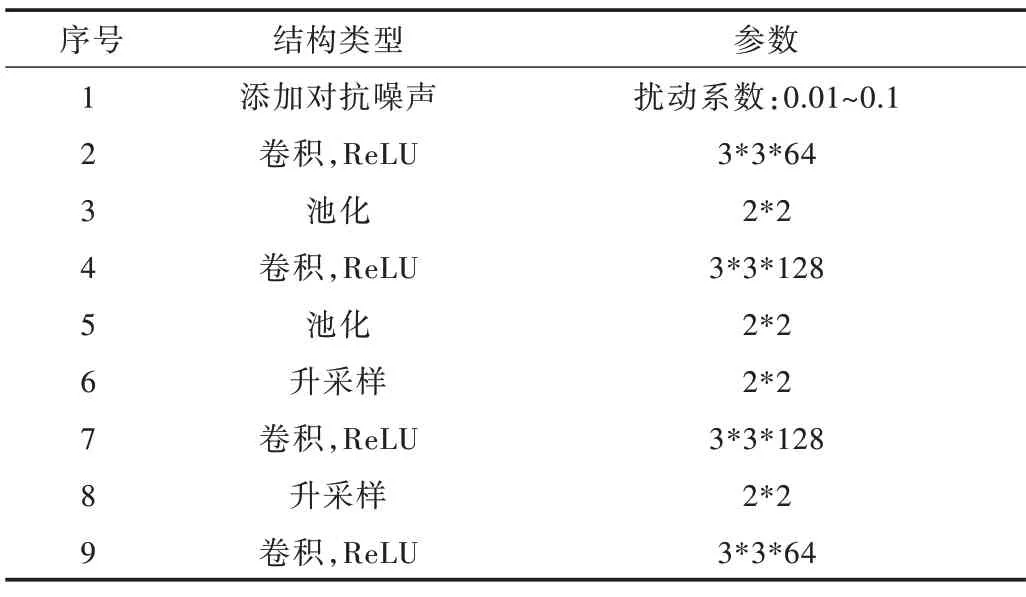

本文通过训练一个卷积降噪自编码器,以防御对抗样本攻击。参考文献[18]所述,本文将双边滤波器的颜色空间标准差值与坐标空间标准差值参数设置为20,从而进行图像保边滤波。卷积降噪自编码器结构如表2 所示。

Table 2 Convolutional noise reduction autoencoder structure表2 卷积降噪自编码器结构

3.2 实验环境配置

算法运行环境为:Python 3.6.4,16.04.1-Ubuntu SMP,硬件配置为:CPU 8 核,12G 内存,NVIDIA Tesla-K80 GPU。

3.3 实验评估指标

本文主要使用卷积降噪自编码器网络,在特征提取过程中,其重构数据与原始数据之间的均方误差结果如图3所示。由图可以看出,随着训练时间的增加,均方误差持续减小,表明本文使用的网络能够有效提取图像数据特征。

Fig.3 Mean square error between reconstructed data and original data图3 重构数据与原始数据之间的均方误差

由于本文处理的是多分类数据集,所以主要通过准确率(Accuracy,ACC)对防御指标进行评测。本文进行了以下两组实验,以验证该防御方法的有效性。

实验一:为保证原始图片经过滤波与自编码器后,分类结果不受影响,本文采用l2范数对输出图片进行约束,设置FGSM 攻击扰动系数为0.01。在MNIST 测试集上选取不同模型、处理方式,通过CNN 分类器进行分类的准确率对比如表3 所示。

Table 3 Comparison of classification accuracy of different models and processing methods表3 选取不同模型、处理方式的分类准确率对比

从表3 的结果来看,添加本模型后的原数据分类结果相比未添加模型的结果并没有发生太大改变,并且可以看到,在原数据上添加对抗样本扰动后,原分类准确率仅能达到10.81%,说明对抗样本对模型的影响是巨大的。通过本模型训练后,分类准确率直线上升到近乎未添加扰动的水平,证明了本模型具有较强的防御能力。

实验二:为了验证本文提出防御方法的有效性,将本文方法与其他学者提出的对抗样本防御方法的准确率进行比较,包括文献[19]提出的一种基于图像总方差最小化与图像拼接的对抗样本防御方法Image quilting、文献[20]提出的一种基于DCT 编码器与对抗训练的对抗样本防御方法DCT-AT,另外本文也将未添加任何防御方法的结果加入对比中。当设置抗扰动系数ε在0.01~0.1 之间时,本文方法BF-CDAE 与其他方法的分类准确率对比如图4 所示。

Fig.4 Comparison of classification accuracy of different defense methods图4 不同防御方法分类准确率对比

从图4 可以看出,本文提出的BF-CDAE 方法在不同的扰动值部分,分类准确率都高于其他防御方法,验证了本文方法的可行性。

4 结语

随着科技的进步,人工智能技术开始在人们生活中得到广泛应用,但因其内部工作机理十分复杂,使得其应用的安全性受到人们关注,对抗样本的存在更是敲响了人工智能安全方面的警钟。一些学者通过优化机制建立具有对抗鲁棒性的神经网络,而另一些研究者则通过设计去噪模块,过滤掉对抗性扰动以构建防御模型,从而达到相应的防御效果。

本文采用将双边滤波与卷积降噪自编码器相结合的方式,可更深层次地滤除加入图像的扰动,最大限度保证模型的鲁棒性与分类准确性,并通过两组实验验证了方案的可行性与有效性。后续将作进一步理论研究,将该模型运用到语音识别、恶意代码入侵检测等领域的对抗样本防御中。