基于改进ResNet网络的交通标志识别研究∗

郑秋梅 谭 丹 王风华

(中国石油大学(华东)计算机与通信工程学院 青岛 266580)

1 引言

交通标志是智能交通识别系统的重要组成部分,其中包含大量直观、有用的交通信息。交通标志识别既为驾驶员提供安全驾驶的环境,也为解决交通拥堵问题提供了一定的指导信息。

交通标志识别算法有很多种,基于LeNet-5、VGG等网络的卷积神经网络识别方法由于分类精度改善而被广泛采用[1~6]。但基于传统LeNet-5网络对交通标志进行识别,存在过拟合、梯度消失及分类识别精度不高等问题。汪贵平等[7]于2018年提出改进LeNet-5网络算法对交通标志识别,有效解决过拟合及梯度消失现象,识别准确率也得到提升,但在更深的网络中识别精度不高,网络训练较慢。基于VGG网络对交通标志识别,随着深度增加,使得网络的计算速度变慢,并且出现梯度消失现象,识别精度下降。S.R.Zhou等[8]于2018年提出基于VGG的改进网络,通过添加Dropout层及BN层,进一步加快了模型收敛速度,但识别精度仍然不高。针对LeNet-5、VGG等网络的问题,残差网络(ResNet)算法可以有效解决深度增加后计算缓慢及梯度消失问题,但由于残差网络直接采用shortcut连接操作,对图像中局部目标信息关注较低,仍然没有解决识别精度不高的问题[9]。Wang F等[10]于2017年提出残差注意力网络,通过添加At⁃tention机制增强对多类别局部目标的关注度,提升了总体识别精度,但添加Attention机制后,增加了网络参数,致使训练收敛速度减慢。

针对网络训练收敛速度慢及分类识别精度不高的问题,本文提出一种改进ResNet网络的A-ResNet模型,利用数据增强技术扩充GTSRB数据集,通过引入残差注意力机制、Dropout层及微调网络层架构对模型进行优化,实验证明此改进网络在扩充后的GTSRB数据集上得到了更好的识别精度,并有效提高了训练收敛速度。

2 相关理论

2.1 传统ResNet网络结构

自Alexnet[11]以来,CNN结构在不断加深,VGG和GoogLeNet[12]分别有19个和22个卷积层。随着网络深度的增加,梯度消失问题的存在使得网络训练变得更为困难,收敛效果不好,进而引入了ResNet网络[13]。ResNet网络是2015年ImageNet比赛分类任务的冠军,其特点是采用“shortcut”的连接方式,如图1所示。

ResNet中残差模块输出是由主干网络与跳跃连接相加得到,shortcut连接采用恒等映射的方式。ResNet网络可以较好地削弱梯度消失的现象,保留输入图像中更多的原始信息,减少损失,并且相比于传统VGG网络,在更深的网络中收敛速度也得到提升,本质上降低了训练过程中数据信息的冗余,但shortcut直接连接使其在多种类别的局部目标信息的关注度降低,从而降低分类精度。

2.2 Dropout层

大型网络多存在训练耗时长及模型易发生过拟合等问题,Dropout层能很好地解决这个问题。Dropout层的本质是在网络训练过程中,对神经元以一定概率进行暂时丢弃。当数据样本较少时,可以防止模型过拟合,有效提升分类精度。G.E.Hin⁃ton等[14]将Dropout层引入进卷积神经网络中,既解决了模型过拟合现象,又获得了良好的分类精度。

2.3 残差注意力(Attention)网络

Attention网络可以突出局部目标信息,让网络更专注查找输入图像中与输出有关的有用信息,从而提升图像目标的分类精度[8,15~16]。Fei Wang等[8]于2017年提出残差注意力网络,通过残差注意力网络更专注目标信息,使分类精度得到提升。残差注意力网络是一个含有注意力机制的卷积神经网络,是以端到端训练方式与前向反馈网络架构的结合,通过叠加注意力机制来构建。

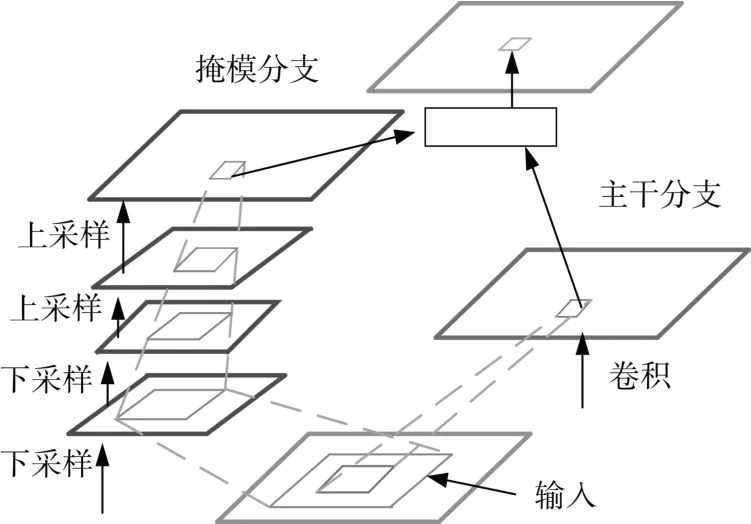

残差注意力网络是由多个注意力模块叠加而成,注意力模块分为两个分支:主干分支及掩模分支。注意力模块结构如图2所示。

图2 注意力模块结构图

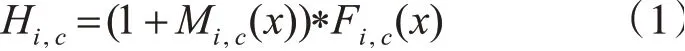

掩模分支包含上采样层及下采样层,既能快速前馈扫描采集图像的全局信息,也能自顶向下进行反馈将全局信息与原图特征相结合。每个主干分支都有其对应的掩模分支,用于学习其对应层特征的注意力信息,防止主干分支更新错误的权重参数,可通过叠加网络结构逐步细化复杂图像的注意力特征。残差注意力块的计算公式可以如式(1)所示:

Fi,c(x)表示卷积神经网络输出的结果,Mi,c(x)表示掩模分支权重输出结果,其取值范围在[0,1],越接近0,输出越接近F(x),这时就可以将网络表示为残差学习网络。Mi,c(x)作为特征选择器,可以增强有用信息并抑制来自主干分支的不良噪声信息,但注意力机制的增加使得网络中参数增多,可能造成过拟合,使训练收敛缓慢。

综上所述,传统ResNet网络的shortcut连接可加快深层网络的收敛速度,但由于直接连接使得识别精度降低,残差注意力网络利用Attention机制,增强目标信息,提升识别精度,但减缓了网络收敛速度,Dropout层可解决神经网络中的过拟合问题,以正确的正则化提升目标图像分类精度,并利用暂时丢弃参数的特点,加快网络训练速度,为解决网络收敛慢及识别精度不高等问题,需要对传统ResNet网络进行改进。

3 基于ResNet网络(A-ResNet)的交通标志识别

针对传统网络识别精度不高及残差注意力网络训练收敛速度慢的问题,本文为提升训练收敛速度及分类精度,对传统ResNet网络模型进行了改进,提出了A-ResNet网络模型,并应用到交通标志识别系统中。

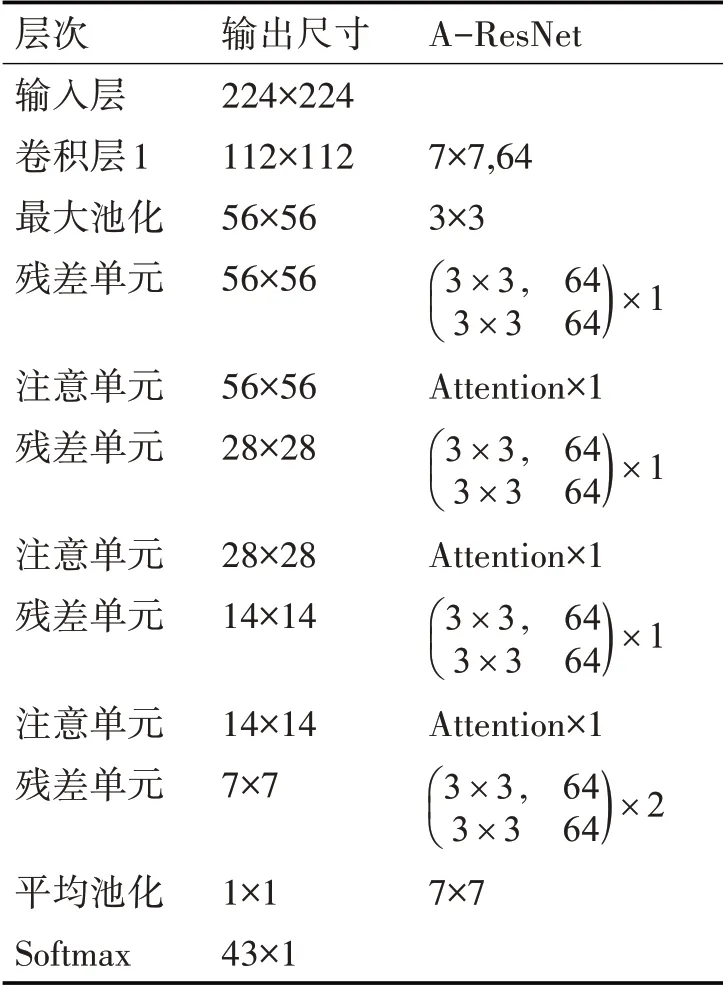

A-ResNet网络是由卷积层、池化层、残差单元、残差注意力单元和softmax层组成。其结构组成如表1所示。

表1 A-ResNet网络模型结构

A-ResNet网络的输入图像为固定尺寸224×224,第一层卷积层之后生成112×112的特征图,经过池化层降维之后,输入到4个残差单元及3个注意力单元,将输出的14×14的特征图输入至平均池化层,将结果组合成特征向量输入至softmax进行分类。相比于原始ResNet网络,增加了注意力单元,并调整各单元结构及添加Dropout层,既能够加快网络训练损失值收敛速度,也能够提升网络识别交通标志的分类精度。

3.1 A-ResNet中残差模块的改进

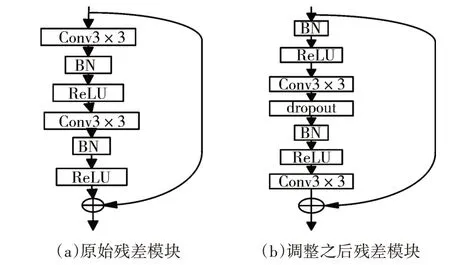

传统ResNet网络中残差单元采用图3(a)的结构,此结构组成的ResNet网络训练速度慢,识别精度不高,因此为提升分类精度及训练收敛速度而调整网络后的残差单元结构如图3(b)所示。

将尺度归一化层(BN层)以及激活层(ReLU层)调整到卷积层之前,BN层对数据进行标准化,用于稳定网络收敛,再将处理后的数据输入至Re⁃LU激活函数进行激活,既可增加各层之间的非线性关系,又可以增强网络稀疏性,防止过拟合现象发生,将激活后的数据输入至卷积层,继续提取特征,在卷积层之间添加Dropout层,可以避免网络参数过度拟合。

图3 改进前后残差模块

3.2 A-ResNet中残差注意力模块的改进

针对残差注意力网络在网络训练阶段收敛速度慢的问题,为在稳定识别精度同时加快网络训练收敛速度,本文提出一种改进后的残差注意力网络。采用的注意力网络具体如图4所示。

图4 注意力模块结构

其中残差块、上采样、下采样及跳跃分支模块的基础结构均采用与本文改进后的残差单元相一致的结构。但不会直接使用shortcut连接机制,若直接采用shortcut机制作为掩模分支结构,会造成深层网络梯度得不到反转的问题,所以,掩模分支采用上采样与下采样过程相结合的结构,既能获取图像中的全局特征信息,又能将提取出来的全局信息转换为维度一致的特征图。最后将主干分支与掩模分支所得到的维度一致的特征图用点乘方式组合起来,构成最后输出的特征图。其中在下采样阶段,采用最大池化层对提取的特征图进行降维,降维到最小尺寸7×7,然后在上采样阶段,逐层采用双线性插值方式扩张特征图维度,将下采样得到的特征图与之相加,得到最终特征图。这样做的目的在于结合全局与局部特征,使表征能力进一步加强。

4 实验

本文在德国数据集基准GTRSB上进行实验,使用caffe框架环境,在装有Centos Linux release 7.4,NVIDIA Tesla-PCIE-16GB的linux机器上完成。

4.1 数据集

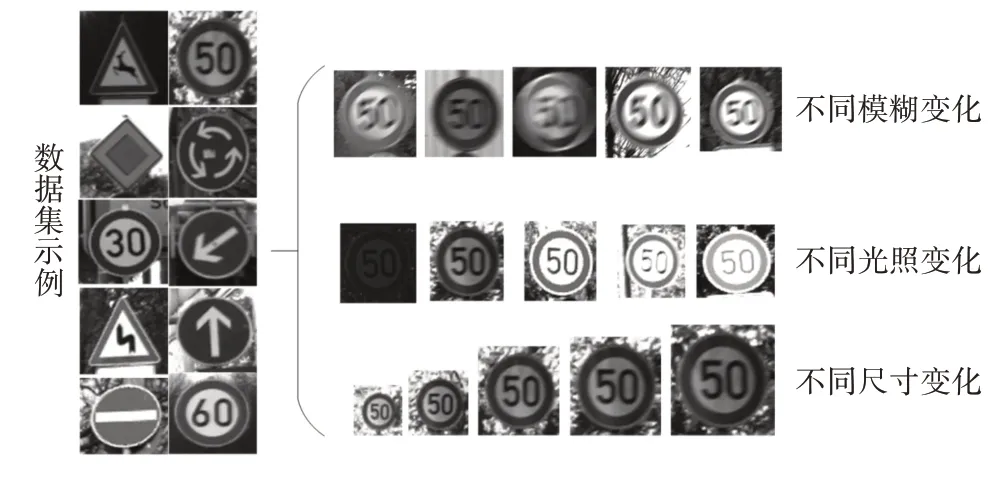

本文实验采用德国标准数据集GTRSB,数据集有43类交通标志,其中训练集有39209张图像,测试集有12630张图像,样本图像均包含交通标志区域以及周围区域,尺寸范围在15×15到250×250不等。本文使用固定224×224尺寸的图像作为输入,输入格式为LMDB。数据集是通过裁剪现实场景图像中的交通标志得到的,其中包括光照、尺寸、模糊程度等不定因素所造成影响的图像样本。数据集示例如图5所示。

图5 GTSRB数据集

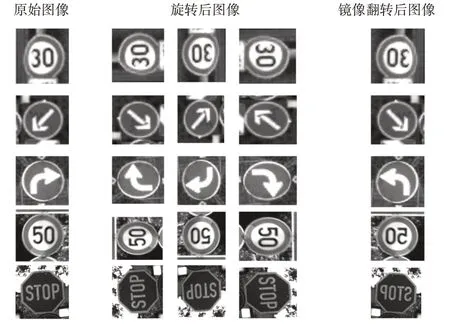

可看出在数据集中,每一张图像均含有不同尺寸变化,不同光照强度以及不同背景、模糊等影响因素的扩展图像,但通过实验发现,数据集数目还是偏少,实验数据的欠缺会导致实验结果不理想,为降低实验数据对最后分类精度的影响程度,本文使用数据增强技术对数据集进行增强。利用镜像翻转、90°和180°及270°旋转、缩放裁剪、颜色亮度不同等操作下,对交通标志数据集进行扩充处理。通过数据扩充方式,在输入图像阶段,提升数据的数量,从而进一步提升交通标志分类精度。交通标志数据集数据增强示例图像如图6所示。在经过数据增强之后,数据集增多,变为源数据集的4倍,增强了数据集的表现能力,使分类结果更准确。

图6 数据集的数据增强方式

4.2 A-ResNet残差模块改进实验

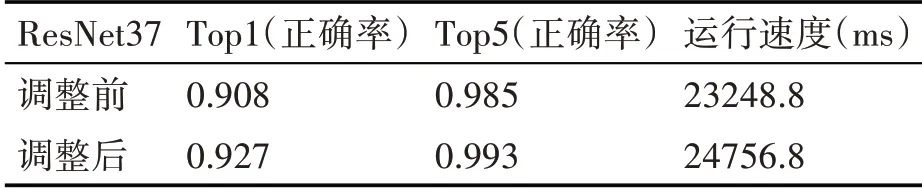

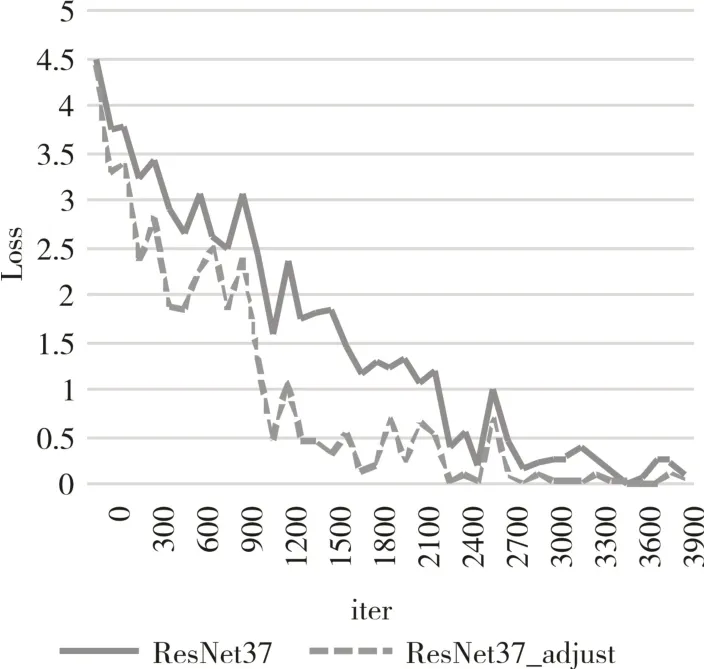

针对传统ResNet网络中的残差模块存在识别精度低的问题,为验证改进后残差模块可提升识别精度及进一步加快收敛速度,本文设计37层的ResNet网络进行实验,所得结果如表2所示。在训练阶段,改进网络前后的损失值收敛情况如图7所示。

因此,实验证明,调整网络后所的分类精度比调整之前在top1正确率上提升2%左右,在top5正确率上提升1%左右。但由于添加Dropout层后增加更多前向反馈参数,在运行速度上有些许牺牲。在训练阶段,改进后网络比原网络的损失值收敛更快,证明改进后网络可以达到加快网络收敛的目的。

表2 ResNet37改进前后实验结果对比表

图7 训练损失值变化情况

4.3 A-ResNet对比实验分析

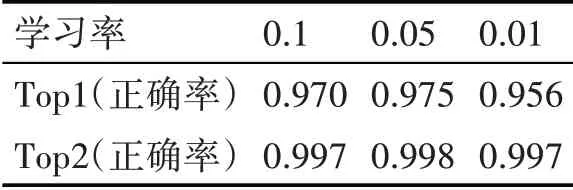

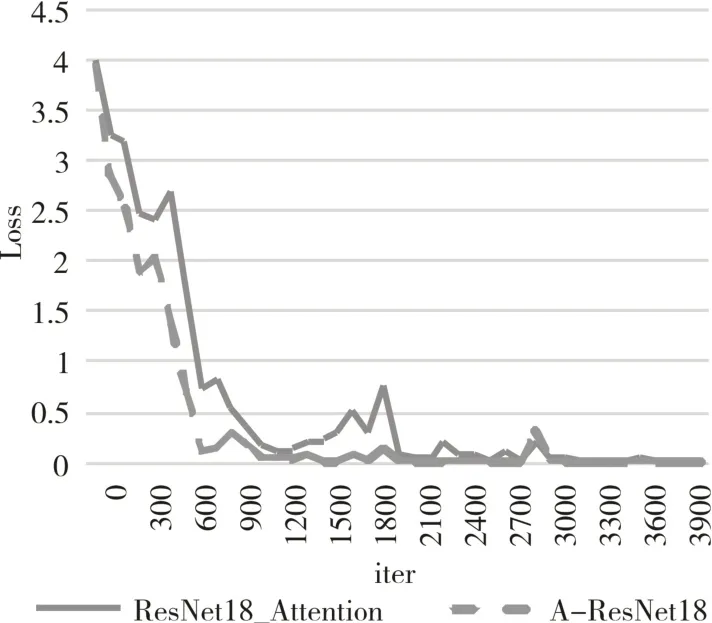

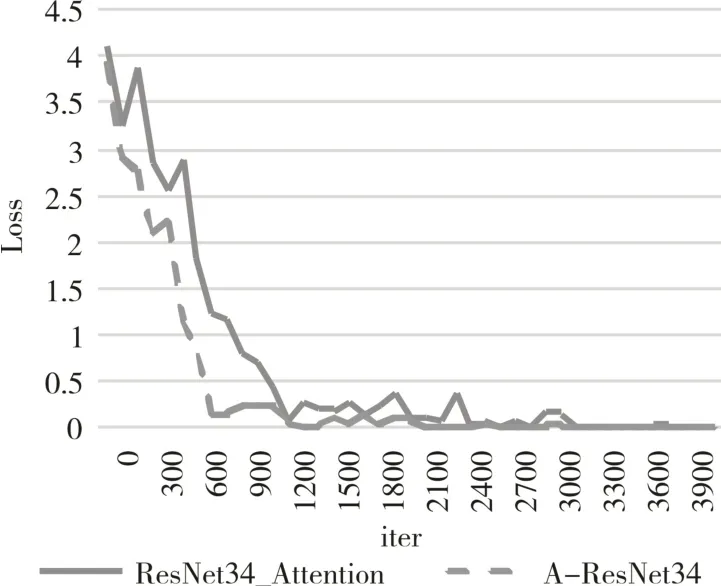

针对识别精度和网络训练收敛情况两方面,对传统ResNet网络、残差注意力网络以及A-ResNet网络(本文),在GTSRB增强后数据集上进行实验对比,经多次实验发现设置学习率为0.05时分类精度最优,以训练A-ResNet为例,部分结果如表3所示,因此实验学习率为0.05,迭代4K次,识别正确率实验结果如表4所示。残差网络与本文模型训练时收敛情况如图8、图9所示。

因此,通过实验比较看出,A-ResNet网络在GTSRB数据集上得到的分类识别率在top1最高达到97%左右,在top5均达到99%左右,既比传统ResNet网络提升了2%左右的top1精度,也加快了收敛速度。结果证明,在网络中调整结构可以加快网络训练时损失值收敛速度,在网络中添加残差注意力机制及添加Dropout层可以增强类别关注及防止过拟合,从而提升分类精度。

表3 A-ResNet不同经验学习率实验结果

表4 识别正确率实验结果

图8 18层残差注意力网络与本文训练收敛情况

图9 34层残差注意力网络与本文训练收敛情况

5 结语

本文对实际场景中的交通标志识别进行研究,针对传统ResNet网络识别精度不高,残差注意力网络收敛速度慢等问题,基于残差注意力网络对传统ResNet网络进行改进,提出了A-ResNet网络。经实验测试,本文提出的A-ResNet网络通过调整网络结构加快了训练收敛速度,引入残差注意力网络及Dropout层可以提升网络分类精度。