增强型深度对抗样本攻击防御算法

刘佳玮,张文辉,寇晓丽,李雁妮

(西安电子科技大学 计算机科学与技术学院,陕西 西安 710071)

近年来,深度神经网络模型(Deep Neural Networks,DNNs)已被成功应用于很多应用领域,如:计算机视觉、语音识别、自然语言处理等等。但DNNs极易受到一种被添加了细微的恶意扰动信息的样本,称之为对抗样本(Adversarial Example,AE)的攻击。由于对抗样本的扰动非常细微,以致人眼及深度神经网络模型均难以察觉辨识,从而导致深度神经网络模型产生错误的分类/预测结果,即深度神经网络模型防御对抗样本的鲁棒性(Adversarial Robustness,AR)大大降低[1-2]。因此,研究高效的深度对抗样本防御算法,以提高深度模型的鲁棒性是当前深度学习面临的一个极具挑战性问题。SZEGEDY等[3]首次提出深度神经网络模型中存在对抗样本的概念,通过深度攻击算法在原始输入的干净样本上添加细微扰动后以产生对抗样本,从而攻击深度模型的鲁棒性。防御算法的核心目标是让深度模型有效抵御对抗样本的攻击,以提高其鲁棒性。近年来,已产生了一些较好的深度对抗防御算法[4-16]。现有对抗防御算法主要分为以下两类:对抗训练算法[4-9]与对抗样本去噪算法[10-16]。对抗样本去噪算法通过在目标深度神经网络模型中添加一个预训练好的去噪模型,从而消除对抗样本中的扰动信息。对抗样本去噪算法简单、高效,但它在去除对抗样本噪声的同时,也损伤了原始干净样本上的一些有用信息,导致最终训练的深度模型对干净样本的分类/预测精度下降。对抗训练算法通过优化损失函数[17]、修改目标模型结构、更新网络参数等形式训练出具有更强的对抗鲁棒性的深度模型。但该类算法相对复杂,模型训练收敛缓慢且模型不稳定。

针对现有的对抗样本去噪算法的上述缺陷,笔者提出了一种基于输入去噪与隐层信息恢复的新的增强型深度对抗样本防御算法。主要贡献有以下3点。(1)针对现有深度去噪算法精度有待于提高,对干净样本去噪时产生信息损失的缺陷,提出了基于U-net[21]网络模型,以及对抗样本与增强型干净样本联合训练模型的一种新的增强型对抗样本输入去噪方法。基于凸包理论,将对抗样本与预测/分类错误的干净样本的隐层向量进行凸组合以训练并修正模型对干净样本有损信息的恢复策略。(2)在此基础上,提出了一种高效的增强型深度对抗样本防御算法(Input Denoising and Hidden Information Restoring,ID+HIR)。(3)在多个基准数据集上与现有代表性的深度对抗样本去噪算法进行了性能对比仿真实验,理论分析与实验结果表明笔者所提出的ID+HIR算法的对抗防御性能优于现有代表性的对抗去噪防御算法。笔者提出的算法ID+HIR源码及附录(包含相关部分实验及分析、训练算法伪码及定理证明)的下载地址为:https://github.com/xd-1307/ID-HIR。

1 相关工作

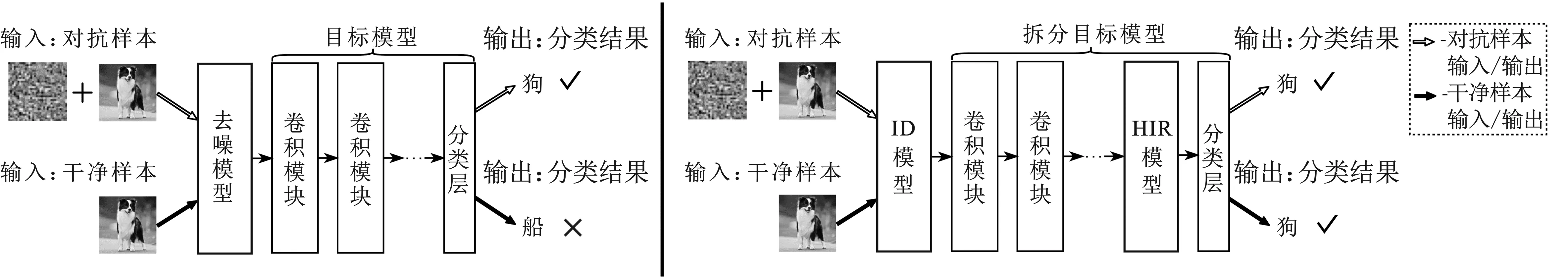

近年来,由于对抗样本去噪算法的简单高效性,它已成为深度防御对抗样本攻击的主流算法。DAE[13]是最早提出的对抗样本去噪算法,它使用去噪自编码器网络结构,通过输入仅叠加了高斯噪音的原始样本,以抵御对抗样本的噪音;ComDefend算法[10]通过压缩的卷积神经网络ComCNN以及重构卷积神经网络RecCNN来实现对抗样本的去噪;HGD算法[11]将对抗样本输入所提出的去噪模型中,通过将原始图像与去噪图像在CNN的距离作为损失以指导模型的优化;PixelDefend[12]通过特定的去噪模型以实现图像灰度级的对抗防御;FS算法[14]通过滤波器平滑数据的方式去除对抗扰动信息;JPEG和TVM算法[15]将图像进行压缩,压缩失真后的图像在一定程度上抵御了对抗样本;NRP算法[16]利用对抗训练的思想来训练模型;FD特征去噪算法[18]输入对抗样本,通过在模型的隐层对特征向量进行均值滤波来抵御对抗样本的噪声;DS去噪平滑算法[19]输入干净样本并叠加特殊噪音,通过最小化噪声样本和干净样本的误差来训练模型。上述对抗去噪类算法思想及缺陷如图1所示。

(a)已有大多数对抗去噪算法缺陷示意图 (b)文中ID+HIR对抗去噪算法示意图

按照惯例,将完成特定预测/分类任务的深度网络模型称为目标模型。已有的对抗样本去噪算法均面临如下挑战性问题:(1)由于在目标模型的前端加入了对抗样本的去噪模型,故算法在提升目标模型对抗鲁棒性的同时,会损失干净样本的有用信息,造成目标模型对干净样本的识别精度下降;(2)对干净样本有用信息的改变/损坏会被目标深度神经网络逐层放大,即导致干净样本的分类/预测结果误差会随着网络模型的加深而逐步放大。

不同于现有的对抗样本去噪算法,笔者提出的ID+HIR算法由两部分构成:即由输入去噪模型(Input Denoiser,ID)及隐层信息恢复模型(Hidden Information Restorer,HIR)构成。ID+HIR算法首先在目标模型输入前端插入ID模型,以去除对抗样本的扰动信息。之后在目标模型的隐层后插入HIR模型,以恢复干净样本上受损的有用信息,以进一步提高目标模型的对抗鲁棒性和识别精度,并避免现有算法对原始干净样本信息的损失缺陷。

2 基于输入去噪及隐层信息恢复的ID+HIR算法

2.1 ID+HIR算法概述

与现有的对抗去噪算法不同,笔者提出的算法在目标模型Tθ(·)中插入了两个相互独立的模型:即输入ID模型和隐层HIR信息恢复模型。其中,ID模型负责去除输入样本上可能存在的对抗性扰动信息。ID模型的输入为待分类样本,输出为去除扰动对抗信息(亦称为噪声)后的样本。HIR模型负责在目标模型的隐层恢复干净样本受损的信息,该模型输入为样本在目标模型的隐层输出向量,输出为被修复的隐层向量。在对HIR模型进行训练时,通过构建对抗样本和干净样本的隐层向量凸包作训练数据,以有效提升HIR模型对干净样本有损信息的恢复。该机制使得目标模型在具有良好的对抗鲁棒性的前提下,维持了对干净样本的识别能力。ID和HIR两模型的功能与训练相互独立,两者协同完成输入样本(对抗样本和/或干净样本)的去噪及受损信息的恢复功能,以最终实现深度目标模型的正确预测/分类任务。

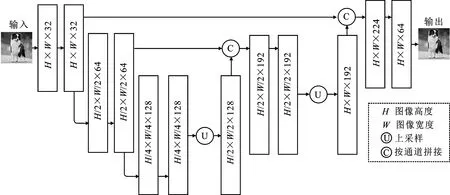

ID+HIR算法首先将ID插入到目标模型Tθ(·)的前端,然后将深度目标模型Tθ(·)进行切分,在切分点处插入HIR模型。由于在图像识别领域的目标模型通常选择卷积神经网络CNNs,故切分点可以选在卷积层之后与分类层之间,在切分点处添加HIR模型。笔者提出算法的网络模型结构示意图如图2所示。

2.2 输入层ID模型

2.2.1 ID模型

笔者提出的输入层ID模型结构采用U-net[21]网络结构。由于U-net结构含有的残差结构,可以有效提取图像的高维语义信息并融合低维空间信息,并善于提取细微的数据信息,避免了传统DAE对于彩色图和大尺寸图拟合能力较差的弊端,使模型具有更强的去噪能力。ID网络模型结构如图 2所示。

图2 ID模型结构示意图

2.2.2 ID模型的训练

ID模型记为Iw(·),其中,w为ID模型的参数。设ID模型的输入为对抗样本x′和/或干净样本x,期望其输出为去除对抗样本扰动信息后的样本,故可给出ID模型的优化目标损失函数为

(1)

其中,Iw(·)为指示函数,满足条件为1,否则为0。由于指示函数I(·)是0-1函数,在采用反向传播算法优化深度模型参数时会存在梯度消失问题,故文中将指示函数I(·)替换为交叉熵损失函数来训练ID模型。故ID模型的损失函数式(1)可转化为

LID=arg min(-∑ylogTθ(Iw(x,x′))) 。

(2)

值得注意的是:由于训练好的ID模型的输入为对抗样本和/或干净样本,故在ID模型训练时,采用对抗样本和干净样本同时进行训练,以避免ID模型过拟合对抗样本;另外,当对抗样本中的扰动(噪声)较大时,为了避免训练出的ID模型过度拟合对抗样本,而对干净样本的拟合能力降低的问题,可首先采用多轮的高斯扰动数据增强方法[20],对干净样本进行数据增强处理,得到增强的干净样本数据集XE。然后,采用X′∪XE联合训练Iw(·),以提高其去噪及泛化能力。

2.3 隐层信息恢复模型HIR

2.3.1 HIR模型

如前文所述,传统的去噪算法会导致干净样本的信息损失,使干净样本的特征分布偏离目标模型Tθ(·)的分类器所能正确识别的分布空间。为了恢复信息受损的干净样本,将目标模型Tθ(·)进行拆分为特征提取层(即隐空间层,简称隐层)和分类层,其中,用φ(·)表示隐层的函数映射,用g(·)表示分类层的函数映射。文中算法在隐层后增加HIR模型,以恢复干净样本的受损信息,并保证对去噪后的对抗样本不产生负面影响。即目标模型的输入的干净样本x和对抗样本x′经过Iw(·)和φ(·)后,其隐层输出为xh。xh在经过HIR模型的函数映射Hπ(·)(π为HIR模型参数)得到的隐层表示将能被g(·)正确识别。与ID模型相同,本文的HIR模型的网络结构也采用U-net网络模型。

2.3.2 HIR模型的训练

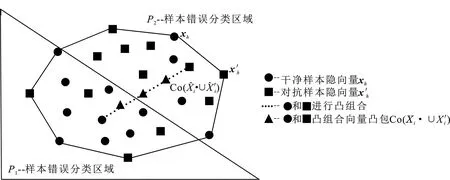

在对HIR模型进行训练时,需保证:(1)输入若是有损的干净样本的隐层向量,则HIR模型需要对其进行恢复并输出,以使目标模型能够实现正确分类;(2)若输入为经过ID模型去噪后的对抗样本的隐层向量,则该隐层向量已经能够被分类器正确分类,故HIR模型不能对该向量造成任何不良的负面影响,以此为目标并指导HIR模型的训练。在测试阶段,HIR模型确保无需预知当前样本是干净样本或对抗样本的隐层输出,可自适应地选择是否应恢复受损信息。为了达到上述目标,基于凸包理论,构建对抗样本和干净样本的隐层向量凸包作为训练数据,以此来有效训练HIR模型。需要注意的是,所构建的凸包仅用于指导HIR模型的训练,并不参与模型的测试。

干净样本经过去噪模型ID处理后,其样本上的有用信息可能会遭到破坏,造成目标模型对干净样本的预测/分类错误。该问题的本质是:干净样本在经过ID模型及目标模型后,其隐层向量可能会偏移到目标模型错误的预测/分类分布空间中。

为了更清楚地论述HIR训练数据的思想,引入如下助记符及定理。

图3 干净样本与对抗样本隐层向量凸包示意图,其内部的向量是xh和x′h的线性组合

HIR模型希望使P1和P2分布内的数据均能处于分类器能够正确分类的空间P1中。因此,为了使无法被正确分类的数据(处于P2空间中)能够被HIR模型恢复,定义HIR的P2交叉熵损失函数如下:

(3)

其中,Hπ(·)为HIR模型的映射函数。

同理,为了维持正确分类的数据(处于P1空间中),定义HIR的P1损失函数如下:

LP1=-∑ylogg(Hπ(xhi)) 。

(4)

为保证训练得到的HIR模型能够使P1、P2中的数据均处于正确的分布空间中,定义训练HIR模型的损失函数如下所示:

LHIR=LP1+LP2。

(5)

(6)

3 实验结果及分析

3.1 实验环境与模型超参及度量标准

(1)实验环境与模型超参设置

实验环境为:Intel(R)Xeon(R)Gold 5115 CPU @2.40 GHz,97 GB RAM,NVIDIA Tesla P40 22 GB GPU。文中算法ID+HIR及对比基准算法均基于Python 3.7实现,并在Pytorch 1.6.0下进行了测试。中文算法模型所设置的超参为:学习率λ=η=0.01,训练次数T=50,优化器选择Adam。实验对比的基准算法的模型超参严格遵循论文原文的超参设置。

(2)对抗防御性能度量标准

在对抗学习领域,通常用两个性能指标来衡量一个防御算法的优劣。第1个指标为添加防御算法后目标模型对原始干净样本的分类/预测准确率;第2个指标为防御算法对目标模型鲁棒性的提升,即目标模型分类/预测准确率的提升程度。笔者亦采用上述两个通用的度量标准来衡量本文算法及对比算法的对抗防御性能。

3.2 数据集

实验采用CIFAR-10、CIFAR-100、MNIST和SVNH标准数据集。CIFAR-10数据集是一个用于识别普适物体的小型数据集,由10个类别的32×32彩色图像组成,共60 000张。CIFAR-100数据集是基于CIFAR-10的扩展,共有100个类别,颜色尺寸与CIFAR-10的相同。MNIST数据集由70 000张28×28的手写数字的灰度图片组成。SVNH数据集来源于谷歌街景门牌号码图片,每张图片尺寸为32×32的RBG图片。

3.3 ID+HIR在CIFAR-10和CIFAR-100数据集上的对抗鲁棒性

首先,将CIFAR-10、CIFAR-100数据集以5∶1的比例划分为训练集和测试集,分别在ResNet56模型[24],采用FGSM[25]、CW[26]、BIM[27]攻击算法制作了3种不同类别的对抗样本,分别简记为FGSM/CW/BIM(对抗样本)。其中,对抗扰动阈值ε分别为4、8、16,ε表示p范数的对抗扰动阈值δ的上限,即‖δ‖p≤ε。

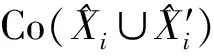

ID+HIR算法的训练数据为训练集的3种对抗样本的集合。测试数据为测试集下的各种对抗样本以及干净样本。目标模型采用典型的卷积神经网络模型VGG16[28]和ResNet18[24]。另外,对比算法中额外增加了Fast AT[29]算法,该算法是一种对抗训练算法,以验证文中算法在分类精度和鲁棒性上优于该对抗训练算法。实验结果如表1所示。

表1 ID+HIR算法在CIFAR-10较小图像数据集对抗鲁棒性对比结果 %

表1的实验结果表明,在CIFAR-10数据集上,笔者提出的ID+HIR算法在目标模型VGG16与ResNet18上展现了近似的对抗鲁棒性,且具有以下3种特性:

(1)目标模型(VGG16和ResNet18模型)在不采取任何防御手段的场景下,有较差的对抗鲁棒性;而当使用文中的ID+HIR防御算法加入到目标模型后,其目标模型均对对抗样本有较高的分类精度。

(2)ID+HID算法对原始样本的识别精度为91.2%和92.1%,虽然相比无防御场景下目标模型对干净样本92.6%和93.2%的分类精度有所降低,但是相比其他的对抗样本去噪类算法,如ComDefend算法对干净样本的分类精度为85.2%,文中算法均有着较大的精度提升,且它在各种对抗样本上的分类精度也远高于ComDefend等去噪算法。

(3)在ResNet18模型上,ID+HIR算法对原始样本识别精度略低于FS算法,但是FS算法对FGSM、CW和BIM等对抗样本展现出的对抗鲁棒性均大幅度低于文中算法。JPEG-Compression、TVM等算法同样在干净样本和对抗样本上的分类精度低于本文算法。本实验选择的对抗训练类算法Fast AT在面对BIM对抗样本时略优于文中算法,其原因在于BIM算法是一种迭代攻击的算法,对模型具有更强的干扰性,对抗训练算法在训练模型时直接更新目标模型的参数,具有更好的适应能力,但是在面对FGSM和CW对抗样本时,ID+HIR算法具有更好的性能。

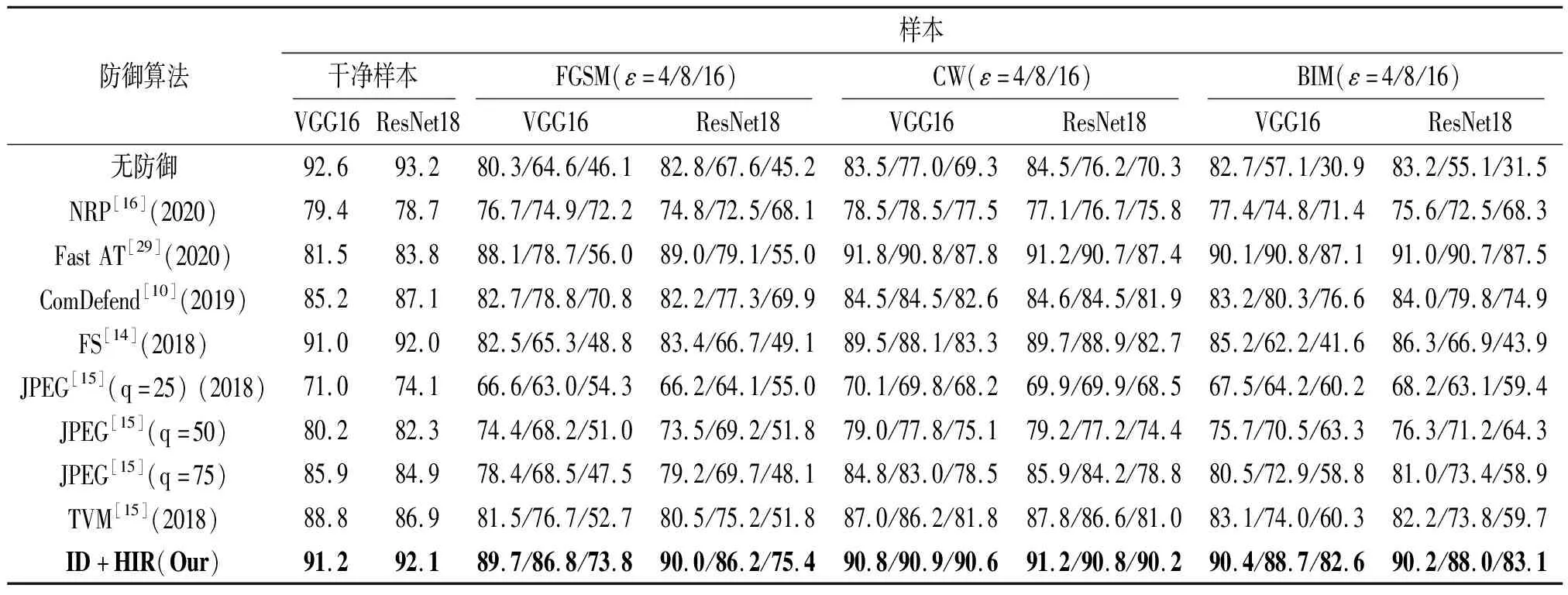

表2的实验结果表明:在CIFAR-10数0据集上,笔者提出的IHD算法在VGG16模型与ResNet18模型上展现了近似的对抗鲁棒性。从上述实验结果得出以下结论:

表2 ID+HIR算法在CIFAR-100数据集上的对抗鲁棒性对比结果表 %

在CIFAR-100数据集上,VGG16和ResNet18模型均有着类似于CIFAR-10数据集上的效果,IHD算法面对各类对抗样本时,分类精度均强于其他的去噪算法,证明了IHD算法在面临类别数为100的更多分类的问题时,仍能展现出更优的对抗鲁棒性。

上述实验结果充分表明,笔者所提出的ID+HIR算法不仅能在小尺寸图像数据集上(CIFAR-10和CIFAR-100)表现出较好的去噪性能,在很大程度上去除对抗样本上的扰动信息,而且能维持目标模型对原始干净样本的分类精度。这充分证明了文中算法的有效性及在各种数据集上良好的普适性。

3.4 ID+HIR的消融实验

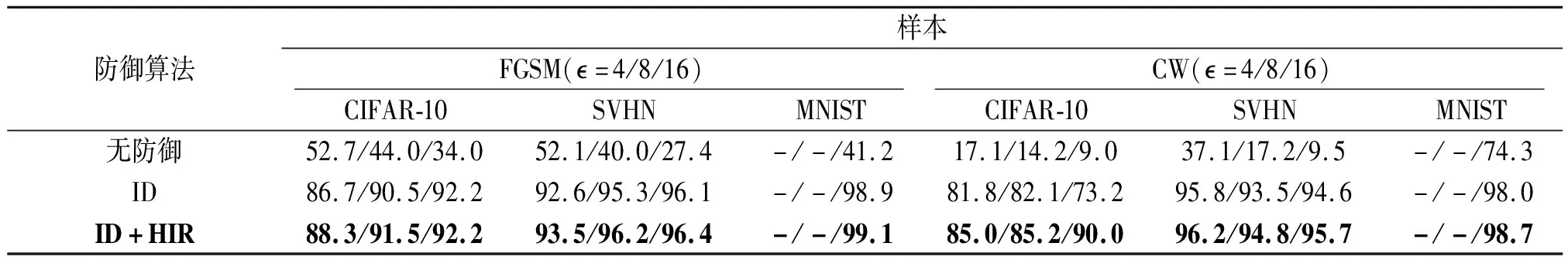

为进一步测试与验证笔者提出的ID+HIR对干净样本的受损信息的恢复能力,故进行了消融实验,即移除该算法中的HIR模型以测试目标模型的性能,并与完整的ID+HIR算法进行性能对比。同时,为了验证算法的ID模型在面对高扰动对抗样本训练时,会加剧对干净样本的损失,本实验对防御模型的训练在具有不同扰动的对抗样本下独立训练,并验证模型的对抗鲁棒性以及对干净样本的鲁棒性。ID+HIR消融实验结果均表明了ID及HIR模型的有效性及正确性。

训练数据为对抗扰动阈值ε分别采用4、8、16的FGSM和CW对抗样本,目标模型选择ResNet56模型。该模型对CIFAR-10干净样本的识别精度为92.6%,对SVHN的识别精度为96.5%。针对MNIST数据集选择具有4层卷积层的卷积神经网络,识别精度为99.1%。目标模型对对抗样本的识别精度以及两种防御场景下的实验结果如表3所示。

表3 HIR模型消融实验结果表 %

表3实验结果表明:

(1)在CIFAR-10数据集中,在仅使用ID模型做对抗防御的情况下,均能大幅提升模型对对抗样本的识别精度,说明ID模型有效地去除了对抗样本上的扰动噪声;

(2)选用CW作为训练数据时,可以看到本文算法下目标模型对对抗样本识别精度为90.0%,而ID为73.2%,证明了HIR模型在隐层的凸包训练方式同时可以有效地将对抗样本的隐层向量拉回到分类器所能正确识别的空间中;

(3)在SVHN数据集上的实验,有着和CIFAR-10数据集相似的特点,但是针对该数据集训练得到的模型在对抗样本上均有着比CIFAR-10更高的精度。通过MNIST数据集上的实验可以发现,在本文ID+HIR算法防御下,目标模型对对抗样本的识别精度维持在98.7%,与之前的99.2%相差无几,证明HIR防御模型几乎不影响模型的分类精度。

4 结束语

防御对抗样本的攻击,是当前深度模型面临的一个严峻挑战性难题。针对现有对抗样本去噪算法损失干净样本信息,导致目标模型预测/分类精度下降的缺陷,基于增强型输入去噪模型ID,以及基于凸包理论所构建的隐层有损失信息恢复器HIR,笔者提出了一种新的高效深度对抗样本攻击防御算法ID+HIR。在多个基准数据集上的大量对比仿真实验表明,所提出的算法优于当前典型优良的对抗样本去噪算法。