一种风机叶片图像采集及缺陷检测系统

赵春溢,郭洪涛,郭 涛,梁 国,荆海城

一种风机叶片图像采集及缺陷检测系统

赵春溢,郭洪涛,郭 涛,梁 国,荆海城

(中电投东北新能源发展有限公司,辽宁 沈阳 110179)

本文针对目前风机叶片人工检测工作量大、效率低、缺陷检测准确率不高的问题,提出并设计了一种基于无人机图像的缺陷自动化检测系统。本文介绍了系统的图像采集系统、采集方法、缺陷检测原理及检测效果:系统以无人机为飞行载体实现了(风机叶片的)自动巡检,从而提高了巡检效率,降低了人工的工作量;通过图像分割及缺陷检测算法设计实现了缺陷可疑区域的自动检测;可见光加红外光双光融合提高了叶片缺陷自动识别的准确性。经过多次现场测试验证,本系统可以精确、快速地实现鼓包,裂纹和褶皱等缺陷的自动识别与检测。

无人机;风机叶片;缺陷检测;图像处理

0 引言

目前中国已是全球最大的风电市场。风场主要分布在城市的远郊、近海以及戈壁等地理环境和气候环境十分复杂的风能储备地,叶片是风机捕捉风能的关键部件,易受环境影响造成自身缺陷,若不及时进行处理会影响风机寿命及发电量,甚至演变成严重事故。经过长期对叶片检查的结果统计发现,叶片缺陷主要存在如下故障:裂纹、边缘腐蚀、开裂、褶皱、雷击、结冰等。

当前叶片的缺陷检测主要依赖人工完成,由于检测的精度、速度和安全性等方面的限制,检测存在效率低下、可靠性低、危险性高和成本高等问题[1]。当前众多研究院校、机构针对以上问题进行研究。Menon等人介绍了基于声发射信号自适应阈值的小波分析方法来评估风机叶片状况[2]。CUI Hongyu等人利用采集的振动信号提出了一种基于EMD(empirical mode decomposition)的风机叶片裂纹诊断方法[3]。Wang等人提出了一种基于无人机采集图片,运用Logiboost、决策树和支持向量机相结合的风机裂纹分类方法[4]。目前依靠声波及振动信号的分析方法适用于地面检查,无法在叶片安装后使用。基于可见光的分析方法解决了叶片安装后的检查问题。但是易受光线、拍摄角度等因素影响,且仅可检测叶片表面故障。针对以上问题本文提出的基于无人机搭载可见光加红外光的检测方式,风机停机即可检测,提高巡检效率的同时可检测叶片内部缺陷,提高叶片缺陷检测的多样性与准确性。

红外光可通过叶片辐射的热量,对叶片内部的缺陷进行判断。叶片最为致命的缺陷往往产生于内部,并向外部扩散,如内部褶皱、内部开裂等,反应到外表面时,叶片已受损严重甚者不可修复,本文通过可见光与红外的双光融合手段,可见光与红外光结合分析,得出更加准确、更加有效的故障诊断系统。同时基于分析手段搭建了一套以无人机为飞行平台,双光吊舱为采集设备的全自动巡检系统,为风电场提高发电量,节约运维成本,减小事故发生率。

1 图像采集系统与采集方法

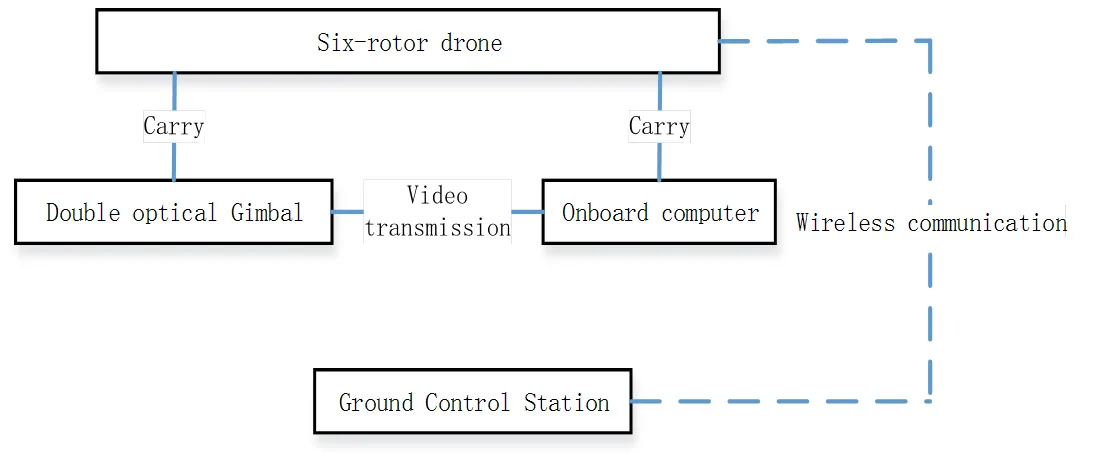

由于风场的风速较大,需要选用抗风性能较强的六旋翼无人机为飞行平台,搭载双光云台(可见光+红外光)的双光谱图像采集系统,同时还需搭载机载计算机进行视觉导航,并配有专业版本地面站来发布指令。故图像采集系统的组成结构如图1所示。

图1 图像采集系统组成结构图

1.1 图像采集系统

1.1.1 无人机选型

鉴于风场风速、任务航时、载荷重量等综合因素,系统采用DJI经纬M600 PRO型号无人机作为飞行平台(如图2所示)。该型号无人机配备3套IMU和GNSS模块,配合软件解析余度实现6路冗余导航系统,提升飞行时的安全性。该机型最大载荷为5.5kg,有效航时为20min,满足本系统任务需求。

该款飞行平台面向开发者用户提供API(application programming interface),可获取无人机GPS数据,IMU数据等,并且用户可向无人机发送姿态、速度、位置等控制指令。使系统可基于无人机提供的数据及控制接口实现全流程自动化作业。

图2 DJI经纬M600 PRO

1.1.2 双光云台选型

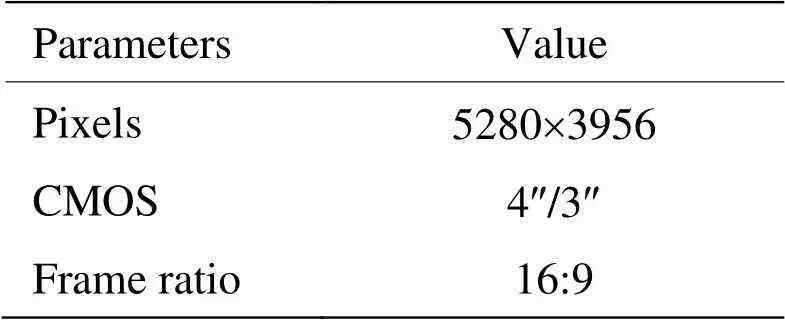

双光云台是本系统图像采集的主要部分,为保证后期故障检测时可见光图像与红外光图像进行匹配融合检测,需要保证两摄像头同轴且水平视场角和垂直视场角一致。两者机械安装位置为垂直方向机芯间隔3cm,偏差可忽略不计。可见光与红外机芯参数分别如表1,表2所示。

表1 可见光机芯参数表

表2 红外光机芯参数表

1.1.3 机载计算机选型

在整体任务巡检中,无人机自主飞行主要依靠惯性导航与视觉导航。其中视觉导航需要机载小型计算机实时处理可见光相机图像。本系统选用NIVDIA TX2计算设备,这款超级计算机模块采用NVIDIA Pascal™ GPU、高达8GB内存、59.7GB/s内存带宽,可实现GPU加速,快速处理图像。

1.1.4 地面站设计

地面站主要完成风机塔基位置输入,及巡检任务启动、图像缺陷检测等功能。地面站特为本系统定制设计与开发,起到人机交互的作用。基于DJI提供的Mobile SDK,在android系统上开发风机叶片巡检地面站软件,安装于平板电脑上。该平板电脑开拓展数传模块,用于与无人机的无线通信,实现无人机状态接收与控制指令上传功能。此外,地面站实时接收机载端采集的图像数据并进行实时处理。

1.2 现场采集方案

现场采集时风机为停机锁车状态,叶片成倒“Y”字型,如图3所示。

图3 叶片位置

巡检人员将风机塔基编号输入地面站中,地面站预先配置好风机编号对应其经纬度。巡检人员开启无人机,无人机自检查无故障后,即可启动自动巡检按钮。无人机接收到风机编号对应的塔基经纬度信息,自动起飞至距起飞点140m高度,此时无人机高于垂直向上叶片的叶尖部,无人机再飞向塔基的经度、纬度,控制云台垂直向下拍摄。由于塔基的经纬度可能存在误差,此时的机舱(风机发电机部位)可能不在图像中心位置,通过机载计算机对图像进行目标识别并计算得到无人机的控制指令,无人机依据指令移动将机舱调整到图像中心,最后经过图像处理提取机舱边缘朝向,通过无人机当前航向与机舱边缘和无人机机头方向偏差,可得到机舱的航向角度。

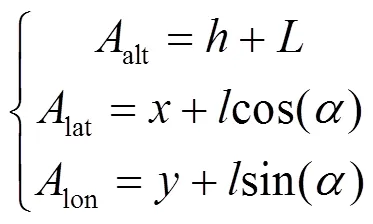

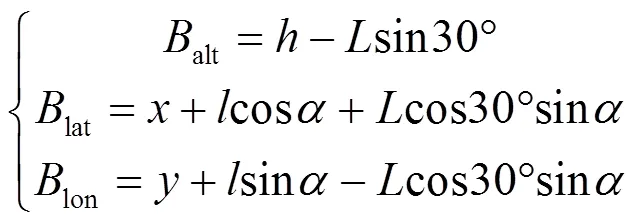

由无人机的当前经度、纬度、机舱的航向角度、风机的物理参数,可计算得到叶片叶尖的空间位置。

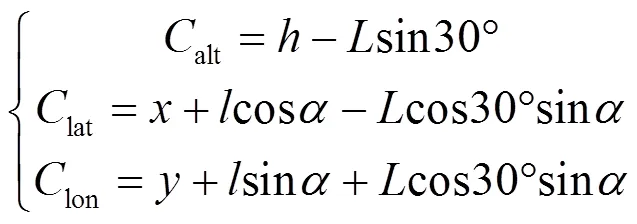

式中:、、分别代表图3中对应的叶片,下角标alt为高度、lat为纬度、lon为经度;为机舱高度;为叶片长度;为无人机的纬度;为无人机的经度;为机头中心点距机舱中心点偏移量;为机舱的航向角度。

为分辨出毫米的裂纹故障,根据相机参数,可计算得出,无人机需距叶片的最小垂直距离取水平方向与垂直方向计算的最小值:

式中:为相机水平像素;相机水平视场角为25°;相机垂直视场角为19°;为识别算法识别故障所需最小所占像素;d为以水平方向计算的最小距离;d为以垂直方向计算的最小距离。

无人机计算出叶尖的空间位置后根据无人机需距叶片的最小垂直距离。即可生成初步的自动巡检路线,如图4所示,图中1~10表示生成的航点及其序号。

为保证安全,无人机机头与叶片旋转面成45°角关系,形成旋转面外叶片前缘后缘两部分主要航线,共18个航点。

图4 自动巡检路线(正视图、右视图、俯视图)

无人机在自动航线飞行过程中,由于定位误差、图像目标识别误差等,图像中叶片位置会产生偏差,通过机载计算机对画面中叶片边缘提取,得到叶片弦长中心与图像中心偏差,机载计算机将向无人机发送控制指令,使无人机在按航线飞行过程中,不断修正位置,使叶片弦长中心在图像中心。运行完所有航点后,无人机上升至140m,然后完成自动返航动作,至此一台风机叶片巡检任务完成。流程图如图5所示,现场作业情况如图6所示。

图5 巡检任务流程图

图6 无人机自动巡检现场

2 叶片缺陷检测算法

2.1 红外与可见光图像融合

由于红外图像和可见光图像具有不同的特性,可见光是基于颜色特征形成的图像,可直观地反映叶片的表面特征,红外图像可反映物体的温度场分布,间接反映物体的热辐射特性,热辐射特性又可反映出物体的结构特征,因此将二者进行融合,可反映出物体的综合特征[5]。针对本双光系统红外相机和可见光相机同轴,且相对位姿固定,使得二者采集的图像可进行特征级融合。

依据单应性矩阵原理,从可见光相机成像平面到红外成像平面的投影映射中,两平面中的坐标点是一一对应的。假设点为可见光成像平面中的一点,其齐次坐标为1=(1,1,1),将其映射到红外成像平面上,匹配点的齐次坐标为2=(1,1,2),则满足:

2=1(5)

其中单应性矩阵为3×3的方阵,假设其为:

式中:33=1。

那么将式(6)代入式(5)矩阵相乘得:

式中:

=[1112132122233132]T(8)

通过式(7)每组点可以得到两个线性方程,要想求解,由式(9)得含有8个变量,故至少需要4组不共线的对应点即可得如下:

由式(9)通过SVD分解可求得矩阵H[6],利用式(5)可将可见光平面上的像素点转换到红外图像成像平面上,从而使得可见光图像与红外图像融合,示例图像如图7所示,可见光图像与红外图像融合后的效果如图8所示。

图8 可见光与红外图像融合效果

可见光与红外图像的融合,可以实现从红外图像上定位缺陷的可疑区域,通过映射关系定位可疑区域在可见光图像上的位置。

2.2 缺陷提取

本系统由于采用无人机进行叶片图像采集,目标背景为地面,为了提高风机巡检的准确性,对于采集的叶片图像首先进行目标分割,将叶片准确地分割出来。在此选择深度学习语义分割网络Deeplab v3+作为基础网络,该网络结合空间金字塔模块和编码-解码结构的优点,使用扩张卷积和深度分离卷积对风机叶片进行有效分割。实现过程为:

①依据采集的风机叶片图像,通过数据清洗剔除风机叶片占比较小、曝光不足或过曝的图像;

②选择VIA标注工具对风机叶片进行标注,获得单通道的mask图。

③进行网络训练,得到分割模型并视效果迭代优化。

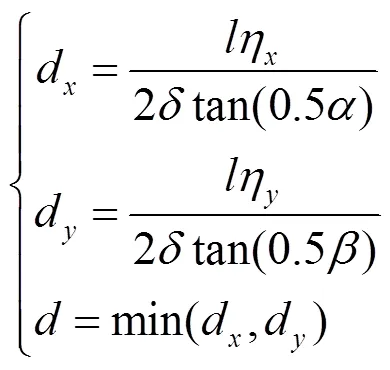

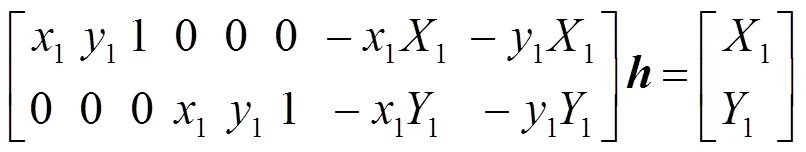

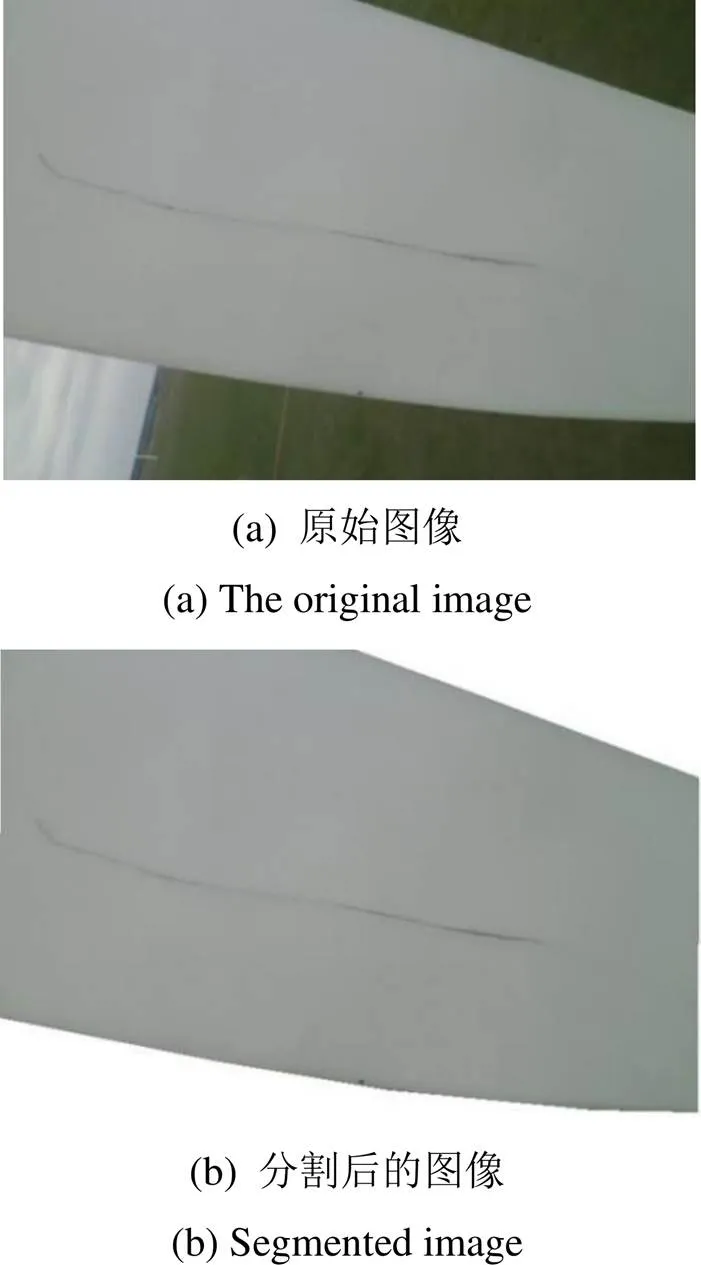

通过对优化模型进行测试,分割结果如图9所示。

无人机采集叶片图像后,实时将可见光和红外图像传输到地面端,地面多功能地面站部署有Opencv和Visual Studio 2017开发的图像处理系统,实现对实时采集的图像进行实时处理。图像处理系统如图10所示。

图9 分割效果图

图10 可疑缺陷提取流程图

鉴于以下原因,需要对采集的图像进行滤波和增强:

1)无人机搭载双光谱云台采集图像时一直处于运动状态,导致相机本身具有难以克服的抖动性;

2)由于风机叶片长年运行于几十米的高空,自然环境较恶劣,表面易积存油污、水渍、污渍等;

3)3只叶片处于不同的位姿,由于背光面光线较暗,迎光面光线超强,会导致光线分布不均;

4)由于数字图像生成的原理,采集的图像都会存在不同程度的噪声。

此外,相对于叶片,缺陷的区域占比较小,需要缺陷区域有比较明显的特征才能快速、准确地定位缺陷区域。传统的图像增强算法均为全局图像增强算法,通过对全局图像像素进行统计,制定统一尺度改变图像的亮度,存在对部分区域增强过度变得更暗或更亮,丢失细节的风险。在此针对红外和可见光双光谱图像本文采用“局部”增强的算法,“局部”思想主要体现在:①为了避免背景对前景的影响,局部增强算法只对前景图像区域增强;②前景图像区域内采用改进的直方图均衡化算法——“自适应局部”增强算法。

传统的图像增强算法原理如下:

1)统计整幅图像的像素分布,即各灰度级像素的个数n;

2)累积积分计算分布概率:

式中:为灰度级;为总像素个数。

3)依据累积积分结果进行像素映射计算得增强后的图像。

p=Sk(11)

改进后的“自适应局部”增强算法原理如下:

1)依据2.2的分割结果,去除背景,只保留前景区域;

2)将前景区域均匀分成若干等份;

3) 统计计算每块的直方图,积分分布函数及对应的变换;

4)设计变换规则:

对于规则的区域如图11(a)所示,采用如下变换:①角点处(深色区域):直接使用块所在的变换函数;②边缘处(浅色区域):采用线性插值;③中心(灰色区域)采用双线性插值。

对于非规则区域如图11(b)所示,其中白色区域代表背景区域,背景区域与前景区域交界采用如下变换:含有边界的块区域采用块区域的全局直方图均衡化算法,但直方图统计及累计积分时,背景区域不参与计算。其余区域同规则区域变换规则。

传统的基于全局的图像增强算法效果如图12(a)所示,改进后的自适应局部增强算法效果如图12(b)所示。通过对比发现全局算法出现了局部更暗,影响后续缺陷检测。改进后的自适应局部增强算法对裂纹实现了增强,没有出现局部增强过度的现场。

增强后的图像通过生态学组合算法检测图像中各点梯度的最大值,并将梯度最大值的点连接起来形成缺陷的边缘,从而实现对可疑缺陷区域的提取。

2.3 实验与结果分析

本文将红外与可见光图像分别进行处理,通过可见光图像判别叶片表面的缺陷,通过红外图像判别叶片的内部缺陷,再通过二者的映射融合关系将红外可疑缺陷区域定位至可见光图像中进一步进行确认。

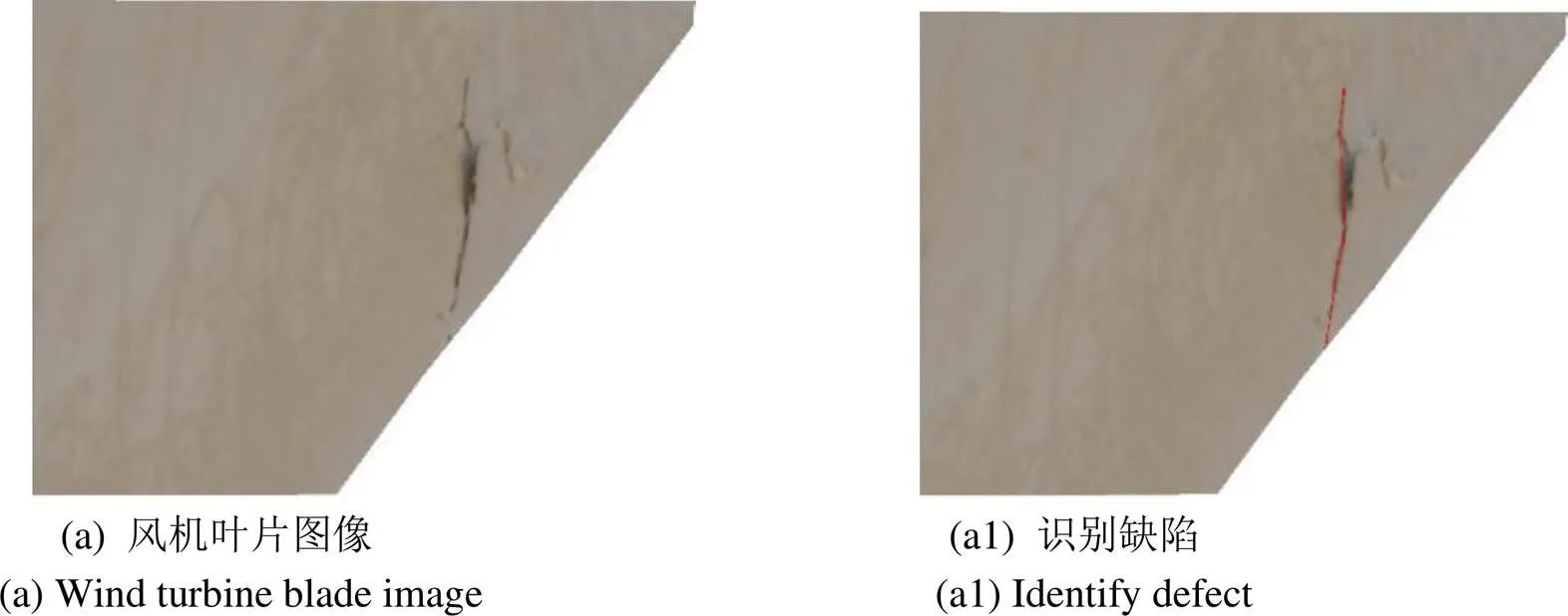

可见光图像的处理结果如图13所示。

红外图像的处理结果以及对应的可见光图像表现如图14所示。

图11 图像分块示意图

图12 增强效果对比

图13 可见光图像缺陷检测效果图

图14 可见光与红外对应缺陷

3 结论

本文针对目前风电巡检的技术水平,设计和开发了一套基于无人机平台的风机叶片自动图像采集和故障检测系统。系统选用了抗风性能较强的M600机型作为平台,搭载可见光与红外双光系统,通过科学的航线规划实现了图像自动采集。通过单应性原理实现了红外与可见光融合,通过算法设计实现了对风机叶片的缺陷检测。该系统经过测试,可以实现鼓包、裂纹和褶皱等缺陷的自动识别与检测,且准确率可以达到90%以上,相对于传统检测手段具有较高的准确率,为风电场的无损自动检测开辟了新的思路。

[1] 贺斌, 贾建华, 赵峰, 等. 无人机在风机叶片检测中的应用[J]. 电工技术, 2019(13): 64-65.

HE Bin, JIA Jianhua, ZHAO Feng, et al. Application of UAV in detection of wind turbine blade[J]., 2019(13): 64-65.

[2] Menon S, Schoess J N, Hamza R, et al. Wavelet-based acoustic emission detection method with adaptive thresholding[C]/, 2000,3986: 71-78.

[3] CUI Hongyu, DING Ning, HONG Ming. Crack diagnosis of wind turbine blades based on MD method[J].:, 2016, 157(1): 012003.

[4] WANG Long, ZHANG Zijun. Automatic detection of wind turbine blade surface cracks based on UAV-taken images[J]., 2017, 64(9): 7293-7303.

[5] 王凯, 韦宏利, 陈超波, 等. 基于红外和可见光融合的目标跟踪[J]. 计算机系统应用, 2018, 27(1): 149-153.

WANG Kai, WEI Hongli, CHEN Chaobo, et al. Target tracking based on infrared and visible light fusion[J]., 2018, 27(1): 149-153.

[6] 翟永杰, 刘金龙, 程海燕. 基于机器视觉的汽车工件抓取定位系统设计与开发[J]. 现代电子技术, 2018, 41(20): 6-9.

ZHAI Yongjie, LIU Jinlong, CHENG Haiyan. Design and development of automobile workpiece grasping and positioning system based on machine vision[J]., 2018, 41(20): 6-9.

Defect Detection System Based on UAV Images for Wind Turbine Blades

ZHAO Chunyi,GUO Hongtao,GUO Tao,LIANG Guo,JING Haicheng

(SPIC Northeast New Energy Development Co., Ltd., Shenyang 110000, China)

This study proposes and designs an automatic defect detection system based on UAV images for wind turbine blades, aimed at alleviating problems with manual detection methods, such as low efficiency and inaccurate defect detection. This paper introduces the system's image acquisition system, acquisition method, defect detection principle, and detection result. This system uses a UAV as the flying carrier to realize automatic inspection of wind turbine blades, thereby improving the inspection efficiency and reducing the manual workload. Through image segmentation and defect detection algorithm design, automatic detection of suspicious defect areas is achieved. Double light fusion of visible and infrared light improves the accuracy of automatic blade defect recognition. After multiple field tests and verification, the system is shown to accurately and quickly realize the automatic identification and detection of defects, such as bulges, cracks, and wrinkles.

UAV, wind turbine blade, defect defection, image processing

TP391

A

1001-8891(2020)10-1203-08

2020-04-04;

2020-05-18.

赵春溢(1970-),男,学士学位,高级工程师,主要研究方向火电及新能源技术管理,E-mail:sshsdsfyj@126.com。

荆海城(1973-),男,学士学位,高级工程师,主要研究方向为新能源技术管理。E-mail:smart_3d@126.com。