资源一号02D卫星高光谱与多光谱遥感影像融合方法

郭慧婷 韩波 王雪 谭琨

(1 华东师范大学 河口海岸学国家重点实验室,上海 200241)(2 中国空间技术研究院遥感卫星总体部,北京 100094)(3 华东师范大学 地理科学学院,上海 200241)(4 华东师范大学 地理信息科学教育部重点实验室,上海 200241)

随着我国高分辨率对地观测系统重大专项(简称高分专项)的实施,我国发射了一系列的高分辨率和高光谱遥感卫星,如高分五号、资源一号02D卫星(又称为5米光学业务卫星)。资源一号02D卫星搭载两台相机,其中多光谱相机可获取115 km幅宽的9谱段多光谱数据,全色谱段空间分辨率可达2.5 m,多光谱为10 m;高光谱相机可获取60 km幅宽的166谱段高光谱数据,可见近红外和短波红外光谱分辨率分别达到10 nm和20 nm,但与多光谱数据相比,其空间分辨率较低,为30 m。如果能对高光谱数据和多光谱数据进行有效融合,得到具有高空间分辨率的高光谱影像,将会进一步扩展资源一号02D卫星的应用场景。

目前,高光谱影像(Hyperspectral Image,HSI)与多光谱影像(Multispectral Image,MSI)融合方法主要包括成分替代法(Component Substitution,CS)[1-2]、多分辨率分析法(Multiresolution Analysis ,MRA)[3-5]、基于模型优化的方法[6-9]以及基于深度学习的方法[10-15]四类。其中,成分替代法和多分辨率分析法最早是为遥感影像泛锐化而设计的,可以将其应用扩展至HSI-MSI融合中。基于模型优化的方法将融合过程看作一个逆问题,根据光谱图像的退化机理,建立待融合影像(HR-HSI)与观测影像低空间分辨率高光谱影像(Low Resolution Hyperspectral Image,LR-HSI)和高分辨率多光谱影像(High Resolution Multispectral Image,HR-MSI)之间的关系模型,利用优化算法求解得到融合影像。尽管这些方法在高光谱影像与多光谱影像融合问题上取得了一定的效果,但仍然存在不足。成分替代法会因两种影像的波长覆盖范围不完全一致导致融合后影像光谱失真;而多分辨率分析法只提取高分辨率影像中的高频部分,融合后影像面临着空间分辨率提高不足的问题;相比前两种方法,基于模型优化的融合方法具有更高的融合精度,但模型求解复杂,此外,基于模型优化的融合方法严重依赖于人工设计的先验特征。

与传统方法相比,深度学习以其端到端的完整性训练方式以及有效的深层高阶特征挖掘方式而被广泛应用到遥感影像的处理与分析中。在遥感影像融合领域,文献[10]最早提出了一个泛锐化神经网络(Pansharpening Neural Network,PNN)用于多光谱影像和全色影像的融合。虽然PNN是为泛锐化问题设计的,但它也可以直接应用于高光谱影像和多光谱影像的融合中。文献[11]针对高光谱影像与全色影像的融合,提出高光谱泛锐化神经网络(HyperPNN),通过增加光谱预测层提高了网络的光谱预测能力。文献[12]为高光谱影像与多光谱影像融合设计了一个3D-CNN网络,使用3维卷积提取输入影像的特征。然而上述方法都将两种影像视为一个整体,网络输入的是两种影像沿通道维度的拼接,忽略了它们各自的显著特性。为解决这一问题,越来越多的学者放弃使用单支网络。如文献[13]中设计了一个包含两分支的遥感影像融合神经网络(RSIFNN)分别提取多光谱影像和全色影像的特征,将两种特征融合用于影像重建。文献[14]使用一维卷积和二维卷积分别提取高光谱影像的光谱信息和多光谱影像的空间信息,最后通过全连接层得到融合影像。文献[15]受到U-net的启发,将网络分成编码-解码结构,其中特征提取部分使用两个子网络分别提取多光谱影像和全色影像的特征。以上实验结果表明,基于深度学习方法的融合方法效果优于传统方法。

通过分析已有的研究,本文根据资源一号02D卫星高光谱影像和多光谱影像的特点,提出了一种基于空谱特征分离式网络(Spatial-Spectral Features Separated Network,SSFSN)的深度学习融合方法,实现端到端的高光谱影像与多光谱影像融合。

1 应用深度学习的高光谱与多光谱影像融合方法

(1)

式中:f(·)表示输入输出之间的映射,θ表示待优化的参数,‖·‖F表示Frobenius范数。

本文应用深度学习方法进行HSI-MSI融合,提出空谱特征分离式网络。具体的网络结构如图1所示,主要由3部分组成:①特征提取部分;②特征融合部分;③特征重建部分。其中,特征提取部分采用双分支网络架构分别提取LR-HSI和HR-MSI的特征,特征融合部分引入层次特征融合结构(Hierarchy Feature Fusion Structure,HFFS),特征重建部分利用通道注意力机制实现特征波段的选择重建。此外,网络借鉴了残差学习的思想,在光谱保真的同时加快了训练速度。

注:WRB为权重归一化残差块,CA为通道注意力。

1.1 特征提取部分

遥感影像特征提取是基于深度学习的图像融合方法的关键环节,可以通过使用卷积结构完成自动提取。如图1所示,每个分支分别使用一个3×3的卷积层提取输入影像的浅层特征,其过程可以分别表示为

(2)

(3)

σ(x)=max (0,x)

(4)

提取到的浅层特征继续输入网络进行深层特征的挖掘。文献[16]中提出了残差块(Residual Block,RB)结构,并证实了这种结构在影像超分辨率重建任务中的有效性。本文在RB结构基础上提出权重归一化残差块(Weight Normalization Residual Block,WNRB),通过堆叠WNRB结构提取影像深层特征。RB结构和WNRB结构如图2所示。

图2 残差结构与权重归一化残差结构Fig.2 Structures of RB and WRB

1.2 特征融合部分

在影像融合过程中,充分利用提取到的特征对于影像重建来说是至关重要的。然而,随着网络深度的增加,这些特征会在前馈过程中逐渐消失。文献[17]中提出了一种简单的HFFS结构,即将每一层提取到的特征都送入网络末端,并在最后引入了一个1×1卷积层对提取到的特征进行降维,有效避免了信息冗余并降低了计算复杂度,使得网络可以自适应地从这些层次特征中提取有用的信息。

将HFFS结构引入网络中,对于特征提取部分的两分支各自使用一个HFFS结构进行层次特征的融合,得到两分支中最有用的特征,再将其串联拼接实现特征融合,表示为

Hhs=[H0,H1,…,Hn]

(5)

(6)

Hms=[M0,M1,…,Mn]

(7)

(8)

F=[Fhs,Fms]

(9)

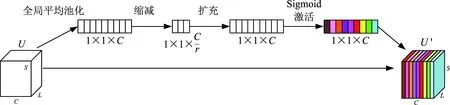

1.3 特征重建部分

网络的最后一部分是从融合特征中重建出预期的高分辨率高光谱影像。由于融合特征的各通道包含了不同的信息,而各通道信息对最终的重建过程贡献程度不同,因此,在特征重建部分引入CA机制以差异化各通道特征。CA机制可以动态调节不同通道的重要程度,从而更高效地使用网络提取到的特征,结构如图3所示。假设U表示输入特征图,特征图的高、宽和通道数分别表示为L、S和C,对每个通道的特征图进行全局平均池化(Global Average Pool,GAP),并将池化后的值作为每个通道的特征描述符,由此可以得到一个C维向量;其次,通过两个全连接层和ReLU激活函数组成的门控机制生成通道特征;再次,用Sigmoid函数激活通道特征,得到每个通道的权重;最后,将通道权重与输入特征相乘,获得具有通道注意力的学习特征。

表述为

HGAP=Avgglobal(U)

(10)

FU=Sigmoid(WU(WD(HGAP)))

(11)

U′=FU×U

(12)

式中:HGAP为经过全局平均池化后的特征,FU为通道特征,U′为具有通道注意力的学习特征,Avgglobal(·)表示全局平均池化操作,WD(·)表示对通道数目缩减,WU(·)表示对通道数目扩充,Sigmoid激活函数的表达式为

(13)

在网络的最后,使用一个3×3的卷积层重建融合影像。

图3 通道注意力机制示意图Fig.3 An illustration of the channel attention mechanism

2 融合方法验证与分析

2.1 试验数据与评价指标

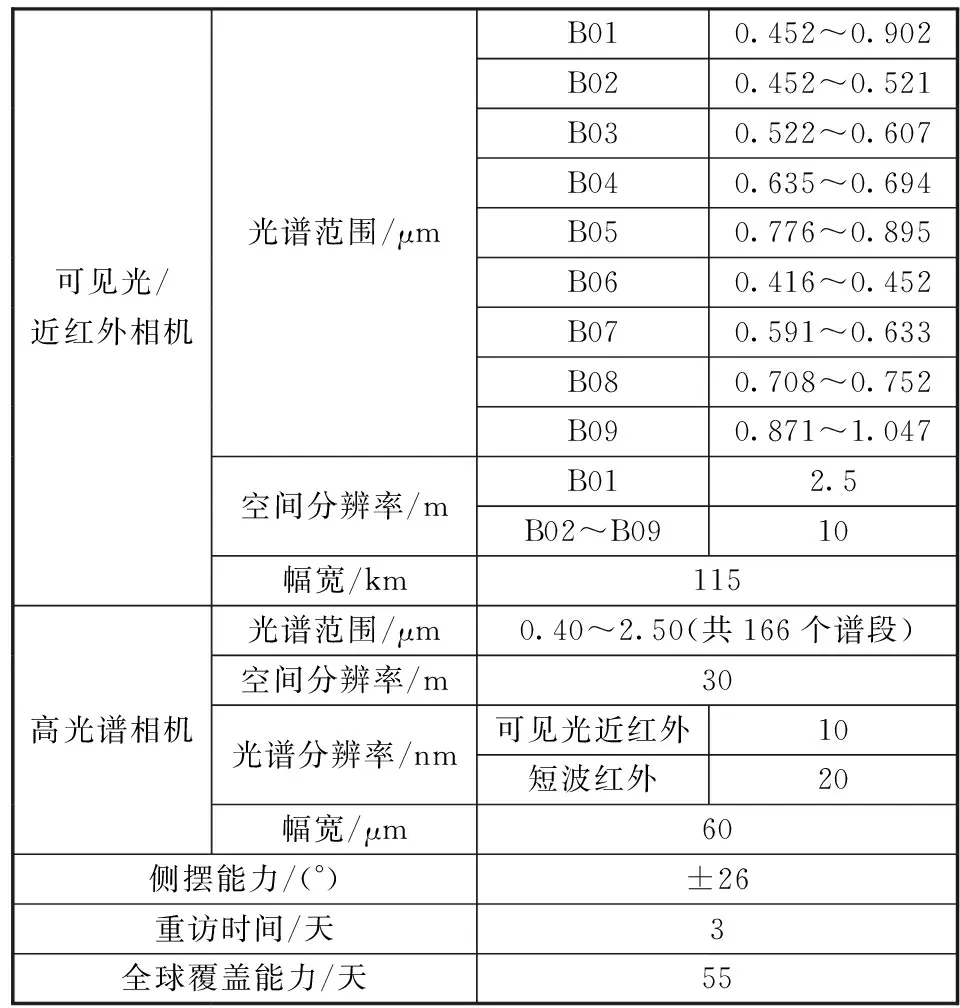

为验证本文方法的有效性,使用资源一号02D卫星采集的高光谱和多光谱数据进行融合试验,数据介绍见表1。对获取到的高光谱影像和多光谱影像进行辐射校正、几何校正、噪声波段去除、图像裁剪等预处理操作。由于缺乏真实的高空间分辨率高光谱参考影像,故将融合过程分为两个阶段:第一阶段为低分辨率训练阶段,基于Wald’s协议[18],将原始高光谱影像作为参考影像,将多光谱影像下采样至和原始高光谱影像一样的尺寸(空间分辨率为30 m),高光谱影像降采样同等倍数作为低分辨率LR-HSI(空间分辨率为90 m),整体在缩小的比例上进行融合;第二阶段为原始分辨率影像融合阶段,由于卷积神经网络具有尺度不变的特性,利用第一阶段训练好的网络模型对原始高光谱影像和多光谱影像进行融合,最终得到符合需求的高空间分辨率高光谱影像(空间分辨率为10 m)。

表1 资源一号02D卫星数据介绍Table 1 Overview of ZY-1-02D satellite data

此外,采用均方根误差(Root Mean Square Error, RMSE)、光谱角度映射(Spectral Angle Mapping, SAM)、相对全局综合误差(Erreur Relative Globale Adimensionnelle de Synthe’se, ERGAS)和空间相关系数(Spatial Correlation Coefficient, SCC)对融合影像进行定量评价。其中,RMSE、SAM、ERGAS值越接近0,表示融合质量越好;而SCC值越接近1,表示融合质量越好。

2.2 试验结果与分析

对比试验设置为3个传统融合方法:自适应施密特正交算法(GSA-HS)、平滑强度调制滤波算法(SFIM-HS)、非负矩阵分解算法(CNMF)以及2个深度学习方法:HyperPNN2、RSIFNN,将这5个方法与本文融合方法进行对比分析。表2显示了图像融合第一阶段的定量评价结果,从表2可以看出,本文算法在各项指标上都取得了最优结果,同时,使用深度学习算法得到的结果大幅优于传统算法。

表2 仿真数据融合质量评价指标Table 2 Quantitative evaluation of image fusion quality

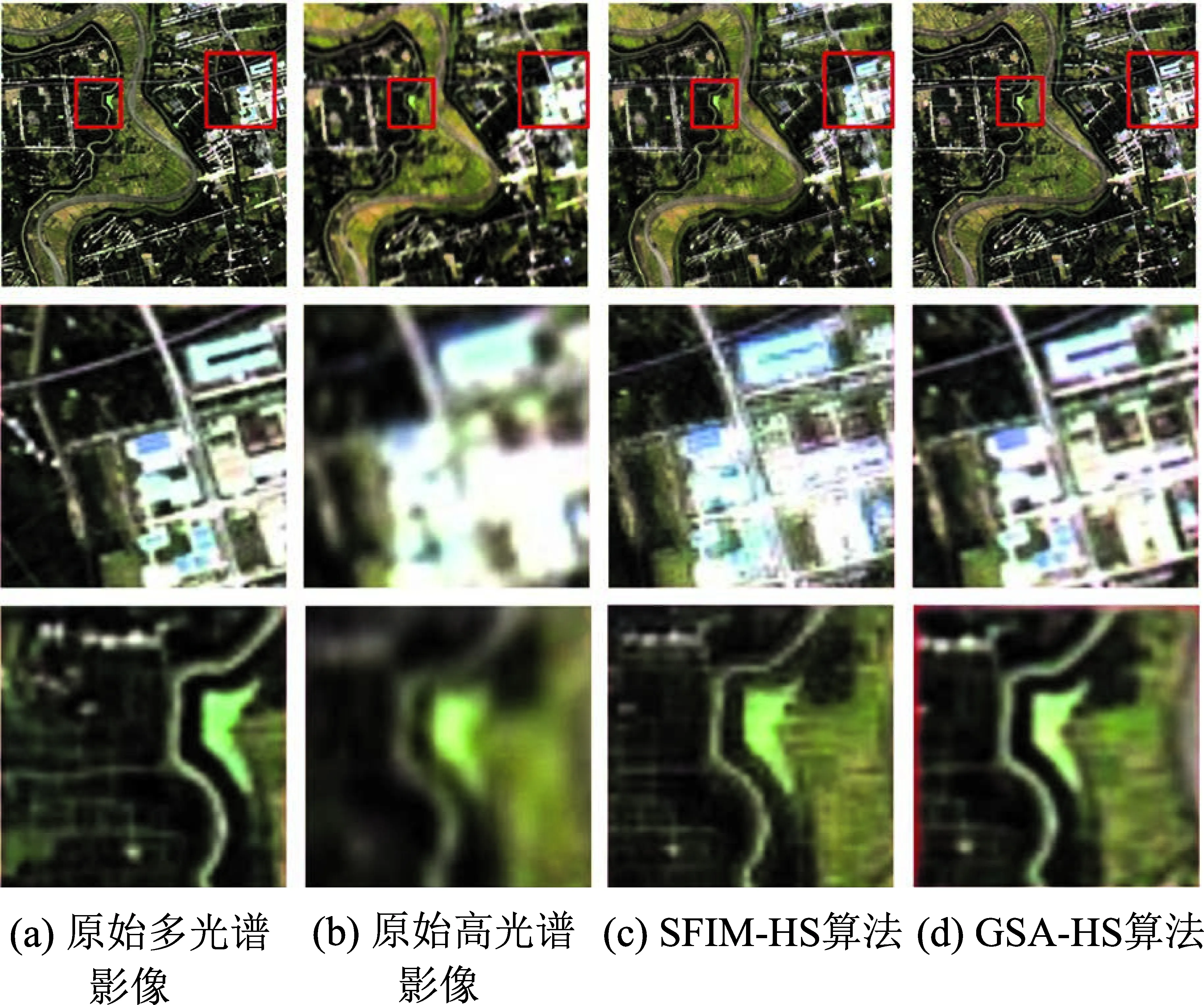

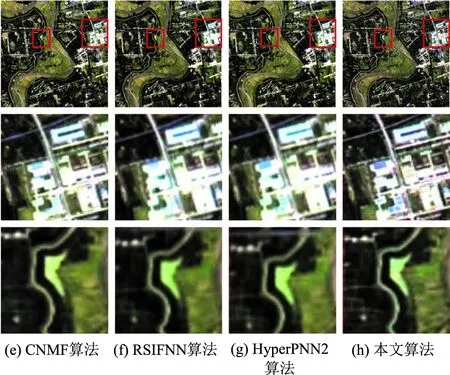

图4(a)和图4(b)分别为原始多光谱影像和原始高光谱影像,原始分辨率影像融合结果如图4(c)~4(f)所示。由于缺乏参考影像,仅展示融合影像的目视效果,这里给出了建筑区和植被区的局部放大图。通过对比融合影像和多光谱影像的空间细节可以看出:本文提出的算法目视效果最优,生成的融合影像能够很好地学习到多光谱影像的空间纹理特征,边缘及纹理清晰,与多光谱影像的目视效果最为接近。SFIM-HS算法效果最差,在建筑物上出现了明显的扭曲变形。CNMF、RSIFNN以及HyperPNN2算法在高亮度的建筑物区域表现较差,存在明显的局部分界不清晰。GSA-HS算法也存在一定程度的细节模糊。通过指标定量评价结果和目视效果可知,本文提出的融合算法在纹理特征、边缘细节及整体效果上均优于对比方法。

图4 图像融合算法实验效果对比Fig.4 Experimental comparison of image fusional gorithms

3 结束语

本文针对资源一号02D卫星的高光谱影像与多光谱影像融合问题,提出了一种空谱特征分离式网络基于深度学习方法,实现了高光谱影像与多光谱影像的有效融合。试验结果表明:提出的方法在目视效果和评价指标上均优于对比方法。该方法的提出扩展了国产资源一号02D卫星遥感影像的应用场景,为其在农作物精细分类、微小目标异常探测等方面的应用提供了可能。