基于卷积神经网络的织物起球等级客观评定

占 竹 卢开新 陈 霞 汪 军

(东华大学,上海,201620)

服装和面料在穿着或者洗涤过程中会不断与自身以及外界其他物体发生摩擦,在过度频繁的摩擦力作用下,纤维与纤维之间开始滑动并且逐渐摆脱纱线和纤维束的控制从而暴露于织物表面,形成绒毛,如果这些绒毛在随后的摩擦过程中没能及时脱落,将会彼此缠绕、交织在一起,突出于织物表面,形成毛球,这不仅破坏织物外观,而且会影响织物的接触舒适度,最终导致织物使用价值下降。随着消费者对于服装和面料的需求更加注重舒适性和装饰性,织物起球问题越来越受到重视。

随着计算机视觉技术的发展,众多学者尝试利用图像处理技术研究织物起球等级客观评定问题。这些方法可分为两类:一类是在空间域内利用织物表面毛球的灰度差异对毛球的位置和面积进行统计,进而实现起球等级评定[1⁃3];另一类基于频域内织物纹理背景和毛球的频率信息的差异进行等级评定[4⁃7]。以上两种方法都是基于人工特征提取的图像处理方法,而具有特征自提取特性的机器学习方法,如卷积神经网络(Convolutional Neural Networks,CNN),却少有研究。CNN 技术在最近的报道中被证明在计算机视觉相关任务上表现出色[8]。

本研究主要基于CNN 建立了一种织物起球等级客观评定方法,对精梳毛织物起球标准样照进行采集,滤除纹理分量等预处理步骤,在考虑所有圆形起球区域的基础上,验证了所提方法的可行性,并研究了子样本尺寸对起球等级评定准确率的影响。

1 标准样照图像预处理

1.1 图像采集

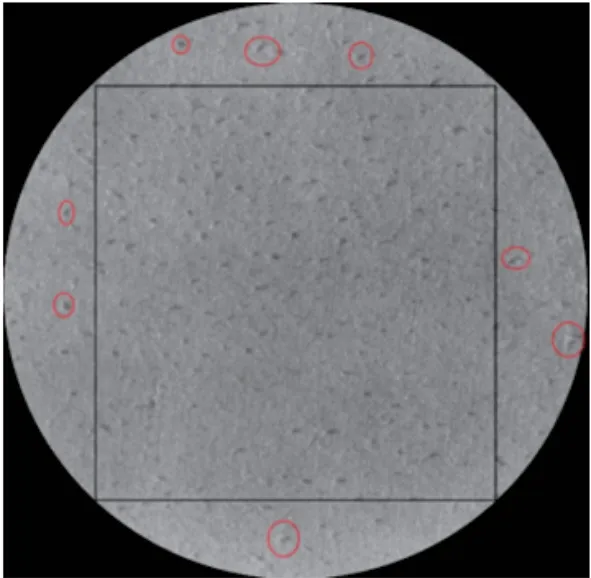

精梳毛织物起球标准样照(光面,GB/T 4802.2—2008《纺织品织物起毛起球性能的测定第2 部分:改型马丁代尔法》)共有5 个等级,从一级到五级起球数量依次减少,每个等级包含一张标准样照且所有等级标准样照尺寸大小相同,其中圆形织物区域直径为11.4 cm,整个图片尺寸为11.5 cm×11.5 cm。由于标准样照是以纸质图片的形式保存的,因此可通过具有平行光源的扫描仪采集数字图像以减少其他因素的影响。本研究采用MICROTEK 4800 型扫描仪对标准样照进行扫描,考虑采集对象的实际尺寸为11.5 cm,选用600 dpi 的分辨率,可计算得出采集所得到图像大小应为2 717 pixel×2 717 pixel,如图1 所示。

图1 织物起球标准样照数字图像

1.2 圆形起球区域提取

织物起球等级评定相关标准规定,不管是织物磨料还是起球区域都是圆形的,但目前关于织物起球等级的图像处理研究中,还没有针对圆形起球区域进行采样的报道,大多学者的做法如图2 所示,即截取部分起球区域或者截取圆形起球区域的最大内接正方形。显然,这样的做法是不全面和不合理的,即使是最大内接正方形也会丢失部分毛球信息(如红色椭圆框所示),从而导致最终的评定过程出现误差。

图2 圆形起球区域最大内接正方形截取示意图

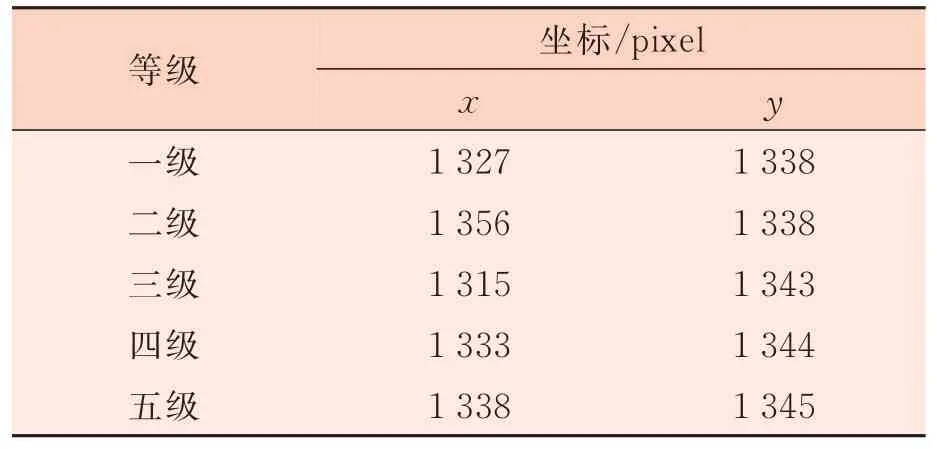

由于所采集图像中织物区域和背景区域差异明显,可通过图像二值化操作容易地提取圆形织物区域,然后借助Matlab 软件的Regionprops函数定位该圆形区域的圆心坐标(x,y),其中x 表示圆心到图像左边界的像素距离,y 表示圆心到图像上边界的像素距离,x 和y 的单位均为pixel。考虑到起球区域同样为圆形且处于织物试样中央,因此使用圆形织物区域的圆心等效代替圆形起球区域的中心。按照GB/T 4802.2—2008 规定,马丁代尔法中用于放置试样的毡垫直径为9.0 cm,即起球区域半径为4.5 cm。根据比例关系计算可得圆形起球区域半径对应的像素为1 063 pixel。以五级标准样照为例,圆形织物区域轮廓及圆心如图3(a)所示,圆形起球区域示意如图3(b)所示,提取的圆形织物区域如图3(c)所示,提取的圆形起球区域如图3(d)所示。表1 列出了所有等级标准样照的圆形起球区域圆心坐标。

图3 圆形起球区域提取过程

表1 织物标准样照圆形起球区域的圆心坐标

1.3 织物纹理滤除

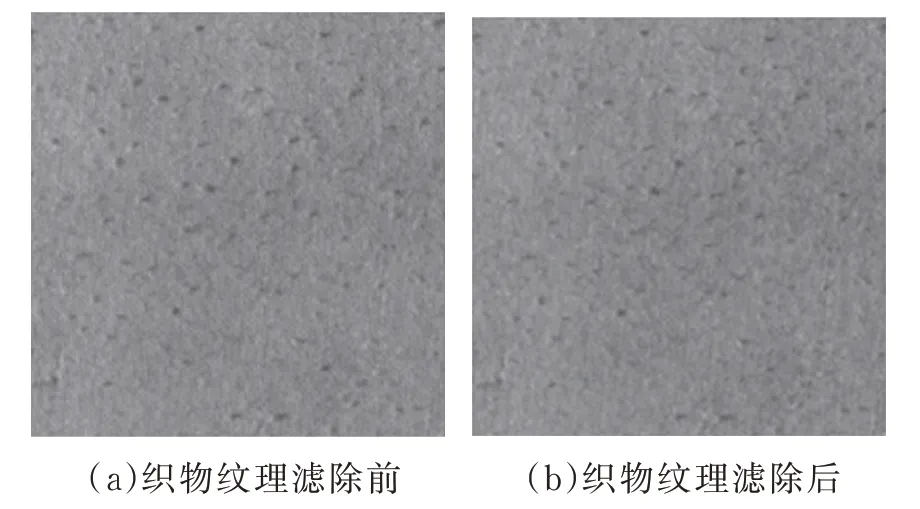

织物起球等级的客观评定主要以毛球的数量和大小分布为依据,织物纹理的存在会引入无关干扰项,进而影响后续CNN 模型的测试准确率,因此需要将织物纹理滤除。

主要过程:对上述步骤提取得到的起球区域图像进行快速傅里叶变换获得频谱图,并绘制对应的三维频谱,分别如图4(a)和图5 所示,其中的亮点对应高频纹理分量;取频率幅值的50%作为阈值过滤高频分量,滤波后的频谱如图4(b)所示;最后再通过傅里叶逆变换即可获得纹理滤除后的图像。织物纹理滤除前后标准样照局部图像如图6 所示。

图4 起球标准样照对应的频谱图

图5 三维频谱图

图6 起球标准样照局部图像

2 CNN 模型

2.1 数据集制作

由于原始的起球标准样照图像太大,不适合直接输入CNN 模型进行训练,因此需要对原始图像进行分割采样获取子样本。采样程序基于Py⁃thon 软件完成,子样本分割采样示意图如图7所示。

图7 子样本分割采样示意图

为了增加数据量,采样过程为横向按照10 pixel固定步长有重叠采样,纵向采用不重叠采样,每个子样本要求包含完整的起毛区域而不包含任何背景像素。

2.2 模型搭建

CNN 是一种带有卷积结构的深度学习模型[9],主要包括卷积层、池化层和全连接层,每一层有多个特征图,而每个特征图对应通过卷积滤波器提取的某种特征。与传统的神经网络模型相比,CNN 通过局部感受野、权值共享、池化层等思想,有效减少了网络的参数个数,缓解了模型的过拟合问题,并使得模型具有一定程度的位移、尺度、缩放、非线性形变稳定性。

本研究所使用的训练CNN 的工作站配置为Intel i7 六 核CPU,64 GB DDR4 内 存 和4 块NVIDIA GTX1080Ti 显存12 GB 的GPU,Ubun⁃tu18.04 系统。本研究所设计的CNN 模型包含3个卷积层和2 个全连接层,选用目前学术界常用的PyTorch 框架进行搭建。在训练阶段,CNN 使用训练集样本对应的起球等级标签训练模型,在测试阶段则利用训练好的模型对测试集中未知标签样本的起球等级进行预测。

3 结果与讨论

按照2.1 节所述子样本采样方式,设置了4种不同的子样本大小,表2 详细描述了按照这4种不同大小进行采样所构建的训练集、测试集样本数量。

表2 训练集、测试集样本数量

将训练集样本作为输入进行2.2 节所述CNN 模型的训练,再将测试集样本输入训练好的模型中,获得起球等级客观评定测试结果。取模型预测的起球等级与实际起球等级一致的测试集样本数为Nc,测试集样本总数为N,定义织物起球等级客观评定准确率,见式(1)。

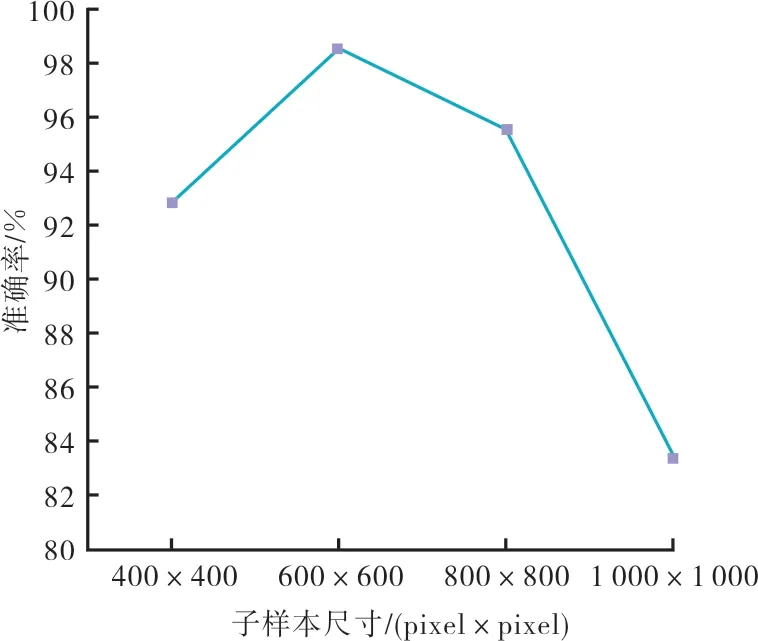

子样本大小对起球等级客观评定准确率的影响如图8 所示。可以看出,尺寸为600 pixel×600 pixel 的子样本集训练所得模型具有最高的评定准确率,准确率可达98.5%,这主要是因为小尺寸子样本会导致毛球被分割开的概率增大,影响模型对毛球数量和大小分布的拟合结果;另外,子样本尺寸越小其对应的数据集样本数量越多,容易发生过拟合;同样,大尺寸子样本所构建的数据集数量较少,训练出的CNN 模型欠拟合,导致评定准确率急剧下降。

图8 子样本尺寸对起球等级客观评定准确率的影响

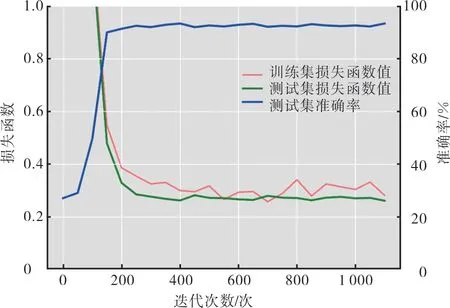

子样本大小为600 pixel×600 pixel 时,CNN模型中训练集的损失函数值以及测试集的损失函数值和测试集上的准确率曲线如图9 所示。在迭代次数为200 次左右时,模型快速趋于收敛,并在后续训练过程中保持稳定,织物起球客观评定准确率始终保持在95%以上,这说明使用CNN模型来评定织物起球等级是可行的,并且可以达到实时性要求。

图9 600 pixel×600 pixel 子样本对应的准确率曲线

曹飞等人与周圆圆等人同样使用精纺毛织物标准样照作为研究对象,并利用频域滤波去除了织物纹理分量,但他们并没有提取整个圆形起球区域,而是针对圆形起球区域的最大内接正方形部分进行分析。另外,其后续试验主要利用基于图像灰度值的阈值分割算法提取毛球的位置、面积等人工设计特征,并没有给出所设计方法在大批量样本情况下的准确率。GUAN S Q 等人利用小波分解和阈值分割相结合的方法提取毛球的二值图像,然后提取毛球的面、位置等信息,最后输入BP 神经网络进行训练,最终的准确率最高可达95%。相较而言,本研究所提方法等级评定准确率最高达到了98.5%,并且不需要提取人工设计特征,而是利用CNN 强大的特征提取能力自动寻找样本的最合适特征,精简了图像处理流程;适用于各种不同的织物起球等级评定,从而提高了泛化能力。

4 结论

本研究以精梳毛织物起球标准样照作为研究对象,使用扫描仪完成了图像扫描,运用Mat⁃lab 软件完成了圆形起球区域的提取和织物纹理分量的滤除,运用Python 软件实现了基于整个圆形起球区的子样本分割采样,在此基础上,搭建基于CNN 的织物起球等级客观评定模型,并研究了子样本尺寸对评定准确率的影响。分析结果表明,子样本尺寸为600 pixel×600 pixel 时,评定准确率可达98.5%,验证了所提方法的可行性和有效性,但CNN 的泛化性还有待进一步研究。