医疗人工智能安全监管主体责任调查研究*

茅鸯对,沈 茜,王维标,丁 静

(浙江医药高等专科学校,浙江 宁波315000)

《新一代人工智能发展规划的通知》(国发〔2017〕35号)指出,到2025年新一代人工智能(AI)会在智能医疗领域得到广泛应用。AI正成功地应用于放射学、病理学和皮肤病学的图像分析,其诊断速度可超过医学专家,且准确性与之相当[1],在提高诊疗效率的同时能降低医疗成本。医疗AI对医师的诊断和决策具有重要的导向作用,一旦失误,可能危及患者的生命安全。北京智源人工智能研究院联合北京大学、清华大学、中国科学院自动化研究所等发布的《人工智能北京共识》指出,要为未来打造“负责任的、有益的”AI,实现这一目标的前提是确立医疗AI诊断主体,明确侵权责任归属,但我国尚未出台相关法律规范、评价标准与方法规范[2]。本研究中通过实证调研分析,探讨医疗AI诊断器械的主体责任相关焦点问题,以期为监管部门完善法律规范提供参考。

1 对象与方法

1.1 调查对象

药械监管系统人员、医疗机构医务人员、药械企业人员(含AI企业人员)、医药类高校教师、医疗器械专业(精密医疗器械、医疗器械检验与注册、医疗器械经营与管理)学生。

1.2 调查方法

采用文献分析法、专家访谈法进行医疗AI诊断主体责任相关焦点问题摸底,结合专家意见进行问卷设计,最终通过问卷调查法开展调研工作。

1.3 统计学处理

采用SPSS 22.0统计学软件分析。对医疗人工智能诊断法律主体资格、责任主体、侵权责任归属等问题进行描述性统计,对不同职业、学历、职称与主体责任相关问题的关系采用χ2检验,以P<0.05为差异有统计学意义。对医疗AI诊断主体责任评价指标体系采用探索因子分析法。

2 结果

2.1 问卷基本情况

本次调查共发放问卷155份,回收有效问卷150份,有效回收率96.77%。调查对象的职业分布情况,药械监管系统人员25人(16.67%)、医疗机构医务人员27人(18.00%)、药械企业人员45人(30.00%)、医药类高校教师23人(15.33%)、医疗器械专业学生30人(20.00%)。职 称 分 布 情 况,初 级 职 称20人(13.33%)、中级职称37人(24.67%)、高级职称21人(14.00%)、无职称72人(48.00%)。学历分布情况,大学专科12人(8.00%)、大学本科61人(40.67%)、硕士研究生64人(42.67%)、博士研究生13人(8.66%)。

分析问卷Cronbach信度,统计可得Cronbach′sα=0.748(>0.7),表明研究数据信度良好;采用KMO抽样适当性检查和Bartlett′s球形检验进行数据效度分析,KMO=0.757(>0.5),说明研究数据结构效度良好。

2.2 主体责任相关问题

产品应用潜在风险多:受访者认为,AI在应用中会出现诸多问题,包括误诊、漏诊风险(89.33%),与医院使用需求不配套(46.00%),应变能力差(79.33%),诊断效率提升不明显(36.67%),造成院方数据泄露(52.00%),伦理风险(3.33%)。

法律主体资格存在争议:对于可否赋予医疗AI法律主体资格,57人(38.00%)认为可以,57人(38.00%)认为弱AI时代不可以,强AI时代可以,36人(24.00%)认为不可以。交叉分析结果显示,不同职业(χ2=12.919,P=0.040)和不同学历(χ2=15.791,P=0.045)人群对医疗AI法律主体资格认定结果有显著差异,而不同职称者(χ2=9.744,P=0.136)的认定结果无显著差异。

责任主体不单一:123人(82.00%)认为虽然AI技术革新,仍不能完全替代医师进行诊断,27人(18.00%)则认为可以。不同职业、学历、职称人群对于医疗AI能否替代医师的判断结果均无显著差异(χ2=3.563,4.220,0.580,P=0.313,0.377,0.901)。表明大部分被访者坚定支持医师在诊断中的核心地位,小部分被访者信任医疗AI的诊断。选择设计者、生产者、医疗机构、医师作为医疗AI诊断责任主体的分别有80人(53.33%)、63人(42.00%)、91人(60.67%)、86人(57.33%)。

侵权责任需由多方承担:对于医疗AI诊断失误造成医疗损害的侵权责任,104位被访者(69.33%)认为应厘清设计者、生产者、医疗机构等各方职责,合理分配各自责任,24位被访者(16.00%)认为应由生产者、医疗机构承担连带赔偿责任,13位被访者(8.67%)认为应由设计者、生产者承担连带赔偿责任,9位被访者(6.00%)认为应由医院或医师承担责任。不同学历人群对于侵权归责的判定有显著差异(χ2=30.607,P=0.002),不同职业人群与不同职称人群的判定无显著差异(χ2=13.231,6.867,P=0.152,0.651)。

2.3 主体责任评价指标的构建

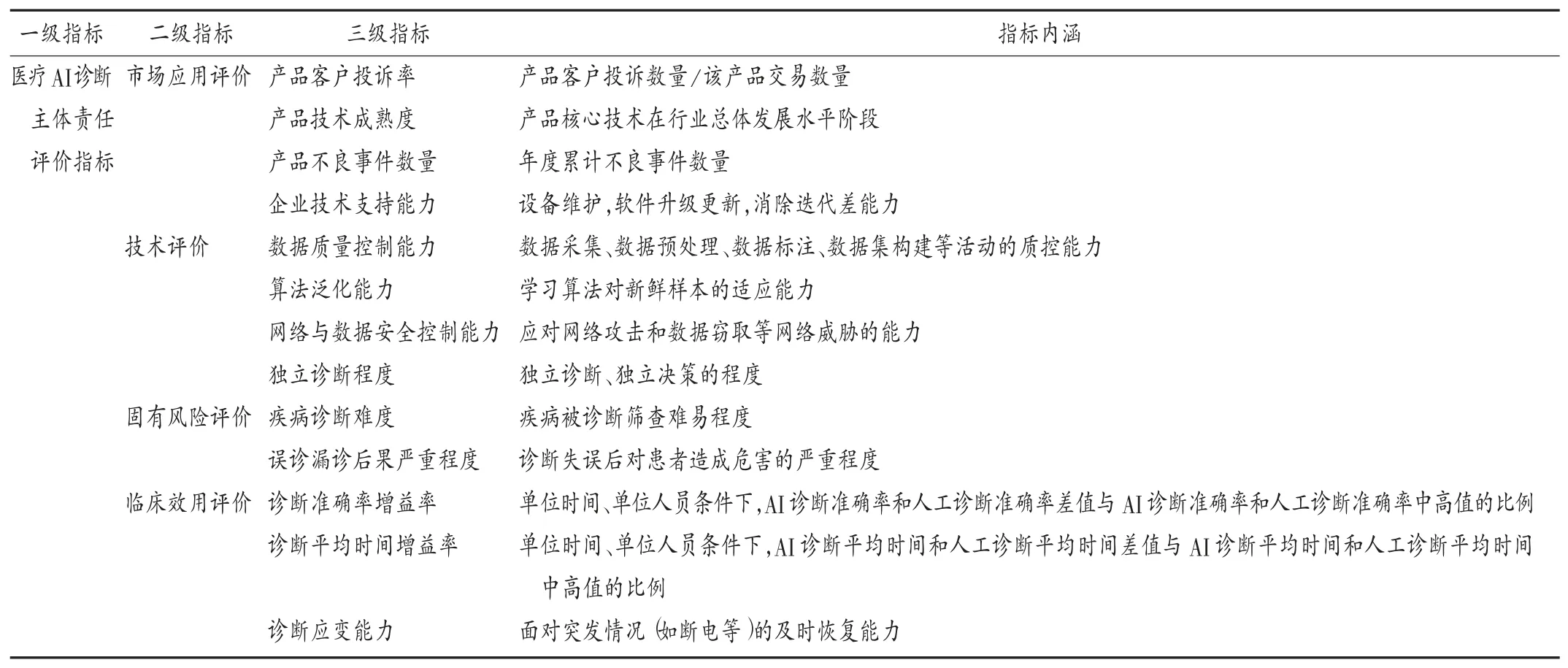

以国家药品监督管理局医疗器械技术审评中心《深度学习辅助决策医疗器械软件审评要点》、国家卫生健康委员会《人工智能辅助诊断技术临床应用质量控制指标(2017年版)》等为依据,结合专家调研,梳理出13个医疗AI诊断主体责任评价指标,进行探索性因子分析。

信度、效度检验:信度检验处理数据后得Cronbach′s α=0.892(>0.8),说明信度高;对有效样本数据进行KMO抽样适当性检验和Bartlett′s球形检验,检验结果显示,KMO=0.859(>0.5),Bartlett′s球形检验的χ2值为977.798(自由度为78),达到显著水平(P=0.000<0.01)。数据显示,样本数据结构效度良好,可进行因子分析。

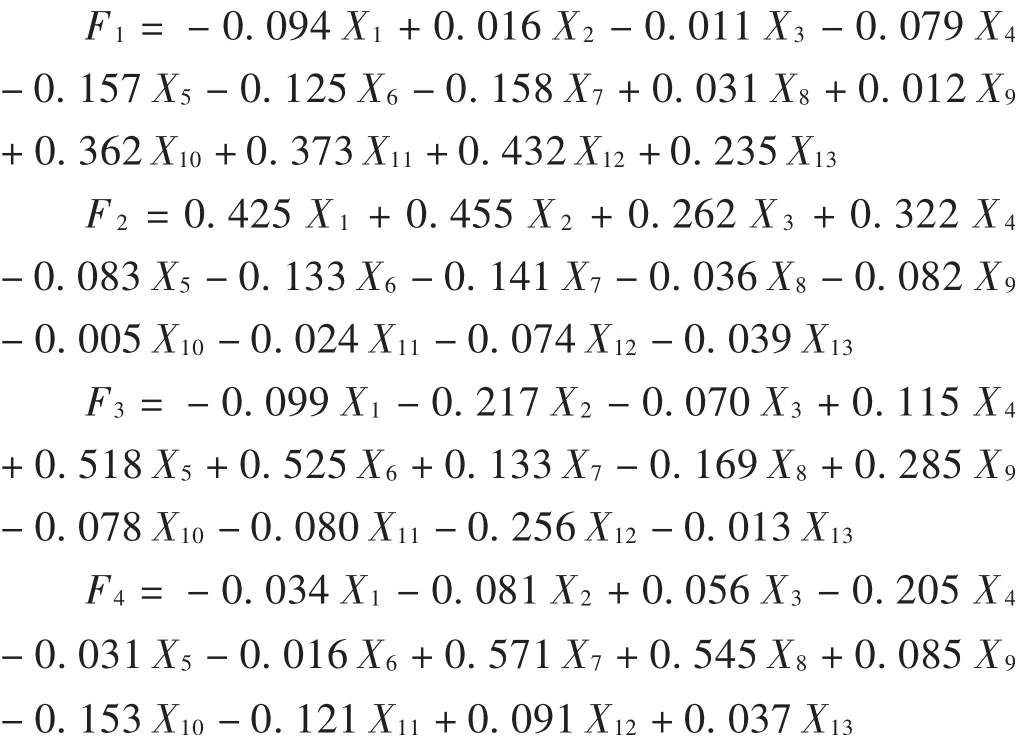

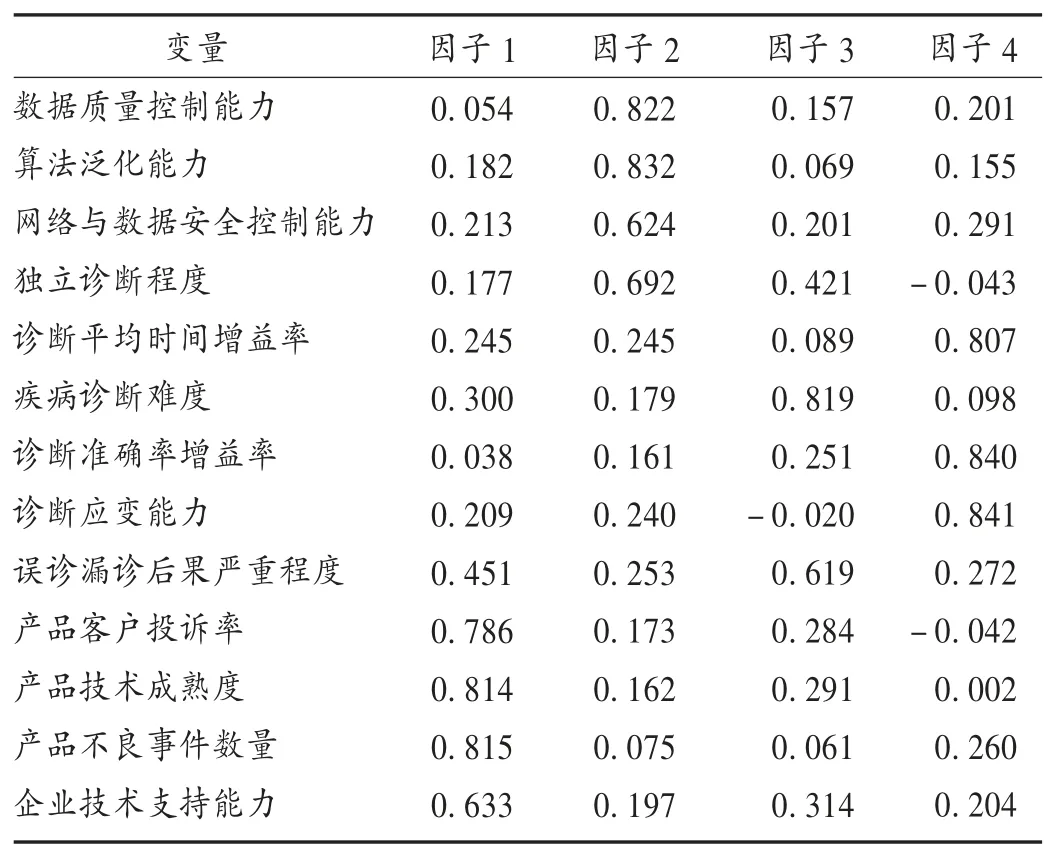

因子分析结果:采用主成分分析法提取公因子,对13个指标进行Varimax方差正交旋转,最终提取特征值大于1,得出3个公因子累计方差贡献率为66.276%,旋转后成分矩阵各因子解释度差。故将提取公因子设定为4个,累计方差贡献率为72.923%。根据因子分析解释的总方差(见表1),计算评估总指标公式如下。

F=(21.955F1+19.819F2+17.557F3+13.591F4)/72.923

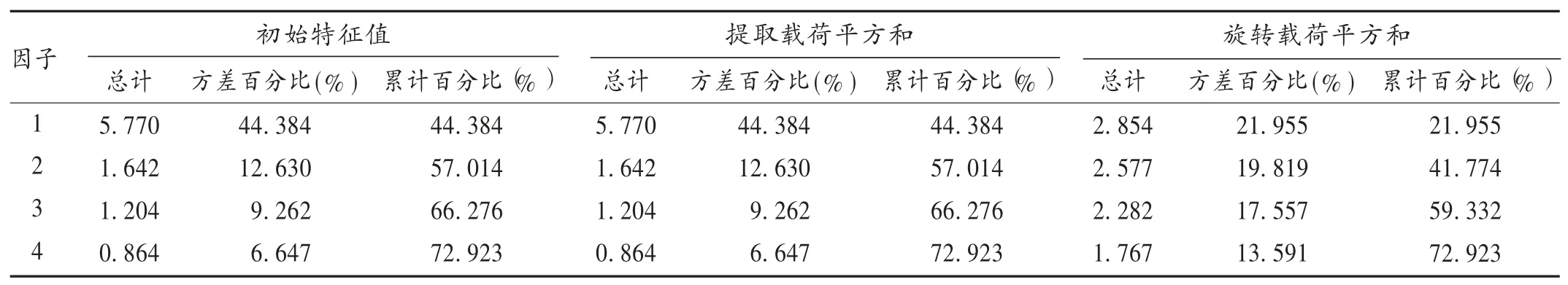

正交旋转后得到的因子负荷矩阵见表2。某个公因子下的变量旋转成分值大于0.5时,此变量应归属于此公因子。梳理13项指标,可得医疗AI诊断主体责任评价指标体系(见表3),通过旋转后因子得分系数矩阵可得出如下各公因子的得分公式。

表1总方差解释

表2旋转后的因子矩阵

3 讨论与建议

3.1 按AI强弱确立产品法律主体资格及责任主体

医疗AI诊断产品隐患较多,成为其大规模实施的障碍,亟须明确主体责任边界。不同医疗AI诊断产品独立诊断与决策能力不同,对医师工作帮助程度有所区别。考虑到应用场景的特殊性,其责任主体并不单一。国家卫生健康委员会医院管理研究所人工智能蓝皮书《中国医疗人工智能发展报告(2019年)》指出,现阶段的弱AI医疗诊断器械在不同程度上需借助人类智慧,受人类的操作与监管,其地位等同于普通医疗器械,不能赋予其法律主体资格。鉴于存在大量混合责任的情况[3],设计者、生产者、医疗机构、医师等均是相关责任主体。强AI拥有独立思考及决策能力,具备自我感知和行为能力,可赋予其享有同人类平等的权利并承担相应责任义务[4],但考虑到其能承担的法律后果有限,建议将其确立为具有特殊性质的法律主体[5],即具有有限法律人格。

表3医疗人工智能诊断主体责任评价指标体系

3.2 医疗AI应用需遵循权责一致原则

医疗AI存在算法泛化能力弱、重复性和再现性差、鲁棒性设计缺乏等问题[6],诊断结果容易出现漏诊、误诊、错诊,给患者带来生理伤害和精神伤害,构成额外的经济负担。医疗AI技术应用方面应遵循权责一致原则[7],设计者、生产者、经营者、使用者等责任主体应严格遵守伦理道德与法律规范,切实履行自身权利和责任。AI诊断产品致损后要追溯原因,判定后按《产品质量法》和《产品侵权法》进行追责。侵权责任归责前,首先要明确AI诊断产品对诊断结果的影响程度及其自身定位。若注册时在适用范围项明确写明其能进行有效决策,则加重制造商的责任;若表明其仅起辅助筛查作用,医师仍需结合患者病史、基础病症、身体状况进行综合判断,则应以医师为重要归责对象。为合理分散举证负担,受害者向主要责任者索要赔偿,主要承担者可向其他方追偿。同时,建议建立以责任保险制度为核心的综合救济体系[8],提高社会救济能力。

3.3 主体责任评价体系的应用

医疗AI诊断主体责任评价指标体系的构建有利于企业“内部监管+外部监管”并行,充分激发企业活力,释放技术红利。企业每年结合指标体系开展内部自查,及时纠正问题,向监管部门提交年度报告。建议开启多元共治新篇章[9],监管部门邀请行业专家、行业协会、媒体、公众代表等多方共同开展评价工作,结合评价结果对企业开展分级分类监管,制订《医疗人工智能诊断产品重点监管目录》,对主营品种在目录范围内且主体履责严重不到位的企业予以重点监管,对主体履责到位的企业予以宽松监管,合理分配有限的监管资源,提高监管效能。对主体责任评价结果进行年度公告,对表现极差的企业予以警示,并加强日常监管;对表现优异的企业予以表扬。医疗AI安全监管正面临平衡创新与风险的难题,公众对AI主体的信任是至关重要,而可信任AI唯有具备诚实、一致性、可靠性、透明度、公平性五大特性,才能真正提高公众满意度,提升健康服务质量。