基于颜色通道融合特征的现勘图像分类算法

刘颖 张倩楠 王富平 雷研博 公衍超 杨凡超

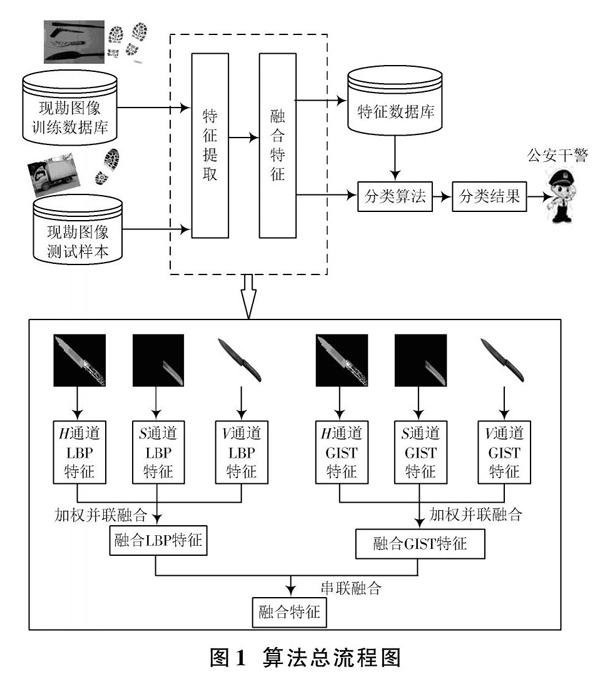

摘 要: 针对单一特征难以精确地表达复杂图像内容的问题,提出基于颜色通道融合特征的现勘图像分類算法。首先,分别在H,S和V三个颜色通道上提取图像的 LBP 特征和GIST特征,并利用颜色空间信息进行加权融合;然后,将融合的LBP和GIST特征串联形成新的特征描述向量,并用于训练分类器以实现精确地现勘图像分类。在现勘图像数据库上,大量实验结果显示提出的现勘图像分类算法优于基于单一特征的图像分类正确率。

关键词: 现勘图像分类; 颜色通道; 特征提取; 特征融合; 训练分类器; 实验分析

中图分类号: TN911.73?34; TP391.41 文献标识码: A 文章编号: 1004?373X(2020)04?0067?06

Crime scene investigation image classification algorithm based on color

channel fusion features

LIU Ying1,2, ZHANG Qiannan1, WANG Fuping1, LEI Yanbo1, GONG Yanchao1, YANG Fanchao3

(1.Institute of Image and Information Processing, Xian University of Posts and Telecommunications, Xian 710121, China;

2. Key Laboratory of Electronic Information Application Technology for Scene Investigation, Ministry of Public Security, Xian 710121, China;

3. Key Laboratory of Spectral Imaging Technology, Xian Institute of Optics and Precision Mechanics, Chinese Academy of Sciences, Xian 710119, China)

Abstract: A crime scene investigation (CSI) classification algorithm based on color channel fusion feature is proposed to solve the problem that it is difficult for a single feature to accurately express the complex image content. The LBP features and GIST features of the image are extracted from the three color channels of H, S and V respectively, and the weight fusion of them is performed with the color space information. The fused LBP and GIST features are connected in series to form a new feature description vector, which is used to train the classifier to realize accurate classification of the CSI image. On the CSI image database, a large number of experimental results show that the classification accuracy of the proposed CSI image classification algorithm is better than that of image classification based on a single feature.

Keywords: crime scene investigation image classification; color channel; feature extraction; feature fusion; training classifier; experimental analysis

0 引 言

随着公安刑侦现勘技术的发展及现勘采集设备质量的提升,采集到的现勘图像数据规模迅速增长。而现勘图像数据内容丰富多样,对现勘图像数据的精确分类可以提高办案人员的工作效率[1?2]。特征提取是实现图像分类处理的关键环节,而常用的低层图像特征包含颜色特征、纹理特征、形状特征和空间特征。

颜色空间是颜色信息的表达方式,不同的颜色空间反映不同的颜色特征。常见的颜色空间有RGB,HSV,HIS和YCrCb等[3]。很多文献将纹理特征、形状特征等应用在不同颜色空间,用极值融合模式、求和融合模式和编码模式[4]等方法提高图像分类和检索的性能。文献[5]提出了一种使用联合降维算法的颜色通道融合方法,通过HSV三通道中选择更加可靠的特征进行人脸识别。文献[6]提出了一种对光照强度具有不变性的纹理描述子,通过融合局部二值模式(Local Binary Pattern,LBP)和颜色对比度特征以构建新描述子,并采用夹角余弦相似性度量方法进行纹理图像的分类。文献[7]引入RGB颜色空间,分别对RGB三个通道计算局部GIST特征,串联得到颜色局部GIST特征。文献[8]使用联合颜色通道和分层二进制模式进行快速和鲁棒的旋转不变对象检测的方法,用作众所周知的级联AdaBoost中的分类器实现分类。文献[9]使用卷积神经网络(Convolutional Neural Networks,CNN),对比RGB,HSV和CIE Lab三种颜色空间中公共车辆的识别模型,选择效果最好的RGB颜色空间提升智能交通系统的性能。

以上研究表明,在不同颜色空间提取低层特征并进行合适的融合,可以有效提高图像的检索与分类准确率。但是,特征層融合会面临特征空间不匹配或“维度灾难”等不足。本文提出一种新的颜色通道特征融合算法,在不增加特征维度的条件下,有效地融合了HSV颜色空间的三个通道上的LBP局部纹理特征和GIST全局特征。首先,在HSV三个通道上分别提取图像的LBP特征和GIST特征,并在颜色空间上进行加权并联融合;然后,将融合的LBP和GIST特征进行串联形成最终的特征向量,并用于训练分类器实现图像分类。提出的算法既能将图像的颜色特征、局部特征和全局特征进行有效融合,又避免了多特征融合造成的“维度灾难”。实验结果证明了该算法能提高现勘图像的分类正确率。

1 基于颜色通道融合特征的现勘图像分类算法

现勘图像数据库包含局部信息突出和场景复杂的类别,为了更有效地描述多种类别现勘图像内容,本文使用描述局部纹理的LBP特征和适用于场景分类的GIST特征来描述现勘图像。LBP特征对于有丰富纹理细节的图片十分有效,比如鞋印、指纹、皮肤和轮胎花纹;而GIST特征描述符适用于描述全局场景,所以对现勘图像中场景比较复杂的图片描述有效。

本文提出的基于HSV颜色通道融合特征的现勘图像分类算法,包括三个环节:

1) 在HSV三个通道上分别提取图像的LBP特征和GIST特征;

2) 对LBP特征和GIST特征分别进行加权并联,并对融合LBP和GIST特征进行串联融合。

3) 对融合特征进行分类器训练,并基于SVM对图像分类。

1.1 基于颜色通道的LBP特征

Ojala等人针对纹理图像提出LBP方法[10],该方法具有抗光照性、旋转不变性等优点,被广泛应用在纹理特征提取和人脸识别为代表的诸多图像处理和计算机视觉领域。随后也有学者们提出改进的LBP算法。基于HSV颜色空间的LBP特征考虑到不同颜色空间的纹理特征,且H,S和V三个颜色通道独立性强,进而提升了分类的正确率,同时HSV颜色空间的三通道融合也增强了通道间的鲁棒性。

首先,对彩色图像进行H,S和V三通道分离。然后,为了考虑特征的位置信息,将每个通道图像均匀划分为[2×2]个子块,通过式(1)和式(2) 计算每个子块中各像素的LBP值。最后,对各子块进行直方图统计,得到[2×2]个子块的LBP直方图,将各子块直方图级联起来描述各通道图像的纹理特征[LBPtG],其中,[t=H,S,V],有:

[LBPtix,y=n=1Nlbptnx,y*2n-1] (1)

式中:

[lbptnx,y=1, ftn(x,y)≥ft(x,y)0, 其他](2) [ftn(x,y)]表示图像第t个颜色通道邻域中第n个像素点的灰度值;[ ft(x,y)]表示图像第t个颜色通道上中心像素点[(x,y)]的灰度值。

1.2 基于颜色通道的GIST特征

现勘图像很多类别是对案发场景的描述,GIST描述符作为全局特征很适合用于场景图像。GIST特征最初是由Oliva提出的[11],其使用一系列统计属性来描述图像场景信息,包括自然度、开放度、粗糙度等属性[12]。构建GIST描述子步骤如下:

1) 在H,S和V三通道上分别对大小为[m·n]的图像[ftx,y]划分为均匀的[na·na]个网格,则每个网格的大小为[mna·nna],其中,[t=H,S,V]。

2) 用[nc]个Gabor滤波器分别对三个通道的图像进行卷积滤波,每个网格滤波后的结果是块特征。

[nc=m·n] (3)

式中:[m]为滤波器的尺度数;[n]为滤波器的方向数。

[Gtix,y=catncftx,y*gmnx,y] (4)

式中,[i=1,2,…,na·na];[ftx,y]中[x,y]为第[i]小块中的坐标值;[Gti]的维数为[mna·nna·nc]。

3) 将上述每一小块计算出的特征值取平均值,得到该小块的GIST描述子特征:

[Gtnc=1mna·nna(x,y)Gtnc(x,y) ] (5)

式中:[Gtnc]表示在第[nc]个滤波后所产生的平均特征值;[Gtnc(x,y)]表示第[nc]个滤波后所产生的特征值。

4) 将每个网格产生的平均特征值级联起来,得到各个通道图像的全局GIST特征[GtG],再将三通道的GIST特征进行加权并联,最终得到三通道融合GIST特征。

1.3 融合特征

根据现勘图像的类别和特点,单一特征只能表达图像的部分特征,为了更全面地描述现勘图像各类别的内容信息,本文从颜色空间上对特征进行并联融合,然后串联LBP局部特征和GIST全局特征。

1) 特征并联融合

设样本空间[θ]的三个通道提取特征是A,B和C,特征向量表示为 [α∈A,β∈B,γ∈C]。并联特征融合方法是将[α,β,γ]三个特征量融合成一个特征量[μ],公式如下:

[μ=ω1*α+ω2*β+ω3*γ] (6)

式中,[ω1,ω2,ω3]为权重系数,其中权重系数同时满足以下约束条件:

[0≤ω1,ω2,ω3≤1ω1+ω2+ω3=1] (7)

因为在三通道提取相同的特征,所以[α,β,γ]三个特征量维度相同,且融合特征量[μ]的维度也相同。例如,[α=α1,α2,α3T],[β=β1,β2,β3T]和[γ=γ1,γ2,γ3T],然后加权成为融合特征[μ],即:

[μ=ω1*α1+ω2*β1+ω3*γ1ω1*α2+ω2*β2+ω3*γ2ω1*α3+ω2*β3+ω3*γ3] (8)

通过实验得出:当三个通道的LBP特征[LBPTG]权重系数为1∶2∶7时分类正确率最高,三个通道的GIST特征[GGG]权重系数为0∶1∶9时分类正确率最高。

2) 特征串联融合

将提取的LBP特征与三个通道的GIST特征进行串联融合,图像最终融合特征[F]为:

[F=cat(2,LBPTG,GGG )] (9)

1.4 SVM多分类

目前,构造SVM多类分类器的方法有直接法和间接法。直接法是将多个分类平面的求解看作一个最优化问题,通过求解该最优化问题实现多分类。间接法的常见方法有一对一分类(One?Versus?One,OVO)和一对多分类(One?Versus?Rest,OVR)两种。本文按照一对多方法构造核函数是RBF(Radial Basis Function,RBF)[13]核的SVM分类器,随机选择每个类别样本数的60%作为训练样本,将剩余40%数据作为测试样本。

2 实验结果

2.1 实验数据库

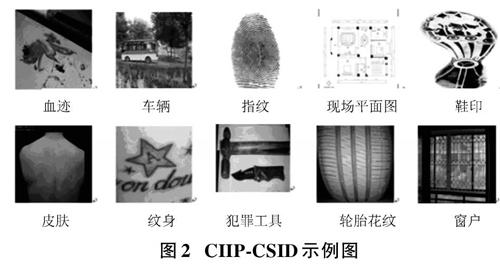

1)CIIP?CSID数据库[14](CIIP Crime Scene Investigation Image database,CIIP?CSID):由西安邮电大学图像与信息处理研究所(Center for Image and Information Processing,CIIP)结合刑侦特殊行业的真实数据,自建的现勘图像数据库。该数据库包含19 363幅图片,共计52类,包括各类典型案件,如盗窃案、凶杀案、伤害案、破坏案等。实验选取CIIP?CSID数据库中血迹、车辆、指纹、现场平面图、鞋印、皮肤、纹身、犯罪工具、轮胎花纹、窗户10个类别,每个类别500幅图像,数据库共5 000幅图像,图2为CIIP?CSID示例图。

2) Corel?1K数据库:Corel?1K数据库包含非洲、海滩、建筑、公共汽车、恐龙、大象、鲜花、马、山和食物10个类别,每个类别100幅图像,共1 000幅图。

2.2 分類性能评价指标

分类性能的评价参数选用正确率(Accuracy)为:

[Accuracy=TN×100%] (10)

式中:T为正确分类样本个数;N为总样本个数。当Accuracy值越高,说明分类的效果越好。

2.3 实验结果与分析

1) 实验1:不同通道的特征分类结果对比

在CIIP?CSID数据库上分别比较H,S,V三个通道、三个通道的融合以及原始的LBP特征和GIST特征对于图像分类结果的影响。其中,LBP特征为[2×2×256=1 024]维特征;GIST特征把刑侦现勘图像划分成[4×4]的网格,用4尺度8方向的32个Gabor滤波器处理,最终得到图像[4×4×32=512]维的GIST特征。不同通道的LBP特征分类结果如表1、表2所示。

可以看出,三通道融合的LBP特征整体的平均正确率与H,S和V三个通道以及原始LBP特征相比分别提高3.08%,7.74%,2.19%,3.85%。三通道融合的GIST特征整体平均正确率与其他特征相比分别提高9.19%,6.97%,1.41%,1.77%。

2) 实验2:不同特征提取算法的分类结果对比

在CIIP?CSID数据库上将本文算法与HSV直方图特征、HOG特征、颜色矩特征、四层小波特征、词袋(Bag?of?words,BOW)特征、CNN特征进行比较。其中CNN特征是以VGG?19网络为基础,在ImageNet数据集上进行模型预训练,再利用迁移学习训练现勘图像CNN模型执行分类任务。从表3中看出,本文算法的平均分类正确率高于低层特征,但与CNN特征相比较,分类正确率相差3.49%。CNN特征通过对样本进行不断学习与训练,在多目标图像类别中表现突出,如“血迹”“车辆”“现场平面图”“纹身”“犯罪工具”“作案工具”“窗户”这些类别中CNN特征的正确率高于本文算法。而在单目标图像类别中,“指纹”“鞋印”“皮肤”“轮胎花纹”类别中本文算法的正确率略高与CNN特征。卷积神经网络在图像分类中有很好的分类效果,但在训练时间上与本文算法平均每张图像多出0.047 s的时间,见表4。当训练样本过大时,卷积神经网络的时间复杂度很高。

此外,笔者已经利用迁移学习方法进行现勘图像分类实验并取得较好结果。但由于CIIP?CSID数据库数量规模不够大,神经网络无法得到充分训练,难以发挥CNN的强大性能。因此,下一步工作中将研究如何将所提出的低层图像特征与CNN特征结合来进一步提高分类效率。为了验证本文算法的适用性, 在Corel?1K数据库上比较本文算法、HSV直方图特征、HOG特征、颜色矩特征、四层小波特征BOW词袋特征、CNN特征。如表5所示,在Corel?1K数据库上本文的分类正确率高于其他低层特征提取算法,但平均正确率低于CNN特征的正确率。然而“建筑”“大象”“鲜花”“山”这些单目标的图像类别,本文算法的正确率接近于CNN特征的正确率。可以看出本算法无论是现勘数据集还是Corel?1K数据库,对于图像场景复杂、目标不明确的图像的分类性能还需要提高。

3) 实验3:CIIP?CSID上不同融合特征以及不同融合系数的分类结果

三通道融合LBP及GIST特征不同权重的分类结果如图3、图4所示。

可以看出,当融合LBP特征中的三个通道特征的权重系数为1∶2∶7时比其他权重的正确率要高,在现勘图像数据库上平均分类正确率为84.72%。当GIST的三个通道特征的权重系数为0∶1∶9时可以获得最高的分类正确率,在现勘图像数据库上平均分类正确率为91.22%。可以看出,当 GIST场景描述符分离在三个通道上时,H通道相比其他通道提供的信息少,因此H通道不参与融合后的正确率最高。

图5是用LBP特征与GIST特征进行串联的结果和本文融合方法进行对比。可以看出,在LBP特征与GIST特征串联之前,对特征进行颜色空间上的加权并联融合能提高现勘图像每个类别的分类正确率。

3 结 语

为了提升现勘图像分类的正确率,本文提出一种基于颜色通道特征融合的图像特征提取算法。该算法有两点创新:

1) 将LBP特征和GIST特征应用在HSV颜色通道上,使最终融合特征包含局部LBP特征和全局GIST特征的同时加入图像颜色信息。

2) 在颜色通道中分别对LBP特征和GIST特征进行基于空间信息的加权融合及串联融合,在保证融合特征维度不变的同时,提高了其分类正确率。在现勘图像数据库上,实验结果表明本文提出的现勘图像分类算法的有效性。

注:本文通讯作者为张倩楠。

参考文献

[1] 刘颖,胡丹,范九伦.现勘图像检索综述[J].电子学报,2018,46(3):761?768.

[2] LIU Ying, PENG Yanan, LIM Kengpang, et al. A novel image retrieval algorithm based on transfer learning and fusion features [J]. World wide web?internet & web information systems, 2018(1): 1?12.

[3] SARAVANAN G, YAMUNA G, NANDHINI S. Real time implementation of RGB to HSV/HSI/HSL and its reverse color space models [C]// International Conference on Communication and Signal Processing. New Jersey: IEEE, 2016: 462?466.

[4] 刘涛,周先春,严锡君.多通道多模式融合LBP特征的纹理相似度计算[J].计算机应用研究,2018,35(12):289?292.

[5] LU Z, JIANG X, KOT A C. A color channel fusion approach for face recognition [J]. IEEE signal processing letters, 2015, 22(11): 1839?1843.

[6] CUSANO C, NAPOLANTANO P, SCHETTINI R. Illuminant invariant descriptors for color texture classification [C]// International Conference on Computational Color Imaging. Berlin: Springer, 2013: 239?249.

[7] 杨昭,高隽,谢昭,等.局部Gist特征匹配核的场景分类[J].中国图象图形学报,2013,18(3):264?270.

[8] KIM I, SUNG J, LEE D, et al. Fast and robust rotation invariant object detection with joint color channel and hierarchical binary pattern [C]// 2015 12th International Conference on Ubiquitous Robots and Ambient Intelligence. Goyang: IEEE, 2015: 1221?1225.

[9] RACHMADI R F, PURNAMA I K E. Vehicle color recognition using convolutional neural network [J]. Computer vision and pattern recognition, 2015(14): 41?46.

[10] OJALA T, PIETIKAINEN M, MAENPAA T. Multiresolution gray?scale and rotation invariant texture classification with local binary patterns [C]// European Conference on Computer Vision. Dublin: IEEE, 2000: 404?420.

[11] AUDE Oliva, ANTONIO Torralba. Modeling the shape of the scene: a holistic representation of the spatial envelope [J]. International journal of computer vision, 2001, 42(3): 145?175.

[12] DESAI R, SONAWANE B. Gist, HOG, and DWT?based content?cased image retrieval for facial images [M]. Singapore: Springer, 2017.

[13] GOWDA S N. Fiducial points detection of a face using RBF?SVM and adaboost classification [C]// Asian Conference on Computer Vision. [S.l.]: Springer, 2016: 590?598.

[14] Center for Image and Information Processing in Xian University of Posts and Telecommunications. “CIIP?CSID” Crime scene investigation image database [EB/OL]. [2017?04?19]. http://www.xuptciip.com.cn/show.html?database?xksjk04.