基于三维点云的甜菜根表型参数提取与根型判别

柴宏红,邵 科,于 超,邵金旺,王瑞利,随 洋,白 凯,刘云玲,马韫韬

基于三维点云的甜菜根表型参数提取与根型判别

柴宏红1,邵 科2,于 超2,邵金旺2,王瑞利2,随 洋2,白 凯3,刘云玲1,马韫韬1※

(1. 中国农业大学土地科学与技术学院农业部华北耕地保育重点实验室,北京 100193;2. 内蒙古自治区特色植物分子生物学重点实验室,内蒙古自治区生物技术研究院,呼和浩特 010070;3. 内蒙古自治区呼伦贝尔生态环境监测站,呼伦贝尔 021008)

为挑选产糖量高且适合机械化收获的甜菜根型,该文基于多视角图像序列,构建了207个基因型甜菜根的三维点云模型。基于三维点云提取了描述甜菜根形态特征的10个表型参数:最大直径、根长、凸包体积、顶投影面积、紧凑度、凸起率、凸起角、根头比、根尾比和根体渐细指数。与人工测定的最大直径和根长值进行校验,决定系数R均在0.95以上。其中根长、凸包体积及顶投影面积与生产指标呈极显著(<0.01)相关关系。采用稳定性较高的-medoids聚类算法将甜菜根型分为4类,结合专家知识获取理想根构型的主要特征为根型中等长度、比例适中。采用线性判别、随机森林、支持向量机、决策树和朴素贝叶斯5种预测模型进行根型判别。结果表明5种根系判别模型预测准确率均在70.0%以上,随机森林判别准确率达到81.4%。研究结果将为培育高品质和适应机械化生产的甜菜品种提供依据。

图像处理;机器学习;三维点云;甜菜;根型;表型;分类

0 引 言

甜菜(L.)是中国制糖工业的重要原料之一,其产糖量约占全国食糖总产量的10%[1-2]。近年来,随着机械化程度及配套种植技术的逐步提高,甜菜在内蒙古、新疆和黑龙江的种植面积不断扩大。发展甜菜产业对促进边疆和少数民族地区脱贫攻坚有重要的推动作用[3]。甜菜是以收获块根并从其中榨取糖分的经济作物。随着甜菜种植业从人工种植步入机械化时代,如何筛选适合当前规模化种植条件下大型机械收获的甜菜根型成为新阶段的首要任务。各种高通量传感器和多源图像处理技术的相继推出,极大地提高了表型数据的获取效率,保证了数据的客观准确性[4-5]。

基于图像分析技术可以快速准确地确定果实[6-7]、叶子[8-9]和根系形状[10-11]参数。Nankar等[6]通过构建番茄果实表型性状对应的数学模型,开发了可以半自动精确测量番茄果实表型性状的分析系统。吴正敏等[9]提出基于图像自动提取茶叶形态特征参数的方法,进一步提高了茶叶分选精度。孔彦龙等[10]基于图像提取马铃薯面积和周长,采用矩形度、圆形度、偏心率和不变矩等方法进行形状分类,可以对马铃薯质量进行初步筛选。Tsialtas等[2]基于图像分析了不同地点和年型间6个甜菜品种根型的差异,初步建立了根形参数与产量和品质之间的关系。

基于作物三维结构的植物表型分析进一步扩大了表型数据的维度,可以直接进行植物表型参数的精准提取,是建立植物表型-基因型研究最直接的桥梁[4]。研究人员已经基于多视角图像序列对温室内黄瓜、茄子、青椒等进行了三维重建,提取的表型参数精度较高[12]。Zhu等[13]将该方法用于对大田玉米、大豆等植株个体及群体生长动态的监测。尽管大田作物间遮挡严重,但通过去除待测植物周边的遮挡,三维重建效果较好。Mortensen等[14]基于田间莴苣植株三维点云进行植株分割及预测生物量,利用提取的植株表面积建立多种生物量预测模型,预测精度为84.0~94.0%。但基于三维模型对不同基因型甜菜根型表型的研究和精准分类预测目前还未见报道。

应用机器视觉技术,采用三维重建的方法对甜菜根型进行表型数字化处理与自动分类是重新定义甜菜根型并进行精准筛选的需要,也是甜菜从机械化农业步入精准农业阶段的需要。因此,本文基于多视角图像序列,构建了207个不同基因型甜菜根的三维点云模型,开发了自动提取表型参数的程序。采用-medoids算法实现了对甜菜根型的精准分类。通过比较不同分组的表型参数差异,初步筛选出适合机械化种植的甜菜理想根型。以专家对甜菜根型调整后的分类结果为测试集,基于线性判别、随机森林、支持向量机、决策树、朴素贝叶斯5种模型对根型进行精准预测。以期用于今后甜菜根型的分类判别,快速筛选适合机械化种植的甜菜根型。

1 材料与方法

1.1 田间试验

田间试验在内蒙古生物院凉城试验基地(112.28E,40.29N)进行,该地属于中温带半干旱大陆性季风气候。年均气温为2~5 ℃,年日照时数3 026 h,有效积温2 600 ℃。甜菜栽培土层为0~30 cm,土壤有机质质量分数1.80%,全氮量1.03 g/kg,有效磷23.09 mg/kg。试验材料为207个不同基因型的甜菜根。其中73个是国内品种,来源于新疆农业科学院、内蒙古自治区生物技术研究院、内蒙古农业大学和中国农业科学院甜菜研究所,82个来源于荷兰、20个来源于英国、30个来源于德国、2个源于俄罗斯。种植方式为机械覆膜打孔人工点播,行距40 cm,株距25 cm。甜菜根在出苗后140 d采用人工挖掘收获,并测量甜菜根生物量和含糖率。采用iPhone 8 plus手机获取甜菜根多视角图像序列,相机镜头位置至甜菜根的距离不固定,以能拍摄到甜菜根清晰图像为准。本研究中相机镜头保持在距甜菜根50 cm左右范围内,每张图像角度间隔8°,环绕拍摄2圈,以保证图像间的重叠度和重建三维点云的密度。手机像素为4 032×3 024,焦距为3.99 mm,快门速度为0.01 s,光圈数为/1.8,ISO感光度为32。每个甜菜根获取的图像数量在100~120之间。

1.2 三维点云重建与表型参数提取

1.2.1 三维点云重建

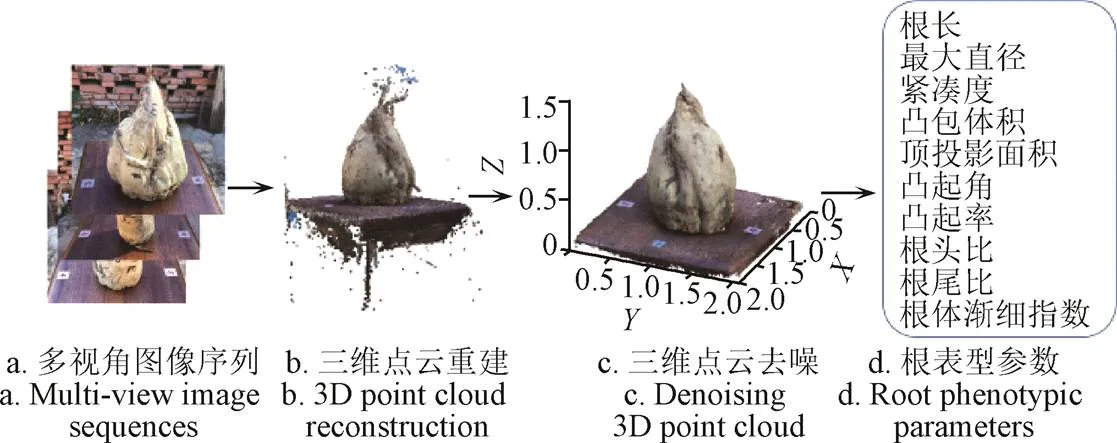

基于获取的甜菜根多视角图像序列(图1a),采用3DF Zephyr Aerial (worldwide) - Version 4.353 (3DF Zephyr,https://www.3dflow.net/3df-zephyr-aerial-download-page/)重建拍摄场景的三维点云(图1b),主要包括以下步骤:导入一个甜菜根对应的多视角图像序列;软件自动从这组图像恢复其位置和方向;基于多视角立体成像技术提取密集且精确的三维点云;导出三维点云。三维重建过程相机定向预设类别选择近景,其他参数均为默认值。三维点云经过去噪、旋转、分离等系列处理后,量化甜菜根各表型参数值用于进一步的分类。

图1 基于多视角图像序列量化甜菜根的流程图

1.2.2 三维点云预处理

表型参数提取前需要先对三维点云进行预处理,主要包括点云去噪,将三维点云旋正及将甜菜根与桌面分割三部分。由于拍照时的复杂背景及拍照时手的抖动均会给点云数据带来噪点,故先在3DF Zephyr中手动去除噪点。拍摄时由于手机位置不固定,采用MATLAB读入的三维点云处于倾斜状态。提取表型参数前需要经过三维坐标位置变换,使甜菜根平行于平面,便于后期数据处理。在坐标系中,桌面是一个光滑平面,采用平面拟合提取桌面并计算桌面法线,进而推导出平面和平面的旋转变换矩阵T(方程1)和T(方程2)[15]。将三维点云栅格化为平面的深度图像,每个图像像素代表点云中0.02Í0.02网格的最大深度(值)。对深度图像二值化,利用霍夫变换检测桌边缘直线并计算直线与轴正方向的夹角θ。根据θ可以推导出平面的旋转矩阵T(方程3)。将倾斜的三维点云坐标值乘以变换矩阵T,T和T得到旋正后的甜菜根三维点云。分离桌面和甜菜根,基于桌面的固定长宽值进行比例换算,获得三维点云的实际坐标值。

(1)

(2)

(3)

式中θ为桌面与空间坐标系平面的夹角;θ为桌面与空间坐标系平面的夹角;θ为桌面边缘直线与空间坐标系轴正方向的夹角,θ、θ、θ单位均为(°)。

1.2.3 基于三维点云的甜菜根表型参数提取

本研究综合借鉴番茄[6]、马铃薯[16]、草莓[17-18]果实表型相关研究和甜菜专家的意见,基于预处理后的甜菜根三维点云提取了10个根表型参数,如表1所示。基本形态特征包括根长、最大直径MD、凸包体积、顶投影面积以及各层段对应的直径。其中:根长为根尾至根头之间的距离,即三维坐标系中最大值与最小值之差(如图2);最大直径MD为能包裹甜菜根最小圆柱体的直径(如图2);凸包体积为能包裹甜菜根最小多边体的体积(如图2);顶投影面积为根体在平面投影不规则形状的面积(如图2)。为量化甜菜根从根头至根尾的各层段直径,选择0.1 cm为步长进行层切,计算各层点的最大距离,记为这一层的甜菜根直径;找到最大直径在甜菜根体上的位置,距离根头的高度记为凸起高(如图2)。为细化对甜菜根形态的数字描述,基于基本形态特征参数建立复杂根表型参数紧凑度、凸起率、凸起角、根头比、根尾比、根体渐细指数[5,8]。

表1 甜菜根表型参数集

注:H为根长,cm;MD为最大直径,cm;S为顶投影面积,cm2;h为最大直径对应的高度,cm;W1为距根头5%高度的直径,cm;W2为距根头80%高度的直径,cm;以最大直径为分界线,W3为根下部平均直径,cm,W4为根上部平均直径,cm。

1.3 基于聚类分析的根型分类及统计分析

聚类分析采用-medoids算法,其工作流程是将所有表型参数的数据集标准化,确定聚类个数,在所有数据集中选择个聚族中心点,计算其余点到这个中心点的距离,并把每个点到个中心点最短的聚簇作为自己所属的聚簇。通过反复迭代计算,使得每个点都属于离他最近的聚类中心对应组且个中心点不再变化,最后确定最优聚类结果[19-21]。

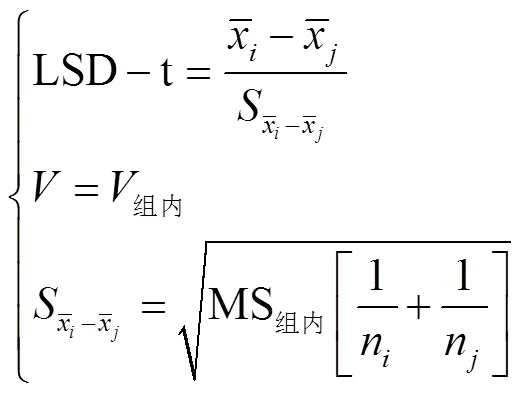

基于分类结果对表型参数采用LSD-t多重比较法检验两两组间的显著性差异,计算LSD-t值的计算公式(4)用字母标记法表示差异显著水平。

1.4 基于机器学习的甜菜根型分类

目前甜菜根型分类不明确,因此在本研究中甜菜专家基于视觉判别经验,结合聚类结果对各组离异值和临近值进行进一步的调整。据此,采用调整后的分组作为根型分类真值,采用线性判别分析、随机森林、支持向量机、决策树和朴素贝叶斯判别5种方法对甜菜根型进行分类建模与预测。以验证本试验提取的表型参数的可分性和聚类算法分类的实用性,并分析不同机器学习算法对复杂甜菜根样本分类效果[22]。各类算法基本原理如下:

线性判别分析通过将高维空间的样本投影到一维空间实现分类判断,其优势在于对训练样本分布、方差等均没有限制,分类能力强大[23]。决策树是一个树结构,每个非叶节点表示一个特征属性上的测试,每个分支代表特征属性的输出值,每个叶节点代表一个类别[9]。随机森林是一种基于分类回归树的机器学习算法,将多种决策树算法结合起来,相较于传统决策树方法,其优势在于同等运算率下具有更高的预测精度[24-25]。支持向量机是一种通用的前馈网络类型,其主要影响因素是核函数的选择和相应参数的设置[8,26]。朴素贝叶斯采用先验概率来描述样本特征,再用训练样本来修正先验概率得到后验概率从而进行统计推算[27-28]。

为了确定5种模型的最优训练样本数量,试验分别选取50、100、150、200个样本的10个表型参数进行训练,比较不同样本数量的模型预测准确率。结果表明线性判别分析、随机森林、支持向量机、决策树4种模型随着训练样本数增加,模型判别准确率提高,而朴素贝叶斯在150个样本数时判别准确率已达到最大78.0%。因此,线性判别分析、随机森林、支持向量机、决策树4种模型选用80%数据作为训练集,20%数据作为测试集,而朴素贝叶斯模型选用70%数据作为训练集,30%数据作为测试集。5种模型均采用十折交叉验证[9],将数据集分成10份,轮流将其中9份用于训练,1份用于验证。

基于上述机器学习系统参数优化过程获得5种模型最优训练测试数据集比例。根据模型输出的混淆矩阵中真正(TP)、真负(TN)、假正(FP)、假负(FN)的样本数量,利用公式(5)计算准确率(Accuracy)、召回率(Recall)和调和平均值1(Harmonic average1)作为模型预测性能的评价指标。

1.5 三维重建模型准确率评估

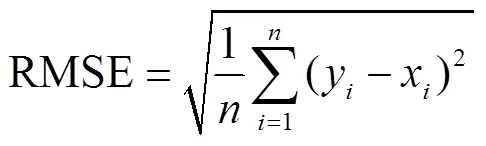

本文方差分析(ANOVA)、线性回归、聚类分析及判别分析均基于R语言完成。模型计算值和测量值的吻合程度采用均方根误差(Root Mean Square Error, RMSE)和决定系数(Coefficient of Determination,2)进行描述:

式中y和x分别为第个计算值和测量值;为样本个数。

2 结果与分析

2.1 甜菜根三维重建与精度验证

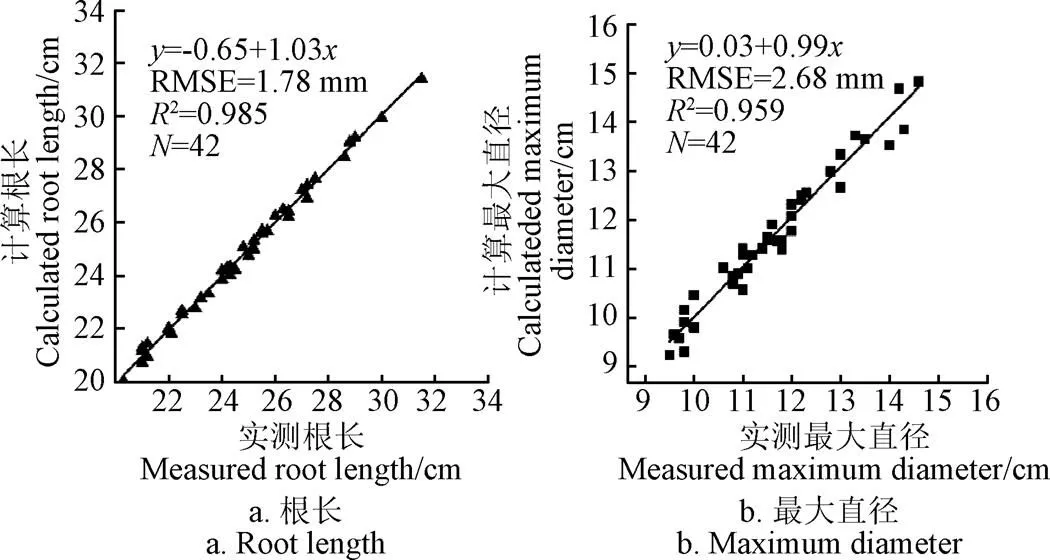

基于多视角图像序列重建的三维点云图包含甜菜根相应的颜色和纹理信息,具有较强的真实感。基于重建的三维点云可用来提取甜菜根的各种表型参数,甜菜根根长和最大直径计算值与测量值的比较如图3所示。基于甜菜根三维模型计算的根长和最大直径与实测值的决定系数2均大于0.95,RMSE分别为1.78和2.68 mm。对比结果表明此方法能够精确再现甜菜根的表型特征。

图3 甜菜根根长和最大直径计算值与实测值的比较

2.2 生产指标与表型参数相关分析

表2为3个生产指标和10个表型参数两两变量间的相关系数。最大直径、顶投影面积及凸包体积间有极显著相关性,相关系数均在0.90以上,表明三者间存在强共线性。凸起率与凸起角都是由凸起高计算得到,两者间为0.91,存在强共线性。最大直径、顶投影面积及凸包体积与生物量呈极显著正相关,均在0.85以上,与含糖率呈负相关,为0.21~0.24。该结果与Tsialtas[2]对最大直径与含糖率间相关关系的研究结论一致。生物量与含糖率间为0.25,结果与高妙真[29]提出的甜菜根在500 g以上时,其生物量与含糖率呈负相关的结论一致。含糖量由生物量和含糖率之积求得,其中生物量有更高数量级,与含糖量有极显著相关关系,达0.97。含糖量与投影面积、凸包体积及最大直径有正相关关系,均在0.80以上。

表2 表型参数与生产指标相关分析

注:***表示相关性极显著(<0.01), **表示相关性显著(<0.05)。

Note: *** means that the correlation is extremely significant (<0.01), ** means that the correlation is significant (<0.05)。

以上结果表明,在10个表型参数中,对甜菜根生产指标影响显著的表型参数依次为凸包体积、顶投影面积、最大直径、根长和凸起率,其他表型参数对生产指标影响均不显著。本试验数据存在共线性和数量级差异,故在聚类分析之前需进行主成分分析消除共线性,并对数据进行归一化。

2.3 甜菜根型聚类结果

传统甜菜根根型依靠人为观察根茎、根体上端和根体下端的宽窄来对根型进行分类。这种分类方法要求研究人员具有一定的甜菜专业知识,且分类标准不明确。本研究采用-medoids算法,基于计算的甜菜根表型数据[30-31]对甜菜根型进行识别与客观分类。图4为对207个基因型甜菜根的分类结果。图中由不同颜色和不同形状分别划分的4个多边形代表4个不同的分类组。多边形包围的数字是207个基因型甜菜根材料序号。由于部分甜菜根的表型特征差异较细微,故组与组之间存在少量重叠。这4组分别记为组1(圆锥形)、组2(锤形)、组3(楔形)、组4(长楔形),各组的成份数目依次为66、21、75、45。

在此分类结果基础上对各组间在表型参数上的差异显著性(<0.05)进行检验,采用字母标记法标注组间差异显著性强弱,结果如表3所示。在4组甜菜根中长楔形组4根最长,最大直径、凸包体积和顶投影面积均小于圆锥形组1,但显著(<0.05)大于锤形组2和楔形组3,紧凑度、凸起率、根尾比及根体渐细指数均显著(<0.05)小于其他组,表明长楔形组4属于根头宽大,根尾细小且根体从根头至根尾的缩小速率最快的根体。锤形组2根最短,紧凑度、根尾比和根体渐细指数均显著(<0.05)大于其他组,表明锤形组2根体是短小形且根头至根尾的缩小程度不大。楔形组3根长显著(<0.05)大于锤形组2而显著(<0.05)小于圆锥形组1,最大直径、凸包体积和投影面积是最小的,根头比显著(<0.05)高于其他组,且凸起率显著(<0.05)低于其它组,表明楔形组3最大直径接近根头处。圆锥形组1最大直径、凸包体积和顶投影面积最大而根头比最小,圆锥形组1属于根头宽度较小,最大直径位于根体中部,根体整个宽度的变化是先增加后减小的过程。

注:组代表分类序号,数目代表各组成份数。

表3 甜菜根组间表型差异的统计分析

注:同一参数不同小写字母表示在0.05水平差异显著。

Note: Different lowercase letters for the same parameter indicate significant differences at the level of 0.05.

从生产指标来看,圆锥形组1生物量和含糖量最大,显著高于锤形组2和楔形组3,而楔形组3含糖率最高且显著高于圆锥形组1。结合实际生产情况和甜菜专家育种知识及田间种植经验分析,锤形组2过于短小,生物量小,长楔形组4根长太长,机械化生产过程中易断。因此,圆锥形组1和楔形组3为甜菜理想根型,产糖量高,尺寸适宜,利于机械化收割。其中圆锥形组1更适合于内蒙古自治区北部生育期较短的地区,楔形组3更适于内蒙古自治区中西部地区,与文献[2-3, 32]结果一致。

根据聚类分析和统计分析结果,在4组中分别挑选2个有代表性的甜菜根进行展示,如图5。这8个根所在坐标系的刻度均为甜菜根的实际大小。

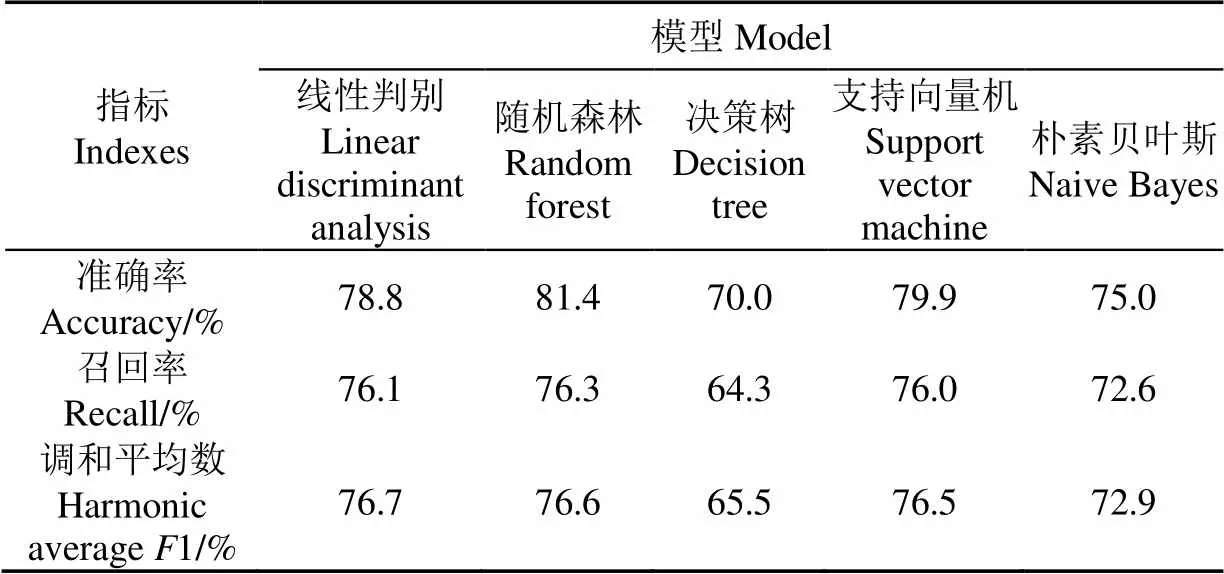

2.4 基于机器学习方法的甜菜根型判别

为快速准确地挑选高品质甜菜根,开发基于多视角图像序列的判别模型。本研究采用5种机器学习方法对甜菜根型的判别结果如表4所示。线性判别、随机森林和支持向量机3种判别模型精准确率、召回率和调和平均数均在75.0%以上,能够较好的用于甜菜根型判别预测。其中随机森林判别效果最佳,判别准确率为81.4%,决策树模型判别效果最差,判别准确率为70.0%,召回率和调和平均数分别为64.3%和65.5%。

图5 4组根型中典型甜菜根的三维点云图

表4 5种模型对甜菜根型的预测结果

决策树法在每个属性测试节点上都会产生分枝,由聚类分析图可以看出本试验数据存在较多离异值,故采用决策树算法判别准确率较低,而随机森林法能够将多种决策树算法结合起来,其基本思想是通过bootstrap 重采样的方法在原始训练集中抽取多个样本,对每个抽取出的样本均进行决策树建模,最后通过多数投票法得到最终的预测结果,有效避免了决策树采样算法的缺点从而提高了判别的准确率。机器学习过程中采用十折交叉验证方法选取每次循环的训练样本集,能够显著提高模型的准确率和普适性。

3 结 论

1)本文以207个基因型甜菜根为研究对象,采用手机获取甜菜根多视角图像序列并重建三维点云。

2)基于重建的三维点云提取了甜菜根根型的基本表型参数,包括根最大直径、根长、凸包体积、顶投影面积和各层段直径。在基本形态参数的基础上提出复杂表型参数,包含紧凑度、凸起率、凸起角、根头比、根尾比和根体渐细指数,其中根长、顶投影面积及凸包体积与生产指标有极显著(<0.01)相关性。

3)采用-medoids算法将根型划分为4组,结合专家知识及多年种植经验分析得出圆锥形和楔形甜菜根产糖量高、根型长度比例适中、适合机械化生产,为理想根型。

4)基于最适训练样本量,建立线性判别分析、随机森林、支持向量机、决策树和朴素贝叶斯5种根型判别模型,并进行准确率比较。随机森林分类效果最佳,判别准确率为81.4%;决策树分类效果最低,判别准确率为70.0%。该研究结果可用于基因型与表型的关联分析,为培育高品质和适应机械化生产的甜菜品种提供依据。

[1]Geng G, Yang J. Sugar beet production and industry in China[J]. Sugar Tech, 2015, 17(1): 13-21.

[2]Tsialtas J T, Maslaris N. Sugar beet root shape and its relation with yield and quality[J]. Sugar Tech, 2010, 12(1): 47-52.

[3]陈艺文,李用财,余凌羿,等. 中国三大主产区甜菜糖业发展分析[J]. 中国糖料,2017,39(4):74-76.

Chen Yiwen, Li Yongcai, Yu Lingyi, et al. Analysis on the development of sugar beet industry in three main producing areas in China[J]. Sugar Crops of China, 2017, 39(4): 74-76. (in Chinese with English abstract)

[4]Yang W N, Feng H, Zhang X H, et al. Crop phenomics and high-throughput phenotyping: Past decades, current challenges, and future perspectives[J]. Molecular Plant, 2020, 13(2): 187-214.

[5]Sankaran S, Khot L R, Espinoza C Z, et al. Low-altitude, high-resolution aerial imaging systems for row and field crop phenotyping: A review[J]. European Journal of Agronomy, 2015, 70: 112-123.

[6]Nankar A N, Tringovska I, Grozeva S, et al. Application of high-throughput phenotyping tool tomato analyzer to characterize balkan capsicum fruit diversity[J]. Scientia Horticulturae, 2020, 260: 108862-108874.

[7]Mohan V J, Gupta S, Thomas S, et al. Tomato fruits show wide phenomic diversity but fruit developmental genes show low genomic diversity[J]. Plos One, 2016, 11(4): e152907-e152931.

[8]Li M, An H, Angelovici R, et al. Topological data analysis as a morphometric method: Using persistent homology to demarcate a leaf morphospace[J]. Frontiers in Plant Science, 2018, 9: 553-567.

[9]吴正敏,曹成茂,王二锐,等. 基于形态特征参数的茶叶精选方法[J]. 农业工程学报,2019,35(11):315-321.

Wu Zhengmin, Cao Chengmao, Wang Errui, et al. Tea selection method based on morphology feature parameters[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(11): 315-321. (in Chinese with English abstract)

[10]孔彦龙,高晓阳,李红玲,等. 基于机器视觉的马铃薯质量和形状分选方法[J]. 农业工程学报,2012,28(17):143-148.

Kong Yanlong, Gao Xiaoyang, Li Hongling, et al. Potato grading method of mass and shapes based on machine vision[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2012, 28(17): 143-148. (in Chinese with English abstract)

[11]惠放,马韫韬,朱晋宇,等. 利用多视角图像法分析番茄幼苗根构型对氮水平的响应[J]. 植物营养与肥料学报,2016,22(5):1418-1424.

Hui Fang, Ma Yuntao, Zhu Jinyu, et al. Analysis of nitrogen effects on root system architecture of tomato seedlings using the multi-view images method[J]. Journal of Plant Nutrition and Fertilizer, 2016, 22(5): 1418-1424. (in Chinese with English abstract)

[12]Hui F, Zhu J Y, Hu P C, et al. Image-based dynamic quantification and high-accuracy 3D evaluation of canopy structure of plant populations[J]. Annals of Botany, 2018, 121(5): 1079-1088.

[13]Zhu B L, Liu F S, Xie Z W, et al. Quantification of light interception within image-based 3D reconstruction of sole and intercropped canopies over the entire growth season[J]. Annals of Botany, [2020-01-30], https://doi.org/10.1093/aob/ mcaa046.

[14]Mortensen A K, Bender A, Whelan B, et al. Segmentation of lettuce in coloured 3D point clouds for fresh weight estimation[J]. Computers and Electronics in Agriculture, 2018, 154: 373-381.

[15]Jiang Y, Li C Y, Takeda F, et al. 3D point cloud data to quantitatively characterize size and shape of shrub crops[J]. Hortic Res, 2019, 6(1): 1-17.

[16]Su Q H, Kondo N S, Li M Z, et al. Potato quality grading based on machine vision and 3D shape analysis[J]. Computers and Electronics in Agriculture, 2018, 152: 261-268.

[17]Oo L M, Aung N Z. A simple and efficient method for automatic strawberry shape and size estimation and classification[J]. Biosystems engineering, 2018, 170: 96-107.

[18]Xu L M, Zhao Y C. Automated strawberry grading system based on image processing[J]. Computers and Electronics in Agriculture, 2010, 71: S32-S39.

[19]Dhanachandra N, Manglem K, Chanu Y J. Image segmentation using K-means clustering algorithm and subtractive clustering algorithm[J]. Procedia Computer Science, 2015, 54: 764-771.

[20]Bhusare B B, Bansode S M. Centroids initialization for K-means clustering using improved pillar algorithm[J]. Int J Adv Res Comput Eng Technol (IJARCET), 2014, 3(4): 1317-1322.

[21]Yu D H, Liu G J, Guo M Z, et al. An improved K-medoids algorithm based on step increasing and optimizing medoids[J]. Expert Systems with Applications, 2018, 92: 464-473.

[22]Ozguven M M, Adem K. Automatic detection and classification of leaf spot disease in sugar beet using deep learning algorithms[J]. Physica A: Statistical Mechanics and its Applications, 2019, 535: 122537-122544.

[23]Gurubelli Y, Ramanathan M, Ponnusamy P. Fractional fuzzy 2DLDA approach for pomegranate fruit grade classification[J]. Computers and Electronics in Agriculture, 2019, 162: 95-105.

[24]Belgiu M, Drăguţ L. Random forest in remote sensing: A review of applications and future directions[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2016, 114: 24-31.

[25]竞霞,白宗璠,高媛,等. 利用随机森林法协同SIF和反射率光谱监测小麦条锈病[J]. 农业工程学报,2019,35(13):154-161.

Jing Xia, Bai Zongfan, Gao Yuan, et al. Wheat stripe rust monitoring by random forest algorithm combined with SIF and reflectance spectrum[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(13): 154-161. (in Chinese with English abstract)

[26]潘春华,肖德琴,林探宇,等. 基于SVM和区域生长结合算法的南方主要蔬菜害虫分类识别[J]. 农业工程学报,2018,34(8):192-199.

Pan Chunhua, Xiao Deqin, Lin Tanyu, et. Classification and recognition for major vegetable pests in Southern China using SVM and region growing algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2018, 34(8): 192-199. (in Chinese with English abstract)

[27]Atoui M A, Cohen A, Verron S, et al. A single Bayesian network classifier for monitoring with unknown classes[J]. Engineering Applications of Artificial Intelligence, 2019, 85: 681-690.

[28]翟治芬,徐哲,周新群. 基于朴素贝叶斯分类器的棉花盲椿象危害等级识别[J]. 农业工程学报,2015,31(1):204-211.

Zhai Zhifen, Xu Zhe, Zhou Xinqun. Recognition of hazard grade for cotton blind stinkbug based on Naïve Bayesian classifier[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2015, 31(1): 204-211. (in Chinese with English abstract)

[29]高妙真. 甜菜根重与含糖率相关关系的研究[J]. 中国甜菜,1995(1):16-19.

Gao Miaozhen. A study on the correlation between root weight and sugar content in sugar beet[J]. China Sugar beet, 1995(1): 16-19.(in Chinese with English abstract)

[30]Sun S P, Li C Y, Chee P W, et al. Three-dimensional photogrammetric mapping of cotton bolls in situ based on point cloud segmentation and clustering[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2020, 160: 195-207.

[31]Li M, Klein L L, Duncan K E, et al. Characterizing 3D inflorescence architecture in grapevine using X-ray imaging and advanced morphometrics: Implications for understanding cluster density[J]. Journal of Experimental Botany, 2019, 70(21): 6261-6276.

[32]Stevanato P, Chiodi C, Broccanello C, et al. Sustainability of the sugar beet crop[J]. Sugar Tech, 2019, 21(5): 703-716.

Extraction of phenotypic parameters and discrimination of beet root types based on 3D point cloud

Chai Honghong1, Shao Ke2, Yu Chao2, Shao Jinwang2, Wang Ruili2, Sui Yang2, Bai Kai3, Liu Yunling1, Ma Yuntao1※

(1,,,100193,; 2.010070,; 3.,021008,)

Sugar beet is one of the main crops for sugar production in the world, and originated from the western and southern coasts of Europe. Selecting and breeding of varieties of sugar beet based on plant phenotyping are the key factors for the development of sugar beet industry on a large-scale cultivation. In China, sugar beet was widely planted in arid and semi-arid regions, particularly for poverty alleviation of farmers living in border areas and ethnic minority areas. The type of beet root with great different genotypes directly determines the sugar yield and mechanization efficiency in modern agriculture. The traditional classification of beet root type depends mainly on manual separation, and thereby greatly limits industry production and breeding of the sugar beet due to heavy workload and relatively large errors. In order to meet the requirements of high-throughput analysis, a three-dimensional (3D) phenotyping technique with multi-view images was recently developed to facilitate the classification of fruit and vegetable with high accuracy and efficiency. In this study, the beet roots with 207 genotypes were selected as experimental materials. Multi-view images were obtained by moving mobile phone around beet root. Three-dimensional point clouds were reconstructed in 3DF Zephyr Aerial software, which can restore position and direction from a dataset of multi-views images to extract for the matching feature points between each pair of images. After the postprocessing of the matching images, including noise reduction, rotating and segment, the detailed features of beet root shape, color, and texture can be achieved in the 3D point cloud. Ten phenotypic parameters can be used to clarify the morphological characteristics of beet roots, the maximum diameter, root length, convex hull volume, top projection area, compactness, convex index, convex angle, distal root end ratio, proximal root end ratio and root taper index. There was a good agreement between the measured maximum diameter and root length, with coefficient of determinationR> 0.95. The-medoids clustering algorithm with high stability was selected to classify the beet root into four groups. Group 1, namely as cone beet root, indicates that the maximum root diameter located at the middle of the root body. Group 2, namely as hammer beet root, shows the shortest body of root, the smallest root head ration while larger root tail ration. Group 3, namely as wedge beet root, has the maximum diameter of root body close to the root head, whereas, the width of root from head to tail gradually decreased. Group 4, namely as long wedge beet root, has longer root body than that in group 3, wider root head and smaller root tail. The reduction rate of root body from head to tail was the greatest. Based on the combination of phenotypic traits and experts’ knowledge, Group 1 (cone beet root) and Group 3 (wedge beet root) were recommended due to their high sugar yield, medium root length and moderate proportion. After adjusting the categories by the experts as the true values, five prediction models were established to discriminate beet root type, including linear discrimination, random forest, support vector machine, decision tree, and naive Bayes. The results showed that the prediction accuracies of the five models were above 70.0%, where accuracy of random forest reached 81.4%. These results demonstrated that 3D point cloud reconstructed by multi-view image sequences can be used for the identification of beet root shape, and thereby to effectively improve the yield prediction of sugar beet and the selection of high-quality beet varieties. Since 207 genotypes have been selected for the classification of root types during this time, much more genotypes at different environments can be expected to enrich the 3D phenotyping library, and thereby further improve the accuracy of classification. This finding can provide a potential practical basis for the beet root type screening and breeding.

image procession; machine learning; three dimensional point cloud; beet; root type; phenotype; classification

柴宏红,邵科,于超,等. 基于三维点云的甜菜根表型参数提取与根型判别[J]. 农业工程学报,2020,36(10):181-188.doi:10.11975/j.issn.1002-6819.2020.10.022 http://www.tcsae.org

Chai Honghong, Shao Ke, Yu Chao, et al. Extraction of phenotypic parameters and discrimination of beet root types based on 3D point cloud[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(10): 181-188. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2020.10.022 http://www.tcsae.org

2020-02-15

2020-04-21

内蒙古自治区科技重大专项和科技成果重大转化项目

柴宏红,博士生,主要研究方向为作物三维表型研究。Email:honghong.chai@cau.edu.cn

马韫韬,副教授,博士生导师,主要研究方向为植物功能-结构-环境互作的模型研究。Email:yuntao.ma@cau.edu.cn

10.11975/j.issn.1002-6819.2020.10.022

TP391.4

A

1002-6819(2020)-10-0181-08