基于流行排序的轨道扣件定位方法研究

孙睿,陈兴杰,李立明,郑树彬

基于流行排序的轨道扣件定位方法研究

孙睿,陈兴杰,李立明,郑树彬

(上海工程技术大学 城市轨道学院,上海 201620)

针对利用图像处理技术在进行轨道扣件定位的过程中易受到拍摄条件及复杂背景干扰的难题,提出一种基于流行排序的轨道扣件定位方法。对轨道扣件图像进行超像素分割和基于图论的特征图构建;根据特征图节点基于背景尺度和前景尺度的相关性进行排序,得到前景突出且背景抑制的轨道扣件显著图,完成轨道扣件区域在图像中的的准确定位。引入准确率−召回率曲线、度量值和平均绝对误差作为评价扣件定位准确程度的指标。研究结果表明:本文方法对不同类型的轨道扣件图像均能进行精确的扣件定位,且与其它算法相比具有更好的定位效果、较高的效率和鲁棒性。

扣件定位;流行排序;图论;图像处理

轨道扣件定位是利用图像处理和机器视觉技术完成定位并分割出扣件区域子图像的过程。同时,为后续对扣件图像进行进一步的扣件特征描述、目标提取及状态检测做准备。因此,扣件定位算法的鲁棒性和准确性在轨道扣件检测领域中对扣件识别与定位的效率与精度有直接的影响。扣件定位方法的定位效果与其采用的图像分割和处理算法密不可分,通过扣件定位方法对相对复杂的轨道扣件图片进行处理:弱化包括钢轨、轨枕及地面等在内的“背景区域”,并将钢轨两边的扣件区域作为显著区域进行定位、突出和分离,最终得到轨道扣件的精确位置。常用的扣件定位方法有:边缘检测法[1−3]、十字交叉法[4−5]、像素统计法[6]、模板匹配法[7−8]等。上述的几种扣件定位方法虽然可以取得不错的定位效果,但在实际的工程应用中容易受到光照和复杂场景对轨道扣件图片处理的干扰。为了获得更好的图像处理效果和提高扣件定位的精确度,LIU等[9]利用灰度投影与十字交叉法相结合的方法确定扣件的粗略位置,并结合图像的灰度特征和梯度特征对扣线图像进行特征提取。代先星等[10]通过利用三维激光检验技术抑制了不均匀光照因素对扣件图像的干扰,同时结合图像处理技术对三维的扣件区域进行定位。还有学者提出基于图论的图像处理算法对扣件区域进行定位;戴鹏等[11]通过将图论与快速定位技术相结合对轨道扣件区域进行定位。为避免扣件定位对检测算法的影响,部分学者还选择了人工提取扣件区域的方法开展研究[12]。除此之外,还有一些算法也在轨道扣件定位领域也取得了不错的效果,例如:从频域和信号的角度对图像进行处理、和基于深度学习的图像处理算法等。随着扣件定位问题越来越受到研究人员的广泛关注,相关定位方法得到不断的优化和完善的同时,还具有一定的局限性;此外,在实际的轨道扣件定位领域,对于扣件定位效果的精确程度也缺乏统一的定量描述和评价标准。本文针对在实际工程项目中对轨道扣件进行精确定位方法的局限性,提出一种基于将轨道扣件图像转换为无向图结构,并分别从图结构中的边界和中心节点的角度对图像节点进行流行排序,最终得到扣件准确位置的轨道扣件定位方法,使得该算法可以减小光照和复杂场景对待处理图像的干扰,进一步提升了轨道扣件定位的精度和鲁棒性。另外,本文通过引入准确率−召回率曲线、度量值和平均绝对误差作为评价扣件定位准确程度的指标,对扣件定位的效果进行定性描述和评价。本文提出的基于流行排序的轨道扣件定位方法如图(1)所示:

图1 基于流行排序的轨道扣件定位方法流程图

1 基于图论的流行排序算法

基于图论的排序问题的描述如下:首先将图像中的一个像素点标记为问询点,其余像素点按照其与问询点的相关性进行排序[13]。排序算法的目标是为了通过定义一个排序函数,能够较好的体现已定义问询点和其他未标记像素点之间的相关关系。

ZHOU等[14]提出一种基于图像像素点之间的相关性进行流行排序的算法,对图像的数据结构进行标记排序:

其中参数的作用为控制式(1)中平滑和拟合约束条件的相关关系和平衡,使得排序参数在相邻像素节点间取值的变化平缓,并与初始问询节点的参数赋值相近(满足拟合约束条件)。排序结果函数可写为:

其中:参数=1/(1+),经试验验证该流行排序算法有较好的试验效果。

基于图论的流行排序算法将输入图像中的像素点标记为一些特定的问询节点,并将每个节点的排序参数值经由式(2)计算得出;然后在给定问询节点的前提下,利用标准化的排序参数值对图像的前景和背景节点显著性进行度量和区分,从而可以将目标区域从背景区域中分割、提取出来,最终实现较好的实验结果。

2 构造轨道扣件无向图

本文提出的基于流行排序的轨道扣件定位方法:首先通过将采集到的轨道扣件图片利用SISC(Simple Linear Iterative Clustering)算法进行超像素分割。然后,将超像素节点作为所构建无向图的节点;将连接相邻超像素节点的线段作为无向图的边。最后,对构建的结构图节点进行进一步的流行排序,得到最终的轨道扣件显著图,从而提取到轨道扣件所在位置的显著区域,完成轨道扣件的定位。

2.1 超像素分割

其中式(5)中,和分别为像素点在颜色和空间尺度的最大值。

如图2所示,图2(a)为待处理的原始轨道扣件图像;图2(b)为图2(a)经超像素聚类后的分类情况;图2(c)为轨道扣件图像经超像素分割后的聚类结果。分割结果表明:在本文介绍方法中,SISC算法可以将轨道扣件图像像素点分类;同时能抑制或忽略一些图像在拍摄和采集过程中产生的噪声干扰:如复杂背景,不均匀光照等等。

2.2 构造无向图结构

本文使用的轨道扣件定位方法是在上述超像素特征图的基础上构建一个单层无向图=(,),再通过流行排序算法计算得出超像素之间的相关关系并重新排序。其中图结构中的节点由SISC算法对原图像进行聚类划分得到超像素构成;边为连接相邻2个超像素节点的无向边;其权重为:

其中:c和c分别表示超像素节点r和r在CIELAB颜色空间中的平均值;为定值,用于调节无向图中边的权重。

(a) 扣件图像;(b) 分类情况;(c) 聚类结果

图2 基于SISC算法的轨道扣件超像素特征图

Fig. 2 Super-pixel characteristic map of track fasteners based on SISC algorithms

图3 轨道扣件无向图模型示意图

如图3所示,所构建的图形结构中的中心问询点不仅和与其相邻的节点相连,并且还与相邻节点共用同一边界的节点相连。此外,对于构建的图结构中4条边上的边界节点均两两相连,共同构成一个闭合环形图。通过这种方式可以对感兴趣的前景扣件区域进行更好的突出,并对背景区域进行抑制。通过对构造图中的节点进行流行排序,可以最终得到前景突出且背景抑制的轨道扣件显著图,进而可以对轨道扣件图片中的扣件区域完成准确 定位。

3 轨道扣件定位算法

本文针对轨道扣件图像构建的单层无向图结构,对图结构的节点进行基于背景尺度和前景尺度的2个阶段的重新排序,得到最终的轨道扣件显著图,确定扣件区域在图像中的准确位置,完成扣件定位。

3.1 基于背景尺度的节点排序

本文通过将轨道扣件图像分割成超像素,构造一个以图像超像素为节点的单层无向图,然后分别将图4条边上的边界节点标记为问询点,并计算其他节点与边界问询点的相关系数,根据其之间的相关性进行流行排序,得到4个方向上的背景特征图,将4个特征图进行融合得到背景显著图。

如图3所示,基于图的左边界进行处理:首先,将图左边界上的各边界节点标记为问询点,图中的其他节点为未标记节点,定义一个标记向量。然后,根据式(2)计算得到图中的所有节点相关排序系数*并进行排序,将计算结果储存在一个维的向量中(为图结构中的节点数量),则基于图像背景的左边界的流行排序结果为:

式中:为图中的超像素节点;*为归一化后的排序向量。

同样,分别将图的右侧、上侧和下侧上的边界节点标记为问询点,然后计算其各自基于其图像背景边界的流行排序结果:right(),top()和down()。最后,将计算得到的4个方向尺度上的背景特征图融合,得到可以对感兴趣区域进行有效突出的背景显著图,特征图融合的数学表示为:

如图4所示:图4(a)为输入的轨道扣件图像,将输入图像进行超像素分割并构造图结构后,对构造图的边界节点进行基于背景尺度的流行排序,分别得到图4中所示的左4(b),右4(c),上4(d)和下4(e) 4个方向尺度的排序图。将上述排序图进行融合,得到扣件背景特征图,如图4(f)所示。由图4所示可以看出:图结构节点通过基于背景尺度的节点排序后,轨道扣件中的扣件区域得到显著的突出,虽然有一些背景节点没能受到较好的抑制,但是已经可以对图像中的扣件部位进行较为精确的定位,可以得到较为不错的扣件定位效果。

(a) 扣件图像;(b) 左排序;(c) 右排序;(d) 上排序;(e) 下排序;(f) 扣件背景特征图

图4 基于背景尺度的边界节点排序特征图

Fig. 4 Ranking characteristic map of boundary nodes based on background scale

3.2 基于前景尺度的节点排序

为了获得更好的扣件定位效果,对轨道扣件图像的背景区域有更好的抑制作用。本文方法进一步对得到的扣件背景显著图通过二值化和自适应阈值分割将图像中的扣件区域与背景分离,得到扣件前景特征图。

对上述得到的扣件前景显著图,进行基于前景尺度的节点排序:将显著图的中心图节点设为问询点,定义标记向量并根据式(2)计算节点的相关系数*,对其进行归一化处理后,得到基于图像前景的流行排序结果为

其中:为图中的超像素节点;*为归一化后的排序向量。

如图5所示:图5(a)为基于背景尺度的扣件节点排序特征图;图5(b)对图5(a)进行阈值分割后的二值化扣件前景显著图;图5(c)为基于前景尺度的扣件节点排序特征图,即为最后的轨道扣件定位显著图。从图5(c)中可以看出:最终的定位显著图相比于图5(a)来说,对图像中的扣件区域有了更加明显的突出,并对图像背景有了更加有效的抑制。在实际的轨道扣件定位领域中,本算法除了能对轨道扣件区域进行准确的定位之外,还能对扣件上的六角螺栓和快速弹条的位置进行定位和进一步检测。

(a) 背景扣件节点排序;(b) 前景显著图;(c) 前景扣件节点排序

此外,如图5(c)所示,本算法还能对所采集图像中的钢轨位置进行定位,进一步地,能根据图像中钢轨边界和钢轨两侧扣件的相对位置,对轨道扣件的状态进行检测,判断扣件是否处于扣紧状态。综上,本文在实际工程应用过程中,能对轨道扣件区域进行准确的定位,并能在其他的轨道图像检测领域取得很好的效果。

4 实验结果

本文提出的基于流行排序的轨道扣件定位算法,应用于实际的工程应用领域,对在轨道沿线的实际现场所采集的轨道扣件图像进行扣件的准确定位。本文算法分别对通过工业线阵相机采集的不同场景下的不同型号的轨道扣件图像(共500幅)进行处理和轨道扣件定位。

4.1 实验参数设置

经实验验证,为取得最优的实验结果,本文算法在进行轨道扣件定位的过程中,相关计算公式及算法所设置的参数如下:设置对输入图像进行SLIC算法分割得到的超像素的数量为200个;在流行算法排序计算过程中,将式(6)中用来控制节点之间边的权重的参数的值设为0.15;将式(2)中的参数设为0.99。

4.2 实验定性评价

图6示出了在不同场景下不同类型的轨道扣件图像通过本算法所取得的最终图像定位结果。其中图6(a)为输入的3种类型的轨道扣件原始图像;图6(b)为基于背景尺度的扣件节点排序特征图;图6(c)为图6(b)进行归一化和阈值分割后得到的扣件前景显著图;图6(d)为基于前景尺度节点排序的扣件特征图,即最后的轨道扣件定位显著图。

(a) 原始图像;(b) 背景扣件排序;(c) 前景显著图;(d) 前景扣件特征

如图6(d)所示,本算法可以对输入的原始图像中的轨道扣件区域进行准确的突出和定位,同时可以对图像中复杂的背景区域进行有效的抑制。此外,本算法在对扣件定位的同时,还可以有效的检测到扣件所在钢轨的位置,根据钢轨边界和轨道扣件的相对位置,可以进一步判断轨道扣件是否处于扣紧钢轨状态,可以对扣件的状态进行检测。综上,本文方法可以在实际的轨道扣件定位过程中,可以准确的对轨道扣件区域进行标定与提取,完成轨道扣件的精准定位,并且可以进行深入研究和广泛应用于其他检测领域。

4.3 实验定量评价

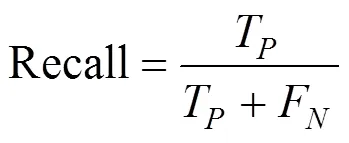

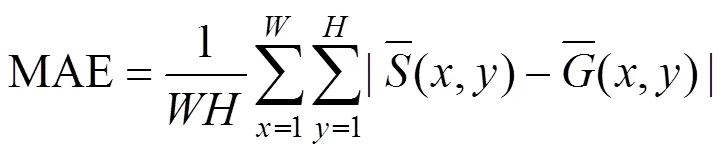

在实际的轨道扣件定位领域中,对通过各种扣件定位方法所获得的轨道区域定位结果还没有一种统一的评价标准,往往很难从定量角度对定位方法进行评价与对比。所以本文通过引入视觉注意机制中的评价参数:准确率(Precision)-召回率(Recall)曲线、度量值(F-measure)、平均绝对误差(MAE)作为评价扣件定位准确程度的指标,用于定性评价定位结果的精确程度。

本文提出首先对输入的轨道扣件图像中的准确扣件区域进行人工标定,从而得到原图像的真值图像;然后,将通过轨道定位方法获得的扣件显著图进行阈值选取为0到255的二值化处理,通过计算每一阈值条件下扣件显著图与真值图的样本数据;最后,计算得出定位结果的准确率−召回率曲线、度量值和平均绝对误差。其中,准确率(Precision)表示扣件显著图中扣件定位正确的区域对显著图中全部的扣件区域比值,召回率(Recall)表示扣件显著图中扣件定位正确的区域对人工标定的真值图中正确的轨道扣件区域的比值;度量值(-measure)是对最终得到的定位结果进行评价的综合指标;平均绝对误差(MAE)用来度量定位结果相对于真值图像的定位误差。

其具体计算式如下:

其中:在式(10)和式(11)中,T表示人工标定真值图像中的被正确定位到的轨道扣件区域样本;F表示扣件显著图定位到的扣件区域样本;F表示人工标定真值图像中未被定位到的轨道扣件区域样本;式(12)中,2的值为0.3;式(13)中的和用来表示输入待处理轨道扣件图像的长度和宽度。

本文将300幅3种不同型号的原始轨道扣件图像构建为3个轨道扣件数据集,其中每个数据集包含100幅原始轨道扣件图像;对数据集图像中的轨道扣件准确位置进行人工标定,得到对应的轨道扣件真值图。然后,对3个数据集通过本文方法进行扣件定位,其结果与真值图进行比较计算,对本文方法基于3种不同类型扣件的定位效果进行评价。

图7示出了3种不同类型的轨道扣件图像数据集通过本文算法后得到的定位精确度的对比结果。实验结果表明:本文方法对不同类型的轨道扣件图像均能进行对扣件区域的准确定位,且定位结果的误差较小,可以完成对多种类型轨道扣件区域的定位。

(a) Precision recall curves; (b) F-measure; (c) MAE

另外,针对本文构建的轨道扣件数据集,将采用本文方法得到的扣件定位结果与其他几种经典目标显著性检测算法对轨道扣件的定位效果比较。其中包括:CA[16],COV[17],SS[18],GR[19],SR[20],SeR[21]和SIM[22]算法;在图8中的代表序号依次记为2-8。如图8所示,通过本文方法得到的轨道扣件定位区域比其他几种算法的定位效果的更精确,且定位结果的平均绝对误差均比其他方法小,说明本文方法能对轨道扣件进行更加精确地定定位。

(a) Precision recall curves; (b) F-measure; (c) MAE

5 结论

1) 提出一种基于流行排序的轨道扣件定位方法,通过将采集到的原始图像构造为无向图结构,在构造图基础上对图节点进行基于背景和前景尺度流行排序算法,最终得到定位到扣件准确局域的扣件显著图,完成扣件的精确定位。

2) 以3种不同型号的轨道扣件图像建立一个标准的轨道扣件图像数据集,通过本文所述方法对轨道扣件区域进行定位均可取得较好的定位效果,说明本文所述方法具有较强的适用性。

3) 通过引入视觉注意机制中的评价参数:准确率−召回率曲线、度量值等作为轨道扣件领域中对扣件区域定位效果统一的定量评价标准;同时将本文方法的定位效果与其他方法进行比较,证明了本文方法能够获得准确的定位效果的同时、还具有较高的效率和鲁棒性。

[1] WANG Mingyu, ZHANG Xinfeng. A detection algorithm of ballast track fastener loss based on shooting direction[C]// 2016 9th International Congress on Image and Signal Processing, BioMedical Engineering and Informatics (CISP-BMEI), October 15-17, 2016. Datong, China. New York, USA: IEEE, 2016.

[2] FENG Hao, JIANG Zhiguo, XIE Fengying, et al. Automatic fastener classification and defect detection in vision-based railway inspection systems[J]. IEEE Transactions on Instrumentation and Measurement, 2014, 63(4): 877−888.

[3] XIA Y, XIE F, JIANG Z. Broken railway fastener detection based on adaboost algorithm[C]// International Conference on Optoelectronics & Image Processing. IEEE, 2010: 313−316.

[4] 吴禄慎, 万超, 陈华伟, 等. 一种改进的十字交叉轨道扣件定位方法[J]. 铁道标准设计, 2016(12): 49−53. WU Lushen, WAN Chao, CHEN Huawei, et al. An improved cross rail fastener positioning method[J]. Railway Standard Design, 2016(12): 49−53.

[5] 杨樊, 陈建政, 吴梦. 一种基于计算机视觉的铁轨扣件缺失检测方法[J]. 电脑知识与技术, 2014, 10(10): 2367−2370. YANG Fan, CHEN Jianzheng, WU Meng. A fastening missing detecting technique based on computer vision[J]. Computer Knowledge and Technology, 2014, 10(10): 2367−2370.

[6] Aytekin C, Rezaeitabar Y, Dogru S, et al. Railway fastener inspection by real-time machine vision[J]. IEEE Transactions on Systems Man & Cybernetics Systems, 2015, 45(7): 1101−1107.

[7] Mo Y H, Lim J W, Park J M, et al. Robust detection system of a bolt hole using template matching and feature based matching[C]// 2011 11th International Conference on Control, Automation and Systems. IEEE, 2011: 1718−1719.

[8] YUAN Xiaocui, LIU Baolin, CHEN Huawei. Algorithm and program design for fastener locating and detection using wavelet transformation and template matching[C]// 2017 IEEE 17th International Conference on Communication Technology (ICCT), October 27−30, 2017. Chengdu. New York, USA: IEEE, 2017.

[9] LIU X, WANG H, ZHOU B. Research on detection algorithm for rail fastener based on computer vision[C]// 2018 International Conference on Mechanical, Electronic, Control and Automation Engineering (MECAE 2018). Atlantis Press, 2018: 647−652.

[10] 代先星, 阳恩慧, 丁世海, 等. 基于三维图像的铁路扣件缺陷自动识别算法[J]. 铁道学报, 2017, 39(10): 89− 96. DAI Xianxing, YANG Enhui, DING Shihai, et al. Automatic defect inspection algorithm of railway fasteners based on 3D images[J]. Journal of the China Railway Society, 2017, 39(10): 89−96.

[11] 戴鹏, 王胜春, 杜馨瑜, 等. 基于半监督深度学习的无砟轨道扣件缺陷图像识别方法[J]. 中国铁道科学, 2018, 39(4): 43−49. DAI Peng, WANG Shengchun, DU Xinyu, et al. Image recognition method for the fastener defect of ballastless track based on semi-supervised deep learning[J]. China Railway Science, 2018, 39(4): 43−49.

[12] Malar R, Jayalakshmy S. Detection of cracks and missing fasteners in railway lines using structure topic model[J]. International Journal of Innovative Science, Engineering & Technology, 2015, 2(10): 369−375.

[13] YANG C, ZHANG L, LU H, et al. Saliency detection via graph-based manifold ranking[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2013: 3166−3173.

[14] ZHOU D, Weston J, Gretton A, et al. Learning to traverse image manifolds[C]// Advances in Neural Information Processing Systems 19. Massachusetts, USA: The MIT Press, 2007.

[15] Achanta R, Shaji A, Smith K, et al. SLIC superpixels compared to state-of-the-art superpixel methods[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(11): 2274−2282.

[16] Goferman S, Zelnik-Manor L, Tal A. Context-aware saliency detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(10): 1915− 1926.

[17] Erdem E, Erdem A. Visual saliency estimation by nonlinearly integrating features using region covariances[J]. Journal of Vision, 2013, 13(4): 11.

[18] HOU Xiaodi, Jonathan Harel, Christof Koch. Image signature: Highlighting sparse salient regions[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(1): 194−201.DOI:10.1109/TPAMI. 2011.146.

[19] YANG C, ZHANG L, LU H. Graph-regularized saliency detection with convex-hull-based center prior[J]. IEEE Signal Processing Letters, 2013, 20(7): 637−640.

[20] HOU Xiaodi, ZHANG Liqing. Saliency detection: A spectral residual approach[C]// 2007 IEEE Conference on Computer Vision and Pattern Recognition, June 17−22, 2007. Minneapolis, MN, USA. New York, USA: IEEE, 2007.

[21] Seo H J, Milanfar P. Nonparametric bottom-up saliency detection by self-resemblance[C]// 2009 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops, June 20−25, 2009. Miami, FL. New York, USA: IEEE, 2009.

[22] Saliency estimation using a non-parametric low-level vision model[C]// CVPR 2011, IEEE, 2011: 433−440.

Research on location method of track fasteners based on manifold sorting

SUN Rui, CHEN Xingjie, LI Liming, ZHENG Shubin

(Shanghai University of Engineering Science College of Urban Rail Transit, Shanghai 201620, China)

The problem was studied that image processing technology is easy to be disturbed by photographic conditions and complex background conditions in the process of track fastener positioning. In this paper, a method of track fastener location based on popular sorting was proposed. First, the image of track fastener was segmented by super-pixels and the feature map based on graph theory was constructed. Then, according to the correlation between background scale and foreground scale, the feature map nodes were sorted. Finally, the salient map of track fastener with prominent foreground and restrained background was obtained, and the accurate location of track fastener area in the image was completed; In addition, the Precision-Recall curve,-measure and Mean Absolute Error (MAE) were introduced as indices to evaluate the accuracy of fastener positioning. The experimental results show that the proposed method can accurately locate the track fastener images collected in different scenarios, resulting in better positioning effect, higher efficiency and robustness than other algorithms.

fastener positioning; manifold ranking; graph theory; image processing

TP391

A

1672 − 7029(2020)02 − 0288 − 09

10.19713/j.cnki.43−1423/u.T20190429

2019−05−17

国家自然科学基金资助项目(51975347);上海市地方院校能力建设资助项目(18030501300)

陈兴杰(1975−),男,江苏南通人,副教授,从事信号检测与图像处理方向的研究;E−mail:zcycchen@sina.cn

(编辑 蒋学东)