基于深度学习的电器目标检测

陈从平,李游,徐道猛,邓扬,何枝蔚

基于深度学习的电器目标检测

陈从平1,2,李游1,徐道猛1,邓扬1,何枝蔚1

(1.三峡大学机械与动力学院,湖北 宜昌 443002;2.常州大学 机械工程学院,江苏 常州 213164)

针对传统目标检测算法无法自适应提取目标相应特征并完成识别的现象,提出一种基于快速区域卷积神经网络(Faster R-CNN)模型的电器识别方法,其优势在于可以自适应获取不同场景下目标的特征,避免由于人为设计目标的特征而带来的主观因素影响,具有良好的鲁棒性与准确性。Faster R-CNN中首先通过建立区域建议网络RPN(Region Proposal Network)代替Fast R-CNN中的Selective Search方法,得到建议位置后再进行检测。为了解决训练过程当中正负样本失衡问题,在Faster R-CNN中引入了难负样本挖掘策略,增强了模型的判别能力,提高检测的精度。

目标检测;识别;深度学习;神经网络

随着电器更新速度的加快,常见废旧电器如洗衣机、冰箱等进行拆解处理后回收利用,不仅可以降低污染,还可以提高经济效益。因此,开展废旧电器整机自动化识别方法的研究具有重要的意义[1]。目前废旧电器主要是通过纯人工拆解或者流水线人工拆解,存在占地大、成本高、人员需求量大等缺点。为提高工作效率、降低成本,拟设计一条针对常见废旧电器的综合拆解线,并制定好各自的拆解工艺,当拆解线上料时,系统自动识别拆解线上来料电器的类型,自动选择相应的拆解工艺,实现一线多用、降低设备重复建设和减少人员数量的效果,提高效率并降低成本。

为实现以上自动识别的功能,本文提出一种基于Faster R-CNN[2-4]的深度学习电器识别方法。相对于传统目标检测方法如帧差法、光流法、背景减除法[5-6]这几类,基于深度学习[7]的目标检测识别方法具有学习效率高、识别速度快且识别精确度高等特点。基于Faster R-CNN算法对电器目标图像进行了目标检测识别,并在Faster R-CNN的训练中加入难负样本挖掘策略,提高检测的精度。

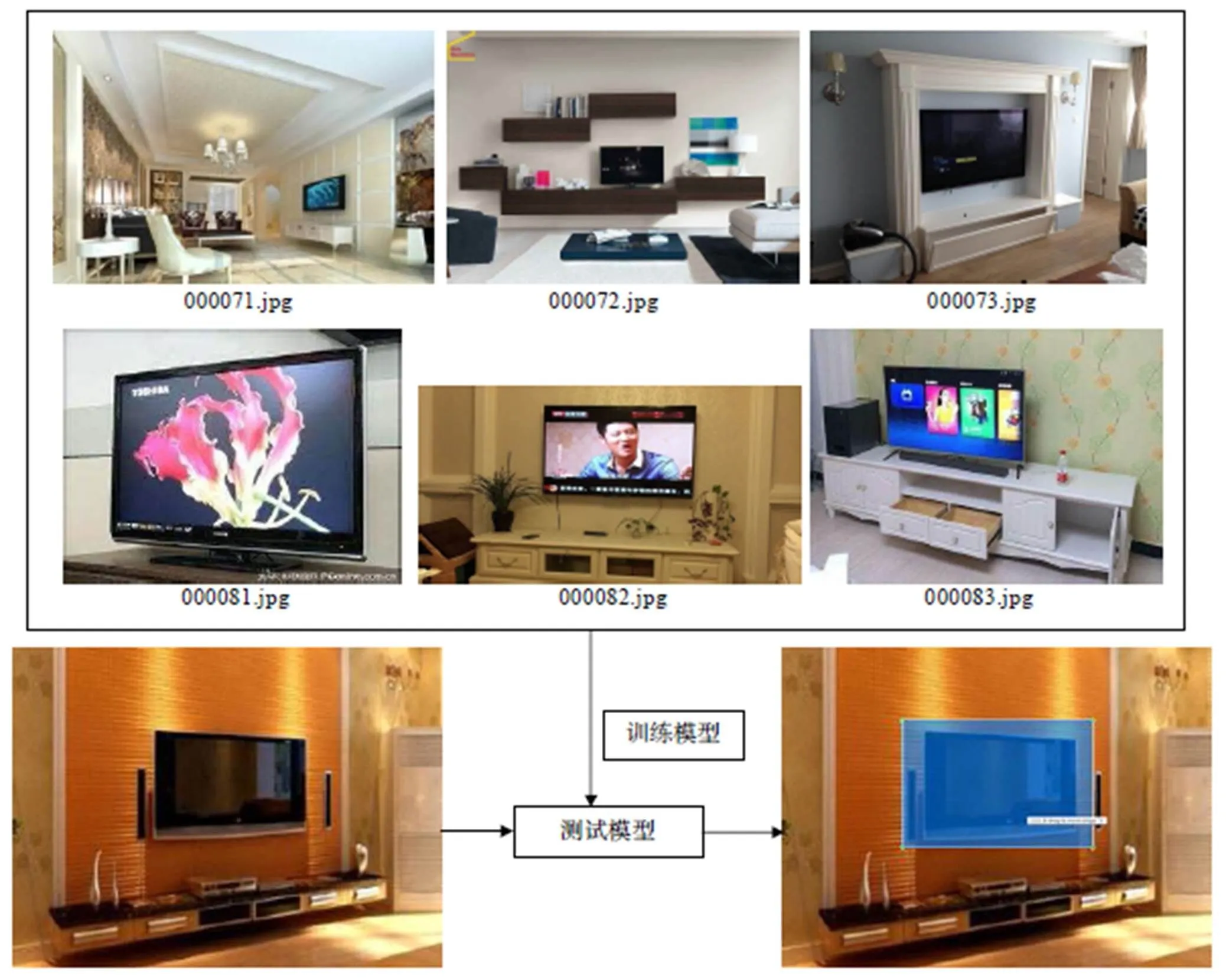

本文提出的方法大体思路如下,首先通过学习大量的电器(主要为电视机、冰箱、空调、电扇以及洗衣机五类)图像训练集,训练获得一个识别准确率高的检测模型,然后将电器图像测试集输入到该模型,得到可能的结果。如图1所示。

图1 识别流程

1 数据集的收集与制作

1.1 图片收集

本文主相关数据集为常见电器的图片。在实验中,自建电器数据集中共有800幅图像,包含五类电器,每类大约160幅,获取方式主要包括个人拍摄或者网上搜索,图2为部分电器数据集图片。

1.2 数据集的标定

本文数据集参照VOC2007格式制作[8]。在收集好原始样本图片之后,首先将图片格式统一为jpg,图片名称统一命名为6位长度的数字;然后进行图像中目标的标定,即在含有目标的图像中人工将目标的外接矩形框标定出来,记录目标的位置以及类别,以xml文件的形式保存下来,xml文件中包含标定目标外接矩形框的所属种类、外接矩形框的左下角坐标、右上角坐标

图2 采集的部分样本

2 Faster R-CNN

2.1 Faster R-CNN算法流程

经过R-CNN(Region Convolutional Neural Network,区域卷积神经网络)和Fast R-CNN的积淀,Faster R-CNN将生成候选区域、特征提取分类等统一到一个框架中,所有计算均没有重复,完全在GPU中完成,大大提高了检测速度[9]。Faster R-CNN可以看成“区域建议网络(RPN)+Fast R-CNN”的融合,用RPN代替Fast R-CNN中的Selective Search方法[10]。经过多次的迭代训练之后,RPN网络和Fast R-CNN网络可以很好地融合[11]在一起构成一个统一的网络。本文提出基于Faster R-CNN的电器目标检测识别方法,流程如图3所示。

图3 算法流程

在训练过程中,由于训练样本库不是特别大,为避免产生过拟合现象,采用迁移学习的思想对网络进行预训练。将已学习好的模型参数迁移到新的模型中,来帮助新的模型进行训练,利用在其他大的数据集中预训练的模型参数中进行网络初始化,然后使用自制的数据集去进行微调。本文中的Faster R-CNN基于在ImageNet预训练的模型参数进行初始化,具体训练步骤如下:

(1)用ImageNet已预训练的网络参数进行初始化,训练RPN网络;

(2)用预训练好的网络对Fast R-CNN进行初始化,并用上一步中的RPN网络提取候选区域,训练Fast R-CNN网络;

(3)用训练好的Fast R-CNN网络重新初始化RPN的网络参数,保持Fast R-CNN网络和RPN网络中的共享卷积层不变,单独训练RPN网络特有的部分;

(4)用上一步训练后的RPN网络初始化Fast R-CNN网络参数,单独微调Fast R-CNN网络特有的那一部分。

2.2 RPN(区域建议网络)

Faster R-CNN中选择候选区域时,使用了RPN网络,对于低于阈值的候选区域删除,避免了特征提取和学习阶段过多的重复阶段,降低了计算复杂度。RPN输出的是一组候选目标框,这些目标框对应输入电器图像的可能位置。主要流程为首先输入一张图片,经过一系列卷积、池化的操作后得到一个特征图,将这个特征图输入到RPN网络中后,该网络会对图像中的每个位置提供9个可能的候选窗口,包含3种面积(128×128、256×256、515×512)和3种比例(1:1、1:2、2:1),这九个窗口即为anchors,如图4所示。

图4 Anchor选取方式示意图

选择3×3卷积核对候选窗口的特征图进行卷积操作,输出的每个特征向量将会分别输入到cls layer全连接层和reg layer全连接层中,其中cls layer层用于判定该proposal是前景还是背景;reg layer层预测proposal的中心锚点对应的proposal的坐标、和宽、高、,如图5所示。在RPN训练过程中,将候选区域与真实区域的重叠度作为标准,通过非极大值抑制的方法来消除多余的候选窗口,最终每张图片获得300个候选区域以及和候选区域有关的四个值(候选区域的左上角和右下角坐标)。

图5 区域特征卷积过程图

RPN损失函数的计算如下。

本文给出下列样本的标定规则:

(1)将候选区域与真实区域的最大交并比IoU(Intersection over Union)大于0.7时对应的anchor标记为正样本;

(2)将最大交并比IoU小于0.3时对应的anchor标记为负样本[12]。

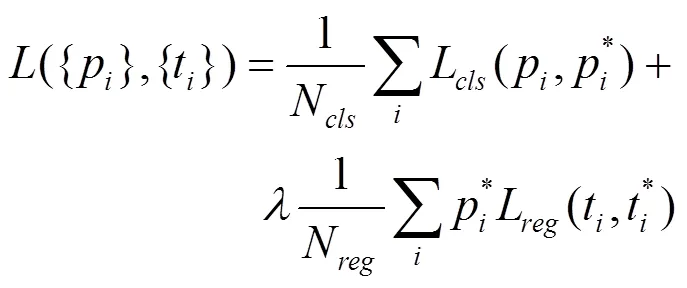

损失函数定义为:

式中:为候选框的索引;p为当候选框为目标时的概率,如果候选框为正样本,对应的真实区域标签p=1,否则p=0;t为预测区域框的4个参数化坐标,t为真实区域框的坐标向量;N和N为归一化参数,在实验中分别为256和2400;为平衡因子,在实验中设为10。

2.3 Faster R-CNN模型的改进

为了使Faster R-CNN网络模型能更好地应用于电器目标检测识别中,本文在训练过程中加入了难负样本挖掘策略来增强模型的性能。Faster R-CNN模型在进行训练时,如果目标区域占整张图的比例过小,正、负样本之间会产生失衡,负样本的空间会过大,从而可能导致将所有样本分为负样本,造成难以收敛的情况。原始Faster R-CNN中mini-batch设置为2,会产生128个候选区域,然后输入到后面的网络中进行分类检测。在实际情况中,产生的候选区域超过128个,这些候选区域从RPN产生的所有候选区域中随机选择。由于是随机挑选,可能会挑选到无效的负样本,对模型的性能产生影响。Shrivastava等[13]提出的难负样本挖掘策略可有效解决训练过程中正负样本失衡的问题。

本文在实验训练中加入难负样本挖掘策略,训练无检测目标的负样本集,并收集检测到的矩形框,用这个错误分类的负样本形成一个难负样本集,最后将该难负样本集加入到训练集中去重新训练模型[14]。将最后输出得分高于0.7且与任意真实区域包围盒的IoU值小于0.5的候选框作为难负样本。通过引入本文提出的难负样本挖掘策略可以增强模型的判别能力和鲁棒性,提高检测的精度。

3 实验与结果分析

实验环境为Ubuntu16.04系统,用python编程语言在Tensorflow深度学习框架中搭建Faster R-CNN模型,本文提出基于Faster R-CNN的常用电器目标检测方法,对于原始的Faster R-CNN来说,加入了难负样本挖掘策略。选择了VGG16[15]网络,VGG16网络相对于ZFNet[16]和LeNet[17]而言,拥有更深的网络层,更有助于提取检测的显著特征,得到更好的检测效果。

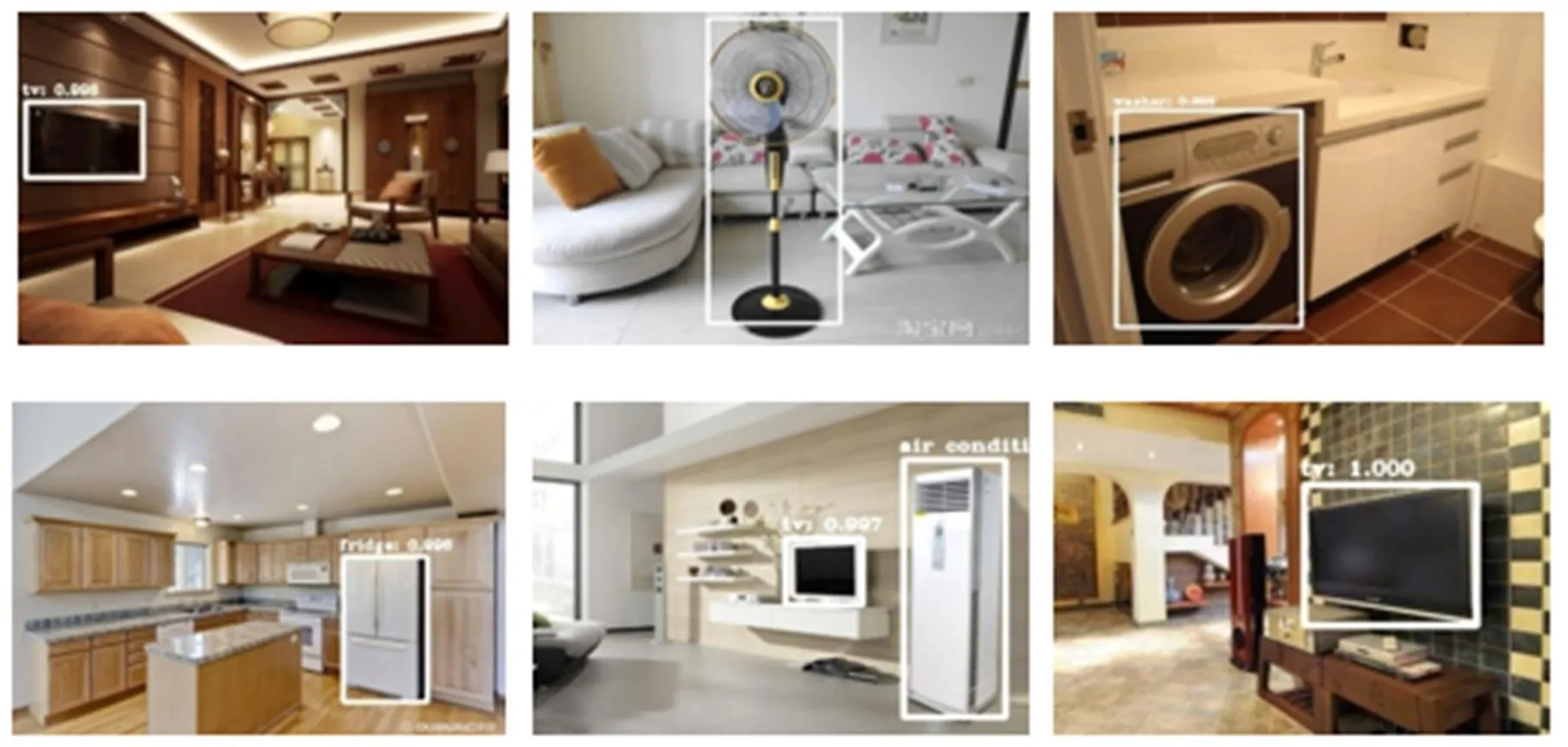

实验中在设置迭代次数为20 000次,并在config.py文件中修改相应参数,进行多次实验。五类电器的图像中,每类电器的训练图像为160幅,并随机抽取30%的图像作为测试图像,最终得到的部分预测图像如图6所示。

图6 部分预测图像

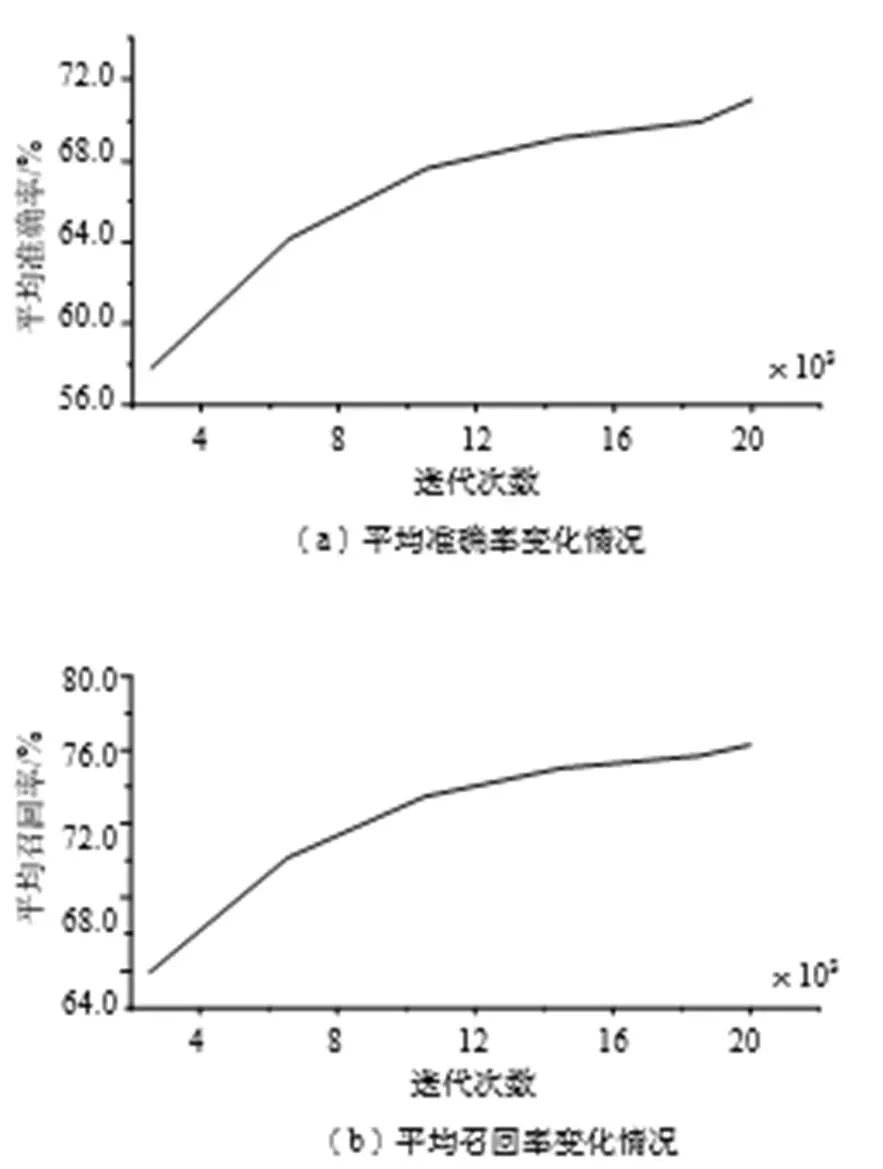

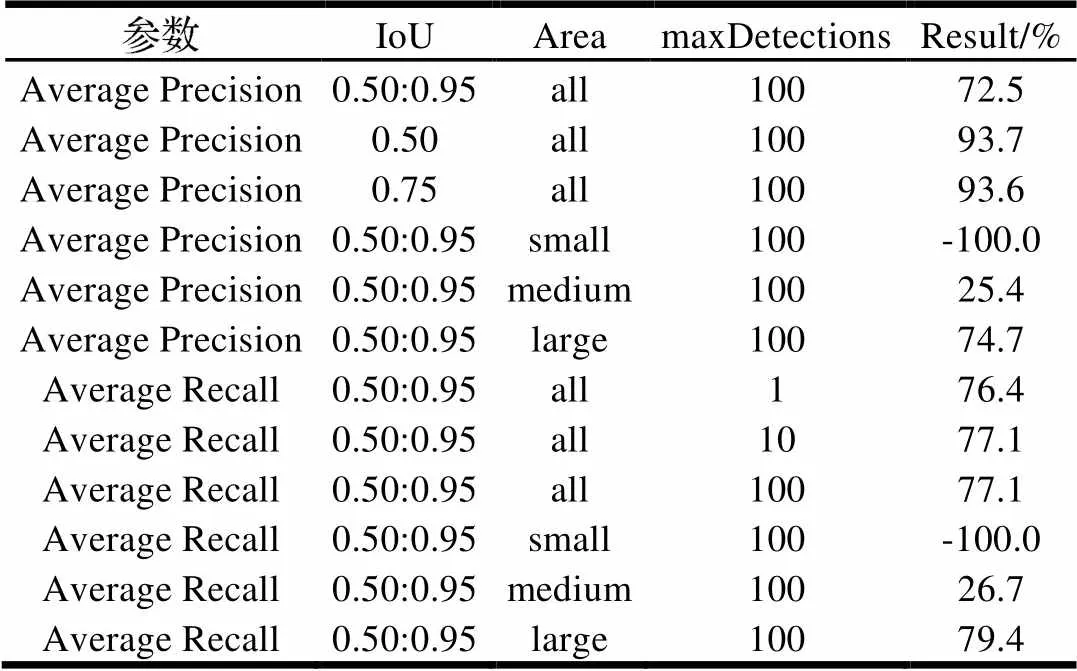

模型训练结果如图7、表1所示。

表1中,IoU是指真实区域框与预测框的最大交并比,其中0.50:0.95是指取0.50~0.95之间的十个IoU值(步距为0.05)所对应的平均准确率的平均值;Area是指不同大小的目标;maxDetections是指允许网络生成最大目标框建议个数。

通过表1可知,当取IoU值0.50~0.95中十个值的平均值时,平均准确率能达到72.5%,当降低标准,IoU值取0.50和0.75时,平均准确率可以分别达到93.7%和93.6%。由于检测目标电器的外接矩形框均为大面积目标,因此无法评估小面积目标的检测效果,故表中Area值为small时,平均准确率与平均召回率均为-100.0%。本文制作的数据集中,每张图片上检测目标固定且数量不多,因此当maxDetections从100降到10时,平均召回率没有改变,均为77.1%,说明如果减少目标框建议个数,对检测的准确率来说并无很大影响,所以可考虑通过减少模型中目标框建议个数来提高检测速率。

图7 平均准确率、平均召回率随迭代次数变化的情况

表1 模型训练结果

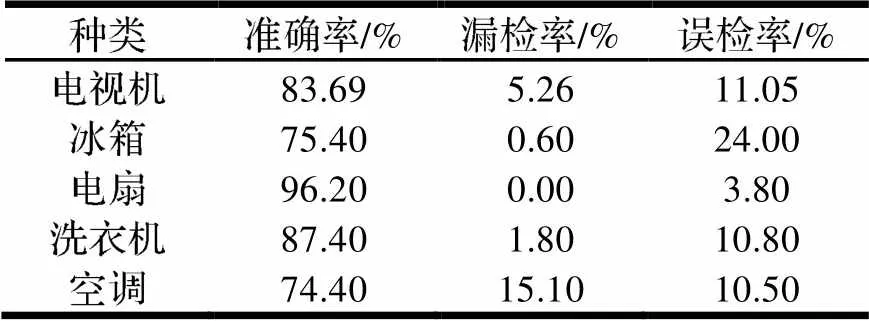

每一类电器的检测结果如表2所示。

表2中的漏检率是指在目标图像中没有识别出检测目标的概率,而误检率则是指错把其他物体识别成检测目标的概率。由表2可知,电扇、洗衣机识别的准确率最高,漏检率最大的是空调,误检率最高的是冰箱。

表2 检测结果

图8为误检情况的展示。

图8 误检情况

图8(a)中的误检是因为电视机与相框在大小、外观轮廓等方面比较相似,因此模型的预测错误;在图8(b)中误将洗衣机旁边的柜子识别成了冰箱,其原因在于柜子与冰箱的外形构造比较类似,产生误检情况。

漏检的原因在于拍摄时角度、光线等原因,对图像质量造成一定影响,使得在检测过程中无法对检测目标进行准确识别;通过检测结果与分析,本文将漏检原因主要归纳为了四个方面,如图9所示。

4 结语

本文提出基于Faster R-CNN的电器目标检测识别方法,对常用的五种电器进行了检测识别。首先自制五类电器数据集,然后输入数据集通过卷积神经网络提取特征,并使用RPN网络生成区域建议,区域网络与目标检测网络共享卷积特征,从而大大缩小了选择候选区域的时间,提升了检测效率。同时本文在训练过程中加入了难负样本挖掘策略,在一定程度上加强了模型的鲁棒性。通过学习研究,本文所用的网络模型在常用电器的检测中有较高的识别准确率。本文的实验中,自制的数据集样本量不够大,对检测结果会有影响;制作数据集时,使用相关软件进行人工标注也可能会对检测结果产生一定影响,后续研究中可通过扩大样本库等方法来进一步提高准确率。

[1]郭汉丁,张印贤,郭伟,等. 废旧电器回收再生利用产业链价格协同机理研究[J]. 生态经济,2013(2):110-112.

[2]Girshick R,Donahue J,Darrell T,et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]. Proceedings of the IEEE conference on computer vision and pattern recognition,2014.

[3]Girshick R. Fast R-CNN[C]. Proceedings of the IEEE conference on computer vision and pattern recognition,2015:1440-1448.

[4]Ren S,He K,Girshick R,et al. Faster R-CNN:Towards Real-Time Object Detection with Region Proposal Networks[C]. International conference on neural information processing systems,2015:1137-1149.

[5]张玲,陈丽敏,何伟,等. 基于视频的改进帧差法在车流量检测中的应用[J]. 重庆大学学报(自然科学版),2004(5):31-33,73.

[6]李超,熊璋,赫阳,等. 基于帧间差的区域光流分析及其应用[J]. 计算机工程与应用,2005(31):199-201,226.

[7]LeCun Y,Boser B E,Denker JS,et al. Handwritten digit recognition with a back-propagation network[C]. Advances in neural information processing systems,1989.

[8]张书洲. 基于深度学习的Logo检测与识别技术研究[D]. 成都:电子科技大学,2018.

[9]乐国庆. 基于车载视觉系统的目标检测优化算法研究[D]. 北京:北京交通大学,2017.

[10]邹雷. 基于深度学习的车辆重识别方法[D]. 武汉:华中科技大学,2017.

[11]Tao Kong,Anbang Yao,Yurong Chen,Fuchun Sun. HyperNet: Towards Accurate Region Proposal Generation and Joint Object Detection[C]. Proceedings of the IEEE conference on computer vision and pattern recognition,2016.

[12]项阳. 基于深度学习的无人机影像车辆提取[D]. 赣州:江西理工大学,2018.

[13]Shrivastava A, Gupta A, Girshick R. Training region-based object detectors with online hard example mining[C]. Proc of IEEE Conference on Computer Vision and Pattern Recognition,2016:761-769.

[14]王林. Faster R-CNN模型在车辆检测中的应用[J]. 计算机应用,2018,38(3):666-670.

[15]Li Jianjun,Peng Kangjian,Chang Chinchen. An Efficient Object Detection Algorithm Based on Compressed Networks [J]. Symmetry,2018,10(7): 235.

[16]Zeiler M D,Fergus R. Visualizing and understanding convolutional networks [C]. Proc of European conference on Computer Vision,Cham:Springer International Publishing AG,2014:818-833.

[17]Haykin S,Kosko B. Gradient based learning applied to document recognition [J]. Proceedings of the IEEE,1998,86(11):2278-2324.

Electrical Target Detection Based on Deep learning

CHEN Congping1,2,LI You1,XU Daomeng1,DENG Yang1,HE Zhiwei1

( 1.College of Mechanical & Power Engineering, China Three Gorges University, Yichang 443002, China; 2.School of Mechanical Engineering, Changzhou University, Changzhou 213164,China )

Aiming at solving the problem that the traditional target detection algorithm cannot adaptively extract the corresponding features of the target, this paper proposes an electrical detection method based on Faster Region Convolutional Neural Network (Faster R-CNN) model. The advantage of the target detection and recognition method based on deep learning is that it can adaptively acquire the features of the target in different scenarios, avoiding the influence of subjective factors due to the characteristics of the artificial design target. This method has good robustness and accuracy. The method used in this paper establishes the Regional Proposal Network (RPN) to replace the selective search method in the original Fast R-CNN, which can obtains the recommended location before detecting it. In order to solve the problem of positive and negative sample imbalance during training, this paper introduces a hard example mining strategy in Faster R-CNN, which enhances the discriminative ability of the model and improves the accuracy of detection.

target detection;identify;deep learning;the neural network

TP183;V448.25+1

A

10.3969/j.issn.1006-0316.2020.01.001

1006-0316 (2020) 01-0001-08

2019-08-26

国家重点研发计划课题(2018YFC1903101,废线路板器件智能拆解和分选技术研究与示范);国家自然科学基金项目(51475266,流体微挤出/堆积制备组织工程支架过程形态调控机理研究)

陈从平(1976-),男,湖北荆州人,博士,教授,主要研究方向为机器视觉、深度学习、3D打印及机电系统控制。